Kursus

Seperti yang kami bahas dalam artikel Memulai dengan MLOps, MLOps dibangun di atas fundamental DevOps, yaitu strategi pengembangan perangkat lunak untuk menulis, menyebarkan, dan menjalankan aplikasi enterprise secara efisien.

Ini adalah pendekatan untuk mengelola proyek machine learning dalam skala besar. MLOps meningkatkan kolaborasi antara tim pengembangan, operasional, dan data science. Hasilnya, Anda mendapatkan penyebaran model yang lebih cepat, produktivitas tim yang teroptimasi, penurunan risiko dan biaya, serta pemantauan model berkelanjutan di produksi.

Pelajari mengapa MLOps penting dan masalah apa yang ingin diselesaikannya dengan membaca blog kami Masa Lalu, Masa Kini, dan Masa Depan MLOps.

Dalam postingan ini, kita akan mempelajari alat MLOps terbaik untuk pengembangan, penyebaran, dan pemantauan model guna menstandarkan, menyederhanakan, dan memperlancar ekosistem machine learning. Untuk pengantar menyeluruh tentang Fundamental MLOps, lihat Skill Track kami.

Kerangka Large Language Models (LLMs)

Dengan hadirnya GPT-4 dan kemudian GPT-4o, dimulailah perlombaan untuk menghasilkan large language models dan mewujudkan potensi penuh AI modern. LLM membutuhkan basis data vektor dan kerangka integrasi untuk membangun aplikasi AI yang cerdas.

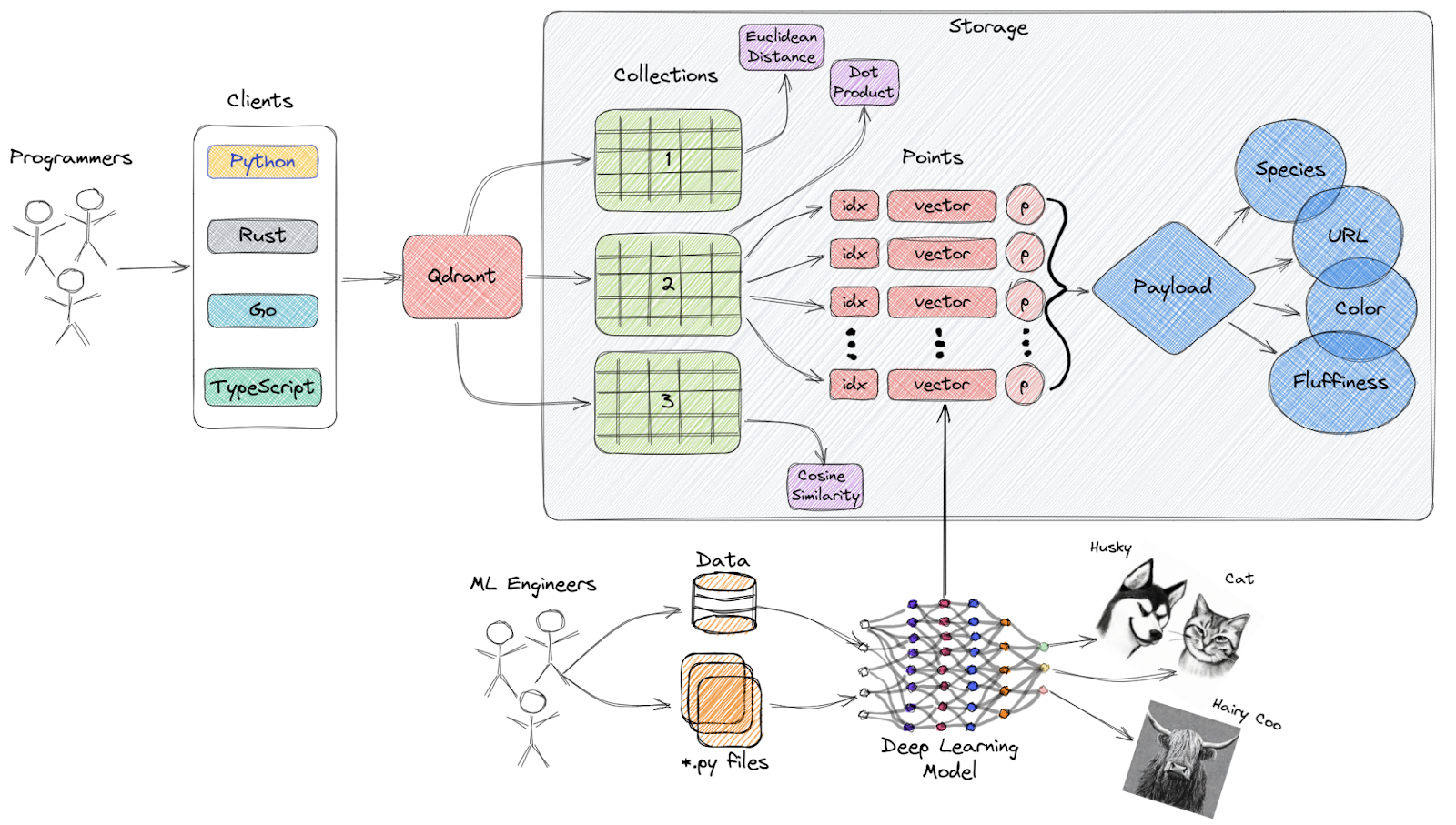

1. Qdrant

Qdrant adalah mesin pencarian kemiripan vektor open-source dan basis data vektor yang menyediakan layanan siap produksi dengan API yang mudah, memungkinkan Anda menyimpan, mencari, dan mengelola embedding vektor.

Gambaran Tingkat Tinggi Arsitektur Qdrant

Fitur utama:

- API yang mudah digunakan: Menyediakan API Python yang mudah digunakan dan juga memungkinkan pengembang membuat library klien dalam berbagai bahasa pemrograman.

- Cepat dan akurat: Menggunakan modifikasi kustom unik dari algoritma HNSW untuk Approximate Nearest Neighbor Search, memberikan kecepatan pencarian mutakhir tanpa mengorbankan akurasi.

- Tipe data yang kaya: Qdrant mendukung beragam tipe data dan kondisi kueri, termasuk pencocokan string, rentang numerik, lokasi geografis, dan lainnya.

- Terdistribusi: Bersifat cloud-native dan dapat diskalakan secara horizontal, memungkinkan pengembang menggunakan sumber daya komputasi yang tepat untuk jumlah data berapa pun yang perlu dilayani.

- Efisien: Qdrant dikembangkan sepenuhnya dalam Rust, bahasa yang dikenal akan performa dan efisiensi sumber dayanya.

Jelajahi basis data vektor teratas dengan membaca 5 Basis Data Vektor Terbaik | Daftar dengan Contoh.

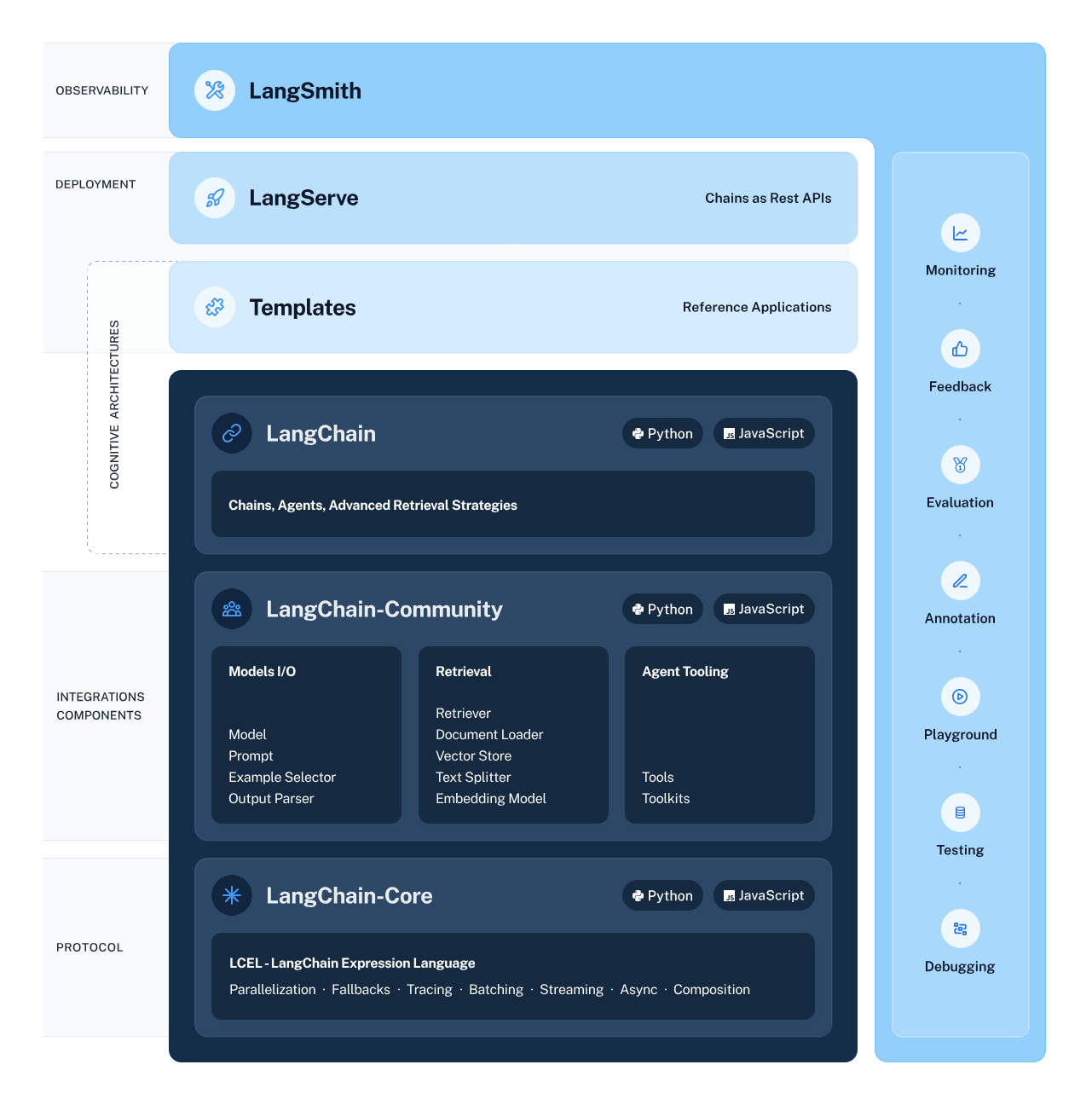

2. LangChain

LangChain adalah kerangka serbaguna dan kuat untuk mengembangkan aplikasi yang didukung oleh model bahasa. Kerangka ini menawarkan beberapa komponen agar pengembang dapat membangun, menyebarkan, dan memantau aplikasi yang peka konteks dan berbasis penalaran.

Kerangka ini terdiri dari 4 komponen utama:

- Library LangChain: Library Python dan JavaScript yang menawarkan antarmuka dan integrasi untuk mengembangkan aplikasi penalaran yang peka konteks.

- Template LangChain: Kumpulan arsitektur referensi yang mudah disebarkan ini mencakup beragam tugas, menyediakan solusi siap pakai bagi pengembang.

- LangServe: Library yang memungkinkan pengembang menyebarkan rantai LangChain sebagai REST API.

- LangSmith: Platform yang memungkinkan Anda melakukan debug, uji, evaluasi, dan memantau rantai yang dibangun pada kerangka LLM mana pun.

Ekosistem LangChain

Pelajari Cara Membangun Aplikasi LLM dengan LangChain dan jelajahi potensi besar large language models.

Alat Pelacakan Eksperimen dan Manajemen Metadata Model

Alat-alat ini memungkinkan Anda mengelola metadata model dan membantu pelacakan eksperimen:

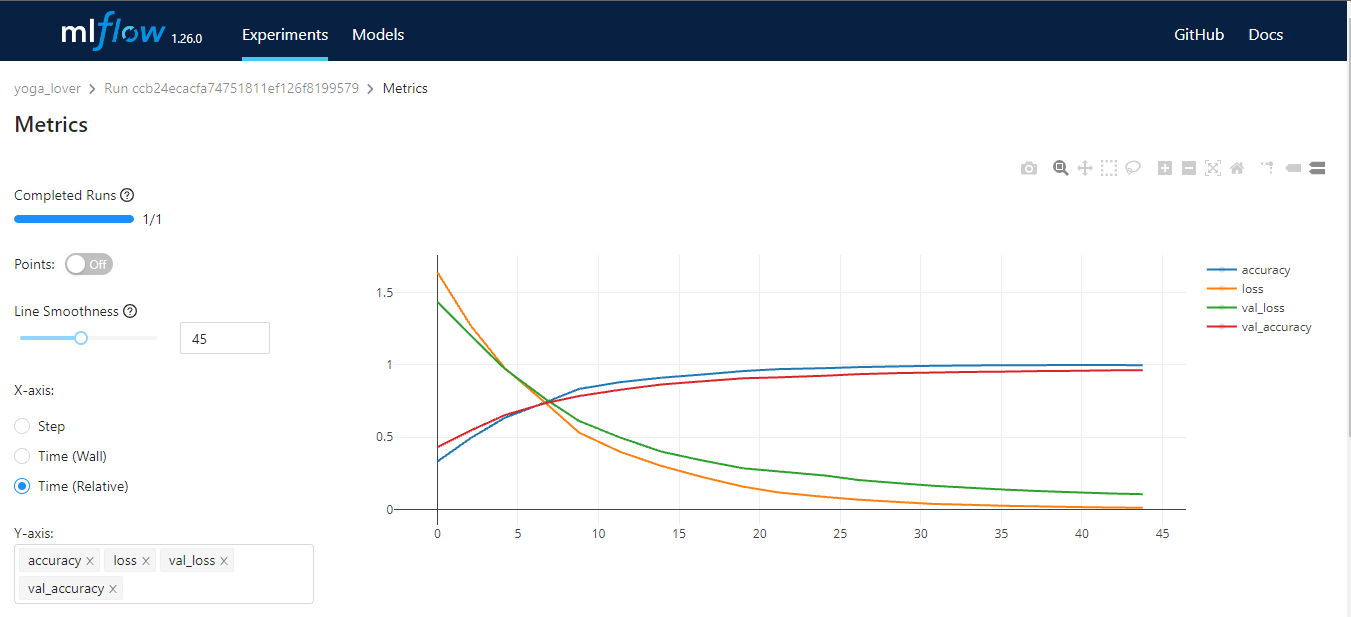

3. MLFlow

MLflow adalah alat open-source yang membantu Anda mengelola bagian inti dari siklus hidup machine learning. Umumnya digunakan untuk pelacakan eksperimen, tetapi Anda juga dapat menggunakannya untuk reprodusibilitas, penyebaran, dan registry model. Anda dapat mengelola eksperimen machine learning dan metadata model menggunakan CLI, Python, R, Java, dan REST API.

MLflow memiliki empat fungsi inti:

- MLflow tracking: menyimpan dan mengakses kode, data, konfigurasi, dan hasil.

- MLflow projects: mengemas sumber data science untuk reprodusibilitas.

- MLflow models: menyebarkan dan mengelola model machine learning ke berbagai lingkungan serving.

- MLflow model registry: penyimpanan model terpusat yang menyediakan versi, transisi tahap, anotasi, dan pengelolaan model machine learning.

Gambar oleh Penulis

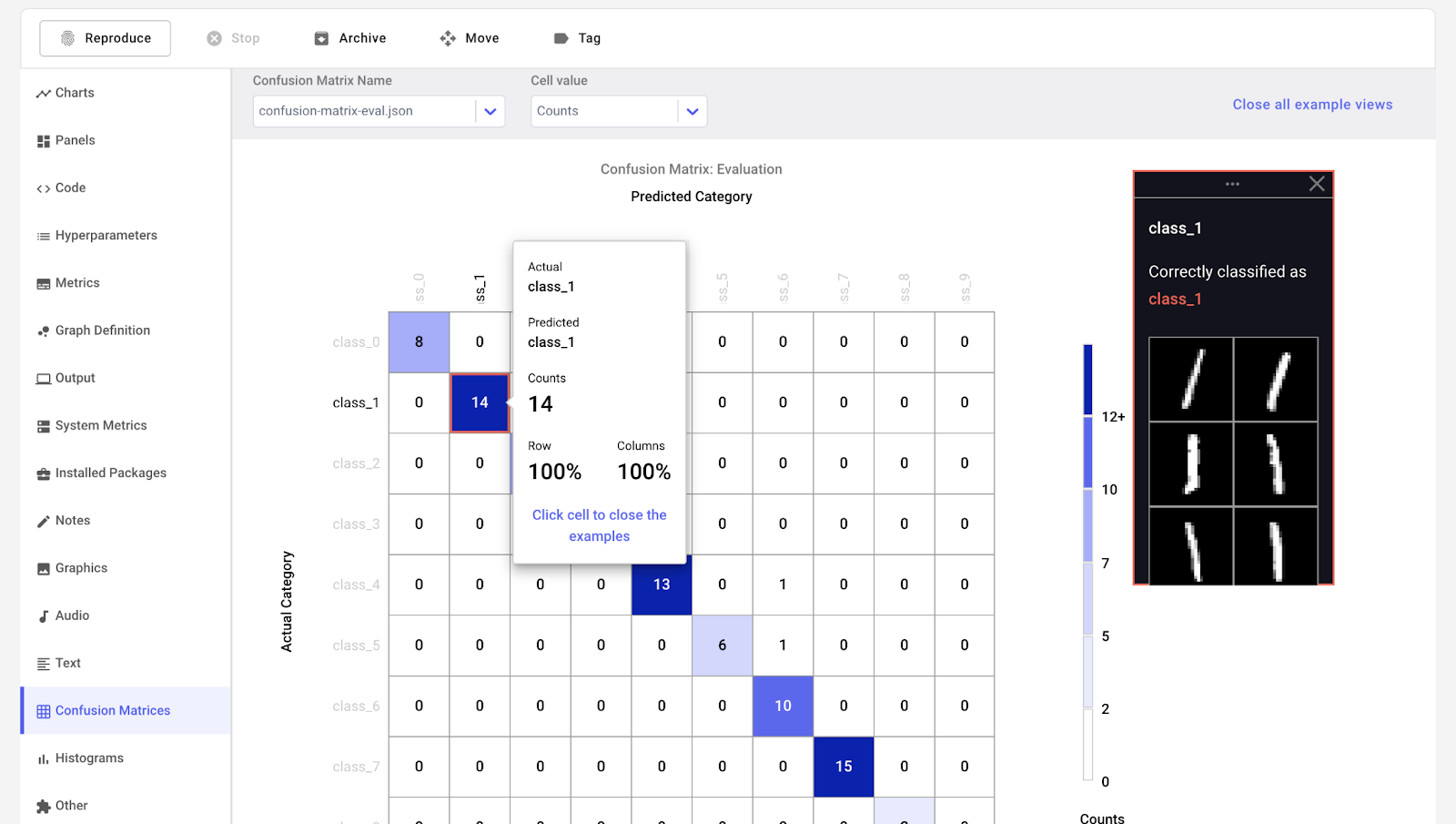

4. Comet ML

Comet ML adalah platform untuk melacak, membandingkan, menjelaskan, dan mengoptimalkan model dan eksperimen machine learning. Anda dapat menggunakannya dengan library machine learning apa pun, seperti Scikit-learn, Pytorch, TensorFlow, dan HuggingFace.

Comet ML ditujukan untuk individu, tim, enterprise, dan akademisi. Platform ini memungkinkan siapa pun memvisualisasikan dan membandingkan eksperimen dengan mudah. Selain itu, Anda dapat memvisualisasikan sampel dari data gambar, audio, teks, dan tabular.

Gambar dari Comet ML

5. Weights & Biases

Weights & Biases adalah platform ML untuk pelacakan eksperimen, versi data dan model, optimasi hyperparameter, dan manajemen model. Selain itu, Anda dapat menggunakannya untuk mencatat artefak (dataset, model, dependensi, pipeline, dan hasil) serta memvisualisasikan dataset (audio, visual, teks, dan tabular).

Weights & Biases memiliki dasbor terpusat yang ramah pengguna untuk eksperimen machine learning. Seperti Comet ML, alat ini dapat diintegrasikan dengan library machine learning lain, seperti Fastai, Keras, PyTorch, Hugging face, Yolov5, Spacy, dan banyak lagi. Anda dapat melihat pengantar Weights & BIases kami dalam artikel terpisah.

Gif dari Weights & Biases

Catatan: Anda juga dapat menggunakan TensorBoard, Pachyderm, DagsHub, dan DVC Studio untuk pelacakan eksperimen dan manajemen metadata ML.

Alat Orkestrasi dan Pipeline Alur Kerja MLOps

Alat-alat ini membantu Anda membuat proyek data science dan mengelola alur kerja machine learning:

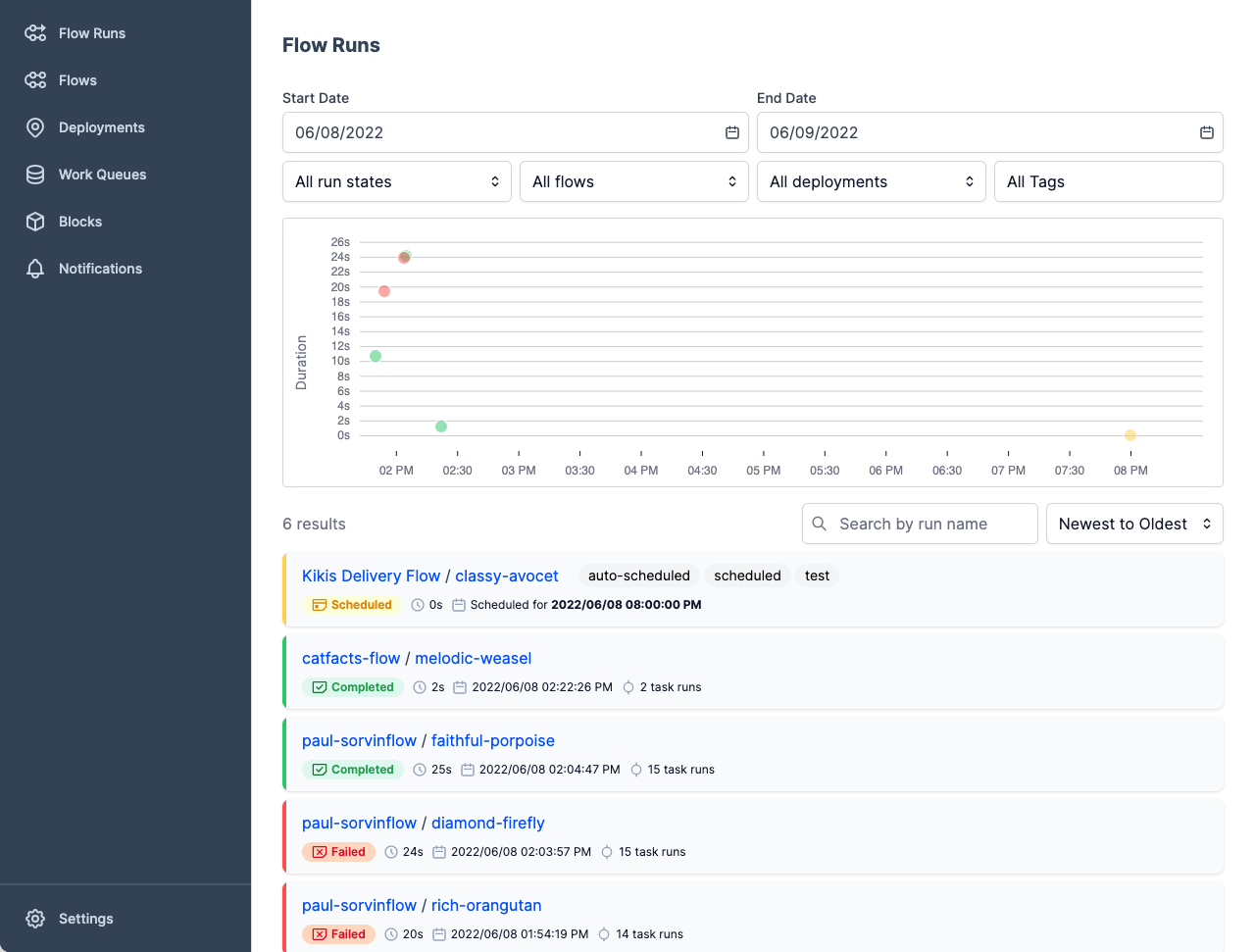

6. Prefect

Prefect adalah tumpukan data modern untuk memantau, mengoordinasikan, dan mengorkestrasi alur kerja di antara dan lintas aplikasi. Ini adalah alat open-source yang ringan, dibangun untuk pipeline machine learning end-to-end.

Anda dapat menggunakan Prefect Orion UI atau Prefect Cloud untuk basis data.

- Prefect Orion UI adalah mesin orkestrasi open-source yang dihosting secara lokal dan server API. Ini memberikan wawasan ke instance lokal Prefect Orion dan alur kerjanya.

- Prefect Cloud adalah layanan terkelola untuk memvisualisasikan flow, flow run, dan deployment. Selain itu, Anda dapat mengelola akun, ruang kerja, dan kolaborasi tim.

Gambar dari Prefect

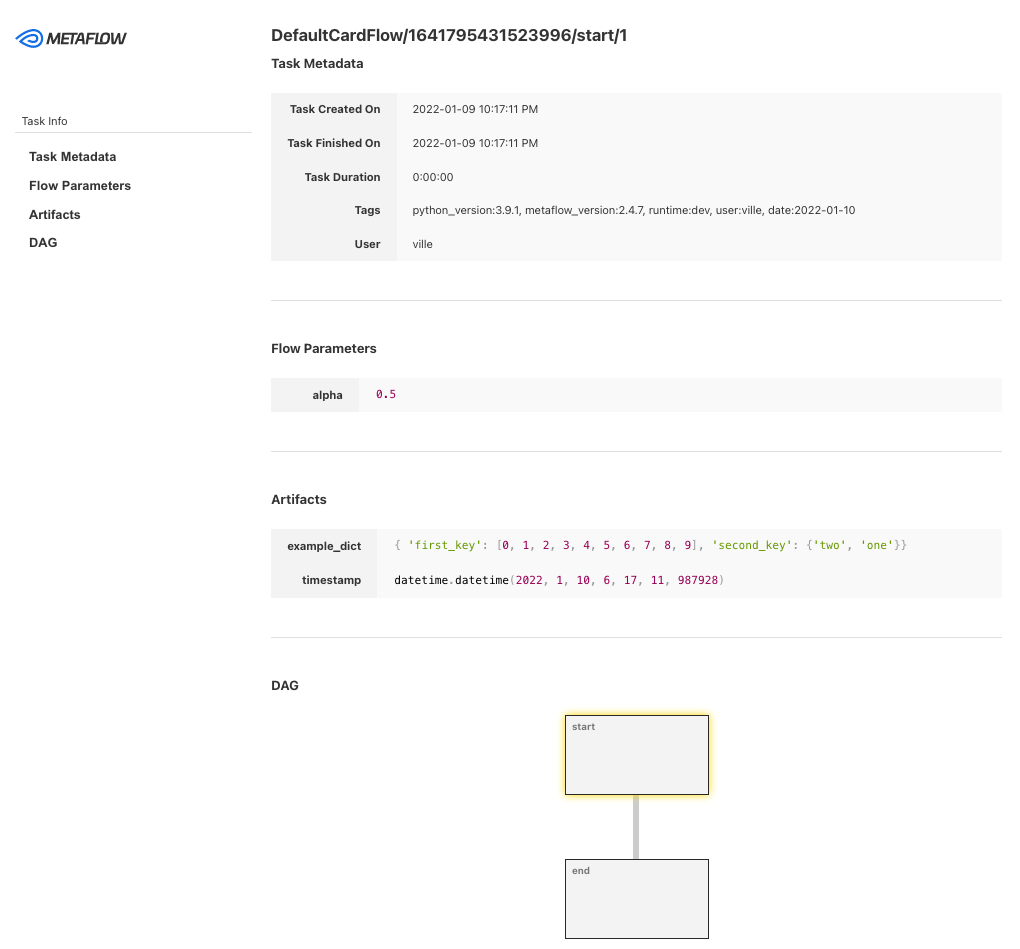

7. Metaflow

Metaflow adalah alat manajemen alur kerja yang kuat dan teruji untuk proyek data science dan machine learning. Alat ini dibuat untuk data scientist agar mereka dapat fokus membangun model alih-alih memikirkan rekayasa MLOps.

Dengan Metaflow, Anda dapat merancang alur kerja, menjalankannya dalam skala besar, dan menyebarkan model ke produksi. Metaflow melacak dan membuat versi eksperimen machine learning dan data secara otomatis. Selain itu, Anda dapat memvisualisasikan hasilnya di notebook.

Metaflow bekerja dengan banyak cloud (termasuk AWS, GCP, dan Azure) dan berbagai paket Python machine learning (seperti Scikit-learn dan Tensorflow), dan API juga tersedia untuk bahasa R.

Gambar dari Metaflow

8. Kedro

Kedro adalah alat orkestrasi alur kerja berbasis Python. Anda dapat menggunakannya untuk membuat proyek data science yang dapat direproduksi, terpelihara, dan modular. Kedro mengintegrasikan konsep dari rekayasa perangkat lunak ke machine learning, seperti modularitas, pemisahan tanggung jawab, dan versi.

Dengan Kedro, Anda dapat:

- Menyiapkan dependensi dan konfigurasi.

- Menyiapkan data.

- Membuat, memvisualisasikan, dan menjalankan pipeline.

- Logging dan pelacakan eksperimen.

- Penyebaran pada mesin tunggal atau terdistribusi.

- Membuat kode data science yang terpelihara.

- Membuat kode modular yang dapat digunakan kembali.

- Berkolaborasi dengan rekan tim dalam proyek.

Gif dari Kedro

Catatan: Anda juga dapat menggunakan Kubeflow dan DVC untuk orkestrasi dan pipeline alur kerja.

Alat Versi Data dan Pipeline

Dengan alat MLOps ini, Anda dapat mengelola tugas seputar versi data dan pipeline:

9. Pachyderm

Pachyderm mengotomatiskan transformasi data dengan versioning data, lineage, dan pipeline end-to-end di Kubernetes. Anda dapat mengintegrasikan dengan data apa pun (gambar, log, video, CSV), bahasa apa pun (Python, R, SQL, C/C++), dan pada skala apa pun (petabyte data, ribuan job).

Edisi komunitas bersifat open-source dan untuk tim kecil. Organisasi dan tim yang menginginkan fitur lanjutan dapat memilih edisi Enterprise.

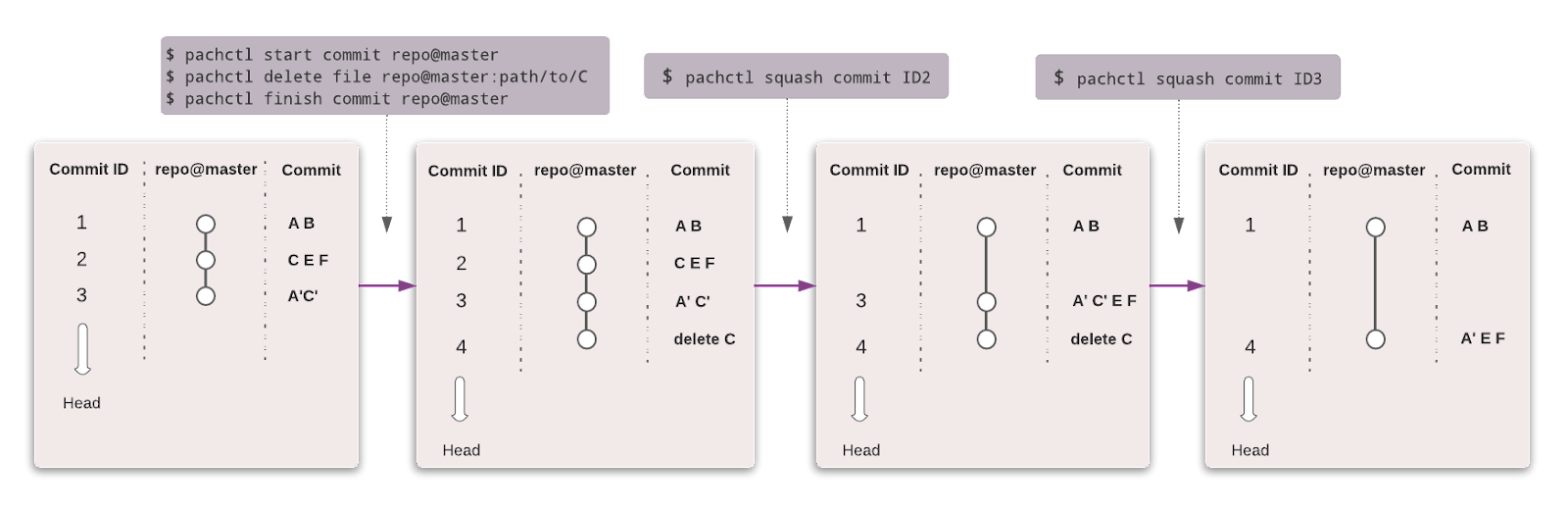

Sama seperti Git, Anda dapat membuat versi data menggunakan sintaks serupa. Di Pachyderm, tingkat objek tertinggi adalah Repository, dan Anda dapat menggunakan Commit, Branches, File, History, dan Provenance untuk melacak dan membuat versi dataset.

Gambar dari Pachyderm

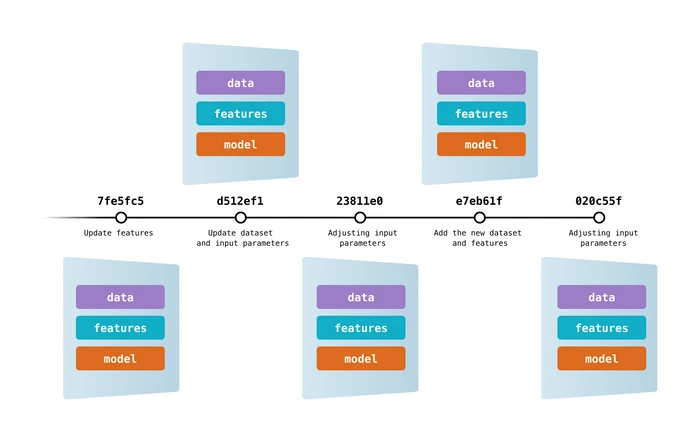

10. Data Version Control (DVC)

Data Version Control adalah alat open-source yang populer untuk proyek machine learning. DVC bekerja mulus dengan Git untuk menyediakan versi kode, data, model, metadata, dan pipeline.

DVC lebih dari sekadar alat pelacakan dan versi data.

Anda dapat menggunakannya untuk:

- Pelacakan eksperimen (metrik model, parameter, versi).

- Membuat, memvisualisasikan, dan menjalankan pipeline machine learning.

- Alur kerja untuk penyebaran dan kolaborasi.

- Reprodusibilitas.

- Registry data dan model.

- Integrasi dan penyebaran berkelanjutan untuk machine learning menggunakan CML.

Gambar dari DVC

Catatan: DagsHub juga dapat digunakan untuk versi data dan pipeline.

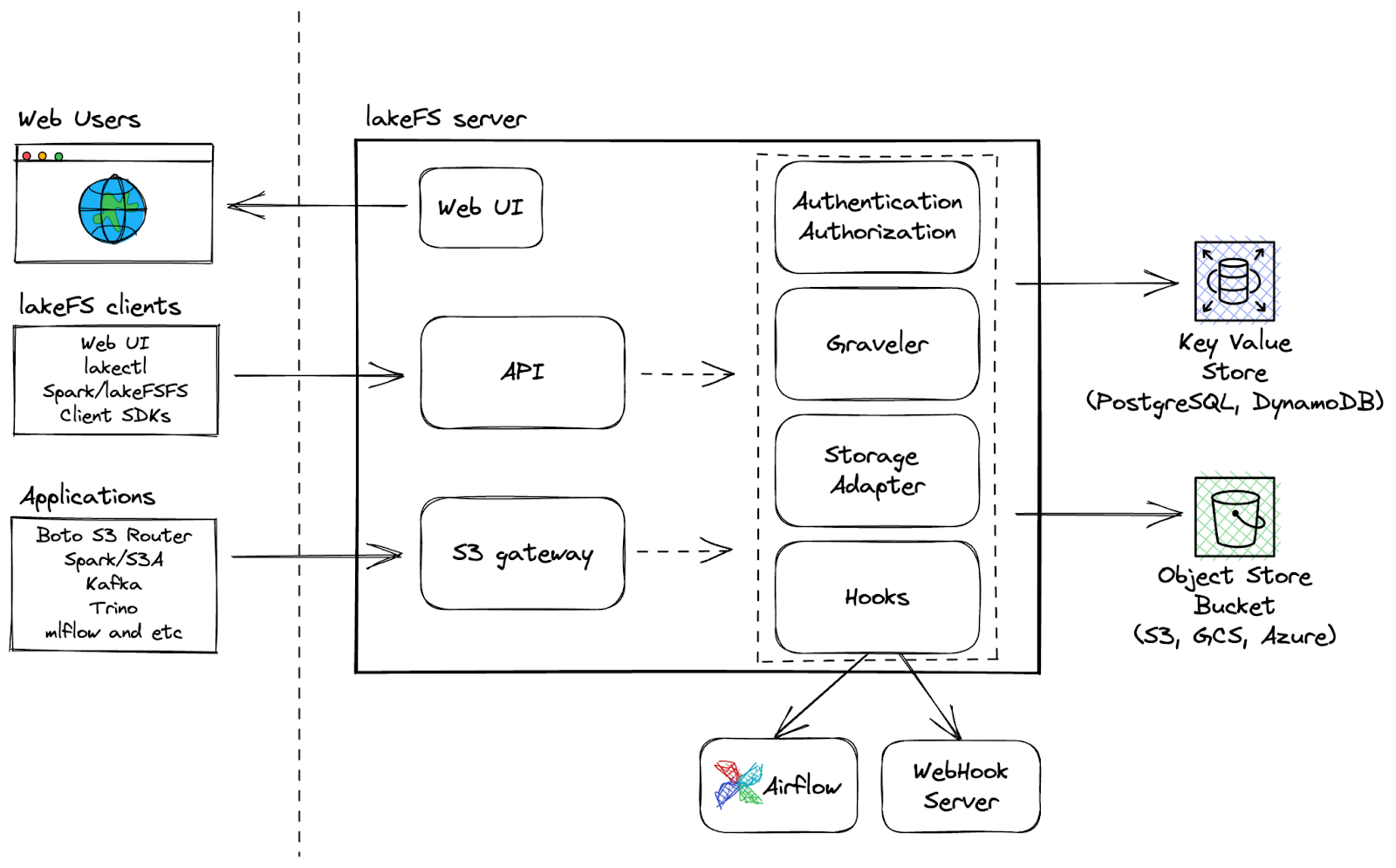

11. LakeFS

LakeFS adalah alat kontrol versi data berskala besar open-source yang menyediakan antarmuka kontrol versi mirip Git untuk object storage, memungkinkan pengguna mengelola data lake seperti mengelola kode. Dengan LakeFS, pengguna dapat membuat versi data pada skala exabyte, menjadikannya solusi yang sangat skalabel untuk mengelola data lake besar.

Kemampuan tambahan:

- Melakukan operasi Git seperti branch, commit, dan merge pada layanan penyimpanan apa pun

- Pengembangan lebih cepat dengan zero copy branching untuk eksperimen tanpa hambatan dan kolaborasi yang mudah

- Gunakan pre-commit dan merge hook untuk alur kerja CI/CD guna memastikan alur yang bersih

- Platform yang tangguh memungkinkan pemulihan lebih cepat dari masalah data dengan kemampuan revert.

Arsitektur LakeFS

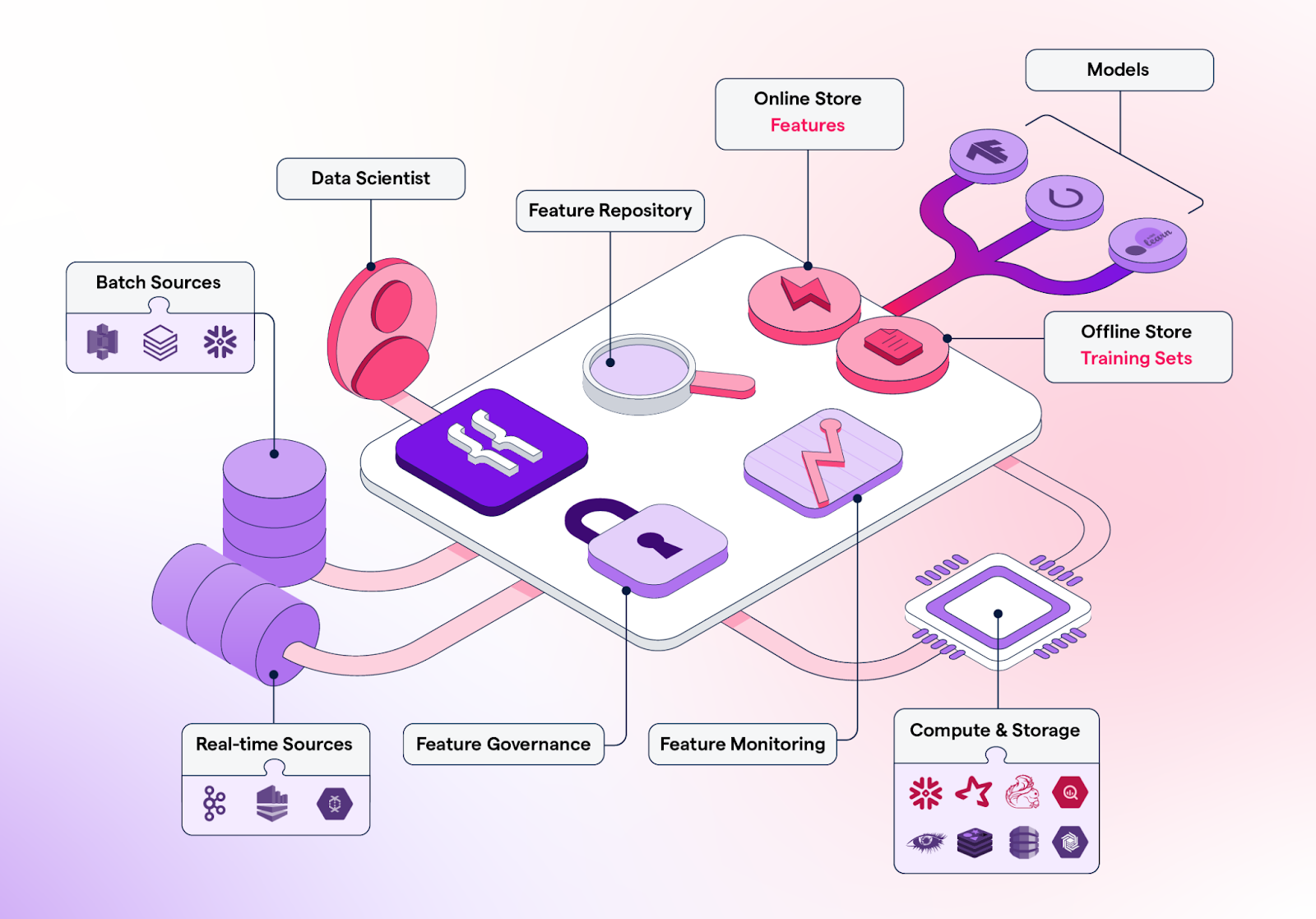

Feature Store

Feature store adalah repositori terpusat untuk menyimpan, membuat versi, mengelola, dan menyajikan fitur (atribut data terproses yang digunakan untuk melatih model machine learning) bagi model machine learning di produksi maupun untuk tujuan pelatihan.

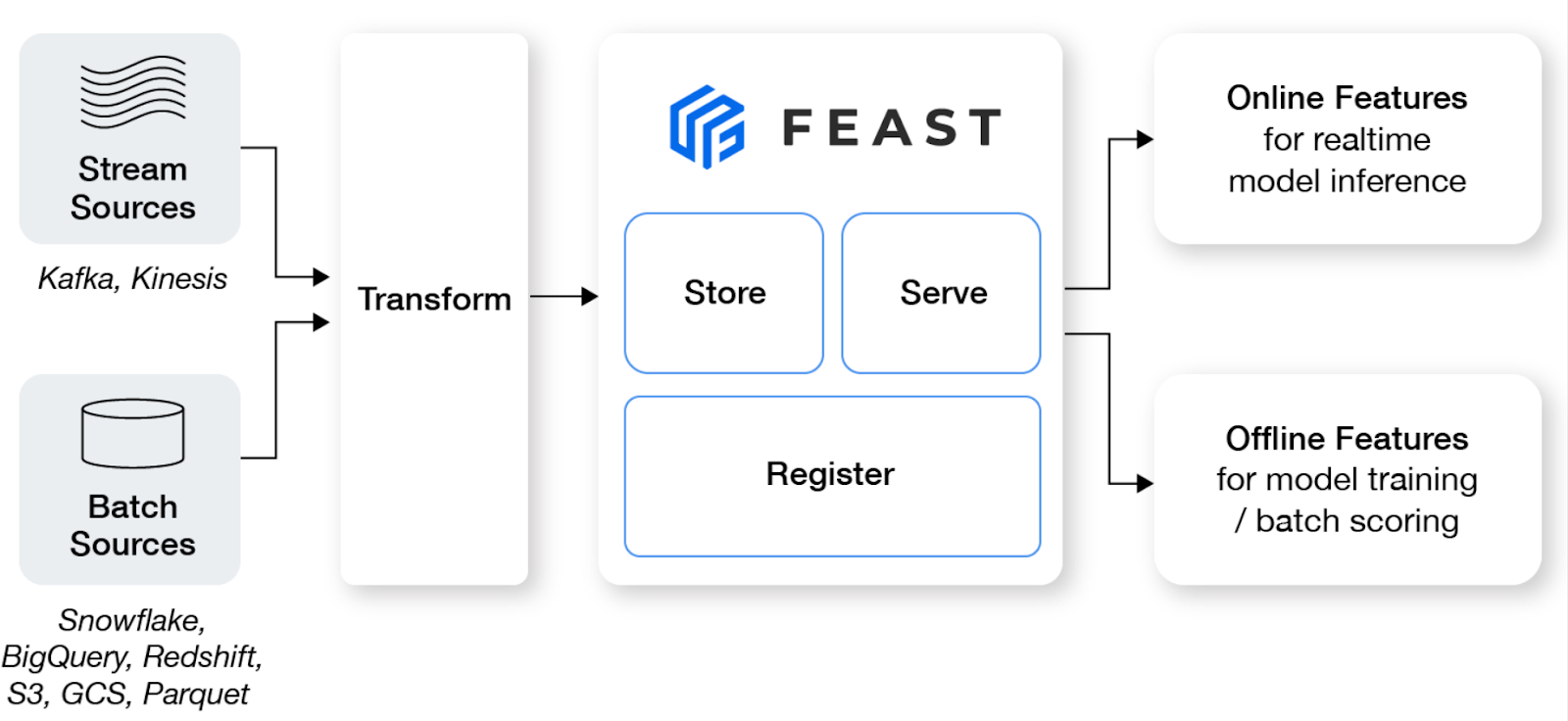

12. Feast

Feast adalah feature store open-source yang membantu tim machine learning memproduksi model real-time dan membangun platform fitur yang mendorong kolaborasi antara engineer dan data scientist.

Fitur utama:

- Kelola offline store, online store berlatensi rendah, dan feature server untuk memastikan ketersediaan fitur yang konsisten untuk pelatihan dan penyajian.

- Hindari kebocoran data dengan membuat kumpulan fitur point-in-time yang akurat, membebaskan data scientist dari penggabungan dataset yang rawan kesalahan.

- Memisahkan ML dari infrastruktur data dengan memiliki satu lapisan akses.

Gambar dari Feast

13. Featureform

Featureform adalah feature store virtual yang memungkinkan data scientist mendefinisikan, mengelola, dan menyajikan fitur untuk model ML mereka. Alat ini dapat membantu tim data science meningkatkan kolaborasi, mengatur eksperimen, memfasilitasi penyebaran, meningkatkan keandalan, dan menjaga kepatuhan.

Fitur utama:

- Meningkatkan kolaborasi dengan berbagi, menggunakan kembali, dan memahami fitur di seluruh tim.

- Saat fitur Anda siap disebarkan, Featureform akan mengorkestrasi infrastruktur data Anda agar siap untuk produksi.

- Sistem memastikan tidak ada fitur, label, atau kumpulan pelatihan yang dapat dimodifikasi untuk meningkatkan keandalan.

- Dengan kontrol akses berbasis peran bawaan, log audit, dan aturan serving dinamis, Featureform dapat menegakkan logika kepatuhan Anda secara langsung.

Gambar dari Featureform

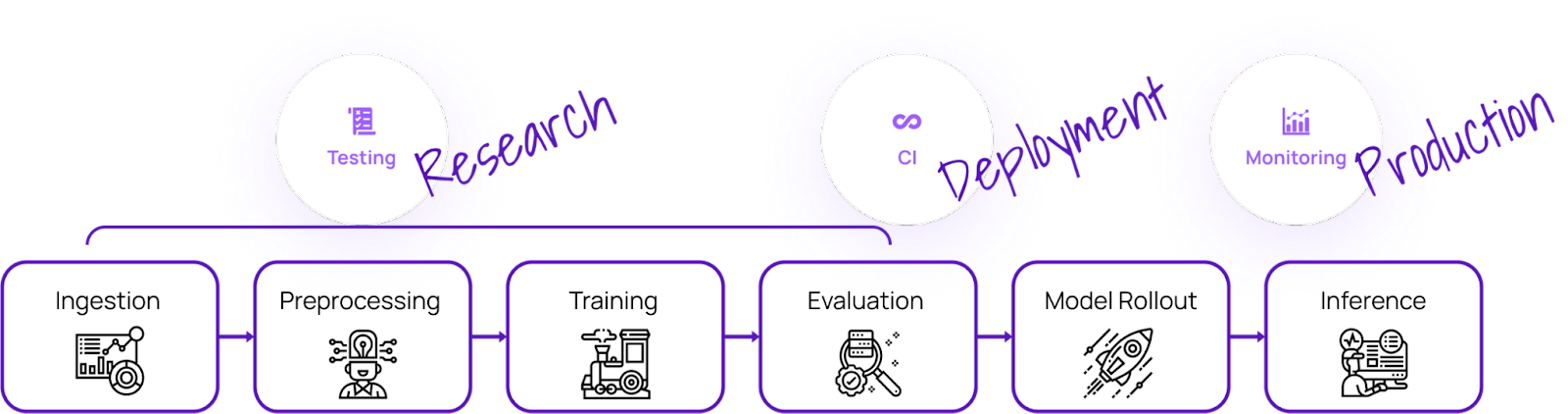

Pengujian Model

Dengan alat MLOps ini, Anda dapat menguji kualitas model dan memastikan keandalan, ketangguhan, dan akurasi model machine learning:

14. Deepchecks ML Models Testing

Deepchecks adalah solusi open-source yang memenuhi semua kebutuhan validasi ML Anda, memastikan data dan model diuji secara menyeluruh dari riset hingga produksi. Deepchecks menawarkan pendekatan holistik untuk memvalidasi data dan model melalui berbagai komponennya.

Gambar dari Deepchecks

Deepchecks terdiri dari tiga komponen:

- Deepchecks testing: memungkinkan Anda membangun pemeriksaan dan suite kustom untuk validasi tabular, pemrosesan bahasa alami, dan visi komputer.

- Manajemen CI & pengujian: menyediakan CI & Testing Management untuk membantu Anda berkolaborasi dengan tim dan mengelola hasil uji secara efektif.

- Deepchecks monitoring: melacak dan memvalidasi model di produksi.

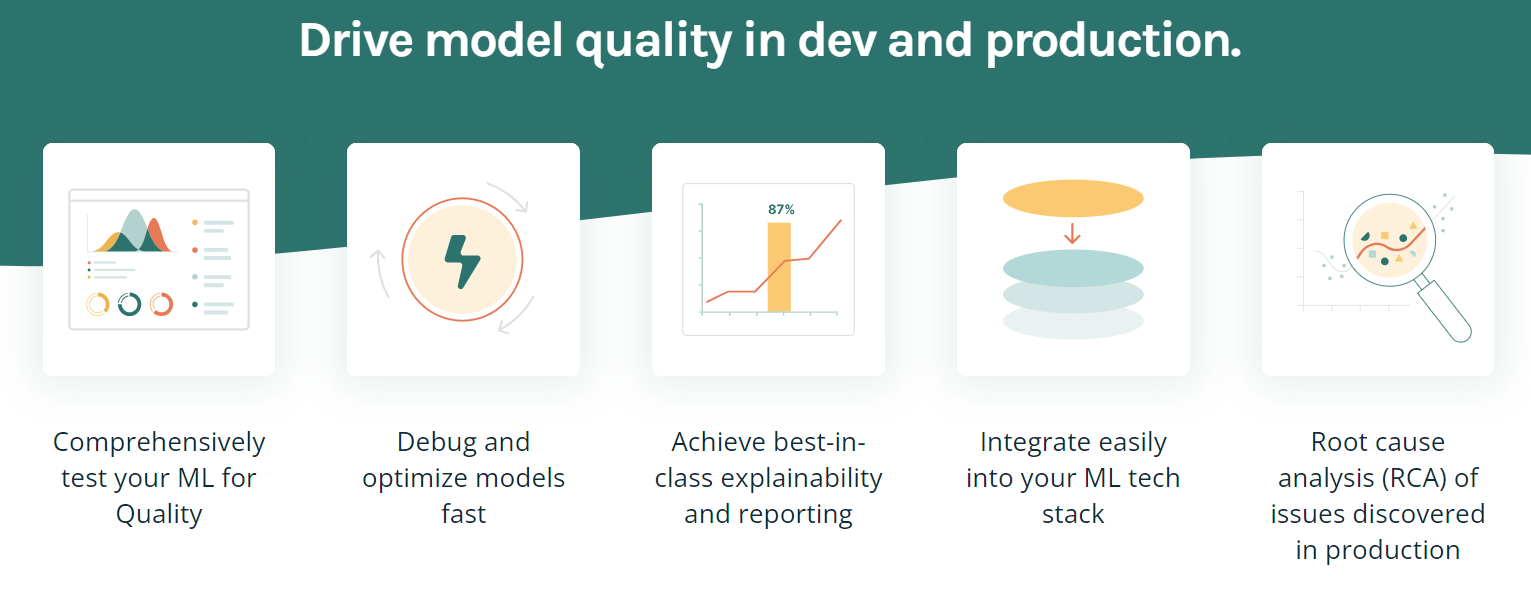

15. TruEra

TruEra adalah platform canggih yang dirancang untuk mendorong kualitas dan performa model melalui pengujian otomatis, explainability, dan analisis akar penyebab. Platform ini menawarkan berbagai fitur untuk membantu mengoptimalkan dan melakukan debug model, mencapai explainability kelas dunia, dan terintegrasi dengan mudah ke tumpukan teknologi ML Anda.

Fitur utama:

- Fitur pengujian dan debugging model memungkinkan Anda meningkatkan kualitas model selama pengembangan dan produksi.

- Dapat melakukan pengujian otomatis dan sistematis untuk memastikan performa, stabilitas, dan keadilan.

- Memahami evolusi versi model. Ini memungkinkan Anda mengekstrak wawasan yang memandu pengembangan model yang lebih cepat dan efektif.

- Mengidentifikasi dan menentukan fitur spesifik mana yang berkontribusi pada bias model.

- TruEra dapat dengan mudah diintegrasikan ke dalam infrastruktur dan alur kerja Anda saat ini tanpa hambatan.

Gambar oleh TruEra

Alat Penyebaran dan Penyajian Model

Saat menyebarkan model, alat MLOps berikut dapat sangat membantu:

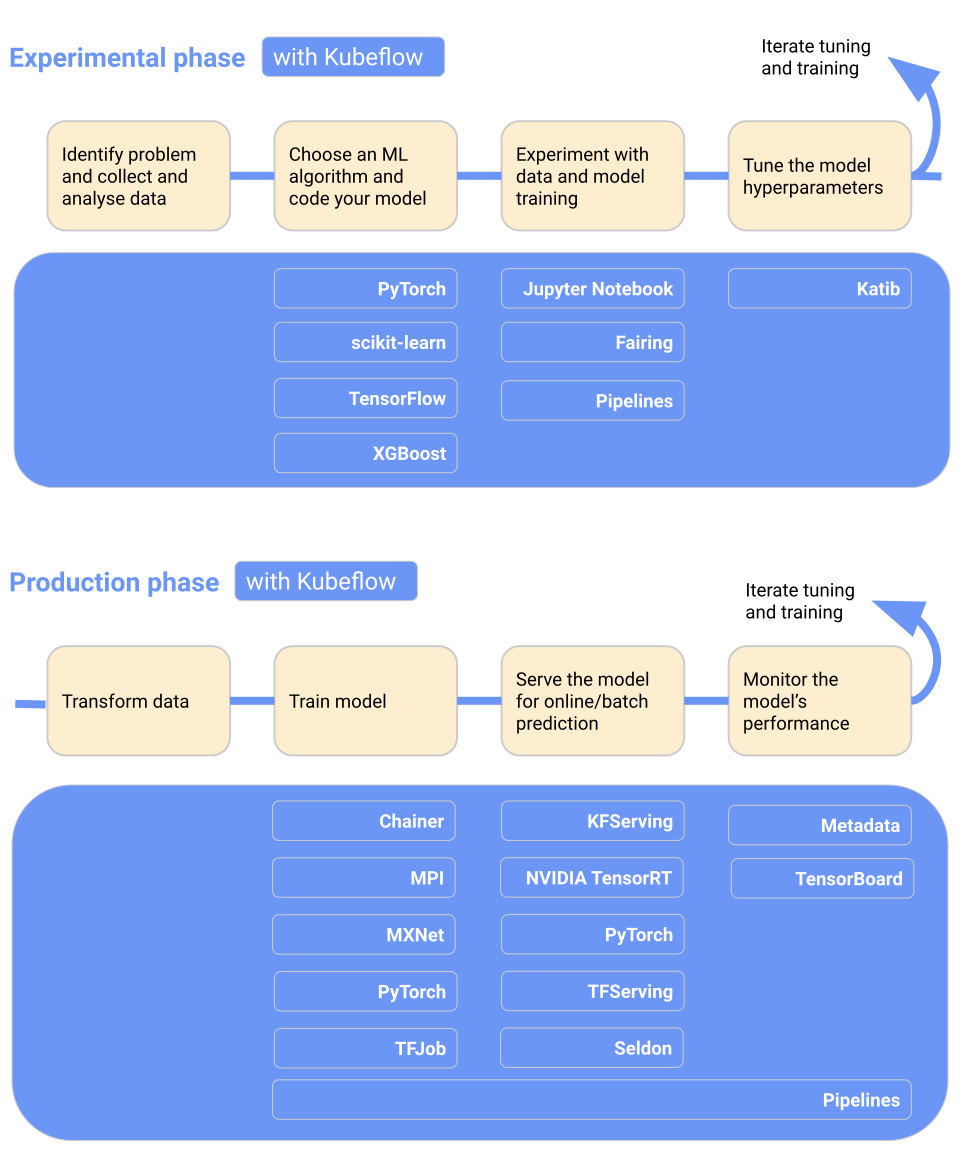

16. Kubeflow

Kubeflow membuat penyebaran model machine learning di Kubernetes menjadi sederhana, portabel, dan skalabel. Anda dapat menggunakannya untuk menyiapkan data, melatih model, mengoptimalkan model, menyajikan prediksi, dan memantau performa model di produksi. Anda dapat menyebarkan alur kerja machine learning secara lokal, on-premises, atau ke cloud. Singkatnya, Kubeflow memudahkan Kubernetes bagi tim data science.

Fitur utama:

- Dasbor terpusat dengan UI interaktif.

- Pipeline machine learning untuk reprodusibilitas dan penyederhanaan.

- Menyediakan dukungan native untuk JupyterLab, RStudio, dan Visual Studio Code.

- Tuning hyperparameter dan pencarian arsitektur neural.

- Pekerjaan pelatihan untuk Tensorflow, Pytorch, PaddlePaddle, MXNet, dan XGboost.

- Penjadwalan job.

- Menyediakan isolasi multi-pengguna bagi administrator.

- Bekerja dengan semua penyedia cloud utama.

Gambar dari Kubeflow

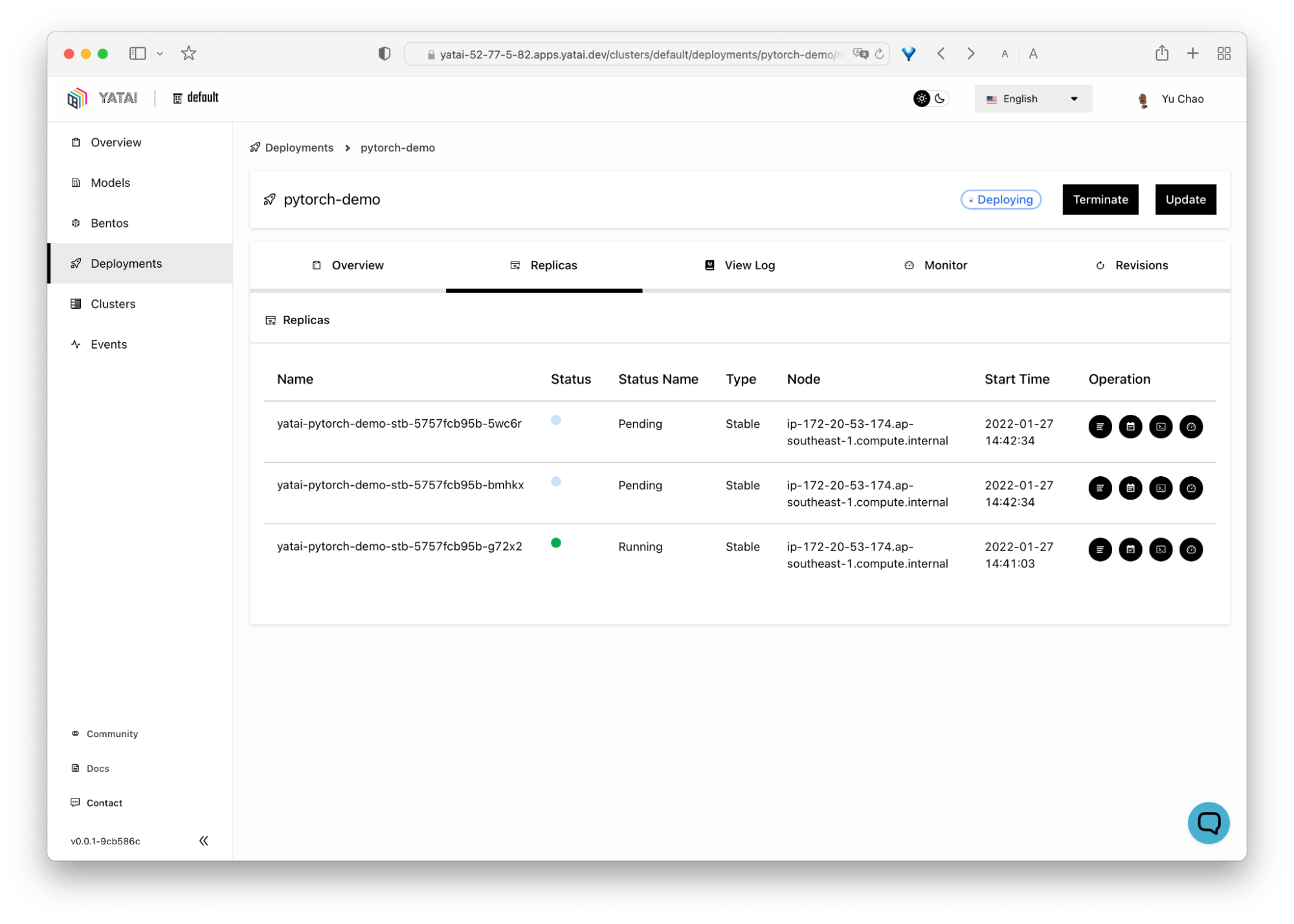

10. BentoML

BentoML memudahkan dan mempercepat pengiriman aplikasi machine learning. Ini adalah alat Python-first untuk menyebarkan dan memelihara API di produksi. BentoML diskalakan dengan optimasi kuat melalui inference paralel dan adaptive batching serta menyediakan akselerasi perangkat keras.

Dasbor terpusat interaktif BentoML memudahkan pengorganisasian dan pemantauan saat menyebarkan model machine learning. Yang terbaik, alat ini bekerja dengan semua jenis kerangka machine learning, seperti Keras, ONNX, LightGBM, Pytorch, dan Scikit-learn. Singkatnya, BentoML memberikan solusi lengkap untuk penyebaran, penyajian, dan pemantauan model.

Gambar dari BentoML

18. Hugging Face Inference Endpoints

Hugging Face Inference Endpoints adalah layanan berbasis cloud yang ditawarkan oleh Hugging Face, sebuah platform ML serba ada yang memungkinkan pengguna melatih, meng-host, dan berbagi model, dataset, dan demo. Endpoint ini dirancang untuk membantu pengguna menyebarkan model machine learning yang mereka latih untuk inference tanpa perlu menyiapkan dan mengelola infrastruktur yang diperlukan.

Fitur utama:

- Biaya serendah $0,06 per inti CPU/jam dan $0,6 per GPU/jam, tergantung kebutuhan Anda.

- Mudah disebarkan dalam hitungan detik.

- Terkelola penuh dan autoscale.

- Bagian dari ekosistem Hugging Face.

- Keamanan tingkat enterprise.

Gambar dari Hugging Face

Catatan: Anda juga dapat menggunakan MLflow dan AWS sagemaker untuk penyebaran dan penyajian model.

Pemantauan Model di Produksi: Alat ML Ops

Baik model ML Anda sedang dalam tahap pengembangan, validasi, atau sudah disebarkan ke produksi, alat-alat ini dapat membantu Anda memantau berbagai faktor:

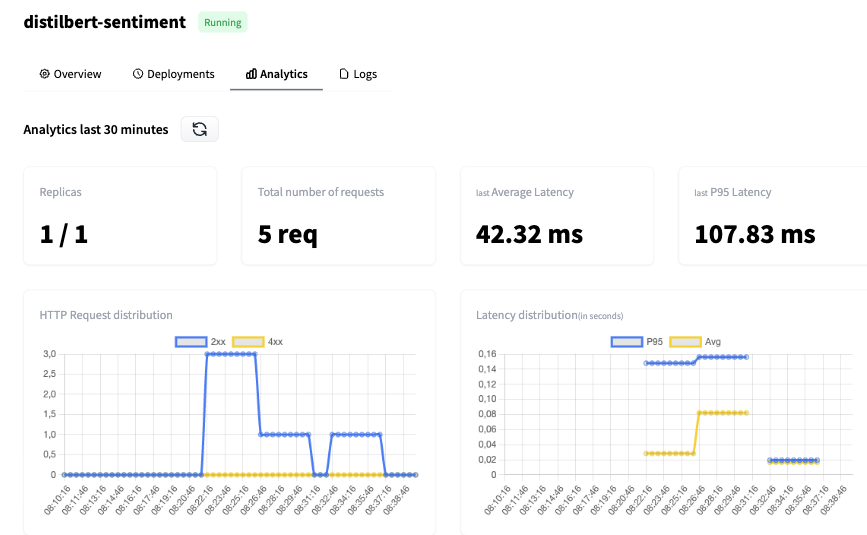

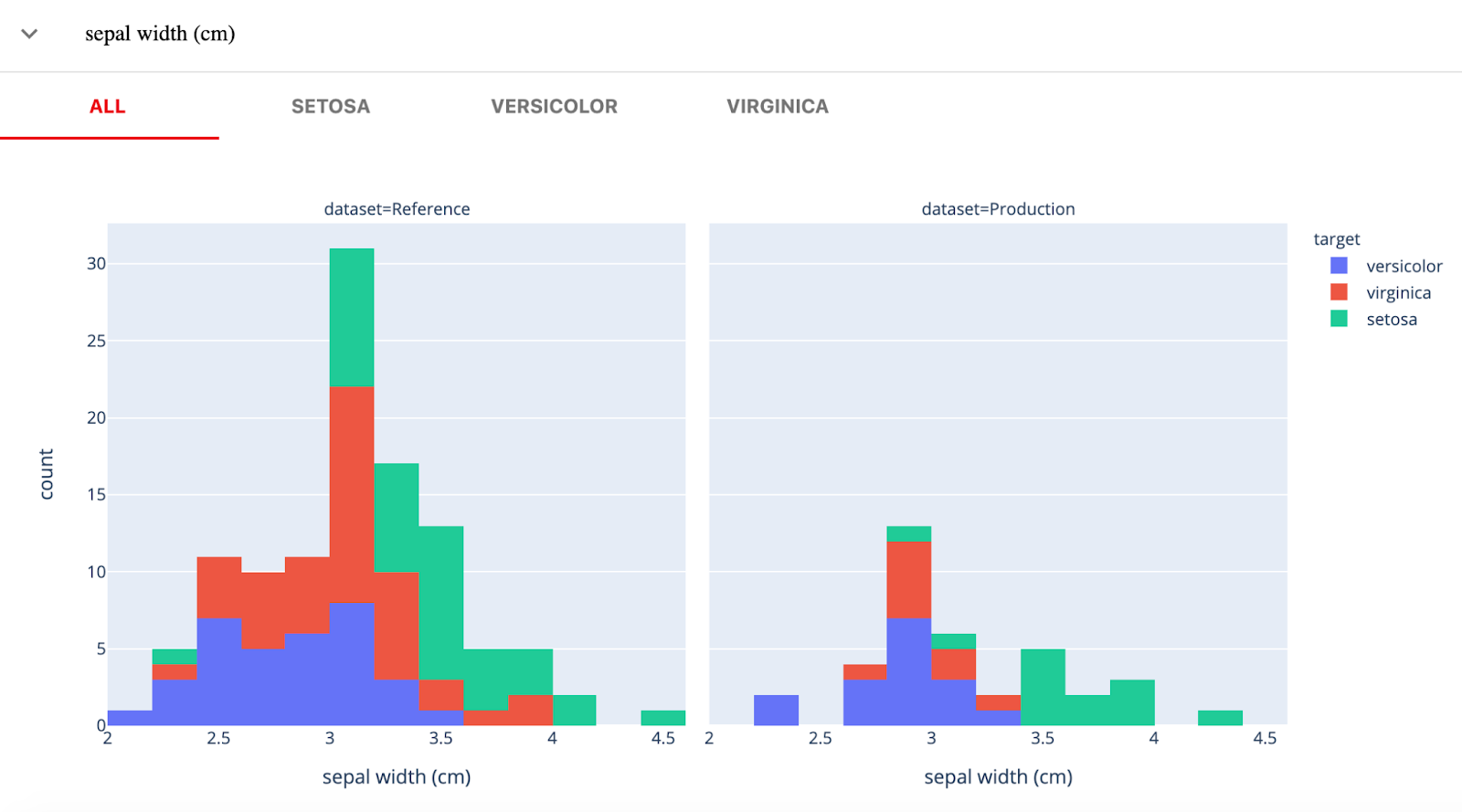

19. Evidently

Evidently AI adalah library Python open-source untuk memantau model ML selama pengembangan, validasi, dan di produksi. Alat ini memeriksa kualitas data dan model, data drift, target drift, serta performa regresi dan klasifikasi.

Evidently memiliki tiga komponen utama:

- Tests (pemeriksaan model batch): untuk melakukan pemeriksaan data terstruktur dan kualitas model.

- Reports (dasbor interaktif): virtualisasi interaktif untuk data drift, performa model, dan target.

- Monitors (pemantauan real-time): memantau data dan metrik model dari layanan ML yang disebarkan.

Gambar dari Evidently

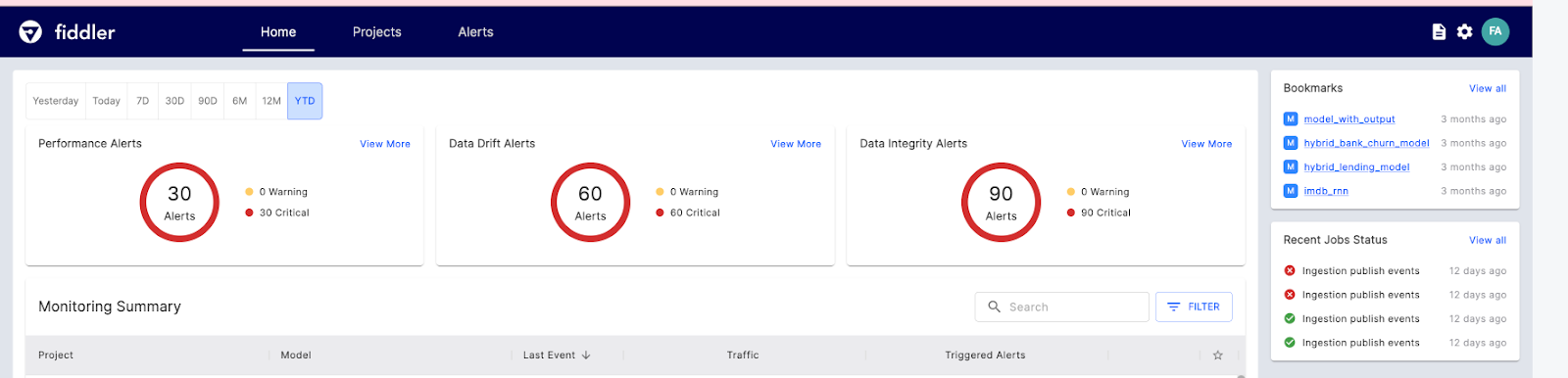

20. Fiddler

Fiddler AI adalah alat pemantauan model ML dengan UI yang mudah digunakan dan jelas. Ia memungkinkan Anda menjelaskan dan melakukan debug prediksi, menganalisis perilaku model untuk seluruh dataset, menyebarkan model machine learning dalam skala besar, dan memantau performa model.

Mari lihat fitur utama Fiddler AI untuk pemantauan ML:

- Pemantauan performa: visualisasi mendalam tentang data drift, kapan terjadi, dan bagaimana terjadinya.

- Integritas data: menghindari pemberian data yang salah untuk pelatihan model.

- Pelacakan outlier: menunjukkan outlier univariat dan multivariat.

- Metrik layanan: menampilkan wawasan dasar tentang operasi layanan ML.

- Peringatan: menyiapkan peringatan untuk satu model atau sekelompok model guna memperingatkan masalah di produksi.

Gambar dari Fiddler

Runtime Engine

Runtime engine bertanggung jawab untuk memuat model, melakukan prapemrosesan data masukan, menjalankan inference, dan mengembalikan hasil ke aplikasi klien.

21. Ray

Ray adalah kerangka serbaguna yang dirancang untuk menskalakan aplikasi AI dan Python, memudahkan pengembang mengelola dan mengoptimalkan proyek machine learning mereka.

Platform ini terdiri dari dua komponen utama: runtime terdistribusi inti dan sekumpulan library AI yang disesuaikan untuk menyederhanakan komputasi ML.

Ray Core menawarkan sekumpulan elemen fundamental yang terbatas yang dapat digunakan untuk membangun dan memperluas aplikasi terdistribusi.

- Tasks adalah fungsi tanpa state yang dieksekusi di dalam klaster.

- Actors adalah proses pekerja yang stateful dan dibuat di dalam klaster.

- Objects adalah nilai tak berubah yang dapat diakses oleh komponen mana pun dalam klaster.

Ray juga menyediakan library AI untuk dataset yang dapat diskalakan untuk ML, pelatihan terdistribusi, tuning hyperparameter, reinforcement learning, serta serving yang dapat diprogram dan diskalakan.

Contoh berikut menunjukkan pelatihan dan penyajian model Gradient Boosting Classifier.

import requests

from starlette.requests import Request

from typing import Dict

from sklearn.datasets import load_iris

from sklearn.ensemble import GradientBoostingClassifier

from ray import serve

# Train model.

iris_dataset = load_iris()

model = GradientBoostingClassifier()

model.fit(iris_dataset["data"], iris_dataset["target"])

@serve.deployment

class BoostingModel:

def __init__(self, model):

self.model = model

self.label_list = iris_dataset["target_names"].tolist()

async def __call__(self, request: Request) -> Dict:

payload = (await request.json())["vector"]

print(f"Received http request with data {payload}")

prediction = self.model.predict([payload])[0]

human_name = self.label_list[prediction]

return {"result": human_name}

# Deploy model.

serve.run(BoostingModel.bind(model), route_prefix="/iris")22. Nuclio

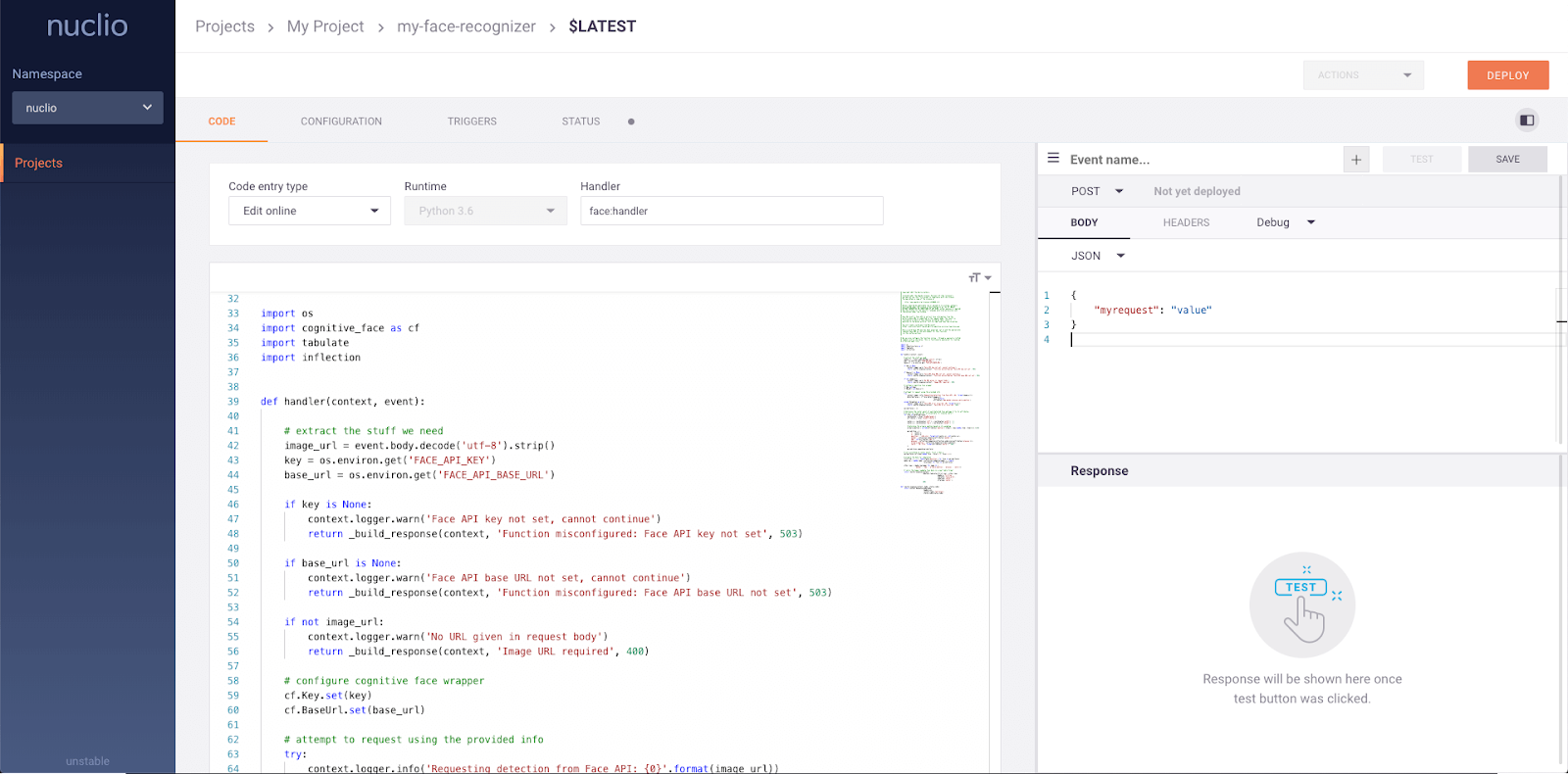

Nuclio adalah kerangka kuat yang berfokus pada beban kerja yang intensif data, I/O, dan komputasi. Kerangka ini dirancang tanpa server (serverless), artinya Anda tidak perlu mengelola server. Nuclio terintegrasi dengan baik dengan alat data science populer, seperti Jupyter dan Kubeflow. Ia juga mendukung beragam sumber data dan streaming serta dapat dijalankan di CPU dan GPU.

Fitur utama:

- Memerlukan sumber daya CPU/GPU dan I/O minimal untuk pemrosesan real-time sambil memaksimalkan paralelisme.

- Terintegrasi dengan berbagai sumber data dan kerangka ML.

- Menyediakan fungsi stateful dengan akselerasi data-path

- Portabilitas di semua jenis perangkat dan platform cloud, terutama perangkat berdaya rendah.

- Dirancang untuk enterprise.

Gambar dari Nuclio

Platform MLOps End-to-End

Jika Anda mencari alat MLOps komprehensif yang dapat membantu sepanjang proses, berikut beberapa yang terbaik:

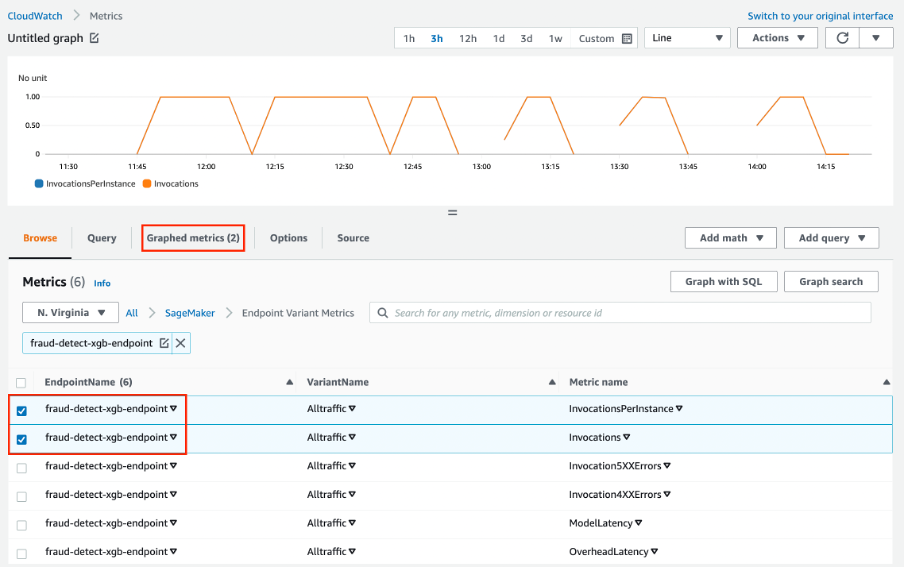

23. AWS SageMaker

Amazon Web Services SageMaker adalah solusi satu atap untuk MLOps. Anda dapat melatih dan mempercepat pengembangan model, melacak dan membuat versi eksperimen, mengkatalogkan artefak ML, mengintegrasikan pipeline ML CI/CD, serta menyebarkan, menyajikan, dan memantau model di produksi secara mulus.

Fitur utama:

- Lingkungan kolaboratif untuk tim data science.

- Mengotomatiskan alur kerja pelatihan ML.

- Menyebarkan dan mengelola model di produksi.

- Melacak dan memelihara versi model.

- CI/CD untuk integrasi dan penyebaran otomatis.

- Pemantauan berkelanjutan dan pelatihan ulang model untuk menjaga kualitas.

- Optimalkan biaya dan performa.

Gambar dari Amazon SageMaker

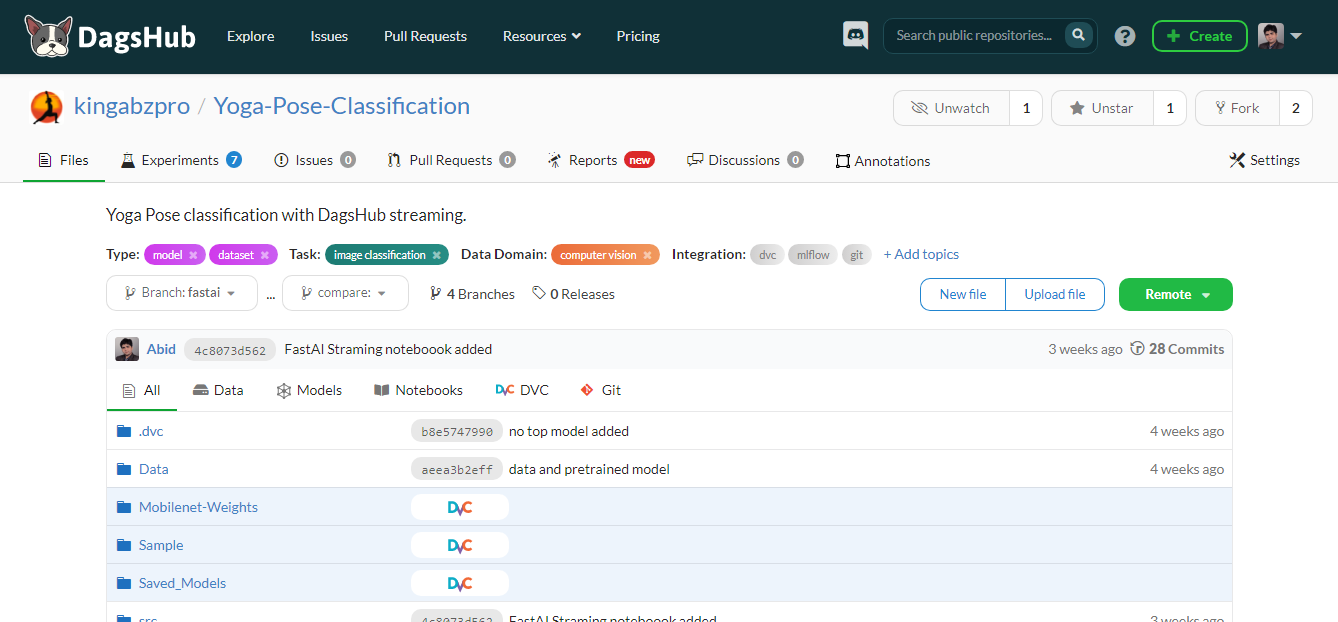

24. DagsHub

DagsHub adalah platform yang dibuat untuk komunitas machine learning guna melacak dan membuat versi data, model, eksperimen, pipeline ML, dan kode. Platform ini memungkinkan tim Anda membangun, meninjau, dan berbagi proyek machine learning.

Sederhananya, ini adalah GitHub untuk machine learning, dan Anda mendapatkan berbagai alat untuk mengoptimalkan proses machine learning end-to-end.

Fitur utama:

- Repositori Git dan DVC untuk proyek ML Anda.

- Logger DagsHub dan instance MLflow untuk pelacakan eksperimen.

- Anotasi dataset menggunakan instance label studio.

- Membedakan (diff) Jupyter notebook, kode, dataset, dan gambar.

- Kemampuan berkomentar pada file, baris kode, atau dataset.

- Membuat laporan untuk proyek seperti wiki GitHub.

- Visualisasi pipeline ML.

- Hasil yang dapat direproduksi.

- Menjalankan CI/CD untuk pelatihan dan penyebaran model.

- Penggabungan data.

- Menyediakan integrasi dengan GitHub, Google Colab, DVC, Jenkins, penyimpanan eksternal, webhook, dan New Relic.

Gambar oleh Penulis

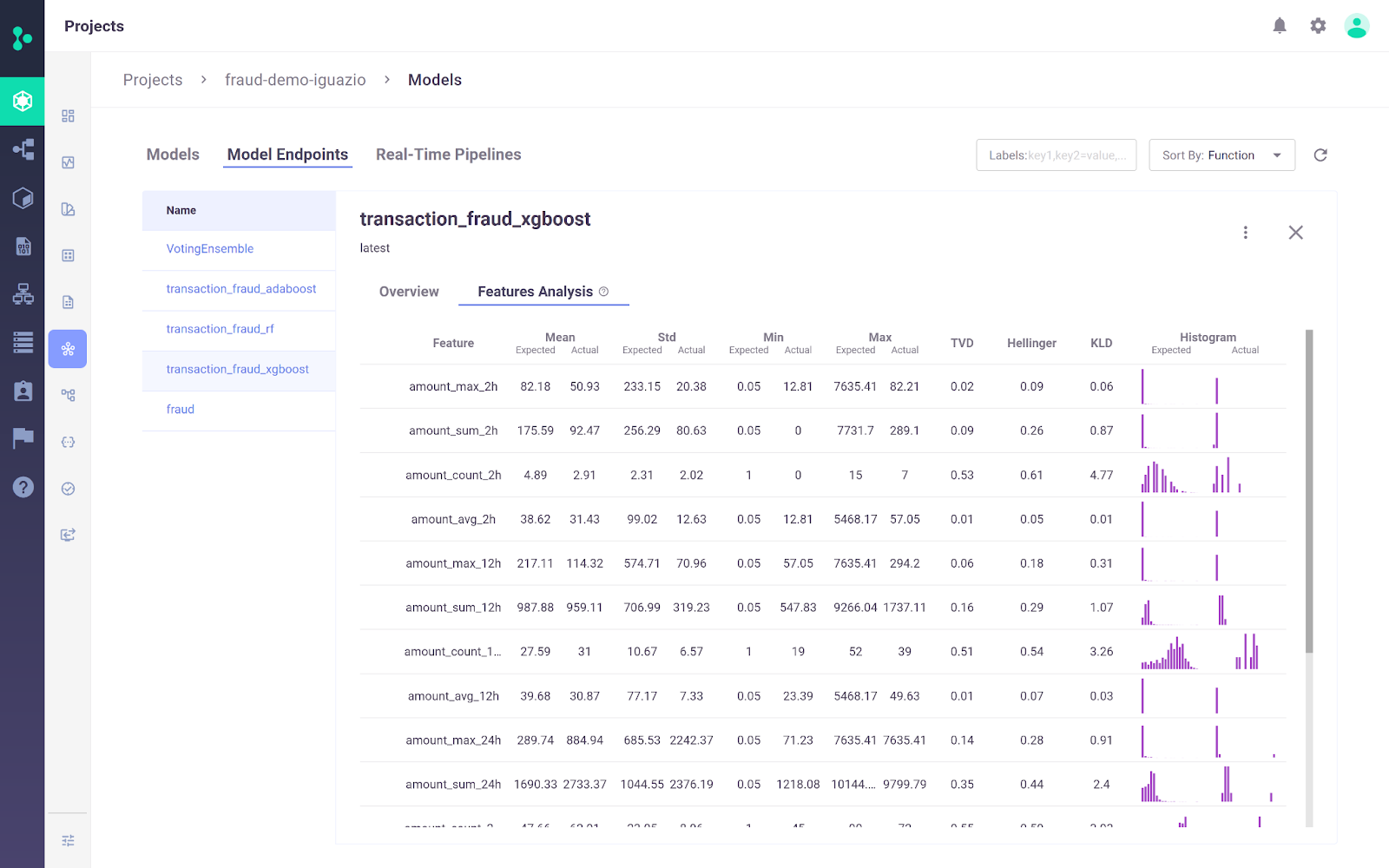

25. Iguazio MLOps Platform

Iguazio MLOps Platform adalah platform MLOps end-to-end yang memungkinkan organisasi mengotomatiskan pipeline machine learning dari pengumpulan dan persiapan data hingga pelatihan, penyebaran, dan pemantauan di produksi. Platform ini menyediakan platform terbuka (MLRun) dan terkelola.

Salah satu pembeda kunci Iguazio MLOps Platform adalah fleksibilitas dalam opsi penyebaran. Pengguna dapat menyebarkan aplikasi AI di mana saja, termasuk cloud apa pun, lingkungan hybrid, atau on-premises. Hal ini sangat penting untuk industri seperti layanan kesehatan dan keuangan, di mana masalah privasi data mungkin membuat penyebaran on-premises menjadi keharusan.

Gambar dari Iguazio MLOps Platform

Fitur utama:

- Platform memungkinkan pengguna mengisap (ingest) data dari sumber apa pun dan membangun fitur online dan offline yang dapat digunakan kembali menggunakan feature store terintegrasi.

- Mendukung pelatihan dan evaluasi model secara berkelanjutan dalam skala besar menggunakan serverless yang dapat diskalakan dengan pelacakan otomatis, versioning data, serta integrasi dan penyebaran berkelanjutan.

- Mudah menyebarkan model ke produksi hanya dengan beberapa klik, terus memantau performa model dan mengurangi model drift.

- Platform dilengkapi dasbor sederhana untuk mengelola, mengatur, dan memantau model serta produksi real-time.

Gambaran Umum Alat MLOps

Berikut tabel perbandingan sehingga Anda dapat mengevaluasi alat-alat ini secara berdampingan dan memutuskan yang terbaik untuk proyek Anda:

| Tool | Fungsionalitas utama | Kerangka yang didukung | Opsi penyebaran |

|---|---|---|---|

| Qdrant | Pencarian kemiripan vektor dan manajemen basis data | Python, berbagai bahasa | Cloud-native, skalabel horizontal |

| LangChain | Mengembangkan aplikasi dengan model bahasa | Python, JavaScript | REST API, template |

| MLFlow | Pelacakan eksperimen, registry model, penyebaran | Python, R, Java, REST API | Lokal, cloud |

| Comet ML | Pelacakan eksperimen dan optimasi | Scikit-learn, PyTorch, TensorFlow, HuggingFace | Lokal, cloud |

| Weights & Biases | Pelacakan eksperimen, versi data dan model | Fastai, Keras, PyTorch, HuggingFace, Yolov5, Spacy | Lokal, cloud |

| Prefect | Orkestrasi dan pemantauan alur kerja | Python | Lokal (Orion UI), Cloud |

| Metaflow | Manajemen alur kerja untuk data science | Scikit-learn, TensorFlow, Python, R | AWS, GCP, Azure, lokal |

| Kedro | Orkestrasi alur kerja, reprodusibilitas | Python | Lokal, terdistribusi |

| Pachyderm | Transformasi, versioning, dan lineage data | Bahasa apa pun | Kubernetes |

| DVC | Versi data dan pipeline | Git, Python | Lokal, cloud |

| LakeFS | Kontrol versi mirip Git untuk data lake | Layanan penyimpanan apa pun | Lokal, cloud |

| Feast | Feature store terpusat untuk model ML | Python | Lokal, cloud |

| Featureform | Feature store virtual untuk model ML | Python | Lokal, cloud |

| Deepchecks | Pengujian dan validasi model ML | Python | Lokal, cloud |

| TruEra | Pengujian kualitas dan performa model | Python | Lokal, cloud |

| Kubeflow | Penyebaran dan orkestrasi model ML | TensorFlow, PyTorch, PaddlePaddle, MXNet, XGboost | Kubernetes, cloud |

| BentoML | Penyebaran model dan manajemen API | Keras, ONNX, LightGBM, PyTorch, Scikit-learn | Lokal, cloud |

| Hugging Face | Inference dan penyebaran model | Model apa pun | Cloud |

| Evidently | Pemantauan model ML untuk data dan target drift | Python | Lokal, cloud |

| Fiddler | Pemantauan dan debugging model ML | Python | Lokal, cloud |

| Ray | Menskalakan aplikasi AI dan Python | Python | Lokal, cloud |

| Nuclio | Kerangka serverless untuk beban kerja intensif data dan komputasi | Jupyter, Kubeflow | Cloud, on-premises |

| AWS SageMaker | Manajemen siklus hidup ML end-to-end | Python, R, Java, TensorFlow, PyTorch | Cloud AWS |

| DagsHub | Versi dan kolaborasi untuk proyek ML | Git, DVC, MLflow | Lokal, cloud |

| Iguazio | Otomasi end-to-end pipeline ML | Python, MLRun | Cloud, hybrid, on-premises |

Kesimpulan

Kita berada pada masa ketika industri MLOps sedang booming. Setiap minggu Anda melihat perkembangan baru, startup baru, dan alat baru diluncurkan untuk menyelesaikan masalah mendasar mengubah notebook menjadi aplikasi siap produksi. Bahkan alat yang sudah ada pun memperluas cakrawala dan mengintegrasikan fitur baru untuk menjadi super tools MLOps.

Dalam blog ini, kita telah mempelajari alat MLOps terbaik untuk berbagai langkah proses MLOps. Alat-alat ini akan membantu Anda selama tahap eksperimen, pengembangan, penyebaran, dan pemantauan.

Jika Anda baru dalam machine learning dan ingin menguasai keterampilan esensial untuk mendapatkan pekerjaan sebagai ilmuwan machine learning, cobalah Career Track Machine Learning Scientist with Python kami.

Jika Anda seorang profesional dan ingin mempelajari lebih lanjut tentang Praktik Standar MLOps, baca artikel kami Praktik Terbaik MLOps dan Cara Menerapkannya serta lihat Skill Track Fundamental MLOps kami.

MLOps Tools FAQs

Apa itu Alat MLOps?

Alat MLOps membantu menstandarkan, menyederhanakan, dan memperlancar ekosistem ML. Alat-alat ini digunakan untuk pelacakan eksperimen, manajemen metadata model, orkestrasi, optimasi model, versi alur kerja, penyebaran dan penyajian model, serta pemantauan model di produksi.

Keterampilan apa yang dibutuhkan untuk menjadi MLOps Engineer?

- Kemampuan menerapkan solusi cloud.

- Pengalaman dengan Docker dan Kubernetes.

- Pengalaman Quality Assurance menggunakan pelacakan eksperimen dan versi alur kerja.

- Kemampuan membangun pipeline MLOps.

- Familiar dengan sistem operasi Linux.

- Pengalaman dengan kerangka ML seperti PyTorch, Tensorflow, dan TFX.

- Pengalaman dengan DevOps dan pengembangan perangkat lunak.

- Pengalaman dengan unit dan integration testing, validasi data dan model, serta pemantauan pasca penyebaran.

Cloud mana yang terbaik untuk MLOps?

AWS, GCP, dan Azure menyediakan berbagai alat untuk siklus hidup machine learning. Semuanya menyediakan solusi end-to-end untuk MLOps. AWS memimpin dari segi popularitas dan pangsa pasar. AWS juga menyediakan solusi mudah untuk pelatihan, penyajian, dan pemantauan model.

Apakah MLOps mudah dipelajari?

Tergantung pada pengalaman sebelumnya Anda. Untuk menguasai MLOps, Anda perlu mempelajari siklus hidup machine learning dan pengembangan perangkat lunak. Selain kemahiran kuat dalam bahasa pemrograman, Anda perlu mempelajari beberapa alat MLOps. Bagi engineer DevOps, mempelajari MLOps relatif mudah karena sebagian besar alat dan strateginya didorong oleh pengembangan perangkat lunak.

Apakah Kubeflow lebih baik daripada MLflow?

Tergantung pada kasus penggunaan. Kubeflow memberikan reprodusibilitas pada tingkat yang lebih besar daripada MLflow, karena ia mengelola orkestrasi.

- Kubeflow umumnya digunakan untuk menyebarkan dan mengelola sistem ML yang kompleks dalam skala besar.

- MLFlow umumnya digunakan untuk pelacakan eksperimen ML serta penyimpanan dan pengelolaan metadata model.

Bagaimana MLOps berbeda dari DevOps?

Keduanya adalah strategi pengembangan perangkat lunak. DevOps berfokus pada pengembangan dan pengelolaan sistem perangkat lunak skala besar, sedangkan MLOps berfokus pada penyebaran dan pemeliharaan model machine learning di produksi.

- DevOps: Continuous Integration (CI) dan Continuous Delivery (CD).

- MLOps: Continuous Integration, Continuous Delivery, Continuous Training, dan Continuous Monitoring.

Bagaimana Alat MLOps Berintegrasi dengan Alur Kerja Data Science yang Ada?

Alat MLOps dirancang untuk terintegrasi mulus dengan alur kerja data science yang ada. Biasanya mereka mendukung berbagai alat dan platform data science, menyediakan API untuk integrasi, serta menawarkan plugin atau ekstensi untuk lingkungan data science populer. Integrasi ini memungkinkan data scientist mempertahankan alur kerja saat ini sambil memanfaatkan manfaat MLOps untuk skalabilitas, reprodusibilitas, dan efisiensi penyebaran yang lebih baik.

Dapatkah Alat MLOps Membantu Explainability dan Fairness Model?

Ya, banyak alat MLOps menyertakan fitur untuk meningkatkan explainability dan fairness model. Mereka menawarkan fungsionalitas seperti interpretasi model, deteksi bias, dan metrik fairness, yang membantu memahami dan meningkatkan cara model mengambil keputusan. Ini penting untuk menerapkan AI yang bertanggung jawab dan menjaga kepatuhan terhadap standar regulasi.

Bisakah saya mengambil sertifikasi MLOps?

Sertifikasi khusus MLOps masih berkembang, tetapi ada beberapa sertifikasi yang berfokus pada machine learning dan data science yang mencakup keterampilan MLOps. Baca panduan sertifikasi MLOps kami untuk rinciannya.

Sebagai data scientist tersertifikasi, saya bersemangat memanfaatkan teknologi mutakhir untuk menciptakan aplikasi machine learning yang inovatif. Dengan latar belakang kuat di pengenalan ucapan, analisis dan pelaporan data, MLOps, conversational AI, dan NLP, saya mengasah keterampilan dalam mengembangkan sistem cerdas yang berdampak nyata. Selain keahlian teknis, saya juga komunikator andal yang mampu menyederhanakan konsep kompleks menjadi bahasa yang jelas dan ringkas. Karena itu, saya menjadi blogger yang dicari di bidang data science, membagikan wawasan dan pengalaman kepada komunitas profesional data yang terus berkembang. Saat ini, saya berfokus pada pembuatan dan penyuntingan konten, bekerja dengan large language model untuk mengembangkan konten yang kuat dan menarik agar membantu bisnis dan individu memaksimalkan data mereka.