Curso

Em novembro de 2022, a OpenAI lançou o ChatGPT. Levou apenas alguns dias para que ele tomasse o mundo de assalto com seus recursos sem precedentes. A revolução da IA generativa havia começado, e todos estavam fazendo a mesma pergunta: o que vem a seguir?

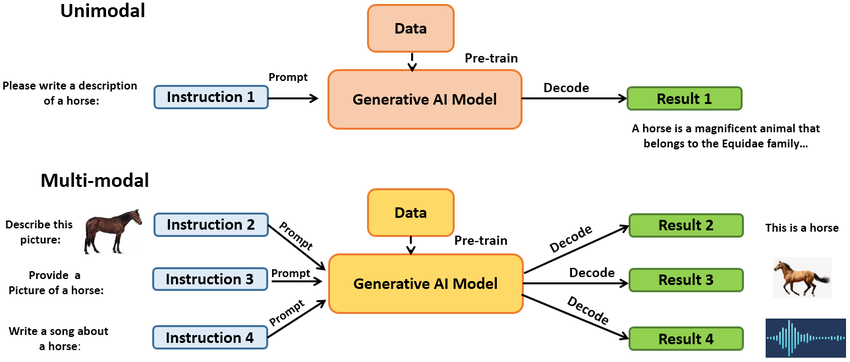

Naquela época, o ChatGPT e muitas outras ferramentas de IA generativa com base em modelos de linguagem grandes (LLMs) foram projetados para processar entradas de texto dos usuários e gerar saídas de texto. Em outras palavras, elas foram consideradas ferramentas de IA unimodais.

No entanto, isso foi apenas o começo. Estávamos apenas arranhando a superfície do que os LLMs podem fazer. Apenas um ano após o lançamento do ChatGPT, o progresso do setor é simplesmente surpreendente, tornando muito difícil localizar as fronteiras do possível, conforme analisamos em nosso artigo separado sobre os impactos de longo prazo do ChatGPT e da IA generativa.

Hoje, se tivéssemos que responder à pergunta "o que vem a seguir?", a melhor resposta provavelmente seria aprendizagem multimodal. Essa é uma das tendências mais promissoras da atual revolução da IA. Os modelos de IA generativa multimodal são capazes de combinar vários tipos de entradas e criar uma saída que também pode incluir vários tipos de saídas.

Neste guia, vamos apresentar a você o conceito de IA multimodal. Daremos uma olhada na definição de IA multimodal, seus conceitos principais, tecnologias subjacentes e aplicativos, além de como implementá-los em cenários do mundo real. Pronto para a multimodalidade? Vamos começar!

Entendendo a IA multimodal

Embora a maioria das ferramentas avançadas de IA generativa ainda seja incapaz de pensar como os humanos, elas estão apresentando resultados inovadores que nos aproximam um pouco mais do limiar da Inteligência Artificial Geral (AGI). Esse termo se refere a um sistema hipotético de IA que pode entender, aprender e aplicar conhecimento em uma ampla gama de tarefas, de forma muito semelhante a um ser humano.

No debate sobre como alcançar a AGI, uma questão central que precisamos abordar é como os seres humanos aprendem. E isso nos leva à forma como o cérebro humano funciona. Para encurtar a história, nosso cérebro depende dos cinco sentidos para coletar todos os tipos de informações do ambiente ao redor. Essas informações são então armazenadas em nossa memória, processadas para obter novas percepções e aproveitadas para tomar decisões.

Os primeiros modelos modernos de IA generativa, como o ChatGPT, eram considerados unimodais, ou seja, só podiam receber um tipo de dados como entrada e gerar o mesmo tipo de saída. Em particular, a maioria desses modelos foi projetada para processar solicitações de texto e gerar uma resposta de texto.

Isso faz sentido, pois esses modelos precisam de grandes quantidades de dados para serem treinados, e o texto não é apenas um tipo de dados que pode ser armazenado e processado facilmente, mas também está prontamente disponível. Não é de surpreender que a maioria dos dados de treinamento de ferramentas como o ChatGPT venha de diferentes fontes na Internet. Explicamos todos esses aspectos técnicos em nosso artigo O que é o ChatGPT , onde fazemos as perguntas diretamente ao ChatGPT.

Entretanto, a leitura é apenas uma das várias maneiras pelas quais os seres humanos podem aprender coisas novas e, para muitas tarefas, não é a mais eficaz.

A aprendizagem multimodal é um subcampo da IA que tenta aumentar a capacidade de aprendizagem das máquinas treinando-as com grandes quantidades de texto, além de outros tipos de dados, também conhecidos como dados sensoriais, como imagens, vídeos ou gravações de áudio. Isso permite que os modelos aprendam novos padrões e correlações entre as descrições de texto e suas imagens, vídeos ou áudio associados.

A aprendizagem multimodal está abrindo novas possibilidades para sistemas inteligentes. A combinação de vários tipos de dados durante o processo de treinamento torna os modelos de IA multimodais adequados para receber várias modalidades de tipo de entrada e gerar vários tipos de saídas. Por exemplo, o GPT-4, o modelo básico do ChatGPT, pode aceitar entradas de imagem e texto e gerar saídas de texto, e o modelo de texto para vídeo Sora da OpenAI, anunciado recentemente.

Conceitos básicos de IA multimodal

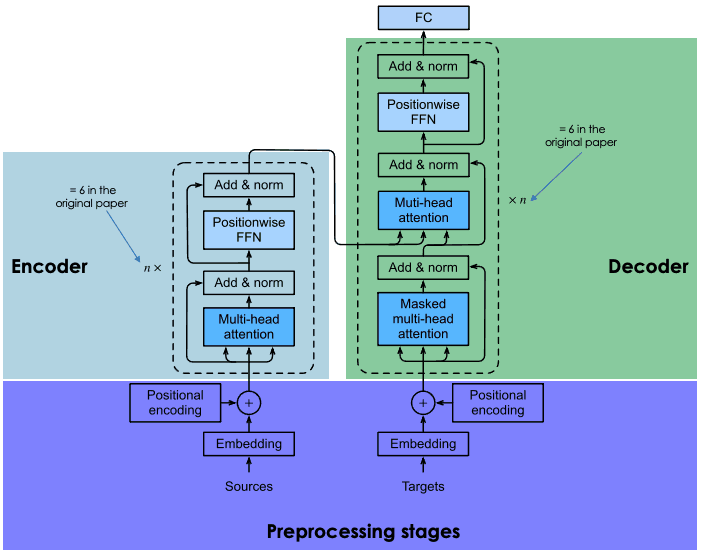

Os modelos de IA generativa multimodal acrescentam uma nova camada de complexidade aos LLMs de última geração. Esses modelos são baseados em um tipo de arquitetura neural chamada Transformer. Desenvolvidos por pesquisadores do Google, os transformadores dependem da arquitetura codificador-decodificador e do mecanismo de atenção para permitir o processamento eficiente dos dados.

Esse é um processo bastante complexo que pode ser difícil de entender. Se quiser obter mais detalhes sobre como funcionam os LLMs e os transformadores, recomendamos que você leia nosso guia Como funcionam os transformadores ou, se quiser colocar a mão na massa e aprender a criar LLMs passo a passo, confira nosso Curso de conceitos de modelos de linguagem grande (LLMs).

Fonte: DataCamp

A IA multimodal se baseia em técnicas de fusão de dados para integrar tipos de dados diferentes e criar uma compreensão mais completa e precisa dos dados subjacentes. O objetivo final é fazer previsões melhores combinando as informações complementares que as diferentes modalidades de dados fornecem.

IA unimodal vs. multimodal. Fonte: ResearchGate

Várias técnicas de fusão de dados podem ser implementadas para enfrentar os desafios multimodais. Dependendo do estágio de processamento no qual a fusão ocorre, podemos classificar as técnicas de fusão de dados em três categorias:

- Fusão precoce. Isso envolve a codificação das diferentes modalidades no modelo para criar um espaço de representação comum. Esse processo resulta em uma única saída invariante de modalidade que encapsula as informações semânticas de todas as modalidades.

- Fusão média. Isso envolve a combinação de modalidades em diferentes estágios de pré-processamento. Isso é feito por meio da criação de camadas especiais na rede neural projetada especificamente para fins de fusão de dados.

- Fusão tardia. Isso envolve a criação de vários modelos para processar as diferentes modalidades e combinar a saída de cada modelo em uma nova camada algorítmica.

Não existe uma única técnica de fusão de dados que seja a melhor para todos os tipos de cenários. Em vez disso, a técnica escolhida dependerá da tarefa multimodal em questão. Portanto, provavelmente será necessário um processo de tentativa e erro para encontrar o pipeline de IA multimodal mais adequado.

Tecnologias que potencializam a IA multimodal

A IA multimodal é o resultado do conhecimento acumulado em vários subcampos da IA. Nos últimos anos, os profissionais e acadêmicos de IA fizeram um progresso impressionante no armazenamento e processamento de dados em vários formatos e modalidades.

Abaixo, você pode encontrar uma lista dos domínios que estão alimentando o boom da IA multimodal:

Aprendizagem profunda

A aprendizagem profunda é um subcampo da IA que emprega um tipo de algoritmo chamado de rede neural artificial para lidar com tarefas complexas. A atual revolução da IA generativa é impulsionada por modelos de aprendizagem profunda, especialmente transformadores, que são um tipo de arquitetura neural.

O futuro da IA multimodal também dependerá de novos progressos nesse domínio. Em especial, a pesquisa é muito necessária para encontrar novas maneiras de aumentar os recursos dos transformadores, bem como novas técnicas de fusão de dados.

Confira nossa trilha de aprendizagem profunda em Python para aprofundar seu aprendizado nesse domínio promissor.

Processamento de linguagem natural (NLP)

A PNL é uma tecnologia essencial para a inteligência artificial, que preenche a lacuna entre a comunicação humana e a compreensão do computador. É um domínio multidisciplinar que capacita os computadores a interpretar, analisar e gerar linguagem humana, permitindo a interação perfeita entre humanos e máquinas.

Como a principal forma de comunicação com as máquinas é por meio de texto, não é de surpreender que a PNL seja essencial para garantir o alto desempenho dos modelos de IA generativa, inclusive os multimodais.

Interessado em PNL? Confira nosso curso de processamento de linguagem natural em Python para adquirir as principais habilidades de PNL necessárias para converter dados não estruturados em insights valiosos.

Visão computacional

A análise de imagens, também conhecida como visão computacional, compreende um conjunto de técnicas pelas quais os computadores podem "ver" e entender uma imagem. O progresso nesse setor permitiu o desenvolvimento de modelos de IA multimodais que podem processar imagens e vídeos como entradas e saídas.

Se você estiver interessado em se aprofundar nesse tópico fascinante, confira nossa trilha de habilidades de processamento de imagens com Python para incorporar as habilidades de processamento de imagens à sua caixa de ferramentas de ciência de dados.

Processamento de áudio

Alguns dos modelos de IA generativa mais avançados são capazes de processar arquivos de áudio como entradas e saídas. As possibilidades de processamento de áudio vão desde a interpretação de mensagens de voz até a tradução simultânea e a criação de músicas.

Confira nosso Curso de Processamento de Linguagem Falada em Python para aprender a carregar, transformar e transcrever a fala de arquivos de áudio brutos em Python.

Aplicativos de IA multimodal

O aprendizado multimodal permite que as máquinas adquiram novos "sentidos", aumentando sua precisão e capacidade de interpretação. Esses poderes estão abrindo as portas para uma infinidade de novos aplicativos em todos os setores e indústrias, incluindo:

IA generativa aumentada

A maior parte da primeira geração de modelos de IA generativa era de texto para texto, capaz de processar solicitações de texto dos usuários e fornecer respostas em texto. Os modelos multimodais, como o GPT-4 Turbo, o Google Gemini ou o DALL-E, trazem novas possibilidades que podem melhorar a experiência do usuário tanto na entrada quanto na saída. Seja aceitando avisos em várias modalidades ou gerando conteúdo em vários formatos, as possibilidades dos agentes de IA multimodais parecem ilimitadas.

Carros autônomos

Os carros autônomos dependem muito da IA multimodal. Esses carros são equipados com vários sensores para processar informações do ambiente em vários formatos. O aprendizado multimodal é fundamental para que esses veículos combinem essas fontes de maneira eficaz e eficiente para tomar decisões de inteligência em tempo real.

Biomedicina

A disponibilidade cada vez maior de dados biomédicos de biobancos, registros eletrônicos de saúde, imagens clínicas e sensores médicos, bem como de dados genômicos, está alimentando a criação de modelos de IA multimodal no campo da medicina. Esses modelos são capazes de processar essas diversas fontes de dados provenientes de várias modalidades para nos ajudar a desvendar os mistérios da saúde e das doenças humanas, bem como para tomar decisões clínicas inteligentes.

Ciências da Terra e mudanças climáticas

A rápida expansão de sensores terrestres, drones, dados de satélite e outras técnicas de medição está aumentando nossos recursos para entender o planeta. A IA multimodal é fundamental para combinar essas informações com precisão e criar novos aplicativos e ferramentas que possam nos ajudar em diversas tarefas, como monitoramento de emissões de gases de efeito estufa, previsão de eventos climáticos extremos e agricultura de precisão.

Os desafios da implementação de soluções multimodais de IA

O boom da IA multimodal traz infinitas possibilidades para empresas, governos e indivíduos. No entanto, como acontece com qualquer tecnologia nascente, implementá-las em suas operações diárias pode ser um desafio.

Em primeiro lugar, você precisa encontrar os casos de uso que atendam às suas necessidades específicas. Passar do conceito à implementação nem sempre é fácil, especialmente se você não tiver pessoas que entendam adequadamente os aspectos técnicos por trás da IA multimodal. No entanto, dada a atual lacuna de habilidades de alfabetização em dados, encontrar as pessoas certas para colocar seus modelos em produção pode ser difícil e caro, pois as empresas estão dispostas a pagar valores altos para atrair um talento tão limitado.

Por fim, ao falar sobre IA generativa, é obrigatório mencionar a acessibilidade econômica. Esses modelos, especialmente os multimodais, exigem recursos de computação consideráveis para funcionar, e isso significa dinheiro. Portanto, antes de adotar qualquer solução de IA generativa, é importante estimar os recursos que você deseja investir.

Riscos da IA multimodal

Como acontece com qualquer nova tecnologia, há várias armadilhas em potencial que devemos enfrentar com modelos de IA multimodais:

- Falta de transparência. A opacidade algorítmica é uma das principais preocupações associadas à IA generativa. Isso também se aplica à IA multimodal. Esses modos são frequentemente rotulados como modelos de "caixa preta" devido à sua complexidade, o que torna impossível monitorar seu raciocínio e funcionamento interno.

- Monopólio de IA multimodal. Considerando os recursos consideráveis necessários para desenvolver, treinar e operar um modelo multimodal, o mercado está altamente concentrado em um grupo de grandes empresas de tecnologia com o know-how e os recursos necessários. Felizmente, um número cada vez maior de LLMs de código aberto está chegando ao mercado, facilitando o entendimento e a operação dos LLMs por parte dos desenvolvedores, dos pesquisadores de IA e da sociedade.

- Preconceito e discriminação. Dependendo dos dados usados para treinar modelos de IA multimodal, eles podem conter vieses que podem resultar em decisões injustas que, muitas vezes, exacerbam a discriminação, especialmente contra grupos minoritários. Como já mencionado, a transparência é essencial aqui para entender melhor e abordar os possíveis vieses.

- Questões de privacidade. Os modelos de IA multimodal são treinados com grandes quantidades de dados provenientes de várias fontes e formatos. Em muitos casos, ele pode conter dados pessoais. Isso pode levar a problemas e riscos relacionados à privacidade e à segurança dos dados.

- Considerações éticas. A IA multimodal pode, às vezes, levar a decisões que têm sérias implicações em nossas vidas, com impactos significativos em nossos direitos fundamentais. Exploramos a ética da IA generativa em um post separado.

- Considerações ambientais. Pesquisadores e defensores do meio ambiente estão preocupados com a pegada ambiental associada ao treinamento e à operação de modelos generativos de IA. Os proprietários de modelos proprietários de IA multimodal raramente publicam informações sobre a energia e os recursos consumidos pelos modelos, nem sobre a pegada ambiental associada, o que é extremamente problemático com a rápida adoção dessas ferramentas.

O futuro da IA multimodal

A IA multimodal é certamente a próxima fronteira da revolução da IA generativa. O rápido desenvolvimento do campo da aprendizagem multimodal está estimulando a criação de novos modelos e aplicativos para todos os tipos de finalidades. Estamos apenas no início dessa revolução. À medida que novas técnicas forem desenvolvidas para combinar mais e novas modalidades, o escopo da IA multimodal será ampliado.

Entretanto, com grande poder vem grande responsabilidade. A IA multimodal traz sérios riscos e desafios que precisam ser abordados para garantir um futuro justo e sustentável.

Se você quiser começar a usar a IA generativa, o DataCamp o ajudará. Confira nossos cursos, blogs e materiais dedicados: