programa

"¿Mil millones de euros?" Tenía que asegurarme de que lo había oído bien.

Me quedé alucinado cuando oí el importe que los modelos de riesgo crediticio sancionarían automáticamente en un año: ¡los modelos en los que yo trabajaría! Me quedé aún más sorprendido cuando me di cuenta de que los sistemas de inteligencia artificial que gestionaban ese dinero funcionaban con simples modelos de regresión. Esto me enseñó una valiosa lección: la solución óptima no siempre es la más compleja.

Trabajando para un gran banco en Irlanda, he visto muchas formas de aplicar la IA. Además de la concesión de préstamos, incluyen la detección de fraudes, el modelado de bajas de clientes y los bots de atención al cliente. Hablaremos de todas estas aplicaciones y de los retos a los que se enfrentan.

Estos retos, como la normativa, la interpretabilidad de los modelos, las consideraciones éticas y la resistencia al cambio, hacen que el sector se incline a menudo por soluciones sencillas. Aun así, veremos que hay aplicaciones en las que se necesitan métodos de IA más avanzados. Terminamos debatiendo cómo pueden utilizarse algunos de ellos en el futuro.

Aplicaciones de la IA en la banca

Desde el cálculo de las reservas de capital hasta la evaluación de las estrategias de marketing, el análisis estadístico influye en casi todas las decisiones de un banco. Muchas personas, incluidos científicos de datos, analistas, gestores, responsables de negocio y reguladores, necesitarán a menudo consultar el análisis o los informes basados en él.

El machine learning y las predicciones de modelos estadísticos pueden ser una parte importante de este análisis. Sin embargo, utilizarlos de este modo no se consideraría IA.

IA es cuando se utiliza un modelo para automatizar una decisión. Sus predicciones se introducen en un sistema. El sistema contiene reglas basadas en la predicción y otras variables que conducen a una decisión. Los llamamos "sistemas de IA".

El equipo en el que trabajé se dedicaba principalmente a desarrollar estos sistemas para sancionar automáticamente nuevos préstamos. El modelo más importante que impulsa estos sistemas se denomina modelo de riesgo crediticio.

Evaluación del riesgo crediticio

Cuando solicites un préstamo a un banco, te someterás a una evaluación del riesgo crediticio. Esto puede implicar calcular la pérdida esperada en caso de impago o la probabilidad de impago, es decir, la probabilidad de que no puedas devolver el préstamo debido a dificultades financieras. Es esta última predicción la que suele impulsar la decisión de sancionar (conceder) un préstamo.

Cómo modelamos el riesgo de crédito

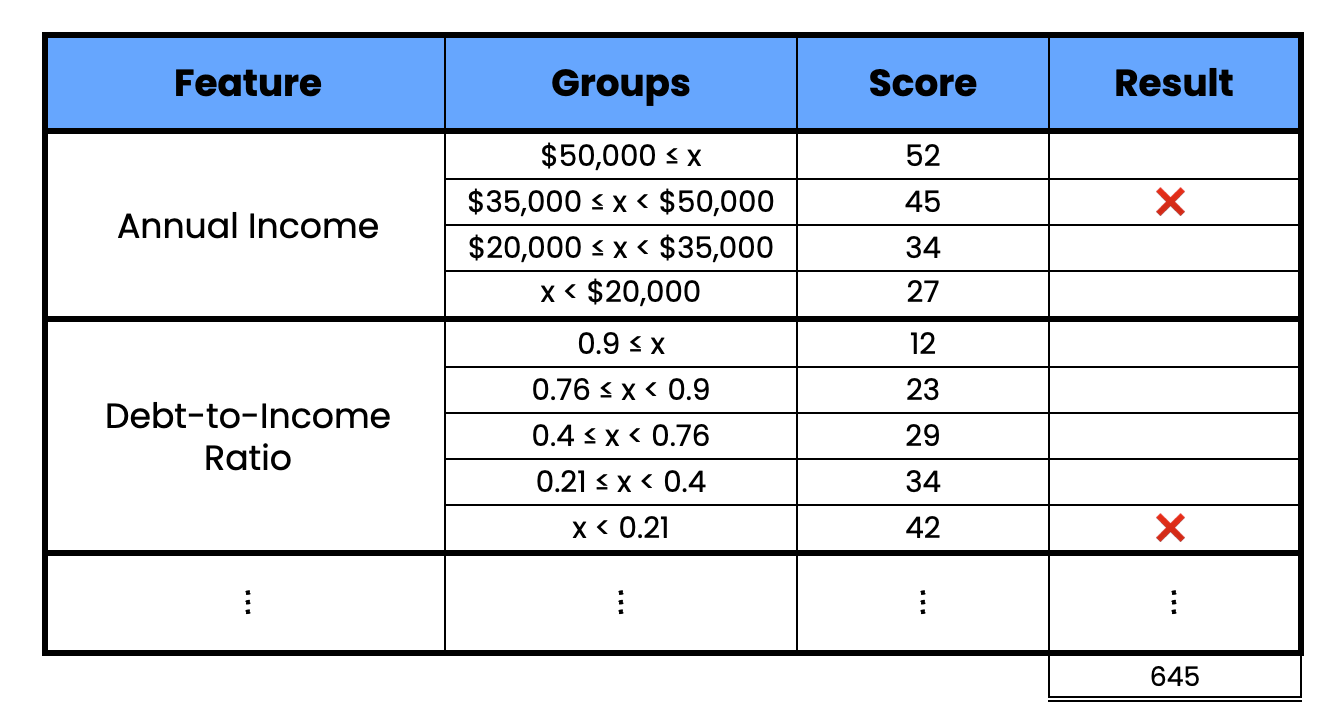

Desde antes de la invención de los ordenadores, los bancos han estado evaluando el riesgo crediticio. Esto se hizo principalmente utilizando una "tarjeta de calificación crediticia".

Como se ve a continuación, se tendrán en cuenta varias características de un prestatario potencial. Obtendrás una puntuación en función del grupo en el que te encuentres para una característica determinada, y se suman todas para obtener una puntuación final. Cuanto mayor sea su puntuación, menor será la probabilidad de impago.

Ejemplo de tarjeta de calificación crediticia (fuente: autor)

En el pasado, se creaban principalmente mediante el "juicio de expertos". Es otra forma de decir que una persona trajeada decidió los valores. Y, sí, esto era tan tendencioso como parece. Ahora, los bancos tienen acceso a grandes cantidades de datos y potencia de cálculo para crear tarjetas de calificación crediticia estadísticamente óptimas. Como veremos más adelante, esto también puede producir resultados más justos.

En términos de datos, hay mucho con lo que trabajar. Internamente, un banco tiene acceso a todo su historial de transacciones y al comportamiento de sus deudas en el pasado. Externamente, la mayoría de los países dispondrán de registros públicos sobre deudas anteriores e impagos en todas las entidades de crédito.

Todas estas fuentes pueden utilizarse para crear características de los modelos. Algunos bancos pueden incluso llegar a utilizar datos de dispositivos como su geolocalización. Aunque, en ese punto, pueden empezar a toparse con algunas consideraciones normativas y éticas.

El proceso de creación de estas tarjetas de calificación crediticia ha cambiado mucho, pero el producto final es el mismo. Las características del modelo se discretizar. Para ello se utiliza la ponderación de las pruebas (Weight of Evidence, WOE) para maximizar la diferencia en las tasas de impago con cada grupo de características. A continuación, podemos asignar una puntuación en función de en qué medida un grupo modifica la probabilidad de impago. Por tanto, al igual que antes, la puntuación final puede utilizarse para evaluar la probabilidad de que el prestatario no pague el préstamo.

Cómo se utilizan las tarjetas de calificación crediticia

Estas tarjetas de calificación crediticia constituyen la base de un sistema de inteligencia artificial utilizado para conceder préstamos automáticamente. En su forma más simple, es un límite estricto. Si la puntuación es inferior a este límite, se deniega el préstamo.

Las normas adicionales también pueden basarse en la estrategia del banco, la normativa u otras características como la edad del cliente. Como veremos en la próxima sección, los sistemas más complejos pueden utilizar predicciones de varios modelos.

En la práctica, estos sistemas de IA se utilizan para sancionar préstamos personales o a pequeñas empresas. Los importes más elevados, como hipotecas o préstamos a empresas, no están totalmente automatizados. Estos casos pueden ser demasiado singulares o la cantidad de dinero demasiado grande para sancionarlos sin que una persona tome la decisión final. A menudo, la decisión seguirá tomándose con la ayuda de una tarjeta de calificación crediticia.

Con todos los avances en la recopilación y automatización de datos, sería de esperar que los modelos subyacentes sean complejos. Pues no es así.

La regresión logística se utiliza para calcular las probabilidades de impago y crear tarjetas de calificación crediticia. En la sección dedicada a los retos analizaremos algunas razones. Tienen que ver con la interpretabilidad del modelo, la regulación y la equidad. Sin embargo, la razón principal es que la regresión logística es suficientemente precisa.

El impago del que hemos hablado se produce cuando alguien tiene problemas financieros debido a malas decisiones o a acontecimientos ajenos a su control. Lo importante es que estas personas no quieren entrar en mora. Esto significa que las relaciones subyacentes que impulsan el riesgo de crédito se mueven con lentitud. Esto nos da tiempo para elaborar rasgos lineales que capten estas relaciones de forma interpretable. Sin embargo, hay otros tipos de impagos que no son tan sencillos.

Detección y prevención del fraude

En medicina, el machine learning predice cosas complejas, como si un tumor es benigno o maligno. Ahora, imagina que el tumor fuera consciente de ello y que pudiera cambiar su apariencia para evitar ser detectado. De repente, esto se convierte en un problema mucho más difícil de resolver. Del mismo modo, esta es la razón por la que la detección del fraude es tan difícil.

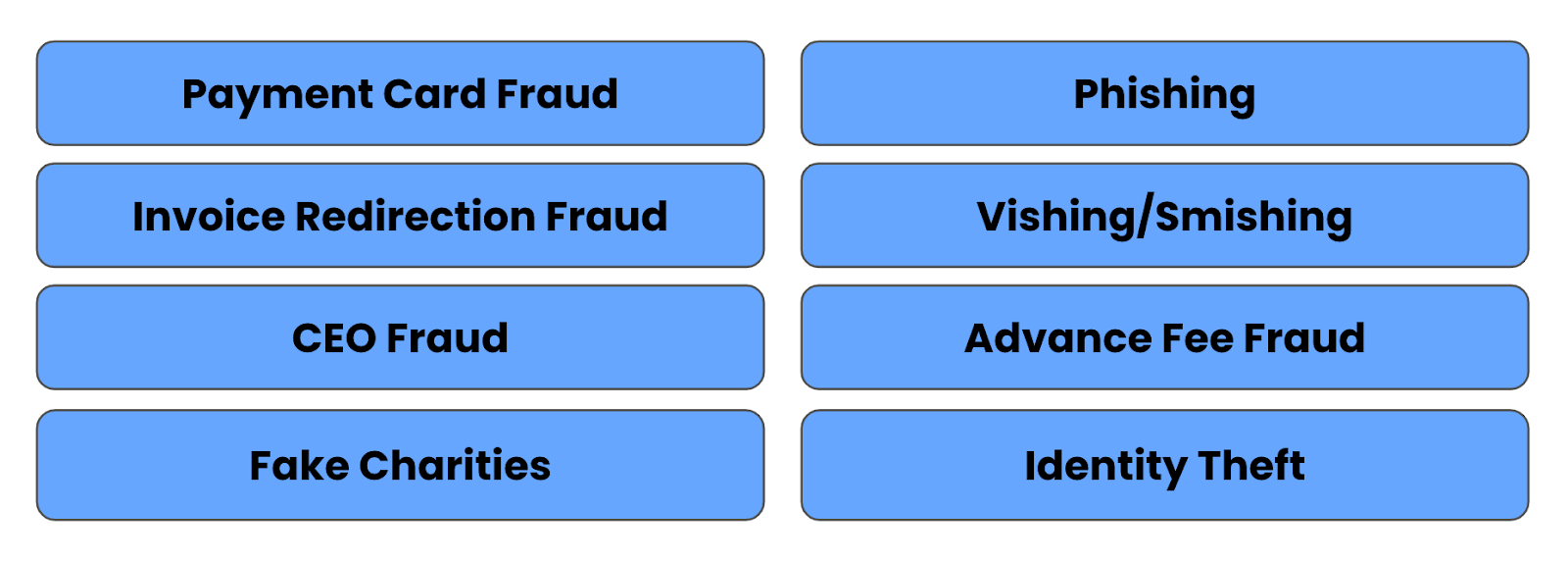

Hay muchos tipos de fraude. En el contexto de la concesión automatizada de préstamos, el fraude se produce cuando el prestatario nunca tuvo la intención de efectuar los reembolsos. Su objetivo es conseguir el préstamo y desaparecer con el dinero. El prestatario podría haber exagerado sus ingresos mensuales, haber ocultado que tiene otras deudas que pagar o incluso haber robado la identidad de alguien para hacer la solicitud. Sea cual sea la forma en que lo consigan, consideraríamos que se trata de un impago por fraude.

Tipos de fraude (fuente: autor)

Cómo predecimos el fraude

La naturaleza del impago del riesgo de crédito significa que podemos agregar transacciones para tener una idea general del comportamiento de la persona. En caso de fraude, las transacciones individuales pueden ser importantes. También examinamos un conjunto más diverso de fuentes de datos, como los datos de los dispositivos y el historial de comunicaciones.

Otro aspecto a tener en cuenta es que la naturaleza cambiante del fraude, lo que significa que tenemos que sacar los modelos más rápidamente. Todo esto significa que los modelos lineales a menudo no están a la altura del reto.

Por eso es habitual utilizar modelos no lineales como Random Forests y XGBoost. Las redes neuronales también pueden ayudar si queremos incorporar datos de texto. Con estos modelos, se pone menos énfasis en la ingeniería de características, lo que ahorra un tiempo valioso y nos permite modelar comportamientos que no se comprenden del todo.

El inconveniente es que todos ellos siguen siendo modelos predictivos. Queremos detectar nuevos casos de fraude antes de que se produzcan. Con los modelos predictivos, necesitamos un conjunto de datos de entrenamiento de casos de fraude etiquetados. En otras palabras, ¡primero hay que esperar a que se produzca el fraude!

Por eso también podemos evaluar posibles casos de fraude utilizando métodos no supervisados, como algoritmos de agrupación o modelos de clase única, como Isolation Forest. Pueden ayudar a identificar clientes con comportamientos únicos o, en términos más generales, valores atípicos.

Adversarial Machine Learning (AML)

Con el fraude, también tenemos que preocuparnos de que los atacantes ataquen a los propios modelos. Por ello, los modelos de fraude se solapan con una importante rama de la inteligencia artificial: el Adversarial Machine Learning o machine learning adverso.

El objetivo de este campo es encontrar puntos débiles ocultos en los modelos que puedan ser explotados por los atacantes. Alguien podría engañar al modelo para que haga predicciones incorrectas o revele información sensible. Los ataques por envenenamiento consisten en inyectar datos falsos en el proceso de entrenamiento para corromper los modelos sin que nos demos cuenta.

En cuanto a la automatización de los préstamos, la primera es la más destacada. Básicamente, un estafador intentará hacerse pasar por un buen cliente. Intentarán encontrar formas de disminuir su riesgo crediticio percibido. Podría hacerlo aumentando artificialmente sus ingresos o mintiendo en su solicitud. Los modelos de fraude se utilizan para cubrir estas posibles deficiencias de los modelos de riesgo de crédito. Sin embargo, también deben evaluarse para detectar posibles ataques de adversarios.

En última instancia, los numerosos tipos y la naturaleza del fraude hacen que a menudo tengamos que recurrir a modelos más complejos. En algunos casos, estos modelos pueden señalar posibles casos de fraude, que pueden ser revisados más a fondo por una persona.

En cuanto a la IA, los modelos de fraude a menudo se ejecutarán junto con los modelos de riesgo de crédito en los sistemas utilizados para sancionar préstamos automáticamente. Se complementan entre sí, ya que pretenden predecir el impago por motivos diferentes.

Tanto la detección del fraude como la evaluación del riesgo crediticio tienen que ver con la captación de nuevos clientes. Los clientes adecuados. Una vez que los tienen, los bancos se enfrentan a otro problema. ¿Cómo los conservan? Los siguientes dos apartados tratan algunas de las formas en las que la IA puede ayudar.

Pérdida de clientes

Los bancos utilizan estrategias similares basadas en IA para predecir si un cliente se marchará. Esto podría significar cerrar su cuenta bancaria o cambiar de proveedor hipotecario. También podrían reducir su negocio sin marcharse eliminando un descubierto, cancelando una tarjeta de crédito o transfiriendo una gran cantidad de fondos a otro banco.

Los bancos quieren intervenir antes de que se produzcan estos acontecimientos. Intentarán persuadir a los clientes insatisfechos para que utilicen tipos de interés más bajos, descuentos u otras ventajas especiales. Gran parte de esto puede ser un proceso totalmente automatizado.

Los bancos utilizan modelos para predecir si es probable que una persona o empresa deje de pagar en el futuro (es decir, entre en mora) o incumpla por completo. Una vez más, el banco querrá intervenir antes de que esto ocurra. Pueden ofrecer asesoramiento financiero o la oportunidad de reestructurar su deuda. Incluso un simple mensaje automático recordándoles los pagos futuros puede ser eficaz.

Atención al cliente y chatbots

Otra área en la que la automatización puede ayudar es cuando los clientes buscan activamente la ayuda del banco. Puede que necesiten asesoramiento para abrir una cuenta de ahorro o realizar pagos por Internet. Muchas de estas consultas serán repetitivas, y un chatbot dotado de IA puede gestionarlas. Puede dar respuestas más rápidamente y dejar las tareas más complejas a los humanos.

Este es también un ámbito en el que puede aplicarse la IA más avanzada. Muchas empresas están actualizando sus chatbots para utilizar LLM e IA generativa. Estos potentes modelos han potenciado el chatbot de un banco, permitiéndole gestionar consultas más complejas e incluso ofrecer asesoramiento personal. Sin embargo, debemos desconfiar de estos últimos. Esto tiene que ver con el entorno altamente regulado en el que operan los bancos.

Retos de la IA en la banca

Los verdaderos retos a los que se enfrenta la IA en la banca no suelen ser técnicos. Las dificultades relacionadas con la gestión de datos y el desarrollo de modelos se han resuelto en gran medida. Los inconvenientes a los que se enfrenta la adopción de métodos avanzados de IA proceden del entorno en el que operan los bancos, los procedimientos establecidos y una baja tolerancia al riesgo.

Regulación, explicabilidad y transparencia

Desde la crisis financiera de 2008, digamos que los bancos no tienen tanto margen para tomar sus propias decisiones. Se enfrentan a un entorno normativo mucho más estricto que determina la cantidad que deben mantener en reservas de capital, el nivel de riesgo que pueden asumir e incluso los tipos de tecnología que pueden implantar. Esto último significa que sólo determinados tipos de modelos pueden aplicarse a algunas tareas. Por ejemplo, las reservas de capital pueden tener que calcularse con un modelo lineal y características predefinidas.

A menudo es necesario aclarar y justificar el proceso de toma de decisiones para los préstamos. Esto significa explicar a un regulador cómo hacen predicciones los modelos. Aunque esto no restringe necesariamente el tipo de modelos que podemos utilizar, sí que implica ciertas complicaciones. Como ya se ha mencionado, ésta es una de las razones por las que se utilizan modelos lineales para la modelización del riesgo de crédito. Cualquier mejora en el rendimiento derivada del uso de modelos no lineales se ve contrarrestada por la mayor carga que supone explicarlos.

Considera las ideas de Cynthia Rudin sobre este tema:

En lugar de intentar crear modelos que sean intrínsecamente interpretables, recientemente se ha producido una explosión de trabajos sobre "ML explicable", en los que se crea un segundo modelo (posthoc) para explicar el primer modelo de caja negra. Esto es problemático. A menudo, las explicaciones no son fiables y pueden ser engañosas, como veremos a continuación. En cambio, si utilizamos modelos que son intrínsecamente interpretables, proporcionan sus propias explicaciones, que son fieles a lo que el modelo realmente calcula.

Cynthia Rudin, Duke University, Durham, NC, USA

Hay otras aplicaciones en las que sí tiene sentido utilizar métodos más avanzados. Los modelos de rotación de clientes y los bots de atención al cliente pueden enfrentarse a un menor escrutinio normativo.

Para la predicción del fraude, el mayor rendimiento proporciona suficiente movimiento para realizar el trabajo que supone explicar los modelos de caja negra. En este caso, tendrás que utilizar métodos de IA explicables como SHAP para explicar tus modelos. Es probable que también tengas que explicar el propio método de IA explicable.

Si quieres saber más sobre SHAP y explicabilidad, consulta esta introducción a los valores SHAP y este artículo sobre IA explicable.

Privacidad y seguridad de los datos

Los bancos tienen acceso a detalles íntimos de tu vida. Imagina que alguien se hiciera con todas las transacciones que has hecho. Cada tienda que visitaste.

La seguridad debe ser estricta para evitar filtraciones de datos. También es una de las principales razones por las que los bancos evitan nuevas tecnologías como los LLM. A menudo, el uso de estos modelos requiere el envío de datos a un tercero a través de su API. Los riesgos para la seguridad son mayores que los beneficios potenciales.

Al mismo tiempo, los bancos deben ser conscientes de cómo utilizan sus datos. La normativa de la que hemos hablado hasta ahora se ha centrado en el riesgo de crédito. Los bancos pueden enfrentarse a otras normativas, como el GDPR, que restringen qué datos recopilan y cómo pueden utilizarlos.

Además, la Ley de IA de la UE restringirá el uso de la IA. Esto puede repercutir en las demás aplicaciones de las que hemos hablado. Por ejemplo, es posible que no se les permita utilizar los datos de las transacciones para venderte nuevos productos.

Consideraciones éticas

Las decisiones que toman los modelos en banca pueden tener graves consecuencias. Podrían denegarte una hipoteca o una empresa podría no obtener un préstamo que necesita desesperadamente para sobrevivir.

Es crucial que estas decisiones se tomen de forma justa y que no discriminen a un determinado grupo de personas. Dependiendo del banco, esto puede ser exigido por la legislación o impulsado por su deseo de proteger su reputación.

La automatización puede reducir la injusticia. Al centralizar las decisiones de préstamo y hacerlas más transparentes, podemos mitigar el impacto de los sesgos humanos individuales. Por eso es aún más importante que los modelos que sustentan esas decisiones no sean injustos. Una forma de garantizarlo es mediante un análisis de equidad del algoritmo, que evalúa el rendimiento del modelo en función de variables protegidas como el sexo, la raza y el país de origen.

Otra manera de fomentar la imparcialidad adoptada habitualmente por los bancos es permitir al cliente impugnar una decisión automatizada. También deben poder solicitar información sobre los motivos de la decisión. Esto significa que, junto con la aceptación y el rechazo automáticos, los sistemas dispondrán de una tercera opción: ponerse en contacto con el prestamista. Un humano evaluaría por qué se tomó una decisión automatizada y corregiría las decisiones injustas.

Esta es otra razón por la que los modelos lineales simples pueden ser preferibles en todas las aplicaciones. Como ya se ha dicho, son intrínsecamente interpretables. Al ser más fáciles de entender, pueden ser analizados de forma crítica por un grupo más amplio de personas. Cualquier situación que pueda dar lugar a un posible sesgo puede identificarse antes de implantar un modelo.

Resistencia al cambio

La normativa, los problemas de seguridad y las consideraciones éticas suponen obstáculos para la adopción de métodos avanzados de IA. Sin embargo, el mayor obstáculo puede ser el propio banco.

Los bancos, sobre todo los grandes bancos tradicionales, tienen mucha aversión al riesgo. Han establecido formas de construir modelos y tarjetas de calificación crediticia. Incluso utilizan el mismo formato histórico.

Cualquier desviación de estos métodos requeriría una justificación importante, y tendrás que convencer a muchos niveles de gobernanza. En resumen, los grandes bancos se mueven despacio.

Por ello, las empresas de nueva creación y las empresas de tecnología financiera están en mejor situación para adoptar estos métodos. No tienen procedimientos establecidos y suelen tener menos aversión al riesgo. Sin embargo, carecen de las grandes cantidades de capital de los grandes bancos y de la mano de obra necesaria para cumplir la normativa de la que hemos hablado. Con el tiempo, es posible que los operadores más pequeños puedan avanzar posiciones gracias al mayor valor que aporta la IA avanzada.

El futuro de la IA en la banca

Cuando miramos al futuro de la IA en la banca, debemos reconocer que los métodos avanzados desempeñarán un papel importante.

La IA generativa reviste especial importancia. Aunque puede ser arriesgado aplicar estos modelos en aplicaciones orientadas al cliente, pueden ser útiles para desarrollar productos y modelos orientados al cliente. No se utilizan para predecir el riesgo de crédito, sino para ayudar a construir modelos de riesgo de crédito. Esto es especialmente cierto si tenemos en cuenta la naturaleza rutinaria de los modelos que esperamos construir en el sector bancario.

Muchos bancos van un paso más allá. Los bancos, como todas las organizaciones, tienen mucha documentación interna. Esto puede incluir todos los procedimientos de gestión corporativa, análisis histórico y modelización. Los sistemas RAG, impulsados por LLM, pueden convertir este tesoro de información en una base de datos consultable y un chatbot interno. Puede considerarse como un colega servicial que lo sabe todo sobre los bancos y está deseando ayudarte a ponerte al día.

Algunas empresas pueden incluso tolerar el riesgo que supone utilizar LLM en productos orientados al cliente. Podrían automatizar cosas como el asesoramiento financiero a los clientes a partir de sus datos bancarios. Sin embargo, es probable que las alucinaciones, unidas a la gravedad de un asesoramiento incorrecto, resulten demasiado arriesgadas para los bancos tradicionales. Al menos con el nivel actual de LLM.

Conclusión

Como científico de datos que trabaja en el sector bancario, es vital aprender continuamente, pero también pensar de forma crítica sobre cómo se puede aplicar la nueva tecnología. Hablamos de muchas aplicaciones potenciales, como el riesgo de crédito, el fraude y la pérdida de clientes.

Es importante estar al tanto de las nuevas tecnologías, ya que los métodos avanzados de IA pueden aplicarse a algunas de estas áreas. Sin embargo, a menudo descubrirás que es más importante una sólida comprensión de los fundamentos de la ciencia de datos y el machine learning.

A medida que el sector madure, también tendremos que adoptar una visión más holística de la IA. Las competencias responsables en materia de IA son fundamentales en un mundo en el que el machine learning se enfrenta a un escrutinio y una legislación cada vez mayores. Tenemos que saber interpretar los modelos, asegurarnos de que son justos y de que se protegen los datos sensibles. Muchos de estos son nuevos retos a los que se enfrentan los bancos, y tendremos que adaptarnos si queremos adoptar la IA.

Si quieres más información sobre la IA responsable, consulta este curso sobre ética de la IA.