Cursus

Le 6 novembre 2024, Google a apparemment révélé sans le vouloir l'IA Jarvis en publiant accidentellement une première version de cet agent d'IA sous la forme d'une extension sur le Google Chrome Web Store. Dans cet article, je vais explorer ce que pourrait être l'IA de Jarvis et comment elle pourrait changer radicalement notre façon de naviguer sur le web.

Qu'est-ce que Jarvis AI ?

La seule chose que nous savons à propos de Jarvis AI est qu'au début du mois de novembre, une extension Google Chrome nommée Jarvis a été lancée pour une courte période. Malgré sa brève apparition, la description de l'extension sur la page du magasin la décrit comme "un compagnon utile qui surfe sur le web pour vous". Cette description correspond à la fonctionnalité prévue de Jarvis en tant qu'agent d'intelligence artificielle. agent d'intelligence artificielle conçu pour automatiser des tâches sur le web.

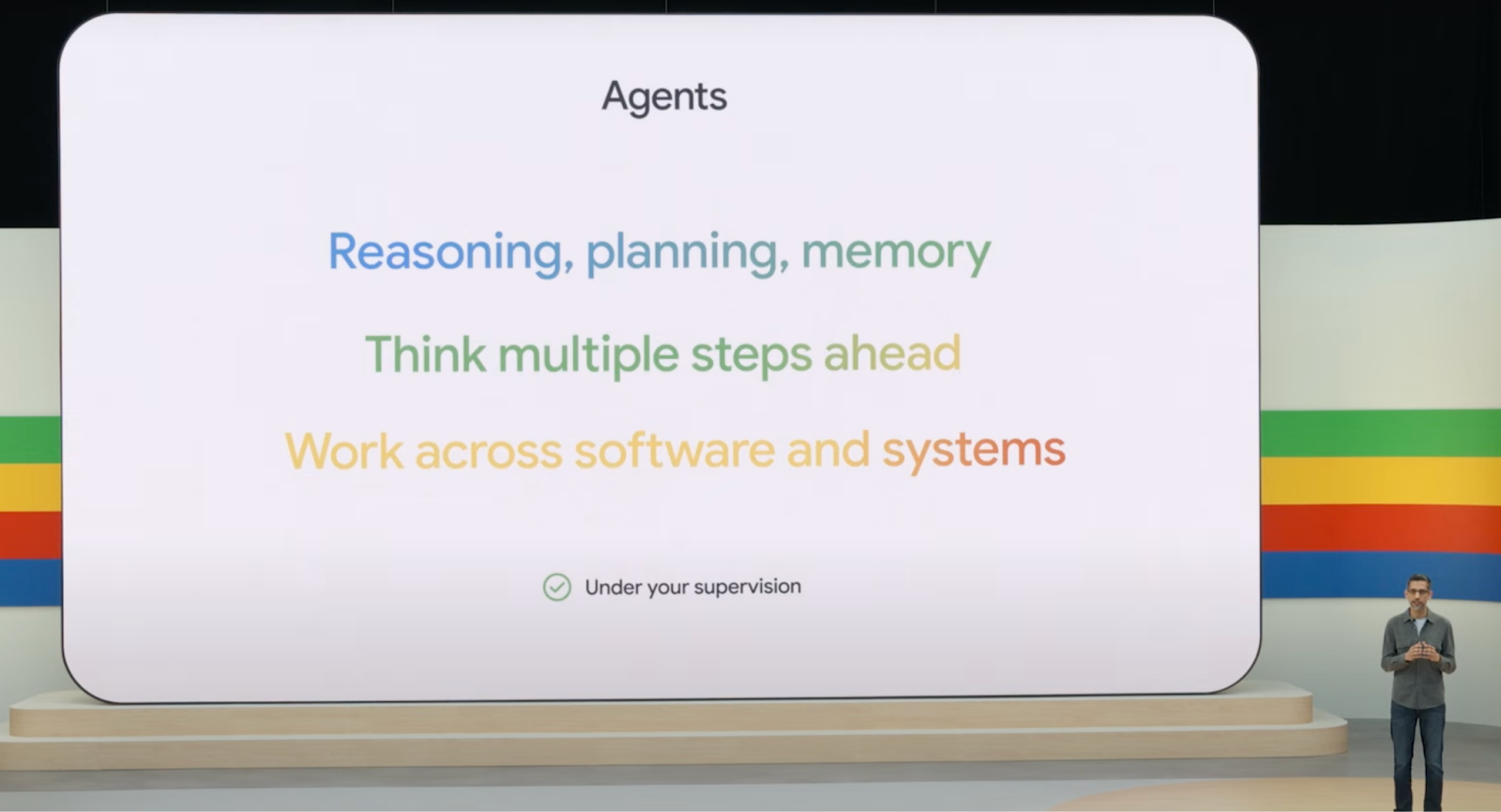

Dans le discours qu'ils ont prononcé lors de son discours inaugural en début d'annéeGoogle a présenté des agents d'intelligence artificielle inédits capables de contrôler le navigateur pour effectuer une grande variété de tâches. Je suppose que Jarvis AI pourrait être le produit qui se cache derrière cette présentation.

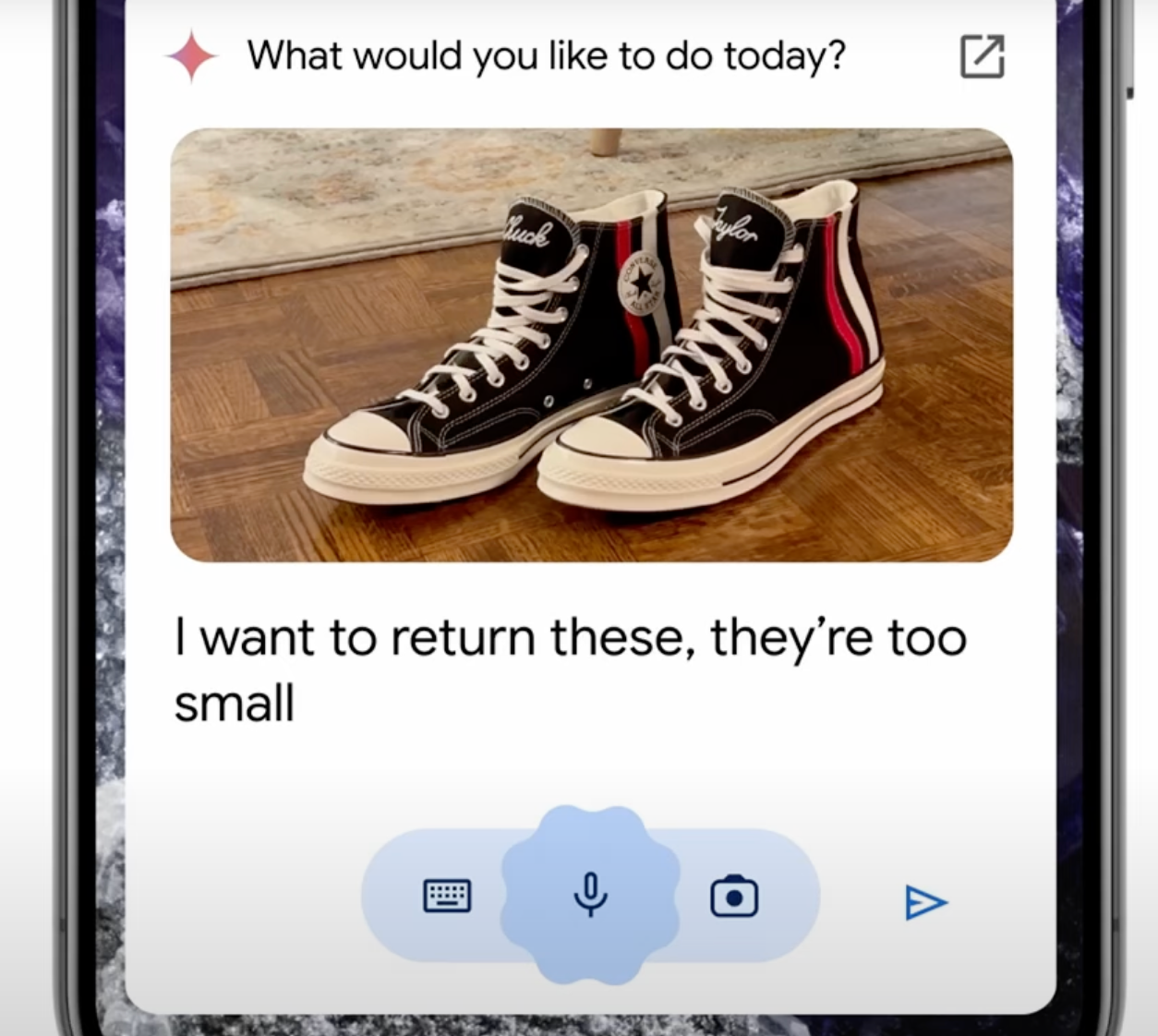

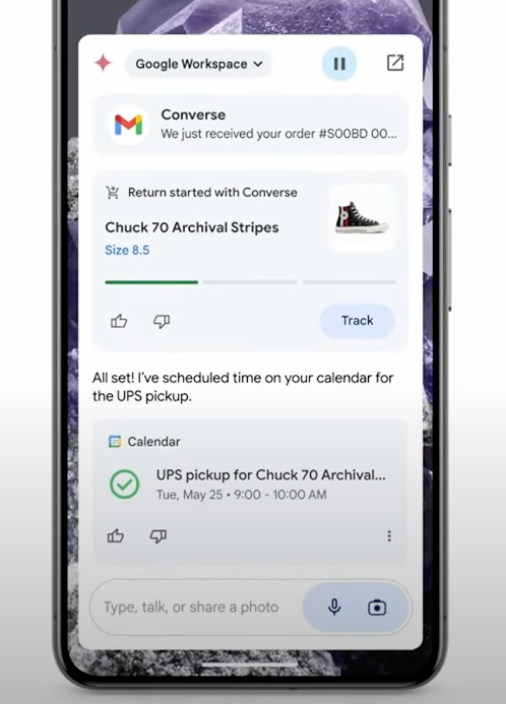

Dans leur présentation, ils donnent un exemple de retour de chaussures. Grâce aux agents d'intelligence artificielle, il nous suffirait d'indiquer que nous voulons rendre les chaussures, et l'agent effectuerait toutes les démarches de manière autonome.

Intégré au navigateur et à d'autres produits Google, tels que Gmail, l'agent peut compléter le processus de retour en suivant les étapes suivantes :

- Recherchez le reçu dans la boîte de réception.

- Localisez le numéro de commande dans l'e-mail.

- Remplissez le formulaire de retour.

- Planifiez un enlèvement.

Comment fonctionne Jarvis AI ?

Jarvis AI peut automatiser les tâches quotidiennes des utilisateurs sur le web, telles que la recherche, les achats en ligne et la réservation de vols ou de billets d'avion.

Jarvis utilise probablement une version spécialisée de la famille de modèles linguistiques Gemini de Google. grands modèles de langage de Google. Cela suggère que Jarvis utilise un modèle de "pensée" ou de raisonnement, ce qui contribue à sa capacité à gérer des tâches complexes et à fournir des réponses plus personnalisées. En outre, il devrait s'intégrer en profondeur aux services existants de Google, tels que Gmail, Maps et Search.

Cette intégration pourrait améliorer les capacités de Jarvis en lui donnant accès aux données des utilisateurs et en rationalisant divers processus, comme la récupération des reçus de Gmail pour les retours en ligne ou l'utilisation des données de localisation de Maps pour la planification des voyages.

Les modèles Gemini sont multimodaux et peuvent traiter différents types de données (texte, images, vidéo, audio, etc.) et trouver des connexions entre elles. Il est probable que l'agent aura accès au contenu du navigateur, ce qui lui permettra de visualiser, d'interpréter et d'interagir avec les éléments affichés à l'écran.

Il est important de noter que les informations concernant le fonctionnement interne et la dépendance à l'égard de technologies spécifiques sont basées sur des spéculations.

Jarvis AI vs. Autres agents d'IA

Comme je l'ai déjà mentionné, je pense que Jarvis est conçu pour automatiser les tâches quotidiennes sur le web. Jarvis se distingue par son intégration étroite avec le navigateur web Google Chrome. Jarvis n'est toutefois pas le seul dans ce domaine.

Utilisation de l'ordinateur d'Anthropic

Anthropic, la société à l'origine de Claudea également fait des progrès avec son propre agent d'IA, connu sous le nom d'agent d'utilisation de l'ordinateur. utilisation de l'ordinateur. Cet agent est capable d'interagir avec diverses applications au-delà des navigateurs web. L'agent d'Anthropic est entré dans sa phase bêta publique en octobre 2024, montrant sa capacité à déplacer le curseur, à cliquer sur des boutons et à taper du texte, comme le ferait un utilisateur humain.

Malgré leurs différences en termes de stade de développement et de champ d'action, l'utilisation de l'ordinateur par Jarvis et Anthropic a un objectif commun : automatiser des tâches en imitant l'interaction entre l'homme et l'ordinateur. Les deux agents s'appuient probablement sur des mécanismes sophistiqués de capture et d'interprétation d'écran pour comprendre le contexte des demandes des utilisateurs et exécuter les actions appropriées.

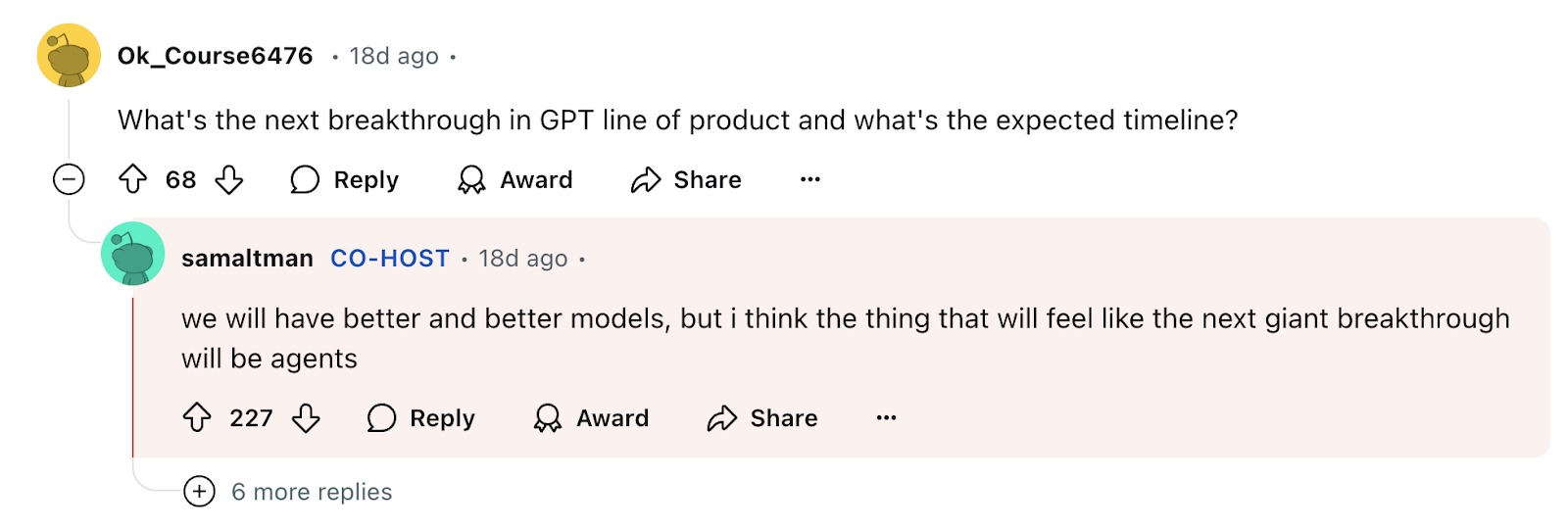

Opérateur d'OpenAI

L'OpenAI s'apprête à présenter "Operator", un agent d'IA autonome conçu pour effectuer des tâches au nom des utilisateurs, telles que l'écriture de code et la réservation d'arrangements de voyage. Selon Bloombergl'opérateur est prévu pour une sortie en avant-première en janvier 2025.

Sam Altman répondant un Reddit AMA

La machine à former les outils de Meta

Meta AI Research a présenté Toolformer, un modèle de langage capable d'utiliser de manière autonome des outils externes pour améliorer ses performances dans diverses tâches. Détaillé dans l'article "Toolformer : Language Models Can Teach Themselves to Use Tools", le modèle est entraîné à déterminer quelles API appeler, quand les appeler, quels arguments passer et comment incorporer les résultats dans les futures prédictions de jetons.

Cette approche auto-supervisée ne nécessite qu'une poignée de démonstrations pour chaque API, ce qui permet au modèle d'utiliser efficacement des outils tels que des calculatrices, des systèmes de réponse aux questions, des moteurs de recherche, des systèmes de traduction et des calendriers.

Défis des agents d'IA

En général, les agents d'intelligence artificielle posent une série de défis et de considérations, notamment en ce qui concerne la vie privéela précision et les implications éthiques.

Préoccupations en matière de protection de la vie privée

Si l'automatisation des tâches ennuyeuses et fastidieuses peut sembler attrayante, cette commodité s'accompagne d'un sentiment d'inconfort. Est-ce que je veux que Google ou toute autre entreprise ait un accès total à mon ordinateur ? Cette idée me met profondément mal à l'aise.

Les questions de protection de la vie privée revêtent une grande importance. Google doit garantir aux utilisateurs que leurs données seront traitées de manière sûre et responsable. Ils devront mettre en œuvre des mesures de sécurité robustes et des pratiques transparentes de traitement des données afin d'atténuer les risques potentiels de violation ou d'utilisation abusive des données. risques potentiels de violation ou d'utilisation abusive des données. L'établissement de lignes directrices claires sur l'accès, le stockage et l'utilisation des données et la possibilité pour les utilisateurs d'exercer un contrôle granulaire sur leurs préférences en matière de partage des données seront essentiels pour instaurer la confiance et garantir l'adoption par les utilisateurs.

Précision et fiabilité

Que se passe-t-il lorsque mon agent d'intelligence artificielle commet une erreur ? Lorsqu'un chatbot d'IA commet une erreur, il peut fournir des informations incorrectes, mais aucune mesure n'est prise directement. Si je demande à un chatbot IA de m'aider à planifier un voyage, il me propose un plan textuel, mais c'est toujours à moi qu'il incombe de faire les réservations, de gérer les paiements, etc. Il y a une couche humaine pour éviter les résultats indésirables. Cependant, lorsque les agents d'IA agissent dans le monde réel, ces actions peuvent avoir des conséquences réelles et non désirées.

Qui est responsable lorsque l'agent d'intelligence artificielle réserve le mauvais vol ou renvoie les mauvaises chaussures ? J'imagine que ces agents demanderont à l'utilisateur d'effectuer chaque action, mais je ne suis pas sûr que cela suffise à éviter les erreurs dans des scénarios plus complexes.

Les entreprises comme Google doivent donner la priorité à des tests rigoureux et à des processus de validation afin de minimiser ces inexactitudes. Il sera essentiel de mettre en œuvre des mécanismes de vérification des faits, de recoupement des informations et de fournir aux utilisateurs des avertissements clairs sur les risques d'erreurs.

Implications éthiques

Les implications éthiques de Jarvis et des agents d'intelligence artificielle, en général, vont au-delà de la protection de la vie privée et de la précision. Les entreprises doivent également prendre en compte l'impact sociétal plus large de ces agents, y compris le déplacement potentiel d'emplois et la création de nouvelles dépendances à l'égard des systèmes d'IA.

Conclusion

Tout ce que nous avons dit sur Jarvis AI est spéculatif. Jusqu'à sa publication, nous ne saurons pas avec certitude ce qu'il fait. Cependant, une chose est sûre : Les agents d'intelligence artificielle arrivent et représentent la prochaine étape de la révolution de l'intelligence artificielle.

Bien que je reconnaisse que l'automatisation des tâches est incroyablement utile et qu'elle permet de gagner beaucoup de temps, je ne suis pas à l'aise avec l'idée de donner le contrôle de mon ordinateur à une IA (ou à n'importe qui d'autre, d'ailleurs).

Ces dernières années, les dangers potentiels de l'IA ont fait l'objet de nombreuses discussions. Je pense que tant que les IA se limitent à des chatbots et ne peuvent pas effectuer d'actions dans le monde réel, les risques sont minimes. Oui, une IA peut donner des instructions à quelqu'un sur la manière de faire quelque chose de nuisible, mais cette personne doit encore agir en conséquence. Si quelqu'un veut vraiment apprendre cela, il peut acquérir les connaissances de toute façon, avec suffisamment de temps. Avec les agents d'IA, nous perdons cette couche de protection et cela semble vraiment dangereux car nous fournissons à ces agents de plus en plus de capacités.

Je pense que l'évolution vers des agents d'IA est inévitable, mais qu'elle doit être abordée avec beaucoup de prudence.