Cours

En novembre 2022, OpenAI a lancé le chatGPT. Il n'a fallu que quelques jours pour qu'il prenne le monde d'assaut grâce à ses capacités sans précédent. La révolution de l'IA générative avait commencé et tout le monde se posait la même question : quelle est la prochaine étape ?

À l'époque, ChatGPT et les nombreux autres outils d'IA générative alimentés par de grands modèles de langage (LLM) étaient conçus pour traiter les entrées textuelles des utilisateurs et générer des sorties textuelles. En d'autres termes, ils étaient considérés comme des outils d'IA unimodaux.

Mais ce n'était qu'un début. Nous n'avons fait qu'effleurer la surface de ce que les LLM peuvent faire. Un an seulement après le lancement du ChatGPT, les progrès de l'industrie sont tout simplement stupéfiants, ce qui rend très difficile la localisation des frontières du possible, comme nous l'avons analysé dans notre article distinct sur les impacts à long terme du ChatGPT et de l'IA générative.

Aujourd'hui, si nous devions répondre à la question de l'avenir, la meilleure réponse serait probablement l'apprentissage multimodal. C'est l'une des tendances les plus prometteuses de la révolution de l'IA en cours. Les modèles génératifs multimodaux d'IA sont capables de combiner différents types d'entrées et de créer un résultat qui peut également comprendre plusieurs types de sorties.

Dans ce guide, nous allons vous présenter le concept de l'IA multimodale. Nous examinerons la définition de l'IA multimodale, ses concepts fondamentaux, les technologies sous-jacentes et les applications, ainsi que la manière de les mettre en œuvre dans des scénarios réels. Prêt pour la multimodalité ? Commençons !

Comprendre l'IA multimodale

Bien que les outils d'IA générative les plus avancés soient encore incapables de penser comme les humains, ils produisent des résultats révolutionnaires qui nous rapprochent un peu plus du seuil de l'intelligence générale artificielle (AGI). Ce terme désigne un système d'IA hypothétique capable de comprendre, d'apprendre et d'appliquer des connaissances à un large éventail de tâches, à l'instar d'un être humain.

Dans le débat sur la manière de réaliser l'AGI, une question centrale que nous devons aborder est celle de savoir comment les humains apprennent. Cela nous amène à la question du fonctionnement du cerveau humain. Pour faire court, notre cerveau s'appuie sur nos cinq sens pour collecter toutes sortes d'informations sur le milieu environnant. Ces informations sont ensuite stockées dans notre mémoire, traitées pour en tirer de nouvelles connaissances et exploitées pour prendre des décisions.

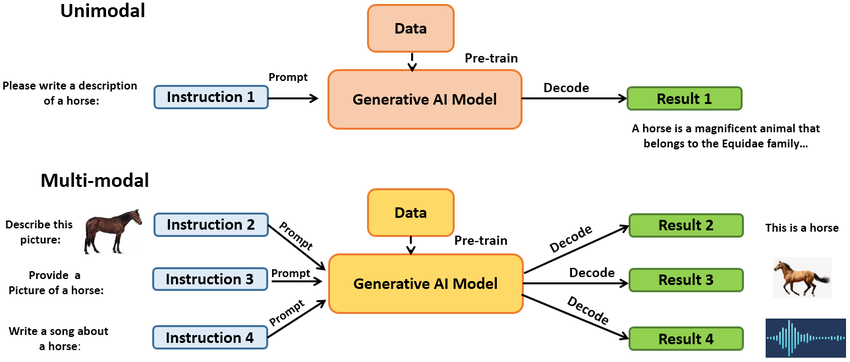

Les premiers modèles d'IA générative modernes, comme le ChatGPT, étaient considérés comme unimodaux, c'est-à-dire qu'ils ne pouvaient prendre qu'un seul type de données en entrée et générer le même type de sortie. En particulier, la plupart de ces modèles ont été conçus pour traiter des invites textuelles et générer une réponse textuelle.

C'est logique, car ces modèles ont besoin de grandes quantités de données pour être formés, et le texte n'est pas seulement un type de données qui peut être stocké et traité facilement, mais il est aussi facilement disponible. Il n'est pas surprenant que la plupart des données de formation d'outils tels que ChatGPT proviennent de différentes sources sur Internet. Nous expliquons toutes ces technicités dans notre article Qu'est-ce que le ChatGPT , où nous posons les questions directement au ChatGPT.

Cependant, la lecture n'est que l'un des nombreux moyens dont dispose l'homme pour apprendre de nouvelles choses et, pour de nombreuses tâches, ce n'est pas le plus efficace.

L'apprentissage multimodal est un sous-domaine de l'intelligence artificielle qui tente d'augmenter la capacité d'apprentissage des machines en les entraînant avec de grandes quantités de texte, ainsi qu'avec d'autres types de données, également appelées données sensorielles, telles que des images, des vidéos ou des enregistrements audio. Cela permet aux modèles d'apprendre de nouveaux modèles et corrélations entre les descriptions textuelles et les images, vidéos ou sons qui leur sont associés.

L'apprentissage multimodal ouvre de nouvelles perspectives aux systèmes intelligents. La combinaison de plusieurs types de données au cours du processus de formation permet aux modèles d'IA multimodale de recevoir plusieurs modalités d'entrée et de générer plusieurs types de sortie. Par exemple, GPT-4, le modèle de base de ChatGPT, peut accepter à la fois des entrées d'image et de texte et générer des sorties de texte, ainsi que le modèle texte-vidéo Sora récemment annoncé par OpenAI.

Concepts fondamentaux de l'IA multimodale

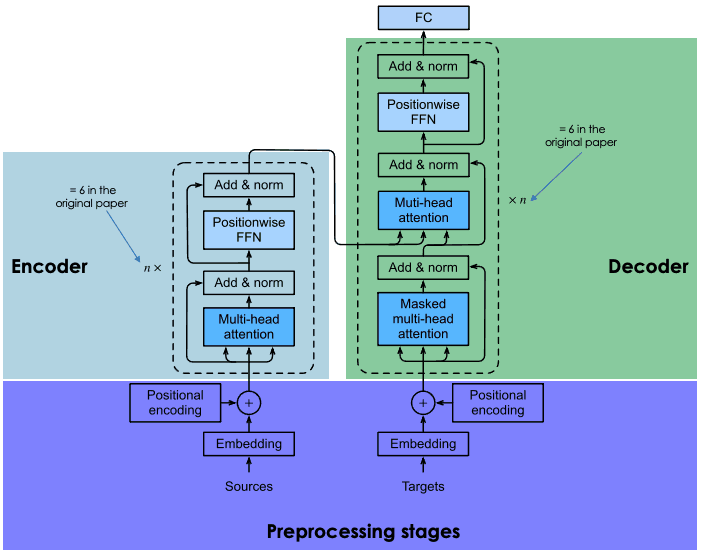

Les modèles d'IA générative multimodale ajoutent une nouvelle couche de complexité aux LLM les plus récents. Ces modèles sont basés sur un type d'architecture neuronale appelé "transformateur". Développés par les chercheurs de Google, les transformateurs s'appuient sur l'architecture codeur-décodeur et le mécanisme d'attention pour permettre un traitement efficace des données.

Il s'agit d'un processus assez complexe qui peut être difficile à comprendre. Si vous souhaitez obtenir plus de détails sur le fonctionnement des LLM et des transformateurs, nous vous encourageons vivement à lire notre guide sur le fonctionnement des transformateurs ou, si vous souhaitez mettre la main à la pâte et apprendre à créer des LLM étape par étape, consultez notre cours sur les concepts des grands modèles de langue (LLM).

Source : DataCamp

L'IA multimodale s'appuie sur des techniques de fusion de données pour intégrer des types de données disparates et obtenir une compréhension plus complète et plus précise des données sous-jacentes. L'objectif final est de faire de meilleures prévisions en combinant les informations complémentaires fournies par les différentes modalités de données.

IA unimodale ou multimodale. Source : ResearchGate

Plusieurs techniques de fusion de données peuvent être mises en œuvre pour relever les défis multimodaux. En fonction de l'étape de traitement à laquelle la fusion a lieu, nous pouvons classer les techniques de fusion de données en trois catégories :

- Fusion précoce. Il s'agit d'encoder les différentes modalités dans le modèle afin de créer un espace de représentation commun. Ce processus aboutit à un résultat unique invariant selon les modalités, qui englobe les informations sémantiques de toutes les modalités.

- Fusion moyenne. Il s'agit de combiner les modalités à différents stades de prétraitement. Pour ce faire, on crée des couches spéciales dans le réseau neuronal, spécialement conçues pour la fusion de données.

- Fusion tardive. Il s'agit de créer plusieurs modèles pour traiter les différentes modalités et de combiner les résultats de chaque modèle dans une nouvelle couche algorithmique.

Il n'existe pas de technique unique de fusion des données qui soit la meilleure pour tous les types de scénarios. La technique choisie dépendra plutôt de la tâche multimodale à accomplir. Par conséquent, un processus d'essais et d'erreurs sera probablement nécessaire pour trouver le pipeline d'IA multimodale le plus approprié.

Technologies de l'IA multimodale

L'IA multimodale est le résultat des connaissances accumulées dans plusieurs sous-domaines de l'IA. Ces dernières années, les praticiens et les chercheurs de l'IA ont réalisé des progrès impressionnants dans le stockage et le traitement des données sous de multiples formats et modalités.

Vous trouverez ci-dessous une liste des domaines qui alimentent le boom de l'IA multimodale :

Apprentissage en profondeur

L'apprentissage profond est un sous-domaine de l'IA qui utilise un type d'algorithme appelé réseau neuronal artificiel pour traiter des tâches complexes. La révolution actuelle de l'IA générative est alimentée par des modèles d'apprentissage profond, en particulier des transformateurs, qui sont un type d'architecture neuronale.

L'avenir de l'IA multimodale dépendra également des nouveaux progrès réalisés dans ce domaine. La recherche est particulièrement nécessaire pour trouver de nouveaux moyens d'augmenter les capacités des transformateurs, ainsi que de nouvelles techniques de fusion des données.

Consultez notre cursus Deep Learning in Python pour approfondir votre apprentissage dans ce domaine prometteur.

Traitement du langage naturel (NLP)

La PNL est une technologie essentielle de l'intelligence artificielle, qui comble le fossé entre la communication humaine et la compréhension par l'ordinateur. Il s'agit d'un domaine multidisciplinaire qui permet aux ordinateurs d'interpréter, d'analyser et de générer du langage humain, permettant ainsi une interaction transparente entre les humains et les machines.

Le texte étant le principal moyen de communication avec les machines, il n'est pas surprenant que le NLP soit essentiel pour garantir les performances élevées des modèles d'IA génératifs, y compris les modèles multimodaux.

Intéressé par la PNL ? Consultez notre cursus Traitement du langage naturel en Python pour acquérir les compétences NLP de base nécessaires pour convertir des données non structurées en informations précieuses.

Vision par ordinateur

L'analyse d'images, également connue sous le nom de vision par ordinateur, comprend un ensemble de techniques permettant aux ordinateurs de "voir" et de comprendre une image. Les progrès réalisés dans ce secteur ont permis de développer des modèles d'IA multimodaux capables de traiter des images et des vidéos à la fois en entrée et en sortie.

Si vous souhaitez approfondir ce sujet fascinant, consultez notre cursus de compétences sur le traitement d'images avec Python pour intégrer des compétences en traitement d'images à votre boîte à outils de science des données.

Traitement audio

Certains des modèles d'IA générative les plus avancés sont capables de traiter des fichiers audio à la fois en entrée et en sortie. Les possibilités de traitement audio vont de l'interprétation de messages vocaux à la traduction simultanée et à la création musicale.

Consultez notre cours sur le traitement du langage parlé en Python pour apprendre à charger, transformer et transcrire la parole à partir de fichiers audio bruts en Python.

Applications de l'IA multimodale

L'apprentissage multimodal permet aux machines d'acquérir de nouveaux "sens", ce qui accroît leur précision et leurs capacités d'interprétation. Ces pouvoirs ouvrent la voie à une myriade de nouvelles applications dans tous les secteurs et toutes les industries :

IA générative augmentée

La plupart des modèles d'IA générative de la première génération étaient des modèles texte-à-texte, capables de traiter les messages textes des utilisateurs et de fournir des réponses textuelles. Les modèles multimodaux, tels que GPT-4 Turbo, Google Gemini ou DALL-E, offrent de nouvelles possibilités qui peuvent améliorer l'expérience de l'utilisateur, tant du côté de l'entrée que de celui de la sortie. Qu'il s'agisse d'accepter des invites dans des modalités multiples ou de générer du contenu dans différents formats, les possibilités des agents d'IA multimodaux semblent illimitées.

Voitures autonomes

Les voitures auto-conduites s'appuient fortement sur l'IA multimodale. Ces voitures sont équipées de multiples capteurs qui traitent les informations provenant de l'environnement sous différents formats. L'apprentissage multimodal est essentiel pour que ces véhicules puissent combiner ces sources de manière efficace et efficiente afin de prendre des décisions en matière de renseignement en temps réel.

Biomédecine

La disponibilité croissante de données biomédicales provenant de biobanques, de dossiers médicaux électroniques, d'imagerie clinique et de capteurs médicaux, ainsi que de données génomiques, alimente la création de modèles d'IA multimodaux dans le domaine de la médecine. Ces modèles sont capables de traiter ces diverses sources de données provenant de modalités multiples pour nous aider à percer les mystères de la santé et de la maladie humaines, ainsi qu'à prendre des décisions cliniques intelligentes.

Sciences de la terre et changement climatique

L'expansion rapide des capteurs terrestres, des drones, des données satellitaires et d'autres techniques de mesure accroît notre capacité à comprendre la planète. L'IA multimodale est essentielle pour combiner ces informations avec précision et créer de nouvelles applications et de nouveaux outils qui peuvent nous aider dans toute une série de tâches, telles que la surveillance des émissions de gaz à effet de serre, la prévision des événements climatiques extrêmes et l'agriculture de précision.

Les défis de la mise en œuvre de solutions d'IA multimodales

L'essor de l'IA multimodale offre des possibilités infinies aux entreprises, aux gouvernements et aux particuliers. Cependant, comme pour toute technologie naissante, leur mise en œuvre dans vos activités quotidiennes peut s'avérer difficile.

Tout d'abord, vous devez trouver les cas d'utilisation qui correspondent à vos besoins spécifiques. Il n'est pas toujours facile de passer du concept au déploiement, surtout si vous ne disposez pas des personnes qui comprennent bien les aspects techniques de l'IA multimodale. Toutefois, compte tenu du déficit actuel de compétences en matière de maîtrise des données, il peut s'avérer difficile et coûteux de trouver les bonnes personnes pour mettre vos modèles en production, car les entreprises sont prêtes à payer des sommes élevées pour attirer des talents aussi limités.

Enfin, lorsque l'on parle d'IA générative, il est impératif de mentionner l'accessibilité financière. Ces modèles, en particulier les modèles multimodaux, nécessitent des ressources informatiques considérables pour fonctionner, ce qui signifie de l'argent. Par conséquent, avant d'adopter une solution d'IA générative, il est important d'évaluer les ressources que vous souhaitez investir.

Les risques de l'IA multimodale

Comme pour toute nouvelle technologie, les modèles d'IA multimodale présentent plusieurs pièges potentiels qu'il convient de contourner :

- Manque de transparence. L'opacité algorithmique est l'une des principales préoccupations associées à l'IA générative. Cela s'applique également à l'IA multimodale. Ces modes sont souvent qualifiés de modèles "boîte noire" en raison de leur complexité, qui rend impossible le contrôle de leur raisonnement et de leur fonctionnement interne.

- Monopole multimodal de l'IA. Compte tenu des ressources considérables nécessaires pour développer, former et exploiter un modèle multimodal, le marché est fortement concentré entre les mains d'un petit nombre de grandes entreprises technologiques qui disposent du savoir-faire et des ressources nécessaires. Heureusement, un nombre croissant de LLM à code source ouvert arrivent sur le marché, ce qui permet aux développeurs, aux chercheurs en IA et à la société de comprendre et d'exploiter plus facilement les LLM.

- Les préjugés et la discrimination. Selon les données utilisées pour former les modèles d'IA multimodale, ceux-ci peuvent contenir des biais susceptibles de donner lieu à des décisions injustes qui exacerbent souvent la discrimination, en particulier à l'encontre des groupes minoritaires. Comme nous l'avons déjà mentionné, la transparence est essentielle ici pour mieux comprendre et traiter les biais potentiels.

- Questions relatives à la protection de la vie privée. Les modèles d'IA multimodale sont formés à partir de grandes quantités de données provenant de sources et de formats multiples. Dans de nombreux cas, il peut contenir des données à caractère personnel. Cela peut entraîner des problèmes et des risques liés à la confidentialité et à la sécurité des données.

- Considérations éthiques. L'IA multimodale peut parfois conduire à des décisions qui ont des implications graves dans nos vies, avec des impacts significatifs sur nos droits fondamentaux. Nous avons exploré l'éthique de l'IA générative dans un autre article.

- Considérations environnementales. Les chercheurs et les défenseurs de l'environnement s'inquiètent de l' empreinte écologique associée à la formation et au fonctionnement des modèles d'IA générative. Les propriétaires de modèles d'IA multimodaux propriétaires publient rarement des informations sur l'énergie et les ressources consommées par les modèles, ni sur l'empreinte environnementale associée, ce qui est extrêmement problématique compte tenu de l'adoption rapide de ces outils.

L'avenir de l'IA multimodale

L'IA multimodale est certainement la prochaine frontière de la révolution de l'IA générative. Le développement rapide du domaine de l'apprentissage multimodal alimente la création de nouveaux modèles et applications pour toutes sortes d'objectifs. Nous ne sommes qu'au début de cette révolution. Au fur et à mesure que de nouvelles techniques sont mises au point pour combiner de nouvelles modalités, le champ d'application de l'IA multimodale s'élargira.

Cependant, un grand pouvoir s'accompagne d'une grande responsabilité. L'IA multimodale s'accompagne de risques et de défis importants qu'il convient de relever pour garantir un avenir équitable et durable.

Si vous souhaitez vous lancer dans l'IA générative, DataCamp vous couvre. Consultez nos cours, blogs et matériels dédiés :

Je suis analyste de données indépendant et je collabore avec des entreprises et des organisations du monde entier dans le cadre de projets de science des données. Je suis également formateur en science des données avec plus de 2 ans d'expérience. Je rédige régulièrement des articles sur les sciences des données en anglais et en espagnol, dont certains ont été publiés sur des sites web réputés tels que DataCamp, Towards Data Science et Analytics Vidhya En tant que scientifique des données ayant une formation en sciences politiques et en droit, mon objectif est de travailler à l'interaction des politiques publiques, du droit et de la technologie, en tirant parti du pouvoir des idées pour faire avancer des solutions et des récits innovants qui peuvent nous aider à relever des défis urgents, à savoir la crise climatique. Je me considère comme un autodidacte, un apprenant permanent et un fervent partisan de la pluridisciplinarité. Il n'est jamais trop tard pour apprendre de nouvelles choses.