Cours

Au cours de mes dix années d'expérience en finance quantitative, j'ai rencontré de nombreuses distributions statistiques, mais peu d'entre elles se sont révélées aussi intrigantes par leur nom et aussi précieuses sur le plan pratique que la distribution binomiale négative. En analysant les modèles de négociation et de risque, j'ai découvert que cette distribution, malgré son nom apparemment pessimiste, donne des indications sur les processus de comptage que de nombreux modèles plus simples ne parviennent pas à saisir.

La distribution binomiale négative fournit un cadre sophistiqué pour la modélisation de tels scénarios, offrant une plus grande flexibilité que ses homologues plus simples tels que la distribution de Poisson. Il s'agit d'une extension naturelle de la distribution binomiale, qui s'adapte aux situations dans lesquelles nous devons modéliser le nombre d'essais jusqu'à ce qu'un certain nombre d'événements se produisent, plutôt que le nombre d'événements au cours d'un nombre fixe d'essais.

Dans ce guide complet, nous explorerons les fondements mathématiques de la distribution binomiale négative, ses applications pratiques et sa mise en œuvre dans Python et R. En partant de ses propriétés de base et en passant à des applications avancées, nous construirons une compréhension approfondie de ce puissant outil statistique.

Qu'est-ce que la distribution binomiale négative ?

La distribution binomiale négative est née au XVIIIe siècle de l'étude des probabilités dans les jeux de hasard. Cette distribution de probabilité discrète modélise le nombre d'échecs dans une séquence d'essais indépendants de Bernoulli avant d'atteindre un nombre prédéterminé de succès. Chaque essai doit être indépendant et avoir la même probabilité de réussite.

Pour comprendre intuitivement cette répartition, considérez une expérience simple : vous interviewez des candidats jusqu'à ce que vous trouviez trois candidats qualifiés pour un poste. La distribution modéliserait le nombre d'entretiens infructueux (échecs) nécessaires avant de trouver ces trois candidats qualifiés (succès). Elle diffère fondamentalement de la distribution binomiale, qui modélise plutôt le nombre de succès dans un nombre fixe d'essais - comme le nombre de candidats qualifiés trouvés lors de 20 entretiens exactement.

Vous voyez donc que même si le nom "binôme négatif" peut faire froncer les sourcils, il n'implique rien de négatif au sens classique du terme. L'aspect "négatif" provient de sa dérivation historique impliquant des exposants négatifs.

Domaines d'utilisation de la distribution binomiale négative

La distribution binomiale négative est utilisée de différentes manières. Il est utilisé dans le domaine de la finance, où il modélise des scénarios tels que le nombre de jours de négociation avant d'atteindre un niveau de profit cible, ou le nombre de demandes de crédit examinées avant de trouver un certain nombre d'emprunteurs qualifiés.

Plus généralement, la distribution binomiale négative s'est également avérée utile pour modéliser les données de comptage lorsque la variance dépasse la moyenne, un phénomène connu sous le nom de surdispersion. Alors que la distribution de Poisson suppose que la moyenne est égale à la variance, les données de comptage réelles présentent souvent une plus grande variabilité. Par exemple, en épidémiologie, le nombre de cas de maladie varie souvent plus qu'un modèle de Poisson ne le prévoirait, ce qui rend la distribution binomiale négative plus appropriée pour modéliser la propagation de la maladie.

Les généticiens s'appuient sur cette distribution lorsqu'ils analysent les données de séquençage. Dans les expériences de séquençage de l'ARN, les gènes présentent des niveaux d'expression variables avec une grande variabilité. La binomiale négative modélise le nombre de lectures de séquences mises en correspondance avec chaque gène, en tenant compte des variations techniques et biologiques. Cela permet d'identifier les gènes différentiellement exprimés avec plus de précision que les méthodes supposant une variance constante.

Dans les études écologiques, les chercheurs l'utilisent pour modéliser l'abondance des espèces. Considérez l'étude des populations d'oiseaux : certaines zones peuvent avoir peu d'oiseaux alors que d'autres en ont beaucoup, ce qui crée une variance plus élevée que prévu. La binomiale négative modélise efficacement ces distributions groupées, ce qui aide les écologistes à comprendre la dynamique des populations et à planifier les efforts de conservation.

Caractéristiques de la distribution binomiale négative

La distribution binomiale négative est caractérisée par deux paramètres clés qui déterminent sa forme et son comportement. La compréhension de ces paramètres et de leur représentation mathématique nous aide à comprendre comment cette distribution modélise les phénomènes du monde réel. Examinons ces caractéristiques de manière systématique.

Représentation mathématique et paramètres

La distribution binomiale négative a deux paramètres fondamentaux :

- r - Le nombre cible de succès (un nombre entier positif)

- p - La probabilité de réussite de chaque essai (entre 0 et 1)

Ces paramètres déterminent le comportement de la distribution. Pensez à suivre le nombre d'appels commerciaux nécessaires pour obtenir cinq nouveaux clients (r = 5) lorsque chaque appel a 20 % de chances de réussir (p = 0,2). La valeur de r détermine notre point d'arrêt, tandis que p détermine la durée pendant laquelle nous pouvons espérer continuer à passer des appels.

Lorsque nous augmentons r tout en maintenant p constant, la distribution se déplace vers la droite et devient plus étalée, ce qui indique que nous avons besoin de plus d'essais pour obtenir plus de succès. Inversement, lorsque nous augmentons p tout en maintenant r constant, la distribution se déplace vers la gauche et devient plus concentrée, ce qui indique que moins d'essais sont généralement nécessaires lorsque le succès est plus probable.

Fonction de masse de probabilité (PMF) et fonction de distribution cumulative (CDF)

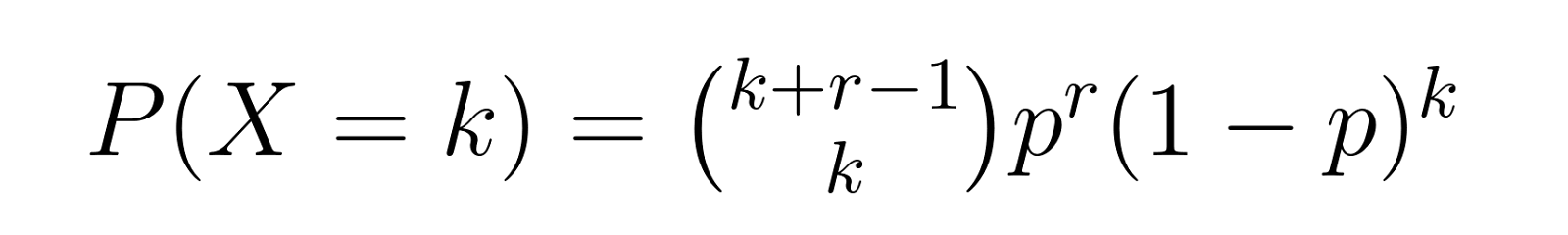

La fonction de masse de probabilité nous donne la probabilité d'avoir exactement k échecs avant d'obtenir r succès. Pour la distribution binomiale négative, le CMR est :

Où ?

- X représente le nombre d'échecs avant d'obtenir r succès

- (k+r-1 choisir k) est le coefficient binomial, représentant le nombre de façons d'arranger k échecs et r-1 succès.

- p est la probabilité de succès

- r est le nombre de succès souhaité

- K est le nombre d'échecs

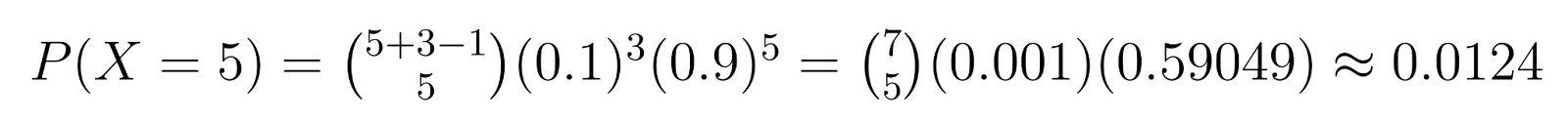

Exemple : Dans le cadre du contrôle de la qualité, si nous avons besoin de 3 unités défectueuses (r = 3) et que chaque unité a 10 % de chances d'être défectueuse (p = 0,1), nous pouvons calculer des probabilités spécifiques. Par exemple, la probabilité d'obtenir exactement 5 unités non défectueuses (k = 5) avant de trouver la troisième unité défectueuse est la suivante :

Ce calcul montre qu'il y a environ 1,24 % de chances qu'il faille exactement 5 unités non défectueuses avant de trouver la troisième unité défectueuse.

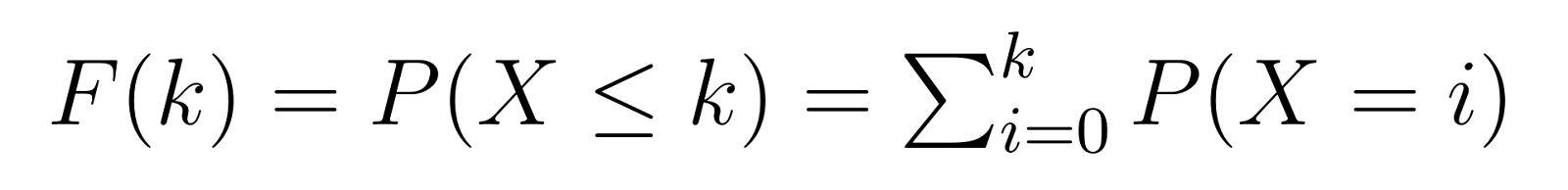

La fonction de distribution cumulative (FDC) s'appuie sur la CMR et nous donne la probabilité d'avoir besoin de k échecs ou moins avant d'atteindre le nombre de succès visé :

Cela signifie que F(k) nous donne la probabilité d'avoir besoin d'au plus k unités non défectueuses avant de trouver notre troisième unité défectueuse. Par exemple, F(5) nous donnerait la probabilité d'avoir besoin de 5 unités non défectueuses ou moins.

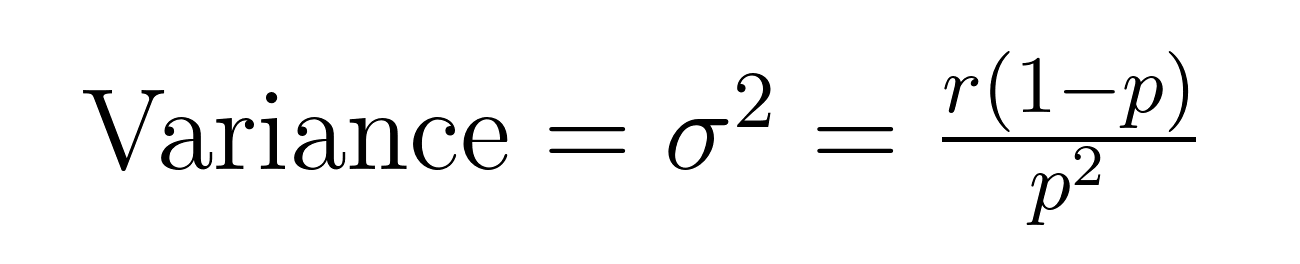

Moyenne et variance

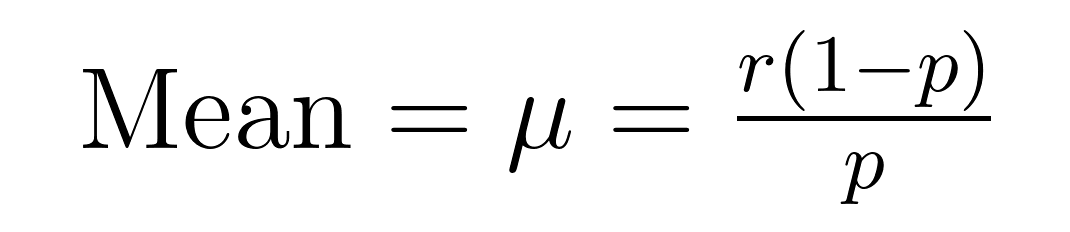

La moyenne (valeur attendue) et la variance de la distribution binomiale négative ont des formules élégantes qui révèlent des propriétés importantes sur la moyenne (μ) et la variance (σ²).

Ces formules démontrent pourquoi cette distribution excelle dans la modélisation de données surdispersées. Remarquez que la variance est toujours plus grande que la moyenne d'un facteur 1/p. Cette propriété intégrée rend le système naturellement adapté aux ensembles de données où la variabilité est supérieure à la moyenne.

Par exemple, si nous modélisons des appels au service clientèle pour lesquels nous prévoyons de résoudre 5 cas (r = 5) avec un taux de réussite de 20 % par tentative (p = 0,2), le nombre attendu de tentatives infructueuses serait le suivant :

- Moyenne = 5(1-0.2)/0.2 = 20 échecs

- Variance = 5(1-0.2)/0.2² = 100

Cette variance plus élevée tient compte du fait que certains cas peuvent être résolus rapidement alors que d'autres nécessitent de nombreuses tentatives, un schéma souvent observé dans les scénarios du monde réel.

La compréhension de ces caractéristiques nous permet de savoir quand appliquer la distribution binomiale négative et comment interpréter efficacement ses résultats. Ces fondements mathématiques préparent le terrain pour les applications pratiques et la mise en œuvre, que nous explorerons dans les sections suivantes.

Mise en œuvre en Python et R

Validons notre exemple précédent : calculer la probabilité d'obtenir exactement 5 unités non défectueuses avant de trouver la troisième défectueuse (r=3, p=0,1).

Mise en œuvre de Python

import scipy.stats as stats

import math

def calculate_nb_pmf(k, r, p):

# Calculate binomial coefficient (k+r-1 choose k)

binom_coef = math.comb(k + r - 1, k)

# Calculate p^r * (1-p)^k

prob = (p ** r) * ((1 - p) ** k)

return binom_coef * prob

# Our example parameters

k = 5 # failures (non-defective units)

r = 3 # successes (defective units)

p = 0.1 # probability of success (defective)

# Calculate using our function

prob_manual = calculate_nb_pmf(k, r, p)

print(f"Manual calculation: {prob_manual:.4f}")

# Verify using scipy

prob_scipy = stats.nbinom.pmf(k, r, p)

print(f"SciPy calculation: {prob_scipy:.4f}")L'extrait de code ci-dessus devrait produire le résultat suivant :

Manual calculation: 0.0124

SciPy calculation: 0.0124R mise en œuvre

# Calculate probability mass function

k <- 5 # failures (non-defective units)

r <- 3 # successes (defective units)

p <- 0.1 # probability of success (defective)

# Using dnbinom

prob_r <- dnbinom(k, size = r, prob = p)

print(sprintf("R calculation: %.4f", prob_r))

# Manual calculation for verification

manual_calc <- choose(k + r - 1, k) * p^r * (1-p)^k

print(sprintf("Manual calculation: %.4f", manual_calc))L'extrait de code ci-dessus devrait produire les mêmes chiffres que dans notre exemple Python :

R calculation: 0.0124

Manual Calculation: 0.0124Les deux implémentations confirment notre probabilité calculée précédemment d'environ 0,0124 ou 1,24%.

Relation avec les autres distributions

Comprendre comment la distribution binomiale négative est liée à d'autres distributions de probabilités permet de savoir quand utiliser chacune d'entre elles. La distribution binomiale négative a des liens uniques avec plusieurs distributions importantes en statistique.

Distribution binomiale négative et distribution binomiale

La distribution binomiale sert de point de départ. Alors que la distribution binomiale compte les succès dans un nombre fixe d'essais, la distribution binomiale négative inverse ce concept en comptant les essais nécessaires pour un nombre fixe de succès. Ces distributions sont complémentaires - si vous avez besoin d'exactement 3 succès et que vous souhaitez connaître la probabilité d'y parvenir en exactement 8 essais, utilisez la distribution binomiale. Si vous souhaitez connaître la probabilité qu'il faille exactement 8 essais pour obtenir 3 succès, utilisez la binomiale négative.

Distribution binomiale négative vs. Distribution de Poisson

La distribution de Poisson est souvent comparée à la distribution binomiale négative lorsqu'il s'agit de modéliser des données de comptage. Les deux traitent des événements discrets, mais diffèrent dans leurs hypothèses de variance. La caractéristique principale de la distribution de Poisson est que sa moyenne est égale à sa variance. Cependant, les données de comptage du monde réel présentent souvent une surdispersion, c'est-à-dire que la variance est supérieure à la moyenne. La distribution binomiale négative prend naturellement en compte cette variabilité supplémentaire, ce qui la rend plus adaptée à des phénomènes tels que :

- Modèles d'épidémies où certains cas entraînent de nombreuses autres infections

- Données relatives aux réclamations des clients lorsque certains problèmes donnent lieu à plusieurs réclamations connexes

- Les pics de trafic sur le site web lorsque certains événements provoquent des niveaux d'activité élevés

Distribution binomiale négative et distribution géométrique

La distribution géométrique apparaît comme un cas particulier de la binomiale négative lorsque nous fixons r=1, ce qui signifie que nous n'attendons qu'un seul succès. Il est donc parfait pour modéliser des scénarios tels que :

- Nombre de tentatives jusqu'au premier succès

- Délai jusqu'à la première défaillance dans les essais de fiabilité

- Nombre d'essais jusqu'à la première avancée de la recherche

Distribution binomiale négative en tant que mélange Gamma-Poisson

Enfin, la binomiale négative peut être dérivée comme un mélange Gamma-Poisson, fournissant une base théorique pour sa capacité à gérer la surdispersion. Cette relation explique pourquoi la distribution binomiale négative fonctionne bien dans les modèles hiérarchiques où les taux d'occurrence individuels varient selon une distribution gamma.

Avantages et limites

La distribution binomiale négative présente des avantages distincts qui la rendent précieuse pour la modélisation des phénomènes du monde réel, mais aussi des limites importantes que les scientifiques doivent prendre en compte.

| Avantages | Limites |

|---|---|

| Traite avec souplesse les données surdispersées lorsque la variance est supérieure à la moyenne. | Nécessité d'une indépendance entre les essais/événements |

| Les paramètres sont clairement interprétés pour une utilisation pratique | L'estimation des paramètres n'est plus fiable lorsque les échantillons sont petits |

| S'adapte à la fois aux comptes et aux proportions | Le calcul est plus intensif que pour les distributions plus simples. |

| Modélisation naturelle de la formation de grappes dans les données de comptage | Peut être surajouté lorsque les données ne sont pas vraiment surdispersées |

| Fonctionne bien avec les séries temporelles et les données longitudinales | On suppose que la probabilité de réussite est constante d'un essai à l'autre |

Régression binomiale négative

La régression binomiale négative étend la régression traditionnelle aux données de comptage, en particulier lorsque les données présentent une surdispersion. Alors que la régression de Poisson suppose que la moyenne est égale à la variance, la régression binomiale négative relâche cette contrainte, ce qui la rend plus adaptée aux applications du monde réel.

Prenons l'exemple d'un centre d'appel : Nous voulons prédire le nombre d'appels au service clientèle par heure. Nos prédicteurs pourraient être les suivants :

- Heure de la journée

- Jour de la semaine

- Statut des vacances

- Campagne de marketing

- Conditions météorologiques

La régression standard de Poisson peut sous-estimer la variation des volumes d'appels, en particulier pendant les heures de pointe ou les événements spéciaux. La régression binomiale négative tient compte de cette variabilité supplémentaire et fournit des prédictions et des intervalles de confiance plus réalistes.

Conclusion

Grâce à sa capacité à modéliser des données de comptage complexes et à gérer la surdispersion, la distribution binomiale négative reste un outil essentiel pour comprendre et prévoir les phénomènes du monde réel. Comme vous l'avez vu, il excelle dans la modélisation de données surdispersées, il offre la flexibilité nécessaire pour modéliser un grand nombre de scénarios différents et il s'étend même naturellement à l'analyse de régression.

Si vous souhaitez approfondir votre compréhension des distributions de probabilité et de leurs applications, nos cours de probabilités et de statistiques offrent une couverture complète de ces sujets. Nos cours comprennent des exercices pratiques avec des ensembles de données du monde réel, vous aidant à maîtriser à la fois les concepts théoriques et les implémentations pratiques en Python et R. En outre, considérez notre parcours de carrière Machine Learning Scientist in Python. Je vous promets que vous apprendrez beaucoup.

Distribution binomiale négative Q&R

Qu'est-ce que la distribution binomiale négative ?

La distribution binomiale négative modélise le nombre d'essais nécessaires pour obtenir un nombre spécifié de succès dans une séquence d'essais de Bernoulli indépendants et identiquement distribués.

En quoi la distribution binomiale négative diffère-t-elle de la distribution de Poisson ?

La distribution binomiale négative tient compte de la surdispersion dans les données de comptage, contrairement à la distribution de Poisson, qui suppose une moyenne et une variance égales.

Quels sont les paramètres de la distribution binomiale négative ?

Les paramètres clés sont le nombre de succès (r) et la probabilité de succès (p) pour chaque essai.

Quand dois-je utiliser la distribution binomiale négative ?

Utilisez-le pour modéliser des données de comptage avec surdispersion, où la variance dépasse la moyenne.

Quelle est la fonction de masse de probabilité de la distribution binomiale négative ?

Le CMR donne la probabilité d'obtenir un certain nombre de succès en un nombre donné d'essais.

Comment calculer les probabilités à l'aide de la distribution binomiale négative ?

Utilisez la formule PMF ou un logiciel statistique pour calculer les probabilités en fonction des paramètres de la distribution.

Qu'est-ce que la surdispersion dans les données de comptage ?

Il y a surdispersion lorsque la variance des données de comptage est supérieure à la moyenne, ce qui est souvent illustré par la distribution binomiale négative.