Programma

L'addestramento di large language models (LLM) richiede spesso notevoli risorse computazionali, il che può rappresentare una barriera per molte organizzazioni e ricercatori.

La tecnica della mixture of experts (MoE) affronta questa sfida scomponendo i modelli di grandi dimensioni in reti più piccole e specializzate.

Il concetto di MoE ha origine dal paper del 1991 Adaptive Mixture of Local Experts. Da allora, le MoE sono state impiegate in modelli con trilioni di parametri, come gli Switch Transformers open source da 1,6 trilioni di parametri.

In questo articolo, ti propongo un'esplorazione approfondita delle MoE, incluse applicazioni, vantaggi e sfide.

Che cos'è una Mixture of Experts (MoE)?

Immagina un modello di AI come una squadra di specialisti, ognuno con una competenza unica. Un modello mixture of experts (MoE) si basa su questo principio dividendo un compito complesso tra reti più piccole e specializzate chiamate "esperti".

Ogni esperto si concentra su un aspetto specifico del problema, consentendo al modello di affrontare il compito in modo più efficiente e accurato. È come avere un medico per i problemi di salute, un meccanico per l'auto e uno chef per la cucina: ogni esperto gestisce ciò che sa fare meglio.

Collaborando, questi specialisti riescono a risolvere un ventaglio più ampio di problemi in modo più efficace rispetto a un unico generalista.

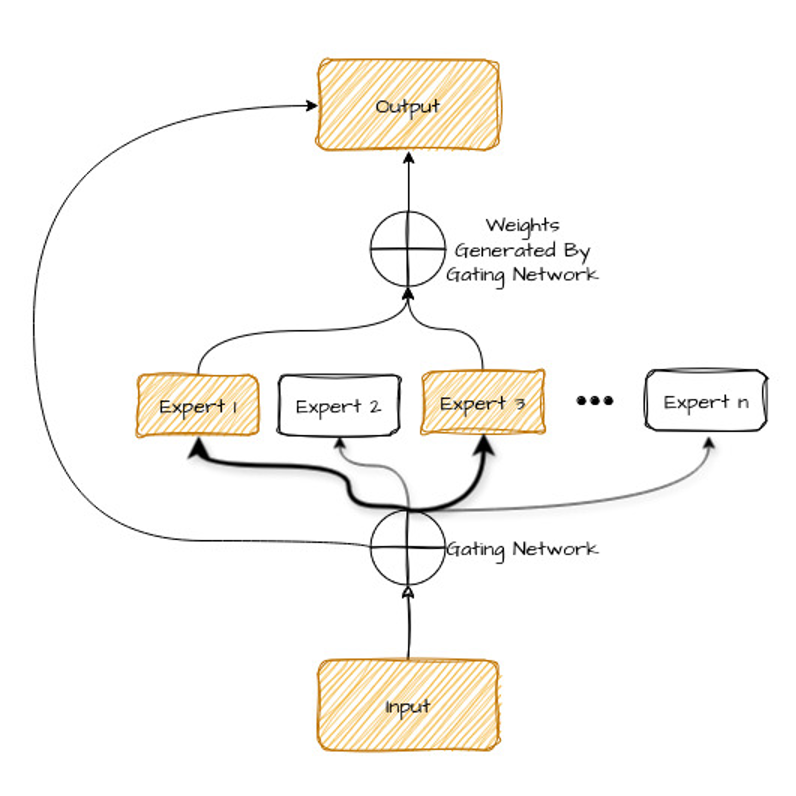

Diamo uno sguardo al diagramma qui sotto: lo spiegheremo tra poco.

Analizziamo i componenti di questo diagramma:

- Input: è il problema o il dato che vuoi far gestire all'AI.

- Esperti: sono modelli di AI più piccoli, ciascuno addestrato per eccellere in una parte specifica del problema complessivo. Pensali come i diversi specialisti della tua squadra.

- Rete di gating: è come un responsabile che decide quale esperto è più adatto per ciascuna parte del problema. Osserva l'input e stabilisce chi deve lavorare su cosa.

- Output: è la risposta o soluzione finale prodotta dal modello di AI dopo il lavoro degli esperti.

I vantaggi dell'uso delle MoE sono:

- Efficienza: vengono utilizzati solo gli esperti più adatti a una determinata parte del problema, risparmiando tempo e potenza di calcolo.

- Flessibilità: puoi aggiungere facilmente altri esperti o cambiare le loro specializzazioni, rendendo il sistema adattabile a problemi diversi.

- Risultati migliori: dato che ogni esperto si concentra su ciò in cui è forte, la soluzione complessiva è di solito più accurata e affidabile.

Entriamo un po' più nel dettaglio con le reti di esperti e le reti di gating.

Reti di esperti

Pensa alle "reti di esperti" in un modello MoE come a una squadra di specialisti. Invece di avere un unico modello di AI che fa tutto, ogni esperto si concentra su un particolare tipo di compito o di dato.

In un modello MoE, questi esperti sono come singole reti neurali, ciascuna addestrata su dataset o compiti diversi.

Sono progettati per essere sparsi, cioè solo pochi sono attivi in un dato momento, a seconda della natura dell'input. Questo evita di sovraccaricare il sistema e garantisce che lavorino gli esperti più pertinenti.

Ma come fa il modello a sapere quali esperti scegliere? Qui entra in gioco la rete di gating.

Reti di gating

La rete di gating (il router) è un altro tipo di rete neurale che impara ad analizzare i dati in input (come una frase da tradurre) e a determinare quali esperti sono più adatti a gestirli.

Lo fa assegnando un "peso" o punteggio di importanza a ciascun esperto in base alle caratteristiche dell'input. Gli esperti con i pesi più alti vengono poi selezionati per elaborare i dati.

Esistono vari modi (detti "algoritmi di instradamento") con cui la rete di gating può selezionare gli esperti giusti. Eccone alcuni comuni:

- Top-k routing: è il metodo più semplice. La rete di gating sceglie i 'k' esperti con i punteggi di affinità più alti e invia loro i dati di input.

- Expert choice routing: in questo metodo, invece che i dati scelgano gli esperti, sono gli esperti a decidere quali dati possono gestire meglio. Questa strategia mira al miglior bilanciamento del carico e permette un modo variegato di mappare i dati agli esperti.

- Instradamento sparso: questo approccio attiva solo pochi esperti per ogni elemento di dato, creando una rete sparsa. L'instradamento sparso usa meno potenza di calcolo rispetto a quello denso, in cui tutti gli esperti sono attivi per ogni dato.

Durante il processo di previsione, il modello combina gli output degli esperti seguendo lo stesso processo usato per assegnare loro i compiti. Per un singolo compito possono servire più esperti, a seconda della complessità e varietà del problema.

Ora vediamo come funziona una MoE.

Come funziona la Mixture of Experts (MoE)

La MoE opera in due fasi:

- Fase di addestramento

- Fase di inferenza

Fase di addestramento

Analogamente ad altri modelli di machine learning, la MoE inizia addestrandosi su un dataset. Tuttavia, il processo non si applica all'intero modello, ma ai suoi componenti singolarmente.

Addestramento degli esperti

Ogni componente di un framework MoE viene addestrato su un sottoinsieme specifico di dati o compiti. L'obiettivo è permettere a ciascun componente di concentrarsi su un aspetto particolare del problema più ampio.

Questo focus si ottiene fornendo a ogni componente dati pertinenti al compito assegnato. Per esempio, in un compito di elaborazione del linguaggio, un componente potrebbe concentrarsi sulla sintassi e un altro sulla semantica.

L'addestramento di ciascun componente segue un normale processo di training di una rete neurale, in cui il modello impara a minimizzare la funzione di perdita per il proprio sottoinsieme di dati.

Addestramento della rete di gating

La rete di gating ha il compito di imparare a selezionare l'esperto più adatto per un dato input.

Durante l'addestramento della rete di gating, questa viene addestrata insieme alle reti di esperti. Riceve lo stesso input degli esperti e impara a predire una distribuzione di probabilità sugli esperti. Questa distribuzione indica quale esperto è più adatto a gestire l'input corrente.

La rete di gating è in genere addestrata usando metodi di ottimizzazione che tengono conto sia dell'accuratezza della rete di gating sia delle prestazioni degli esperti selezionati.

Addestramento congiunto

Nella fase di addestramento congiunto, l'intero sistema MoE, che include sia i modelli esperti sia la rete di gating, viene addestrato insieme.

Questa strategia assicura che sia la rete di gating sia gli esperti siano ottimizzati per lavorare in armonia. La funzione di perdita nell'addestramento congiunto combina le perdite dei singoli esperti e della rete di gating, promuovendo un'ottimizzazione collaborativa.

I gradienti della perdita combinata vengono quindi propagati sia attraverso la rete di gating sia attraverso i modelli esperti, facilitando aggiornamenti che migliorano le prestazioni complessive del sistema MoE.

Fase di inferenza

L'inferenza consiste nel generare output combinando il contesto dalle reti di gating con gli output degli esperti. Nelle MoE, questo processo è progettato per mantenere minimi i costi di inferenza.

Instradamento dell'input

Nel contesto delle MoE, il ruolo della rete di gating è fondamentale nel decidere quali modelli devono elaborare uno specifico input.

Alla ricezione di un input, la rete di gating lo valuta e crea una distribuzione di probabilità su tutti i modelli. Questa distribuzione indirizza quindi l'input verso i modelli più adatti, sfruttando i pattern appresi durante la fase di addestramento. Ciò garantisce che a ogni compito venga applicata l'esperienza giusta, ottimizzando il processo decisionale.

Selezione degli esperti

Solo un numero ristretto di modelli, di solito uno o pochi, viene scelto per elaborare ciascun input. Questa selezione è determinata dalle probabilità assegnate dalla rete di gating.

Scegliere un numero limitato di modelli per ogni input aiuta a usare in modo efficiente le risorse computazionali, beneficiando al contempo delle conoscenze specialistiche all'interno del framework MoE.

L'output della rete di gating assicura che i modelli scelti siano i più appropriati per gestire l'input, migliorando così l'efficienza e le prestazioni complessive del sistema.

Combinazione degli output

L' ultimo passaggio del processo di inferenza consiste nel fondere gli output dei modelli selezionati.

Questa fusione si ottiene spesso tramite una media pesata, in cui i pesi riflettono le probabilità assegnate dalla rete di gating. In alcuni scenari si possono usare metodi alternativi, come il voto o tecniche di combinazione apprese, per unire gli output degli esperti. L'obiettivo è integrare i diversi contributi dei modelli selezionati in una previsione finale unificata e accurata, sfruttando i punti di forza dell'architettura MoE.

Con il rapido avanzamento della tecnologia, cresce la necessità di tecniche veloci, efficienti e ottimizzate per gestire modelli di grandi dimensioni. Le MoE stanno emergendo come una soluzione promettente in questo senso. Quali altri vantaggi offrono le MoE?

Vantaggi della Mixture of Experts (MoE)

L'architettura Mixture of Experts (MoE) offre diversi vantaggi:

- Prestazioni: attivando selettivamente solo gli esperti rilevanti per un dato compito, i modelli MoE evitano calcoli non necessari, migliorando la velocità e riducendo il consumo di risorse.

- Flessibilità: le capacità diversificate degli esperti rendono i modelli MoE altamente flessibili. Chiamando in causa esperti con competenze specializzate, il modello MoE può avere successo in una gamma più ampia di compiti.

- Tolleranza ai guasti: l'approccio "dividi e conquista" delle MoE, in cui i compiti sono eseguiti separatamente, aumenta la resilienza del modello agli errori. Se un esperto ha un problema, non compromette necessariamente il funzionamento dell'intero modello.

- Scalabilità: scomporre problemi complessi in compiti più piccoli e gestibili aiuta i modelli MoE a gestire input sempre più complicati.

Applicazioni della Mixture of Experts (MoE)

Il fatto che le MoE esistano da 30 anni le rende una tecnica ampiamente usata in diverse aree del machine learning.

Natural language processing (NLP)

Le MoE offrono un approccio unico all'addestramento di modelli di grandi dimensioni con maggiore efficienza, pre-training più rapido e velocità di inferenza competitive.

Nei modelli densi tradizionali, tutti i parametri sono utilizzati per tutti gli input. La sparsità consente invece al modello di eseguire solo parti specifiche del sistema in base all'input, riducendo significativamente i calcoli.

Un esempio è l'API di traduzione di Microsoft, Z-code. L'architettura MoE in Z-code supporta una scala enorme di parametri del modello mantenendo costante la quantità di calcolo.

Computer vision

I V-MoE di Google, un'architettura sparsa basata sui Vision Transformer (ViT), mostrano l'efficacia delle MoE nei task di computer vision.

Suddividendo le immagini in patch più piccole e inviandole a un livello di gating/instradamento, i V-MoE possono selezionare dinamicamente gli esperti più adatti per ogni patch, ottimizzando sia l'accuratezza sia l'efficienza.

Un vantaggio notevole di questo approccio è la flessibilità. Puoi diminuire il numero di esperti selezionati per token per risparmiare tempo e calcolo, senza ulteriore addestramento sui pesi del modello.

Sistemi di raccomandazione

Le MoE sono state applicate con successo anche ai sistemi di raccomandazione. Per esempio, i ricercatori di Google hanno proposto un sistema di ranking basato su MMoE (Multi-Gate Mixture of Experts) per le raccomandazioni di video su YouTube.

Hanno innanzitutto raggruppato gli obiettivi del task in due categorie: engagement e soddisfazione. Dato l'elenco di video candidati dalla fase di retrieval, il loro sistema di ranking utilizza caratteristiche del candidato, dell'utente e del contesto per imparare a prevedere le probabilità corrispondenti alle due categorie di comportamento utente.

Da notare che in questo approccio non hanno applicato direttamente il livello MoE all'input, perché l'alta dimensionalità dell'input comporterebbe costi significativi di addestramento e serving del modello.

Le MoE hanno visto un'adozione su larga scala nell'industria per diverse applicazioni. La loro procedura di apprendimento divide il compito in sottocompiti appropriati, ognuno dei quali può essere risolto da una rete di esperti molto semplice. Questa capacità si traduce in addestramento parallelizzabile e inferenza rapida, rendendo le MoE attraenti per sistemi su larga scala.

Mixture of Experts (MoE): sfide

Gli esperti sono particolarmente vantaggiosi in scenari ad alto throughput che coinvolgono molte macchine. A parità di budget computazionale per il pretraining, un modello sparso può essere più efficiente.

Tuttavia, i modelli sparsi richiedono molta memoria in esecuzione, poiché tutti gli esperti devono essere conservati in memoria. Questo può essere un limite significativo in sistemi con poca VRAM, dove tali modelli possono avere difficoltà.

Esploriamo altre limitazioni delle MoE.

Complessità dell'addestramento

Addestrare modelli MoE è più complesso che addestrare un singolo modello. Ecco perché:

- Coordinamento: serve che la rete di gating impari a instradare correttamente gli input verso gli esperti giusti mentre ogni esperto si specializza in parti diverse dei dati. Bilanciare il tutto può essere complicato.

- Ottimizzazione: la funzione di perdita usata nell'addestramento congiunto deve bilanciare le prestazioni degli esperti e della rete di gating, il che complica il processo di ottimizzazione.

- Tuning degli iperparametri: i modelli MoE hanno più iperparametri, come il numero di esperti e l'architettura della rete di gating. Sintonizzarli può richiedere tempo ed essere complesso.

Efficienza dell'inferenza

L'inferenza nei modelli MoE può essere meno efficiente per alcuni fattori:

- Rete di gating: la rete di gating deve essere eseguita per ogni input per determinare gli esperti giusti. Questo aggiunge calcolo extra.

- Selezione e attivazione degli esperti: anche se per ogni input viene attivato solo un sottoinsieme di esperti, selezionare e attivare questi esperti introduce overhead, potenzialmente aumentando i tempi di inferenza.

- Parallelismo: eseguire più esperti in parallelo può essere impegnativo, soprattutto in ambienti con risorse computazionali limitate. Un parallelismo efficace richiede pianificazione e gestione delle risorse avanzate.

Aumento della dimensione del modello

I modelli MoE tendono a essere più grandi dei modelli singoli a causa dei molteplici esperti:

- Requisiti di archiviazione: conservare più reti di esperti e la rete di gating aumenta le necessità complessive di storage, che possono rappresentare uno svantaggio in ambienti con spazio limitato.

- Uso di memoria: addestramento e inferenza richiedono più memoria perché più modelli devono essere caricati e mantenuti in memoria contemporaneamente. Questo può essere problematico in contesti con risorse limitate.

- Sfide di deployment: distribuire modelli MoE è più difficile a causa delle loro dimensioni e complessità. Un deployment efficiente su varie piattaforme, inclusi i dispositivi edge, può richiedere ulteriori sforzi di ottimizzazione e ingegneria.

Conclusione

In questo articolo abbiamo esplorato la tecnica Mixture of Experts (MoE), un approccio sofisticato per scalare le reti neurali in modo da gestire compiti complessi e dati eterogenei. Le MoE utilizzano molteplici esperti specializzati e una rete di gating per instradare efficacemente gli input.

Abbiamo trattato i componenti fondamentali delle MoE, incluse le reti di esperti e la rete di gating, e discusso i processi di addestramento e inferenza.

Abbiamo evidenziato vantaggi come prestazioni, scalabilità e adattabilità migliorate, insieme ad applicazioni in elaborazione del linguaggio naturale, computer vision e sistemi di raccomandazione.

Nonostante le sfide in termini di complessità di addestramento e dimensioni del modello, le MoE offrono un metodo promettente per far progredire le capacità dell'AI.

Senior GenAI Engineer e Content Creator che ha totalizzato 20 milioni di visualizzazioni condividendo conoscenze su GenAI e data science.