Programma

Alibaba ha appena presentato il suo ultimo large language model, Qwen3.5. Questo nuovo modello arriva in risposta a recenti rilasci come GPT-5.3 Codex e Claude Opus 4.6, che ci hanno entrambi colpito.

Secondo Alibaba, Qwen 3.5 è "costruito per l’era dell’AI agentica" e il modello vision-language sarebbe più economico ed efficiente del suo predecessore, con statistiche di performance di frontiera in diversi benchmark.

Alibaba rilascia anche Qwen3.5-Plus, una versione premium del modello con una finestra di contesto da 1 milione di token, che punta direttamente a Gemini 3.

In questo articolo ti guiderò tra le novità principali di Qwen3.5 e Qwen3.5-Plus, esaminando come se la cavano rispetto ai concorrenti, cosa dicono i benchmark e come puoi accedere ai nuovi modelli.

Dai un’occhiata anche alle nostre guide sui modelli concorrenti più recenti, come Claude Sonnet 4.6 o GPT-5.3 Instant.

Che cos’è Qwen3.5?

Qwen3.5 è l’ultima generazione della serie di large language model (LLM) di Alibaba, Qwen3.5-397B-A17B. A differenza della precedente famiglia di modelli Qwen3, Qwen3.5 combina modelli specializzati in un unico modello nativo vision-language. Come i precedenti Qwen, è open source sotto licenza Apache 2.0.

È proposto come foundation model generico per casi d’uso consumer e enterprise ed è progettato per workflow nativamente multimodali e agentici. Qwen3.5-397B-A17B offre due modalità:

- “Thinking” per compiti che richiedono ragionamento più profondo

- “Fast” per inferenza rapida con attività di routine

Qwen3.5 vs Qwen3.5-Plus

Qwen3.5-Plus è un servizio hosted, solo API, corrispondente a Qwen3.5-397B-A17B e non è di per sé un modello con pesi aperti. Le note di rilascio su questo punto erano un po’ ambigue: il riferimento a Qwen3.5-Plus potrebbe far pensare a un modello separato, ma in realtà è il servizio proprietario di Alibaba costruito sullo stesso modello.

Sebbene Qwen3.5-Plus si basi sul modello Qwen3.5-397B-A17B, ci sono alcune differenze da notare. È accessibile solo tramite Alibaba Cloud Model Studio con pagamento a token, e tramite la Qwen Chat UI con accesso limitato.

Qwen3.5-Plus utilizza una finestra di contesto estesa di 1 milione di token, rispetto alla finestra da 256K token del modello Qwen3.5 standard. Oltre a “Thinking” e “Fast”, Qwen3.5-Plus include anche una modalità “Auto” con thinking adattivo che, oltre al ragionamento, può usare strumenti come la ricerca e un interprete di codice.

Caratteristiche principali di Qwen3.5

Vediamo alcune delle nuove funzionalità disponibili con Qwen3.5:

Capacità multimodali native

Analogamente a OpenAI, che ha unito i suoi modelli standard e Codex nel recente rilascio di GPT-5.3 Codex, Alibaba ha combinato testo, visione e interazione con l’interfaccia in un unico modello.

Qwen3.5 è stato addestrato congiuntamente su testo, immagini, screenshot di interfacce e contenuti strutturati. Supporta il visual question answering, la comprensione di documenti e l’interpretazione di grafici/tabelle, e gestisce il grounding a livello di pixel per identificare e interagire con elementi a schermo.

Capacità agentiche visive

Questo ci porta al prossimo punto focale del nuovo Qwen3.5. Grazie all’ampio addestramento su screenshot di UI, il modello può riconoscere e agire su interfacce mobile e desktop. Questo consente di eseguire workflow multi-step come:

- Compilare moduli

- Navigare tra le app

- Modificare le impostazioni di sistema

- Organizzare file

Questo rende Qwen3.5 ideale per l’automazione della produttività. Usando istruzioni in linguaggio naturale, puoi consentire all’agente visivo Qwen di agire su più app, completando workflow complessi. Può persino mantenere uno stato su lunghe sequenze di interazione, abilitando un’orchestrazione solida di strumenti e app.

Prestazioni ed efficienza migliorate

Qwen3.5 è un modello piuttosto grande, con 397 miliardi di parametri totali, anche se solo 17 miliardi sono attivati per token, grazie all’architettura mixture-of-experts. In sostanza, significa che ha l’intelligenza di un modello gigante, con la velocità e l’efficienza di costo di uno molto più piccolo.

In pratica, rispetto a Qwen3-Max, Qwen3.5 397B-A17B è 19 volte più veloce nel decodificare compiti a lungo contesto (256k token) e 8,6 volte più veloce per i workflow standard. Fondamentale, questa velocità non compromette l’intelligenza; eguaglia comunque il ragionamento e le prestazioni di coding di Qwen3-Max e supera Qwen3-VL, grazie alla fusione precoce di testo e video.

Efficienza dei costi migliorata

Con le migliori prestazioni, vediamo anche efficienze sui costi con questo modello.

Allo stesso modo, una pipeline nativa FP8 (elaborazione dei dati a 8 bit di precisione, piuttosto che i canonici 16 bit) fa sì che Qwen3.5 dimezzi la memoria necessaria all’esecuzione. Questo consente calcoli più rapidi, migliorando le velocità di oltre il 10% alla scala del trilione di token.

Qwen3.5 ha anche un lessico notevole da 250k, che gli permette di esprimere concetti complessi con meno token. Insieme alle predizioni multi-token, il modello può “indovinare” diverse parole future in un singolo step, riducendo i costi in token dal 10% al 60% in 201 lingue.

Come è stato sviluppato Qwen3.5

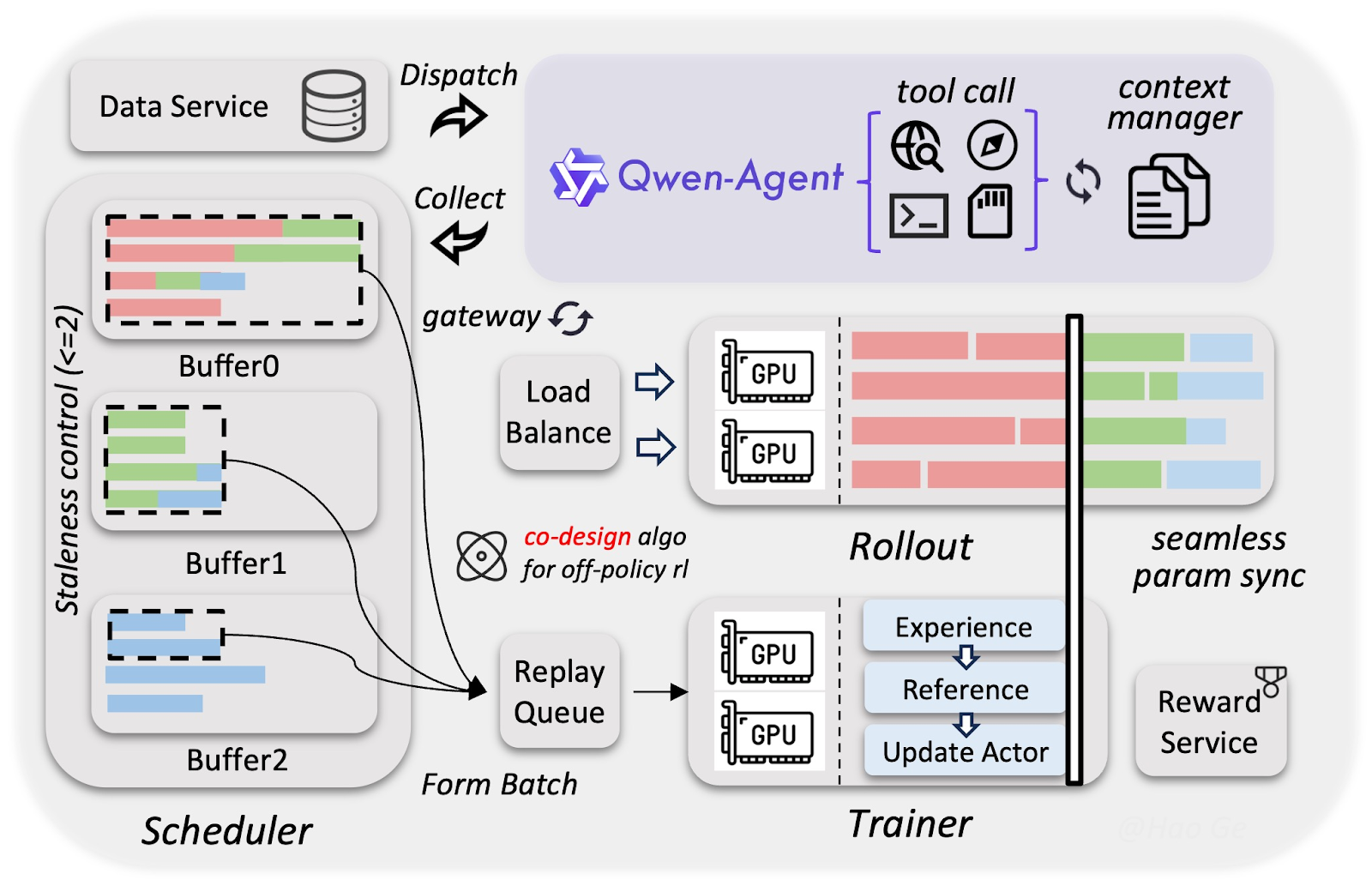

Lo sviluppo di Qwen3.5 ha utilizzato un’infrastruttura personalizzata che rende l’addestramento di modelli multimodali e agentici (quasi) veloce ed economico quanto quello dei modelli puramente testuali. L’approccio speciale all’addestramento di Qwen3.5 si basa su tre componenti chiave:

- Qualità dei dati

- Infrastruttura eterogenea

- Reinforcement learning (RL) asincrono

Qualità dei dati

Il team di Alibaba ha raccolto molti più dati visivo-testuali rispetto alla famiglia Qwen3, ma li ha filtrati in modo molto rigoroso per garantire input di alta qualità. Il dataset risultante consente al modello da 397B parametri di eguagliare le capacità di modelli molto più grandi da 1T parametri, come Qwen3-Max.

Infrastruttura eterogenea

Le parti di visione e linguaggio sono state addestrate separatamente ma in parallelo. Poiché nessuna delle due deve attendere i calcoli dell’altra, la sovrapposizione risultante offre una velocità di addestramento quasi al 100% rispetto ai modelli puramente testuali.

Reinforcement learning asincrono

Usando la compressione FP8 (in sostanza memorizzando i numeri con metà dei bit) e la decodifica speculativa (anticipando le previsioni), gli agenti eseguono migliaia di task simultaneamente mentre l’addestramento procede in background senza attese. Questo ha accelerato l’addestramento senza perdite significative di qualità, così Qwen3.5 ha imparato abilità agentiche complesse, come il clic su UI o i task multi-step, 3-5 volte più velocemente.

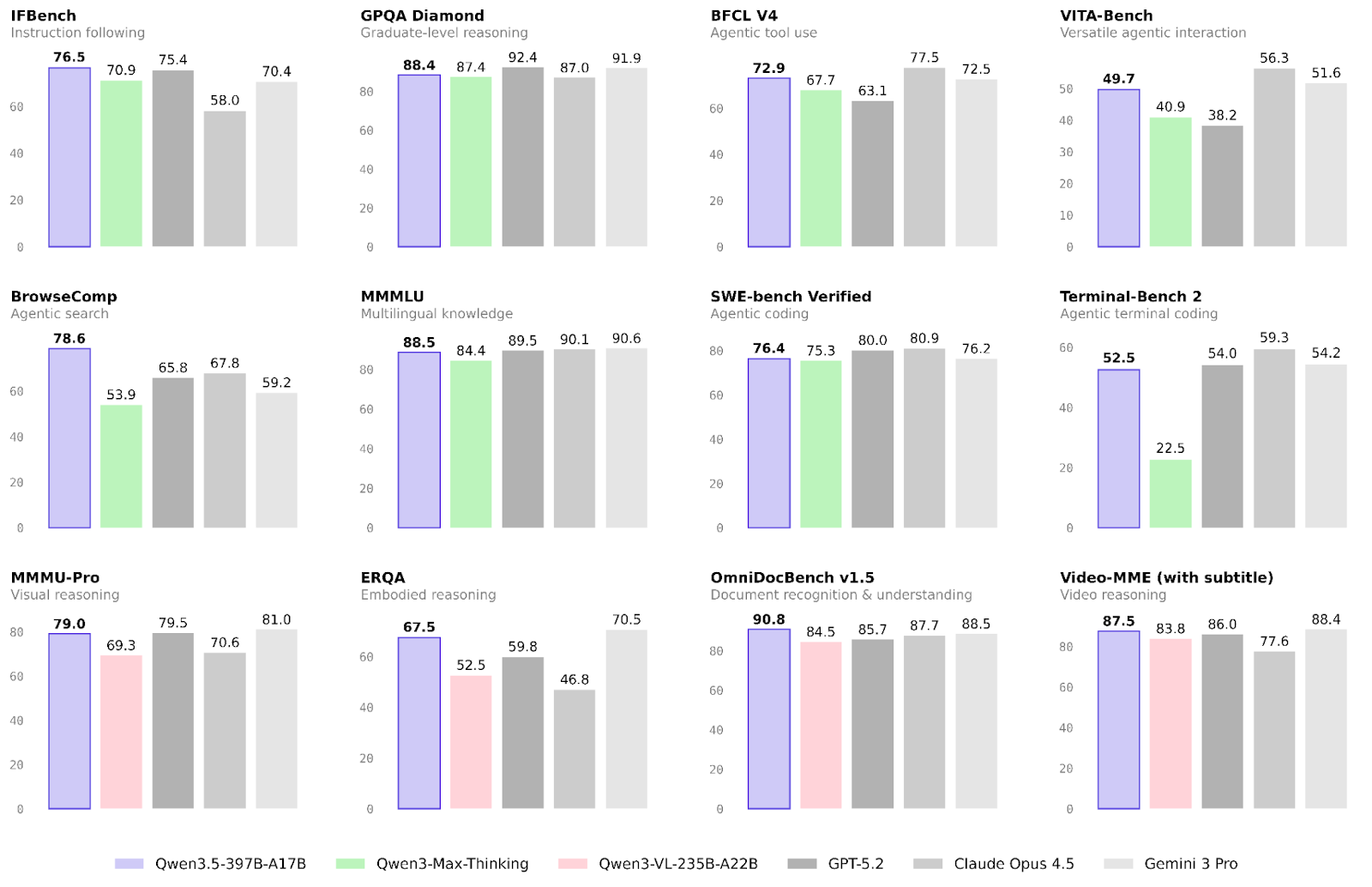

Benchmark di Qwen3.5

Le prestazioni del nuovo modello di Alibaba sono già state validate su molti compiti. Ci concentreremo sui risultati nelle aree chiave di workflow agentici e multimodali, oltre che sulle capacità generali di ragionamento.

Workflow agentici

L’area in cui Qwen3.5 è migliorato di più rispetto alla famiglia Qwen3 sono i workflow agentici.

- Coding agentico da terminale: Il salto più significativo si registra in Terminal-Bench 2.0, dove Qwen3.5 raggiunge 52,5 rispetto ai soli 22,5 di Qwen3-Max-Thinking, riuscendo a competere con Gemini 3 Pro (54,2). Detto ciò, resta ben dietro all’attuale leader, il recente GPT-5.3 Codex (77,3).

- Ricerca agentica: Questa sembra essere la forza principale di Qwen3.5. Raggiunge un notevole 78,6 in BrowseComp, superando di molto Gemini 3 Pro (59,2) e piazzandosi al secondo posto dietro a Claude Opus 4.6 (84,0)

Multimodalità

La multimodalità è un altro ambito che ha visto miglioramenti significativi rispetto alla famiglia precedente. Ciò è particolarmente vero per l’embodied reasoning e il riconoscimento di documenti:

- Embodied reasoning: Qwen3.5 ottiene 67,5 in ERQA, molto superiore a Qwen3-VL (52,5); quasi in linea con Gemini 3 Pro (70,5)

- Riconoscimento documenti: Qwen3.5 supera la soglia del 90% in OmniDocBench v1.5 con un impressionante 90,8, superando GPT-5.2 (85,7), Claude Opus 4.5 (87,7) e Gemini 3 Pro (88,5)

- Ragionamento visivo: Qui Qwen3.5 è solo leggermente sotto Gemini 3 Pro, con 79,0 in MMMU-Pro e 87,5 in Video-MME (Gemini 3 Pro: 81,0 e 88,4)

Ragionamento, conoscenza e affidabilità

Ragionamento e conoscenza non sono chiaramente le aree principali di questo rilascio. Ciononostante, ci sono lievi miglioramenti, soprattutto in termini di affidabilità.

- Rispetto delle istruzioni: Con 76,5 in IFBench, Qwen3.5 sembra essere molto affidabile e si posiziona in alto in classifica. Per confronto, l’attuale leader, AWS Nova 2.0 Pro, ottiene 79,0

- Ragionamento a livello graduate: Il punteggio GPQA Diamond di 88,4 è solo un miglioramento incrementale rispetto a Qwen3-Max-Thinking (87,4)

- Conoscenza multilingue: Qwen3.5 raggiunge un punteggio MMMLU di 88,5, inferiore a Gemini 3 Pro (90,6) ma un miglioramento significativo rispetto al modello precedente (84,4)

Come accedere a Qwen3.5

Come per i modelli precedenti, i modelli Qwen3.5 sono open source e possono essere utilizzati in vari modi: direttamente nell’app di chat, via API, scaricati per il deploy locale o integrati in setup personalizzati.

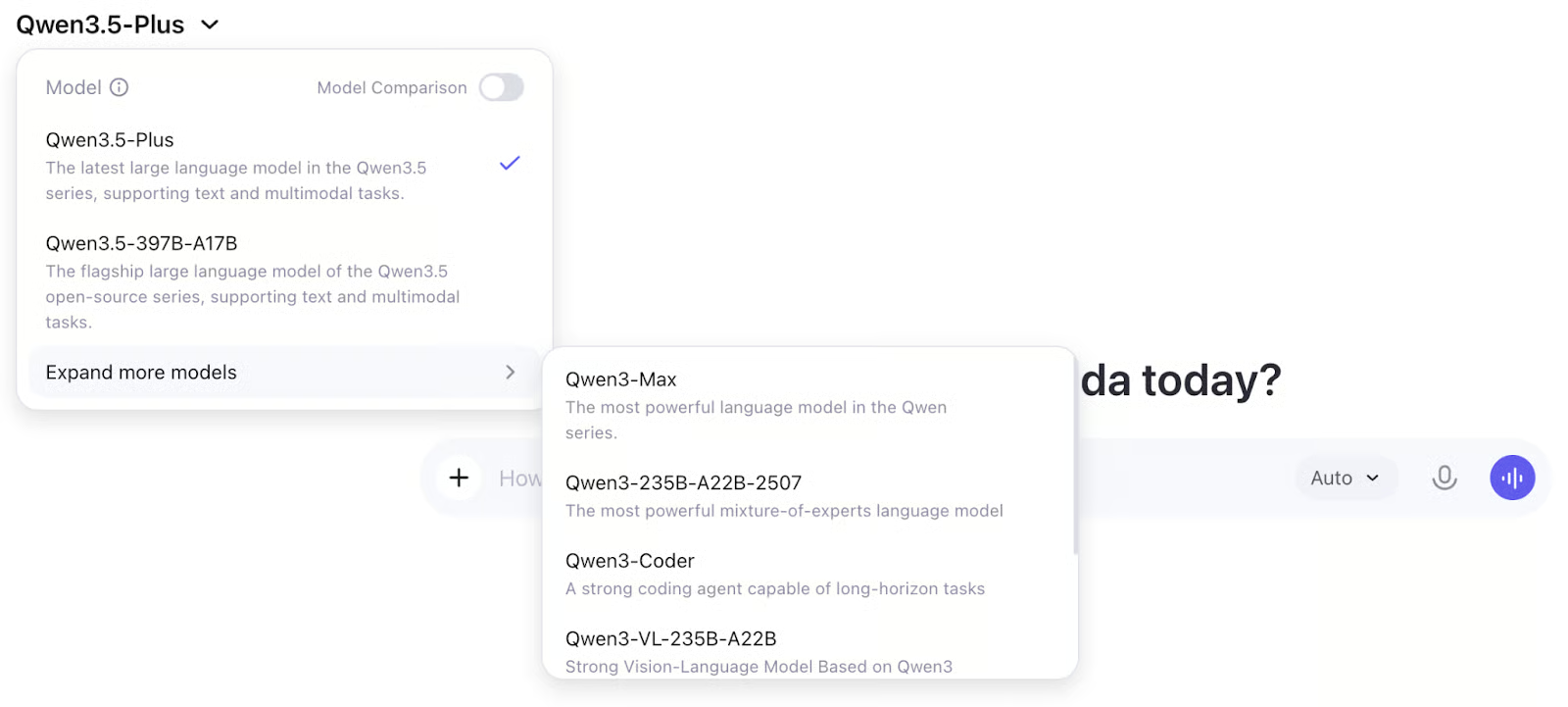

Interfaccia chat

Puoi accedere a Qwen3.5 direttamente su chat.qwen.ai nella consueta interfaccia di chat.

Il menu a tendina per la selezione del modello offre sia Qwen3.5-397B-A17B che Qwen3.5-Plus, oltre ad alcuni modelli precedenti della famiglia Qwen3 e Qwen2.5-Max.

Accesso via API

L’accesso API a Qwen 3.5 funziona come per Qwen3: endpoint compatibili con OpenAI tramite ModelScope (free tier, quote giornaliere) o DashScope/Model Studio (a pagamento, include Qwen3.5-Plus). Aggiorna l’ID modello a qwen3.5-397b-a17b o qwen3.5-plus e sei pronto.

Pesi aperti e deploy locale

Come detto, i pesi del modello Qwen3.5-397B-A17B sono stati rilasciati sotto licenza Apache 2.0. Puoi eseguire Qwen3.5 in locale con strumenti come Ollama, LM Studio o vLLM.

I pesi possono essere scaricati da:

Considerazioni finali

Con nuovi agenti visivi, prestazioni migliorate e ottimizzazione dei costi, il rilascio di Qwen3.5 è notevole e mette pressione non solo sugli altri modelli cinesi ma anche su quelli di OpenAI e Anthropic.

Come per altri rilasci di quest’anno, come GPT-5.3-Codex e Claude Opus 4.6, l’attenzione si sta chiaramente spostando verso l’AI agentica. Il rapido successo di OpenClaw ha dimostrato che le persone desiderano usi pratici dell’AI, e modelli come Qwen3.5, Seedance 2.0 e il presunto prossimo rilascio di DeepSeek mostrano che la Cina sta rapidamente diventando il leader di mercato nei modelli di AI.

Qwen3.5 FAQ

Qual è la differenza tra Qwen3.5 e Qwen3.5-Plus?

Qwen3.5-397B-A17B è il modello con pesi aperti che puoi scaricare ed eseguire in autonomia. Ha una finestra di contesto da 256k e supporta le modalità "Thinking" (ragionamento profondo) e "Fast". Qwen3.5-Plus è la versione hosted via API. Usa la stessa architettura ma aggiunge una enorme finestra di contesto da 1 milione di token e una modalità esclusiva "Auto", che può usare in modo adattivo strumenti come la ricerca sul web e interpreti di codice senza prompt manuali.

Posso eseguire Qwen3.5 in locale e quale hardware mi serve?

Sì, ma richiede hardware significativo. Anche se Qwen3.5 attiva solo 17B parametri per token (rendendolo veloce), devi comunque caricare in memoria il totale di 397B parametri.

- Modello completo (FP16/BF16): Richiede ~800GB di VRAM (necessario cluster di livello enterprise).

- Quantizzato (4 bit): Richiede ~220GB di memoria unificata. Puoi eseguirlo su un Mac Studio/Pro con chip M-series Ultra (256GB di RAM) o su una macchina multi-GPU (es. 3x A100 80GB o 10x RTX 3090/4090).

Qwen3.5 è gratuito per uso commerciale?

Sì. A differenza di molti modelli di frontiera che usano licenze comunitarie restrittive, Qwen3.5 è rilasciato sotto licenza Apache 2.0. Ciò consente uso commerciale senza restrizioni, modifica e distribuzione, rendendolo molto interessante per applicazioni enterprise.

Cosa significa davvero "Nativo Multimodale"?

La maggior parte dei modelli multimodali (come il precedente Qwen3-VL) usa un approccio "agganciato", in cui un modello di visione separato elabora le immagini e le traduce in feature testuali per il modello linguistico. Nativo Multimodale significa che Qwen3.5 è stato addestrato fin dall’inizio per "vedere" e "leggere" simultaneamente usando un unico modello. Questo si traduce in elaborazione più rapida e accuratezza molto superiore per compiti che richiedono un grounding visivo profondo, come la comprensione di UI complesse.

Come si confronta Qwen3.5 con il più grande Qwen3-Max?

Qwen3.5 è progettato come successore più efficiente. Mentre Qwen3-Max è un modello enorme >1 trilione di parametri, Qwen3.5 ne eguaglia le prestazioni nei principali benchmark di ragionamento e coding essendo al contempo 19 volte più veloce nella generazione di testo. Pensa a Qwen3.5 come alla stessa "potenza cerebrale" di Max, ma con un pensiero significativamente più rapido ed economico.

Tom è un data scientist e formatore tecnico. Scrive e gestisce i tutorial e i post del blog di DataCamp su data science. In precedenza, Tom ha lavorato nella data science presso Deutsche Telekom.

Senior editor nell’ambito dell’AI e dell’edtech. Impegnata a esplorare le tendenze in tema di dati e intelligenza artificiale.