Program

Alibaba baru saja meluncurkan model bahasa besar terbarunya, Qwen3.5. Model terbaru ini hadir merespons rilis baru seperti GPT-5.3 Codex dan Claude Opus 4.6, yang keduanya mengesankan kami.

Menurut Alibaba, Qwen 3.5 "dibangun untuk era AI agen", dan model visi-bahasa ini dikabarkan lebih murah dan lebih efisien daripada pendahulunya, dengan menorehkan statistik kinerja kelas terdepan yang mengesankan di beberapa tolok ukur.

Alibaba juga merilis Qwen3.5-Plus, versi premium dari model ini dengan jendela konteks 1 juta token, yang menargetkan Gemini 3.

Dalam artikel ini, saya akan memandu Anda melalui fitur-fitur baru utama Qwen3.5 dan Qwen3.5-Plus, meninjau perbandingannya dengan pesaing, melihat hasil tolok ukurnya, dan menjelaskan cara mengakses model-model baru ini.

Jangan lupa lihat juga panduan kami untuk model pesaing terbaru, seperti Claude Sonnet 4.6 atau GPT-5.3 Instant.

Apa Itu Qwen3.5?

Qwen3.5 adalah generasi terbaru dalam seri model bahasa besar (LLM) Alibaba, Qwen3.5-397B-A17B. Berbeda dengan keluarga model Qwen3 sebelumnya, Qwen3.5 menggabungkan model-model khusus ke dalam satu model visi-bahasa native. Seperti model Qwen sebelumnya, model ini bersifat open-source di bawah lisensi Apache 2.0.

Model ini diposisikan sebagai model fondasi serbaguna untuk kebutuhan konsumen dan perusahaan, serta dirancang untuk alur kerja multimodal dan agen secara native. Qwen3.5-397B-A17B menawarkan dua mode:

- "Thinking" untuk tugas yang memerlukan penalaran lebih mendalam

- "Fast" untuk inferensi cepat pada tugas rutin

Qwen3.5 vs Qwen3.5-Plus

Qwen3.5-Plus adalah layanan hosted yang hanya tersedia melalui API dan sesuai dengan Qwen3.5-397B-A17B, serta bukan model dengan bobot terbuka. Catatan rilis sempat agak membingungkan dalam hal ini: penyebutan Qwen3.5-Plus bisa terbaca sebagai model terpisah, padahal sebenarnya ini adalah layanan proprieter Alibaba yang dibangun di atas model yang sama.

Walau Qwen3.5-Plus berbasis model Qwen3.5-397B-A17B, ada beberapa perbedaan yang perlu diperhatikan. Model ini hanya dapat diakses melalui Alibaba Cloud Model Studio dengan skema bayar per token, dan melalui UI Qwen Chat dengan akses terbatas.

Qwen3.5-Plus menggunakan jendela konteks yang diperluas hingga 1 juta token, dibandingkan jendela konteks 256K token pada model Qwen3.5 standar. Selain "Thinking" dan "Fast", Qwen3.5-Plus juga menyertakan mode "Auto" dengan penalaran adaptif, yang di samping berpikir, dapat menggunakan alat seperti penelusuran dan interpreter kode.

Fitur Utama Qwen3.5

Mari kita lihat beberapa fitur baru yang tersedia di Qwen3.5:

Kemampuan multimodal native

Mirip dengan OpenAI yang menggabungkan model standar dan Codex dalam rilis GPT-5.3 Codex terbaru, Alibaba menggabungkan teks, visi, dan interaksi UI dalam satu model.

Qwen3.5 dilatih secara bersama pada teks, gambar, tangkapan layar UI, dan konten terstruktur. Model ini mendukung tanya jawab visual, pemahaman dokumen, serta interpretasi bagan/tabel, dan menangani grounding tingkat piksel untuk mengidentifikasi dan berinteraksi dengan elemen di layar.

Kemampuan agen visual

Ini membawa kita ke fokus utama berikutnya dari model Qwen3.5. Berkat pelatihan intensif pada tangkapan layar UI, model ini dapat mengenali dan bertindak pada antarmuka seluler dan desktop. Ini memungkinkan model mengeksekusi alur kerja multi-langkah seperti:

- Mengisi formulir

- Menavigasi aplikasi

- Mengubah pengaturan sistem

- Mengelola file

Ini menjadikan Qwen3.5 ideal untuk otomasi produktivitas. Dengan instruksi bahasa alami, Anda dapat membuat agen visual Qwen bertindak di berbagai aplikasi, menyelesaikan alur kerja kompleks. Model ini bahkan dapat mempertahankan state selama rangkaian interaksi panjang, memungkinkan orkestrasi alat dan aplikasi yang andal.

Kinerja dan efisiensi yang ditingkatkan

Qwen3.5 adalah model yang cukup besar, dengan total 397 miliar parameter, meskipun hanya 17 miliar yang diaktifkan per token berkat arsitektur mixture-of-experts. Intinya, ini berarti model ini memiliki kecerdasan model raksasa, dengan kecepatan dan efisiensi biaya layaknya model yang jauh lebih kecil.

Secara praktis, dibandingkan Qwen3-Max, Qwen3.5 397B-A17B 19x lebih cepat dalam dekode tugas konteks panjang (256k token) dan 8,6x lebih cepat untuk alur kerja standar. Yang penting, kecepatan ini tidak mengorbankan kecerdasan; model ini tetap menyamai kinerja penalaran dan pengkodean Qwen3-Max dan melampaui Qwen3-VL, berkat penggabungan awal teks dan video.

Efisiensi biaya yang lebih baik

Seiring peningkatan kinerja, kami juga melihat efisiensi biaya pada model ini.

Demikian pula, pipeline FP8 native (memproses data dalam presisi 8-bit, alih-alih standar 16-bit) membuat Qwen3.5 mengurangi kebutuhan memori hingga 50%. Ini berarti perhitungan dapat berlangsung lebih cepat, meningkatkan kecepatan lebih dari 10% pada skala triliunan token.

Qwen3.5 juga memiliki kosakata yang mengesankan sebesar 250 ribu, memungkinkannya mengekspresikan konsep kompleks dengan lebih sedikit token. Bersama dengan prediksi multi-token, model ini dapat "menebak" beberapa kata berikutnya dalam satu langkah, mengurangi biaya token sebesar 10–60% di 201 bahasa.

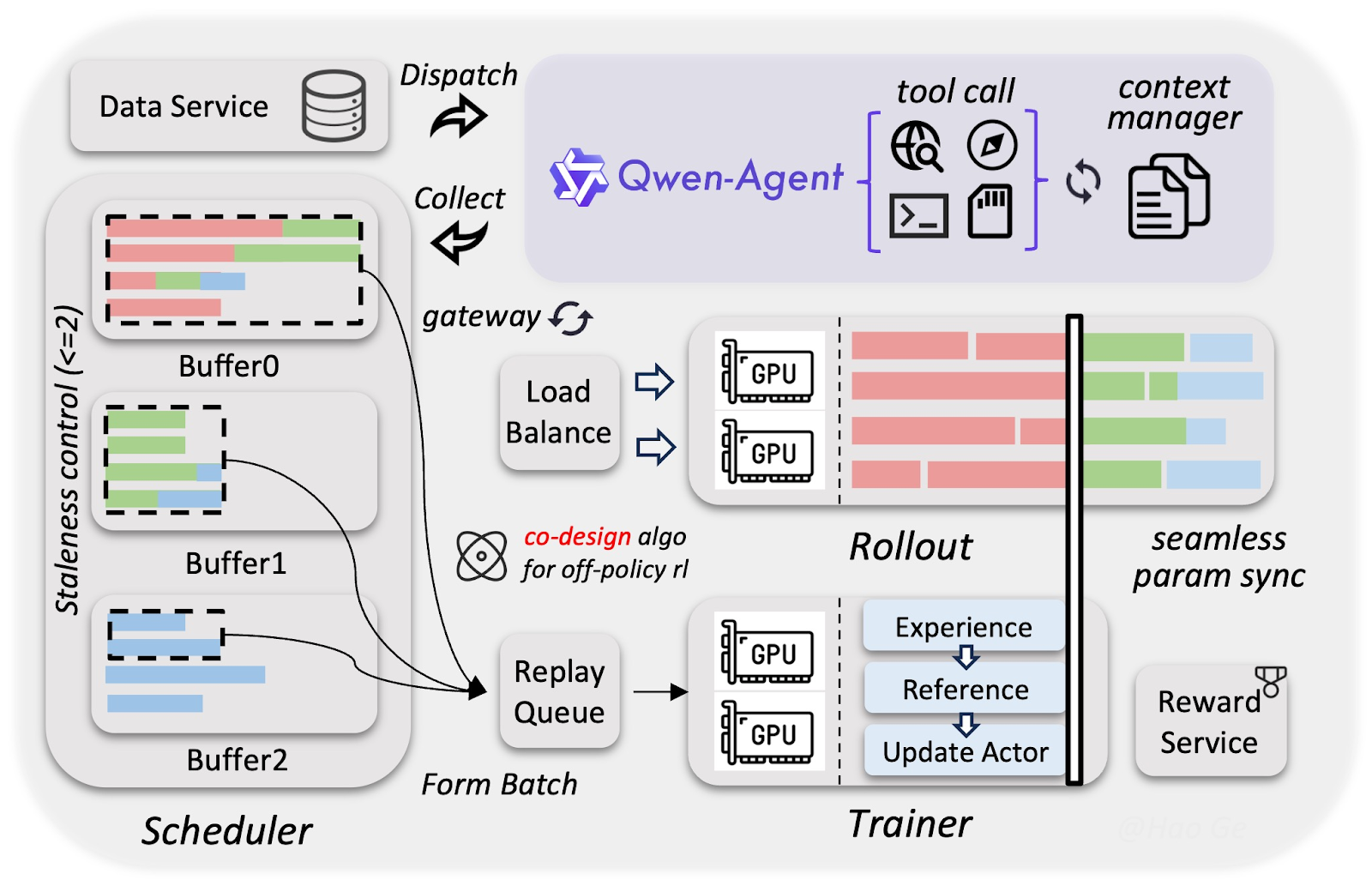

Bagaimana Qwen3.5 Dikembangkan

Proses pengembangan Qwen3.5 menggunakan infrastruktur khusus yang membuat pelatihan model multimodal dan agen (hampir) sama cepat dan murahnya dengan model teks murni. Pendekatan khusus dalam melatih Qwen3.5 bertumpu pada tiga komponen kunci:

- Kualitas data

- Infrastruktur heterogen

- Reinforcement learning (RL) asinkron

Kualitas data

Tim Alibaba mengumpulkan jauh lebih banyak data visual-teks dibandingkan untuk keluarga model Qwen3, namun menyaringnya dengan sangat ketat guna memastikan masukan berkualitas tinggi. Dataset berkualitas tinggi yang dihasilkan memungkinkan model 397B parameter menyamai kecerdasan model 1T parameter yang jauh lebih besar, seperti Qwen3-Max.

Infrastruktur heterogen

Bagian visi dan bahasa dilatih secara terpisah namun simultan. Karena keduanya tidak perlu saling menunggu saat yang lain menghitung, tumpang tindih yang dihasilkan memberikan throughput pelatihan hampir 100% dibandingkan model teks murni.

Reinforcement learning asinkron

Dengan menggunakan kompresi FP8 (pada dasarnya menyimpan angka dengan separuh jumlah bit) dan decoding spekulatif (menebak ke depan), agen menjalankan ribuan tugas secara simultan sementara pelatihan berlangsung di latar belakang tanpa menunggu. Ini mempercepat pelatihan tanpa kehilangan kualitas signifikan, sehingga Qwen3.5 mempelajari keterampilan agen yang kompleks, seperti mengeklik UI atau tugas multi-langkah, 3–5x lebih cepat.

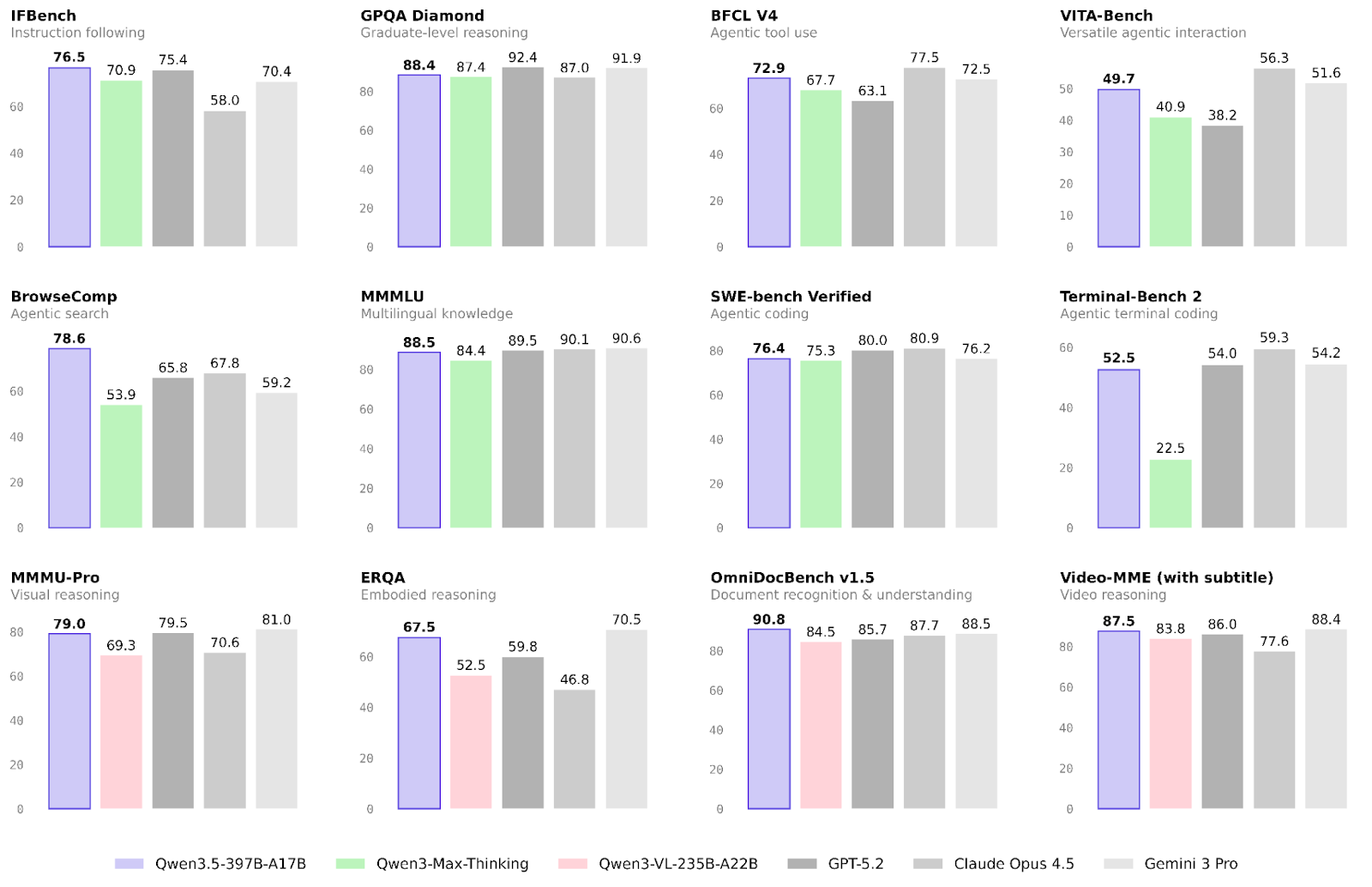

Tolok Ukur Qwen3.5

Kinerja model baru Alibaba ini telah divalidasi di banyak tugas. Kami akan berfokus pada hasil di area alur kerja agen dan multimodal, serta kemampuan penalaran yang lebih umum.

Alur kerja agen

Area di mana Qwen3.5 paling meningkat dibanding keluarga Qwen3 adalah alur kerja agen.

- Pengodean terminal agen: Lompatan paling signifikan terjadi pada Terminal-Bench 2.0, di mana Qwen3.5 mencapai 52,5 dibandingkan hanya 22,5 untuk Qwen3-Max-Thinking, dan mampu bersaing dengan Gemini 3 Pro (54,2). Meski begitu, model ini masih tertinggal cukup jauh dari pemimpin saat ini, GPT-5.3 Codex (77,3).

- Pencarian agen: Ini tampaknya menjadi kekuatan terbesar Qwen3.5. Model ini mencapai 78,6 di BrowseComp, jauh melampaui Gemini 3 Pro (59,2) dan menempati posisi kedua hanya di belakang Claude Opus 4.6 (84,0)

Multimodalitas

Multimodalitas adalah bidang lain yang mengalami peningkatan signifikan dibanding keluarga model sebelumnya. Hal ini terutama berlaku untuk penalaran embodied dan pengenalan dokumen:

- Embodied reasoning: Qwen3.5 meraih 67,5 pada ERQA, jauh lebih tinggi daripada Qwen3-VL (52,5); hampir setara dengan Gemini 3 Pro (70,5)

- Pengenalan dokumen: Qwen3.5 menembus ambang 90% di OmniDocBench v1.5 dengan skor 90,8, melampaui GPT-5.2 (85,7), Claude Opus 4.5 (87,7), dan Gemini 3 Pro (88,5)

- Penalaran visual: Di sini, Qwen3.5 hanya sedikit di bawah Gemini 3 Pro, dengan skor 79,0 di MMMU-Pro dan 87,5 di Video-MME (Gemini 3 Pro: 81,0 dan 88,4)

Penalaran, pengetahuan, dan keandalan

Penalaran dan pengetahuan jelas bukan fokus utama rilis ini. Meski begitu, ada peningkatan kecil di area ini, terutama dalam hal keandalan.

- Mengikuti instruksi: Dengan skor 76,5 di IFBench, Qwen3.5 tampak sangat andal dan menempati peringkat tinggi. Sebagai perbandingan, pemimpin saat ini, AWS Nova 2.0 Pro, meraih 79,0

- Penalaran setara pascasarjana: Skor GPQA Diamond 88,4 hanya merupakan peningkatan kecil dari Qwen3-Max-Thinking (87,4)

- Pengetahuan multibahasa: Qwen3.5 mencapai skor MMMLU 88,5, di bawah Gemini 3 Pro (90,6), namun peningkatan signifikan dari model sebelumnya (84,4)

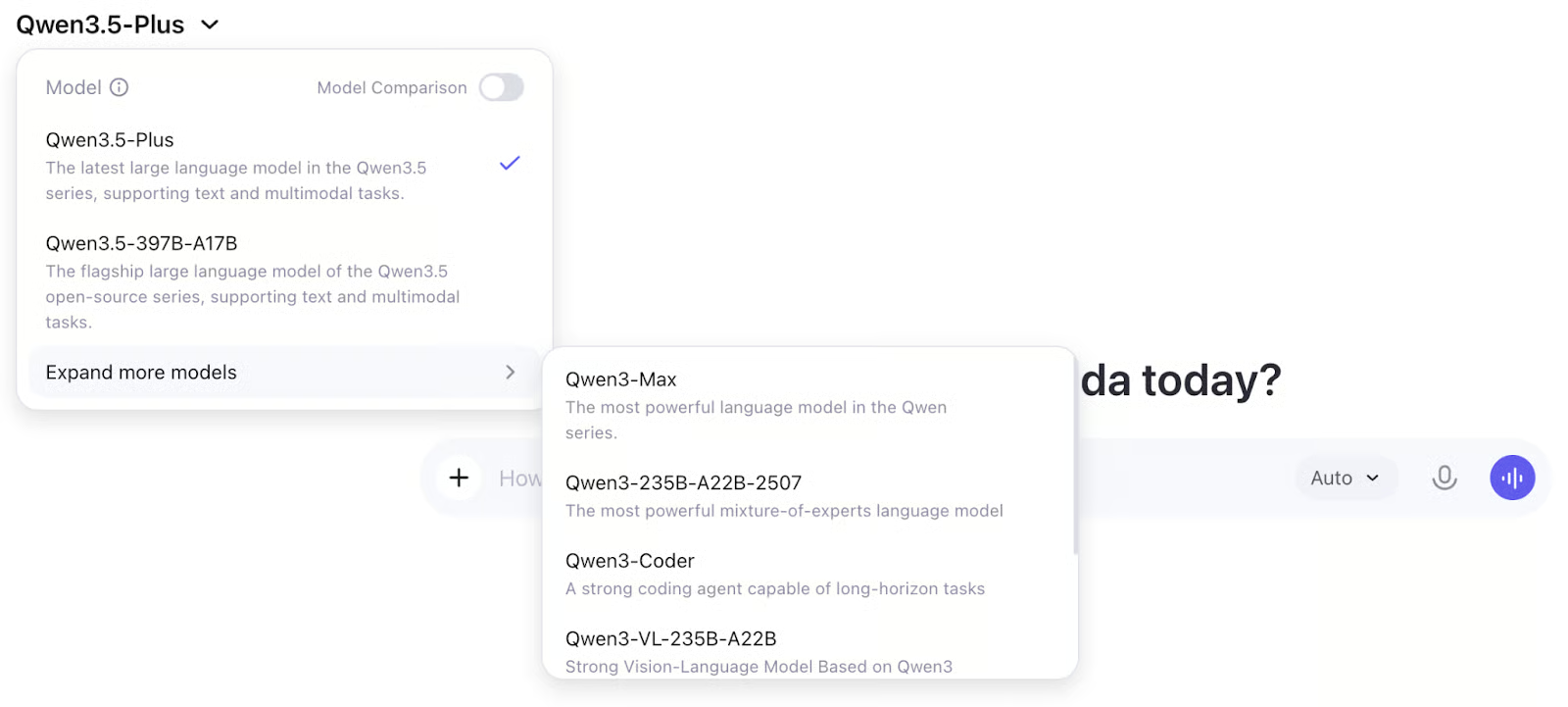

Cara Mengakses Qwen3.5

Seperti model sebelumnya, model Qwen3.5 bersifat open source dan dapat digunakan dalam berbagai cara: langsung di aplikasi chat, melalui API, diunduh untuk penerapan lokal, atau diintegrasikan ke dalam pengaturan kustom.

Antarmuka chat

Anda dapat mengakses Qwen3.5 langsung di chat.qwen.ai dalam antarmuka chat yang familiar.

Menu dropdown pemilihan model menawarkan model Qwen3.5-397B-A17B dan Qwen3.5-Plus, serta beberapa model sebelumnya dari keluarga model Qwen3 dan Qwen2.5-Max.

Akses API

Akses API Qwen 3.5 bekerja sama seperti Qwen3: endpoint yang kompatibel dengan OpenAI melalui ModelScope (tingkat gratis, kuota harian) atau DashScope/Model Studio (berbayar, termasuk Qwen3.5-Plus). Perbarui ID model Anda ke qwen3.5-397b-a17b atau qwen3.5-plus dan Anda siap menggunakannya.

Bobot terbuka dan penerapan lokal

Seperti disebutkan sebelumnya, bobot model Qwen3.5-397B-A17B dirilis di bawah lisensi Apache 2.0. Anda dapat menjalankan Qwen3.5 secara lokal menggunakan alat seperti Ollama, LM Studio, atau vLLM.

Bobot dapat diunduh dari:

Penutup

Dengan agen visual baru, peningkatan kinerja, dan optimasi biaya, rilis Qwen3.5 terbilang mengesankan, menekan bukan hanya model-model China lainnya tetapi juga menantang model dari OpenAI dan Anthropic.

Seperti rilis baru lainnya tahun ini, seperti GPT-5.3-Codex dan Claude Opus 4.6, fokus jelas bergeser ke AI agen. Keberhasilan cepat OpenClaw membuktikan bahwa orang menginginkan penggunaan AI yang praktis, dan model seperti Qwen3.5, Seedance 2.0, serta kabar rilis mendatang dari DeepSeek menunjukkan bahwa China dengan cepat menjadi pemimpin pasar dalam model AI.

Qwen3.5 FAQs

Apa perbedaan antara Qwen3.5 dan Qwen3.5-Plus?

Qwen3.5-397B-A17B adalah model berbobot terbuka yang dapat Anda unduh dan jalankan sendiri. Model ini memiliki jendela konteks 256k dan mendukung mode "Thinking" (penalaran mendalam) dan "Fast". Qwen3.5-Plus adalah versi API hosted. Model ini menggunakan arsitektur yang sama tetapi menambahkan jendela konteks 1 juta token yang sangat besar dan mode "Auto" eksklusif, yang dapat secara adaptif menggunakan alat seperti penelusuran web dan interpreter kode tanpa prompt manual.

Bisakah saya menjalankan Qwen3.5 secara lokal, dan perangkat keras apa yang saya butuhkan?

Bisa, tetapi memerlukan perangkat keras yang signifikan. Meskipun Qwen3.5 hanya mengaktifkan 17B parameter per token (sehingga cepat), Anda tetap perlu memuat total 397B parameter ke dalam memori.

- Model Penuh (FP16/BF16): Membutuhkan ~800GB VRAM (diperlukan klaster kelas enterprise).

- Terkualitas (4-bit): Membutuhkan ~220GB memori terpadu. Anda dapat menjalankannya pada Mac Studio/Pro dengan chip M-series Ultra (RAM 256GB) atau rig multi-GPU (mis., 3x A100 80GB atau 10x RTX 3090/4090).

Apakah Qwen3.5 gratis untuk penggunaan komersial?

Ya. Tidak seperti banyak model frontier yang menggunakan lisensi komunitas yang restriktif, Qwen3.5 dirilis di bawah lisensi Apache 2.0. Ini memungkinkan penggunaan komersial tanpa batas, modifikasi, dan distribusi, sehingga sangat menarik untuk aplikasi enterprise.

Apa sebenarnya yang dimaksud dengan "Multimodal Native"?

Kebanyakan model multimodal (seperti Qwen3-VL sebelumnya) menggunakan pendekatan "dipasang tambahan", di mana model visi terpisah memproses gambar dan menerjemahkannya menjadi fitur teks untuk model bahasa. Multimodal Native berarti Qwen3.5 dilatih sejak awal untuk "melihat" dan "membaca" secara bersamaan menggunakan satu model. Hasilnya adalah pemrosesan yang lebih cepat dan akurasi yang jauh lebih tinggi untuk tugas yang memerlukan grounding visual yang mendalam, seperti memahami layar UI yang kompleks.

Bagaimana Qwen3.5 dibandingkan dengan Qwen3-Max yang lebih besar?

Qwen3.5 dirancang sebagai penerus yang lebih efisien. Sementara Qwen3-Max adalah model dengan >1 triliun parameter, Qwen3.5 menyamai kinerjanya pada tolok ukur penalaran dan pengkodean utama sekaligus 19x lebih cepat dalam menghasilkan teks. Anggap Qwen3.5 memiliki "daya otak" yang sama dengan Max, tetapi berpikir jauh lebih cepat dan lebih murah.

Tom adalah seorang ilmuwan data dan pendidik teknis. Ia menulis dan mengelola tutorial serta artikel blog ilmu data DataCamp. Sebelumnya, Tom bekerja di bidang ilmu data di Deutsche Telekom.

Editor senior di bidang AI dan edtech. Berkomitmen mengeksplorasi tren data dan AI.