Tracks

Alibaba vừa ra mắt mô hình ngôn ngữ lớn mới nhất, Qwen3.5. Mô hình này xuất hiện sau các bản phát hành mới như GPT-5.3 Codex và Claude Opus 4.6, cả hai đều đã gây ấn tượng mạnh với chúng tôi.

Theo Alibaba, Qwen 3.5 được “xây dựng cho kỷ nguyên AI tác tử”, và mô hình ngôn ngữ–thị giác này được cho là rẻ hơn và hiệu quả hơn thế hệ trước, đạt một số chỉ số hiệu năng ấn tượng ở nhiều bài kiểm tra chuẩn cấp độ tiên phong.

Alibaba cũng ra mắt Qwen3.5-Plus, phiên bản cao cấp của mô hình với cửa sổ ngữ cảnh 1 triệu token, hướng thẳng tới đối thủ Gemini 3.

Trong bài viết này, tôi sẽ giới thiệu các tính năng mới quan trọng của Qwen3.5 và Qwen3.5-Plus, đánh giá chúng so với đối thủ, xem xét các điểm chuẩn và cách bạn có thể truy cập các mô hình mới.

Bạn cũng nên xem các hướng dẫn về những mô hình cạnh tranh mới nhất, như Claude Sonnet 4.6 hoặc GPT-5.3 Instant.

Qwen3.5 là gì?

Qwen3.5 là thế hệ mới nhất trong dòng mô hình ngôn ngữ lớn (LLM) của Alibaba, Qwen3.5-397B-A17B. Khác với họ mô hình Qwen3 trước đó, Qwen3.5 kết hợp các mô hình chuyên biệt thành một mô hình ngôn ngữ–thị giác bản địa duy nhất. Giống các phiên bản Qwen trước, nó là mã nguồn mở theo giấy phép Apache 2.0.

Mô hình được định vị là mô hình nền tảng đa dụng cho cả người dùng cá nhân và doanh nghiệp, được thiết kế cho quy trình làm việc đa phương thức và tác tử bản địa. Qwen3.5-397B-A17B cung cấp hai chế độ:

- “Thinking” cho các tác vụ cần suy luận sâu

- “Fast” cho suy luận nhanh với các tác vụ thường lệ

Qwen3.5 so với Qwen3.5-Plus

Qwen3.5-Plus là dịch vụ được lưu trữ, chỉ truy cập qua API, tương ứng với Qwen3.5-397B-A17B và bản thân không phải mô hình mở trọng số. Ghi chú phát hành có phần gây nhầm lẫn: việc nhắc tới Qwen3.5-Plus có thể được hiểu là một mô hình riêng, nhưng thực tế đây là dịch vụ độc quyền của Alibaba xây dựng trên cùng mô hình.

Dù Qwen3.5-Plus dựa trên mô hình Qwen3.5-397B-A17B, vẫn có một số khác biệt đáng chú ý. Nó chỉ có thể truy cập qua Alibaba Cloud Model Studio theo hình thức trả phí theo token, và qua giao diện Qwen Chat với quyền truy cập hạn chế.

Qwen3.5-Plus dùng cửa sổ ngữ cảnh mở rộng 1 triệu token, so với 256K token của Qwen3.5 tiêu chuẩn. Bên cạnh “Thinking” và “Fast”, Qwen3.5-Plus còn có chế độ “Auto” với tư duy thích ứng, ngoài tư duy còn có thể dùng công cụ như tìm kiếm và trình thông dịch mã.

Các tính năng chính của Qwen3.5

Hãy xem một số tính năng mới của Qwen3.5:

Khả năng đa phương thức bản địa

Tương tự việc OpenAI hợp nhất mô hình tiêu chuẩn và Codex trong bản phát hành GPT-5.3 Codex gần đây, Alibaba kết hợp văn bản, thị giác và tương tác UI trong một mô hình duy nhất.

Qwen3.5 được huấn luyện chung trên văn bản, hình ảnh, ảnh chụp màn hình UI và nội dung có cấu trúc. Nó hỗ trợ hỏi đáp trực quan, hiểu tài liệu, diễn giải biểu đồ/bảng, và xử lý liên kết ở cấp độ điểm ảnh để nhận diện và tương tác với phần tử trên màn hình.

Năng lực tác tử trực quan

Đây là trọng tâm tiếp theo của Qwen3.5. Nhờ huấn luyện rộng rãi trên ảnh chụp UI, mô hình có thể nhận diện và thao tác trên giao diện di động và máy tính. Điều này cho phép mô hình thực thi các quy trình nhiều bước như:

- Điền biểu mẫu

- Điều hướng ứng dụng

- Thay đổi cài đặt hệ thống

- Tổ chức tệp tin

Điều này khiến Qwen3.5 lý tưởng cho tự động hóa năng suất. Bằng hướng dẫn ngôn ngữ tự nhiên, bạn có thể cho tác tử trực quan của Qwen hành động trên nhiều ứng dụng, hoàn tất các quy trình phức tạp. Nó còn có thể duy trì trạng thái qua các chuỗi tương tác dài, cho phép điều phối công cụ và ứng dụng một cách vững chắc.

Hiệu năng và hiệu quả được tăng cường

Qwen3.5 là mô hình khá lớn, với tổng 397 tỷ tham số, dù chỉ 17 tỷ tham số được kích hoạt trên mỗi token nhờ kiến trúc mixture-of-experts. Về bản chất, điều này có nghĩa là nó có trí tuệ của mô hình khổng lồ, nhưng tốc độ và chi phí như mô hình nhỏ hơn nhiều.

Thực tế, so với Qwen3-Max, Qwen3.5 397B-A17B nhanh hơn 19 lần khi giải mã tác vụ ngữ cảnh dài (256k token) và nhanh hơn 8,6 lần cho quy trình tiêu chuẩn. Quan trọng là tốc độ này không làm giảm trí tuệ; nó vẫn ngang bằng về suy luận và lập trình so với Qwen3-Max và vượt Qwen3-VL nhờ kết hợp sớm văn bản và video.

Tối ưu chi phí

Cùng với hiệu năng cải thiện, mô hình này cũng mang lại hiệu quả chi phí.

Tương tự, pipeline FP8 bản địa (xử lý dữ liệu ở độ chính xác 8-bit thay vì chuẩn 16-bit) giúp Qwen3.5 cắt giảm 50% bộ nhớ cần thiết để chạy. Điều này cho phép tính toán nhanh hơn, cải thiện tốc độ hơn 10% ở quy mô nghìn tỷ token.

Qwen3.5 còn có bộ từ vựng 250 nghìn ấn tượng, cho phép diễn đạt khái niệm phức tạp với ít token hơn. Cùng với dự đoán đa token, mô hình có thể “đoán” nhiều từ tiếp theo trong một bước, giảm chi phí token từ 10–60% trên 201 ngôn ngữ.

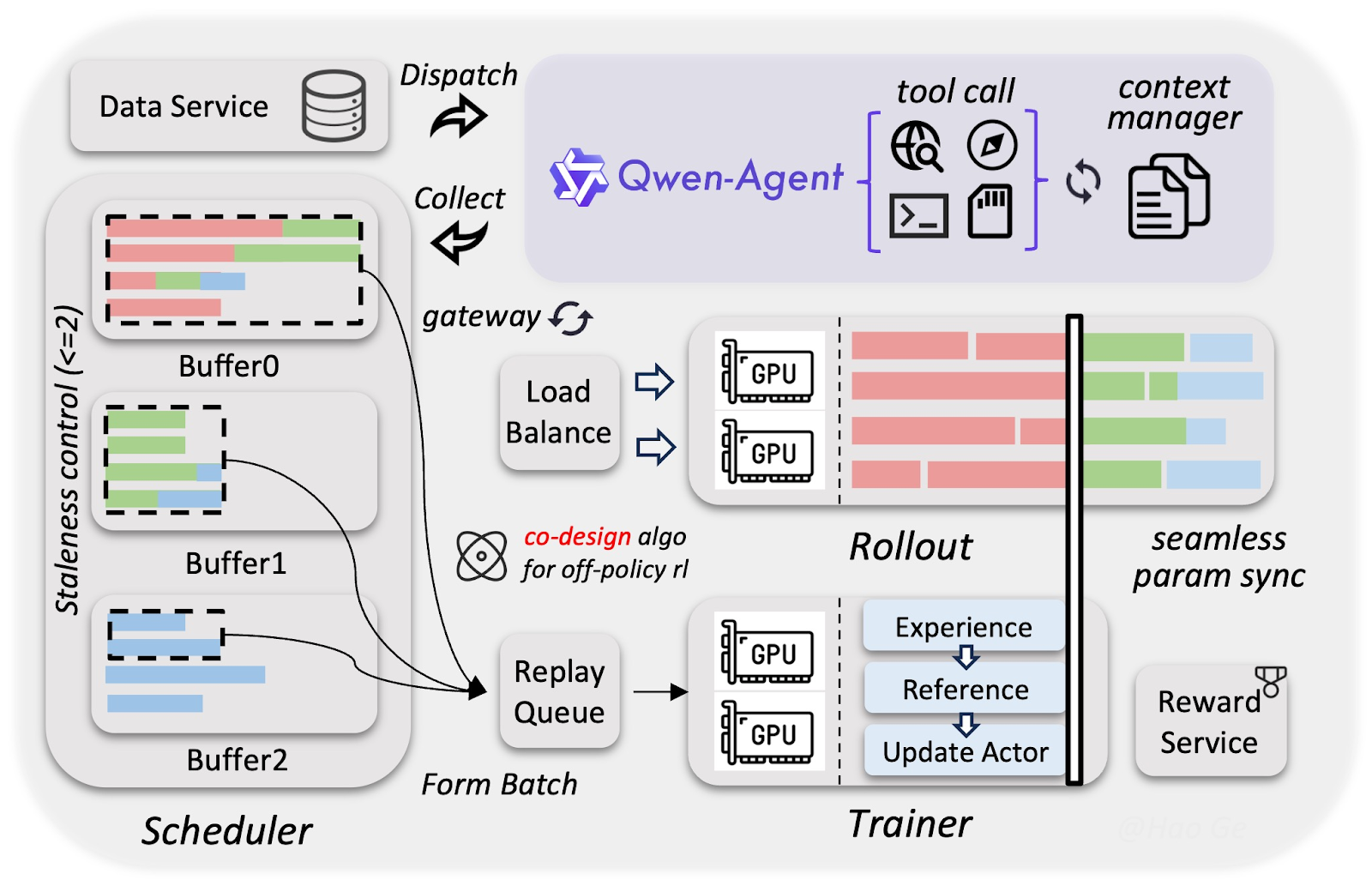

Qwen3.5 được phát triển như thế nào

Quy trình phát triển Qwen3.5 sử dụng hạ tầng tùy chỉnh giúp huấn luyện mô hình đa phương thức và tác tử nhanh và rẻ (gần) như mô hình thuần văn bản. Cách tiếp cận đặc biệt trong huấn luyện Qwen3.5 nằm ở ba thành phần chính:

- Chất lượng dữ liệu

- Hạ tầng dị thể

- Học tăng cường bất đồng bộ (RL)

Chất lượng dữ liệu

Đội ngũ Alibaba thu thập dữ liệu văn bản–hình ảnh nhiều hơn đáng kể so với họ mô hình Qwen3, nhưng lọc rất nghiêm ngặt để đảm bảo đầu vào chất lượng cao. Bộ dữ liệu chất lượng này giúp mô hình 397B tham số đạt mức thông minh tương đương những mô hình 1T tham số lớn hơn, như Qwen3-Max.

Hạ tầng dị thể

Phần thị giác và ngôn ngữ được huấn luyện tách biệt nhưng đồng thời. Vì không phần nào phải chờ phần kia tính toán, sự chồng lấp này đem lại thông lượng huấn luyện gần như 100% so với mô hình thuần văn bản.

Học tăng cường bất đồng bộ

Sử dụng nén FP8 (về cơ bản là lưu trữ số với một nửa số bit) và giải mã suy đoán (đoán trước), các tác tử chạy hàng nghìn tác vụ đồng thời trong khi huấn luyện diễn ra nền mà không cần chờ. Điều này tăng tốc huấn luyện mà không suy giảm chất lượng đáng kể, nên Qwen3.5 học các kỹ năng tác tử phức tạp, như bấm UI hoặc tác vụ nhiều bước, nhanh hơn 3–5 lần.

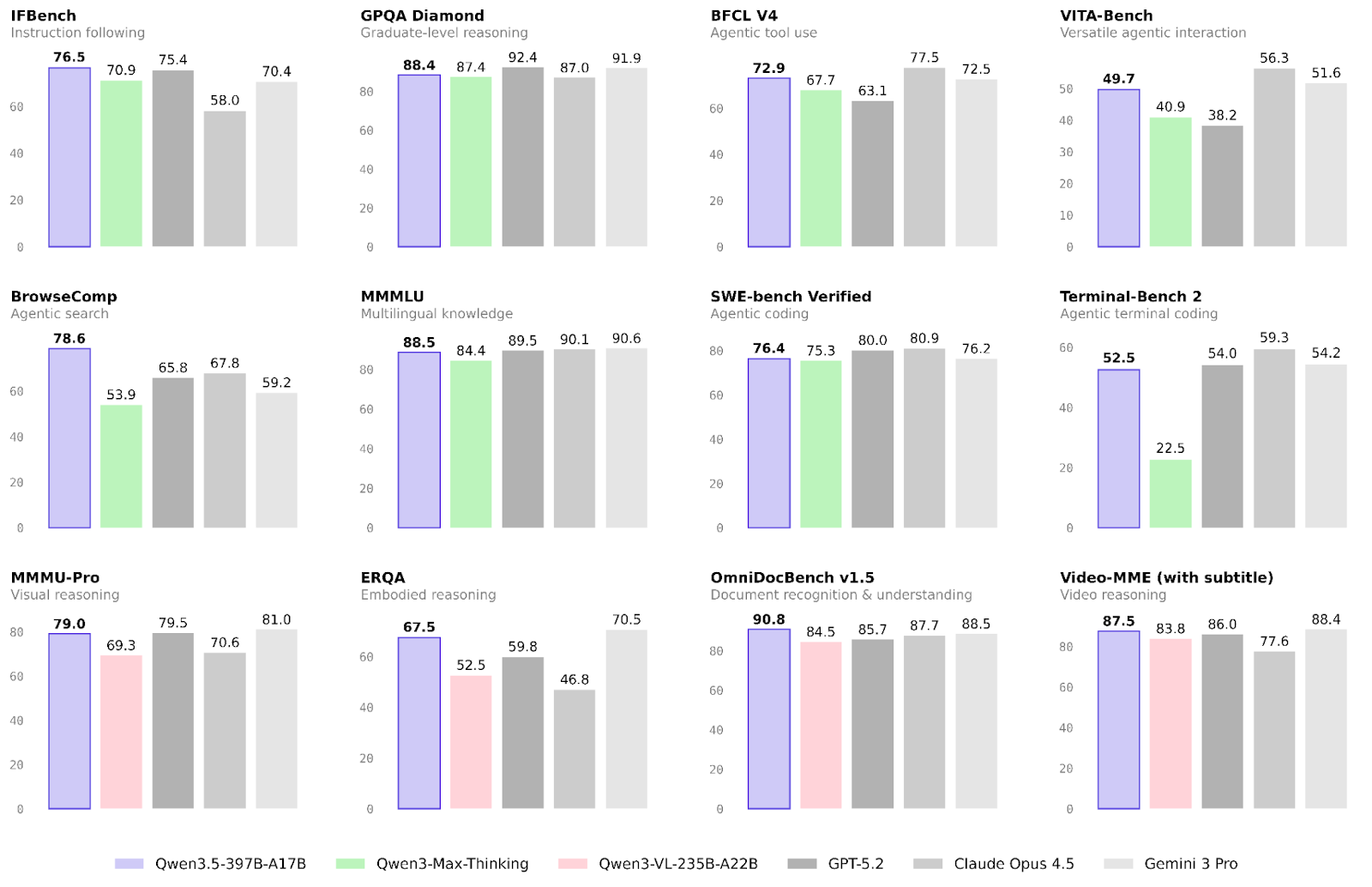

Điểm chuẩn Qwen3.5

Hiệu năng của mô hình mới từ Alibaba đã được kiểm chứng trên nhiều tác vụ. Chúng tôi sẽ tập trung vào kết quả trong các lĩnh vực quy trình tác tử và đa phương thức, cũng như kỹ năng suy luận tổng quát.

Quy trình tác tử

Lĩnh vực Qwen3.5 cải thiện nhiều nhất so với họ Qwen3 là các quy trình tác tử.

- Lập trình tác tử trên terminal: Bước nhảy lớn nhất diễn ra ở Terminal-Bench 2.0, nơi Qwen3.5 đạt 52,5 so với chỉ 22,5 của Qwen3-Max-Thinking, và có thể cạnh tranh với Gemini 3 Pro (54,2). Dẫu vậy, nó vẫn tụt khá xa so với quán quân hiện tại, GPT-5.3 Codex (77,3).

- Tác tử tìm kiếm: Đây có vẻ là thế mạnh lớn nhất của Qwen3.5. Nó đạt 78,6 ở BrowseComp, vượt xa Gemini 3 Pro (59,2) và đứng thứ hai, chỉ sau Claude Opus 4.6 (84,0)

Đa phương thức

Đa phương thức cũng được cải thiện đáng kể so với họ mô hình trước. Điều này đặc biệt đúng với suy luận nhập vai và nhận dạng tài liệu:

- Suy luận nhập vai: Qwen3.5 đạt 67,5 ở ERQA, cao hơn đáng kể so với Qwen3-VL (52,5); gần ngang bằng Gemini 3 Pro (70,5)

- Nhận dạng tài liệu: Qwen3.5 vượt ngưỡng 90% ở OmniDocBench v1.5 với 90,8, vượt GPT-5.2 (85,7), Claude Opus 4.5 (87,7) và Gemini 3 Pro (88,5)

- Suy luận trực quan: Ở đây, Qwen3.5 chỉ kém nhẹ Gemini 3 Pro, đạt 79,0 ở MMMU-Pro và 87,5 ở Video-MME (Gemini 3 Pro: 81,0 và 88,4)

Suy luận, kiến thức và độ tin cậy

Suy luận và kiến thức rõ ràng không phải trọng tâm chính của bản phát hành này. Dù vậy, vẫn có những cải tiến nhỏ, đặc biệt về độ tin cậy.

- Tuân thủ hướng dẫn: Với 76,5 ở IFBench, Qwen3.5 tỏ ra rất đáng tin cậy và xếp hạng cao. So sánh, đứng đầu hiện tại, AWS Nova 2.0 Pro, đạt 79,0

- Suy luận trình độ sau đại học: Điểm GPQA Diamond 88,4 chỉ là cải thiện nhỏ so với Qwen3-Max-Thinking (87,4)

- Kiến thức đa ngôn ngữ: Qwen3.5 đạt điểm MMMLU 88,5, thấp hơn Gemini 3 Pro (90,6), nhưng cải thiện đáng kể so với mô hình trước (84,4)

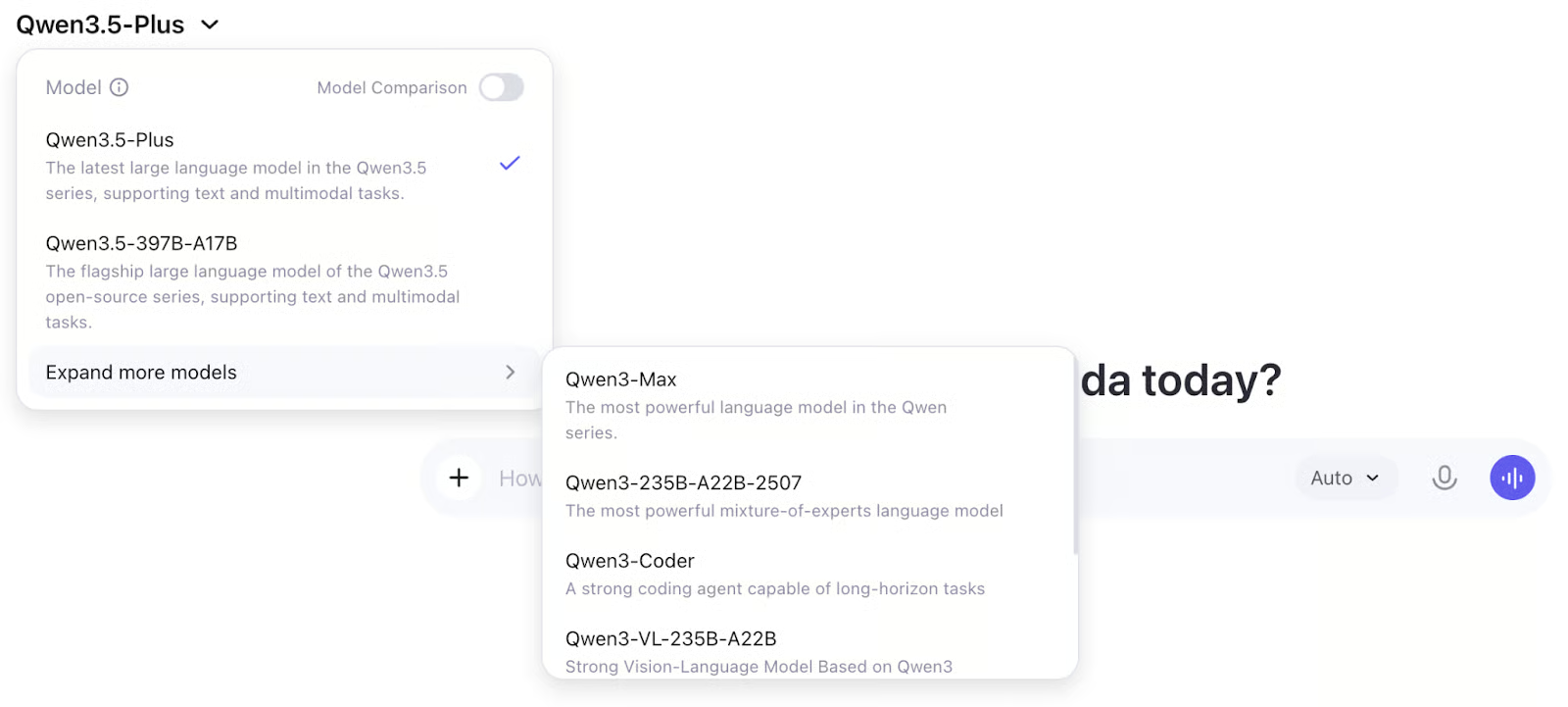

Cách truy cập Qwen3.5

Tương tự các mô hình trước, Qwen3.5 là mã nguồn mở và có thể dùng theo nhiều cách: trực tiếp trong ứng dụng chat, qua API, tải về để triển khai cục bộ, hoặc tích hợp vào thiết lập tùy chỉnh.

Giao diện chat

Bạn có thể truy cập Qwen3.5 trực tiếp tại chat.qwen.ai với giao diện quen thuộc.

Danh sách chọn mô hình gồm cả Qwen3.5-397B-A17B và Qwen3.5-Plus, cùng một vài mô hình trước thuộc họ Qwen3 và Qwen2.5-Max.

Truy cập API

Truy cập API Qwen 3.5 hoạt động giống Qwen3: endpoint tương thích OpenAI qua ModelScope (miễn phí, hạn ngạch hằng ngày) hoặc DashScope/Model Studio (trả phí, bao gồm Qwen3.5-Plus). Cập nhật ID mô hình thành qwen3.5-397b-a17b hoặc qwen3.5-plus là bạn có thể bắt đầu.

Trọng số mở và triển khai cục bộ

Như đã đề cập, trọng số mô hình Qwen3.5-397B-A17B được phát hành theo giấy phép Apache 2.0. Bạn có thể chạy Qwen3.5 cục bộ bằng các công cụ như Ollama, LM Studio, hoặc vLLM.

Bạn có thể tải trọng số từ:

Kết luận

Với các tác tử trực quan mới, hiệu năng cao hơn và tối ưu chi phí, Qwen3.5 là một bản phát hành ấn tượng, tạo áp lực không chỉ lên các mô hình Trung Quốc khác mà còn thách thức cả mô hình từ OpenAI và Anthropic.

Giống nhiều bản phát hành năm nay như GPT-5.3-Codex và Claude Opus 4.6, trọng tâm đang chuyển dịch rõ rệt sang AI tác tử. Thành công nhanh chóng của OpenClaw cho thấy mọi người đang khao khát các ứng dụng AI thực tiễn, và những mô hình như Qwen3.5, Seedance 2.0, cùng tin đồn về bản phát hành sắp tới từ DeepSeek cho thấy Trung Quốc đang nhanh chóng trở thành thị trường dẫn đầu về mô hình AI.

Qwen3.5 FAQs

Sự khác biệt giữa Qwen3.5 và Qwen3.5-Plus là gì?

Qwen3.5-397B-A17B là mô hình mở trọng số mà bạn có thể tải về và tự chạy. Nó có cửa sổ ngữ cảnh 256k và hỗ trợ các chế độ "Thinking" (suy luận sâu) và "Fast". Qwen3.5-Plus là phiên bản API được lưu trữ. Nó dùng cùng kiến trúc nhưng bổ sung cửa sổ ngữ cảnh 1 triệu token và chế độ độc quyền "Auto", có thể linh hoạt dùng các công cụ như tìm kiếm web và trình thông dịch mã mà không cần nhắc lệnh thủ công.

Tôi có thể chạy Qwen3.5 cục bộ không, và cần phần cứng gì?

Có, nhưng cần phần cứng đáng kể. Dù Qwen3.5 chỉ kích hoạt 17B tham số trên mỗi token (giúp nhanh), bạn vẫn cần nạp tổng 397B tham số vào bộ nhớ.

- Mô hình đầy đủ (FP16/BF16): Cần ~800GB VRAM (yêu cầu cụm máy cấp doanh nghiệp).

- Định lượng (4-bit): Cần ~220GB bộ nhớ hợp nhất. Bạn có thể chạy trên Mac Studio/Pro với chip M-series Ultra (256GB RAM) hoặc giàn đa GPU (ví dụ, 3x A100 80GB hoặc 10x RTX 3090/4090).

Qwen3.5 có miễn phí cho mục đích thương mại không?

Có. Không giống nhiều mô hình tiên phong dùng giấy phép cộng đồng hạn chế, Qwen3.5 được phát hành theo giấy phép Apache 2.0. Điều này cho phép sử dụng thương mại không hạn chế, sửa đổi và phân phối, khiến nó rất hấp dẫn cho các ứng dụng doanh nghiệp.

"Đa phương thức bản địa" thực sự nghĩa là gì?

Hầu hết mô hình đa phương thức (như Qwen3-VL trước đây) dùng cách tiếp cận "ghép thêm", trong đó mô hình thị giác riêng xử lý ảnh và chuyển thành đặc trưng văn bản cho mô hình ngôn ngữ. Đa phương thức bản địa nghĩa là Qwen3.5 được huấn luyện ngay từ đầu để "nhìn" và "đọc" đồng thời bằng một mô hình duy nhất. Kết quả là xử lý nhanh hơn và độ chính xác cao hơn nhiều cho các tác vụ đòi hỏi liên kết hình ảnh sâu, như hiểu các màn hình UI phức tạp.

Qwen3.5 so với Qwen3-Max lớn hơn như thế nào?

Qwen3.5 được thiết kế để hiệu quả hơn người tiền nhiệm. Trong khi Qwen3-Max là mô hình >1 nghìn tỷ tham số, Qwen3.5 sánh ngang hiệu năng trên các điểm chuẩn suy luận và lập trình then chốt, đồng thời nhanh hơn 19 lần khi sinh văn bản. Hãy coi Qwen3.5 có cùng "sức mạnh não bộ" như Max, nhưng suy nghĩ nhanh hơn và rẻ hơn đáng kể.

Tom là một nhà khoa học dữ liệu và giảng viên kỹ thuật. Anh viết và quản lý các bài hướng dẫn và bài blog về khoa học dữ liệu của DataCamp. Trước đây, Tom làm việc trong lĩnh vực khoa học dữ liệu tại Deutsche Telekom.

Biên tập viên cấp cao trong lĩnh vực AI và công nghệ giáo dục. Cam kết khám phá các xu hướng dữ liệu và AI.