Programma

L’attuale rivoluzione dell’AI generativa non sarebbe possibile senza i cosiddetti large language model (LLM). Basati sui transformer, una potente architettura neurale, gli LLM sono sistemi di AI utilizzati per modellare ed elaborare il linguaggio umano. Si chiamano “large” perché hanno centinaia di milioni o addirittura miliardi di parametri, pre-addestrati su un enorme corpus di testi.

Inizia oggi il nostro corso sui concetti dei Large Language Models (LLM) per scoprire come funzionano gli LLM.

Gli LLM sono i foundation model di chatbot popolari e molto usati, come ChatGPT e Google Gemini. In particolare, ChatGPT è alimentato da GPT-5, un LLM sviluppato e di proprietà di OpenAI.

ChatGPT e Gemini, così come molti altri chatbot popolari, hanno in comune il fatto che i loro LLM sottostanti sono proprietari. Ciò significa che appartengono a un’azienda e possono essere usati solo dai clienti dopo l’acquisto di una licenza. Tale licenza garantisce diritti, ma anche possibili restrizioni su come utilizzare l’LLM, oltre a informazioni limitate sui meccanismi alla base della tecnologia.

Eppure, un movimento parallelo nello spazio degli LLM sta crescendo rapidamente: gli LLM open source. A fronte delle crescenti preoccupazioni per la mancanza di trasparenza e la scarsa accessibilità degli LLM proprietari, controllati principalmente dalle Big Tech come Microsoft, Google e Meta, gli LLM open source promettono di rendere il campo in rapida crescita degli LLM e dell’AI generativa più accessibile, trasparente e innovativo.

Questo articolo esplora i migliori LLM open source disponibili nel 2026. Anche se sono passati solo pochi anni dal lancio di ChatGPT e dalla diffusione degli LLM (proprietari), la community open source ha già raggiunto traguardi importanti, con un buon numero di LLM open source disponibili per scopi diversi. Continua a leggere per scoprire i più popolari!

In breve: i migliori LLM open source nel 2026

- GLM 4.6: contesto da 200K token, ragionamento agentico e coding più solidi, supera GLM-4.5 e DeepSeek-V3.1.

- gpt-oss-120B: modello open-weight di OpenAI con 117B parametri, accesso alla chain-of-thought, livelli di ragionamento e deployment su singola GPU.

- Qwen3-235B-Instruct-2507: contesto oltre 1M di token, 22B parametri attivi, ragionamento multilingue e follow-up istruzioni allo stato dell’arte.

- DeepSeek-V3.2-Exp: modello sperimentale con attenzione sparsa che eguaglia le prestazioni di V3.1 a costi computazionali molto inferiori.

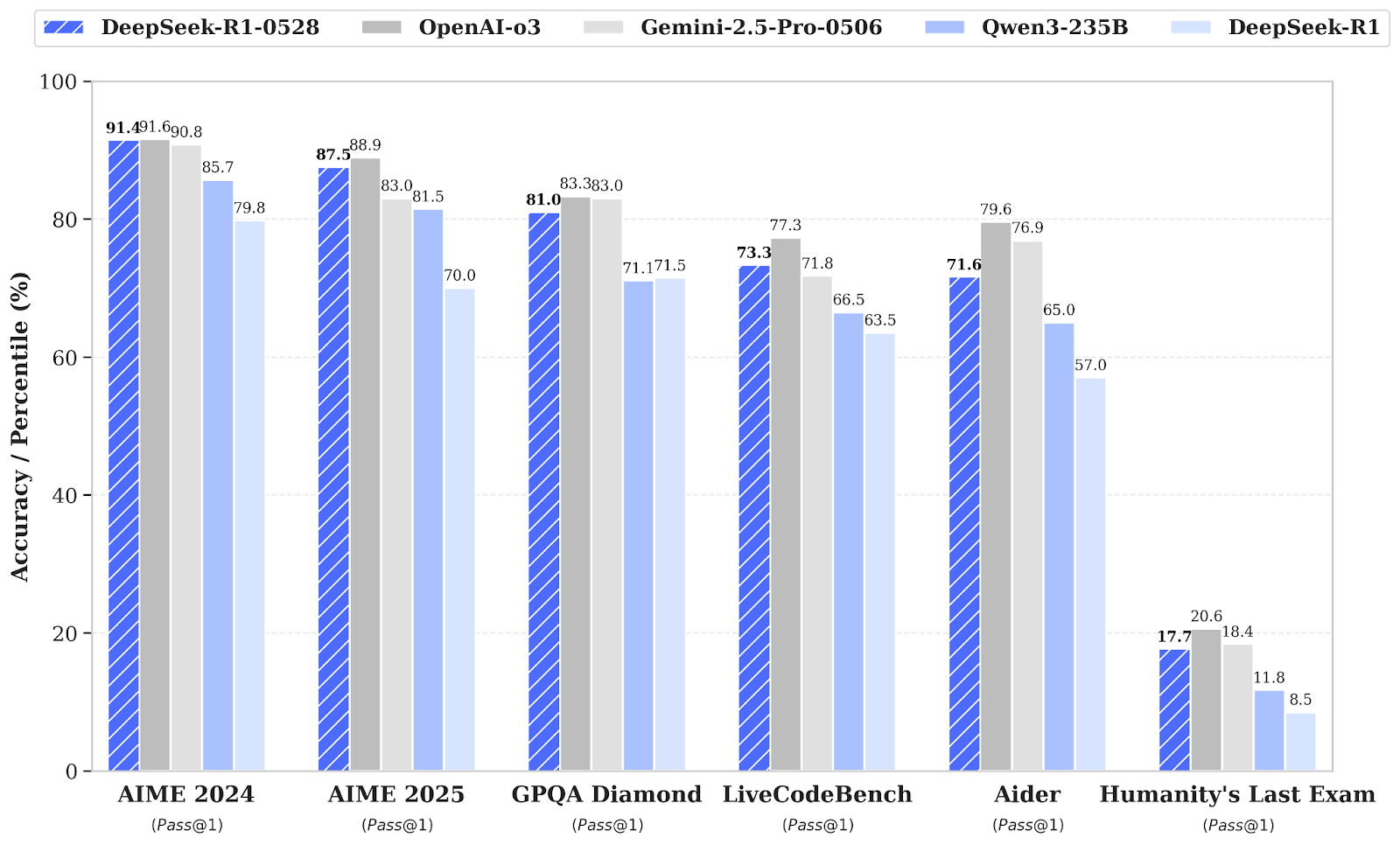

- DeepSeek-R1-0528: upgrade con ragionamento potenziato e grandi progressi in matematica, logica e coding (AIME 2025: 87,5%).

- Apriel-1.5-15B-Thinker: modello di ragionamento multimodale (testo+immagine) di ServiceNow con risultati di frontiera su una singola GPU.

- Kimi-K2-Instruct-0905: MoE da 1T parametri con contesto da 256K; eccelle in workflow agentici e di coding di lungo periodo.

- Llama-3.3-Nemotron-Super-49B-v1.5: modello di ragionamento da 49B ottimizzato da NVIDIA per RAG e chat con strumenti.

- Mistral-Small-3.2-24B-Instruct-2506: modello compatto da 24B con follow-up istruzioni migliorato e meno errori di ripetizione.

Vantaggi dell’uso di LLM open source

Ci sono molteplici vantaggi, a breve e lungo termine, nello scegliere LLM open source invece di LLM proprietari. Qui sotto trovi un elenco dei motivi più convincenti:

Maggiore sicurezza e privacy dei dati

Una delle maggiori preoccupazioni nell’uso di LLM proprietari è il rischio di fughe di dati o di accessi non autorizzati a dati sensibili da parte del fornitore dell’LLM. In effetti, ci sono già state diverse controversie riguardo al presunto uso di dati personali e confidenziali per scopi di training.

Usando LLM open source, le aziende saranno le uniche responsabili della protezione dei dati personali, poiché ne manterranno il pieno controllo.

Riduzione dei costi e minore dipendenza dai fornitori

La maggior parte degli LLM proprietari richiede una licenza per essere utilizzati. Nel lungo periodo, questo può rappresentare una spesa importante che alcune aziende, soprattutto le PMI, potrebbero non potersi permettere. Non è il caso degli LLM open source, che di norma sono gratuiti.

Tuttavia, è importante notare che eseguire LLM richiede risorse considerevoli, anche solo per l’inferenza, il che significa che di solito dovrai pagare per l’uso di servizi cloud o di un’infrastruttura potente.

Trasparenza del codice e personalizzazione del modello linguistico

Le aziende che scelgono LLM open source avranno accesso al funzionamento degli LLM, incluso il codice sorgente, l’architettura, i dati di training e i meccanismi di training e inferenza. Questa trasparenza è il primo passo sia per l’analisi critica sia per la personalizzazione.

Poiché gli LLM open source sono accessibili a tutti, incluso il codice sorgente, le aziende che li usano possono personalizzarli per i propri casi d’uso specifici.

Community attiva e stimolo all’innovazione

Il movimento open source promette di democratizzare l’uso e l’accesso alle tecnologie LLM e di AI generativa. Consentire agli sviluppatori di ispezionare il funzionamento interno degli LLM è fondamentale per il futuro sviluppo di questa tecnologia. Abbassando le barriere d’ingresso per i coder in tutto il mondo, gli LLM open source possono favorire l’innovazione e migliorare i modelli, riducendo i bias e aumentando accuratezza e prestazioni complessive.

Affrontare l’impronta ambientale dell’AI

Con la diffusione degli LLM, ricercatori e osservatori ambientali sollevano preoccupazioni sull’impronta di carbonio e il consumo d’acqua necessari per far funzionare queste tecnologie. Gli LLM proprietari raramente pubblicano informazioni sulle risorse necessarie per addestrare e far funzionare gli LLM, né sull’impronta ambientale associata.

Con gli LLM open source, i ricercatori hanno più possibilità di conoscere queste informazioni, aprendo la strada a nuovi miglioramenti progettati per ridurre l’impronta ambientale dell’AI.

9 migliori Large Language Model open source per il 2026

1. GLM 4.6

GLM-4.6 è un large language model di nuova generazione, successore di GLM-4.5. È progettato per potenziare i workflow agentici, fornire un supporto solido al coding, facilitare il ragionamento avanzato e generare linguaggio naturale di alta qualità. Il modello è pensato sia per ambienti di ricerca sia di produzione, con focus su comprensione di contesti più lunghi, inferenza con strumenti e scrittura più allineata alle preferenze dell’utente.

Fonte:zai-org/GLM-4.6

Rispetto a GLM-4.5, GLM-4.6 introduce diversi miglioramenti chiave: la finestra di contesto è stata ampliata da 128K a 200K token, consentendo compiti agentici più complessi. Anche le prestazioni nel coding sono state migliorate, con punteggi più alti nei benchmark e risultati più solidi nelle applicazioni reali.

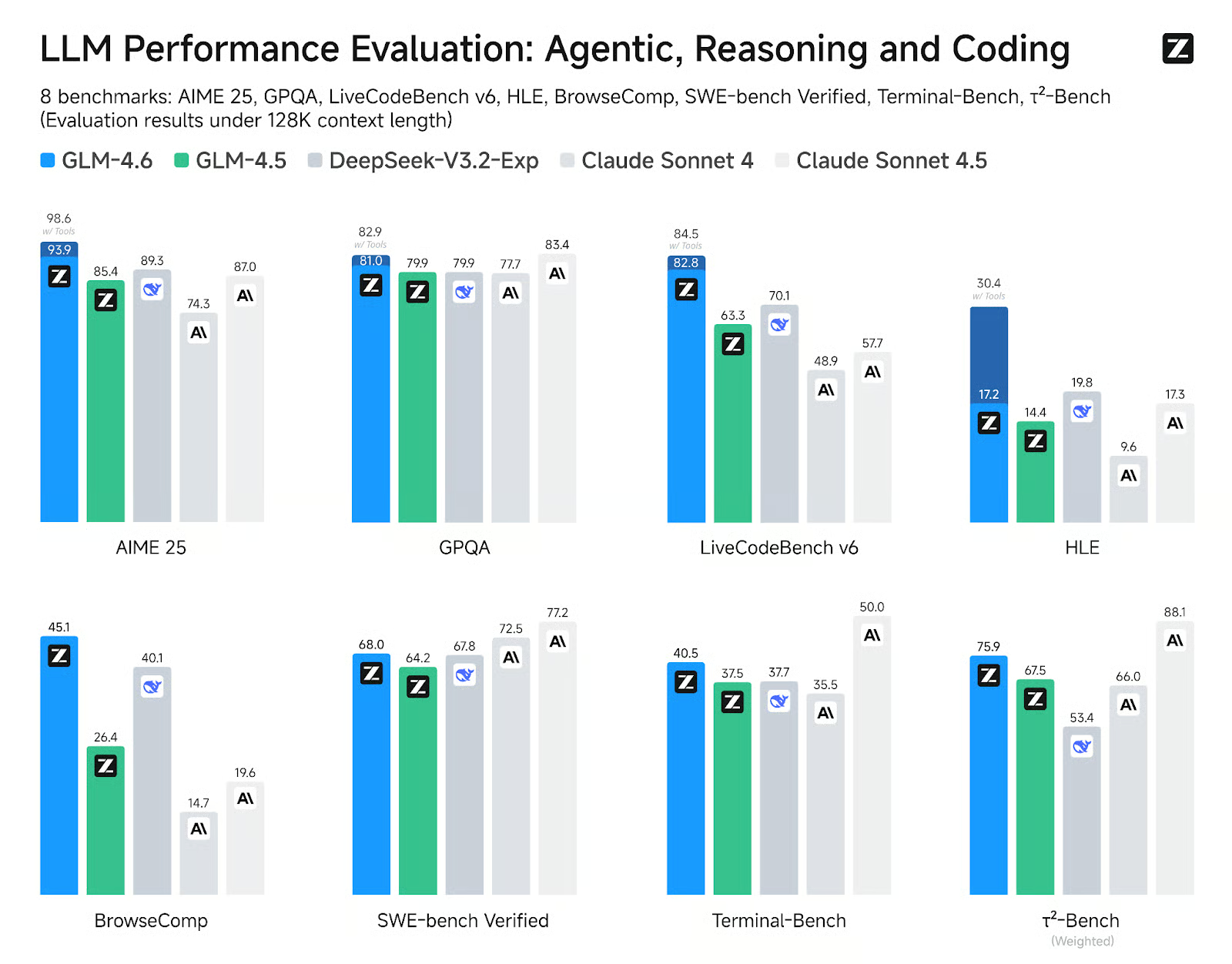

GLM-4.6 mostra progressi netti su otto benchmark pubblici relativi ad agenti, ragionamento e coding, superando GLM-4.5 e dimostrando vantaggi competitivi rispetto a modelli leader come DeepSeek-V3.1-Terminus e Claude Sonnet 4.

2. gpt-oss-120B

gpt-oss-120b è l’apice della serie gpt-oss: i modelli open-weight di OpenAI progettati per ragionamento avanzato, compiti agentici e workflow versatili per sviluppatori. La serie include due versioni: gpt-oss-120b, pensata per casi d’uso generali di livello production che richiedono ragionamento avanzato e possono operare su una singola GPU da 80GB (con 117 miliardi di parametri, di cui 5,1 miliardi attivi); e gpt-oss-20b, ottimizzata per bassa latenza e deployment locali o specializzati (con 21 miliardi di parametri e 3,6 miliardi attivi). Entrambi i modelli sono addestrati con il formato di risposta harmony e dovrebbero essere usati con il framework harmony per funzionare efficacemente.

Fonte: Introducing gpt-oss | OpenAI

gpt-oss-120b offre anche sforzi di ragionamento configurabili: basso, medio o alto, per bilanciare profondità e latenza. Fornisce pieno accesso alla chain-of-thought per il debugging e l’audit. Questi modelli sono finetunabili e includono capacità agentiche integrate, come function calling, web browsing, esecuzione di codice Python e output strutturati.

Grazie alla quantizzazione MXFP4 dei pesi MoE, gpt-oss-120b può girare su una singola GPU da 80GB, mentre gpt-oss-20b può operare in un ambiente da 16GB. Leggi il nostro articolo su 10 modi per accedere a GPT-OSS 120B gratis.

3. Qwen3 235B 2507

Qwen3-235B-A22B-Instruct-2507 è il modello di punta non-thinking della famiglia Qwen3-MoE, progettato per follow-up istruzioni ad alta precisione, rigoroso ragionamento logico, comprensione multilingue del testo, matematica, scienza, coding, uso di strumenti e compiti che richiedono contesti molto lunghi. È un language model causale Mixture of Experts (MoE) con un totale di 235 miliardi di parametri e 22 miliardi di parametri attivi (utilizza 128 esperti con 8 attivi alla volta). Il modello comprende 94 layer, include un meccanismo GQA con 64 query head e 4 key-value head, e ha una finestra di contesto nativa di 262.000 token, estendibile fino a circa 1,01 milioni di token.

L’ultimo aggiornamento Instruct-2507 introduce miglioramenti significativi nelle capacità generali ed espande la copertura delle conoscenze long-tail in più lingue. Offre inoltre un allineamento delle preferenze nettamente migliore per i compiti aperti e migliora la qualità della scrittura, in particolare per comprensioni a lungo contesto oltre i 256.000 token.

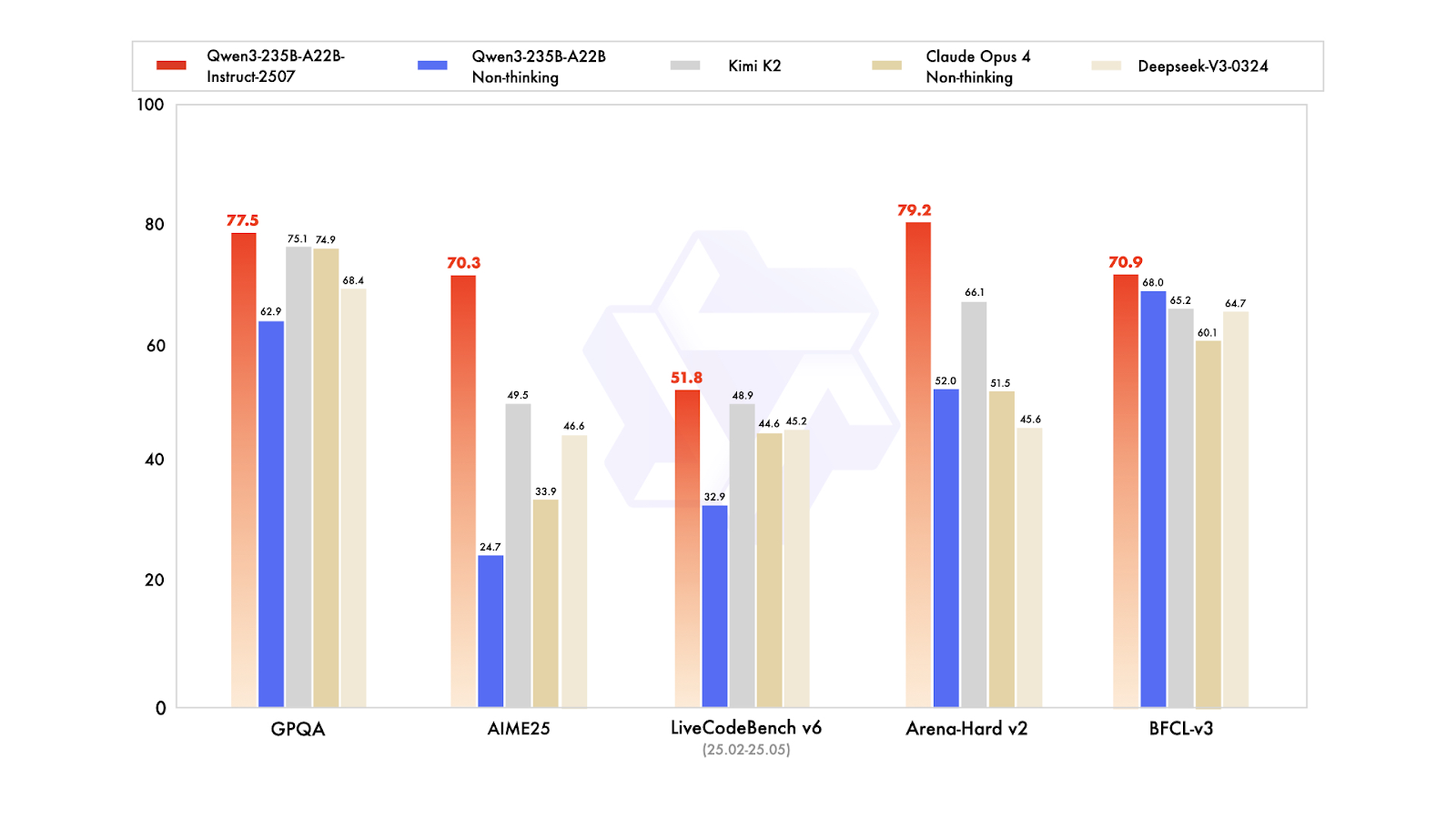

Sui benchmark pubblici, mostra risultati eccezionali. In pratica, questo colloca Instruct-2507 tra i modelli non-thinking di fascia alta, superando sia il precedente Qwen3-235B-A22B non-thinking sia concorrenti di punta come DeepSeek-V3, GPT-4o, Claude Opus 4 (non-thinking) e Kimi K2.

Puoi saperne di più su Qwen3 nel nostro articolo completo.

4. DeepSeek V3.2 Exp

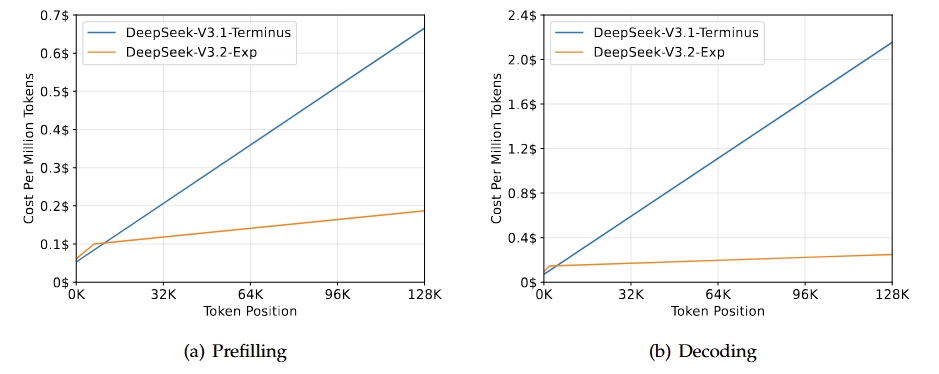

DeepSeek-V3.2-Exp è una versione sperimentale e intermedia che porta alla prossima generazione dell’architettura DeepSeek. Si basa su V3.1-Terminus e introduce la DeepSeek Sparse Attention per migliorare l’efficienza di training e inferenza, in particolare negli scenari a lungo contesto. Questo modello mira a migliorare l’efficienza dei transformer per sequenze estese mantenendo la qualità dell’output attesa dalla linea Terminus.

Fonte: DeepSeek-V3.2-Exp

Il risultato principale di questo rilascio è che eguaglia le capacità complessive di V3.1-Terminus offrendo notevoli miglioramenti di efficienza per compiti a lungo contesto. Valutazioni e analisi di terze parti mostrano che le sue prestazioni sono paragonabili a Terminus, con una riduzione significativa dei costi computazionali. Ciò conferma che l’attenzione sparsa può aumentare l’efficienza senza compromettere la qualità.

Leggi la nostra guida completa a DeepSeek-V3.2-Exp per seguire un progetto demo.

5. DeepSeek R1 0528

DeepSeek-R1 ha ricevuto un aggiornamento di versione minore a DeepSeek-R1-0528, che ne migliora le capacità di ragionamento e inferenza grazie a maggiore potenza computazionale e ottimizzazioni algoritmiche post-training. Il risultato è un miglioramento significativo in varie aree, tra cui matematica, programmazione e logica generale. Le prestazioni complessive sono ora più vicine a sistemi leader come O3 e Gemini 2.5 Pro.

Oltre alle capacità grezze, questo aggiornamento enfatizza l’utilità pratica con un function calling migliore e workflow di coding più efficaci, riflettendo l’attenzione a produrre output più affidabili e orientati alla produttività.

Fonte: deepseek-ai/DeepSeek-R1-0528

Rispetto alla precedente versione DeepSeek R1, il modello aggiornato mostra progressi sostanziali nel ragionamento complesso. Ad esempio, all’esame AIME 2025, l’accuratezza è passata dal 70% all’87,5%, supportata da un pensiero analitico più profondo (con il numero medio di token per domanda aumentato da circa 12.000 a 23.000).

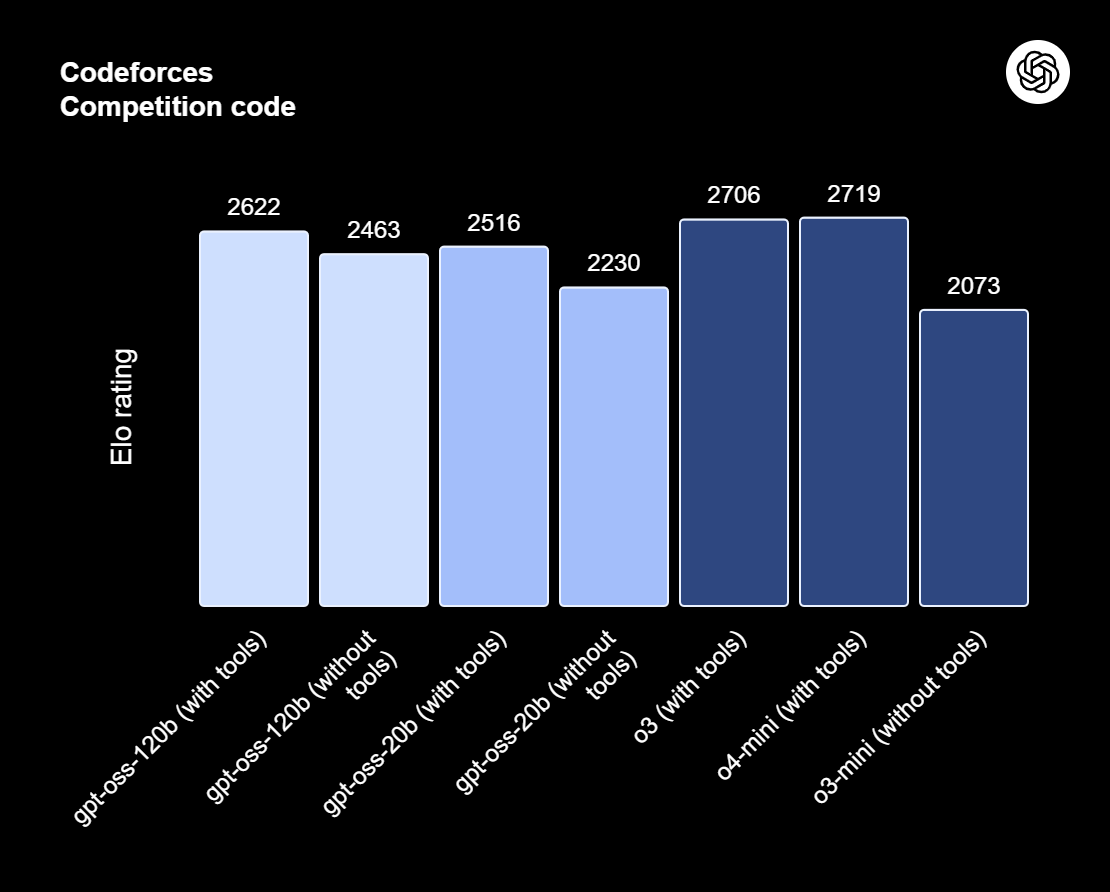

Valutazioni più ampie mostrano tendenze positive anche in aree come conoscenza, ragionamento e prestazioni nel coding. Esempi includono miglioramenti in LiveCodeBench, rating Codeforces, SWE Verified e Aider-Polyglot, a indicare una maggiore profondità nella risoluzione dei problemi e capacità di coding nel mondo reale superiori.

6. Apriel-v1.5-15B-Thinker

Apriel-1.5-15b-Thinker è un modello di ragionamento multimodale della serie Apriel SLM di ServiceNow. Offre prestazioni competitive con soli 15 miliardi di parametri, puntando a risultati di frontiera entro i limiti di un budget a singola GPU. Questo modello non solo aggiunge capacità di ragionamento sulle immagini al precedente modello solo testo, ma approfondisce anche le sue abilità di ragionamento testuale.

Come secondo modello della serie di ragionamento, ha subito un ampio pretraining continuo su domini sia testuali sia visivi. Il post-training prevede un SFT (supervised fine-tuning) solo testo, senza SFT specifico per immagini o reinforcement learning. Nonostante questi limiti, il modello punta a una qualità allo stato dell’arte nel ragionamento su testo e immagini per la sua dimensione.

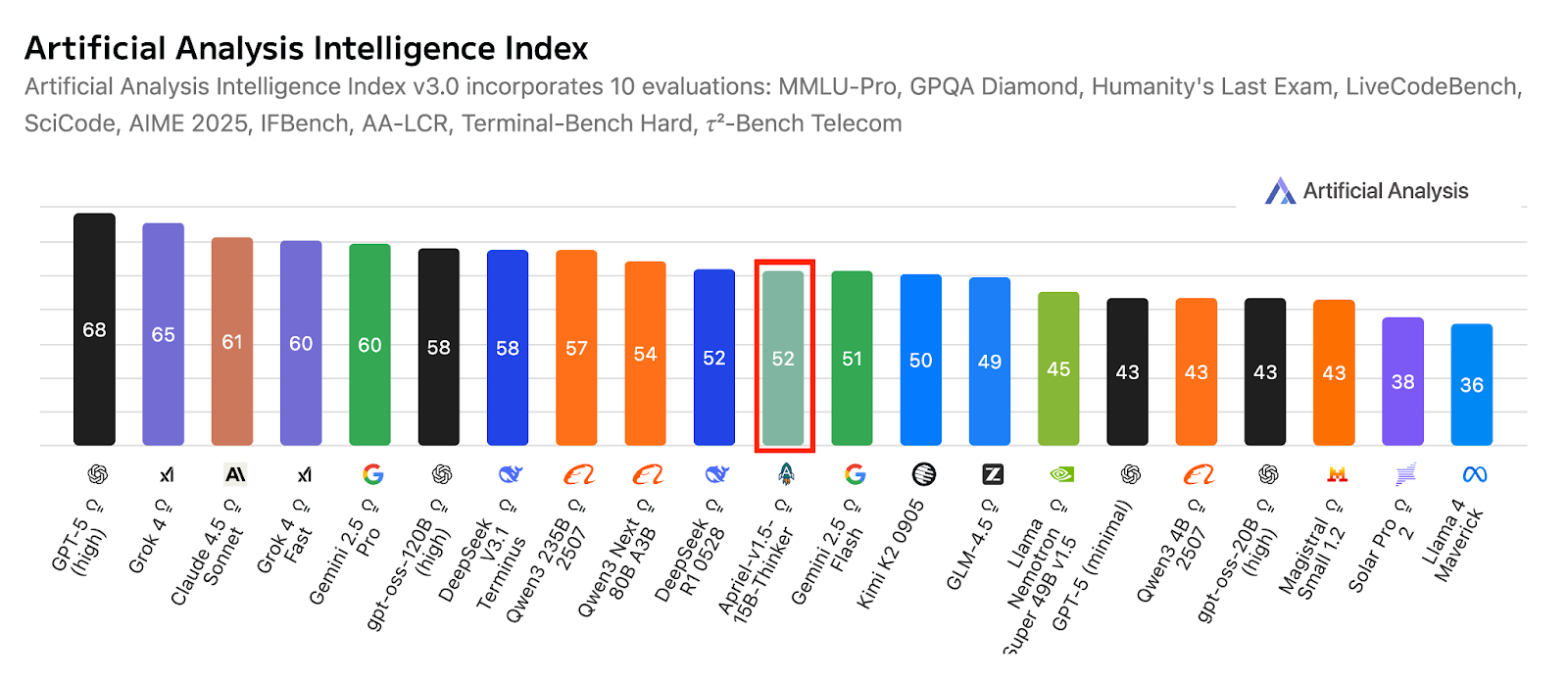

Fonte: ServiceNow-AI/Apriel-1.5-15b-Thinker

Progettato per girare su una singola GPU, privilegia il deployment pratico e l’efficienza. I risultati di valutazione indicano una forte prontezza per applicazioni reali, con un punteggio Artificial Analysis Index di 52, che posiziona il modello in modo competitivo rispetto a sistemi molto più grandi. Questo punteggio riflette anche la sua copertura rispetto a pari compatti e di frontiera, mantenendo al contempo un footprint da modello piccolo adatto all’uso enterprise.

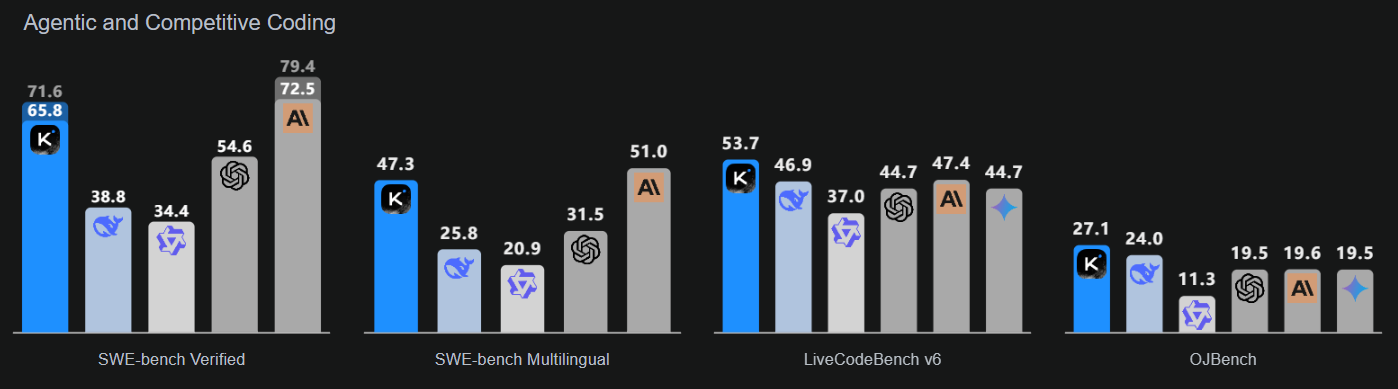

7. Kimi K2 0905

Kimi-K2-Instruct-0905 è il modello più recente e avanzato della linea Kimi K2. È un language model Mixture-of-Experts all’avanguardia, con un totale di 1 trilione di parametri e 32 miliardi di parametri attivati. È progettato specificamente per workflow di ragionamento di alto livello e coding.

K2-Instruct-0905 migliora significativamente la capacità di K2 di gestire compiti di lungo periodo con una finestra di contesto da 256.000 token, rispetto ai precedenti 128.000. Mira a supportare casi d’uso agentici robusti, tra cui chat con strumenti e assistenza al codice. Come rilascio di punta della serie K2 Instruct, si concentra su un’ergonomia per sviluppatori solida e affidabilità per applicazioni di qualità production.

Fonte: Kimi K2: Open Agentic Intelligence

Questo modello enfatizza tre aree chiave: intelligenza di coding potenziata per compiti agentici, con chiari miglioramenti nei benchmark pubblici e nelle applicazioni reali; un’interfaccia utente migliorata che esalta estetica e funzionalità; e un contesto esteso a 256.000 token che consente cicli di pianificazione e modifica più ampi.

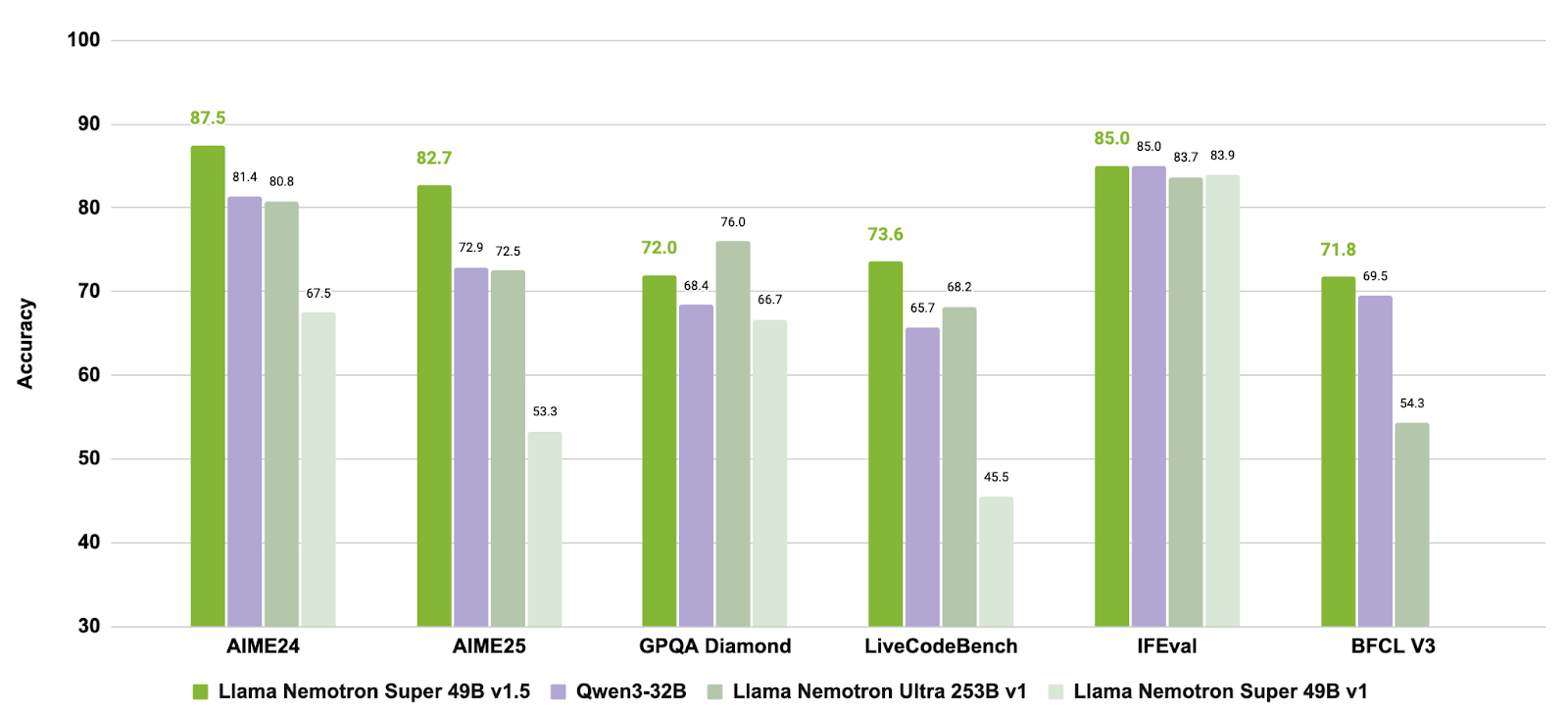

8. Llama Nemotron Super 49B v1.5

Llama-3_3-Nemotron-Super-49B-v1_5 è un modello aggiornato da 49 miliardi di parametri della linea Nemotron di NVIDIA, derivato da Llama-3.3-70B-Instruct di Meta. È specificamente progettato come modello di ragionamento per chat allineate all’umano e compiti agentici, come retrieval-augmented generation (RAG) e tool calling.

Questo modello ha subito un post-training per potenziare le capacità di ragionamento, l’allineamento alle preferenze e l’uso degli strumenti. Supporta anche workflow a lungo contesto fino a 128.000 token, rendendolo adatto ad applicazioni complesse e multi-step.

Fonte: nvidia/Llama-3_3-Nemotron-Super-49B-v1_5

Combinando un post-training mirato per ragionamento e comportamenti agentici con il supporto per compiti a lungo contesto, Llama-3.3-Nemotron-Super-49B-v1.5 offre una soluzione equilibrata per gli sviluppatori che necessitano di capacità di ragionamento avanzate e uso robusto di strumenti senza sacrificare l’efficienza in runtime.

9. Mistral-small-2506

Mistral-Small-3.2-24B-Instruct-2506 è un aggiornamento significativo rispetto a Mistral-Small-3.1-24B-Instruct-2503: migliora il follow-up delle istruzioni, riduce gli errori di ripetizione e offre un template di function calling più robusto, mantenendo o leggermente migliorando le capacità complessive. Come modello instruct da 24B parametri, è ampiamente accessibile su varie piattaforme, inclusi i marketplace AWS, dove si distingue per una migliore aderenza alle istruzioni.

Fonte: mistralai/Mistral-Small-3.2-24B-Instruct-2506

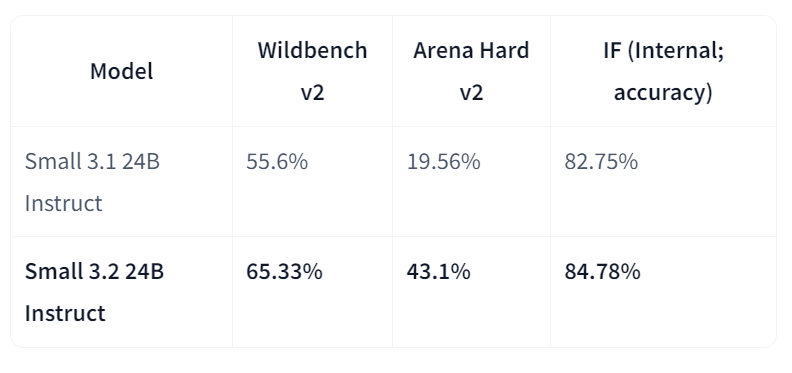

Nel confronto diretto con la versione 3.1, Small-3.2 mostra progressi evidenti nella qualità e affidabilità dell’assistant. Aumenta le prestazioni nel follow-up istruzioni su Wildbench v2 (dal 55,6% al 65,33%) e Arena Hard v2 (dal 19,56% al 43,1%), mentre l’accuratezza interna nel follow-up passa dall’82,75% all’84,78%. I fallimenti di ripetizione su prompt impegnativi si dimezzano (dal 2,11% all’1,29%). Nel frattempo, le prestazioni STEM restano comparabili, con MATH al 69,42% e HumanEval+ Pass@5 al 92,90%.

Confronto tra i migliori LLM open source nel 2026

Nella tabella seguente trovi un confronto tra i modelli principali:

| Modello | Punti di forza | Upgrade / caratteristiche notevoli |

|---|---|---|

| GLM 4.6 | Ragionamento solido, workflow agentici e capacità di coding | Finestra di contesto ampliata da 128K → 200K; performance benchmark migliorate vs. GLM-4.5 e DeepSeek-V3.1 |

| gpt-oss-120B | Modello GPT open-weight per ragionamento avanzato e compiti agentici | Profondità di ragionamento configurabile, accesso alla chain-of-thought, function calling e formato di risposta harmony |

| Qwen3-235B-Instruct-2507 | Multilingue, ragionamento ad alta precisione e follow-up istruzioni | Contesto oltre 1M di token, scrittura allineata alle preferenze, supera GPT-4o e Claude Opus 4 (non-thinking) |

| DeepSeek-V3.2-Exp | Elaborazione efficiente di lunghi contesti tramite attenzione sparsa | Eguaglia le prestazioni di V3.1 con minore compute; efficienza del transformer ottimizzata |

| DeepSeek-R1-0528 | Ragionamento avanzato, matematica e programmazione | Miglioramento AIME 2025 del 17,5%; maggiore profondità analitica e affidabilità nel coding |

| Apriel-1.5-15B-Thinker | Ragionamento multimodale (testo + immagine) su una singola GPU | Pretraining continuo su testo e immagine; ragionamento di frontiera per dimensioni compatte |

| Kimi-K2-Instruct-0905 | Ragionamento di fascia alta e workflow di coding agentici | Contesto da 256K token, migliore ergonomia per sviluppatori e supporto a compiti con strumenti |

| Llama-3.3-Nemotron-Super-49B-v1.5 | Modello bilanciato per ragionamento e uso di strumenti | Ottimizzato da NVIDIA per RAG e applicazioni agentiche; supporto a lunghi contesti fino a 128K token |

| Mistral-Small-3.2-24B-Instruct-2506 | Follow-up istruzioni compatto e affidabile | Errori di ripetizione ridotti (−50%) e grandi progressi su WildBench v2 e Arena Hard v2 |

Scegliere l’LLM open source giusto per le tue esigenze

Lo spazio degli LLM open source si sta espandendo rapidamente. Oggi ci sono molti più LLM open source che proprietari e il divario di prestazioni potrebbe colmarsi presto, man mano che gli sviluppatori di tutto il mondo collaborano per aggiornare gli LLM attuali e progettarne di più ottimizzati.

In questo contesto vivace ed entusiasmante, può essere difficile scegliere l’LLM open source giusto per i tuoi scopi. Ecco alcuni fattori da considerare prima di optare per un LLM open source specifico:

- Cosa vuoi fare? È la prima domanda da porti. Gli LLM open source sono sempre aperti, ma alcuni sono rilasciati solo per scopi di ricerca. Quindi, se stai pianificando di avviare un’azienda, fai attenzione alle possibili limitazioni di licenza.

- Perché ti serve un LLM? Anche questo è fondamentale. Gli LLM sono di gran moda in questo momento. Tutti ne parlano e delle loro infinite opportunità. Ma se puoi realizzare la tua idea senza LLM, allora non usarli. Non è obbligatorio (e probabilmente risparmierai un sacco di soldi e ulteriori risorse).

- Di quanta accuratezza hai bisogno? È un aspetto importante. C’è una relazione diretta tra dimensione e accuratezza degli LLM allo stato dell’arte. In generale, più grande è l’LLM in termini di parametri e dati di training, più accurato sarà il modello. Quindi, se ti serve alta accuratezza, dovresti optare per LLM più grandi, come LLaMA o Falcon.

- Quanto denaro vuoi investire? È strettamente collegato alla domanda precedente. Più grande è il modello, maggiori saranno le risorse necessarie per addestrarlo e farlo funzionare. Questo si traduce in infrastrutture aggiuntive da utilizzare o in una fattura più alta dai provider cloud se vuoi operare il tuo LLM nel cloud. Gli LLM sono strumenti potenti, ma richiedono risorse considerevoli per essere usati, anche quelli open source.

- Puoi raggiungere i tuoi obiettivi con un modello pre-addestrato? Perché investire denaro ed energia per addestrare un LLM da zero se puoi semplicemente usare un modello pre-addestrato? Là fuori ci sono molte versioni di LLM open source addestrati per casi d’uso specifici. Se la tua idea rientra in uno di questi casi, sfruttala.

Potenziare il tuo team con AI e LLM

Gli LLM open source non sono solo per progetti o interessi individuali. Con l’accelerazione della rivoluzione dell’AI generativa, le aziende stanno riconoscendo l’importanza cruciale di comprendere e implementare questi strumenti. Gli LLM sono già diventati fondamentali per alimentare applicazioni di AI avanzate, dai chatbot all’elaborazione complessa dei dati. Assicurarti che il tuo team sia competente nelle tecnologie di AI e LLM non è più solo un vantaggio competitivo: è una necessità per mettere al riparo il tuo business in futuro.

Se sei un team leader o un imprenditore e vuoi dare al tuo team competenze in AI e LLM, DataCamp for Business offre programmi di formazione completi che possono aiutare i tuoi dipendenti ad acquisire le skill necessarie per sfruttare questi potenti strumenti. Offriamo:

- Percorsi di apprendimento mirati su AI e LLM: personalizzabili in base alle conoscenze attuali del tuo team e alle esigenze specifiche del business, coprendo tutto, dai concetti base di AI allo sviluppo avanzato di LLM.

- Pratica hands-on con l’AI: progetti reali incentrati sulla costruzione e il deployment di modelli di AI, incluso il lavoro con LLM popolari come GPT-4 e alternative open source.

- Monitoraggio dei progressi nelle skill di AI: strumenti per monitorare e valutare i progressi del tuo team, assicurando che acquisiscano le competenze necessarie per sviluppare e implementare soluzioni di AI in modo efficace.

Investire nell’upskilling in AI e LLM non solo migliora le capacità del tuo team, ma posiziona anche la tua azienda all’avanguardia dell’innovazione, permettendoti di sfruttare appieno il potenziale di queste tecnologie trasformative. Mettiti in contatto con il nostro team per richiedere una demo e iniziare a costruire oggi la tua forza lavoro pronta per l’AI.

Conclusione

Gli LLM open source stanno vivendo un momento entusiasmante. Con la loro rapida evoluzione, sembra che lo spazio dell’AI generativa non sarà necessariamente monopolizzato dai grandi player che possono permettersi di costruire e usare questi potenti strumenti.

Abbiamo visto solo otto LLM open source, ma il numero è molto più alto e in rapida crescita. Noi di DataCamp continueremo a fornire informazioni sulle ultime novità nel mondo degli LLM, offrendo corsi, articoli e tutorial dedicati. Per ora, dai un’occhiata alla nostra lista di materiali selezionati:

- Corso sui concetti dei Large Language Models (LLM)

- Skill track Developing Large Language Models

- Come creare applicazioni LLM con LangChain

- Come addestrare un LLM con PyTorch

- LlamaIndex: aggiungere dati personali agli LLM

- Pro e contro dell’uso di LLM nel cloud rispetto all’esecuzione locale

- LLM vs SLM

FAQ

Cosa sono gli LLM open source?

Gli open-source large language model (LLM) sono modelli il cui codice sorgente e la cui architettura sono pubblicamente disponibili per l’uso, la modifica e la distribuzione. Sono costruiti con algoritmi di machine learning che elaborano e generano testo simile a quello umano e, in quanto open source, promuovono trasparenza, innovazione e collaborazione della community nel loro sviluppo e nella loro applicazione.

Perché gli LLM open source sono importanti?

Gli LLM open source democratizzano l’accesso all’AI all’avanguardia, consentendo agli sviluppatori di tutto il mondo di contribuire ai progressi dell’AI e di beneficiarne senza i costi elevati dei modelli proprietari. Aumentano la trasparenza, favorendo la fiducia e consentendo la personalizzazione per esigenze specifiche.

Quali sono le sfide comuni con gli LLM open source?

Le sfide includono elevati requisiti computazionali per l’esecuzione e l’addestramento, che possono essere una barriera per individui o piccole organizzazioni. Anche mantenere e aggiornare i modelli per restare al passo con le ultime ricerche e gli standard di sicurezza può essere impegnativo senza un supporto strutturato.

Esistono risorse GRATUITE per imparare gli LLM open source?

Sì! Se sei un docente universitario o uno studente, puoi usare DataCamp Classrooms per ottenere GRATIS l’intero catalogo dei nostri corsi, che include corsi sugli LLM open source.

In quanto data scientist certificato, sono appassionato di sfruttare tecnologie all’avanguardia per creare applicazioni di machine learning innovative. Con una solida esperienza in riconoscimento vocale, analisi e reportistica dei dati, MLOps, AI conversazionale e NLP, ho affinato le mie competenze nello sviluppo di sistemi intelligenti in grado di avere un impatto concreto. Oltre alla mia expertise tecnica, sono anche un comunicatore efficace, con il talento di rendere chiari e sintetici concetti complessi. Di conseguenza, sono diventato un blogger molto seguito in ambito data science, condividendo idee ed esperienze con una community in crescita di professionisti dei dati. Attualmente mi concentro sulla creazione e sull’editing di contenuti, lavorando con large language model per sviluppare contenuti potenti e coinvolgenti che possano aiutare aziende e singoli a valorizzare al meglio i propri dati.