Cursus

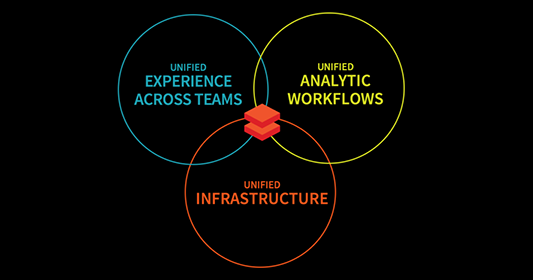

Databricks is een open analyticsplatform voor het bouwen, uitrollen en beheren van data-, analytics- en AI-oplossingen op schaal. Het is gebouwd op Apache Spark en integreert met elk van de drie grote cloudproviders (AWS, Azure of GCP), waardoor we cloudinfrastructuur kunnen beheren en uitrollen namens ons, terwijl het ondersteuning biedt voor elke data science-toepassing die je je kunt voorstellen.

Vandaag neem ik je mee in een uitgebreide introductie tot Databricks, met de kernfuncties, praktische toepassingen en gestructureerde leerroutes om te beginnen. Van het opzetten van je omgeving tot het beheersen van datapreparatie, orkestratie en visualisatie: je vindt hier alles wat je nodig hebt om met Databricks te starten.

Waarom Databricks leren?

Databricks leren en een stevige basis opbouwen kan je verschillende belangrijke voordelen opleveren:

Databricks heeft veel toepassingen

Databricks kent brede toepassingen waarmee bedrijven data kunnen transformeren, opschonen, verwerken en optimaliseren om inzichten te verkrijgen. Het maakt geavanceerde analytics mogelijk voor betere besluitvorming via data-exploratie en visualisatie; het ondersteunt de ontwikkeling en uitrol van voorspellende modellen en AI-oplossingen.

Databricks geeft je een voorsprong

Databricks biedt een concurrentievoordeel dankzij de cloudcompatibiliteit. Het is gebouwd op Apache Spark en integreert met toonaangevende datatools zoals AWS, Azure en Google Cloud. Meesterschap in Databricks positioneert je als koploper in elke data-gedreven sector.

Belangrijkste functies van Databricks

Databricks is een compleet platform voor data engineering, analytics en machine learning, met vijf hoofdkenmerken die schaalbaarheid, samenwerking en workflow-efficiëntie versterken.

Belangrijkste functies van Databricks. Afbeelding door de auteur.

Geünificeerd dataplatform

Databricks verenigt de drie workflows voor data engineering, data science en machine learning in één platform. Dit vereenvoudigt datapreparatie, modeltraining en uitrol. Door deze domeinen te bundelen, versnelt Databricks AI-initiatieven en helpt het bedrijven om gesiloëde data om te zetten in bruikbare inzichten en samenwerking te bevorderen.

Apache Spark-integratie

Apache Spark, het toonaangevende framework voor gedistribueerd rekenen, is diep geïntegreerd in Databricks. Hierdoor kan Databricks de Spark-configuratie automatisch afhandelen. Gebruikers kunnen zich dus richten op het bouwen van datasolutions zonder zich zorgen te maken over de setup.

Bovendien is de gedistribueerde verwerkingskracht van Spark ideaal voor big data-taken, en Databricks breidt dit uit met beveiliging op ondernemingsniveau, schaalbaarheid en optimalisatie.

Delta Lake

Delta Lake is de ruggengraat van de Lakehouse-architectuur van Databricks en voegt functies toe zoals ACID-transacties, schemahandhaving en real-time dataconsistentie. Dit waarborgt betrouwbaarheid en nauwkeurigheid van data en maakt Delta Lake cruciaal voor het beheren van zowel batch- als streamingdata.

MLflow

MLflow is een open-source platform voor het beheren van de volledige machinelearning-levenscyclus. Van het tracken van experimenten tot het beheren van modeluitrol: MLflow vereenvoudigt het bouwen en operationaliseren van ML-modellen.

Daarnaast breidt MLflow met de nieuwste integraties voor generatieve AI-tools zoals OpenAI en Hugging Face zijn mogelijkheden uit met toepassingen als chatbots, samenvattingen van documenten en sentimentanalyse.

Samenwerkingstools

Databricks stimuleert samenwerking via:

- Interactieve notebooks: Combineer code, markdown en visualisaties om workflows te documenteren en inzichten naadloos te delen.

- Delen in realtime: Werk live samen aan notebooks voor directe feedback en soepel teamwork.

- Versiebeheerfuncties: Volg wijzigingen en integreer met Git voor veilige en efficiënte projectvoering.

Hoe begin je met Databricks?

Starten met Databricks kan zowel spannend als overweldigend zijn. Daarom is de eerste stap bij het leren van elke nieuwe technologie een helder beeld te hebben van je doelen—waarom je het wilt leren en hoe je het wilt gebruiken.

Stel duidelijke doelen

Bepaal voordat je begint wat je met Databricks wilt bereiken.

Wil je als data engineer big data-processing stroomlijnen? Of wil je vooral de ML-mogelijkheden benutten om voorspellende modellen te bouwen en uit te rollen?

Door je hoofddoelen te definiëren, kun je een gerichte leerroute maken. Enkele tips per ambitie:

- Als je focus data engineering is, geef dan prioriteit aan het leren over tools van Databricks voor data-inname, transformatie en beheer, evenals de naadloze integratie met Apache Spark en Delta Lake.

- Als je focus machine learning is, richt je dan op MLflow voor experimenttracking, modelbeheer en -uitrol, en maak gebruik van de ingebouwde ondersteuning voor libraries zoals TensorFlow en PyTorch.

Begin met de basis:

Aan de slag gaan met Databricks is makkelijker dan je denkt. Ik leid je door een stapsgewijze aanpak, zodat je snel vertrouwd raakt met de essentie van het platform.

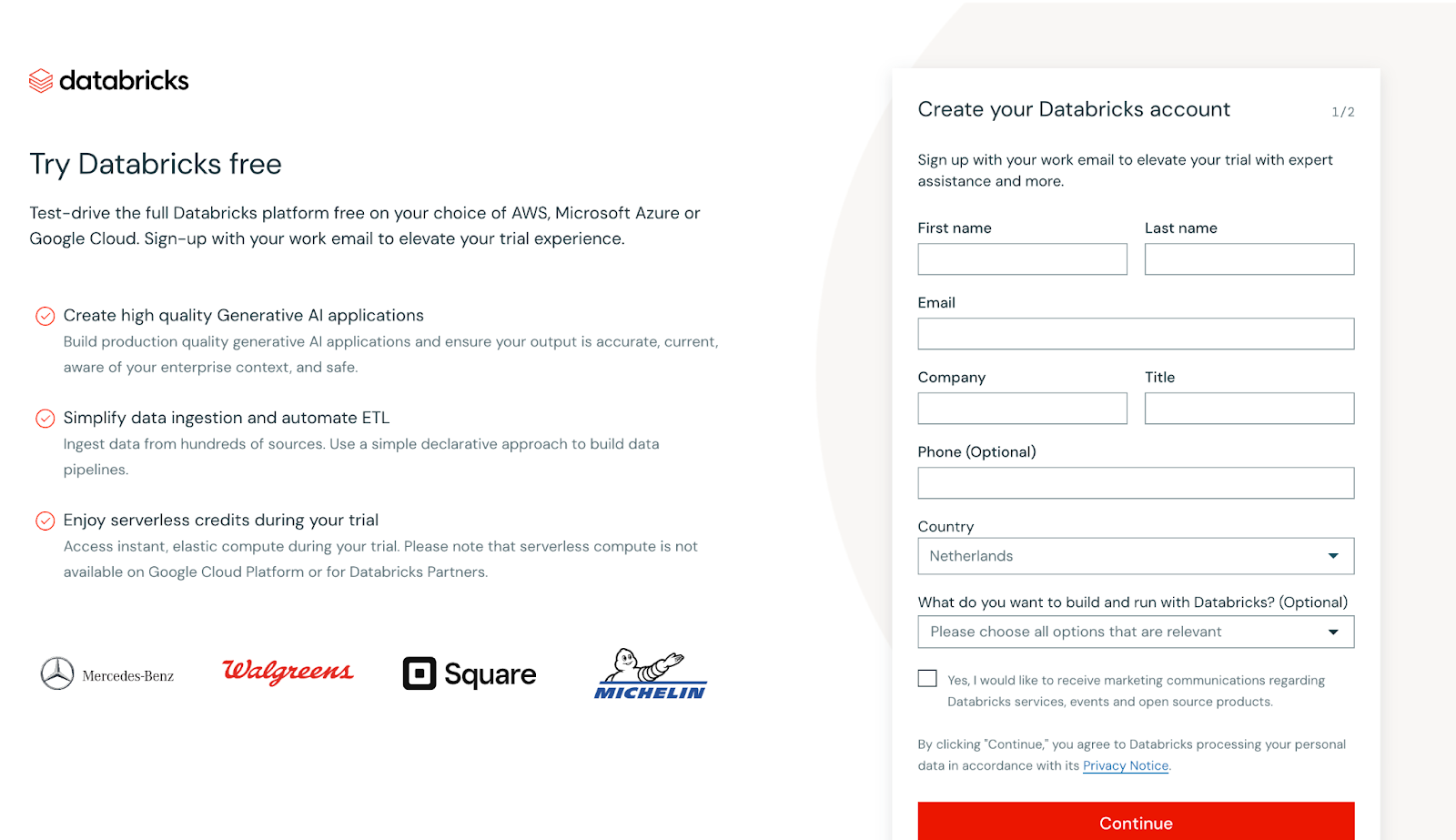

Meld je gratis aan

Maak een gratis account aan op de Databricks Community Edition, die gratis toegang biedt tot de kernfuncties van het platform. Deze editie is ideaal om praktisch te verkennen, zodat je kunt experimenteren met Workspaces, Clusters en Notebooks zonder betaald abonnement.

Screenshot van het Databricks-aanmeldscherm. Afbeelding door de auteur

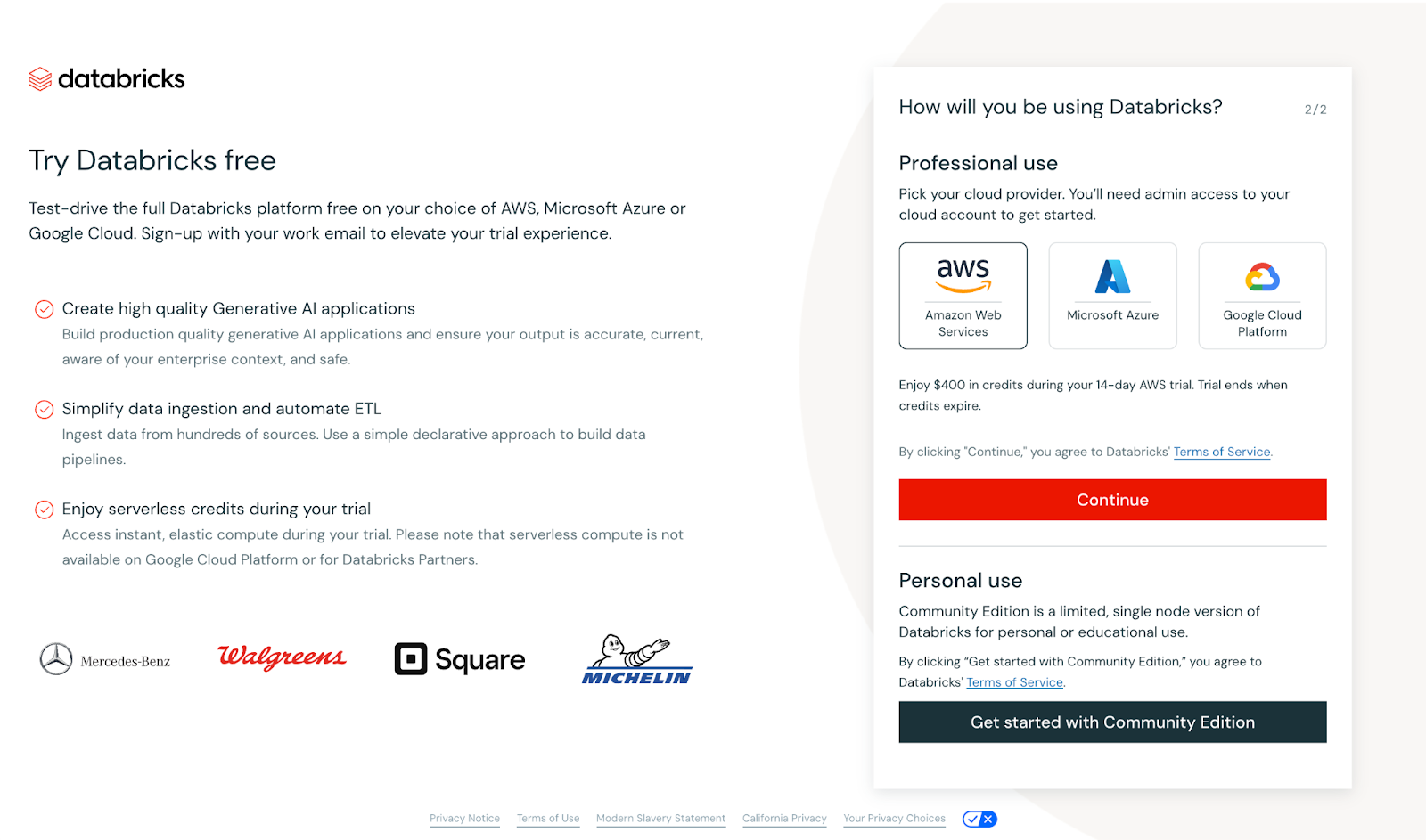

Zodra je je gegevens hebt ingevoerd, verschijnt het volgende scherm.

Screenshot van het Databricks-aanmeldscherm. Afbeelding door de auteur

Je krijgt vervolgens de keuze om een cloudprovider in te stellen of door te gaan met de Community Edition. Om het laagdrempelig te houden, gebruiken we de Community Edition. Die biedt minder functies dan de Enterprise-versie, maar is ideaal voor kleinere use-cases zoals tutorials en vereist geen cloudprovider-setup.

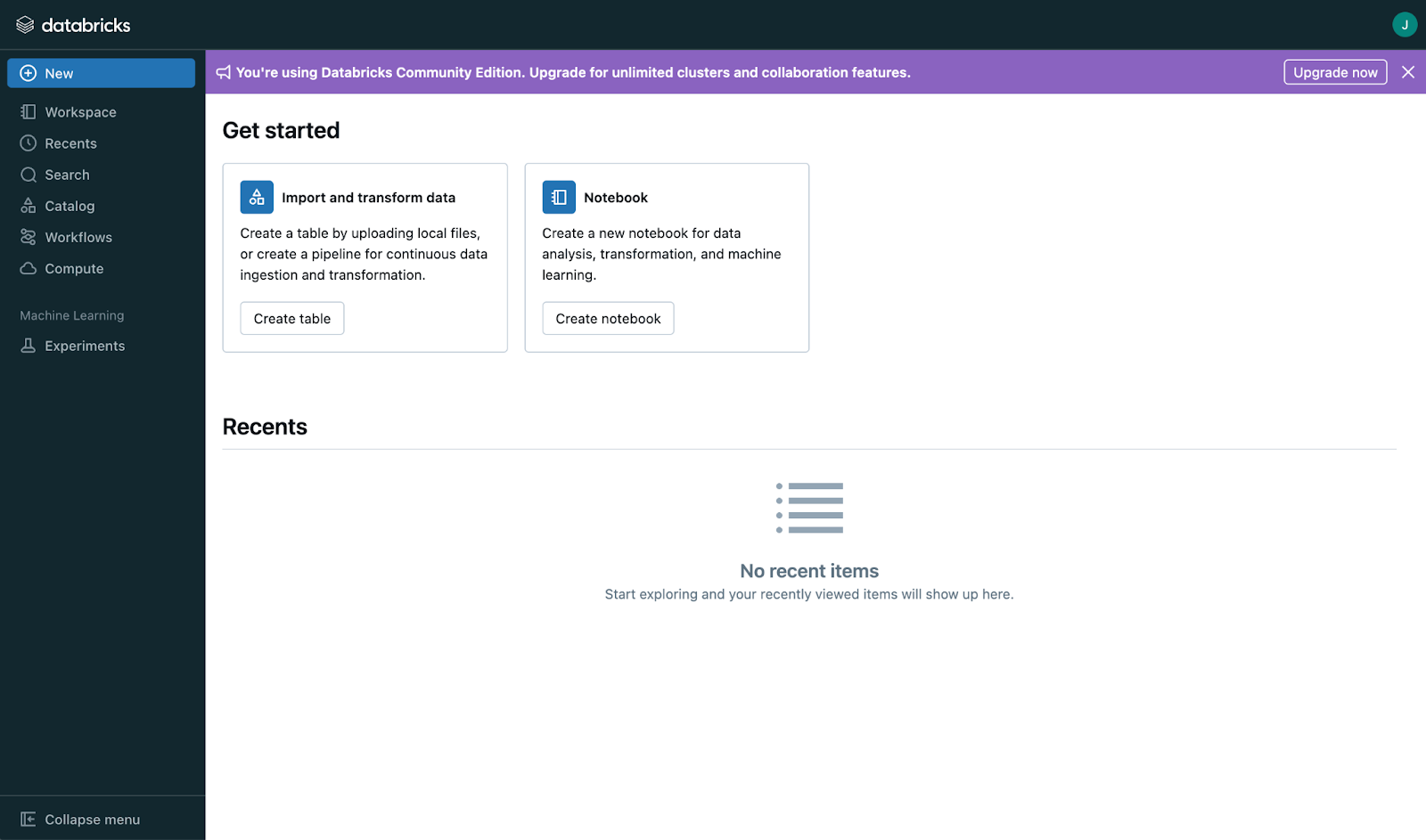

Na selectie van de Community Edition verifieer je je e-mailadres. Na verificatie kom je op een hoofddashboard dat er zo uitziet:

Screenshot van de Databricks-startpagina. Afbeelding door de auteur

Begin met de interface

Neem, zodra je bent ingelogd, de tijd om de indeling te begrijpen. Op het eerste gezicht lijkt de interface misschien basic, maar als je verder verkent of je account upgradet, ontdek je tal van sterke functies:

- Workspaces: Hier organiseer je projecten, notebooks en bestanden. Zie het als de hub voor al je werk.

- Notebooks: Schrijf en voer code uit in meerdere programmeertalen binnen hetzelfde notebook.

- Clustermanagement: Dit zijn groepen virtuele machines die datapreparatie afhandelen. Ze leveren de rekenkracht voor taken zoals datatransformaties en machine learning.

- Tabelbeheer: Organiseer en analyseer gestructureerde data efficiënt.

- Dashboards maken: Bouw interactieve dashboards direct in de workspace om inzichten te visualiseren.

- Samen bewerken: Werk in realtime samen aan notebooks voor naadloze samenwerking.

- Versiebeheer: Volg wijzigingen in notebooks en beheer eenvoudig versies.

- Jobplanning: Automatiseer het uitvoeren van notebooks en scripts op vaste intervallen voor gestroomlijnde workflows.

Leer kernconcepten

Databricks heeft drie kernconcepten die onmisbaar zijn voor elke professional die het onder de knie wil krijgen:

- Clusters: De ruggengraat van Databricks; clusters zijn rekenomgevingen die je code uitvoeren. Leer hoe je ze maakt, configureert en beheert voor jouw workload.

- Jobs: Automatiseer repeterende taken door jobs te maken die je notebooks of scripts volgens schema draaien en zo je workflows stroomlijnen.

- Notebooks: Interactieve documenten waarin je code schrijft en uitvoert, resultaten visualiseert en bevindingen documenteert. Notebooks ondersteunen meerdere talen zoals Python, SQL en Scala en zijn daardoor veelzijdig inzetbaar.

Databricks-leerplan

Hier is mijn idee voor een leerplan in drie stappen.

Stap 1: Beheers de basis van Databricks

Begin je traject met een sterke fundering in Databricks Essentials.

Databeheer

Effectief databeheer staat centraal in elk dataplatform, en Databricks vereenvoudigt dit met robuuste tools voor het laden, transformeren en organiseren van data op schaal. Hier volgt een overzicht van de belangrijkste aspecten van databeheer in Databricks:

Data laden

Databricks ondersteunt diverse databronnen, waardoor het eenvoudig is om data in te lezen uit gestructureerde, semi-gestructureerde en ongestructureerde formaten.

- Ondersteunde dataformaten: CSV, JSON, Parquet, ORC, Avro en meer.

- Databronnen: Cloudopslag zoals AWS S3, Azure Data Lake en Google Cloud Storage, evenals relationele databases en API’s.

- Auto Loader: Een Databricks-functie die het laden van data uit cloudopslag vereenvoudigt op een schaalbare, incrementele manier—perfect voor continu groeiende datasets.

Data transformeren

Zodra je data is ingelezen, biedt Databricks krachtige tools om deze op te schonen en te transformeren ter voorbereiding op analyse of ML-workflows.

- DataFrames: Een intuïtieve manier om transformaties uit te voeren, vergelijkbaar met SQL of pandas in Python. Je kunt datasets eenvoudig filteren, aggregeren en joinen.

- SparkSQL: Voor wie bekend is met SQL: in Databricks kun je je data direct met SQL-commando’s bevragen en bewerken.

- Delta Lake: Versterk datatransformaties met Delta Lake dankzij schemahandhaving, versies en real-time consistentie.

Data beheren

Databricks maakt naadloos beheer van je data mogelijk in alle fasen van de workflow.

- Data Lakehouse: Databricks combineert het beste van data lakes en datawarehouses tot één platform voor alle databehoeften.

- Partitionering: Optimaliseer prestaties en opslag door datasets te partitioneren voor snellere queries en verwerking.

- Metadata-afhandeling: Databricks volgt en werkt metadata voor je datasets automatisch bij, wat datagovernance en queryoptimalisatie vereenvoudigt.

Basis van Apache Spark

Maak je vertrouwd met de kernconcepten van Spark, waaronder:

- RDD’s (Resilient Distributed Datasets): De fundamentele datastructuur voor gedistribueerde verwerking.

- DataFrames: Hoog-niveau abstracties voor gestructureerde data, voor efficiënte verwerking en analyse.

- SparkSQL: Een SQL-interface voor het bevragen en bewerken van data in Spark.

Aanbevolen bronnen

- Databricks Academy: begin met hun Fundamentals-leerpad voor begeleide lessen.

- Volg de DataCamp-cursus Introduction to Databricks om te starten en de basis van dit platform te begrijpen.

- Je kunt ook de documentatie van je gebruikelijke cloudprovider gebruiken om met Databricks te beginnen. Zo heeft Azure goed introductiemateriaal over Databricks.

Stap 2: Ga hands-on met Databricks

De beste manier om een nieuwe tool te leren, ook Databricks, is door te oefenen. Door de concepten toe te passen op realistische scenario’s bouw je niet alleen zelfvertrouwen op, maar verdiep je ook je begrip van de krachtige mogelijkheden van het platform.

Doe mini-projecten

Praktische projecten zijn een uitstekende manier om de functies van Databricks te verkennen en tegelijk belangrijke skills te ontwikkelen. Enkele startersprojecten:

- Bouw een end-to-end data-engineeringproject

- Volg een complete data-engineeringworkflow door een ETL-proces op Databricks te implementeren.

- Extraheer data uit een cloudopslagdienst zoals AWS S3 of Azure Blob Storage.

- Transformeer de data met Spark voor taken als opschoning, deduplicatie en aggregaties.

- Laad de verwerkte data in een Delta-tabel voor efficiënte opslag en query’s.

- Voeg waarde toe met een dashboard of rapport dat inzichten uit de verwerkte data visualiseert.

- Referentie: Volg dit project hier.

Je vindt veel andere projecten (van gemiddeld tot gevorderd) op deze website over projectgebaseerd leren. Deze projecten helpen niet alleen om kernconcepten te versterken, maar bereiden je ook voor op complexere workflows in data engineering en machine learning.

Gebruik labs van Databricks Community Edition

De Databricks Community Edition biedt een gratis, cloudgebaseerde omgeving die perfect is om te experimenteren. Gebruik deze om toegang te krijgen tot:

- Voorgebouwde labs: Hands-on labs die je kernskills leren zoals werken met clusters, notebooks en Delta Lake.

- Interactieve notebooks: Oefen direct in Databricks-notebooks, met ondersteuning voor Python, SQL, Scala en R.

- Samenwerkingsfuncties: Experimenteer met realtime samenwerking om teamprojecten te simuleren.

Laat je skills zien

Een gevarieerde portfolio is een prima manier om je expertise te tonen. Het documenteren en presenteren van je projecten is net zo belangrijk als ze bouwen. Gebruik GitHub of een persoonlijke website om:

- Uitgebreide beschrijvingen te geven van elk project, inclusief doelen, gebruikte tools en resultaten.

- Code-repositories te delen met duidelijke documentatie, zodat anderen ermee uit de voeten kunnen.

- Visuals toe te voegen zoals screenshots, diagrammen of dashboards om resultaten te illustreren.

- Een blogpost of projectsamenvatting te schrijven met uitdagingen, oplossingen en belangrijkste learnings.

Door hands-on ervaring te combineren met een verzorgde portfolio toon je je expertise overtuigend aan en val je op in het competitieve Azure-ecosysteem.

Stap 3: Verdiep je in gespecialiseerde domeinen

- Data engineering: Focus bij voorkeur op Delta Lake en streamprocessing.

- Machine learning: Bestudeer MLflow voor modeltracking en -uitrol.

- Certificeringen: Denk aan certificeringen zoals Databricks Certified Associate Developer for Apache Spark en Databricks Certified Professional Data Scientist.

Als je de fundamenten van Databricks beheerst en praktische ervaring hebt opgedaan, is de volgende stap je te richten op specialisaties die passen bij je carrièredoelen. Of je nu geïnteresseerd bent in data engineering, machine learning of certificeringen om je skills te valideren: met deze stap bouw je gevorderde expertise op.

Data engineering

Data engineering vormt de kern van schaalbare datapijplijnen, en Databricks biedt krachtige tools om dit te ondersteunen. Om je hierin te verdiepen:

| Focusthema | Belangrijkste activiteiten en leerdoelen |

|---|---|

| Leer Delta Lake | Begrijp de rol van Delta Lake bij het waarborgen van databetrouwbaarheid en consistentie met functies als ACID-transacties en schemahandhaving Ontdek hoe Delta Lake batch- en streamingverwerking op één platform faciliteert Oefen met het maken, bevragen en optimaliseren van Delta-tabellen voor high-performance analytics |

| Duik in streamprocessing | Bestudeer Spark Structured Streaming om realtime datapijplijnen te bouwen Experimenteer met use-cases zoals eventstreamverwerking, loganalytics en realtime dashboards Leer streamingdata te integreren met Delta Lake voor continue datastromen |

Machine learning

Het machinelearning-ecosysteem van Databricks versnelt modelontwikkeling en -uitrol. Om je hierin te specialiseren:

| Focusthema | Belangrijkste activiteiten en leerdoelen |

|---|---|

| Beheers MLflow | Gebruik MLflow om experimenten te tracken, parameters te loggen en modelmetrics te evalueren Leer de MLflow Model Registry kennen om modellen te beheren gedurende hun levenscyclus, van ontwikkeling tot productie Verken geavanceerde functies zoals GenAI-ondersteuning voor toepassingen als chatbots en documentsamenvatting |

| Focus op uitrol | Oefen met het uitrollen van ML-modellen als REST-API’s of via frameworks zoals Azure ML en Amazon SageMaker Experimenteer met Databricks Model Serving om uitrol efficiënt te schalen |

| Integreer geavanceerde libraries | Gebruik TensorFlow, PyTorch of Hugging Face Transformers om geavanceerde modellen in Databricks te bouwen. |

Haal certificering

Certificeringen valideren je expertise en laten je opvallen op de arbeidsmarkt. Databricks biedt diverse certificeringen voor verschillende rollen en niveaus:

| Certificering | Beschrijving |

|---|---|

| Databricks Certified Associate Developer for Apache Spark | Ontworpen voor developers; richt zich op Spark-programmeerconcepten, DataFrame-API’s en Spark SQL. |

| Databricks Certified Data Engineer Associate | Behandelt kernskills zoals het bouwen van betrouwbare datapijplijnen met Delta Lake en het optimaliseren van dataopslag voor analytics. |

| Databricks Certified Professional Data Scientist | Voor gevorderden; test je vermogen om ML-modellen te bouwen, uit te rollen en te monitoren met Databricks-tools. |

Databricks-leerbronnen

Cursussen en tutorials

- Databricks Academy: Biedt officiële leerpaden over kernonderwerpen zoals data engineering, machine learning en Databricks SQL. Perfect om certificeringen te behalen en de tools van Databricks te beheersen.

- DataCamp: Biedt toegankelijke introducties tot Databricks en geavanceerde gidsen gericht op certificeringen.

- Coursera en edX: Bevatten cursussen van toonaangevende instellingen en experts over Databricks-workflows en Spark-programmeren.

- Udemy: Biedt betaalbare cursussen over ETL-pijplijnen, Delta Lake en de basis van Databricks.

- Communitybronnen: Verken blogs, YouTube-kanalen (zoals Databricks of TheSeattleGuy) en tutorials van ervaren gebruikers voor praktische, hands-on learning.

Documentatie en communitysupport

- Databricks-documentatie: Een uitgebreide bron om platformfuncties, API’s en best practices te begrijpen. Inclusief tutorials, FAQ’s en gidsen voor zowel beginners als gevorderden.

- Databricks Community Edition: Een gratis omgeving om Databricks te testen en te leren zonder cloudaccount.

- Gebruikersfora: Sluit je aan bij de communityfora van Databricks of doe mee op platforms zoals Stack Overflow voor troubleshooting en kennisdeling.

- GitHub-repositories: Toegang tot open-sourceprojecten, voorbeeldnotebooks en codefragmenten van Databricks-engineers en de community, zoals de 30 days of Databricks challenge.

Cheat sheets en referentiegidsen

- Spark Command Cheat Sheets: Gebruik de Spark-commando’s cheatsheet van Stanford om je leerproces te versterken.

- Delta Lake Quick Start: Downloadbare gidsen om Delta Lake in te richten voor efficiënte opslag en transacties.

- Databricks CLI- en API-gidsen: Gebruik deze om je Databricks-omgeving programmatisch te beheren.

Om Databricks echt te beheersen, is het essentieel om een mix van gestructureerde cursussen, officiële documentatie en naslagmateriaal te gebruiken. Hieronder staan sleutelbronnen die je leertraject sturen en ondersteunen terwijl je expertise opbouwt.

Blijf bij met Databricks

Continu leren

Bijblijven met Databricks is essentieel, omdat het platform vaak wordt uitgebreid met nieuwe functies en verbeteringen.

- Haal je kennis op: Herhaal regelmatig basisconcepten zoals Spark, Delta Lake en MLflow, en verken updates om voorop te blijven.

- Experimenteer met nieuwe functies: Gebruik de gratis Community Edition of sandboxomgevingen om recent geïntroduceerde tools en mogelijkheden te testen.

- Verken certificeringsopties: Databricks biedt certificeringsprogramma’s die je skills valideren en je helpen aansluiten bij de nieuwste praktijken.

Blogs en nieuws volgen

- Officiële Databricks-blog: Blijf op de hoogte van productaankondigingen, best practices en succesverhalen in de officiële Databricks-blog.

- Technieuwsplatforms: Volg bronnen zoals TechCrunch, InfoWorld en Medium om te zien hoe Databricks innovatie in sectoren aanjaagt.

In contact met de community

- Word lid van usergroups: Doe mee aan Databricks-groepen op Meetup, LinkedIn of Discord om kennis te delen en samen te leren.

- Bezoek conferenties: Evenementen zoals de Databricks Summit zijn ideaal voor netwerken en het ontdekken van cutting-edge use-cases.

- Doe mee op fora: Ga in discussie op platforms zoals Stack Overflow, de Databricks-communityfora en subreddits over data engineering op Reddit.

Abonneren op DataFramed

Abonneer je op de DataFramed-podcast voor inzichten in de laatste trends en luister naar interviews met experts. Een sterke Databricks-aflevering die ik aanraad bevat zelfs de CTO van Databricks: [AI and the Modern Data Stack] How Databricks is Transforming Data Warehousing and AI with Ari Kaplan, Head Evangelist & Robin Sutara, Field CTO at Databricks.

Conclusie

Databricks stelt professionals in staat om uitdagingen op te lossen en carrièrekansen te benutten. Ik ben blij dat ik Databricks heb geleerd en ik moedig je aan om te blijven studeren. Onthoud om:

-

Je doelen te bepalen: Stem je leerpad af op specifieke doelstellingen, of dat nu data engineering, AI of analytics is.

-

Bronnen te benutten: Maak gebruik van gestructureerde cursussen, community-edities en hands-on projecten om ervaring op te doen.

-

Betrokken te blijven: Volg updates, doe mee aan de Databricks-community en omarm continu leren om voorop te blijven.

Josep is een freelance Data Scientist die zich richt op Europese projecten, met expertise in dataopslag, -verwerking, geavanceerde analyses en impactvolle data storytelling.

Als docent geeft hij Big Data in de masteropleiding aan de Universiteit van Navarra en deelt hij inzichten via artikelen op platforms als Medium, KDNuggets en DataCamp. Josep schrijft ook over Data en Tech in zijn nieuwsbrief Databites (databites.tech).

Hij heeft een bachelor in Engineering Physics van de Polytechnische Universiteit van Catalonië en een master in Intelligent Interactive Systems van de Pompeu Fabra-universiteit.

Veelgestelde vragen bij het leren van Databricks

Wat is Databricks en waarom is het belangrijk voor dataprofessionals?

Databricks is een open analyticsplatform voor het bouwen, uitrollen en beheren van data-, analytics- en AI-oplossingen op schaal. De integratie met grote cloudproviders (AWS, Azure, GCP) en robuuste tools maken het een gamechanger voor dataprofessionals door big data-processing te stroomlijnen en geavanceerde analytics en machine learning mogelijk te maken.

Wat zijn de drie belangrijkste voordelen van het leren van Databricks?

Carrièregroei: Grote vraag en tekort aan gekwalificeerde professionals; 2) Brede toepassingen: Maakt datatransformatie, geavanceerde analytics en machine learning mogelijk; 3) Concurrentievoordeel: Biedt compatibiliteit met AWS, Azure, GCP en integreert naadloos met Apache Spark.

Welke kernfuncties maken Databricks tot een compleet platform?

Belangrijke functies zijn onder meer een geünificeerd dataplatform dat data engineering, analytics en machine learning combineert; Apache Spark-integratie voor gedistribueerde verwerking; Delta Lake voor dataconsistentie; MLflow voor het beheren van ML-levenscycli; en samenwerkingstools zoals interactieve notebooks.

Hoe kunnen beginners beginnen met Databricks?

Beginners kunnen starten door hun leerdoelen te bepalen, zich aan te melden voor de gratis Databricks Community Edition, de interface te verkennen (workspaces, clusters, notebooks) en hands-on projecten te doen zoals het bouwen van ETL-pijplijnen of experimenteren met MLflow.

Hoe blijven professionals up-to-date met Databricks?

Blijf up-to-date door regelmatig kernconcepten zoals Delta Lake en MLflow te herhalen, te experimenteren met nieuwe functies in de Community Edition, de officiële Databricks-blog te volgen en in contact te blijven met de community via fora, conferenties en usergroups.