Courses

Databricks là một nền tảng phân tích mở để xây dựng, triển khai và vận hành các giải pháp dữ liệu, phân tích và AI ở quy mô lớn. Nền tảng này được xây dựng trên Apache Spark và tích hợp với ba nhà cung cấp đám mây lớn (AWS, Azure hoặc GCP), cho phép chúng ta quản lý và triển khai hạ tầng đám mây thay cho bạn, đồng thời cung cấp mọi ứng dụng khoa học dữ liệu mà bạn có thể hình dung.

Hôm nay tôi muốn giới thiệu toàn diện về Databricks, bao gồm các tính năng cốt lõi, ứng dụng thực tiễn và lộ trình học tập có cấu trúc để bạn bắt đầu. Từ thiết lập môi trường đến làm chủ xử lý dữ liệu, điều phối và trực quan hóa, bạn sẽ tìm thấy mọi thứ cần thiết để khởi đầu với Databricks.

Vì sao nên học Databricks?

Học Databricks và có nền tảng vững chắc về nó có thể mang lại cho bạn một số lợi thế chính sau:

Databricks có nhiều ứng dụng

Databricks có phạm vi ứng dụng rộng, giúp doanh nghiệp chuyển đổi dữ liệu, làm sạch, xử lý và tối ưu hóa các bộ dữ liệu lớn để khai thác insight. Nền tảng cho phép phân tích nâng cao để ra quyết định tốt hơn thông qua khám phá và trực quan hóa dữ liệu; đồng thời hỗ trợ phát triển và triển khai mô hình dự đoán và giải pháp AI.

Databricks sẽ giúp bạn có lợi thế

Databricks mang lại lợi thế cạnh tranh nhờ khả năng tương thích đám mây. Được xây dựng trên Apache Spark, nền tảng tích hợp với các công cụ dữ liệu hàng đầu như AWS, Azure và Google Cloud. Làm chủ Databricks sẽ giúp bạn trở thành người dẫn đầu trong mọi ngành coi trọng dữ liệu.

Các tính năng chính của Databricks

Databricks là một nền tảng toàn diện cho kỹ thuật dữ liệu, phân tích và học máy, kết hợp năm tính năng chính giúp tăng khả năng mở rộng, cộng tác và hiệu quả quy trình làm việc.

Các tính năng chính của Databricks. Ảnh: Tác giả.

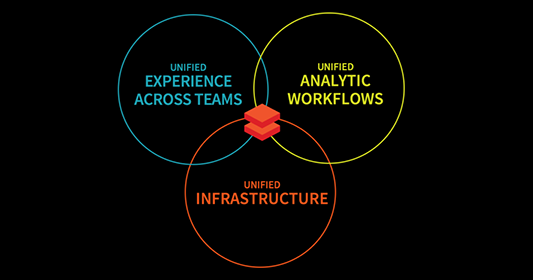

Nền tảng dữ liệu hợp nhất

Databricks kết hợp cả ba quy trình làm việc về kỹ thuật dữ liệu, khoa học dữ liệu và học máy vào một nền tảng duy nhất. Điều này giúp đơn giản hóa hơn nữa việc xử lý dữ liệu, huấn luyện và triển khai mô hình. Bằng cách hợp nhất các lĩnh vực này, Databricks tăng tốc các sáng kiến AI, giúp doanh nghiệp chuyển dữ liệu rời rạc thành insight có thể hành động và thúc đẩy hợp tác.

Tích hợp Apache Spark

Apache Spark, khuôn khổ tính toán phân tán hàng đầu, được tích hợp sâu với Databricks. Nhờ đó, Databricks có thể tự động xử lý cấu hình Spark. Vì vậy, người dùng có thể tập trung xây dựng giải pháp dữ liệu mà không phải lo phần thiết lập.

Hơn nữa, sức mạnh xử lý phân tán của Spark lý tưởng cho các tác vụ dữ liệu lớn, và Databricks bổ sung bảo mật cấp doanh nghiệp, khả năng mở rộng và tối ưu hóa.

Delta Lake

Delta Lake là xương sống của kiến trúc Lakehouse của Databricks, bổ sung các tính năng như giao dịch ACID, áp đặt lược đồ và tính nhất quán dữ liệu thời gian thực. Điều này đảm bảo độ tin cậy và chính xác của dữ liệu, khiến Delta Lake trở thành công cụ thiết yếu để quản lý cả dữ liệu theo lô và dữ liệu dòng.

MLflow

MLflow là nền tảng mã nguồn mở để quản lý toàn bộ vòng đời học máy. Từ theo dõi thí nghiệm đến quản lý triển khai mô hình, MLflow đơn giản hóa quá trình xây dựng và đưa mô hình ML vào vận hành.

Ngoài ra, với các tích hợp mới nhất cho các công cụ AI tạo sinh như OpenAI và Hugging Face, MLflow mở rộng khả năng sang các ứng dụng tiên tiến như chatbot, tóm tắt tài liệu và phân tích cảm xúc.

Công cụ cộng tác

Databricks thúc đẩy cộng tác thông qua:

- Notebooks tương tác: Kết hợp mã, markdown và trực quan hóa để ghi chép quy trình và chia sẻ insight liền mạch.

- Chia sẻ theo thời gian thực: Cộng tác trực tiếp trên notebooks để nhận phản hồi tức thì và tối ưu làm việc nhóm.

- Tính năng kiểm soát phiên bản: Theo dõi thay đổi và tích hợp với Git để quản lý dự án an toàn, hiệu quả.

Cách bắt đầu học Databricks

Bắt đầu với Databricks vừa thú vị vừa có thể gây choáng ngợp. Vì vậy, bước đầu tiên khi học bất kỳ công nghệ mới nào là hiểu rõ mục tiêu của bạn—vì sao bạn muốn học và bạn dự định sử dụng nó như thế nào.

Đặt mục tiêu rõ ràng

Trước khi bắt đầu, hãy xác định bạn muốn đạt được điều gì với Databricks.

Bạn có muốn tinh gọn xử lý dữ liệu lớn với vai trò kỹ sư dữ liệu? Hay bạn tập trung khai thác khả năng ML để xây dựng và triển khai mô hình dự đoán?

Bằng cách xác định mục tiêu chính, bạn có thể xây dựng kế hoạch học tập tập trung. Dưới đây là một số gợi ý tùy theo định hướng của bạn:

- Nếu bạn tập trung vào kỹ thuật dữ liệu, hãy ưu tiên học các công cụ của Databricks cho thu nạp, biến đổi và quản trị dữ liệu, cũng như khả năng tích hợp mượt mà với Apache Spark và Delta Lake.

- Nếu bạn tập trung vào học máy, hãy chú trọng hiểu MLflow để theo dõi thí nghiệm, quản lý và triển khai mô hình, cũng như tận dụng hỗ trợ sẵn có cho các thư viện như TensorFlow và PyTorch.

Bắt đầu với những điều cơ bản:

Bắt đầu với Databricks có thể dễ hơn bạn nghĩ. Tôi sẽ hướng dẫn bạn theo từng bước để bạn nhanh chóng làm quen với những yếu tố cốt lõi của nền tảng.

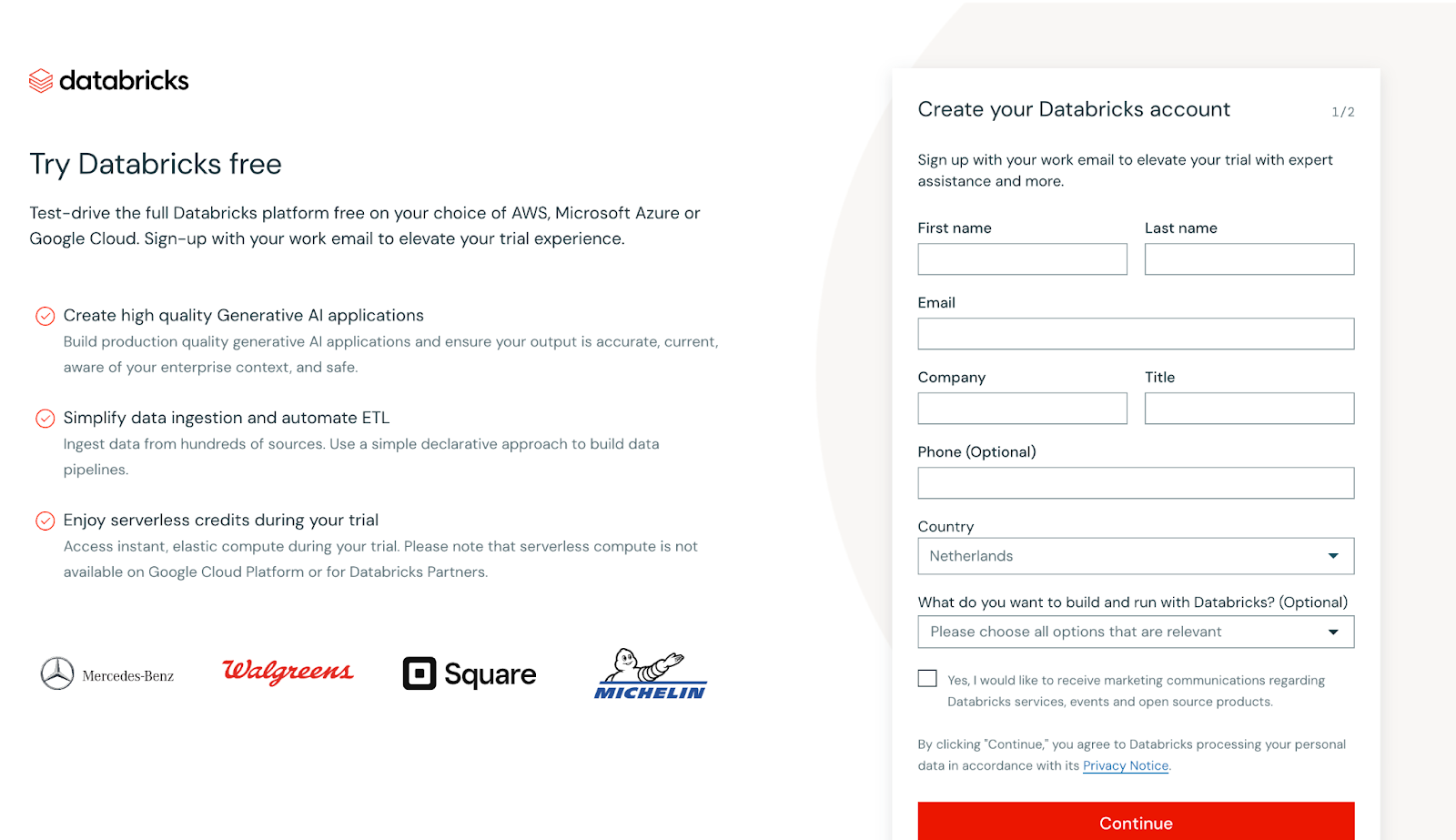

Đăng ký miễn phí

Bắt đầu bằng cách tạo tài khoản miễn phí trên Databricks Community Edition, phiên bản này cung cấp quyền truy cập các tính năng cốt lõi của nền tảng mà không tốn phí. Rất phù hợp để thực hành trực tiếp, cho phép bạn thử nghiệm với Workspaces, Clusters và Notebooks mà không cần đăng ký trả phí.

Ảnh chụp màn hình trang đăng ký Databricks. Ảnh: Tác giả

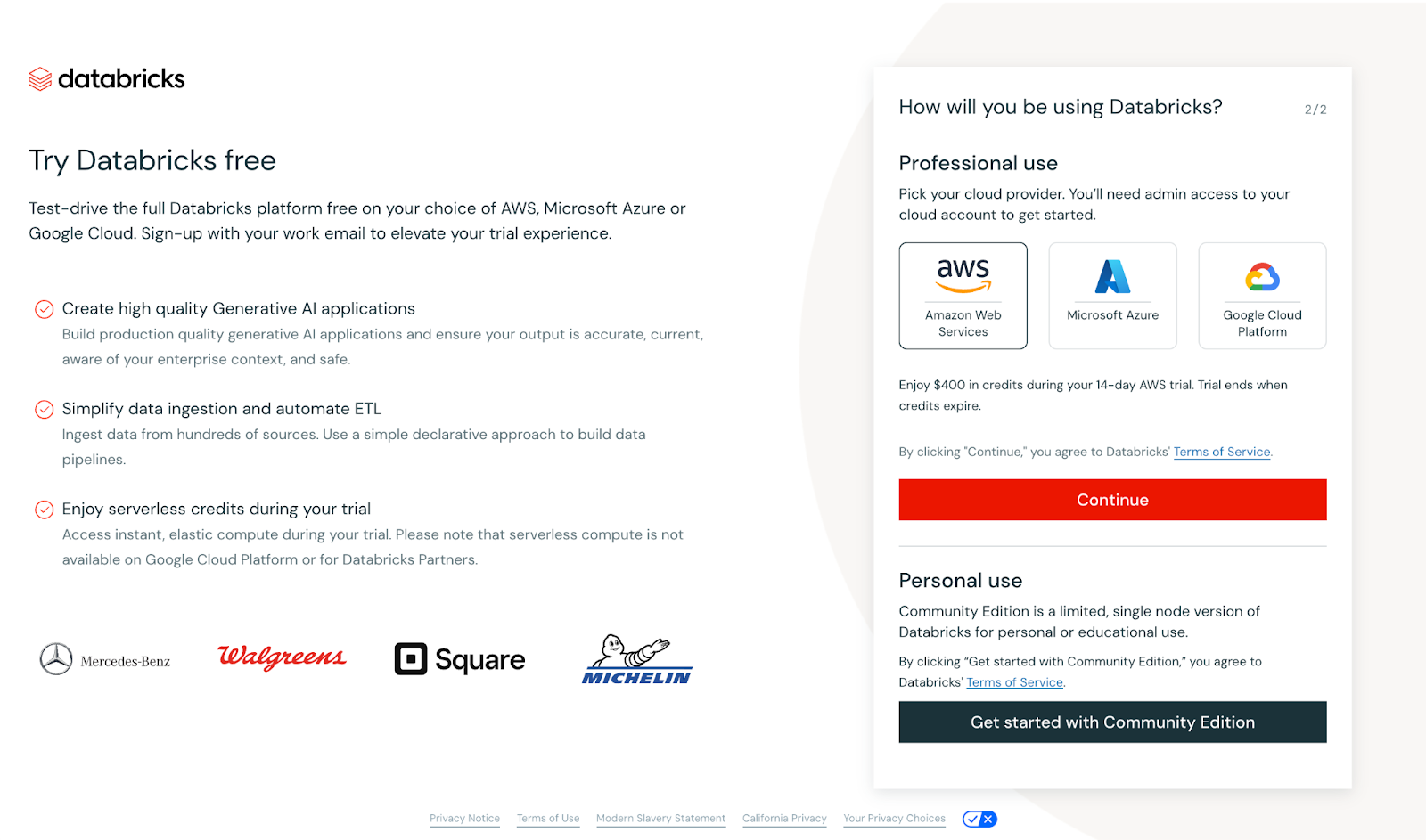

Sau khi bạn cung cấp thông tin, màn hình sau sẽ xuất hiện.

Ảnh chụp màn hình trang đăng ký Databricks. Ảnh: Tác giả

Lúc này, bạn sẽ được nhắc chọn thiết lập nhà cung cấp đám mây hoặc tiếp tục với Community Edition. Để dễ tiếp cận, chúng ta sẽ dùng Community Edition. Dù ít tính năng hơn phiên bản Enterprise, nó lý tưởng cho các mục đích nhỏ như hướng dẫn và không yêu cầu thiết lập nhà cung cấp đám mây.

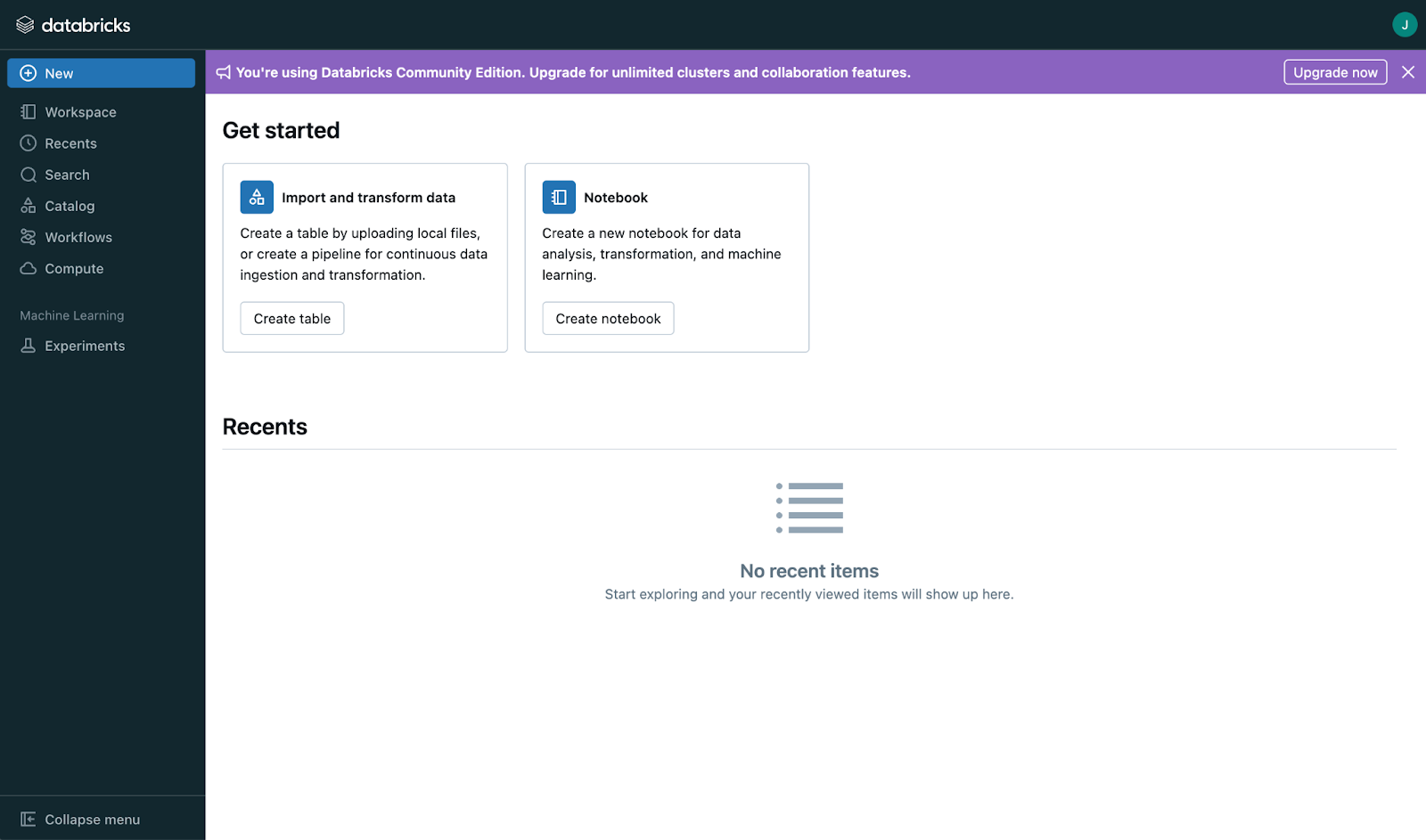

Sau khi chọn Community Edition, hãy xác minh địa chỉ email của bạn. Khi xác minh xong, bạn sẽ thấy bảng điều khiển chính như sau:

Ảnh chụp màn hình trang chính Databricks. Ảnh: Tác giả

Làm quen giao diện

Sau khi đăng nhập, hãy dành thời gian hiểu bố cục. Ở cái nhìn đầu tiên, giao diện có vẻ đơn giản, nhưng khi khám phá sâu hơn hoặc nâng cấp tài khoản, bạn sẽ thấy rất nhiều tính năng hữu ích:

- Workspaces: Nơi bạn tổ chức dự án, notebooks và tệp. Hãy coi đây là trung tâm cho toàn bộ công việc của bạn.

- Notebooks: Viết và chạy mã bằng nhiều ngôn ngữ trong cùng một notebook.

- Quản lý cụm máy (Cluster): Các nhóm máy ảo xử lý dữ liệu. Chúng cung cấp sức mạnh tính toán cho các tác vụ như biến đổi dữ liệu và học máy.

- Quản lý bảng: Tổ chức và phân tích dữ liệu có cấu trúc hiệu quả.

- Tạo bảng điều khiển: Xây dựng dashboard tương tác trực tiếp trong workspace để trực quan hóa insight.

- Chỉnh sửa cộng tác: Làm việc trên notebooks theo thời gian thực với đồng đội để cộng tác liền mạch.

- Kiểm soát phiên bản: Theo dõi thay đổi notebook và quản lý phiên bản dễ dàng.

- Lên lịch công việc: Tự động chạy notebooks và scripts theo chu kỳ định sẵn để tinh gọn quy trình.

Học các khái niệm cốt lõi

Databricks có ba khái niệm cốt lõi mà bất kỳ chuyên gia nào muốn làm chủ cũng cần nắm:

- Clusters: Xương sống của Databricks, là môi trường tính toán để chạy mã của bạn. Hãy học cách tạo, cấu hình và quản lý chúng phù hợp với nhu cầu xử lý.

- Jobs: Tự động hóa tác vụ lặp lại bằng cách tạo jobs để chạy notebooks hoặc scripts theo lịch, giúp tinh gọn quy trình.

- Notebooks: Tài liệu tương tác nơi bạn viết và chạy mã, trực quan hóa kết quả và ghi lại phát hiện. Notebooks hỗ trợ nhiều ngôn ngữ như Python, SQL và Scala, linh hoạt cho nhiều tác vụ.

Kế hoạch học Databricks

Đây là gợi ý kế hoạch học ba bước của tôi.

Bước 1: Nắm vững những điều căn bản của Databricks

Bắt đầu hành trình của bạn bằng cách xây nền tảng vững chắc với Databricks Essentials.

Quản lý dữ liệu

Quản lý dữ liệu hiệu quả là cốt lõi của mọi nền tảng dữ liệu, và Databricks đơn giản hóa quy trình này với các công cụ mạnh mẽ để nạp, biến đổi và tổ chức dữ liệu ở quy mô lớn. Dưới đây là tổng quan về các khía cạnh chính của quản lý dữ liệu trong Databricks:

Nạp dữ liệu

Databricks hỗ trợ nhiều nguồn dữ liệu, giúp dễ dàng thu nạp dữ liệu từ các định dạng có cấu trúc, bán cấu trúc và phi cấu trúc.

- Định dạng dữ liệu hỗ trợ: CSV, JSON, Parquet, ORC, Avro, v.v.

- Nguồn dữ liệu: Hệ thống lưu trữ đám mây như AWS S3, Azure Data Lake và Google Cloud Storage, cũng như cơ sở dữ liệu quan hệ và API.

- Auto Loader: Tính năng của Databricks giúp đơn giản hóa việc tải dữ liệu từ lưu trữ đám mây theo cách mở rộng, tăng dần, hoàn hảo cho các tập dữ liệu tăng trưởng liên tục.

Biến đổi dữ liệu

Sau khi nạp dữ liệu, Databricks cung cấp các công cụ mạnh để làm sạch và biến đổi nhằm chuẩn bị cho phân tích hoặc quy trình học máy.

- DataFrames: Cách trực quan để thực hiện biến đổi, tương tự SQL hoặc pandas trong Python. Bạn có thể lọc, tổng hợp và nối dữ liệu dễ dàng.

- SparkSQL: Với những ai quen SQL, Databricks cho phép truy vấn và thao tác dữ liệu trực tiếp bằng lệnh SQL.

- Delta Lake: Tăng cường biến đổi dữ liệu với khả năng áp đặt lược đồ, tạo phiên bản và đảm bảo nhất quán thời gian thực.

Quản trị dữ liệu

Databricks cho phép quản lý dữ liệu mượt mà qua các giai đoạn khác nhau của quy trình làm việc.

- Data Lakehouse: Databricks kết hợp ưu điểm của data lake và data warehouse, cung cấp một nền tảng duy nhất cho mọi nhu cầu dữ liệu.

- Phân vùng (Partitioning): Tối ưu hiệu năng và lưu trữ bằng cách phân vùng dữ liệu để truy vấn và xử lý nhanh hơn.

- Xử lý metadata: Databricks tự động theo dõi và cập nhật metadata cho tập dữ liệu của bạn, đơn giản hóa quản trị dữ liệu và tối ưu truy vấn.

Những điều cơ bản về Apache Spark

Làm quen với các khái niệm cốt lõi của Spark, bao gồm:

- RDDs (Resilient Distributed Datasets): Cấu trúc dữ liệu nền tảng cho tính toán phân tán.

- DataFrames: Trừu tượng cấp cao cho dữ liệu có cấu trúc, giúp xử lý và phân tích hiệu quả.

- SparkSQL: Giao diện SQL để truy vấn và thao tác dữ liệu trong Spark.

Tài nguyên gợi ý

- Databricks Academy: Bắt đầu với lộ trình Fundamentals để có bài học hướng dẫn.

- Học khóa Introduction to DataBricks của DataCamp để bắt đầu và hiểu những điều cơ bản của nền tảng này.

- Bạn cũng có thể dùng tài liệu của nhà cung cấp đám mây quen thuộc để bắt đầu với Databricks. Ví dụ, Azure có nội dung nhập môn Databricks khá tốt.

Bước 2: Thực hành với Databricks

Cách tốt nhất để học bất kỳ công cụ mới nào, bao gồm Databricks, là thông qua thực hành. Bằng cách áp dụng các khái niệm đã học vào kịch bản thực tế, bạn không chỉ xây dựng sự tự tin mà còn hiểu sâu hơn về các khả năng mạnh mẽ của nền tảng.

Tham gia các mini-project

Các dự án thực hành là cách tuyệt vời để khám phá tính năng của Databricks đồng thời phát triển kỹ năng quan trọng. Dưới đây là vài dự án khởi đầu để cân nhắc:

- Xây dựng dự án Kỹ thuật dữ liệu End-to-End

- Thực hiện toàn bộ quy trình kỹ thuật dữ liệu bằng cách triển khai ETL trên Databricks.

- Trích xuất dữ liệu từ dịch vụ lưu trữ đám mây như AWS S3 hoặc Azure Blob Storage.

- Biến đổi dữ liệu bằng Spark cho các tác vụ làm sạch, khử trùng lặp và tổng hợp.

- Nạp dữ liệu đã xử lý vào bảng Delta để truy vấn và lưu trữ hiệu quả.

- Gia tăng giá trị bằng cách tạo dashboard hoặc báo cáo trực quan hóa insight từ dữ liệu đã xử lý.

- Tham khảo: Làm theo dự án này tại đây.

Bạn có thể tìm nhiều dự án khác (từ trung cấp đến nâng cao) trên trang web học qua dự án. Các dự án này không chỉ củng cố khái niệm cốt lõi mà còn giúp bạn sẵn sàng cho quy trình phức tạp hơn trong kỹ thuật dữ liệu và học máy.

Sử dụng phòng lab của Databricks Community Edition

Databricks Community Edition cung cấp môi trường đám mây miễn phí lý tưởng để thử nghiệm. Hãy dùng để truy cập:

- Phòng lab dựng sẵn: Phòng lab thực hành được thiết kế để dạy bạn kỹ năng như làm việc với clusters, notebooks và Delta Lake.

- Notebooks tương tác: Luyện code trực tiếp trong notebooks của Databricks, hỗ trợ Python, SQL, Scala và R.

- Tính năng cộng tác: Thử nghiệm các công cụ cộng tác thời gian thực để mô phỏng dự án làm việc nhóm.

Phô diễn kỹ năng của bạn

Xây dựng một danh mục đa dạng là cách tuyệt vời để thể hiện chuyên môn. Việc ghi chép và trình bày dự án quan trọng không kém xây dựng chúng. Hãy dùng GitHub hoặc trang cá nhân để:

- Cung cấp mô tả chi tiết cho mỗi dự án, gồm mục tiêu, công cụ sử dụng và kết quả.

- Chia sẻ kho mã với tài liệu rõ ràng để người khác dễ tiếp cận.

- Bao gồm hình ảnh như ảnh chụp màn hình, sơ đồ hoặc dashboard để minh họa kết quả.

- Viết bài blog hoặc tóm tắt dự án để nêu bật thách thức, giải pháp và bài học chính.

Kết hợp trải nghiệm thực hành với danh mục được trau chuốt, bạn sẽ chứng minh hiệu quả chuyên môn của mình và nổi bật trong hệ sinh thái Azure cạnh tranh.

Bước 3: Nâng cao kỹ năng ở các mảng chuyên sâu

- Kỹ thuật dữ liệu: Nên tập trung vào Delta Lake và xử lý dữ liệu dòng.

- Học máy: Nên học MLflow để theo dõi và triển khai mô hình.

- Chứng chỉ: Liệt kê các chứng chỉ như Databricks Certified Associate Developer for Apache Spark và Databricks Certified Professional Data Scientist.

Khi đã nắm vững các nền tảng của Databricks và có kinh nghiệm thực hành, bước tiếp theo là tập trung vào các mảng chuyên sâu phù hợp với mục tiêu nghề nghiệp của bạn. Dù bạn quan tâm đến kỹ thuật dữ liệu, học máy hay đạt chứng chỉ để xác thực kỹ năng, bước này sẽ giúp bạn xây dựng chuyên môn nâng cao.

Kỹ thuật dữ liệu

Kỹ thuật dữ liệu là trọng tâm của việc xây dựng pipeline dữ liệu có khả năng mở rộng, và Databricks cung cấp các công cụ mạnh mẽ để hỗ trợ. Để nâng cao kỹ năng ở mảng này:

| Trọng tâm | Hoạt động và mục tiêu học tập chính |

|---|---|

| Học Delta Lake | Hiểu vai trò của Delta Lake trong việc đảm bảo độ tin cậy và nhất quán dữ liệu với các tính năng như giao dịch ACID và áp đặt lược đồ Khám phá cách Delta Lake hỗ trợ xử lý dữ liệu theo lô và dữ liệu dòng trên một nền tảng hợp nhất Thực hành tạo, truy vấn và tối ưu bảng Delta cho phân tích hiệu năng cao |

| Đào sâu xử lý dòng | Nghiên cứu Spark Structured Streaming để xây dựng pipeline dữ liệu thời gian thực Thử nghiệm các trường hợp như xử lý luồng sự kiện, phân tích log và dashboard thời gian thực Học cách tích hợp dữ liệu dòng với Delta Lake để quản lý luồng dữ liệu liên tục |

Học máy

Hệ sinh thái học máy của Databricks tăng tốc phát triển và triển khai mô hình. Để chuyên sâu ở mảng này:

| Trọng tâm | Hoạt động và mục tiêu học tập chính |

|---|---|

| Làm chủ MLflow | Dùng MLflow để theo dõi thí nghiệm, ghi thông số và đánh giá chỉ số của mô hình Tìm hiểu MLflow Model Registry để quản lý mô hình suốt vòng đời, từ phát triển đến sản xuất Khám phá các tính năng nâng cao như hỗ trợ GenAI để tạo ứng dụng như chatbot và tóm tắt tài liệu |

| Tập trung vào triển khai | Thực hành triển khai mô hình học máy dưới dạng REST API hoặc dùng các nền tảng như Azure ML và Amazon SageMaker Thử nghiệm Databricks Model Serving để mở rộng quy mô triển khai hiệu quả |

| Tích hợp thư viện nâng cao | Sử dụng TensorFlow, PyTorch hoặc Hugging Face Transformers để xây dựng mô hình tinh vi trong Databricks. |

Nhận chứng chỉ

Chứng chỉ xác thực chuyên môn của bạn và giúp bạn nổi bật trên thị trường việc làm. Databricks cung cấp nhiều chứng chỉ phù hợp với các vai trò và cấp độ kỹ năng khác nhau:

| Chứng chỉ | Mô tả |

|---|---|

| Databricks Certified Associate Developer for Apache Spark | Thiết kế cho nhà phát triển, tập trung vào khái niệm lập trình Spark, API DataFrame và Spark SQL. |

| Databricks Certified Data Engineer Associate | Bao phủ các kỹ năng chính như xây dựng pipeline dữ liệu đáng tin cậy bằng Delta Lake và tối ưu lưu trữ dữ liệu cho phân tích. |

| Databricks Certified Professional Data Scientist | Dành cho người dùng nâng cao, kiểm tra khả năng xây dựng, triển khai và giám sát mô hình học máy bằng các công cụ của Databricks. |

Tài nguyên học Databricks

Khóa học và hướng dẫn

- Databricks Academy: Cung cấp lộ trình đào tạo chính thức bao gồm các chủ đề cốt lõi như kỹ thuật dữ liệu, học máy và Databricks SQL. Hoàn hảo để đạt chứng chỉ và làm chủ công cụ Databricks.

- DataCamp: Cung cấp các bài học nhập môn Databricks thân thiện với người mới và hướng dẫn nâng cao tập trung vào việc lấy chứng chỉ.

- Coursera và edX: Có các khóa học từ các tổ chức hàng đầu và chuyên gia trong ngành tập trung vào quy trình Databricks và lập trình Spark.

- Udemy: Cung cấp các khóa học tiết kiệm chi phí về chủ đề như pipeline ETL, Delta Lake và nền tảng Databricks.

- Nguồn lực cộng đồng: Khám phá blog, các kênh YouTube (như Databricks hoặc TheSeattleGuy), và hướng dẫn từ người dùng giàu kinh nghiệm để học thực hành.

Tài liệu và hỗ trợ cộng đồng

- Tài liệu Databricks: Nguồn tài nguyên toàn diện để hiểu tính năng nền tảng, API và thực tiễn tốt nhất. Bao gồm hướng dẫn, FAQ và tài liệu cho cả người mới và người dùng nâng cao.

- Databricks Community Edition: Môi trường miễn phí để thử nghiệm và học Databricks mà không cần tài khoản đám mây.

- Diễn đàn người dùng: Tham gia diễn đàn cộng đồng Databricks hoặc thảo luận trên các nền tảng như Stack Overflow để xử lý sự cố và chia sẻ kiến thức.

- Kho GitHub: Truy cập dự án mã nguồn mở, notebook mẫu và đoạn mã do kỹ sư Databricks và cộng đồng chia sẻ như thử thách 30 days of Databricks.

Cheat sheet và tài liệu tham khảo

- Cheat sheet lệnh Spark: Dùng cheat sheet lệnh Spark của Stanford để nâng cao trải nghiệm học tập.

- Delta Lake Quick Start: Tài liệu tải về để thiết lập Delta Lake cho lưu trữ và giao dịch dữ liệu hiệu quả.

- Hướng dẫn Databricks CLI và API: Dùng để quản lý môi trường Databricks của bạn bằng lập trình.

Để làm chủ Databricks hiệu quả, hãy tận dụng kết hợp khóa học có cấu trúc, tài liệu chính thức và tài liệu tham chiếu nhanh. Dưới đây là các nguồn lực chính có thể dẫn dắt hành trình học tập của bạn và hỗ trợ khi bạn xây dựng chuyên môn.

Luôn cập nhật với Databricks

Học tập liên tục

Luôn cập nhật Databricks là điều thiết yếu vì nền tảng thường xuyên phát triển với tính năng và cải tiến mới.

- Làm mới kỹ năng: Thường xuyên ôn lại các khái niệm nền tảng như Spark, Delta Lake và MLflow, đồng thời khám phá bản cập nhật để đi trước.

- Thử nghiệm tính năng mới: Dùng Community Edition miễn phí hoặc môi trường sandbox để thử các công cụ và khả năng vừa ra mắt.

- Khám phá lựa chọn chứng chỉ: Databricks cung cấp chương trình chứng chỉ xác thực kỹ năng của bạn và giúp bạn phù hợp với thực tiễn ngành mới nhất.

Theo dõi blog và tin tức

- Blog chính thức của Databricks: Luôn nắm thông tin về công bố sản phẩm, thực tiễn tốt nhất và câu chuyện thành công tại blog chính thức của Databricks.

- Nền tảng tin tức công nghệ: Theo dõi các nguồn như TechCrunch, InfoWorld và Medium để tìm hiểu cách Databricks thúc đẩy đổi mới trên nhiều ngành.

Gắn kết với cộng đồng

- Tham gia nhóm người dùng: Tham gia các nhóm tập trung vào Databricks trên Meetup, LinkedIn hoặc Discord để chia sẻ kiến thức và học tập cộng tác.

- Tham dự hội nghị: Sự kiện như Databricks Summit rất phù hợp để mở rộng mạng lưới và khám phá các ca sử dụng tiên tiến.

- Tham gia diễn đàn: Thảo luận trên các nền tảng như Stack Overflow, diễn đàn cộng đồng Databricks và các subreddit về kỹ thuật dữ liệu trên Reddit.

Đăng ký DataFramed

Đăng ký podcast DataFramed để cập nhật xu hướng mới nhất và lắng nghe phỏng vấn chuyên gia. Một tập liên quan đến Databricks mà tôi khuyên nghe thậm chí có cả CTO của Databricks: [AI và Hệ sinh thái dữ liệu hiện đại] Databricks đang thay đổi kho dữ liệu và AI như thế nào với Ari Kaplan, Head Evangelist & Robin Sutara, Field CTO tại Databricks.

Kết luận

Databricks trao quyền cho các chuyên gia giải quyết thách thức và mở ra cơ hội nghề nghiệp. Tôi rất vui vì đã học Databricks và khuyến khích bạn tiếp tục nghiên cứu. Hãy ghi nhớ:

-

Xác định mục tiêu: Căn chỉnh lộ trình học với mục tiêu cụ thể, dù là kỹ thuật dữ liệu, AI hay phân tích.

-

Tận dụng tài nguyên: Khai thác các khóa học có cấu trúc, phiên bản cộng đồng và dự án thực hành để tích lũy kinh nghiệm.

-

Luôn gắn kết: Theo dõi cập nhật, tham gia cộng đồng Databricks và học tập liên tục để đi trước.

Josep là một Nhà khoa học dữ liệu tự do chuyên về các dự án châu Âu, có chuyên môn về lưu trữ dữ liệu, xử lý, phân tích nâng cao và kể chuyện bằng dữ liệu tạo tác động.

Với vai trò giảng dạy, anh phụ trách môn Dữ liệu lớn trong chương trình Thạc sĩ tại Đại học Navarra và chia sẻ góc nhìn qua các bài viết trên các nền tảng như Medium, KDNuggets và DataCamp. Josep cũng viết về Dữ liệu và Công nghệ trong bản tin Databites (databites.tech).

Anh có bằng Cử nhân Vật lý Kỹ thuật từ Đại học Bách khoa Catalonia và bằng Thạc sĩ Hệ thống Tương tác Thông minh từ Đại học Pompeu Fabra.

Các câu hỏi thường gặp khi học Databricks

Databricks là gì, và vì sao quan trọng với chuyên gia dữ liệu?

Databricks là một nền tảng phân tích mở để xây dựng, triển khai và vận hành các giải pháp dữ liệu, phân tích và AI ở quy mô lớn. Việc tích hợp với các nhà cung cấp đám mây lớn (AWS, Azure, GCP) và các công cụ mạnh mẽ khiến nó trở thành “cú hích” cho giới chuyên gia dữ liệu bằng cách tinh gọn xử lý dữ liệu lớn và cho phép phân tích nâng cao cũng như học máy.

Ba lợi thế chính của việc học Databricks là gì?

Tăng trưởng sự nghiệp: Nhu cầu cao và thiếu hụt nhân lực kỹ năng; 2) Ứng dụng rộng: Cho phép biến đổi dữ liệu, phân tích nâng cao và học máy; 3) Lợi thế cạnh tranh: Tương thích với AWS, Azure, GCP và tích hợp mượt với Apache Spark.

Những tính năng nào khiến Databricks trở thành nền tảng toàn diện?

Các tính năng chính gồm: nền tảng dữ liệu hợp nhất kết hợp kỹ thuật dữ liệu, phân tích và học máy; tích hợp Apache Spark cho xử lý phân tán; Delta Lake đảm bảo nhất quán dữ liệu; MLflow quản lý vòng đời học máy; và công cụ cộng tác như notebooks tương tác.

Người mới có thể bắt đầu với Databricks như thế nào?

Người mới có thể bắt đầu bằng cách xác định mục tiêu học, đăng ký phiên bản miễn phí Databricks Community Edition, khám phá giao diện (workspaces, clusters, notebooks) và thực hiện dự án thực hành như xây dựng pipeline ETL hoặc thử nghiệm với MLflow.

Chuyên gia có thể cập nhật Databricks như thế nào?

Luôn cập nhật bằng cách thường xuyên ôn lại các khái niệm cốt lõi như Delta Lake và MLflow, thử nghiệm tính năng mới trong Community Edition, theo dõi Blog chính thức của Databricks và gắn kết với cộng đồng qua diễn đàn, hội nghị và nhóm người dùng.