Corso

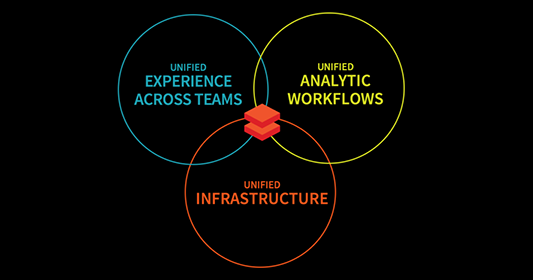

Databricks è una piattaforma di analytics aperta per creare, distribuire e mantenere soluzioni di dati, analytics e AI su larga scala. È basata su Apache Spark e si integra con uno dei tre principali provider cloud (AWS, Azure o GCP), permettendoci di gestire e distribuire l’infrastruttura cloud per nostro conto offrendo qualsiasi applicazione di data science tu possa immaginare.

Oggi voglio guidarti in un’introduzione completa a Databricks, coprendone le funzionalità principali, le applicazioni pratiche e percorsi di apprendimento strutturati per iniziare. Dalla configurazione dell’ambiente alla padronanza di elaborazione dati, orchestrazione e visualizzazione, troverai tutto ciò che ti serve per iniziare con Databricks.

Perché imparare Databricks?

Imparare Databricks e avere basi solide può offrirti diversi vantaggi principali:

Databricks ha molte applicazioni

Databricks ha applicazioni ampie che permettono alle aziende di trasformare i dati, pulire, elaborare e ottimizzare grandi dataset per ottenere insight. Abilita analytics avanzate per decisioni migliori tramite esplorazione e visualizzazione dei dati; supporta lo sviluppo e la distribuzione di modelli predittivi e soluzioni di AI.

Databricks ti darà un vantaggio

Databricks offre un vantaggio competitivo grazie alla sua compatibilità cloud. Costruito su Apache Spark, si integra con i principali strumenti dati come AWS, Azure e Google Cloud. Padroneggiare Databricks ti posiziona come un punto di riferimento in qualsiasi settore attento ai dati.

Funzionalità chiave di Databricks

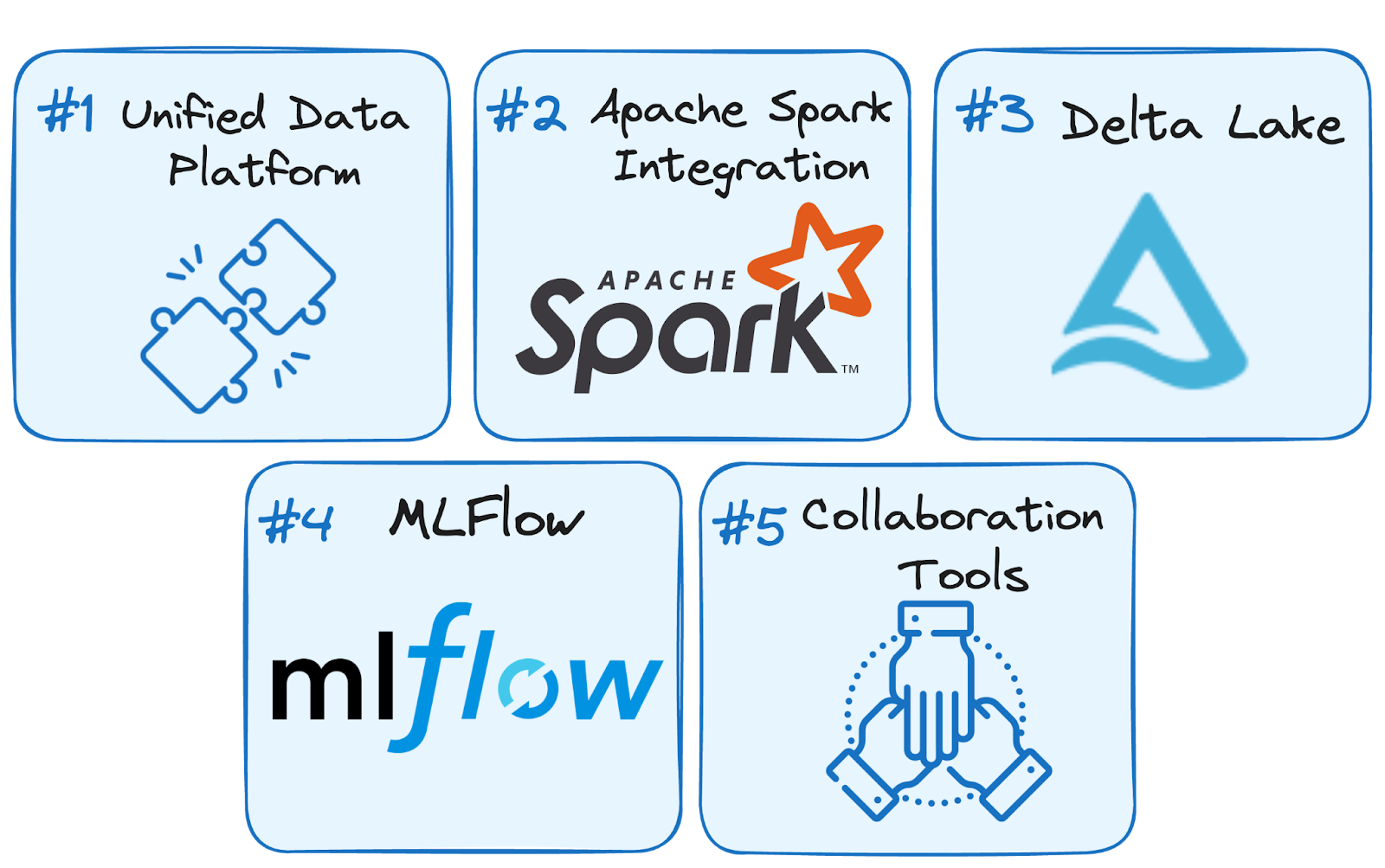

Databricks è una piattaforma completa per data engineering, analytics e machine learning, che combina cinque funzionalità principali per migliorare scalabilità, collaborazione ed efficienza dei workflow.

Funzionalità chiave di Databricks. Immagine dell’autore.

Piattaforma dati unificata

Databricks combina in un’unica piattaforma i workflow di data engineering, data science e machine learning. Questo semplifica ulteriormente l’elaborazione dei dati, l’addestramento e la distribuzione dei modelli. Unificando questi ambiti, Databricks accelera le iniziative di AI, aiutando le aziende a trasformare dati isolati in insight azionabili e favorendo la collaborazione.

Integrazione con Apache Spark

Apache Spark, il principale framework di calcolo distribuito, è profondamente integrato con Databricks. Questo consente a Databricks di gestire automaticamente la configurazione di Spark. Così gli utenti possono concentrarsi sulla costruzione di soluzioni dati senza preoccuparsi del setup.

Inoltre, la potenza di elaborazione distribuita di Spark è ideale per i compiti di big data e Databricks la arricchisce con sicurezza, scalabilità e ottimizzazione a livello enterprise.

Delta Lake

Delta Lake è la spina dorsale dell’architettura Lakehouse di Databricks, che aggiunge funzionalità come transazioni ACID, applicazione dello schema e coerenza dei dati in tempo reale. Questo garantisce affidabilità e accuratezza dei dati, rendendo Delta Lake uno strumento fondamentale per gestire sia dati batch che in streaming.

MLflow

MLflow è una piattaforma open source per gestire l’intero ciclo di vita del machine learning. Dal tracciamento degli esperimenti alla gestione della distribuzione dei modelli, MLflow semplifica la creazione e l’operazionalizzazione dei modelli di ML.

Inoltre, con le più recenti integrazioni per strumenti di AI generativa come OpenAI e Hugging Face, MLflow estende le sue capacità a applicazioni all’avanguardia come chatbot, sintesi di documenti e analisi del sentiment.

Strumenti di collaborazione

Databricks favorisce la collaborazione tramite:

- Notebook interattivi: combina codice, markdown e visualizzazioni per documentare i workflow e condividere insight senza soluzione di continuità.

- Condivisione in tempo reale: collabora in diretta sui notebook per feedback immediati e un lavoro di squadra più snello.

- Funzionalità di controllo versione: tieni traccia delle modifiche e integra con Git per una gestione dei progetti sicura ed efficiente.

Come iniziare a imparare Databricks

Iniziare con Databricks può essere sia entusiasmante che impegnativo. Per questo il primo passo nell’imparare qualsiasi nuova tecnologia è avere una chiara comprensione dei tuoi obiettivi: perché vuoi impararla e come pensi di usarla.

Definisci obiettivi chiari

Prima di iniziare, definisci cosa vuoi ottenere con Databricks.

Vuoi ottimizzare l’elaborazione dei big data come data engineer? Oppure vuoi sfruttarne le capacità di ML per creare e distribuire modelli predittivi?

Definendo i tuoi obiettivi principali, puoi creare un piano di apprendimento mirato. Ecco alcuni suggerimenti in base alla tua aspirazione principale:

- Se il tuo focus è il data engineering, dai priorità agli strumenti di Databricks per ingestion, trasformazione e gestione dei dati, nonché alla sua integrazione fluida con Apache Spark e Delta Lake.

- Se il tuo focus è il machine learning, concentrati sulla comprensione di MLflow per il tracciamento degli esperimenti, la gestione e la distribuzione dei modelli, oltre a sfruttare il supporto integrato della piattaforma per librerie come TensorFlow e PyTorch.

Parti dalle basi:

Iniziare con Databricks può essere più semplice di quanto pensi. Per farlo, ti guiderò con un approccio passo passo, così potrai familiarizzare facilmente con gli elementi essenziali della piattaforma.

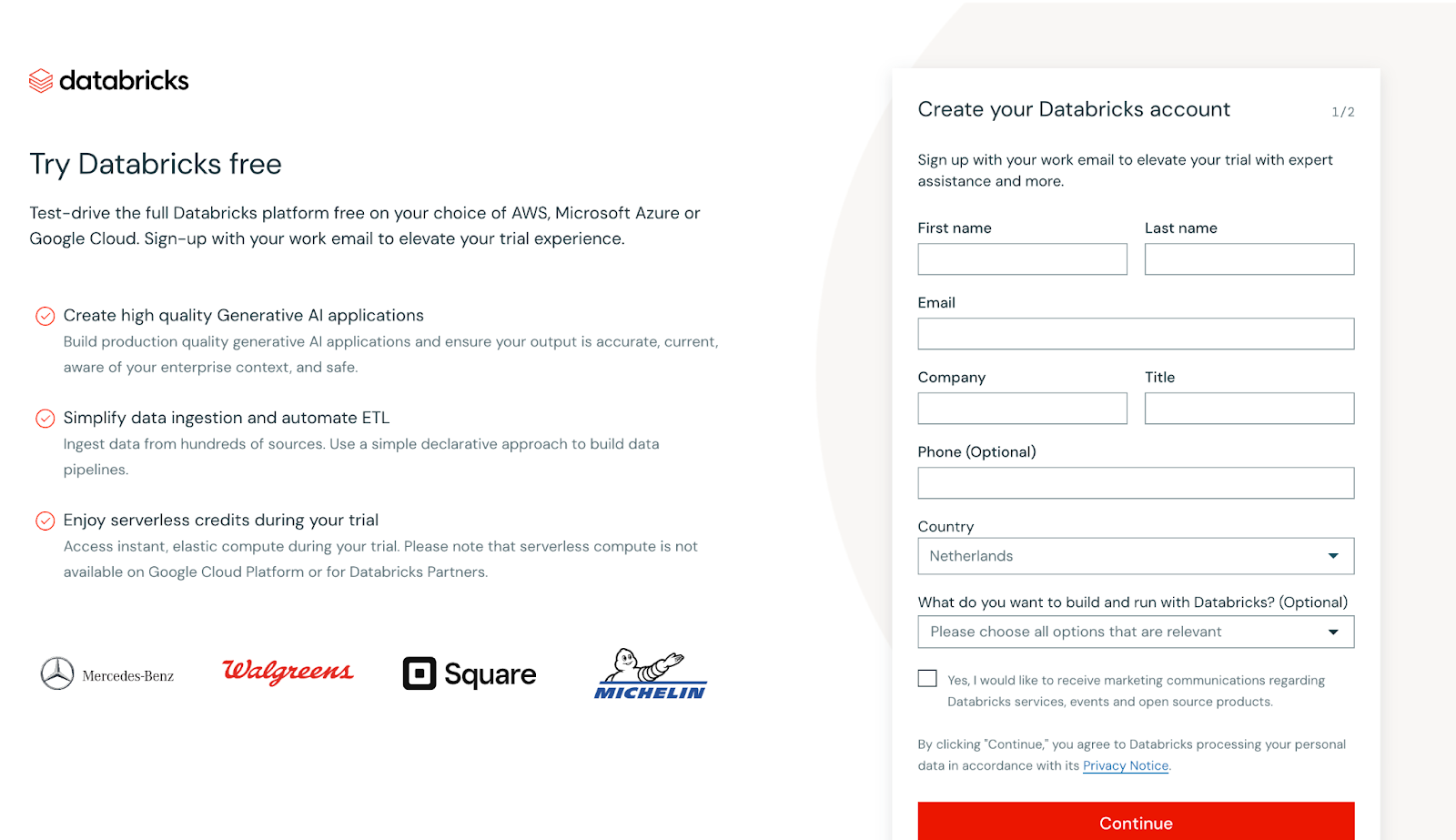

Registrati gratis

Inizia creando un account gratuito su Databricks Community Edition, che offre l’accesso alle funzionalità principali della piattaforma senza costi. Questa edizione è perfetta per l’esplorazione pratica, perché ti consente di sperimentare con Workspace, Cluster e Notebook senza bisogno di un abbonamento a pagamento.

Screenshot della schermata principale di registrazione a Databricks. Immagine dell’autore

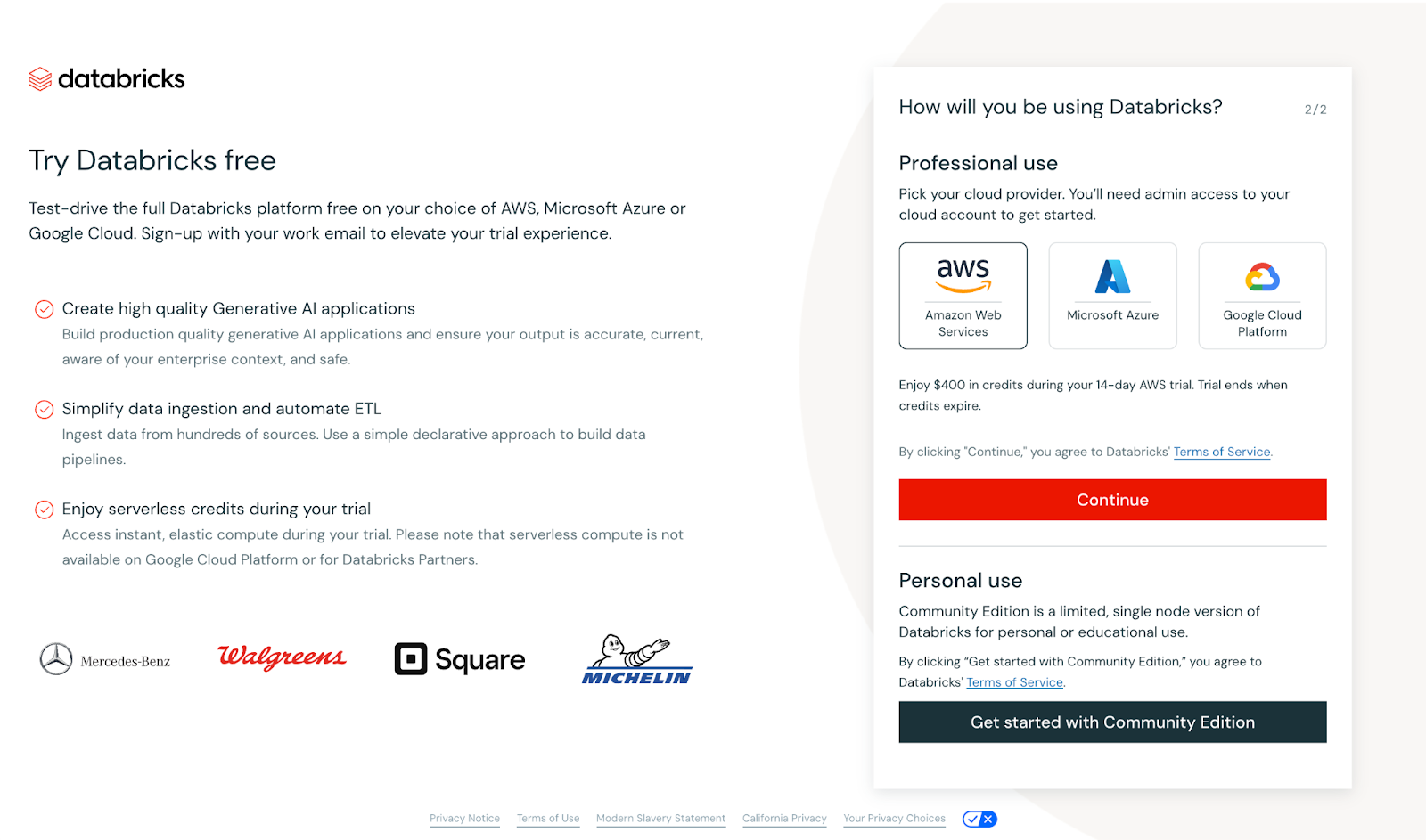

Dopo aver inserito i tuoi dati, apparirà la seguente schermata.

Screenshot della schermata principale di registrazione a Databricks. Immagine dell’autore

In questo passaggio, ti verrà chiesto di configurare un provider cloud o procedere con la Community Edition. Per mantenere tutto accessibile, useremo la Community Edition. Anche se offre meno funzionalità rispetto alla versione Enterprise, è ideale per casi d’uso più piccoli come i tutorial e non richiede la configurazione di un provider cloud.

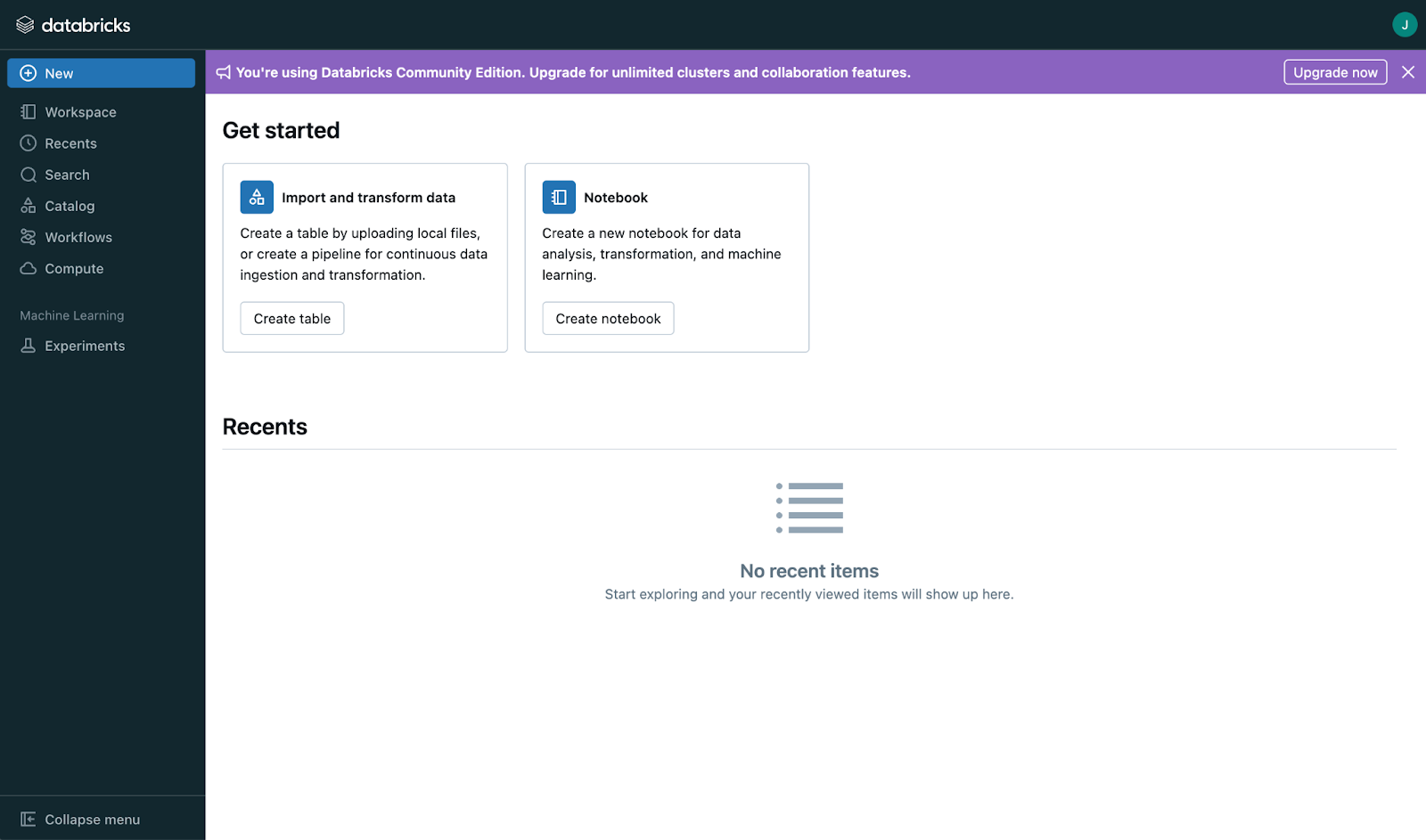

Dopo aver selezionato la Community Edition, verifica il tuo indirizzo email. Una volta verificato, ti troverai davanti una dashboard principale che appare così:

Screenshot della pagina principale di Databricks. Immagine dell’autore

Inizia dall’interfaccia

Una volta effettuato l’accesso, prenditi del tempo per capirne il layout. A una prima occhiata, l’interfaccia può sembrare basilare, ma esplorando ulteriormente o aggiornando l’account scoprirai molte ottime funzionalità:

- Workspace: qui organizzi i tuoi progetti, notebook e file. Pensalo come l’hub di tutto il tuo lavoro.

- Notebook: scrivi ed esegui codice in vari linguaggi di programmazione all’interno dello stesso notebook.

- Gestione dei cluster: gruppi di macchine virtuali che gestiscono l’elaborazione dei dati. Forniscono la potenza di calcolo necessaria per attività come trasformazioni dei dati e machine learning.

- Gestione delle tabelle: organizza e analizza dati strutturati in modo efficiente.

- Creazione di dashboard: crea dashboard interattivi direttamente nel workspace per visualizzare gli insight.

- Modifica collaborativa: lavora sui notebook in tempo reale con i compagni di squadra per una collaborazione fluida.

- Controllo versione: traccia le modifiche ai notebook e gestisci le versioni senza sforzo.

- Pianificazione dei job: automatizza l’esecuzione di notebook e script a intervalli specifici per workflow più snelli.

Impara i concetti fondamentali

Databricks ha tre concetti chiave che restano basilari per qualsiasi professionista che voglia padroneggiarlo:

- Cluster: la spina dorsale di Databricks, i cluster sono ambienti di calcolo che eseguono il tuo codice. Impara a crearli, configurarli e gestirli in base alle tue esigenze di elaborazione.

- Job: automatizza le attività ripetitive creando job che eseguono i tuoi notebook o script in base a una pianificazione, semplificando i workflow.

- Notebook: documenti interattivi in cui scrivi ed esegui codice, visualizzi i risultati e documenti le scoperte. I notebook supportano più linguaggi come Python, SQL e Scala, rendendoli versatili per vari compiti.

Piano di apprendimento per Databricks

Ecco la mia idea di un piano di apprendimento in tre passi.

Passo 1: Padroneggia le basi di Databricks

Inizia costruendo una solida base con i fondamenti di Databricks.

Gestione dei dati

Gestire efficacemente i dati è al centro di qualsiasi piattaforma dati, e Databricks semplifica questo processo con strumenti solidi per il caricamento, la trasformazione e l’organizzazione dei dati su larga scala. Ecco una panoramica degli aspetti chiave della gestione dati in Databricks:

Caricamento dei dati

Databricks supporta una varietà di sorgenti dati, rendendo semplice acquisire dati da formati strutturati, semi-strutturati e non strutturati.

- Formati supportati: CSV, JSON, Parquet, ORC, Avro e altri.

- Sorgenti dati: sistemi di storage cloud come AWS S3, Azure Data Lake e Google Cloud Storage, oltre a database relazionali e API.

- Auto Loader: una funzionalità di Databricks che semplifica il caricamento dei dati dallo storage cloud in modo scalabile e incrementale, perfetta per gestire dataset in continua crescita.

Trasformazione dei dati

Una volta acquisiti, Databricks offre strumenti potenti per pulire e trasformare i dati, preparandoli all’analisi o a workflow di machine learning.

- DataFrame: offrono un modo intuitivo per eseguire trasformazioni, simile a SQL o pandas in Python. Puoi filtrare, aggregare e unire dataset con facilità.

- SparkSQL: se conosci SQL, Databricks ti permette di interrogare e manipolare i dati direttamente con comandi SQL.

- Delta Lake: potenzia le trasformazioni con l’applicazione dello schema, il versioning e la coerenza in tempo reale.

Gestione dei dati

Databricks consente una gestione fluida dei dati nelle diverse fasi del workflow.

- Data Lakehouse: Databricks combina il meglio dei data lake e dei data warehouse, offrendo un’unica piattaforma per tutte le esigenze dati.

- Partizionamento: ottimizza prestazioni e storage partizionando i dataset per query ed elaborazioni più rapide.

- Gestione dei metadati: Databricks tiene traccia e aggiorna automaticamente i metadati dei tuoi dataset, semplificando la governance e l’ottimizzazione delle query.

Basi di Apache Spark

Familiarizza con i concetti fondamentali di Spark, tra cui:

- RDD (Resilient Distributed Dataset): la struttura dati di base per il calcolo distribuito.

- DataFrame: astrazioni di alto livello per dati strutturati, che abilitano elaborazione e analisi efficienti.

- SparkSQL: un’interfaccia SQL per interrogare e manipolare dati in Spark.

Risorse consigliate

- Databricks Academy: inizia con il percorso Fundamentals per lezioni guidate.

- Segui il corso di introduzione a Databricks su DataCamp per iniziare e comprendere le basi di questa piattaforma.

- Puoi usare anche la documentazione del tuo solito Cloud Provider per iniziare con Databricks. Per esempio, Azure ha dei buoni contenuti introduttivi su Databricks.

Passo 2: Fai pratica con Databricks

Il modo migliore per imparare un nuovo strumento, incluso Databricks, è la pratica. Applicando i concetti appresi a scenari reali, non solo acquisirai sicurezza, ma approfondirai anche la comprensione delle potenti capacità della piattaforma.

Svolgi mini‑progetti

I progetti pratici sono un ottimo modo per esplorare le funzionalità di Databricks sviluppando al contempo competenze chiave. Ecco alcuni progetti per iniziare:

- Crea un progetto end‑to‑end di data engineering

- Segui un workflow completo di data engineering implementando un processo ETL su Databricks.

- Estrai i dati da un servizio di storage cloud, come AWS S3 o Azure Blob Storage.

- Trasforma i dati con Spark per attività come pulizia, deduplicazione e aggregazioni.

- Carica i dati elaborati in una tabella Delta per query e storage efficienti.

- Aggiungi valore creando una dashboard o un report che visualizzi gli insight dai dati elaborati.

- Riferimento: Segui questo progetto qui.

Puoi trovare molti altri progetti (da intermedio ad avanzato) su questo sito dedicato all’apprendimento basato su progetti. Questi progetti non solo aiutano a consolidare i concetti fondamentali, ma ti preparano anche a workflow più complessi di data engineering e machine learning.

Usa i lab della Community Edition di Databricks

La Databricks Community Edition offre un ambiente gratuito basato su cloud, perfetto per la sperimentazione. Usalo per accedere a:

- Lab predefiniti: laboratori pratici progettati per insegnarti competenze chiave come lavorare con cluster, notebook e Delta Lake.

- Notebook interattivi: esercitati a programmare direttamente nei notebook Databricks, che supportano Python, SQL, Scala e R.

- Funzionalità collaborative: sperimenta con strumenti di collaborazione in tempo reale per simulare progetti di team.

Metti in mostra le tue competenze

Creare un portfolio vario è un ottimo modo per dimostrare la tua esperienza. Documentare e presentare i tuoi progetti è importante quanto costruirli. Usa GitHub o un sito personale per:

- Fornire descrizioni dettagliate di ogni progetto, inclusi obiettivi, strumenti usati e risultati.

- Condividere repository di codice con documentazione chiara per renderli accessibili agli altri.

- Includere visual come screenshot, diagrammi o dashboard per illustrare i risultati.

- Scrivere un post sul blog o un riepilogo del progetto per evidenziare sfide, soluzioni e lezioni chiave.

Combinando esperienza pratica e un portfolio curato, mostrerai efficacemente la tua competenza e ti distinguerai nell’ecosistema Azure.

Passo 3: Approfondisci in aree specialistiche

- Data engineering: consigliato concentrarsi su Delta Lake e l’elaborazione in streaming.

- Machine learning: suggerito studiare MLflow per il tracciamento e la distribuzione dei modelli.

- Certificazioni: elenca certificazioni come Databricks Certified Associate Developer for Apache Spark e Databricks Certified Professional Data Scientist.

Una volta padroneggiati i fondamenti di Databricks e fatta esperienza pratica, il passo successivo è concentrarti su aree specialistiche in linea con i tuoi obiettivi di carriera. Che tu sia interessato al data engineering, al machine learning o a ottenere certificazioni per convalidare le tue competenze, questo passo ti aiuterà a costruire un’expertise avanzata.

Data engineering

Il data engineering è al cuore della costruzione di pipeline di dati scalabili e Databricks offre strumenti potenti per supportare questo lavoro. Per avanzare in quest’area:

| Area di focus | Attività chiave e obiettivi di apprendimento |

|---|---|

| Impara Delta Lake | Comprendi il ruolo di Delta Lake nel garantire affidabilità e coerenza dei dati con funzionalità come transazioni ACID e applicazione dello schema Esplora come Delta Lake facilita l’elaborazione batch e in streaming su un’unica piattaforma Esercitati a creare, interrogare e ottimizzare tabelle Delta per analytics ad alte prestazioni |

| Approfondisci lo stream processing | Studia Spark Structured Streaming per costruire pipeline dati in tempo reale Sperimenta casi d’uso come elaborazione di eventi, analisi dei log e dashboard in tempo reale Impara a integrare dati in streaming con Delta Lake per una gestione continua dei flussi |

Machine learning

L’ecosistema di machine learning di Databricks accelera lo sviluppo e la distribuzione dei modelli. Per specializzarti in quest’area:

| Area di focus | Attività chiave e obiettivi di apprendimento |

|---|---|

| Padroneggia MLflow | Usa MLflow per tracciare esperimenti, registrare parametri e valutare metriche dei tuoi modelli Scopri il Model Registry di MLflow per gestire i modelli lungo tutto il ciclo di vita, dallo sviluppo alla produzione Esplora funzionalità avanzate come il supporto GenAI per creare applicazioni come chatbot e sintesi di documenti |

| Concentrati sulla distribuzione | Esercitati a distribuire modelli di machine learning come API REST o usando framework come Azure ML e Amazon SageMaker Sperimenta con Databricks Model Serving per scalare le distribuzioni in modo efficiente |

| Integra librerie avanzate | Usa TensorFlow, PyTorch o Hugging Face Transformers per costruire modelli sofisticati all’interno di Databricks. |

Ottieni la certificazione

Le certificazioni convalidano la tua esperienza e ti fanno emergere nel mercato del lavoro. Databricks offre diverse certificazioni pensate per ruoli e livelli di competenza differenti:

| Certificazione | Descrizione |

|---|---|

| Databricks Certified Associate Developer for Apache Spark | Pensata per sviluppatori, questa certificazione si concentra su concetti di programmazione Spark, API DataFrame e Spark SQL. |

| Databricks Certified Data Engineer Associate | Copre competenze chiave come costruire pipeline dati affidabili con Delta Lake e ottimizzare l’archiviazione per l’analytics. |

| Databricks Certified Professional Data Scientist | Per professionisti avanzati, questa certificazione testa la capacità di creare, distribuire e monitorare modelli di machine learning usando gli strumenti Databricks. |

Risorse per imparare Databricks

Corsi e tutorial

- Databricks Academy: offre percorsi di formazione ufficiali che coprono argomenti chiave come data engineering, machine learning e Databricks SQL. Perfetti per ottenere certificazioni e padroneggiare gli strumenti Databricks.

- DataCamp: offre introduzioni per principianti a Databricks e guide avanzate incentrate sul conseguimento delle certificazioni.

- Coursera ed edX: includono corsi di istituzioni leader ed esperti del settore dedicati ai workflow Databricks e alla programmazione Spark.

- Udemy: propone corsi convenienti su temi come pipeline ETL, Delta Lake e i fondamenti di Databricks.

- Risorse della community: esplora blog, canali YouTube (come Databricks o TheSeattleGuy) e tutorial di utenti esperti per un apprendimento pratico.

Documentazione e supporto della community

- Documentazione Databricks: una risorsa completa per comprendere funzionalità della piattaforma, API e best practice. Include tutorial, FAQ e guide utili sia ai principianti che agli utenti avanzati.

- Databricks Community Edition: un ambiente gratuito per testare e imparare Databricks senza bisogno di un account cloud.

- Forum utente: unisciti ai forum della community di Databricks o partecipa a discussioni su piattaforme come Stack Overflow per risolvere problemi e condividere conoscenza.

- Repository GitHub: accedi a progetti open source, notebook di esempio e snippet di codice condivisi dagli ingegneri Databricks e dalla community come la sfida 30 days of Databricks.

Cheat sheet e guide di riferimento

- Cheat sheet dei comandi Spark: usa la cheat sheet dei comandi Spark di Stanford per migliorare la tua esperienza di apprendimento.

- Delta Lake Quick Start: guide scaricabili per configurare Delta Lake per storage e transazioni dei dati efficienti.

- Guide CLI e API di Databricks: usale per gestire programmaticamente il tuo ambiente Databricks.

Per padroneggiare efficacemente Databricks, è essenziale sfruttare un mix di corsi strutturati, documentazione ufficiale e materiali di riferimento rapido. Di seguito trovi risorse chiave che possono guidare il tuo percorso e supportarti mentre costruisci la tua esperienza.

Rimanere aggiornati con Databricks

Apprendimento continuo

Rimanere aggiornati con Databricks è fondamentale, perché la piattaforma evolve spesso con nuove funzionalità e miglioramenti.

- Rinfresca le tue competenze: ripassa regolarmente concetti fondamentali come Spark, Delta Lake e MLflow ed esplora gli aggiornamenti per restare al passo.

- Sperimenta le nuove funzionalità: utilizza la Community Edition gratuita o ambienti sandbox per testare gli strumenti e le capacità introdotte di recente.

- Esplora le opzioni di certificazione: Databricks offre programmi di certificazione che convalidano le tue competenze e ti aiutano a restare allineato alle pratiche più recenti.

Seguire blog e notizie

- Blog ufficiale di Databricks: resta informato su annunci di prodotto, best practice e storie di successo nel blog ufficiale di Databricks.

- Piattaforme di news tech: segui fonti come TechCrunch, InfoWorld e Medium per scoprire come Databricks sta guidando l’innovazione nei settori.

Interagire con la community

- Unisciti ai gruppi utente: partecipa a gruppi focalizzati su Databricks su Meetup, LinkedIn o Discord per condividere conoscenza e imparare in modo collaborativo.

- Partecipa alle conferenze: eventi come il Databricks Summit sono ottimi per fare networking ed esplorare casi d’uso all’avanguardia.

- Partecipa ai forum: intervieni nelle discussioni su piattaforme come Stack Overflow, i forum della community di Databricks e i subreddit di data engineering su Reddit.

Iscriversi a DataFramed

Iscriviti al podcast DataFramed per approfondire le ultime tendenze e ascoltare interviste con esperti. Un ottimo episodio legato a Databricks che ti consiglio include anche il CTO di Databricks: [AI and the Modern Data Stack] Come Databricks sta trasformando il data warehousing e l’AI con Ari Kaplan, Head Evangelist, e Robin Sutara, Field CTO di Databricks.

Conclusione

Databricks permette ai professionisti di risolvere sfide e sbloccare opportunità di carriera. Sono contento di aver imparato Databricks e ti incoraggio a continuare a studiare. Ricorda di:

-

Definire i tuoi obiettivi: allinea il tuo percorso di apprendimento a obiettivi specifici, che si tratti di data engineering, AI o analytics.

-

Usare le risorse: sfrutta corsi strutturati, community edition e progetti pratici per fare esperienza.

-

Restare coinvolto: segui gli aggiornamenti, partecipa alla community di Databricks e abbraccia l’apprendimento continuo per restare avanti.

Josep è un Data Scientist freelance specializzato in progetti europei, con competenze in archiviazione e processamento dei dati, analisi avanzate e data storytelling efficace.

Come docente, insegna Big Data nel corso di laurea magistrale dell’Università di Navarra e condivide le sue idee tramite articoli su piattaforme come Medium, KDNuggets e DataCamp. Josep scrive anche di Data e Tech nella sua newsletter Databites (databites.tech).

Ha conseguito una laurea in Ingegneria Fisica presso la Università Politecnica della Catalogna e un master in Intelligent Interactive Systems presso la Università Pompeu Fabra.

Domande frequenti quando si impara Databricks

Che cos’è Databricks e perché è importante per i professionisti dei dati?

Databricks è una piattaforma di analytics aperta per creare, distribuire e mantenere soluzioni di dati, analytics e AI su larga scala. La sua integrazione con i principali provider cloud (AWS, Azure, GCP) e gli strumenti robusti la rendono rivoluzionaria per i professionisti dei dati, perché semplifica l’elaborazione dei big data e abilita analytics e machine learning avanzati.

Quali sono i tre principali vantaggi nell’imparare Databricks?

Crescita professionale: alta domanda e carenza di profili qualificati; 2) Ampie applicazioni: consente trasformazione dei dati, analytics avanzate e machine learning; 3) Vantaggio competitivo: offre compatibilità con AWS, Azure, GCP e si integra perfettamente con Apache Spark.

Quali funzionalità chiave rendono Databricks una piattaforma completa?

Le caratteristiche chiave includono una piattaforma dati unificata che combina data engineering, analytics e machine learning, integrazione con Apache Spark per l’elaborazione distribuita, Delta Lake per la coerenza dei dati, MLflow per gestire il ciclo di vita del machine learning e strumenti collaborativi come notebook interattivi.

Come possono iniziare i principianti con Databricks?

I principianti possono iniziare definendo gli obiettivi di apprendimento, registrandosi alla Databricks Community Edition gratuita, esplorando l’interfaccia (workspace, cluster, notebook) e lavorando su progetti pratici come costruire pipeline ETL o sperimentare con MLflow.

Come possono i professionisti restare aggiornati su Databricks?

Rimani aggiornato ripassando regolarmente concetti chiave come Delta Lake e MLflow, sperimentando le nuove funzionalità nella Community Edition, seguendo il blog ufficiale di Databricks e interagendo con la community tramite forum, conferenze e gruppi utente.