Kursus

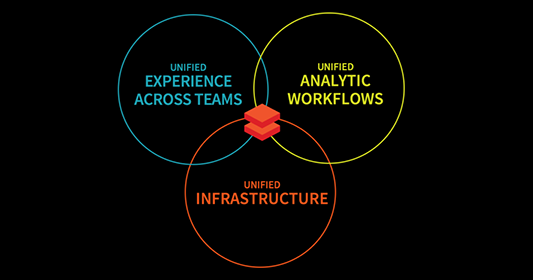

Databricks adalah platform analitik terbuka untuk membangun, menerapkan, dan memelihara solusi data, analitik, dan AI dalam skala besar. Platform ini dibangun di atas Apache Spark dan terintegrasi dengan tiga penyedia cloud utama (AWS, Azure, atau GCP), memungkinkan kita mengelola dan menerapkan infrastruktur cloud atas nama kita sekaligus menawarkan aplikasi data science apa pun yang dapat Anda bayangkan.

Hari ini saya ingin mengajak Anda memahami pengantar komprehensif tentang Databricks, mencakup fitur inti, penerapan praktis, dan jalur belajar terstruktur untuk memulai. Mulai dari menyiapkan lingkungan hingga menguasai pemrosesan data, orkestrasi, dan visualisasi, Anda akan menemukan semua yang Anda butuhkan untuk mulai menggunakan Databricks.

Mengapa Belajar Databricks?

Mempelajari Databricks dan memiliki dasar yang kuat di dalamnya dapat memberikan beberapa keuntungan utama bagi Anda:

Databricks memiliki banyak penerapan

Databricks memiliki cakupan penerapan yang luas yang memberdayakan bisnis untuk mentransformasi data, membersihkan, memproses, dan mengoptimalkan dataset besar untuk mendapatkan wawasan. Platform ini memungkinkan analitik lanjutan untuk pengambilan keputusan yang lebih baik melalui eksplorasi dan visualisasi data; juga mendukung pengembangan dan penerapan model prediktif serta solusi AI.

Databricks akan memberi Anda keunggulan

Databricks menawarkan keunggulan kompetitif dengan kompatibilitas cloud-nya. Dibangun di atas Apache Spark, platform ini terintegrasi dengan alat data teratas seperti AWS, Azure, dan Google Cloud. Penguasaan Databricks memosisikan Anda sebagai pemimpin di industri mana pun yang berfokus pada data.

Fitur Utama Databricks

Databricks adalah platform komprehensif untuk rekayasa data, analitik, dan machine learning, yang menggabungkan lima fitur utama untuk meningkatkan skalabilitas, kolaborasi, dan efisiensi alur kerja.

Fitur utama Databricks. Gambar oleh Penulis.

Platform data terpadu

Databricks menggabungkan tiga alur kerja—data engineering, data science, dan machine learning—ke dalam satu platform. Ini semakin menyederhanakan pemrosesan data, pelatihan model, dan penerapan. Dengan menyatukan domain ini, Databricks mempercepat inisiatif AI, membantu bisnis mengubah data yang terkotak-kotak menjadi wawasan yang dapat ditindaklanjuti sekaligus mendorong kolaborasi.

Integrasi Apache Spark

Apache Spark, kerangka komputasi terdistribusi terdepan, terintegrasi mendalam dengan Databricks. Hal ini memungkinkan Databricks menangani konfigurasi Spark secara otomatis. Dengan demikian, pengguna dapat fokus membangun solusi data tanpa memikirkan penyiapannya.

Selain itu, kekuatan pemrosesan terdistribusi Spark sangat ideal untuk tugas big data, dan Databricks meningkatkannya dengan keamanan, skalabilitas, dan optimisasi tingkat enterprise.

Delta Lake

Delta Lake adalah tulang punggung arsitektur Lakehouse milik Databricks, yang menambahkan fitur seperti transaksi ACID, penegakan skema, dan konsistensi data real-time. Ini memastikan keandalan dan akurasi data, menjadikan Delta Lake alat penting untuk mengelola data batch maupun streaming.

MLflow

MLflow adalah platform open-source untuk mengelola seluruh siklus hidup machine learning. Dari pelacakan eksperimen hingga pengelolaan penerapan model, MLflow menyederhanakan proses membangun dan mengoperasionalkan model ML.

Selain itu, dengan integrasi terbaru untuk alat AI generatif seperti OpenAI dan Hugging Face, MLflow memperluas kemampuannya untuk mencakup aplikasi mutakhir seperti chatbot, peringkasan dokumen, dan analisis sentimen.

Alat kolaborasi

Databricks mendorong kolaborasi melalui:

- Notebook Interaktif: Menggabungkan kode, markdown, dan visual untuk mendokumentasikan alur kerja dan berbagi wawasan secara mulus.

- Berbagi Real-Time: Berkolaborasi langsung di notebook untuk umpan balik instan dan kerja tim yang efisien.

- Fitur Version Control: Melacak perubahan dan berintegrasi dengan Git untuk manajemen proyek yang aman dan efisien.

Cara Mulai Belajar Databricks

Memulai dengan Databricks bisa jadi menarik sekaligus membingungkan. Karena itu, langkah pertama mempelajari teknologi baru adalah memahami tujuan Anda secara jelas—mengapa Anda ingin mempelajarinya dan bagaimana Anda berencana menggunakannya.

Tetapkan tujuan yang jelas

Sebelum terjun, tentukan apa yang ingin Anda capai dengan Databricks.

Apakah Anda ingin merampingkan pemrosesan big data sebagai data engineer? Atau Anda fokus memanfaatkan kemampuan ML-nya untuk membangun dan menerapkan model prediktif?

Dengan mendefinisikan tujuan utama, Anda dapat membuat rencana belajar yang terfokus. Berikut beberapa tips sesuai aspirasi utama Anda:

- Jika fokus Anda adalah data engineering, prioritaskan mempelajari alat Databricks untuk ingestion, transformasi, dan manajemen data, serta integrasinya yang mulus dengan Apache Spark dan Delta Lake.

- Jika fokus Anda adalah machine learning, fokuslah memahami MLflow untuk pelacakan eksperimen, manajemen model, dan penerapan, serta memanfaatkan dukungan bawaan platform untuk pustaka seperti TensorFlow dan PyTorch.

Mulai dari dasar:

Memulai dengan Databricks bisa lebih mudah dari yang Anda kira. Untuk itu, saya akan memandu Anda melalui pendekatan bertahap, sehingga Anda mudah mengenal hal-hal esensial platform ini.

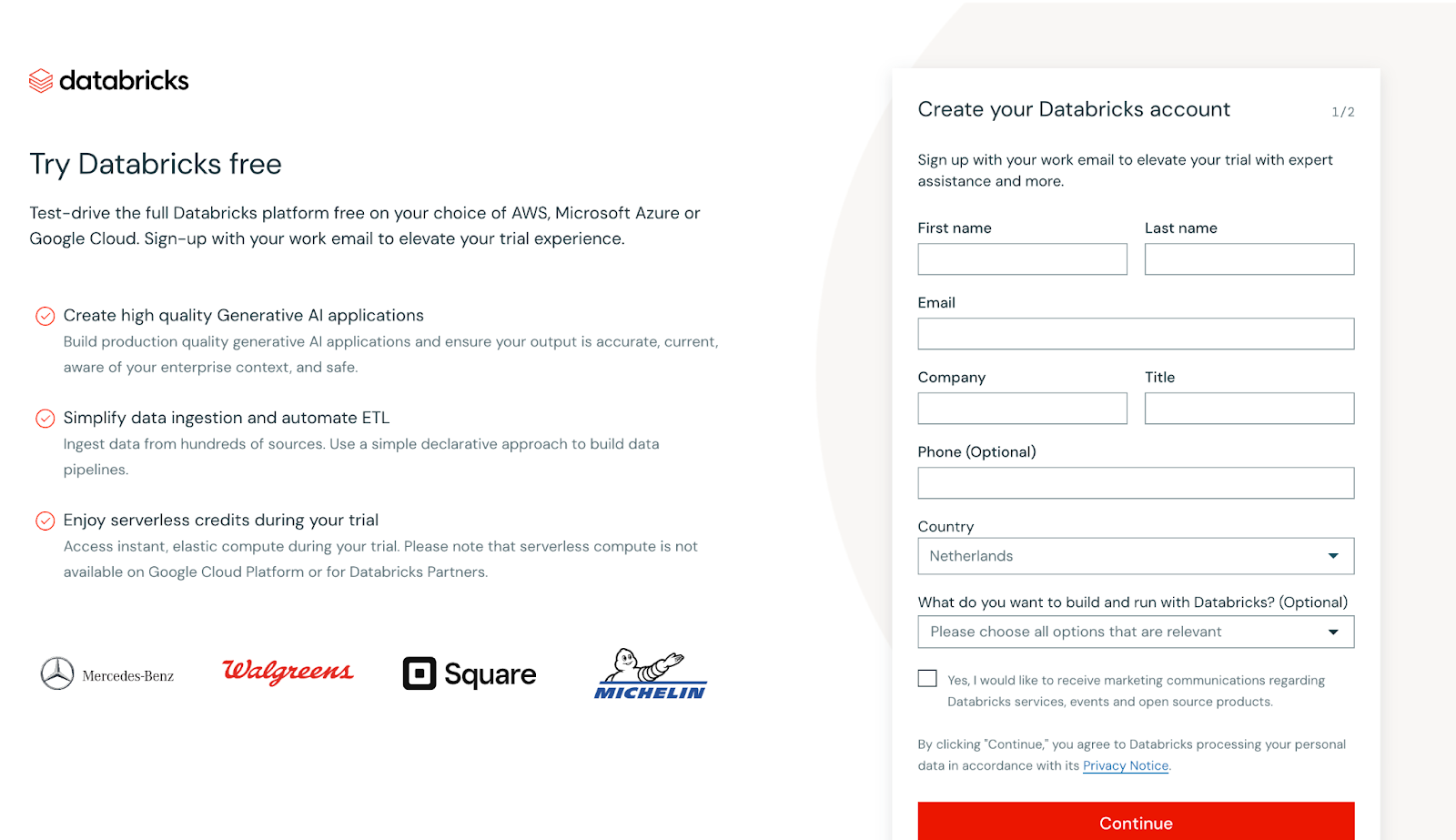

Daftar gratis

Mulailah dengan membuat akun gratis di Databricks Community Edition, yang menyediakan akses ke fitur inti platform tanpa biaya. Edisi ini sempurna untuk eksplorasi langsung, memungkinkan Anda bereksperimen dengan Workspace, Cluster, dan Notebook tanpa memerlukan langganan berbayar.

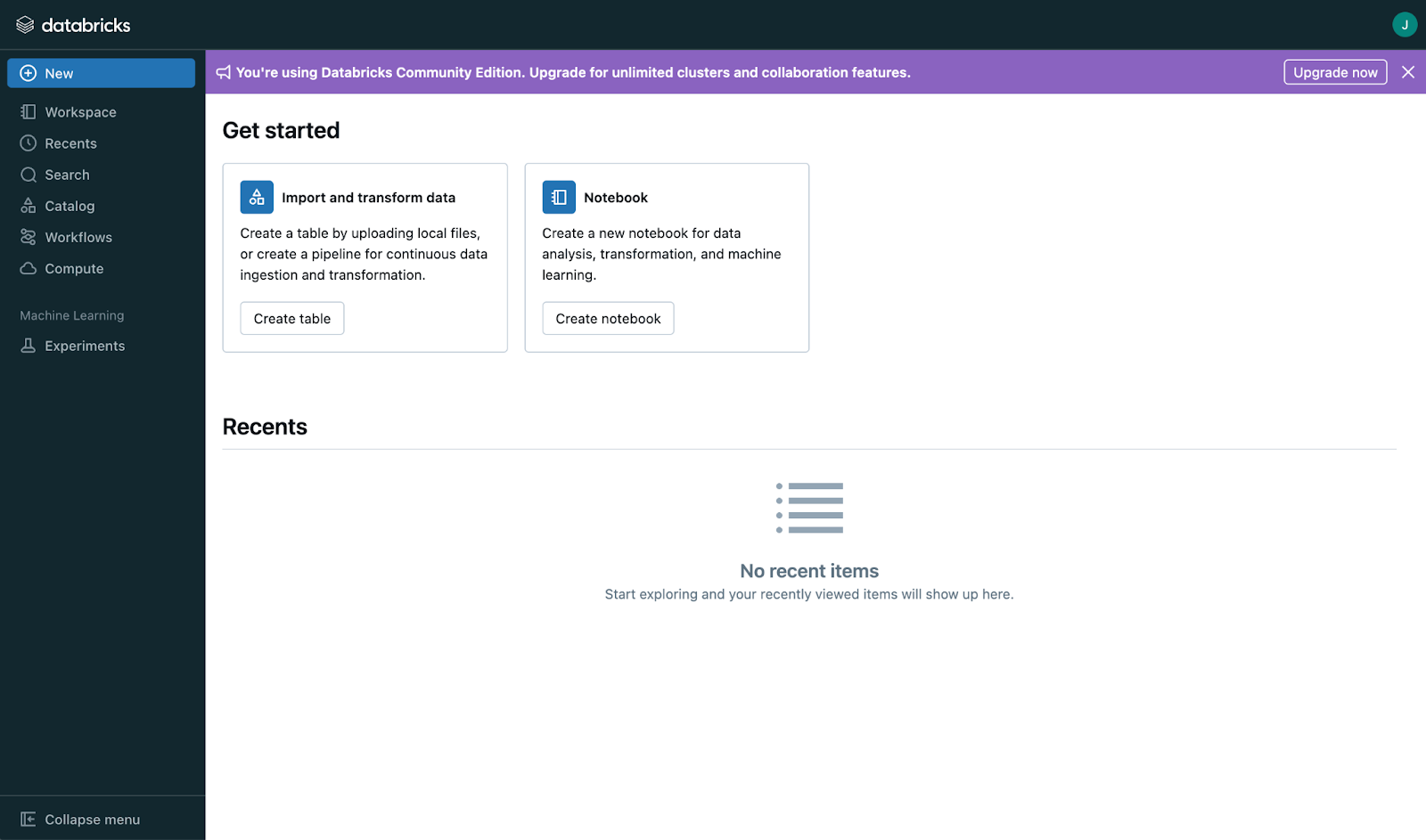

Tangkapan layar tampilan utama pendaftaran Databricks. Gambar oleh Penulis

Setelah Anda mengisi detail, tampilan berikut akan muncul.

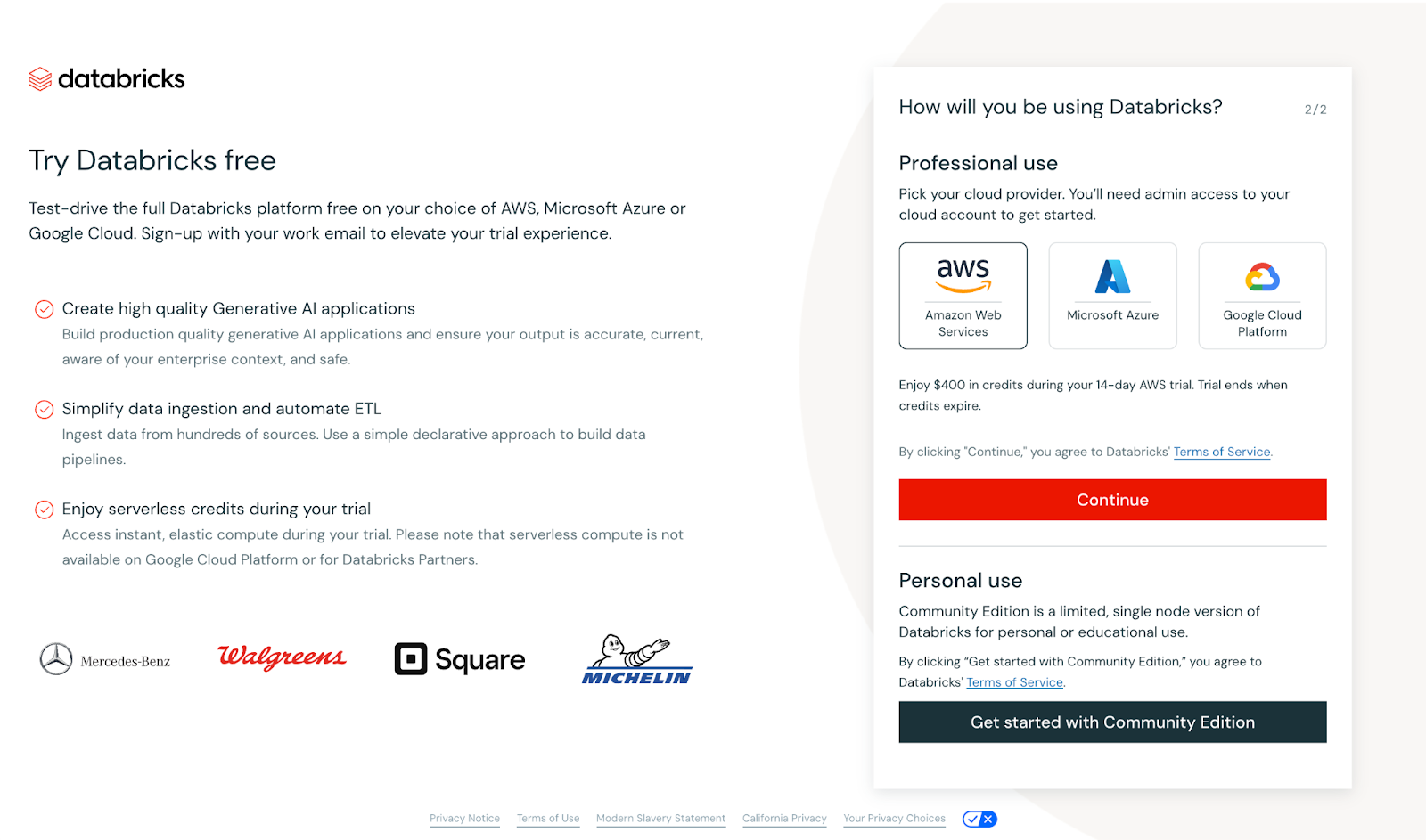

Tangkapan layar tampilan utama pendaftaran Databricks. Gambar oleh Penulis

Pada tahap ini, Anda akan diminta untuk menyiapkan penyedia cloud atau melanjutkan dengan Community Edition. Agar tetap sederhana, kita akan menggunakan Community Edition. Meskipun fiturnya lebih sedikit dibanding versi Enterprise, edisi ini ideal untuk kasus penggunaan kecil seperti tutorial dan tidak memerlukan penyiapan penyedia cloud.

Setelah memilih Community Edition, verifikasi alamat email Anda. Setelah terverifikasi, Anda akan disambut dengan dashboard utama seperti ini:

Tangkapan layar halaman utama Databricks. Gambar oleh Penulis

Mulai dari antarmuka

Setelah masuk, luangkan waktu untuk memahami tata letaknya. Sekilas, antarmukanya mungkin terlihat sederhana, tetapi setelah Anda menjelajah lebih jauh atau meningkatkan akun, Anda akan menemukan banyak fitur hebat:

- Workspaces: Tempat Anda mengatur proyek, notebook, dan file. Anggap ini sebagai pusat untuk semua pekerjaan Anda.

- Notebooks: Menulis dan menjalankan kode dalam berbagai bahasa pemrograman dalam satu notebook.

- Manajemen Cluster: Sekelompok mesin virtual yang menangani pemrosesan data. Ini menyediakan daya komputasi yang Anda perlukan untuk tugas seperti transformasi data dan machine learning.

- Manajemen Tabel: Mengatur dan menganalisis data terstruktur secara efisien.

- Pembuatan Dashboard: Membangun dashboard interaktif langsung di workspace untuk memvisualisasikan wawasan.

- Penyuntingan Kolaboratif: Bekerja pada notebook secara real-time bersama rekan tim untuk kolaborasi yang mulus.

- Version Control: Melacak perubahan notebook dan mengelola versi dengan mudah.

- Penjadwalan Job: Mengotomatisasi eksekusi notebook dan skrip pada interval tertentu untuk alur kerja yang lebih efisien.

Pelajari konsep inti

Databricks memiliki tiga konsep inti yang akan tetap mendasar bagi siapa pun yang ingin menguasainya:

- Cluster: Tulang punggung Databricks, cluster adalah lingkungan komputasi yang mengeksekusi kode Anda. Pelajari cara membuat, mengonfigurasi, dan mengelolanya sesuai kebutuhan pemrosesan Anda.

- Job: Otomatiskan tugas berulang dengan membuat job yang menjalankan notebook atau skrip Anda sesuai jadwal, sehingga alur kerja lebih efisien.

- Notebook: Dokumen interaktif tempat Anda menulis dan menjalankan kode, memvisualisasikan hasil, dan mendokumentasikan temuan. Notebook mendukung banyak bahasa seperti Python, SQL, dan Scala, sehingga serbaguna untuk berbagai tugas.

Rencana Belajar Databricks

Berikut gagasan saya untuk rencana belajar tiga langkah.

Langkah 1: Kuasai dasar-dasar Databricks

Mulailah perjalanan Anda dengan membangun fondasi yang kuat pada Databricks Essentials.

Manajemen data

Mengelola data secara efektif adalah inti dari platform data mana pun, dan Databricks menyederhanakan proses ini dengan alat tangguh untuk memuat, mentransformasi, dan mengatur data dalam skala besar. Berikut gambaran aspek-aspek kunci manajemen data di Databricks:

Memuat data

Databricks mendukung berbagai sumber data, sehingga mudah untuk mengimpor data dari format terstruktur, semi-terstruktur, dan tidak terstruktur.

- Format Data yang Didukung: CSV, JSON, Parquet, ORC, Avro, dan lainnya.

- Sumber Data: Sistem penyimpanan cloud seperti AWS S3, Azure Data Lake, dan Google Cloud Storage, serta database relasional dan API.

- Auto Loader: Fitur Databricks yang menyederhanakan pemuatan data dari penyimpanan cloud secara skalabel dan inkremental, ideal untuk menangani dataset yang terus bertumbuh.

Mentransformasi data

Setelah data diimpor, Databricks menyediakan alat kuat untuk membersihkan dan mentransformasinya agar siap untuk analisis atau workflow machine learning.

- DataFrame: Menyediakan cara intuitif untuk melakukan transformasi, mirip SQL atau pandas di Python. Anda dapat memfilter, mengagregasi, dan menggabungkan dataset dengan mudah.

- SparkSQL: Bagi yang terbiasa dengan SQL, Databricks memungkinkan Anda menanyakan dan memanipulasi data langsung menggunakan perintah SQL.

- Delta Lake: Tingkatkan transformasi data dengan dukungan Delta Lake untuk penegakan skema, versi, dan konsistensi real-time.

Mengelola data

Databricks memungkinkan pengelolaan data Anda secara mulus di berbagai tahap alur kerja.

- Data Lakehouse: Databricks menggabungkan keunggulan data lake dan data warehouse, menyediakan satu platform untuk semua kebutuhan data.

- Partisi: Optimalkan kinerja dan penyimpanan dengan mempartisi dataset Anda untuk kueri dan pemrosesan yang lebih cepat.

- Penanganan Metadata: Databricks secara otomatis melacak dan memperbarui metadata untuk dataset Anda, menyederhanakan tata kelola data dan optimisasi kueri.

Dasar-dasar Apache Spark

Kenali konsep inti Spark, termasuk:

- RDD (Resilient Distributed Datasets): Struktur data dasar untuk komputasi terdistribusi.

- DataFrame: Abstraksi tingkat tinggi untuk data terstruktur, memungkinkan pemrosesan dan analisis yang efisien.

- SparkSQL: Antarmuka SQL untuk menanyakan dan memanipulasi data di Spark.

Sumber yang disarankan

- Databricks Academy: Mulailah dengan jalur pembelajaran Fundamentals mereka untuk pelajaran terarah.

- Ikuti kursus Introduction to Databricks di DataCamp untuk mulai memahami dasar-dasar platform ini.

- Anda juga dapat menggunakan dokumentasi penyedia Cloud yang biasa Anda gunakan untuk mulai dengan Databricks. Misalnya, Azure memiliki konten pengantar yang baik tentang Databricks.

Langkah 2: Praktik langsung dengan Databricks

Cara terbaik mempelajari alat baru, termasuk Databricks, adalah melalui praktik langsung. Dengan menerapkan konsep yang telah Anda pelajari pada skenario dunia nyata, Anda tidak hanya membangun kepercayaan diri tetapi juga memperdalam pemahaman tentang kemampuan kuat platform ini.

Kerjakan mini-proyek

Proyek praktis adalah cara yang sangat baik untuk mengeksplorasi fitur Databricks sambil mengembangkan keterampilan kunci. Berikut beberapa proyek awal yang dapat dipertimbangkan:

- Bangun Proyek Data Engineering Ujung-ke-Ujung

- Ikuti alur kerja data engineering lengkap dengan menerapkan proses ETL di Databricks.

- Ekstrak data dari layanan penyimpanan cloud, seperti AWS S3 atau Azure Blob Storage.

- Transformasi data menggunakan Spark untuk tugas seperti pembersihan, deduplikasi, dan agregasi.

- Muat data yang telah diproses ke tabel Delta untuk kueri dan penyimpanan yang efisien.

- Tambahkan nilai dengan membuat dashboard atau laporan yang memvisualisasikan wawasan dari data yang diproses.

- Referensi: Ikuti proyek ini di sini.

Anda dapat menemukan banyak proyek lainnya (dari menengah hingga mahir) di situs web berikut tentang pembelajaran berbasis proyek. Proyek-proyek ini tidak hanya membantu memperkuat konsep inti, tetapi juga mempersiapkan Anda untuk alur kerja yang lebih kompleks dalam data engineering dan machine learning.

Gunakan lab Databricks Community Edition

Databricks Community Edition menyediakan lingkungan berbasis cloud gratis yang sempurna untuk bereksperimen. Gunakan untuk mengakses:

- Lab Siap Pakai: Lab praktik langsung yang dirancang untuk mengajarkan keterampilan kunci seperti bekerja dengan cluster, notebook, dan Delta Lake.

- Notebook Interaktif: Latihan coding langsung di notebook Databricks, yang mendukung Python, SQL, Scala, dan R.

- Fitur Kolaboratif: Bereksperimen dengan alat kolaborasi real-time untuk mensimulasikan proyek berbasis tim.

Pamerkan keterampilan Anda

Membangun portofolio yang beragam adalah cara yang bagus untuk menampilkan keahlian Anda. Mendokumentasikan dan menyajikan proyek sama pentingnya dengan membangunnya. Gunakan GitHub atau situs pribadi untuk:

- Memberikan deskripsi rinci setiap proyek, termasuk tujuan, alat yang digunakan, dan hasil.

- Membagikan repositori kode dengan dokumentasi jelas agar mudah diakses orang lain.

- Menyertakan visual seperti tangkapan layar, diagram, atau dashboard untuk menggambarkan hasil.

- Menulis posting blog atau ringkasan proyek untuk menyoroti tantangan, solusi, dan pembelajaran utama.

Dengan menggabungkan pengalaman langsung dengan portofolio yang rapi, Anda akan secara efektif menunjukkan keahlian dan menonjol di ekosistem Azure yang kompetitif.

Langkah 3: Perdalam keterampilan dalam area khusus

- Data Engineering: Disarankan fokus pada Delta Lake dan pemrosesan streaming.

- Machine Learning: Disarankan mempelajari MLflow untuk pelacakan dan penerapan model.

- Sertifikasi: Daftar sertifikasi seperti Databricks Certified Associate Developer for Apache Spark dan Databricks Certified Professional Data Scientist.

Setelah Anda menguasai dasar-dasar Databricks dan mendapatkan pengalaman langsung, langkah selanjutnya adalah fokus pada area khusus yang selaras dengan tujuan karier Anda. Baik Anda tertarik pada data engineering, machine learning, maupun memperoleh sertifikasi untuk memvalidasi keterampilan, langkah ini akan membantu Anda membangun keahlian tingkat lanjut.

Data engineering

Data engineering adalah inti dalam membangun pipeline data yang dapat diskalakan, dan Databricks menawarkan alat yang kuat untuk mendukung pekerjaan ini. Untuk meningkatkan keterampilan di area ini:

| Area Fokus | Aktivitas Utama dan Tujuan Belajar |

|---|---|

| Pelajari Delta Lake | Pahami peran Delta Lake dalam memastikan keandalan dan konsistensi data dengan fitur seperti transaksi ACID dan penegakan skema Jelajahi bagaimana Delta Lake memfasilitasi pemrosesan data batch dan streaming pada platform terpadu Latih pembuatan, kueri, dan optimalisasi tabel Delta untuk analitik berkinerja tinggi |

| Dalami Pemrosesan Streaming | Pelajari Spark Structured Streaming untuk membangun pipeline data real-time Bereksperimen dengan kasus penggunaan seperti pemrosesan event stream, analitik log, dan dashboard real-time Pelajari cara mengintegrasikan data streaming dengan Delta Lake untuk manajemen aliran data berkelanjutan |

Machine learning

Ekosistem machine learning Databricks mempercepat pengembangan dan penerapan model. Untuk berspesialisasi di area ini:

| Area Fokus | Aktivitas Utama dan Tujuan Belajar |

|---|---|

| Kuasai MLflow | Gunakan MLflow untuk melacak eksperimen, mencatat parameter, dan mengevaluasi metrik dari model Anda Pelajari MLflow Model Registry untuk mengelola model sepanjang siklus hidupnya, dari pengembangan hingga produksi Jelajahi fitur lanjutan seperti dukungan GenAI untuk membuat aplikasi seperti chatbot dan peringkasan dokumen |

| Fokus pada Penerapan | Latih penerapan model machine learning sebagai REST API atau menggunakan kerangka kerja seperti Azure ML dan Amazon SageMaker Bereksperimen dengan Databricks Model Serving untuk menskalakan penerapan secara efisien |

| Gabungkan Pustaka Lanjutan | Gunakan TensorFlow, PyTorch, atau Hugging Face Transformers untuk membangun model canggih di dalam Databricks. |

Dapatkan sertifikasi

Sertifikasi memvalidasi keahlian Anda dan membuat Anda menonjol di pasar kerja. Databricks menawarkan beberapa sertifikasi yang disesuaikan untuk berbagai peran dan tingkat keterampilan:

| Sertifikasi | Deskripsi |

|---|---|

| Databricks Certified Associate Developer for Apache Spark | Dirancang untuk developer, sertifikasi ini berfokus pada konsep pemrograman Spark, API DataFrame, dan Spark SQL. |

| Databricks Certified Data Engineer Associate | Mencakup keterampilan kunci seperti membangun pipeline data andal menggunakan Delta Lake dan mengoptimalkan penyimpanan data untuk analitik. |

| Databricks Certified Professional Data Scientist | Untuk praktisi tingkat lanjut, sertifikasi ini menguji kemampuan Anda membangun, menerapkan, dan memantau model machine learning menggunakan alat Databricks. |

Sumber Belajar Databricks

Kursus dan tutorial

- Databricks Academy: Menawarkan jalur pelatihan resmi yang mencakup topik inti seperti data engineering, machine learning, dan Databricks SQL. Sempurna untuk meraih sertifikasi dan menguasai alat Databricks.

- DataCamp: Menyediakan pengantar Databricks untuk pemula dan panduan lanjutan berfokus pada perolehan sertifikasi.

- Coursera dan edX: Menampilkan kursus dari institusi terkemuka dan pakar industri yang berfokus pada alur kerja Databricks dan pemrograman Spark.

- Udemy: Menawarkan kursus hemat biaya tentang topik seperti pipeline ETL, Delta Lake, dan dasar-dasar Databricks.

- Sumber Daya Komunitas: Jelajahi blog, saluran YouTube (seperti Databricks atau TheSeattleGuy), dan tutorial dari pengguna berpengalaman untuk pembelajaran praktis.

Dokumentasi dan dukungan komunitas

- Dokumentasi Databricks: Sumber komprehensif untuk memahami fitur platform, API, dan praktik terbaik. Mencakup tutorial, FAQ, dan panduan untuk membantu pemula maupun pengguna tingkat lanjut.

- Databricks Community Edition: Lingkungan gratis untuk menguji dan mempelajari Databricks tanpa memerlukan akun cloud.

- Forum Pengguna: Bergabunglah dengan forum komunitas Databricks atau berpartisipasi dalam diskusi di platform seperti Stack Overflow untuk pemecahan masalah dan berbagi pengetahuan.

- Repositori GitHub: Akses proyek open-source, contoh notebook, dan potongan kode yang dibagikan oleh engineer Databricks dan komunitas seperti tantangan 30 days of Databricks.

Cheat sheet dan panduan referensi

- Cheat Sheet Perintah Spark: Gunakan cheatsheet perintah Spark dari Stanford untuk meningkatkan pengalaman belajar Anda.

- Delta Lake Quick Start: Panduan yang dapat diunduh untuk menyiapkan Delta Lake demi penyimpanan data dan transaksi yang efisien.

- Panduan CLI dan API Databricks: Gunakan ini untuk mengelola lingkungan Databricks Anda secara terprogram.

Untuk menguasai Databricks secara efektif, penting memanfaatkan kombinasi kursus terstruktur, dokumentasi resmi, dan materi referensi cepat. Di bawah ini adalah sumber-sumber kunci yang dapat membimbing perjalanan belajar Anda dan mendukung saat Anda membangun keahlian.

Tetap Terbaru dengan Databricks

Pembelajaran berkelanjutan

Tetap mutakhir dengan Databricks itu penting karena platform ini sering berkembang dengan fitur dan peningkatan baru.

- Segarkan Keterampilan Anda: Secara berkala tinjau kembali konsep dasar seperti Spark, Delta Lake, dan MLflow, serta jelajahi pembaruan untuk tetap unggul.

- Bereksperimen dengan Fitur Baru: Manfaatkan Community Edition gratis atau lingkungan sandbox untuk menguji alat dan kapabilitas yang baru diperkenalkan.

- Jelajahi Opsi Sertifikasi: Databricks menawarkan program sertifikasi yang memvalidasi keterampilan Anda dan membantu Anda tetap selaras dengan praktik industri terbaru.

Mengikuti blog dan berita

- Blog Resmi Databricks: Tetap terinformasi tentang pengumuman produk, praktik terbaik, dan kisah keberhasilan di blog resmi Databricks.

- Platform Berita Teknologi: Ikuti sumber seperti TechCrunch, InfoWorld, dan Medium untuk mempelajari bagaimana Databricks mendorong inovasi lintas industri.

Terlibat dengan komunitas

- Bergabung dengan User Group: Berpartisipasilah dalam grup berfokus Databricks di Meetup, LinkedIn, atau Discord untuk berbagi pengetahuan dan belajar bersama.

- Hadiri Konferensi: Acara seperti Databricks Summit sangat baik untuk berjejaring dan mengeksplorasi use case mutakhir.

- Berpartisipasi di Forum: Ikut berdiskusi di platform seperti Stack Overflow, forum komunitas Databricks, dan subreddit data engineering di Reddit.

Berlangganan DataFramed

Berlangganan podcast DataFramed untuk mendapatkan wawasan tren terbaru dan mendengar wawancara para ahli. Salah satu episode terkait Databricks yang saya rekomendasikan bahkan menampilkan CTO Databricks: [AI and the Modern Data Stack] How Databricks is Transforming Data Warehousing and AI with Ari Kaplan, Head Evangelist & Robin Sutara, Field CTO at Databricks.

Kesimpulan

Databricks memberdayakan profesional untuk memecahkan tantangan dan membuka peluang karier. Saya senang telah mempelajari Databricks, dan saya mendorong Anda untuk terus belajar. Ingat untuk:

-

Tentukan Tujuan Anda: Selaraskan jalur belajar dengan sasaran spesifik, baik di data engineering, AI, maupun analitik.

-

Manfaatkan Sumber Daya: Gunakan kursus terstruktur, edisi komunitas, dan proyek praktik langsung untuk memperoleh pengalaman.

-

Tetap Terlibat: Ikuti pembaruan, berpartisipasi di komunitas Databricks, dan tekuni pembelajaran berkelanjutan agar tetap terdepan.

Josep adalah Data Scientist freelance yang berfokus pada proyek-proyek Eropa, dengan keahlian dalam penyimpanan data, pemrosesan, analitik lanjutan, dan penyusunan narasi data yang berdampak.

Sebagai pendidik, ia mengajar Big Data di program Magister di University of Navarra dan berbagi wawasan melalui artikel di platform seperti Medium, KDNuggets, dan DataCamp. Josep juga menulis tentang Data dan Teknologi dalam buletin Databites (databites.tech).

Ia meraih gelar Sarjana di bidang Fisika Teknik dari Polytechnic University of Catalonia dan gelar Magister di bidang Intelligent Interactive Systems dari Pompeu Fabra University.

Pertanyaan yang Sering Diajukan Saat Belajar Databricks

Apa itu Databricks, dan mengapa penting bagi profesional data?

Databricks adalah platform analitik terbuka untuk membangun, menerapkan, dan memelihara solusi data, analitik, dan AI dalam skala besar. Integrasinya dengan penyedia cloud utama (AWS, Azure, GCP) dan alat yang tangguh menjadikannya pengubah permainan bagi profesional data dengan merampingkan pemrosesan big data dan memungkinkan analitik serta machine learning tingkat lanjut.

Apa tiga keuntungan utama belajar Databricks?

Pertumbuhan Karier: Permintaan tinggi dan kekurangan profesional terampil; 2) Penerapan Luas: Memungkinkan transformasi data, analitik lanjutan, dan machine learning; 3) Keunggulan Kompetitif: Kompatibel dengan AWS, Azure, GCP, dan terintegrasi mulus dengan Apache Spark.

Fitur kunci apa yang membuat Databricks menjadi platform yang komprehensif?

Fitur kunci termasuk platform data terpadu yang menggabungkan data engineering, analitik, dan machine learning; integrasi Apache Spark untuk pemrosesan terdistribusi; Delta Lake untuk konsistensi data; MLflow untuk mengelola siklus hidup machine learning; serta alat kolaborasi seperti notebook interaktif.

Bagaimana pemula dapat mulai belajar Databricks?

Pemula dapat mulai dengan mendefinisikan tujuan belajar, mendaftar ke Databricks Community Edition gratis, mengeksplorasi antarmuka (workspace, cluster, notebook), dan mengerjakan proyek langsung seperti membangun pipeline ETL atau bereksperimen dengan MLflow.

Bagaimana profesional dapat tetap mengikuti perkembangan Databricks?

Tetap terbaru dengan secara berkala meninjau konsep inti seperti Delta Lake dan MLflow, bereksperimen dengan fitur baru di Community Edition, mengikuti Blog Resmi Databricks, dan terlibat dengan komunitas Databricks melalui forum, konferensi, dan user group.