Cursus

Er wordt geschat dat er dagelijks ongeveer 328,77 miljoen terabytes aan data wordt gecreëerd. Elke klik en elke aankoop genereert data die met de juiste tools kan worden omgezet in zinvolle inzichten en voorspellingen.

Daarvoor hebben we wel een high-performance bibliotheek nodig die ons helpt zulke hoeveelheden data te verwerken. Daar komt PySpark om de hoek kijken.

In deze gids bekijken we hoe je PySpark vanaf nul leert. Ik help je met het opstellen van een leerplan, deel mijn beste tips om het effectief te leren en bied nuttige resources om rollen te vinden waarin PySpark vereist is.

Wat is PySpark?

PySpark is de combinatie van twee krachtige technologieën: Python en Apache Spark.

Python is een van de meest gebruikte programmeertalen in softwareontwikkeling, met name voor data science en machine learning, vooral dankzij de eenvoudige en duidelijke syntax.

Apache Spark is daarentegen een framework dat grote hoeveelheden ongestructureerde data aankan. Spark is gebouwd met Scala, een taal die ons meer controle geeft. Scala is echter niet erg populair onder dataprofessionals. Daarom is PySpark ontwikkeld om dit gat te dichten.

PySpark biedt een API en een gebruiksvriendelijke interface om met Spark te werken. Het gebruikt de eenvoud en flexibiliteit van Python om big data-verwerking voor een breder publiek toegankelijk te maken.

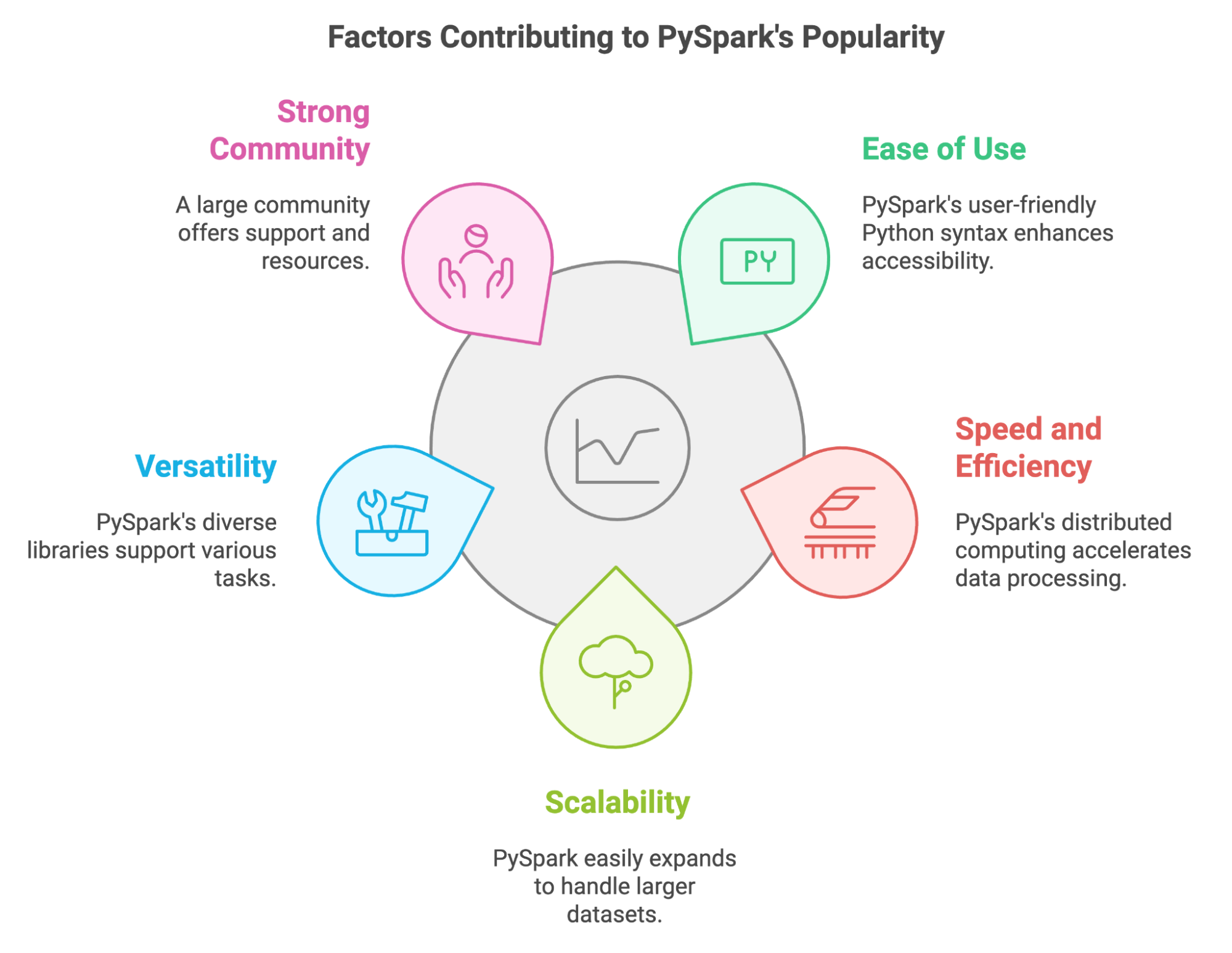

Waarom is PySpark populair?

De laatste jaren is PySpark een belangrijk hulpmiddel geworden voor dataprofessionals die enorme hoeveelheden data moeten verwerken. De populariteit is te verklaren door verschillende factoren:

- Gebruiksgemak: PySpark gebruikt de vertrouwde syntax van Python, waardoor het toegankelijker is voor dataprofessionals zoals wij.

- Snelheid en efficiëntie: Door berekeningen te verdelen over clusters van machines verwerkt PySpark enorme datasets op hoge snelheid.

- Schaalbaarheid: PySpark past zich aan groeiende datavolumes aan, waardoor we applicaties kunnen opschalen door meer rekenkracht toe te voegen.

- Veelzijdigheid: Het biedt een breed ecosysteem aan bibliotheken voor allerlei taken, van datamanipulatie tot machine learning.

- Sterke community: We kunnen rekenen op een grote en actieve community voor support en resources bij problemen en uitdagingen.

Met PySpark kunnen we ook bestaande Python-skills en -bibliotheken benutten. Je integreert het eenvoudig met populaire tools zoals Pandas en Scikit-learn, en je kunt diverse databronnen gebruiken.

Belangrijkste features van PySpark

PySpark is speciaal ontwikkeld voor big data en machine learning. Maar welke features maken het zo krachtig voor het omgaan met enorme hoeveelheden data? Laten we ze bekijken:

- Resilient distributed datasets (RDD's): Dit zijn de fundamentele datastructuren achter PySpark. Dankzij RDD's kunnen datatransformaties, filtering en aggregaties parallel worden uitgevoerd.

- DataFrames en SQL: In PySpark vormen DataFrames een abstractielaag bovenop RDD's. We kunnen ze gebruiken met Spark SQL en queries voor datamanipulatie en analyse.

- Machine-learningbibliotheken: Met de MLlib-bibliotheek van PySpark kunnen we schaalbare ML-modellen bouwen en gebruiken voor taken zoals classificatie en regressie.

- Ondersteuning van verschillende dataformaten: PySpark biedt bibliotheken en API's om data te lezen, te schrijven en te verwerken in formaten zoals CSV, JSON, Parquet en Avro, en meer.

- Fouttolerantie: PySpark houdt elke RDD bij. Als er tijdens de uitvoering een node uitvalt, reconstrueert PySpark de verloren partitie van de RDD met die trackinginformatie. Zo is het risico op dataverlies klein.

- In-memory verwerking: PySpark slaat tussentijdse data in het geheugen op, waardoor minder schijfoperaties nodig zijn en de verwerkingssnelheid toeneemt.

- Streaming en realtime verwerking: We kunnen Spark Streaming gebruiken om realtime datastromen te verwerken en near-realtime analytics uit te voeren.

Waarom is PySpark leren zo nuttig?

De hoeveelheid data blijft alleen maar toenemen. Tegenwoordig omvatten taken voor data wrangling, data-analyse en machine learning het werken met grote hoeveelheden data. We hebben krachtige tools nodig die die data efficiënt en snel verwerken. PySpark is zo'n tool.

PySpark heeft uiteenlopende toepassingen

We hebben de sterke punten van PySpark al genoemd, maar laten we een paar concrete voorbeelden bekijken waar je ze kunt inzetten:

- Data-ETL. PySparks vermogen om data efficiënt te schonen en te transformeren wordt gebruikt voor het verwerken van sensordata en productie-logs in productie en logistiek.

- Machine learning. De MLlib-bibliotheek wordt gebruikt om modellen te ontwikkelen en te deployen voor gepersonaliseerde aanbevelingen, klantsegmentatie en verkoopvoorspellingen in e-commerce.

- Grafen verwerken. De GraphFrames van PySpark worden gebruikt om sociale netwerken te analyseren en relaties tussen gebruikers te begrijpen.

- Streamverwerking. De Structured Streaming API van PySpark maakt realtime verwerking van financiële transacties mogelijk om fraude te detecteren.

- SQL-dataverwerking. De SQL-interface van PySpark maakt het voor onderzoekers en analisten in de gezondheidszorg makkelijker om grote genomische datasets te bevragen en te analyseren.

Er is vraag naar PySpark-skills

Met de opkomst van data science en machine learning en de toename van beschikbare data is er veel vraag naar professionals met datamanipulatie-skills. Volgens het State of Data & AI Literacy Report 2024 hecht 80% van de leiders waarde aan data-analyse en -manipulatievaardigheden.

PySpark leren kan veel carrièrekansen openen. Meer dan 800 vacatures op Indeed, van data engineers tot data scientists, benadrukken de vraag naar PySpark-vaardigheid in data-gerelateerde functies.

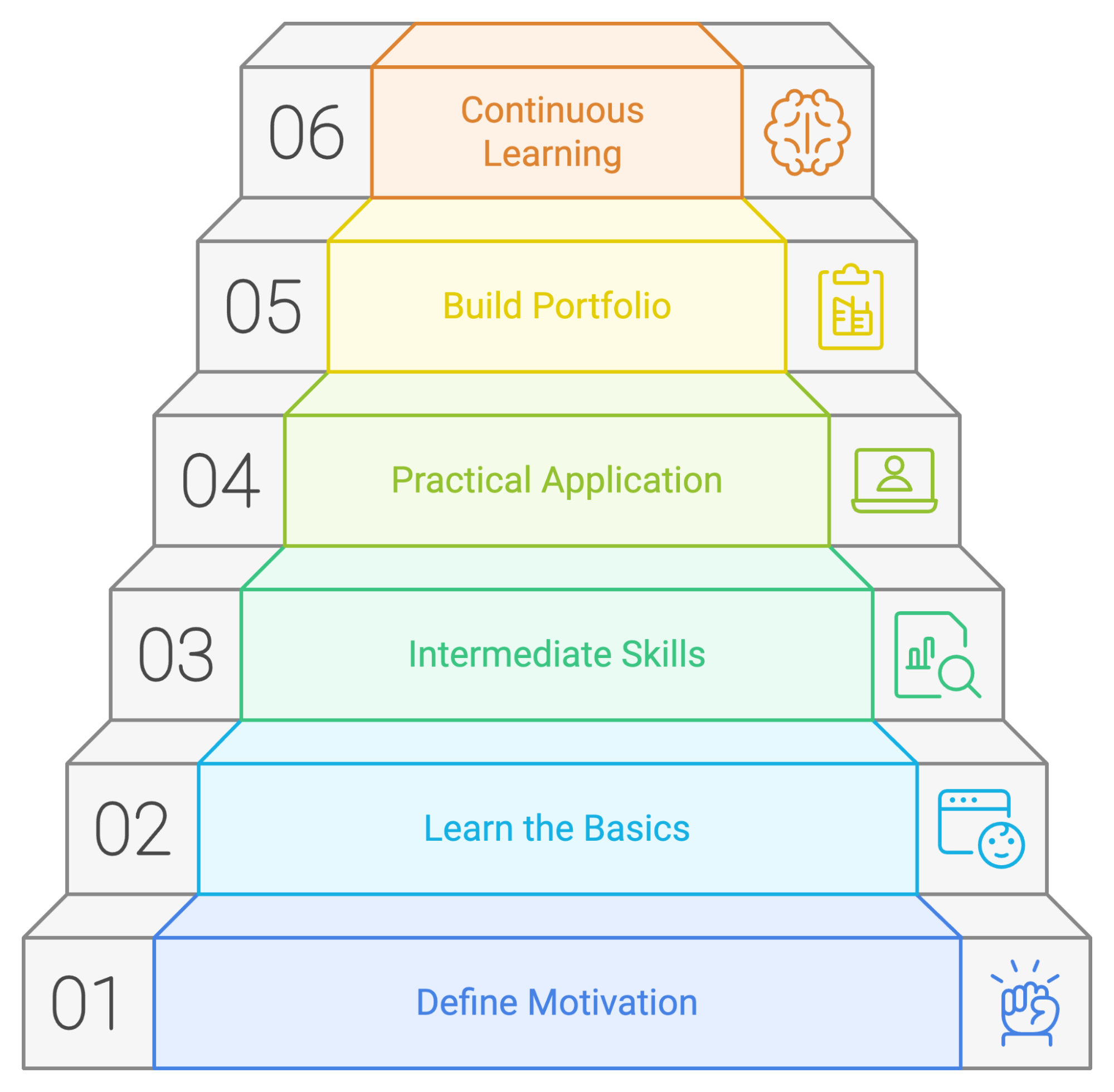

Hoe je PySpark vanaf nul leert in 2026

Als je PySpark methodisch leert, vergroot je je kans op succes. Laten we ons richten op een paar principes die je in je leertraject kunt toepassen.

1. Begrijp waarom je PySpark leert

Voordat je in de technische details duikt, bepaal je motivatie om PySpark te leren. Vraag jezelf af:

- Wat zijn mijn carrièredoelen?

- Is PySpark een skill die je nodig hebt om door te groeien in je huidige rol of je droombaan te bemachtigen?

- Welke kansen verwacht je dat openen als je PySpark beheerst?

- Welke problemen probeer ik op te lossen?

- Heb je moeite met het verwerken van grote datasets die je huidige tools niet aankunnen?

- Moet je complexe datatransformaties uitvoeren of geavanceerde ML-modellen bouwen?

- Wat interesseert mij?

- Word je enthousiast van het bouwen van schaalbare datapijplijnen?

- Ben je geïnteresseerd in big data en het potentieel om inzichten te ontsluiten?

- Heb ik een specifiek project in gedachten waarvoor PySpark nodig is?

- Werk je aan een persoonlijk project dat grootschalige dataverwerking of -analyse omvat?

- Heeft je bedrijf PySpark-expertise nodig voor een aankomend project?

2. Begin met de basis van PySpark

Nadat je je doelen hebt bepaald, beheers je de basis van PySpark en begrijp je hoe het werkt.

Python-basics

Omdat PySpark is gebouwd bovenop Python, moet je eerst vertrouwd raken met Python. Je moet je prettig voelen bij het werken met variabelen en functies. Het is ook handig om bekend te zijn met datamanipulatiebibliotheken zoals Pandas. DataCamps cursus Introduction to Python en Data Manipulation with Pandas helpen je snel op weg.

PySpark installeren en de basis leren

Je moet PySpark installeren om ermee aan de slag te gaan. Je kunt PySpark downloaden met pip of Conda, het handmatig downloaden van de officiële website, of starten met DataLab om direct in je browser met PySpark te werken.

Wil je een volledige uitleg over het opzetten van PySpark, bekijk dan deze handleiding over hoe je PySpark installeert op Windows, Mac en Linux.

PySpark DataFrames

Het eerste concept dat je moet leren is hoe PySpark DataFrames werken. Ze zijn een van de belangrijkste redenen waarom PySpark zo snel en efficiënt is. Begrijp hoe je ze maakt, transformeert (map en filter) en manipuleert. De tutorial over hoe je begint met PySpark helpt je met deze concepten.

3. Beheers gevorderde basisvaardigheden in PySpark

Als je je prettig voelt bij de basis, is het tijd om intermediate PySpark-skills te verkennen.

Spark SQL

Een van de grootste voordelen van PySpark is de mogelijkheid om SQL-achtige queries uit te voeren om DataFrames te lezen en te manipuleren, aggregaties uit te voeren en windowfuncties te gebruiken. Onder de motorkap gebruikt PySpark Spark SQL. Deze introductie tot Spark SQL in Python kan je hierbij helpen.

Data wrangling en transformatie

Werken met data betekent dat je vaardig wordt in het opschonen, transformeren en voorbereiden ervan voor analyse. Dit omvat het omgaan met missende waarden, verschillende datatypen en het uitvoeren van aggregaties met PySpark. Volg DataCamp's Cleaning Data with PySpark om praktische ervaring op te doen en deze skills te beheersen.

Machine learning met MLlib

Met PySpark kun je dankzij de MLlib-bibliotheek ook machinelearningmodellen ontwikkelen en deployen. Je zou feature engineering, model-evaluatie en hyperparameter-tuning met deze bibliotheek moeten leren. De cursus Machine Learning with PySpark van DataCamp biedt een uitgebreide introductie.

4. Leer PySpark door te doen

Cursussen volgen en oefeningen doen met PySpark is een uitstekende manier om vertrouwd te raken met de technologie. Maar om echt vaardig te worden, moet je uitdagende, skill-versterkende problemen oplossen, zoals je die in echte projecten tegenkomt. Begin met eenvoudige data-analysetaken en ga geleidelijk naar complexere uitdagingen.

Zo kun je je skills oefenen:

- Doe mee aan webinars en code-alongs. Bekijk de aankomende DataCamp-webinars en online events waar je PySpark-tutorials en codevoorbeelden kunt volgen. Dit helpt je concepten te versterken en vertrouwd te raken met codepatronen.

- Ontwikkel eigen projecten. Identificeer datasets die je interesseren en pas je PySpark-skills toe om ze te analyseren. Dit kan variëren van het analyseren van trends op social media tot het verkennen van financiële marktdata.

- Draag bij aan open source-projecten. Lever bijdragen aan PySpark-projecten op platforms zoals GitHub om ervaring op te doen met samenwerking en echte projecten.

- Bouw een persoonlijke blog. Schrijf over je PySpark-projecten, deel je inzichten en draag bij aan de PySpark-community met een eigen blog.

5. Bouw een portfolio met projecten

Terwijl je vordert in je PySpark-leertraject, rond je verschillende projecten af. Om je PySpark-skills en -ervaring aan potentiële werkgevers te tonen, moet je ze bundelen in een portfolio. Dit portfolio moet je skills en interesses weerspiegelen en afgestemd zijn op de carrière of sector die je ambieert.

Probeer originele projecten te maken die je probleemoplossend vermogen laten zien. Neem projecten op die je vaardigheid tonen in diverse aspecten van PySpark, zoals data wrangling, machine learning en datavisualisatie. Documenteer je projecten met context, methodologie, code en resultaten. Je kunt DataLab gebruiken, een online IDE waarmee je samen code kunt schrijven, data analyseren en inzichten delen.

Hier zijn twee PySpark-projecten waar je aan kunt werken:

6. Blijf jezelf uitdagen

PySpark leren is een continu traject. Technologie evolueert constant, en er worden regelmatig nieuwe features en toepassingen ontwikkeld. PySpark vormt daarop geen uitzondering.

Als je de fundamentals beheerst, kun je zoeken naar uitdagendere taken en projecten zoals performance-optimalisatie of GraphX. Richt je op je doelen en specialiseer je in gebieden die relevant zijn voor jouw carrière en interesses.

Blijf op de hoogte van nieuwe ontwikkelingen en leer hoe je die toepast in je huidige projecten. Blijf oefenen, zoek nieuwe uitdagingen en kansen, en omarm het idee dat fouten maken een manier is om te leren.

Laten we de stappen samenvatten voor een succesvol PySpark-leerplan:

Een voorbeeldleerplan voor PySpark

Hoewel iedereen op zijn eigen manier leert, is het altijd slim om een plan of leidraad te hebben bij het leren van een nieuwe tool. We hebben een mogelijk leerplan opgesteld met de focuspunten als je net begint met PySpark.

Maand 1: PySpark-basics

- Kernconcepten. Installeer PySpark en verken de syntax. Begrijp de kernconcepten van Apache Spark, de architectuur en hoe het gedistribueerde dataverwerking mogelijk maakt.

- PySpark-basis. Leer je PySpark-omgeving opzetten, SparkContexts en SparkSessions maken en verken basisdatastructuren zoals RDD's en DataFrames.

- Datamanipulatie. Beheers essentiële PySpark-bewerkingen voor datamanipulatie, waaronder filteren, sorteren, groeperen, aggregeren en joinen van datasets. Je kunt het project Cleaning Orders with PySpark voltooien.

Maand 2: PySpark voor data-analyse en SQL

- Werken met verschillende dataformaten: Leer data lezen en schrijven in diverse formaten, waaronder CSV, JSON, Parquet en Avro, met PySpark.

- Spark SQL. Leer Spark SQL gebruiken om data te bevragen en te analyseren met vertrouwde SQL-syntax. Verken concepten zoals DataFrames, Datasets en SQL-functies.

- Datavisualisatie en feature engineering: Verken technieken voor datavisualisatie in PySpark met bibliotheken zoals Matplotlib en Seaborn om inzichten uit je data te halen. Leer data wrangling en feature engineering met de cursus Feature Engineering with PySpark.

Maand 3-4: PySpark voor machine learning en gevorderde topics

- Introductie tot MLlib: Ga aan de slag met de MLlib-bibliotheek van PySpark voor machine learning. Verken basisalgoritmes voor classificatie, regressie en clustering. Je kunt de cursus Machine Learning with PySpark gebruiken.

- ML-pijplijnen bouwen. Leer ML-pijplijnen in PySpark te bouwen en te deployen voor efficiënte training en evaluatie van modellen.

- Ontwikkel een project. Werk aan het ontwikkelen van een Demand Forecasting Model.

- Gevorderde concepten. Verken technieken om PySpark-applicaties te optimaliseren, waaronder partitioneren van data, cachen en performance tuning.

Vijf tips om PySpark te leren

Ik kan me voorstellen dat je nu klaar bent om in PySpark te duiken en met een grote dataset aan de slag te gaan om te oefenen. Maar voordat je dat doet, licht ik graag deze tips uit die je helpen op weg naar PySpark-vaardigheid.

1. Beperk je scope

PySpark is een tool met veel verschillende toepassingen. Om gefocust te blijven en je doel te bereiken, moet je je interessegebied bepalen. Wil je je richten op data-analyse, data engineering of machine learning? Een gerichte aanpak helpt je de meest relevante aspecten en kennis van PySpark voor jouw pad op te doen.

2. Oefen vaak en consequent

Consistentie is de sleutel om een nieuwe skill te beheersen. Plan vaste tijd in om PySpark te oefenen. Een korte tijd per dag is voldoende. Je hoeft niet elke dag complexe concepten aan te pakken. Je kunt herhalen wat je hebt geleerd of een eenvoudige oefening opnieuw schrijven. Regelmatige oefening versterkt je begrip en bouwt je vertrouwen om het toe te passen.

3. Werk aan echte projecten

Dit is een van de belangrijkste tips, en je zult het meerdere keren in deze gids lezen. Oefeningen zijn geweldig om vertrouwen op te bouwen. Maar je PySpark-skills toepassen in echte projecten is wat je echt doet uitblinken. Zoek datasets die je interesseren en gebruik PySpark om ze te analyseren, inzichten te halen en problemen op te lossen.

Begin met simpele projecten en vragen en neem geleidelijk complexere aan. Dit kan zo eenvoudig zijn als het inlezen en opschonen van een echte dataset en het schrijven van een complexe query voor aggregaties en het voorspellen van de prijs van een huis.

4. Sluit je aan bij een community

Samen leren werkt vaak effectiever. Ervaringen delen en van anderen leren versnelt je voortgang en levert waardevolle inzichten op.

Om kennis, ideeën en vragen uit te wisselen, kun je je aansluiten bij groepen rond PySpark en meet-ups en conferenties bijwonen. De Databricks Community, het bedrijf opgericht door de makers van Spark, heeft een actief forum waar je kunt discussiëren en vragen stellen over PySpark. Daarnaast is de Spark Summit, georganiseerd door Databricks, de grootste Spark-conferentie.

5. Maak fouten

Zoals met elke technologie is PySpark leren een iteratief proces. En leren van je fouten is een essentieel onderdeel daarvan. Wees niet bang om te experimenteren, verschillende aanpakken te proberen en van je fouten te leren. Probeer verschillende functies en alternatieven voor het aggregeren van data, voer subqueries of geneste queries uit en merk op hoe snel PySpark reageert.

De beste manieren om PySpark te leren

Laten we een paar efficiënte methoden bespreken om PySpark te leren.

Volg online cursussen

Online cursussen zijn een uitstekende manier om PySpark in je eigen tempo te leren. DataCamp biedt PySpark-cursussen voor alle niveaus, die samen het Big Data with PySpark-track vormen. De cursussen behandelen introductieconcepten tot en met machine learning en zijn ontworpen met hands-on oefeningen.

Enkele PySpark-gerelateerde cursussen op DataCamp:

- Feature Engineering with PySpark

- Machine Learning with PySpark

- Building Recommendation Engines with PySpark

- Big Data Fundamentals with PySpark

Volg online tutorials

Tutorials zijn een andere geweldige manier om PySpark te leren, vooral als je nieuw bent met de technologie. Ze bevatten stapsgewijze instructies om specifieke taken uit te voeren of bepaalde concepten te begrijpen. Ter start, bekijk deze tutorials:

Bekijk PySpark-cheat sheets

Cheat sheets zijn handig als je snel een naslag nodig hebt over PySpark-onderwerpen. Hier zijn twee nuttige cheat sheets:

Rond PySpark-projecten af

PySpark leren vraagt om hands-on oefening. Je ontwikkelt je het snelst door uitdagingen in projecten aan te gaan waarin je al je geleerde skills toepast. Naarmate je complexere taken oppakt, moet je oplossingen vinden en alternatieven onderzoeken om de gewenste resultaten te behalen, wat je PySpark-expertise vergroot.

Bekijk de PySpark-projecten op DataCamp. Hiermee pas je je datamanipulatieskills en het bouwen van ML-modellen toe met PySpark:

Ontdek PySpark via boeken

Boeken zijn een uitstekend middel om PySpark te leren. Ze bieden diepgaande kennis en inzichten van experts, naast codefragmenten en uitleg. Enkele populaire boeken over PySpark:

- Learning PySpark 2nd Edition, Jules S. Damji

- PySpark Cookbook, Denny Lee

- The Spark for Python Developers

Carrières met PySpark

De vraag naar PySpark-skills is toegenomen in verschillende datarollen, van data-analist tot big data engineer. Als je je voorbereidt op een interview, overweeg dan deze PySpark-interviewvragen voor

Big data engineer

Als big data engineer ben je de architect van big data-oplossingen, verantwoordelijk voor het ontwerpen, bouwen en onderhouden van de infrastructuur die grote datasets verwerkt. Je vertrouwt op PySpark om schaalbare datapijplijnen te bouwen en zo efficiënte datainname, -verwerking en -opslag te garanderen.

Je hebt een sterke kennis nodig van gedistribueerd rekenen en cloudplatforms, en expertise in datawarehousing en ETL-processen.

- Belangrijke skills:

- Vaardig in Python en PySpark, Java en Scala

- Inzicht in datastructuren en algoritmen

- Vaardig in zowel SQL als NoSQL

- Expertise in ETL-processen en het bouwen van datapijplijnen

- Inzicht in gedistribueerde systemen

- Belangrijke tools:

- Apache Spark, Hadoop-ecosysteem

- Datawarehousingtools (bijv. Snowflake, Redshift of BigQuery)

- Cloudplatforms (bijv. AWS, GCP, Databricks)

- Workflow-orchestratie (bijv. Apache Airflow, Apache Kafka)

Data scientist

Als data scientist gebruik je de mogelijkheden van PySpark voor data wrangling en -manipulatie en voor het ontwikkelen en deployen van machinelearningmodellen. Je statistische kennis en programmeerskills helpen je modellen te ontwikkelen die bijdragen aan het beslissingsproces.

- Belangrijke skills:

- Sterke kennis van Python, PySpark en SQL

- Inzicht in machine learning- en AI-concepten

- Vaardig in statistische analyse, kwantitatieve analytics en voorspellend modelleren

- Datavisualisatie en rapportagetechnieken

- Effectieve communicatie en presentatieskills

- Belangrijke tools:

- Data-analysetools (bijv. pandas, NumPy)

- Machinelearningbibliotheken (bijv. Scikit-learn)

- Datavisualisatie (bijv. Matplotlib, Tableau)

- Big data-frameworks (bijv. Airflow, Spark)

- Commandlinetools (bijv. Git, Bash)

Machine learning engineer

Als machine learning engineer gebruik je PySpark om data voor te bereiden, ML-modellen te bouwen en te trainen en te deployen.

- Belangrijke skills:

- Vaardig in Python, PySpark en SQL

- Diepgaand begrip van ML-algoritmen

- Kennis van deep learning-frameworks

- Inzicht in datastructuren, datamodellering en softwarearchitectuur

- Belangrijke tools:

- ML-bibliotheken en -algoritmen (bijv. Scikit-learn, TensorFlow)

- Data science-bibliotheken (bijv. Pandas, NumPy)

- Cloudplatforms (bijv. AWS, Google Cloud Platform)

- Versiebeheer (bijv. Git)

- Deep learning-frameworks (bijv. TensorFlow, Keras, PyTorch)

Data-analist

Als data-analist gebruik je PySpark om grote datasets te verkennen en te analyseren, trends te identificeren en je bevindingen te communiceren via rapporten en visualisaties.

- Belangrijke skills:

- Vaardig in Python, PySpark en SQL

- Sterke kennis van statistische analyse

- Ervaring met BI-tools (bijv. Tableau, Power BI)

- Inzicht in dataverzameling en opschoningstechnieken

- Belangrijke tools:

- Data-analysetools (bijv. pandas, NumPy)

- Business intelligence-tools (bijv. Tableau, Power BI)

- SQL-databases (bijv. MySQL, PostgreSQL)

|

Rol |

Wat je doet |

Jouw key skills |

Tools die je gebruikt |

|

Big Data Engineer |

Ontwerpt, bouwt en onderhoudt de infrastructuur voor het verwerken van grote datasets. |

Python, PySpark, Java en Scala, datastructuren, SQL en NoSQL, ETL, gedistribueerde systemen |

Apache Spark, Hadoop, datawarehousingtools, cloudplatforms, workflow-orchestratie |

|

Data Scientist |

Onthult verborgen patronen en haalt waardevolle inzichten uit data. Past statistische kennis en programmeerskills toe om modellen te bouwen die beslissingen ondersteunen. |

Python, PySpark, SQL, machine learning, AI-concepten, statistische analyse, voorspellend modelleren, datavisualisatie, effectieve communicatie |

Pandas, NumPy, Scikit-learn, Keras, Matplotlib, plotly, Airflow, Spark, Git |

|

Machine Learning Engineer |

Ontwerpt, ontwikkelt en deployt ML-systemen die voorspellingen doen op basis van bedrijfsdata. |

Python, PySpark en SQL, ML-algoritmen, deep learning, datastructuren, datamodellering en softwarearchitectuur |

Scikit-learn, TensorFlow, Keras, PyTorch, Pandas, NumPy, AWS, Google Cloud Platform, Git |

|

Data Analyst |

Slaat de brug tussen ruwe data en bruikbare businessinzichten. Communiceert bevindingen via rapporten en visualisaties. |

Python, PySpark en SQL, statistische analyse, datavisualisatie, dataverzameling en opschoningstechnieken |

Pandas, NumPy, Tableau, PowerBI, MySQL, PostgreSQL. |

Hoe vind je een baan waarin PySpark wordt gebruikt of met PySpark

Een diploma kan een groot pluspunt zijn als je begint aan een carrière waarin PySpark wordt gebruikt, maar het is niet de enige route. Tegenwoordig stappen steeds meer professionals in data-gerelateerde rollen via alternatieve paden, waaronder een overstap vanuit andere vakgebieden. Met toewijding, consistent leren en een proactieve houding kun je je droombaan bemachtigen waarin PySpark wordt gebruikt.

Blijf leren over het vakgebied

Blijf op de hoogte van de laatste ontwikkelingen in PySpark. Volg invloedrijke professionals die met PySpark werken op social media, lees PySpark-gerelateerde blogs en luister naar PySpark-podcasts.

PySpark is ontwikkeld door Matei Zaharia, die ook CTO is bij Databricks, een platform bovenop Apache Spark. Zo krijg je inzicht in trending topics, opkomende technologieën en de toekomstige richting van PySpark.

Bekijk ook branche-events, of het nu webinars bij DataCamp, data science- en AI-conferenties of netwerkbijeenkomsten zijn.

Bouw een portfolio

Je moet opvallen tussen andere kandidaten. Een goede manier is een sterk portfolio op te bouwen dat je skills en afgeronde projecten toont. Je maakt indruk op hiring managers door echte uitdagingen aan te pakken.

Je portfolio moet diverse projecten bevatten die je PySpark-expertise en de verschillende toepassingen ervan weerspiegelen. Bekijk deze gids over hoe je een indrukwekkend data science-portfolio maakt.

Maak een effectief cv

De laatste jaren stappen steeds meer mensen over naar data science en data-gerelateerde rollen. Hiring managers moeten honderden cv's beoordelen en uitstekende kandidaten onderscheiden. Ook gaat je cv vaak door Applicant Tracking Systems (ATS), geautomatiseerde systemen die cv's scannen en afwijzen die niet aan specifieke criteria voldoen. Bouw dus een sterk cv dat zowel ATS als recruiters overtuigt.

Bereid je voor op het interview

Als je opvalt bij de hiring manager of je effectieve cv door de selectie komt, moet je je voorbereiden op een technisch interview. Lees hiervoor dit artikel met topvragen voor PySpark-interviews.

Conclusie

PySpark leren kan deuren openen naar betere kansen en carrièreperspectieven. Het pad is lonend maar vraagt consistentie en hands-on oefening. Experimenteren en uitdagingen oplossen met deze tool versnelt je leerproces en levert echte voorbeelden op die je kunt tonen tijdens je zoektocht naar een baan.

FAQs

Wat zijn de belangrijkste features van PySpark?

PySpark biedt een gebruiksvriendelijke Python-API voor het benutten van Spark, met snelheid, schaalbaarheid en ondersteuning voor SQL, machine learning en streamverwerking voor grote datasets.

Waarom groeit de vraag naar PySpark-skills?

Het gebruiksgemak, de schaalbaarheid en de veelzijdigheid van PySpark voor big data-verwerking en machine learning zorgen voor de groeiende vraag naar deze skills.

Waarop moet je letten om PySpark te leren?

Focus op Python-basics, de kernconcepten van Spark en technieken voor datamanipulatie, en verken geavanceerde topics zoals Spark SQL en MLlib.

Wat zijn manieren om PySpark te leren?

Volg online cursussen en tutorials, werk met real-world datasets, gebruik cheat sheets en ontdek PySpark via boeken.

Welke rollen gebruiken PySpark?

Enkele rollen die PySpark gebruiken zijn: big data engineer, machine learning engineer, data scientist en data-analist.