Corso

Si stima che ogni giorno vengano creati circa 328,77 milioni di terabyte di dati. Ogni clic e ogni acquisto generano dati che, con gli strumenti giusti, possono essere trasformati in insight e previsioni significativi.

Però, per elaborare una tale quantità di dati abbiamo bisogno di una libreria ad alte prestazioni. È qui che entra in gioco PySpark.

In questa guida esploreremo come imparare PySpark da zero. Ti aiuterò a creare un piano di apprendimento, condividerò i miei migliori consigli per impararlo in modo efficace e ti fornirò risorse utili per trovare ruoli che richiedono PySpark.

Che cos'è PySpark?

PySpark è l'unione di due tecnologie potenti: Python e Apache Spark.

Python è uno dei linguaggi di programmazione più utilizzati nello sviluppo software, in particolare per data science e machine learning, soprattutto per la sua sintassi semplice e immediata.

Dall'altro lato, Apache Spark è un framework in grado di gestire grandi quantità di dati non strutturati. Spark è stato costruito con Scala, un linguaggio che offre maggiore controllo. Tuttavia, Scala non è particolarmente popolare tra chi lavora con i dati. Così è nato PySpark per colmare questo gap.

PySpark offre un'API e un'interfaccia intuitiva per interagire con Spark. Sfrutta la semplicità e la flessibilità di Python per rendere l'elaborazione dei big data accessibile a un pubblico più ampio.

Cosa rende PySpark popolare?

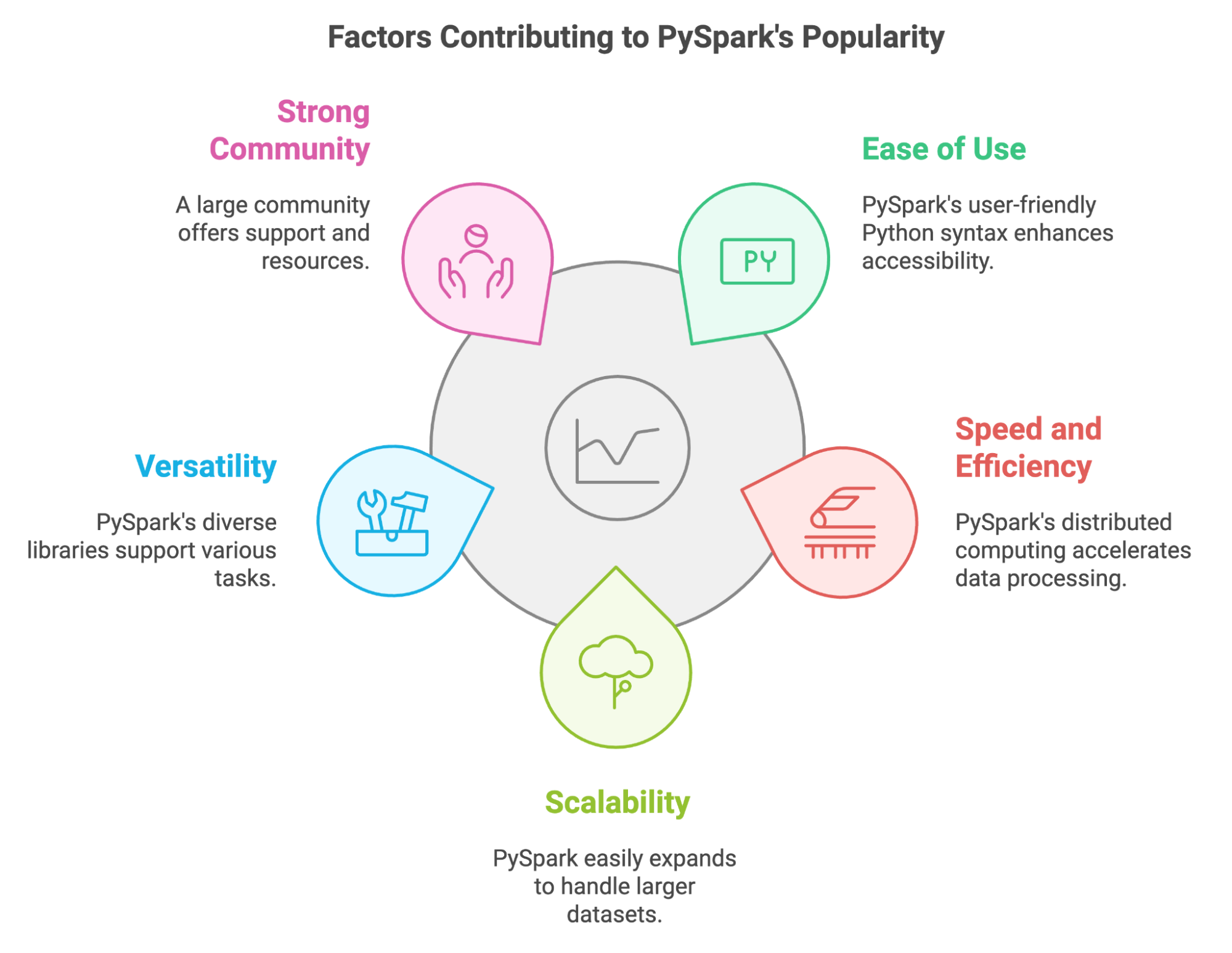

Negli ultimi anni, PySpark è diventato uno strumento importante per i professionisti dei dati che devono elaborare enormi quantità di informazioni. Possiamo spiegare la sua popolarità con diversi fattori chiave:

- Facilità d'uso: PySpark utilizza la sintassi familiare di Python, rendendolo più accessibile a professionisti dei dati come noi.

- Velocità ed efficienza: Distribuendo i calcoli su cluster di macchine, PySpark gestisce dataset enormi ad alta velocità.

- Scalabilità: PySpark si adatta a volumi di dati in crescita, permettendoci di scalare le applicazioni aggiungendo risorse computazionali.

- Versatilità: Offre un ampio ecosistema di librerie per diversi compiti, dalla manipolazione dei dati al machine learning.

- Community solida: Possiamo contare su una community ampia e attiva che ci fornisce supporto e risorse quando affrontiamo problemi e sfide.

PySpark ci permette anche di sfruttare le competenze e le librerie già esistenti in Python. Possiamo integrarlo facilmente con strumenti popolari come Pandas e Scikit-learn, e consente di utilizzare diverse fonti di dati.

Funzionalità principali di PySpark

PySpark è stato creato appositamente per i big data e gli sviluppi di machine learning. Ma quali caratteristiche lo rendono uno strumento potente per gestire enormi quantità di dati? Diamo un'occhiata:

- Resilient Distributed Datasets (RDD): Sono le strutture dati fondamentali dietro PySpark. Grazie ad esse, trasformazioni, filtraggi e aggregazioni dei dati possono essere eseguiti in parallelo.

- DataFrame e SQL: In PySpark, i DataFrame rappresentano un livello di astrazione più alto costruito sopra gli RDD. Possiamo usarli con Spark SQL e query per effettuare manipolazioni e analisi dei dati.

- Librerie di machine learning: Con la libreria MLlib di PySpark possiamo costruire e utilizzare modelli di machine learning scalabili per compiti come classificazione e regressione.

- Supporto a diversi formati di dati: PySpark fornisce librerie e API per leggere, scrivere ed elaborare dati in vari formati come CSV, JSON, Parquet e Avro, tra gli altri.

- Tolleranza ai guasti: PySpark tiene traccia di ogni RDD. Se un nodo fallisce durante l'esecuzione, PySpark ricostruisce la partizione RDD persa utilizzando tali informazioni di tracciamento. Il rischio di perdita di dati è quindi minimo.

- Elaborazione in memoria: PySpark memorizza i dati intermedi in memoria, riducendo la necessità di operazioni su disco e migliorando le prestazioni di elaborazione.

- Streaming ed elaborazione in tempo reale: Possiamo sfruttare il componente Spark Streaming per elaborare flussi di dati in tempo reale ed eseguire analisi near real-time.

Perché imparare PySpark è così utile?

Il volume dei dati è in continua crescita. Oggi, data wrangling, analisi dei dati e attività di machine learning implicano il lavoro con grandi quantità di informazioni. Dobbiamo usare strumenti potenti che elaborino quei dati in modo efficiente e rapido. PySpark è tra questi strumenti.

PySpark ha molte applicazioni

Abbiamo già menzionato i punti di forza di PySpark, ma vediamo alcuni esempi specifici di dove puoi usarli:

- ETL dei dati. La capacità di PySpark di pulire e trasformare i dati in modo efficiente è utilizzata per elaborare dati di sensori e log di produzione in manifattura e logistica.

- Machine learning. La libreria MLlib è usata per sviluppare e distribuire modelli per raccomandazioni personalizzate, segmentazione dei clienti e previsione delle vendite nell'e-commerce.

- Elaborazione di grafi. Le GraphFrames di PySpark sono utilizzate per analizzare i social network e comprendere le relazioni tra gli utenti.

- Stream processing. La Structured Streaming API di PySpark abilita l'elaborazione in tempo reale delle transazioni finanziarie per individuare frodi.

- Elaborazione dati con SQL. L'interfaccia SQL di PySpark semplifica a ricercatori e analisti in ambito sanitario l'interrogazione e l'analisi di grandi dataset genomici.

C'è domanda di competenze in PySpark

Con l'ascesa della data science e del machine learning e l'aumento dei dati disponibili, c'è una forte domanda di professionisti con competenze di manipolazione dei dati. Secondo il The State of Data & AI Literacy Report 2024, l'80% dei leader valuta le competenze di analisi e manipolazione dei dati.

Imparare PySpark può aprire un'ampia gamma di opportunità di carriera. Oltre 800 offerte di lavoro su Indeed, dai data engineer ai data scientist, evidenziano la richiesta di competenze in PySpark nelle posizioni legate ai dati.

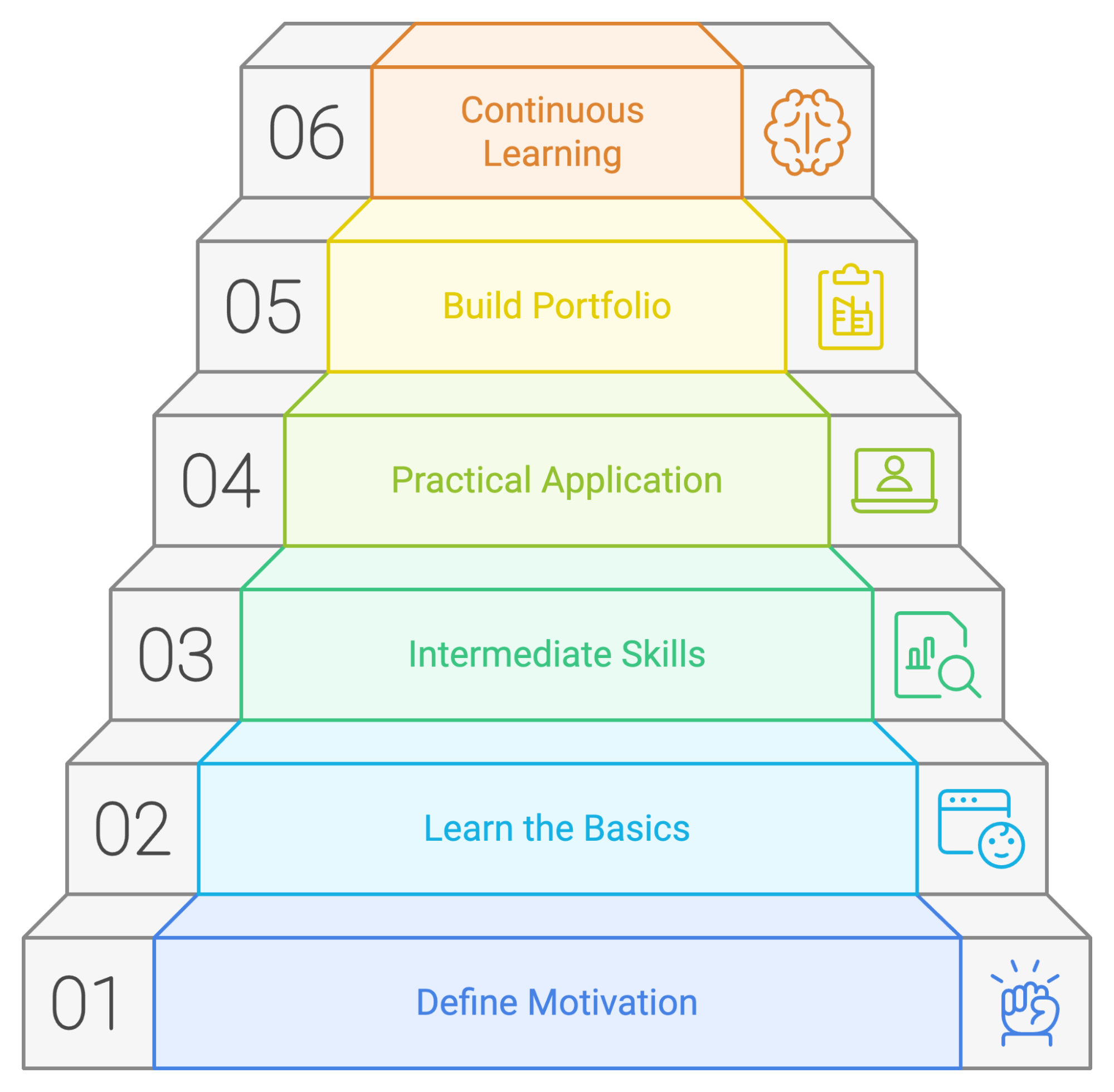

Come imparare PySpark da zero nel 2026

Se impari PySpark in modo metodico, hai più possibilità di successo. Concentrati su alcuni principi che puoi applicare nel tuo percorso di apprendimento.

1. Capisci perché stai imparando PySpark

Prima di passare ai dettagli tecnici, definisci la tua motivazione per imparare PySpark. Chiediti:

- Quali sono i miei obiettivi di carriera?

- PySpark è una competenza di cui hai bisogno per crescere nel ruolo attuale o per ottenere il lavoro dei tuoi sogni?

- Quali opportunità ti aspetti si aprano se padroneggi PySpark?

- Quali problemi sto cercando di risolvere?

- Hai difficoltà a elaborare grandi dataset che gli strumenti che conosci non riescono a gestire?

- Devi eseguire trasformazioni di dati complesse o costruire modelli avanzati di machine learning?

- Cosa mi interessa?

- Ti entusiasma l'idea di costruire pipeline dati scalabili?

- Ti interessano i big data e il loro potenziale nel far emergere insight?

- Ho in mente un progetto specifico che richieda le capacità di PySpark?

- Stai lavorando a un progetto personale che coinvolge elaborazione o analisi di dati su larga scala?

- La tua azienda avrà bisogno di competenze PySpark in un progetto imminente?

2. Parti dalle basi di PySpark

Dopo aver individuato i tuoi obiettivi, padroneggia le basi di PySpark e capisci come funzionano.

Fondamenti di Python

Poiché PySpark è costruito su Python, prima di usarlo devi familiarizzare con Python. Dovresti sentirti a tuo agio con variabili e funzioni. Inoltre, può essere utile conoscere librerie per la manipolazione dei dati come Pandas. I corsi di DataCamp Introduzione a Python e Data Manipulation with Pandas possono aiutarti a metterti in pari.

Installare PySpark e imparare le basi

Devi installare PySpark per iniziare a usarlo. Puoi scaricarlo con pip o Conda, scaricarlo manualmente dal sito ufficiale oppure iniziare con DataLab per usare PySpark direttamente nel browser.

Se vuoi una spiegazione completa della configurazione di PySpark, consulta questa guida su come installare PySpark su Windows, Mac e Linux.

PySpark DataFrame

Il primo concetto da apprendere è come funzionano i DataFrame di PySpark. Sono uno dei motivi principali per cui PySpark è così veloce ed efficiente. Capisci come crearli, trasformarli (map e filter) e manipolarli. Il tutorial su come iniziare a lavorare con PySpark ti aiuterà con questi concetti.

3. Padroneggia le competenze intermedie di PySpark

Una volta che hai confidenza con le basi, è il momento di esplorare le competenze intermedie di PySpark.

Spark SQL

Uno dei maggiori vantaggi di PySpark è la possibilità di eseguire query di tipo SQL per leggere e manipolare DataFrame, effettuare aggregazioni e usare funzioni finestra. Dietro le quinte, PySpark utilizza Spark SQL. Questa introduzione a Spark SQL in Python può aiutarti con questa competenza.

Data wrangling e trasformazione

Lavorare con i dati significa diventare abili nel pulirli, trasformarli e prepararli per l'analisi. Ciò include la gestione dei valori mancanti, dei diversi tipi di dato e l'esecuzione di aggregazioni con PySpark. Segui il corso Cleaning Data with PySpark di DataCamp per fare pratica e padroneggiare queste abilità.

Machine learning con MLlib

PySpark può essere usato anche per sviluppare e distribuire modelli di machine learning grazie alla sua libreria MLlib. Dovresti imparare a eseguire feature engineering, valutazione dei modelli e tuning degli iperparametri con questa libreria. Il corso di DataCamp Machine Learning with PySpark offre un'introduzione completa.

4. Impara PySpark facendolo

Seguire corsi ed esercitarti con PySpark è un ottimo modo per familiarizzare con la tecnologia. Tuttavia, per diventare davvero competente in PySpark, devi risolvere problemi sfidanti che fanno crescere le competenze, simili a quelli dei progetti reali. Puoi iniziare con semplici attività di analisi e passare gradualmente a sfide più complesse.

Ecco alcuni modi per esercitare le tue abilità:

- Partecipa a webinar e code-along. Controlla i prossimi webinar di DataCamp e gli eventi online in cui puoi seguire tutorial PySpark ed esempi di codice. Ti aiuterà a consolidare i concetti e a familiarizzare con i pattern di codice.

- Sviluppa progetti indipendenti. Individua dataset che ti interessano e applica le tue competenze PySpark per analizzarli. Può trattarsi di tutto: dall'analisi dei trend sui social media all'esplorazione dei dati dei mercati finanziari.

- Contribuisci a progetti open source. Contribuisci a progetti PySpark su piattaforme come GitHub per fare esperienza di collaborazione e lavoro su progetti reali.

- Crea un blog personale. Scrivi dei tuoi progetti PySpark, condividi insight e contribuisci alla community PySpark creando un blog personale.

5. Crea un portfolio di progetti

Man mano che avanzi nel tuo percorso di apprendimento su PySpark, completerai diversi progetti. Per mostrare a potenziali datori di lavoro le tue competenze ed esperienza con PySpark, dovresti raccoglierli in un portfolio. Questo portfolio dovrebbe riflettere le tue abilità e i tuoi interessi ed essere allineato alla carriera o al settore che ti interessa.

Cerca di rendere i tuoi progetti originali e mostra le tue capacità di problem solving. Includi progetti che dimostrino la tua padronanza di vari aspetti di PySpark, come data wrangling, machine learning e data visualization. Documenta i progetti fornendo contesto, metodologia, codice e risultati. Puoi usare DataLab, un IDE online che ti consente di scrivere codice, analizzare dati in modo collaborativo e condividere i tuoi insight.

Ecco due progetti PySpark su cui puoi lavorare:

6. Continua a metterti alla prova

Imparare PySpark è un percorso continuo. La tecnologia evolve costantemente e nuove funzionalità e applicazioni vengono sviluppate regolarmente. PySpark non fa eccezione.

Una volta padroneggiate le basi, puoi cercare compiti e progetti più sfidanti come l'ottimizzazione delle prestazioni o GraphX. Rimani concentrato sui tuoi obiettivi e specializzati nelle aree rilevanti per i tuoi interessi e la tua carriera.

Rimani aggiornato sugli sviluppi e impara ad applicarli ai tuoi progetti attuali. Continua a esercitarti, cerca nuove sfide e opportunità e accetta l'idea di sbagliare come modo per imparare.

Ricapitoliamo i passaggi per un piano di apprendimento PySpark di successo:

Un esempio di piano di apprendimento PySpark

Anche se ognuno ha il proprio modo di imparare, è sempre una buona idea avere un piano o una guida da seguire per apprendere un nuovo strumento. Abbiamo creato un possibile piano di apprendimento che indica dove concentrare tempo ed energie se stai iniziando con PySpark.

Mese 1: fondamenti di PySpark

- Concetti chiave. Installa PySpark ed esplorane la sintassi. Comprendi i concetti base di Apache Spark, la sua architettura e come abilita l'elaborazione distribuita dei dati.

- Basi di PySpark. Impara a configurare l'ambiente PySpark, creare SparkContext e SparkSession ed esplorare strutture dati di base come RDD e DataFrame.

- Manipolazione dei dati. Padroneggia le operazioni essenziali di PySpark per la manipolazione dei dati, tra cui filtraggio, ordinamento, raggruppamento, aggregazione e join di dataset. Puoi completare il progetto Cleaning Orders with PySpark.

Mese 2: PySpark per l'analisi dei dati e SQL

- Lavorare con diversi formati di dati: Impara a leggere e scrivere dati in vari formati, tra cui CSV, JSON, Parquet e Avro, usando PySpark.

- Spark SQL. Impara a usare Spark SQL per interrogare e analizzare i dati con una sintassi SQL familiare. Esplora concetti come DataFrame, Dataset e funzioni SQL.

- Data visualization e feature engineering: Esplora tecniche di visualizzazione dei dati in PySpark usando librerie come Matplotlib e Seaborn per ottenere insight. Impara a fare wrangling dei dati ed eseguire feature engineering seguendo il corso Feature Engineering with PySpark.

Mese 3-4: PySpark per il machine learning e argomenti avanzati

- Introduzione a MLlib: Inizia con la libreria MLlib di PySpark per il machine learning. Esplora algoritmi di base per classificazione, regressione e clustering. Puoi usare il corso Machine Learning with PySpark.

- Costruzione di pipeline ML. Impara a creare e distribuire pipeline di machine learning in PySpark per un training e una valutazione efficienti dei modelli.

- Sviluppa un progetto. Lavora allo sviluppo di un Demand Forecasting Model.

- Concetti avanzati. Esplora tecniche per ottimizzare le applicazioni PySpark, tra cui partizionamento dei dati, caching e tuning delle prestazioni.

Cinque consigli per imparare PySpark

Immagino che ormai tu sia pronto a tuffarti nell'apprendimento di PySpark e a mettere le mani su un grande dataset per esercitare la tua nuova competenza. Ma prima, lascia che evidenzi questi consigli che ti aiuteranno a percorrere la strada verso la padronanza di PySpark.

1. Restringi il campo

PySpark è uno strumento che può avere molte applicazioni diverse. Per mantenere il focus e raggiungere l'obiettivo, dovresti identificare la tua area di interesse. Vuoi concentrarti su analisi dei dati, data engineering o machine learning? Un approccio mirato ti aiuta a ottenere gli aspetti e le conoscenze più rilevanti di PySpark per il percorso scelto.

2. Esercitati spesso e con costanza

La costanza è la chiave per padroneggiare qualsiasi nuova competenza. Dovresti ritagliarti del tempo dedicato per esercitarti con PySpark. Anche poco ogni giorno va bene. Non serve affrontare concetti complessi quotidianamente. Puoi rivedere ciò che hai imparato o riprendere un esercizio semplice per rifattorizzarlo. La pratica regolare rafforzerà la comprensione dei concetti e aumenterà la fiducia nell'applicarli.

3. Lavora su progetti reali

Questo è uno dei consigli chiave, e lo leggerai più volte in questa guida. Esercitarsi con gli esercizi è ottimo per prendere confidenza. Tuttavia, applicare le tue competenze PySpark a progetti reali è ciò che ti farà eccellere. Cerca dataset che ti interessano e usa PySpark per analizzarli, estrarre insight e risolvere problemi.

Inizia con progetti e domande semplici e passa gradualmente a quelli più complessi. Può essere qualcosa di semplice, come leggere e pulire un dataset reale e scrivere una query complessa per fare aggregazioni e prevedere il prezzo di una casa.

4. Entra in una community

Spesso imparare insieme è più efficace. Condividere le esperienze e apprendere dagli altri può accelerare i tuoi progressi e offrire insight preziosi.

Per scambiare conoscenze, idee e domande, puoi unirti a gruppi legati a PySpark e partecipare a meet-up e conferenze. La Databricks Community, l'azienda fondata dai creatori di Spark, ha un forum attivo dove puoi discutere e fare domande su PySpark. Inoltre, lo Spark Summit, organizzato da Databricks, è la più grande conferenza su Spark.

5. Sbaglia

Come per qualsiasi altra tecnologia, imparare PySpark è un processo iterativo. E imparare dai propri errori è una parte essenziale del percorso. Non avere paura di sperimentare, provare approcci diversi e imparare dagli errori. Prova funzioni e alternative diverse per aggregare i dati, esegui sottoquery o query annidate e osserva la rapidità di risposta che PySpark offre.

I modi migliori per imparare PySpark

Vediamo alcuni metodi efficaci per imparare PySpark.

Segui corsi online

I corsi online sono un ottimo modo per imparare PySpark ai tuoi ritmi. DataCamp offre corsi PySpark per tutti i livelli, che insieme compongono il percorso Big Data with PySpark. I corsi coprono concetti introduttivi fino a temi di machine learning e sono progettati con esercizi pratici.

Ecco alcuni dei corsi su PySpark presenti su DataCamp:

- Feature Engineering with PySpark

- Machine Learning with PySpark

- Building Recommendation Engines with PySpark

- Big Data Fundamentals with PySpark

Segui tutorial online

I tutorial sono un altro ottimo modo per imparare PySpark, soprattutto se sei alle prime armi con la tecnologia. Contengono istruzioni passo passo su come eseguire compiti specifici o comprendere determinati concetti. Per iniziare, considera questi tutorial:

Consulta le cheat sheet di PySpark

Le cheat sheet sono utili quando ti serve una guida rapida di riferimento su argomenti PySpark. Ecco due cheat sheet utili:

Completa progetti PySpark

Imparare PySpark richiede pratica concreta. Affrontare sfide completando progetti ti permetterà di applicare tutte le competenze acquisite. Quando inizi a occuparti di compiti più complessi, dovrai trovare soluzioni e ricercare nuove alternative per ottenere i risultati desiderati, migliorando la tua esperienza con PySpark.

Cerca i progetti PySpark su cui lavorare su DataCamp. Ti permettono di applicare le tue competenze di manipolazione dei dati e di costruzione di modelli di machine learning sfruttando PySpark:

Scopri PySpark tramite i libri

I libri sono un'ottima risorsa per imparare PySpark. Offrono conoscenze approfondite e insight da parte di esperti insieme a frammenti di codice e spiegazioni. Ecco alcuni dei libri più popolari su PySpark:

- Learning PySpark 2nd Edition, Jules S. Damji

- PySpark Cookbook, Denny Lee

- The Spark for Python Developers

Carriere con PySpark

La domanda di competenze PySpark è aumentata in diversi ruoli legati ai dati, dai data analyst ai big data engineer. Se ti stai preparando per un colloquio, considera queste domande su PySpark per

Big data engineer

Come big data engineer, sei l'architetto delle soluzioni big data, responsabile della progettazione, costruzione e manutenzione dell'infrastruttura che gestisce grandi dataset. Farai affidamento su PySpark per creare pipeline dati scalabili, garantendo un'acquisizione, un'elaborazione e un'archiviazione efficienti.

Ti servirà una solida comprensione del computing distribuito e delle piattaforme cloud, oltre a competenze in data warehousing e processi ETL.

- Competenze chiave:

- Padronanza di Python e PySpark, Java e Scala

- Comprensione di strutture dati e algoritmi

- Padronanza di SQL e NoSQL

- Competenza in processi ETL e costruzione di pipeline dati

- Comprensione dei sistemi distribuiti

- Strumenti chiave utilizzati:

- Apache Spark, ecosistema Hadoop

- Strumenti di Data Warehousing (ad es. Snowflake, Redshift o BigQuery)

- Piattaforme cloud (ad es. AWS, GCP, Databricks)

- Strumenti di orchestrazione dei workflow (ad es. Apache Airflow, Apache Kafka)

Data scientist

Come data scientist, utilizzerai le capacità di PySpark per fare data wrangling e manipolazione e per sviluppare e distribuire modelli di machine learning. Le tue conoscenze statistiche e le tue competenze di programmazione ti aiuteranno a sviluppare modelli che contribuiscono al processo decisionale.

- Competenze chiave:

- Ottima conoscenza di Python, PySpark e SQL

- Comprensione di concetti di machine learning e IA

- Padronanza di analisi statistica, analytics quantitativa e modellazione predittiva

- Tecniche di visualizzazione dei dati e reporting

- Abilità di comunicazione ed esposizione efficaci

- Strumenti chiave utilizzati:

- Strumenti di analisi dei dati (ad es., pandas, NumPy)

- Librerie di machine learning (ad es., Scikit-learn)

- Strumenti di visualizzazione dei dati (ad es., Matplotlib, Tableau)

- Framework big data (ad es., Airflow, Spark)

- Strumenti da riga di comando (ad es., Git, Bash)

Machine learning engineer

Come machine learning engineer, userai PySpark per preparare i dati, costruire modelli di machine learning e addestrarli e distribuirli.

- Competenze chiave:

- Padronanza di Python, PySpark e SQL

- Profonda comprensione degli algoritmi di machine learning

- Conoscenza dei framework di deep learning

- Comprensione di strutture dati, data modeling e architettura software

- Strumenti chiave utilizzati:

- Librerie e algoritmi di machine learning (ad es., Scikit-learn, TensorFlow)

- Librerie di data science (ad es., Pandas, NumPy)

- Piattaforme cloud (ad es., AWS, Google Cloud Platform)

- Sistemi di controllo versione (ad es., Git)

- Framework di deep learning (ad es., TensorFlow, Keras, PyTorch)

Data analyst

Come data analyst, userai PySpark per esplorare e analizzare grandi dataset, identificare trend e comunicare i risultati tramite report e visualizzazioni.

- Competenze chiave:

- Padronanza di Python, PySpark e SQL

- Solida conoscenza di analisi statistica

- Esperienza con strumenti di business intelligence (ad es., Tableau, Power BI)

- Comprensione delle tecniche di raccolta e pulizia dei dati

- Strumenti chiave utilizzati:

- Strumenti di analisi dei dati (ad es., pandas, NumPy)

- Strumenti di business intelligence (ad es., Tableau, Power BI)

- Database SQL (ad es., MySQL, PostgreSQL)

|

Ruolo |

Cosa fai |

Le tue competenze chiave |

Strumenti che usi |

|

Big Data Engineer |

Progetta, costruisce e mantiene l'infrastruttura per gestire grandi dataset. |

Python, PySpark, Java e Scala, strutture dati, SQL e NoSQL, ETL, sistemi distribuiti |

Apache Spark, Hadoop, strumenti di Data Warehousing, piattaforme cloud, strumenti di orchestrazione dei workflow |

|

Data Scientist |

Scopre pattern nascosti ed estrae insight di valore dai dati. Applica conoscenze statistiche e competenze di programmazione per costruire modelli che aiutano nel decision-making. |

Python, PySpark, SQL, machine learning, concetti di IA, analisi statistica, modellazione predittiva, visualizzazione dei dati, comunicazione efficace |

Pandas, NumPy, Scikit-learn, Keras, Matplotlib, plotly, Airflow, Spark, Git |

|

Machine Learning Engineer |

Progetta, sviluppa e distribuisce sistemi di machine learning per effettuare previsioni utilizzando i dati aziendali. |

Python, PySpark e SQL, algoritmi di machine learning, deep learning, strutture dati, data modeling e architettura software |

Scikit-learn, TensorFlow, Keras, PyTorch, Pandas, NumPy, AWS, Google Cloud Platform, Git |

|

Data Analyst |

Colma il divario tra dati grezzi e insight azionabili per il business. Comunica i risultati tramite report e visualizzazioni. |

Python, PySpark e SQL, analisi statistica, visualizzazione dei dati, tecniche di raccolta e pulizia dei dati |

Pandas, NumPy, Tableau, PowerBI, MySQL, PostgreSQL. |

Come trovare un lavoro che usa PySpark o in PySpark

Una laurea può essere un grande vantaggio per iniziare una carriera che utilizza PySpark, ma non è l'unica strada. Oggi, un numero crescente di professionisti inizia a lavorare in ruoli legati ai dati tramite percorsi alternativi, inclusi passaggi da altri settori. Con dedizione, apprendimento costante e un approccio proattivo, puoi ottenere il lavoro dei tuoi sogni che usa PySpark.

Continua a informarti sul settore

Rimani aggiornato sugli ultimi sviluppi di PySpark. Segui sui social professionisti influenti coinvolti in PySpark, leggi blog dedicati e ascolta podcast sull'argomento.

PySpark è stato sviluppato da Matei Zaharia, che è anche CTO di Databricks, una piattaforma costruita sopra Apache Spark. Otterrai insight su temi di tendenza, tecnologie emergenti e la direzione futura di PySpark.

Dovresti anche tenere d'occhio gli eventi del settore, siano essi webinar su DataCamp, conferenze di data science e IA o eventi di networking.

Sviluppa un portfolio

Devi distinguerti dagli altri candidati. Un buon modo per farlo è costruire un portfolio solido che mostri le tue competenze e i progetti completati. Puoi fare una buona impressione sui recruiter affrontando sfide reali.

Il tuo portfolio dovrebbe contenere progetti diversificati che riflettano la tua esperienza con PySpark e le sue varie applicazioni. Consulta questa guida su come creare un ottimo portfolio di data science.

Prepara un curriculum efficace

Negli ultimi anni è aumentato il numero di persone che passano alla data science e a ruoli legati ai dati. I recruiter devono esaminare centinaia di curriculum e individuare i candidati migliori. Inoltre, spesso il tuo CV viene analizzato da Applicant Tracking System (ATS), software automatici utilizzati da molte aziende per filtrare i curriculum che non soddisfano determinati criteri. Quindi, dovresti costruire un ottimo curriculum che impressioni sia l'ATS sia i recruiter.

Preparati al colloquio

Se vieni notato dal recruiter o il tuo curriculum efficace supera la selezione, dovrai prepararti a un colloquio tecnico. Per arrivare pronto, puoi consultare questo articolo sulle domande più comuni nei colloqui su PySpark.

Conclusione

Imparare PySpark può aprire le porte a opportunità e risultati di carriera migliori. Il percorso è gratificante ma richiede costanza e pratica concreta. Sperimentare e risolvere sfide con questo strumento può accelerare l'apprendimento e fornirti esempi reali da mostrare quando cerchi lavoro.

FAQs

Quali sono le principali funzionalità di PySpark?

PySpark fornisce un'API Python intuitiva per sfruttare Spark, garantendo velocità, scalabilità e supporto per SQL, machine learning e stream processing su grandi dataset.

Perché sta crescendo la domanda di competenze in PySpark?

La facilità d'uso, la scalabilità e la versatilità di PySpark per l'elaborazione dei big data e il machine learning stanno alimentando la crescente domanda di queste competenze.

Quali sono i punti chiave da considerare per imparare PySpark?

Concentrati sui fondamenti di Python, sui concetti base di Spark e sulle tecniche di manipolazione dei dati, ed esplora argomenti avanzati come Spark SQL e MLlib.

Quali sono alcuni modi per imparare PySpark?

Segui corsi online e tutorial, lavora su dataset reali, usa le cheat sheet e scopri PySpark attraverso i libri.

Quali sono alcuni dei ruoli che usano PySpark?

Alcuni dei ruoli che utilizzano PySpark sono: big data engineer, machine learning engineer, data scientist e data analyst.