Courses

Ước tính mỗi ngày có khoảng 328,77 triệu terabyte dữ liệu được tạo ra. Mỗi cú nhấp và giao dịch mua đều tạo ra dữ liệu có thể được xử lý thành thông tin chi tiết và dự đoán có giá trị nếu có công cụ phù hợp.

Tuy nhiên, chúng ta cần một thư viện hiệu năng cao để xử lý khối lượng dữ liệu đó. Đó là lúc PySpark phát huy tác dụng.

Trong hướng dẫn này, chúng ta sẽ khám phá cách học PySpark từ đầu. Tôi sẽ giúp bạn xây dựng kế hoạch học tập, chia sẻ những mẹo hay nhất để học hiệu quả, và cung cấp tài nguyên hữu ích để hỗ trợ bạn tìm kiếm các vị trí yêu cầu PySpark.

PySpark là gì?

PySpark là sự kết hợp của hai công nghệ mạnh mẽ: Python và Apache Spark.

Python là một trong những ngôn ngữ lập trình được sử dụng nhiều nhất trong phát triển phần mềm, đặc biệt cho khoa học dữ liệu và machine learning, chủ yếu nhờ cú pháp dễ dùng và rõ ràng.

Mặt khác, Apache Spark là một framework có thể xử lý lượng lớn dữ liệu phi cấu trúc. Spark được xây dựng bằng Scala, một ngôn ngữ cho phép chúng ta kiểm soát nhiều hơn. Tuy nhiên, Scala không phổ biến trong giới làm dữ liệu. Vì vậy, PySpark ra đời để lấp đầy khoảng trống này.

PySpark cung cấp một API và giao diện thân thiện để tương tác với Spark. Nó tận dụng sự đơn giản và linh hoạt của Python để giúp việc xử lý dữ liệu lớn tiếp cận được với đông đảo người dùng hơn.

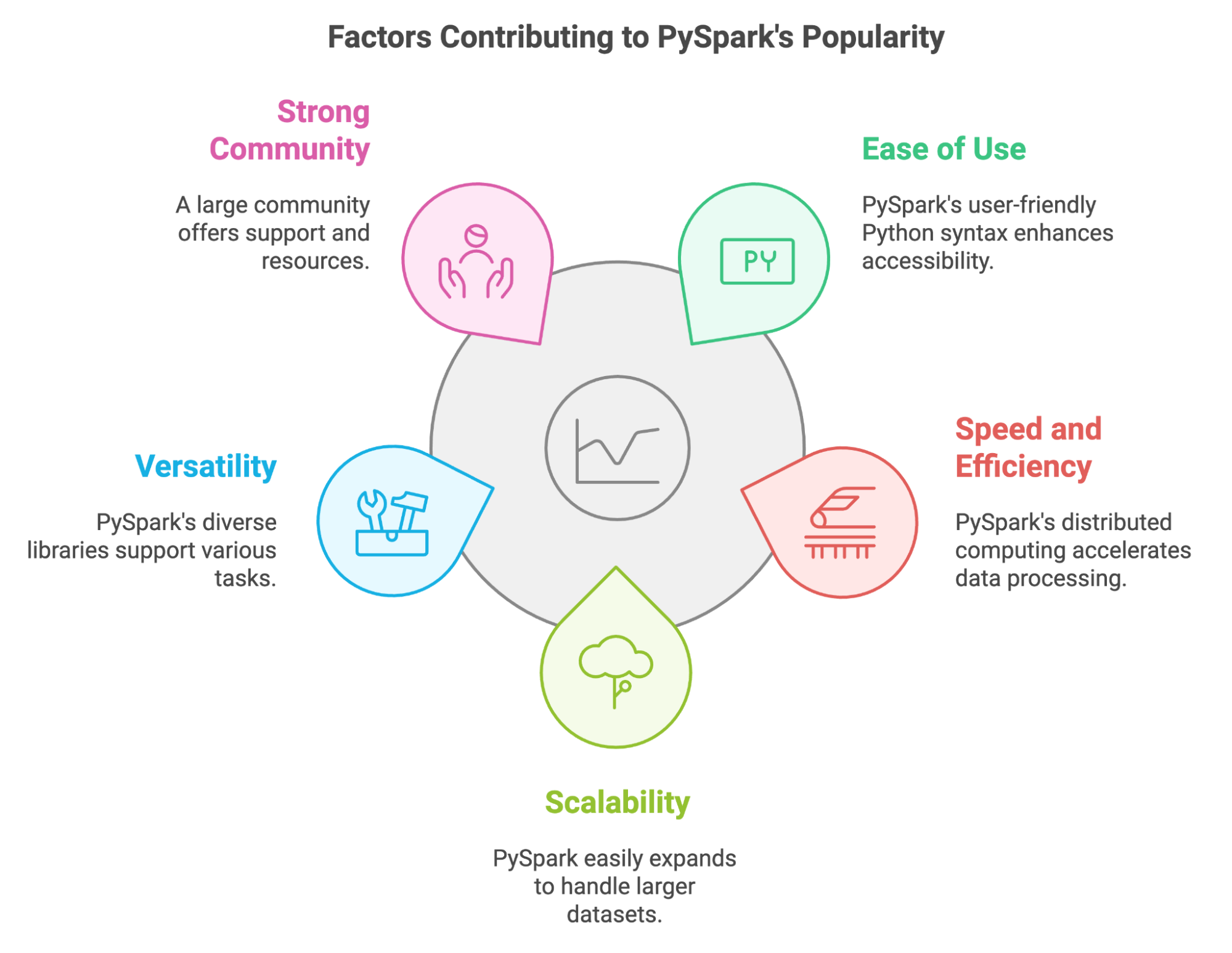

Điều gì khiến PySpark phổ biến?

Những năm gần đây, PySpark đã trở thành công cụ quan trọng cho những người làm dữ liệu cần xử lý lượng dữ liệu khổng lồ. Có thể lý giải sự phổ biến của nó bằng một số yếu tố then chốt:

- Dễ sử dụng: PySpark dùng cú pháp quen thuộc của Python, giúp người làm dữ liệu như chúng ta dễ tiếp cận hơn.

- Tốc độ và hiệu quả: Bằng cách phân tán tính toán trên các cụm máy, PySpark xử lý tập dữ liệu khổng lồ với tốc độ cao.

- Khả năng mở rộng: PySpark thích ứng với sự gia tăng về dữ liệu, cho phép chúng ta mở rộng ứng dụng bằng cách bổ sung tài nguyên tính toán.

- Tính đa dụng: Cung cấp hệ sinh thái thư viện phong phú cho nhiều tác vụ, từ xử lý dữ liệu đến machine learning.

- Cộng đồng mạnh: Chúng ta có thể dựa vào một cộng đồng đông đảo và năng động để nhận hỗ trợ và tài nguyên khi gặp vấn đề.

PySpark cũng cho phép chúng ta tận dụng kỹ năng và thư viện Python sẵn có. Bạn có thể dễ dàng tích hợp với các công cụ phổ biến như Pandas và Scikit-learn, và làm việc với nhiều nguồn dữ liệu khác nhau.

Các tính năng chính của PySpark

PySpark được tạo ra đặc biệt cho big data và các phát triển về machine learning. Nhưng những tính năng nào khiến nó trở thành công cụ mạnh để xử lý lượng dữ liệu khổng lồ? Hãy cùng xem:

- Resilient Distributed Datasets (RDDs): Đây là cấu trúc dữ liệu nền tảng của PySpark. Nhờ RDD, các phép biến đổi dữ liệu, lọc và tổng hợp có thể được thực hiện song song.

- DataFrame và SQL: Trong PySpark, DataFrame là một trừu tượng cấp cao hơn xây dựng trên RDD. Chúng ta có thể dùng cùng Spark SQL và các truy vấn để thao tác và phân tích dữ liệu.

- Thư viện machine learning: Sử dụng thư viện MLlib của PySpark, chúng ta có thể xây dựng và sử dụng các mô hình machine learning có khả năng mở rộng cho các tác vụ như phân loại và hồi quy.

- Hỗ trợ nhiều định dạng dữ liệu: PySpark cung cấp thư viện và API để đọc, ghi và xử lý dữ liệu ở nhiều định dạng như CSV, JSON, Parquet, Avro, v.v.

- Khả năng chịu lỗi: PySpark theo dõi từng RDD. Nếu một nút gặp lỗi trong quá trình chạy, PySpark sẽ tái tạo phân vùng RDD bị mất dựa trên thông tin theo dõi đó. Vì vậy, rủi ro mất dữ liệu là rất thấp.

- Xử lý trong bộ nhớ: PySpark lưu dữ liệu trung gian trong bộ nhớ, giúp giảm nhu cầu đọc/ghi đĩa và từ đó nâng cao hiệu năng xử lý.

- Streaming và xử lý thời gian thực: Chúng ta có thể tận dụng thành phần Spark Streaming để xử lý luồng dữ liệu thời gian thực và thực hiện phân tích gần thời gian thực.

Vì sao học PySpark lại hữu ích?

Khối lượng dữ liệu chỉ có tăng lên. Ngày nay, các tác vụ xử lý dữ liệu, phân tích dữ liệu và machine learning đều liên quan đến làm việc với lượng dữ liệu lớn. Chúng ta cần dùng những công cụ mạnh mẽ để xử lý dữ liệu đó hiệu quả và kịp thời. PySpark là một trong số những công cụ như vậy.

PySpark có nhiều ứng dụng đa dạng

Chúng ta đã đề cập đến điểm mạnh của PySpark, nhưng hãy xem một vài ví dụ cụ thể nơi bạn có thể áp dụng:

- ETL dữ liệu. Khả năng làm sạch và biến đổi dữ liệu hiệu quả của PySpark được dùng để xử lý dữ liệu cảm biến và nhật ký sản xuất trong lĩnh vực sản xuất và logistics.

- Machine learning. Thư viện MLlib được dùng để phát triển và triển khai các mô hình cho gợi ý cá nhân hóa, phân khúc khách hàng và dự báo doanh số trong thương mại điện tử.

- Xử lý đồ thị. GraphFrames của PySpark được sử dụng để phân tích mạng xã hội và hiểu mối quan hệ giữa người dùng.

- Xử lý luồng. API Structured Streaming của PySpark cho phép xử lý giao dịch tài chính theo thời gian thực để phát hiện gian lận.

- Xử lý dữ liệu SQL. Giao diện SQL của PySpark giúp các nhà nghiên cứu và nhà phân tích y tế truy vấn và phân tích các bộ dữ liệu hệ gene lớn dễ dàng hơn.

Nhu cầu về kỹ năng PySpark đang tăng

Với sự trỗi dậy của khoa học dữ liệu và machine learning cùng lượng dữ liệu gia tăng, nhu cầu về các chuyên gia có kỹ năng thao tác dữ liệu rất cao. Theo Báo cáo State of Data & AI Literacy 2024, 80% lãnh đạo đánh giá cao kỹ năng phân tích và thao tác dữ liệu.

Học PySpark có thể mở ra nhiều cơ hội nghề nghiệp. Hơn 800 tin tuyển dụng trên Indeed, từ kỹ sư dữ liệu đến nhà khoa học dữ liệu, nhấn mạnh nhu cầu thành thạo PySpark trong các vị trí liên quan đến dữ liệu.

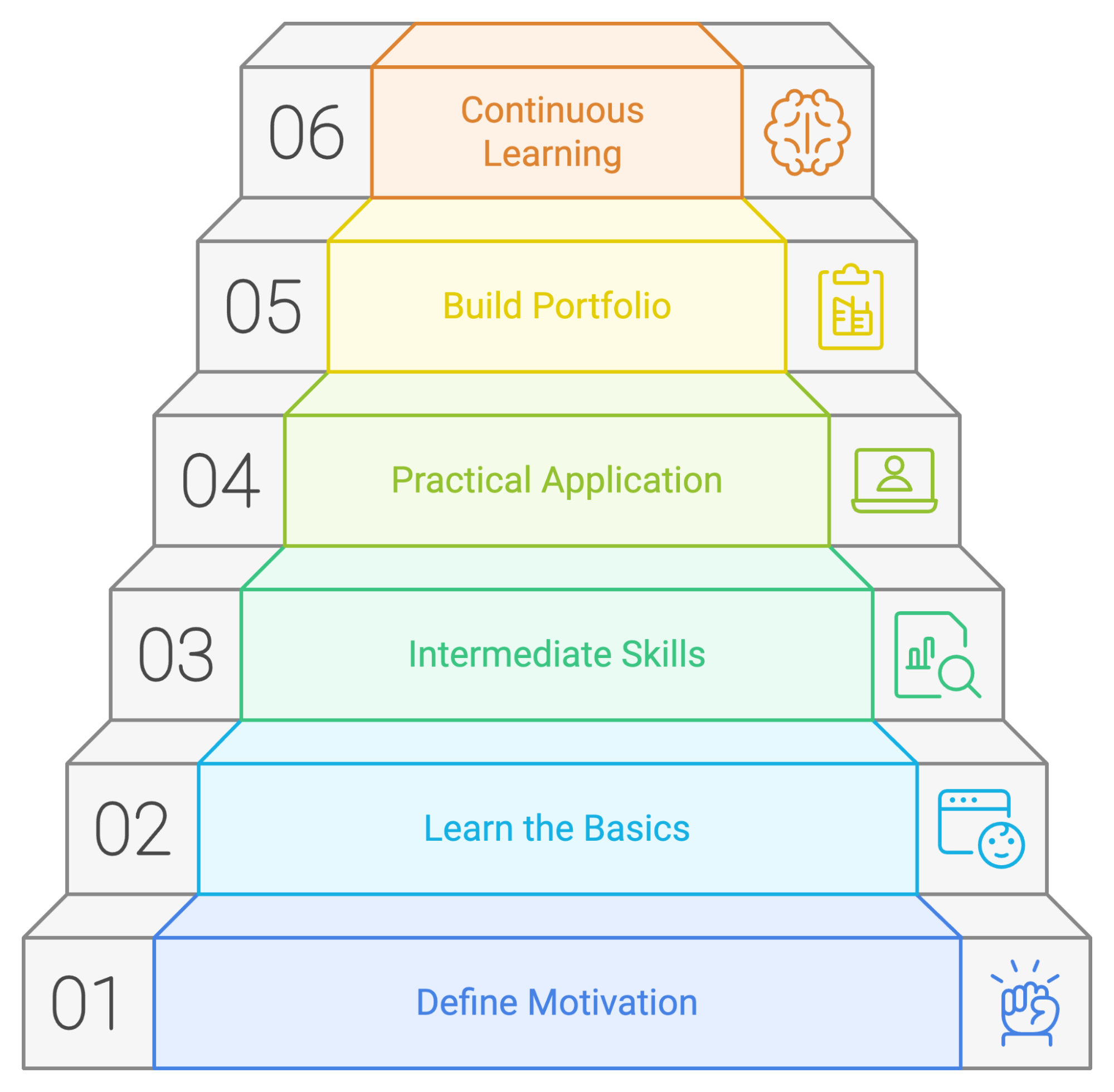

Cách học PySpark từ đầu vào năm 2026

Nếu học PySpark một cách có phương pháp, bạn sẽ có nhiều cơ hội thành công hơn. Hãy tập trung vào một vài nguyên tắc bạn có thể dùng trong hành trình học tập.

1. Hiểu vì sao bạn học PySpark

Trước khi đi vào chi tiết kỹ thuật, hãy xác định động lực của bạn khi học PySpark. Tự hỏi bản thân:

- Mục tiêu nghề nghiệp của tôi là gì?

- PySpark có phải là kỹ năng bạn cần để thăng tiến trong vai trò hiện tại hoặc đạt được công việc mơ ước không?

- Bạn kỳ vọng cơ hội nào sẽ mở ra khi thành thạo PySpark?

- Tôi đang cố gắng giải quyết vấn đề gì?

- Bạn có gặp khó khăn khi xử lý tập dữ liệu lớn mà các công cụ hiện tại không xử lý nổi không?

- Bạn có cần thực hiện các biến đổi dữ liệu phức tạp hoặc xây dựng mô hình machine learning nâng cao không?

- Điều gì khiến tôi hứng thú?

- Bạn có hứng thú với việc xây dựng các pipeline dữ liệu có khả năng mở rộng không?

- Bạn có quan tâm đến big data và tiềm năng khai mở insight của nó không?

- Tôi có dự án cụ thể nào cần đến khả năng của PySpark không?

- Bạn có đang làm dự án cá nhân liên quan đến xử lý hoặc phân tích dữ liệu quy mô lớn không?

- Công ty bạn có cần chuyên môn PySpark cho một dự án sắp tới không?

2. Bắt đầu với những điều cơ bản của PySpark

Sau khi xác định mục tiêu, hãy nắm vững các kiến thức nền tảng của PySpark và cách chúng hoạt động.

Nền tảng Python

Vì PySpark được xây dựng trên Python, bạn cần quen thuộc với Python trước khi dùng PySpark. Bạn nên thoải mái khi làm việc với biến và hàm. Ngoài ra, sẽ hữu ích nếu bạn quen với các thư viện thao tác dữ liệu như Pandas. Khóa Nhập môn Python và Xử lý dữ liệu với Pandas của DataCamp có thể giúp bạn bắt kịp nhanh.

Cài đặt PySpark và học những điều cơ bản

Bạn cần cài đặt PySpark để bắt đầu sử dụng. Bạn có thể tải PySpark bằng pip hoặc Conda, tải thủ công từ trang chính thức, hoặc bắt đầu với DataLab để dùng PySpark ngay trên trình duyệt.

Nếu bạn muốn hướng dẫn đầy đủ cách thiết lập PySpark, hãy xem bài hướng dẫn cách cài đặt PySpark trên Windows, Mac và Linux.

PySpark DataFrame

Khái niệm đầu tiên bạn nên học là cách DataFrame của PySpark hoạt động. Đây là một trong những lý do chính khiến PySpark hoạt động nhanh và hiệu quả. Hãy hiểu cách tạo, biến đổi (map và filter) và thao tác với chúng. Bài hướng dẫn bắt đầu làm việc với PySpark sẽ giúp bạn nắm các khái niệm này.

3. Nâng cao kỹ năng PySpark trung cấp

Khi đã thoải mái với nền tảng, đã đến lúc khám phá các kỹ năng PySpark ở mức trung cấp.

Spark SQL

Một trong những ưu điểm lớn của PySpark là khả năng thực hiện các truy vấn kiểu SQL để đọc và thao tác DataFrame, thực hiện tổng hợp và dùng window function. Phía sau, PySpark dùng Spark SQL. Khóa nhập môn Spark SQL bằng Python có thể giúp bạn kỹ năng này.

Tiền xử lý và biến đổi dữ liệu

Làm việc với dữ liệu đòi hỏi thành thạo việc làm sạch, biến đổi và chuẩn bị dữ liệu cho phân tích. Điều này bao gồm xử lý giá trị khuyết, quản lý các kiểu dữ liệu khác nhau, và thực hiện các phép tổng hợp bằng PySpark. Hãy học khóa Làm sạch dữ liệu với PySpark của DataCamp để có kinh nghiệm thực hành và làm chủ các kỹ năng này.

Machine learning với MLlib

PySpark cũng có thể được dùng để phát triển và triển khai mô hình machine learning nhờ thư viện MLlib. Bạn nên học cách thực hiện kỹ thuật đặc trưng, đánh giá mô hình và tinh chỉnh siêu tham số bằng thư viện này. Khóa Machine Learning với PySpark của DataCamp cung cấp phần giới thiệu toàn diện.

4. Học PySpark bằng thực hành

Tham gia các khóa học và luyện tập bài tập với PySpark là cách tuyệt vời để làm quen với công nghệ. Tuy vậy, để thành thạo PySpark, bạn cần giải quyết những vấn đề thách thức và bồi dưỡng kỹ năng, giống như những gì bạn sẽ gặp trong các dự án thực tế. Hãy bắt đầu bằng những tác vụ phân tích dữ liệu đơn giản và dần chuyển sang các thử thách phức tạp hơn.

Dưới đây là vài cách để rèn luyện kỹ năng:

- Tham gia webinar và code-along. Theo dõi các webinar sắp tới của DataCamp và các sự kiện trực tuyến nơi bạn có thể làm theo các hướng dẫn và ví dụ code PySpark. Điều này giúp củng cố hiểu biết khái niệm và làm quen với mẫu mã code.

- Phát triển dự án độc lập. Xác định các bộ dữ liệu bạn quan tâm và áp dụng kỹ năng PySpark để phân tích. Có thể từ phân tích xu hướng mạng xã hội đến khám phá dữ liệu thị trường tài chính.

- Đóng góp cho dự án mã nguồn mở. Đóng góp cho các dự án PySpark trên các nền tảng như GitHub để có kinh nghiệm cộng tác và làm dự án thực tế.

- Xây dựng blog cá nhân. Viết về các dự án PySpark của bạn, chia sẻ insight và đóng góp cho cộng đồng PySpark bằng cách tạo blog cá nhân.

5. Xây dựng danh mục dự án

Khi tiến xa hơn trong hành trình học PySpark, bạn sẽ hoàn thành nhiều dự án khác nhau. Để phô diễn kỹ năng và kinh nghiệm PySpark với nhà tuyển dụng tiềm năng, bạn nên tổng hợp chúng thành một danh mục. Danh mục này cần phản ánh kỹ năng và sở thích của bạn, đồng thời phù hợp với sự nghiệp hoặc ngành mà bạn quan tâm.

Hãy cố gắng làm dự án có tính riêng và thể hiện kỹ năng giải quyết vấn đề. Bao gồm các dự án chứng minh năng lực ở nhiều khía cạnh của PySpark như tiền xử lý dữ liệu, machine learning và trực quan hóa dữ liệu. Ghi chép dự án, cung cấp bối cảnh, phương pháp, mã và kết quả. Bạn có thể dùng DataLab, một IDE trực tuyến cho phép bạn viết mã, phân tích dữ liệu cộng tác và chia sẻ insight.

Dưới đây là hai dự án PySpark bạn có thể làm:

6. Liên tục thử thách bản thân

Học PySpark là một hành trình liên tục. Công nghệ luôn phát triển và các tính năng, ứng dụng mới được ra mắt thường xuyên. PySpark cũng không ngoại lệ.

Khi đã nắm vững nền tảng, bạn có thể tìm các tác vụ và dự án thách thức hơn như tối ưu hiệu năng hoặc GraphX. Tập trung vào mục tiêu và chuyên sâu ở các mảng phù hợp với định hướng và sở thích nghề nghiệp của bạn.

Luôn cập nhật các phát triển mới và học cách áp dụng chúng vào dự án hiện tại. Tiếp tục luyện tập, tìm kiếm thử thách và cơ hội mới, và chấp nhận việc mắc lỗi như một cách để học.

Hãy cùng điểm lại các bước để có một kế hoạch học PySpark thành công:

Ví dụ về kế hoạch học PySpark

Dù mỗi người có cách học riêng, việc có một kế hoạch hoặc lộ trình để theo khi học công cụ mới luôn hữu ích. Chúng tôi đã xây dựng một kế hoạch học tiềm năng nêu rõ nơi bạn nên tập trung thời gian và công sức nếu bạn mới bắt đầu với PySpark.

Tháng 1: Nền tảng PySpark

- Khái niệm cốt lõi. Cài đặt PySpark và khám phá cú pháp. Hiểu các khái niệm cốt lõi của Apache Spark, kiến trúc của nó và cách Spark cho phép xử lý dữ liệu phân tán.

- Các kiến thức cơ bản về PySpark. Học cách thiết lập môi trường PySpark, tạo SparkContext và SparkSession, và khám phá các cấu trúc dữ liệu cơ bản như RDD và DataFrame.

- Thao tác dữ liệu. Làm chủ các thao tác thiết yếu trong PySpark như lọc, sắp xếp, nhóm, tổng hợp và nối tập dữ liệu. Bạn có thể hoàn thành dự án Làm sạch đơn hàng với PySpark.

Tháng 2: PySpark cho phân tích dữ liệu và SQL

- Làm việc với các định dạng dữ liệu khác nhau: Học cách đọc và ghi dữ liệu ở nhiều định dạng, bao gồm CSV, JSON, Parquet và Avro bằng PySpark.

- Spark SQL. Học cách sử dụng Spark SQL để truy vấn và phân tích dữ liệu với cú pháp SQL quen thuộc. Khám phá các khái niệm như DataFrame, Dataset và hàm SQL.

- Trực quan hóa dữ liệu và kỹ thuật đặc trưng: Khám phá kỹ thuật trực quan hóa dữ liệu trong PySpark bằng các thư viện như Matplotlib và Seaborn để rút ra insight. Học cách tiền xử lý dữ liệu và thực hiện kỹ thuật đặc trưng qua khóa Feature Engineering với PySpark.

Tháng 3-4: PySpark cho Machine Learning và chủ đề nâng cao

- Giới thiệu MLlib: Bắt đầu với thư viện MLlib của PySpark cho machine learning. Khám phá các thuật toán cơ bản cho phân loại, hồi quy và phân cụm. Bạn có thể học qua khóa Machine Learning với PySpark.

- Xây dựng pipeline ML. Học cách xây dựng và triển khai pipeline machine learning trong PySpark để huấn luyện và đánh giá mô hình hiệu quả.

- Phát triển dự án. Làm dự án Dự báo nhu cầu.

- Khái niệm nâng cao. Khám phá kỹ thuật tối ưu hóa ứng dụng PySpark, bao gồm phân vùng dữ liệu, caching và tinh chỉnh hiệu năng.

Năm mẹo để học PySpark

Tôi hình dung đến lúc này bạn đã sẵn sàng bắt tay vào học PySpark và thực hành trên một tập dữ liệu lớn. Nhưng trước đó, hãy điểm qua những mẹo sẽ giúp bạn đi nhanh hơn trên con đường thành thạo PySpark.

1. Thu hẹp phạm vi

PySpark là công cụ có thể ứng dụng vào nhiều việc khác nhau. Để giữ tập trung và đạt mục tiêu, bạn nên xác định mảng quan tâm. Bạn muốn tập trung vào phân tích dữ liệu, kỹ thuật dữ liệu hay machine learning? Cách tiếp cận có trọng tâm sẽ giúp bạn học những khía cạnh và kiến thức liên quan nhất của PySpark cho con đường bạn chọn.

2. Luyện tập thường xuyên và liên tục

Tính đều đặn là chìa khóa để làm chủ kỹ năng mới. Bạn nên dành thời gian cố định để luyện PySpark. Chỉ cần một khoảng thời gian ngắn mỗi ngày là được. Không cần mỗi ngày đều học khái niệm phức tạp; bạn có thể ôn lại những gì đã học hoặc làm lại một bài tập đơn giản để refactor. Luyện tập thường xuyên sẽ củng cố hiểu biết và xây dựng sự tự tin khi áp dụng.

3. Làm dự án thực tế

Đây là một mẹo then chốt và bạn sẽ gặp lại nhiều lần trong hướng dẫn này. Luyện bài tập giúp bạn tự tin, nhưng áp dụng kỹ năng PySpark vào dự án thực tế mới là điều giúp bạn vượt trội. Hãy tìm các bộ dữ liệu bạn hứng thú và dùng PySpark để phân tích, rút ra insight và giải quyết vấn đề.

Bắt đầu với dự án và câu hỏi đơn giản rồi dần nâng độ phức tạp. Đơn giản như đọc và làm sạch một bộ dữ liệu thực, viết truy vấn phức tạp để tổng hợp và dự đoán giá nhà.

4. Tham gia cộng đồng

Học tập thường hiệu quả hơn khi có sự cộng tác. Chia sẻ trải nghiệm và học hỏi từ người khác có thể tăng tốc tiến bộ và mang lại insight giá trị.

Để trao đổi kiến thức, ý tưởng và câu hỏi, bạn có thể tham gia các nhóm liên quan đến PySpark, tham dự meet-up và hội thảo. Cộng đồng Databricks, công ty do những người sáng lập Spark thành lập, có diễn đàn sôi động để thảo luận và đặt câu hỏi về PySpark. Ngoài ra, Spark Summit do Databricks tổ chức là hội nghị Spark lớn nhất.

5. Chấp nhận sai lầm

Giống như bất kỳ công nghệ nào khác, học PySpark là quá trình lặp. Và học từ sai lầm là phần thiết yếu. Đừng ngại thử nghiệm, thử cách tiếp cận khác nhau và rút kinh nghiệm từ lỗi. Thử các hàm và phương án tổng hợp dữ liệu khác nhau, thực hiện truy vấn lồng hoặc con, và quan sát phản hồi nhanh mà PySpark mang lại.

Cách tốt nhất để học PySpark

Hãy cùng điểm qua một vài phương pháp hiệu quả để học PySpark.

Tham gia khóa học trực tuyến

Các khóa học trực tuyến là cách tuyệt vời để học PySpark theo tốc độ của bạn. DataCamp cung cấp khóa học PySpark cho mọi cấp độ, hợp thành lộ trình Big Data với PySpark. Các khóa học bao quát từ khái niệm nhập môn đến chủ đề machine learning và được thiết kế với bài tập thực hành.

Một số khóa học liên quan đến PySpark trên DataCamp:

- Feature Engineering với PySpark

- Machine Learning với PySpark

- Xây dựng hệ gợi ý với PySpark

- Nền tảng Big Data với PySpark

Theo dõi các hướng dẫn trực tuyến

Các tutorial là cách tuyệt vời khác để học PySpark, đặc biệt nếu bạn mới. Chúng có hướng dẫn từng bước để thực hiện tác vụ cụ thể hoặc hiểu một số khái niệm. Khởi đầu, hãy tham khảo các bài này:

Xem các cheat sheet về PySpark

Cheat sheet rất hữu ích khi bạn cần tài liệu tham khảo nhanh về PySpark. Dưới đây là hai cheat sheet hữu ích:

Hoàn thành các dự án PySpark

Học PySpark cần thực hành trực tiếp. Đối mặt với thử thách khi làm các dự án sẽ cho phép bạn áp dụng mọi kỹ năng đã học. Khi đảm nhiệm các tác vụ phức tạp hơn, bạn sẽ cần tìm giải pháp và nghiên cứu phương án mới để đạt kết quả mong muốn, qua đó nâng cao chuyên môn PySpark.

Tìm các dự án PySpark trên DataCamp để thực hành. Chúng cho phép bạn áp dụng kỹ năng thao tác dữ liệu và xây dựng mô hình machine learning với PySpark:

Khám phá PySpark qua sách

Sách là nguồn tuyệt vời để học PySpark. Chúng cung cấp kiến thức chuyên sâu và góc nhìn từ chuyên gia kèm đoạn mã và giải thích. Dưới đây là một số sách phổ biến về PySpark:

- Learning PySpark Ấn bản 2, Jules S. Damji

- PySpark Cookbook, Denny Lee

- The Spark for Python Developers

Nghề nghiệp với PySpark

Nhu cầu về kỹ năng PySpark đã tăng lên ở nhiều vai trò liên quan đến dữ liệu, từ nhà phân tích dữ liệu đến kỹ sư big data. Nếu bạn đang chuẩn bị phỏng vấn, hãy cân nhắc các câu hỏi phỏng vấn PySpark cho

Kỹ sư big data

Với vai trò kỹ sư big data, bạn là kiến trúc sư của các giải pháp big data, chịu trách nhiệm thiết kế, xây dựng và duy trì hạ tầng xử lý các tập dữ liệu lớn. Bạn sẽ dựa vào PySpark để tạo pipeline dữ liệu có khả năng mở rộng, bảo đảm nạp, xử lý và lưu trữ dữ liệu hiệu quả.

Bạn sẽ cần hiểu biết vững về điện toán phân tán và nền tảng đám mây, cùng chuyên môn về kho dữ liệu và quy trình ETL.

- Kỹ năng chính:

- Thành thạo Python và PySpark, Java và Scala

- Hiểu cấu trúc dữ liệu và thuật toán

- Thành thạo cả SQL và NoSQL

- Chuyên môn về quy trình ETL và xây dựng pipeline dữ liệu

- Hiểu biết về hệ thống phân tán

- Công cụ chính sử dụng:

- Apache Spark, hệ sinh thái Hadoop

- Công cụ kho dữ liệu (ví dụ: Snowflake, Redshift hoặc BigQuery)

- Nền tảng đám mây (ví dụ: AWS, GCP, Databricks)

- Công cụ điều phối workflow (ví dụ: Apache Airflow, Apache Kafka)

Nhà khoa học dữ liệu

Với vai trò nhà khoa học dữ liệu, bạn sẽ dùng khả năng của PySpark để tiền xử lý và thao tác dữ liệu, cũng như phát triển và triển khai mô hình machine learning. Kiến thức thống kê và kỹ năng lập trình của bạn sẽ giúp xây dựng mô hình đóng góp vào quá trình ra quyết định.

- Kỹ năng chính:

- Kiến thức vững về Python, PySpark và SQL

- Hiểu biết về machine learning và AI

- Thành thạo phân tích thống kê, phân tích định lượng và mô hình dự báo

- Kỹ thuật trực quan hóa dữ liệu và báo cáo

- Kỹ năng giao tiếp và trình bày hiệu quả

- Công cụ chính sử dụng:

- Công cụ phân tích dữ liệu (ví dụ: pandas, NumPy)

- Thư viện machine learning (ví dụ: Scikit-learn)

- Công cụ trực quan hóa dữ liệu (ví dụ: Matplotlib, Tableau)

- Framework big data (ví dụ: Airflow, Spark)

- Công cụ dòng lệnh (ví dụ: Git, Bash)

Kỹ sư machine learning

Với vai trò kỹ sư machine learning, bạn sẽ dùng PySpark để chuẩn bị dữ liệu, xây dựng mô hình machine learning, huấn luyện và triển khai chúng.

- Kỹ năng chính:

- Thành thạo Python, PySpark và SQL

- Hiểu sâu về thuật toán machine learning

- Kiến thức về framework deep learning

- Hiểu cấu trúc dữ liệu, mô hình dữ liệu và kiến trúc phần mềm

- Công cụ chính sử dụng:

- Thư viện và thuật toán machine learning (ví dụ: Scikit-learn, TensorFlow)

- Thư viện khoa học dữ liệu (ví dụ: Pandas, NumPy)

- Nền tảng đám mây (ví dụ: AWS, Google Cloud Platform)

- Hệ thống quản lý phiên bản (ví dụ: Git)

- Framework deep learning (ví dụ: TensorFlow, Keras, PyTorch)

Nhà phân tích dữ liệu

Với vai trò nhà phân tích dữ liệu, bạn sẽ dùng PySpark để khám phá và phân tích các bộ dữ liệu lớn, xác định xu hướng, và truyền đạt phát hiện thông qua báo cáo và trực quan hóa.

- Kỹ năng chính:

- Thành thạo Python, PySpark và SQL

- Kiến thức vững về phân tích thống kê

- Kinh nghiệm với công cụ BI (ví dụ: Tableau, Power BI)

- Hiểu kỹ thuật thu thập và làm sạch dữ liệu

- Công cụ chính sử dụng:

- Công cụ phân tích dữ liệu (ví dụ: pandas, NumPy)

- Công cụ BI (ví dụ: Tableau, Power BI)

- Cơ sở dữ liệu SQL (ví dụ: MySQL, PostgreSQL)

|

Vai trò |

Bạn làm gì |

Kỹ năng chính |

Công cụ sử dụng |

|

Kỹ sư Big Data |

Thiết kế, xây dựng và duy trì hạ tầng xử lý các tập dữ liệu lớn. |

Python, PySpark, Java và Scala, cấu trúc dữ liệu, SQL và NoSQL, ETL, hệ thống phân tán |

Apache Spark, Hadoop, công cụ kho dữ liệu, nền tảng đám mây, công cụ điều phối workflow |

|

Nhà khoa học dữ liệu |

Khám phá mẫu ẩn và trích xuất insight giá trị từ dữ liệu. Ứng dụng kiến thức thống kê và kỹ năng lập trình để xây dựng mô hình hỗ trợ ra quyết định. |

Python, PySpark, SQL, machine learning, khái niệm AI, phân tích thống kê, mô hình dự báo, trực quan hóa dữ liệu, giao tiếp hiệu quả |

Pandas, NumPy, Scikit-learn, Keras, Matplotlib, plotly, Airflow, Spark, Git |

|

Kỹ sư Machine Learning |

Thiết kế, phát triển và triển khai hệ thống machine learning để đưa ra dự đoán từ dữ liệu của công ty. |

Python, PySpark và SQL, thuật toán machine learning, deep learning, cấu trúc dữ liệu, mô hình dữ liệu và kiến trúc phần mềm |

Scikit-learn, TensorFlow, Keras, PyTorch, Pandas, NumPy, AWS, Google Cloud Platform, Git |

|

Nhà phân tích dữ liệu |

Kết nối dữ liệu thô với insight có thể hành động cho doanh nghiệp. Truyền đạt phát hiện qua báo cáo và trực quan hóa. |

Python, PySpark và SQL, phân tích thống kê, trực quan hóa dữ liệu, kỹ thuật thu thập và làm sạch dữ liệu |

Pandas, NumPy, Tableau, PowerBI, MySQL, PostgreSQL. |

Cách tìm công việc sử dụng PySpark hoặc trong lĩnh vực PySpark

Bằng cấp có thể là lợi thế lớn khi bắt đầu sự nghiệp dùng PySpark, nhưng không phải con đường duy nhất. Ngày nay, ngày càng nhiều chuyên gia bắt đầu làm ở các vai trò liên quan đến dữ liệu qua những lộ trình thay thế, trong đó có chuyển ngành. Với sự tận tâm, học hỏi đều đặn và chủ động, bạn có thể đạt được công việc mơ ước sử dụng PySpark.

Tiếp tục học hỏi về lĩnh vực

Luôn cập nhật những phát triển mới nhất về PySpark. Theo dõi các chuyên gia có liên quan đến PySpark trên mạng xã hội, đọc blog và nghe podcast về PySpark.

PySpark được phát triển bởi Matei Zaharia, người cũng là CTO tại Databricks, một nền tảng xây dựng trên Apache Spark. Bạn sẽ hiểu hơn về chủ đề đang thịnh hành, công nghệ mới nổi và định hướng tương lai của PySpark.

Bạn cũng nên theo dõi các sự kiện trong ngành, có thể là webinar tại DataCamp, các hội nghị dữ liệu và AI, hoặc sự kiện kết nối.

Xây dựng danh mục

Bạn cần nổi bật so với các ứng viên khác. Một cách tốt là xây dựng một danh mục mạnh mẽ thể hiện kỹ năng và dự án đã hoàn thành. Bạn có thể tạo ấn tượng tốt với nhà tuyển dụng bằng cách giải quyết các bài toán thực tế.

Danh mục của bạn nên có các dự án đa dạng phản ánh chuyên môn PySpark và những ứng dụng khác nhau của nó. Hãy xem hướng dẫn về cách xây dựng danh mục khoa học dữ liệu ấn tượng.

Soạn một bản sơ yếu lý lịch hiệu quả

Những năm gần đây, ngày càng có nhiều người chuyển sang khoa học dữ liệu và các vai trò liên quan đến dữ liệu. Nhà tuyển dụng phải xem hàng trăm CV và chọn ứng viên xuất sắc. Ngoài ra, nhiều khi CV của bạn sẽ được đưa qua hệ thống ATS (Applicant Tracking Systems), phần mềm tự động mà nhiều công ty dùng để sàng lọc CV và loại những hồ sơ không đáp ứng tiêu chí. Vì vậy, bạn nên soạn một CV tốt để gây ấn tượng với cả ATS và nhà tuyển dụng.

Chuẩn bị cho phỏng vấn

Nếu bạn được nhà tuyển dụng chú ý hoặc CV hiệu quả vượt qua vòng sàng lọc, bước tiếp theo là chuẩn bị cho phỏng vấn kỹ thuật. Để sẵn sàng, bạn có thể xem bài viết về các câu hỏi thường gặp trong phỏng vấn PySpark.

Kết luận

Học PySpark có thể mở ra cơ hội và kết quả nghề nghiệp tốt hơn. Con đường học PySpark mang lại nhiều giá trị nhưng đòi hỏi sự kiên trì và thực hành. Thử nghiệm và giải quyết thách thức bằng công cụ này sẽ đẩy nhanh quá trình học và cung cấp cho bạn ví dụ thực tế để trình bày khi tìm việc.

Câu hỏi thường gặp

Những tính năng chính của PySpark là gì?

PySpark cung cấp API Python thân thiện để tận dụng Spark, cho phép tốc độ, khả năng mở rộng và hỗ trợ SQL, machine learning, cũng như xử lý luồng cho các tập dữ liệu lớn.

Vì sao nhu cầu về kỹ năng PySpark tăng?

Tính dễ sử dụng, khả năng mở rộng và tính đa dụng của PySpark cho xử lý big data và machine learning đang thúc đẩy nhu cầu ngày càng tăng với các kỹ năng này.

Những điểm mấu chốt để học PySpark là gì?

Tập trung vào nền tảng Python, các khái niệm cốt lõi của Spark và kỹ thuật thao tác dữ liệu, rồi khám phá các chủ đề nâng cao như Spark SQL và MLlib.

Có những cách nào để học PySpark?

Tham gia khóa học và theo dõi hướng dẫn trực tuyến, làm việc với dữ liệu thực tế, dùng cheat sheet và học PySpark qua sách.

Những vai trò nào sử dụng PySpark?

Một số vai trò sử dụng PySpark gồm: kỹ sư big data, kỹ sư machine learning, nhà khoa học dữ liệu và nhà phân tích dữ liệu.