Kursus

Diperkirakan sekitar 328,77 juta terabita data tercipta setiap hari. Setiap klik dan pembelian menghasilkan data yang dapat diproses menjadi wawasan dan prediksi bermakna dengan alat yang tepat.

Namun, kita membutuhkan pustaka berkinerja tinggi untuk membantu memproses jumlah data sebesar itu. Di sinilah PySpark berperan.

Dalam panduan ini, kita akan membahas cara belajar PySpark dari nol. Saya akan membantu Anda menyusun rencana belajar, membagikan tips terbaik untuk mempelajarinya secara efektif, dan menyediakan sumber daya bermanfaat untuk membantu Anda menemukan peran yang membutuhkan PySpark.

Apa itu PySpark?

PySpark adalah kombinasi dari dua teknologi yang kuat: Python dan Apache Spark.

Python adalah salah satu bahasa pemrograman yang paling banyak digunakan dalam pengembangan perangkat lunak, khususnya untuk data science dan machine learning, terutama karena sintaksnya yang mudah digunakan dan lugas.

Di sisi lain, Apache Spark adalah kerangka kerja yang dapat menangani sejumlah besar data tidak terstruktur. Spark dibangun menggunakan Scala, bahasa yang memberi kita kontrol lebih atasnya. Namun, Scala bukanlah bahasa pemrograman yang populer di kalangan praktisi data. Jadi, PySpark diciptakan untuk menjembatani kesenjangan ini.

PySpark menawarkan API dan antarmuka yang ramah pengguna untuk berinteraksi dengan Spark. Ia memanfaatkan kesederhanaan dan fleksibilitas Python untuk membuat pemrosesan big data dapat diakses oleh khalayak yang lebih luas.

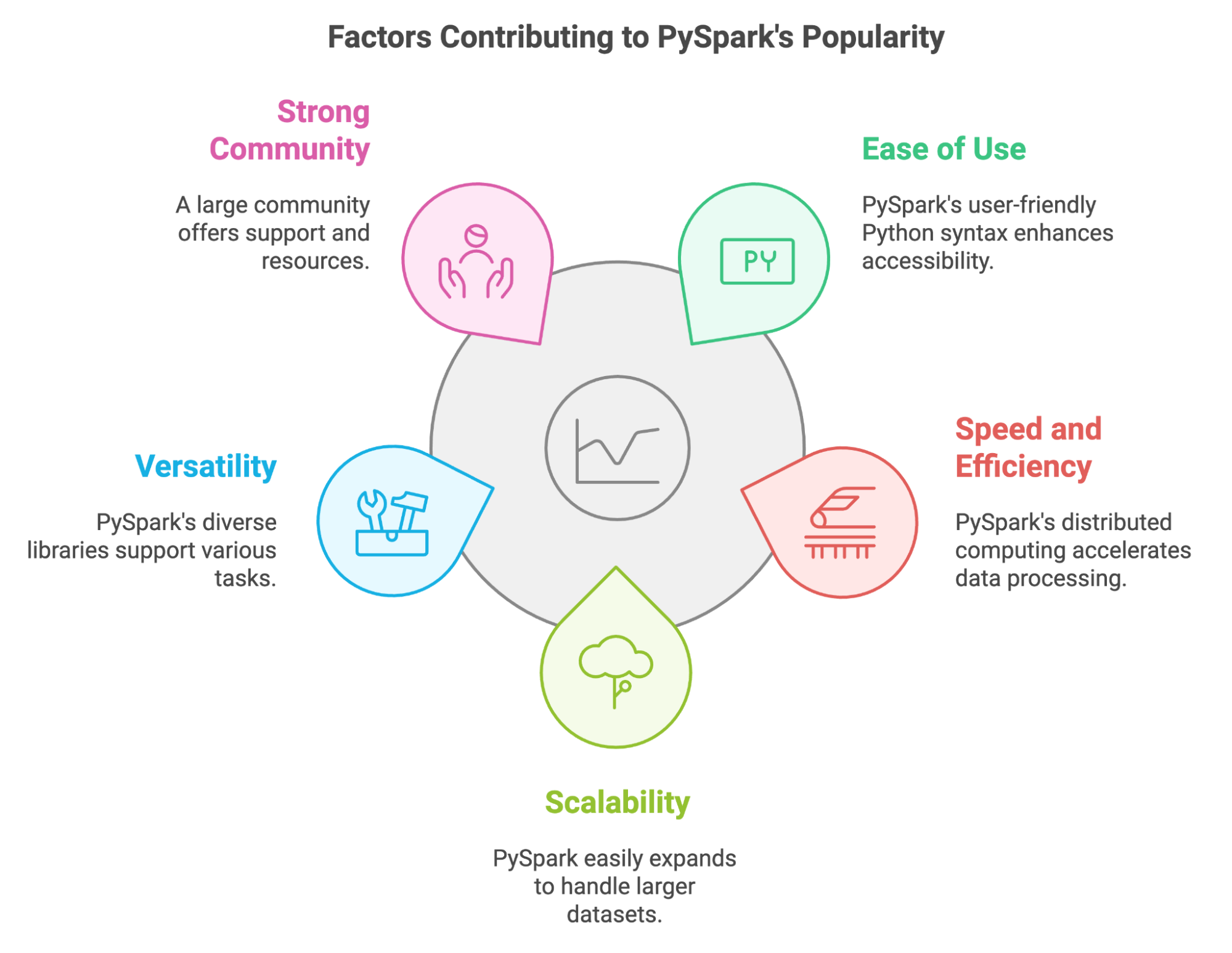

Apa yang membuat PySpark populer?

Dalam beberapa tahun terakhir, PySpark menjadi alat penting bagi praktisi data yang perlu memproses data dalam jumlah besar. Popularitasnya dapat dijelaskan oleh beberapa faktor kunci berikut:

- Kemudahan penggunaan: PySpark menggunakan sintaks Python yang familiar, sehingga lebih mudah diakses oleh praktisi data seperti kita.

- Kecepatan dan efisiensi: Dengan mendistribusikan komputasi ke seluruh klaster mesin, PySpark menangani dataset raksasa dengan kecepatan tinggi.

- Skalabilitas: PySpark beradaptasi dengan pertumbuhan volume data, memungkinkan kita meningkatkan skala aplikasi dengan menambah sumber daya komputasi.

- Fleksibilitas: Ia menawarkan ekosistem pustaka yang luas untuk berbagai tugas, mulai dari manipulasi data hingga machine learning.

- Komunitas yang kuat: Kita dapat mengandalkan komunitas besar dan aktif yang menyediakan dukungan dan sumber daya saat menghadapi masalah dan tantangan.

PySpark juga memungkinkan kita memanfaatkan keterampilan dan pustaka Python yang sudah ada. Kita bisa dengan mudah mengintegrasikannya dengan alat populer seperti Pandas dan Scikit-learn, dan menggunakannya dengan berbagai sumber data.

Fitur utama PySpark

PySpark dibuat khusus untuk big data dan pengembangan machine learning. Lalu, fitur apa yang membuatnya menjadi alat yang kuat untuk menangani data dalam jumlah besar? Mari kita lihat:

- Resilient distributed datasets (RDD): Ini adalah struktur data fundamental di balik PySpark. Berkat RDD, transformasi data, penyaringan, dan agregasi dapat dilakukan secara paralel.

- DataFrame dan SQL: Di PySpark, DataFrame merepresentasikan abstraksi tingkat lebih tinggi di atas RDD. Kita dapat menggunakannya dengan Spark SQL dan kueri untuk melakukan manipulasi dan analisis data.

- Pustaka machine learning: Dengan MLlib PySpark, kita dapat membangun dan menggunakan model machine learning yang dapat diskalakan untuk tugas seperti klasifikasi dan regresi.

- Dukungan berbagai format data: PySpark menyediakan pustaka dan API untuk membaca, menulis, dan memproses data dalam berbagai format seperti CSV, JSON, Parquet, dan Avro, serta lainnya.

- Toleransi kesalahan: PySpark melacak setiap RDD. Jika sebuah node gagal saat eksekusi, PySpark merekonstruksi partisi RDD yang hilang menggunakan informasi penelusuran tersebut. Jadi, risiko kehilangan data sangat kecil.

- Pemrosesan in-memory: PySpark menyimpan data perantara di memori, yang mengurangi kebutuhan operasi disk, dan pada gilirannya meningkatkan kinerja pemrosesan data.

- Streaming dan pemrosesan real-time: Kita dapat memanfaatkan komponen Spark Streaming untuk memproses aliran data real-time dan melakukan analitik hampir real-time.

Mengapa Belajar PySpark Sangat Bermanfaat?

Volume data terus meningkat. Saat ini, tugas penataan data, analisis data, dan machine learning melibatkan kerja dengan data dalam jumlah besar. Kita perlu menggunakan alat yang kuat yang memproses data tersebut secara efisien dan cepat. PySpark adalah salah satunya.

PySpark memiliki beragam aplikasi

Kita sudah menyinggung keunggulan PySpark, tetapi mari lihat beberapa contoh spesifik penggunaannya:

- ETL data. Kemampuan PySpark untuk pembersihan dan transformasi data yang efisien digunakan untuk memproses data sensor dan log produksi di manufaktur dan logistik.

- Machine learning. Pustaka MLlib digunakan untuk mengembangkan dan menerapkan model untuk rekomendasi personal, segmentasi pelanggan, dan peramalan penjualan di e-commerce.

- Pemrosesan graf. GraphFrames PySpark digunakan untuk menganalisis jejaring sosial dan memahami relasi antar pengguna.

- Pemrosesan stream. Structured Streaming API PySpark memungkinkan pemrosesan transaksi keuangan secara real-time untuk mendeteksi penipuan.

- Pemrosesan data SQL. Antarmuka SQL PySpark memudahkan peneliti dan analis kesehatan melakukan kueri dan menganalisis dataset genomik berukuran besar.

Ada permintaan untuk keterampilan PySpark

Dengan bangkitnya data science dan machine learning serta meningkatnya ketersediaan data, terdapat permintaan tinggi bagi profesional dengan keterampilan manipulasi data. Menurut The State of Data & AI Literacy Report 2024, 80% pemimpin menilai keterampilan analisis dan manipulasi data sangat penting.

Belajar PySpark dapat membuka beragam peluang karier. Lebih dari 800 lowongan di Indeed, mulai dari data engineer hingga data scientist, menyoroti tingginya permintaan akan kemahiran PySpark dalam pekerjaan terkait data.

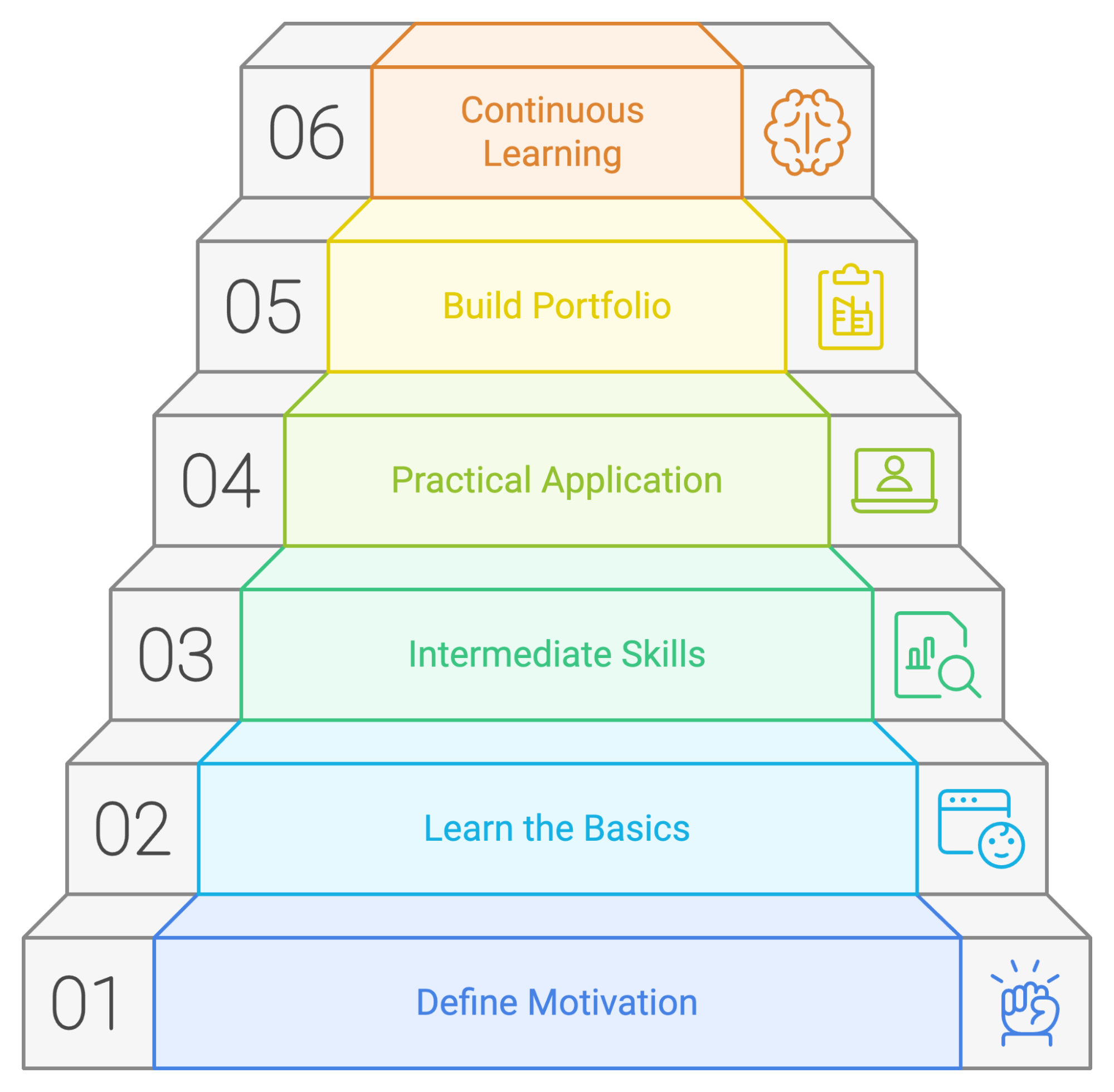

Cara Belajar PySpark dari Nol di 2026

Jika Anda belajar PySpark secara metodis, peluang keberhasilan Anda lebih besar. Mari fokus pada beberapa prinsip yang dapat Anda gunakan dalam perjalanan belajar Anda.

1. Pahami alasan Anda belajar PySpark

Sebelum mempelajari detail teknis, tentukan motivasi Anda mempelajari PySpark. Tanyakan pada diri sendiri:

- Apa tujuan karier saya?

- Apakah PySpark adalah keterampilan yang Anda butuhkan untuk maju di peran saat ini atau meraih pekerjaan impian?

- Peluang apa yang Anda harapkan terbuka jika Anda menguasai PySpark?

- Masalah apa yang ingin saya selesaikan?

- Apakah Anda kesulitan memproses dataset besar yang tidak dapat ditangani oleh alat yang Anda kuasai saat ini?

- Apakah Anda perlu melakukan transformasi data kompleks atau membangun model machine learning tingkat lanjut?

- Apa yang menarik bagi saya?

- Apakah gagasan membangun pipeline data yang dapat diskalakan membuat Anda antusias?

- Apakah Anda tertarik pada big data dan potensinya untuk membuka wawasan?

- Apakah saya memiliki proyek spesifik yang membutuhkan kapabilitas PySpark?

- Apakah Anda mengerjakan proyek personal yang melibatkan pemrosesan atau analisis data skala besar?

- Apakah perusahaan Anda membutuhkan keahlian PySpark dalam proyek mendatang?

2. Mulai dari dasar-dasar PySpark

Setelah Anda mengidentifikasi tujuan, kuasai dasar-dasar PySpark dan pahami cara kerjanya.

Fundamental Python

Karena PySpark dibangun di atas Python, Anda harus akrab dengan Python sebelum menggunakan PySpark. Anda perlu nyaman bekerja dengan variabel dan fungsi. Selain itu, ada baiknya terbiasa dengan pustaka manipulasi data seperti Pandas. Kursus Pengantar Python dan Data Manipulation with Pandas dari DataCamp dapat membantu Anda mempercepat pemahaman.

Menginstal PySpark dan mempelajari dasar-dasarnya

Anda perlu menginstal PySpark untuk mulai menggunakannya. Anda dapat mengunduh PySpark menggunakan pip atau Conda, mengunduhnya secara manual dari situs resmi, atau memulai dengan DataLab untuk mulai menggunakan PySpark di peramban Anda.

Jika Anda ingin penjelasan lengkap tentang cara menyiapkan PySpark, lihat panduan ini tentang cara menginstal PySpark di Windows, Mac, dan Linux.

PySpark DataFrame

Konsep pertama yang harus Anda pelajari adalah cara kerja DataFrame PySpark. Inilah salah satu alasan utama mengapa PySpark bekerja sangat cepat dan efisien. Pahami cara membuat, mentransformasi (map dan filter), dan memanipulasinya. Tutorial tentang cara mulai bekerja dengan PySpark akan membantu Anda memahami konsep-konsep ini.

3. Kuasai keterampilan PySpark tingkat menengah

Setelah Anda nyaman dengan dasar-dasarnya, saatnya mengeksplorasi keterampilan PySpark tingkat menengah.

Spark SQL

Salah satu keuntungan terbesar PySpark adalah kemampuannya melakukan kueri mirip SQL untuk membaca dan memanipulasi DataFrame, melakukan agregasi, dan menggunakan fungsi jendela. Di balik layar, PySpark menggunakan Spark SQL. Pengantar Spark SQL dalam Python ini dapat membantu Anda menguasai keterampilan tersebut.

Penataan dan transformasi data

Bekerja dengan data menuntut Anda mahir dalam membersihkan, mentransformasi, dan menyiapkannya untuk analisis. Ini mencakup menangani nilai hilang, mengelola berbagai tipe data, dan melakukan agregasi menggunakan PySpark. Ikuti Cleaning Data with PySpark dari DataCamp untuk mendapatkan pengalaman praktis dan menguasai keterampilan ini.

Machine learning dengan MLlib

PySpark juga dapat digunakan untuk mengembangkan dan menerapkan model machine learning berkat pustaka MLlib. Anda perlu mempelajari rekayasa fitur, evaluasi model, dan penyetelan hiperparameter menggunakan pustaka ini. Kursus Machine Learning with PySpark dari DataCamp memberikan pengantar yang komprehensif.

4. Belajar PySpark lewat praktik

Mengikuti kursus dan berlatih latihan dengan PySpark adalah cara yang sangat baik untuk mengenal teknologinya. Namun, untuk mahir dalam PySpark, Anda perlu memecahkan masalah yang menantang dan membangun keterampilan, seperti yang akan Anda hadapi dalam proyek dunia nyata. Anda dapat mulai dari tugas analisis data sederhana dan secara bertahap beralih ke tantangan yang lebih kompleks.

Berikut beberapa cara untuk melatih keterampilan Anda:

- Ikuti webinar dan code-along. Cari webinar DataCamp yang akan datang dan acara online tempat Anda bisa mengikuti tutorial dan contoh kode PySpark. Ini akan membantu memperkuat pemahaman konsep dan membiasakan diri dengan pola pengkodean.

- Kembangkan proyek mandiri. Identifikasi dataset yang menarik bagi Anda dan terapkan keterampilan PySpark untuk menganalisisnya. Ini bisa berupa apa saja, dari menganalisis tren media sosial hingga mengeksplorasi data pasar keuangan.

- Berkontribusi pada proyek open-source. Berkontribusilah pada proyek PySpark di platform seperti GitHub untuk mendapatkan pengalaman kolaborasi dan bekerja pada proyek dunia nyata.

- Bangun blog pribadi. Tulis tentang proyek PySpark Anda, bagikan wawasan, dan berkontribusi kepada komunitas PySpark dengan membuat blog pribadi.

5. Bangun portofolio proyek

Seiring Anda melangkah dalam perjalanan belajar PySpark, Anda akan menyelesaikan berbagai proyek. Untuk menampilkan keterampilan dan pengalaman PySpark kepada calon pemberi kerja, Anda harus mengompilasinya menjadi portofolio. Portofolio ini harus mencerminkan keterampilan dan minat Anda serta disesuaikan dengan karier atau industri yang Anda incar.

Usahakan proyek Anda orisinal dan menunjukkan kemampuan pemecahan masalah. Sertakan proyek yang menunjukkan kemahiran Anda dalam berbagai aspek PySpark, seperti penataan data, machine learning, dan visualisasi data. Dokumentasikan proyek Anda, berikan konteks, metodologi, kode, dan hasil. Anda dapat menggunakan DataLab, sebuah IDE online yang memungkinkan Anda menulis kode, menganalisis data secara kolaboratif, dan berbagi wawasan.

Berikut dua proyek PySpark yang bisa Anda kerjakan:

6. Terus tantang diri Anda

Belajar PySpark adalah perjalanan yang berkelanjutan. Teknologi terus berkembang, dan fitur serta aplikasi baru dikembangkan secara berkala. PySpark bukan pengecualian.

Setelah Anda menguasai fundamental, carilah tugas dan proyek yang lebih menantang seperti optimasi kinerja atau GraphX. Fokuslah pada tujuan Anda dan spesialisasi di area yang relevan dengan tujuan dan minat karier Anda.

Selalu ikuti perkembangan terbaru dan pelajari cara menerapkannya pada proyek Anda saat ini. Terus berlatih, cari tantangan dan peluang baru, serta terimalah gagasan membuat kesalahan sebagai cara belajar.

Mari rekap langkah-langkah yang dapat kita ambil untuk rencana belajar PySpark yang sukses:

Contoh Rencana Belajar PySpark

Meskipun setiap orang punya cara belajar masing-masing, memiliki rencana atau panduan untuk mempelajari alat baru selalu menjadi ide yang baik. Kami membuat rencana belajar potensial yang menguraikan fokus waktu dan upaya Anda jika baru memulai PySpark.

Bulan 1: Fundamental PySpark

- Konsep inti. Instal PySpark dan eksplorasi sintaksnya. Pahami konsep inti Apache Spark, arsitekturnya, dan bagaimana ia memungkinkan pemrosesan data terdistribusi.

- Dasar-dasar PySpark. Pelajari cara menyiapkan lingkungan PySpark, membuat SparkContext dan SparkSession, serta mengeksplorasi struktur data dasar seperti RDD dan DataFrame.

- Manipulasi data. Kuasai operasi PySpark esensial untuk manipulasi data, termasuk penyaringan, pengurutan, pengelompokan, agregasi, dan penggabungan dataset. Anda dapat menyelesaikan proyek Cleaning Orders with PySpark.

Bulan 2: PySpark untuk Analisis Data dan SQL

- Bekerja dengan berbagai format data: Pelajari cara membaca dan menulis data dalam berbagai format, termasuk CSV, JSON, Parquet, dan Avro, menggunakan PySpark.

- Spark SQL. Pelajari cara menggunakan Spark SQL untuk melakukan kueri dan menganalisis data dengan sintaks SQL yang familiar. Jelajahi konsep seperti DataFrame, Dataset, dan fungsi SQL.

- Visualisasi data dan rekayasa fitur: Jelajahi teknik visualisasi data di PySpark menggunakan pustaka seperti Matplotlib dan Seaborn untuk mendapatkan wawasan dari data Anda. Pelajari cara menata data dan melakukan rekayasa fitur dengan mengikuti kursus Feature Engineering with PySpark.

Bulan 3-4: PySpark untuk Machine Learning dan Topik Lanjutan

- Pengantar MLlib: Mulailah dengan pustaka MLlib PySpark untuk machine learning. Jelajahi algoritma dasar untuk klasifikasi, regresi, dan klastering. Anda dapat menggunakan kursus Machine Learning with PySpark.

- Membangun pipeline ML. Pelajari cara membangun dan menerapkan pipeline machine learning di PySpark untuk pelatihan dan evaluasi model yang efisien.

- Kembangkan proyek. Kerjakan pengembangan Model Peramalan Permintaan.

- Konsep lanjutan. Jelajahi teknik untuk mengoptimalkan aplikasi PySpark, termasuk pemartisian data, caching, dan penyetelan kinerja.

Lima Tips untuk Belajar PySpark

Saya membayangkan pada titik ini Anda siap terjun mempelajari PySpark dan menjajal dataset besar untuk melatih keterampilan baru Anda. Namun sebelum itu, izinkan saya menyoroti beberapa tips yang akan membantu Anda menavigasi jalan menuju kemahiran PySpark.

1. Persempit lingkup Anda

PySpark adalah alat dengan banyak sekali aplikasi. Untuk tetap fokus dan mencapai tujuan, Anda sebaiknya mengidentifikasi area minat Anda. Apakah Anda ingin berfokus pada analisis data, rekayasa data, atau machine learning? Pendekatan yang terarah membantu Anda memperoleh aspek dan pengetahuan PySpark yang paling relevan untuk jalur yang dipilih.

2. Berlatih sering dan konsisten

Konsistensi adalah kunci untuk menguasai keterampilan baru. Sisihkan waktu khusus untuk berlatih PySpark. Sedikit waktu setiap hari sudah cukup. Anda tidak harus menghadapi konsep kompleks setiap hari. Anda bisa meninjau kembali apa yang telah dipelajari atau mengulang latihan sederhana untuk memperbaikinya. Latihan rutin akan memperkuat pemahaman konsep dan membangun kepercayaan diri saat menerapkannya.

3. Kerjakan proyek nyata

Ini salah satu tips utama, dan Anda akan membacanya beberapa kali dalam panduan ini. Melatih latihan sangat baik untuk membangun kepercayaan diri. Namun, menerapkan keterampilan PySpark pada proyek dunia nyata adalah yang akan membuat Anda unggul. Carilah dataset yang menarik minat Anda dan gunakan PySpark untuk menganalisisnya, mengekstrak wawasan, dan memecahkan masalah.

Mulailah dengan proyek dan pertanyaan sederhana lalu secara bertahap ambil yang lebih kompleks. Ini bisa sesederhana membaca dan membersihkan dataset nyata serta menulis kueri kompleks untuk melakukan agregasi dan memprediksi harga rumah.

4. Terlibat dalam komunitas

Belajar sering kali lebih efektif bila dilakukan secara kolaboratif. Berbagi pengalaman dan belajar dari orang lain dapat mempercepat kemajuan Anda dan memberikan wawasan berharga.

Untuk bertukar pengetahuan, ide, dan pertanyaan, Anda dapat bergabung dengan beberapa grup terkait PySpark, serta menghadiri meet-up dan konferensi. Databricks Community, perusahaan yang didirikan oleh para pembuat Spark, memiliki forum komunitas aktif tempat Anda dapat berdiskusi dan bertanya tentang PySpark. Selain itu, Spark Summit yang diselenggarakan oleh Databricks adalah konferensi Spark terbesar.

5. Buat kesalahan

Seperti teknologi lainnya, belajar PySpark adalah proses iteratif. Dan belajar dari kesalahan adalah bagian penting dari proses tersebut. Jangan takut bereksperimen, mencoba berbagai pendekatan, dan belajar dari kekeliruan. Coba fungsi dan alternatif berbeda untuk mengagregasi data, lakukan subquery atau kueri bertingkat, dan amati respons cepat yang diberikan PySpark.

Cara Terbaik untuk Belajar PySpark

Mari bahas beberapa metode efektif untuk belajar PySpark.

Ikuti kursus online

Kursus online menawarkan cara yang sangat baik untuk belajar PySpark sesuai kecepatan Anda. DataCamp menawarkan kursus PySpark untuk semua tingkat, yang bersama-sama membentuk jalur Big Data with PySpark. Kursus-kursus ini mencakup konsep pengantar hingga topik machine learning dan dirancang dengan latihan praktis.

Berikut beberapa kursus terkait PySpark di DataCamp:

- Feature Engineering with PySpark

- Machine Learning with PySpark

- Building Recommendation Engines with PySpark

- Big Data Fundamentals with PySpark

Ikuti tutorial online

Tutorial juga merupakan cara yang bagus untuk belajar PySpark, terutama jika Anda baru mengenal teknologi ini. Tutorial berisi instruksi langkah demi langkah tentang cara melakukan tugas tertentu atau memahami konsep tertentu. Untuk awal, pertimbangkan tutorial berikut:

Lihat lembar contekan PySpark

Cheat sheet sangat berguna saat Anda membutuhkan panduan referensi cepat tentang topik PySpark. Berikut dua cheat sheet yang bermanfaat:

Selesaikan proyek PySpark

Belajar PySpark membutuhkan latihan langsung. Menghadapi tantangan saat menyelesaikan proyek akan memungkinkan Anda menerapkan semua keterampilan yang telah dipelajari. Saat mulai mengambil tugas yang lebih kompleks, Anda perlu mencari solusi dan meneliti alternatif baru untuk mendapatkan hasil yang diinginkan, sehingga meningkatkan keahlian PySpark Anda.

Cari proyek PySpark yang bisa dikerjakan di DataCamp. Ini memungkinkan Anda menerapkan keterampilan manipulasi data dan pembangunan model machine learning dengan memanfaatkan PySpark:

Pelajari PySpark melalui buku

Buku adalah sumber yang sangat baik untuk belajar PySpark. Buku menawarkan pengetahuan mendalam dan wawasan dari para ahli lengkap dengan potongan kode dan penjelasan. Berikut beberapa buku PySpark paling populer:

- Learning PySpark Edisi ke-2, Jules S. Damji

- PySpark Cookbook, Denny Lee

- The Spark for Python Developers

Karier di PySpark

Permintaan akan keterampilan PySpark meningkat di berbagai peran terkait data, dari data analyst hingga big data engineer. Jika Anda bersiap untuk wawancara, pertimbangkan pertanyaan wawancara PySpark berikut untuk

Big data engineer

Sebagai big data engineer, Anda adalah arsitek solusi big data, bertanggung jawab merancang, membangun, dan memelihara infrastruktur yang menangani dataset besar. Anda akan mengandalkan PySpark untuk membuat pipeline data yang dapat diskalakan, memastikan pemasukan, pemrosesan, dan penyimpanan data yang efisien.

Anda memerlukan pemahaman kuat tentang komputasi terdistribusi dan platform cloud serta keahlian dalam pergudangan data dan proses ETL.

- Keterampilan kunci:

- Kemahiran Python dan PySpark, Java, dan Scala

- Pemahaman struktur data dan algoritma

- Kemahiran SQL dan NoSQL

- Keahlian proses ETL dan pembangunan pipeline data

- Pemahaman sistem terdistribusi

- Alat kunci yang digunakan:

- Apache Spark, Ekosistem Hadoop

- Alat Pergudangan Data (mis. Snowflake, Redshift, atau BigQuery)

- Platform Cloud (mis. AWS, GCP, Databricks)

- Alat Orkestrasi Alur Kerja (mis. Apache Airflow, Apache Kafka)

Data scientist

Sebagai data scientist, Anda akan menggunakan kapabilitas PySpark untuk menata dan memanipulasi data serta mengembangkan dan menerapkan model machine learning. Pengetahuan statistik dan keterampilan pemrograman Anda akan membantu mengembangkan model yang berkontribusi pada proses pengambilan keputusan.

- Keterampilan kunci:

- Pengetahuan kuat tentang Python, PySpark, dan SQL

- Pemahaman konsep machine learning dan AI

- Kemahiran analisis statistik, analitik kuantitatif, dan pemodelan prediktif

- Visualisasi data dan teknik pelaporan

- Komunikasi dan presentasi yang efektif

- Alat kunci yang digunakan:

- Alat analisis data (mis., pandas, NumPy)

- Pustaka machine learning (mis., Scikit-learn)

- Alat visualisasi data (mis., Matplotlib, Tableau)

- Kerangka kerja big data (mis., Airflow, Spark)

- Alat baris perintah (mis., Git, Bash)

Machine learning engineer

Sebagai machine learning engineer, Anda akan menggunakan PySpark untuk menyiapkan data, membangun model machine learning, serta melatih dan menerapkannya.

- Keterampilan kunci:

- Kemahiran Python, PySpark, dan SQL

- Pemahaman mendalam algoritma machine learning

- Pengetahuan kerangka deep learning

- Pemahaman struktur data, pemodelan data, dan arsitektur perangkat lunak

- Alat kunci yang digunakan:

- Pustaka dan algoritma machine learning (mis., Scikit-learn, TensorFlow)

- Pustaka data science (mis., Pandas, NumPy)

- Platform cloud (mis., AWS, Google Cloud Platform)

- Sistem kontrol versi (mis., Git)

- Kerangka deep learning (mis., TensorFlow, Keras, PyTorch)

Data analyst

Sebagai data analyst, Anda akan menggunakan PySpark untuk mengeksplorasi dan menganalisis dataset besar, mengidentifikasi tren, dan mengomunikasikan temuan melalui laporan dan visualisasi.

- Keterampilan kunci:

- Kemahiran Python, PySpark, dan SQL

- Pengetahuan kuat tentang analisis statistik

- Pengalaman dengan alat business intelligence (mis., Tableau, Power BI)

- Pemahaman teknik pengumpulan dan pembersihan data

- Alat kunci yang digunakan:

- Alat analisis data (mis., pandas, NumPy)

- Alat business intelligence data (mis., Tableau, Power BI)

- Database SQL (mis., MySQL, PostgreSQL)

|

Peran |

Apa yang Anda lakukan |

Keterampilan kunci Anda |

Alat yang Anda gunakan |

|

Big Data Engineer |

Merancang, membangun, dan memelihara infrastruktur untuk menangani dataset besar. |

Python, PySpark, Java, dan Scala, struktur data, SQL dan NoSQL, ETL, sistem terdistribusi |

Apache Spark, Hadoop, Alat Pergudangan Data, Platform Cloud, Alat Orkestrasi Alur Kerja |

|

Data Scientist |

Mengungkap pola tersembunyi dan mengekstrak wawasan berharga dari data. Menerapkan pengetahuan statistik dan keterampilan pemrograman untuk membangun model yang membantu pengambilan keputusan. |

Python, PySpark, SQL, machine learning, konsep AI, analisis statistik, pemodelan prediktif, visualisasi data, Komunikasi yang efektif |

Pandas, NumPy, Scikit-learn, Keras, Matplotlib, plotly, Airflow, Spark, Git |

|

Machine Learning Engineer |

Merancang, mengembangkan, dan menerapkan sistem machine learning untuk membuat prediksi menggunakan data perusahaan. |

Python, PySpark, dan SQL, algoritma machine learning, deep learning, struktur data, pemodelan data, dan arsitektur perangkat lunak |

Scikit-learn, TensorFlow, Keras, PyTorch, Pandas, NumPy, AWS, Google Cloud Platform, Git |

|

Data Analyst |

Menjembatani kesenjangan antara data mentah dan wawasan bisnis yang dapat ditindaklanjuti. Mengomunikasikan temuan melalui laporan dan visualisasi. |

Python, PySpark, dan SQL, analisis statistik, visualisasi data, teknik pengumpulan dan pembersihan data |

Pandas, NumPy, Tableau, PowerBI, MySQL, PostgreSQL. |

Cara Menemukan Pekerjaan yang Menggunakan PySpark atau di Bidang PySpark

Gelar dapat menjadi aset berharga saat memulai karier yang menggunakan PySpark, tetapi itu bukan satu-satunya jalur. Saat ini, semakin banyak profesional yang mulai bekerja di peran terkait data melalui jalur alternatif, termasuk beralih dari bidang lain. Dengan dedikasi, pembelajaran konsisten, dan pendekatan proaktif, Anda dapat meraih pekerjaan impian yang menggunakan PySpark.

Terus belajar tentang bidangnya

Tetap ikuti perkembangan terbaru di PySpark. Ikuti para profesional berpengaruh yang berkecimpung dengan PySpark di media sosial, baca blog terkait PySpark, dan dengarkan podcast terkait PySpark.

PySpark dikembangkan oleh Matei Zaharia, yang juga CTO di Databricks, sebuah platform yang dibangun di atas Apache Spark. Anda akan mendapatkan wawasan tentang topik yang sedang tren, teknologi yang muncul, dan arah masa depan PySpark.

Anda juga sebaiknya melihat acara industri, baik itu webinar di DataCamp, konferensi data science dan AI, atau acara networking.

Bangun portofolio

Anda perlu menonjol dari kandidat lain. Salah satu cara yang baik adalah membangun portofolio yang kuat yang menampilkan keterampilan dan proyek yang telah diselesaikan. Anda dapat memberi kesan baik pada manajer perekrutan dengan menangani tantangan dunia nyata.

Portofolio Anda harus berisi proyek beragam yang mencerminkan keahlian PySpark dan berbagai aplikasinya. Lihat panduan ini tentang cara menyusun portofolio data science yang mengesankan.

Buat resume yang efektif

Dalam beberapa tahun terakhir, semakin banyak orang beralih ke data science dan peran terkait data. Manajer perekrutan harus meninjau ratusan resume dan membedakan kandidat unggul. Selain itu, sering kali resume Anda melewati Applicant Tracking Systems (ATS), perangkat lunak otomatis yang digunakan banyak perusahaan untuk meninjau resume dan menyaring yang tidak memenuhi kriteria tertentu. Jadi, Anda perlu membangun resume yang hebat untuk mengesankan ATS dan perekrut Anda.

Bersiaplah untuk wawancara

Jika Anda diperhatikan oleh manajer perekrutan atau resume efektif Anda lolos proses seleksi, langkah berikutnya adalah mempersiapkan wawancara teknis. Untuk siap, Anda dapat melihat artikel ini tentang pertanyaan teratas yang diajukan dalam wawancara PySpark.

Kesimpulan

Belajar PySpark dapat membuka peluang dan hasil karier yang lebih baik. Jalan untuk belajar PySpark itu memuaskan, tetapi membutuhkan konsistensi dan latihan langsung. Bereksperimen dan memecahkan tantangan menggunakan alat ini dapat mempercepat proses belajar Anda dan memberi contoh dunia nyata untuk ditampilkan saat mencari pekerjaan.

FAQs

Apa saja fitur utama PySpark?

PySpark menyediakan API Python yang ramah pengguna untuk memanfaatkan Spark, menghadirkan kecepatan, skalabilitas, serta dukungan untuk SQL, machine learning, dan pemrosesan stream untuk dataset besar.

Mengapa permintaan keterampilan PySpark meningkat?

Kemudahan penggunaan, skalabilitas, dan fleksibilitas PySpark untuk pemrosesan big data dan machine learning mendorong meningkatnya permintaan akan keterampilan ini.

Apa saja poin kunci untuk dipertimbangkan saat belajar PySpark?

Fokus pada fundamental Python, konsep inti Spark, dan teknik manipulasi data, lalu jelajahi topik lanjutan seperti Spark SQL dan MLlib.

Apa saja cara untuk belajar PySpark?

Ikuti kursus online dan tutorial, kerjakan dataset dunia nyata, gunakan cheat sheet, dan pelajari PySpark melalui buku.

Apa saja peran yang menggunakan PySpark?

Beberapa peran yang menggunakan PySpark adalah: big data engineer, machine learning engineer, data scientist, dan data analyst.