Programa

Construir com modelos de IA geralmente significa lidar com chaves de API, ler documentação e escrever código padrão antes de poder testar um único prompt. O Google AI Studio pula essa configuração e leva você direto para um ambiente de testes baseado em navegador, onde você pode conversar com modelos Gemini, gerar mídia e criar protótipos de aplicativos sem mexer em código.

Este tutorial fala sobre as principais funcionalidades do Google AI Studio: Modo de bate-papo para testes rápidos, modo de transmissão para interações de voz e vídeo, modo de criação para fazer aplicativos com linguagem natural e as ferramentas de geração de mídia para imagens, vídeos e áudio.

Você vai aprender quais modelos Gemini usar para diferentes tarefas e como exportar seus protótipos para código pronto para produção. Para saber as últimas novidades sobre os anúncios de IA do Google este ano, dá uma olhada no nosso guia sobre o Gemini 3 e tutorial do Google Antigravity. Você também pode aprender como criar agentes de IA com o Google ADK.

O que é o Google AI Studio?

O Google AI Studio é uma plataforma gratuita, baseada em navegador, para prototipagem com modelos Gemini AI. Ele oferece o modo Chat para testar prompts, o modo Build para criar aplicativos React a partir de linguagem natural e o modo Stream para interações de voz e vídeo, tudo sem precisar escrever código de configuração.

Começando a usar o Google AI Studio

Começar a usar o Google AI Studio leva menos de um minuto. Vá para aistudio.google.com e faça login com qualquer conta do Google. Não precisa instalar nada, não precisa cartão de crédito e não tem tempo de espera. A plataforma funciona totalmente no seu navegador.

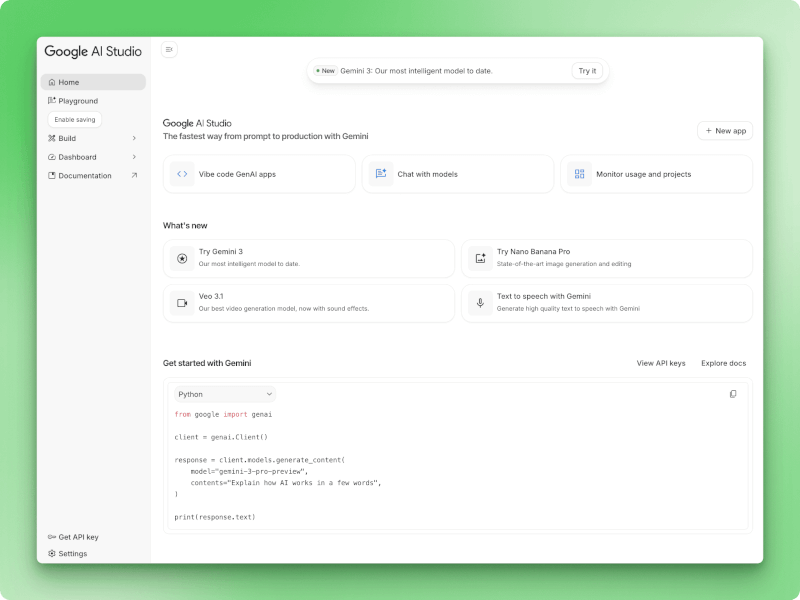

A interface usa uma barra lateral esquerda para navegação com cinco seções principais: Página inicial, Área de jogos, Construir, Painel e Documentação. A página inicial mostra três cartões de ação pra acessar rapidinho tarefas comuns, tipo bater um papo com modelos ou criar aplicativos. Na parte de baixo da barra lateral, você vai encontrar links para “Obter chave API” e “Configurações” para cuidar da sua conta.

Página inicial do Google AI Studio

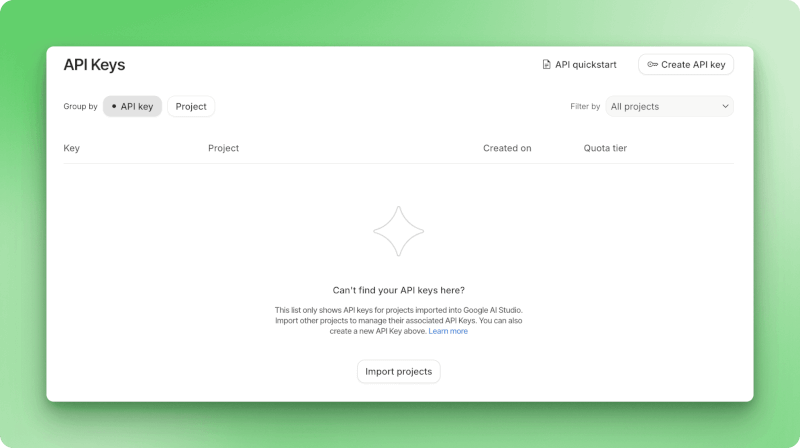

Pra começar a usar a API Gemini nas suas próprias aplicações, clica em “Obter chave API” na parte de baixo da barra lateral esquerda. Isso abre a página de gerenciamento de chaves API, onde você pode criar novas chaves com o botão “Criar chave API”.

O plano gratuito dá acesso imediato com limites de taxa adequados para prototipagem (variando de 5 a 15 solicitações por minuto, dependendo do modelo). Para limites mais altos e uso em produção, você pode fazer upgrade para um plano pago.

Página de gerenciamento de chaves API

Mantenha sua chave API segura e evite colocá-la em repositórios públicos.

Antes de começar a experimentar, é bom entender qual modelo Gemini é mais adequado para a sua tarefa. O AI Studio te dá acesso a várias opções, cada uma com seus pontos fortes.

Que modelos estão disponíveis no Google AI Studio?

Você vai encontrar vários modelos Gemini no AI Studio, cada um feito para tarefas diferentes. A sua escolha depende se você está otimizando para poder de raciocínio, velocidade, custo ou recursos especializados, como geração de imagens.

Série Gemini 3 (mais recente)

O modelogemini-3-pro lida com tarefas complexas de raciocínio que exigem uma análise profunda. Ele tirou 1501 pontos no ranking Elo, ficando no topo dos modelos focados em raciocínio em várias etapas.

Com uma janela de contexto de 1 milhão de tokens, você pode alimentá-lo com bases de código inteiras ou artigos de pesquisa e obter até 65.000 tokens de volta.

O modelo tem um parâmetro chamado “ thinking_level ” que te deixa aumentar ou diminuir a profundidade do raciocínio, dependendo da sua tarefa. Pra saber mais sobre os recursos e benchmarks do Gemini 3, dá uma olhadano guia do Gemini 3 do DataCamp em .

Pra gerar imagens, o gemini-3-pro-image (conhecido como Nano Banana Pro) consegue criar imagens em 2K e 4K com texto legível dentro delas. A maioria dos modelos de imagem não consegue renderizar texto, mas esse aqui dá conta do recado. Você tem 65.000 tokens de entrada e 32.000 tokens de saída pra trabalhar.

Uma coisa a se notar: O recurso de aterramento do Google Maps não está disponível nos modelos Gemini 3. Se você precisa de recursos de localização, vai preferir o Gemini 2.5 Pro.

Série Gemini 2.5

O modelo “ gemini-2.5-pro ” (Pense primeiro, responda depois) adota uma abordagem que prioriza o raciocínio, dedicando mais tempo ao trabalho analítico complexo antes de responder. Ele combina com o contexto de 1M e a capacidade de saída de 65K do Gemini 3 Pro, e é o único modelo que suporta o Google Maps.

As variantes do Flash trocam um pouco da profundidade do raciocínio por velocidade e custo:

· gemini-2.5-flash: Respostas mais rápidas do que os modelos Pro, mantendo a janela de contexto de 1M. Ótima configuração padrão para tarefas gerais

· gemini-2.5-flash-lite: Feito pra lidar com um monte de trabalho, onde você faz consultas simples em grande escala.

Como escolher o modelo certo no Google AI Studio

Comece com gemini-3-pro se você estiver trabalhando com problemas de codificação, análise matemática ou qualquer coisa que exija raciocínio passo a passo.

Mude para gemini-2.5-pro quando precisar de uma base para os mapas ou quiser uma abordagem focada no raciocínio.

Para a maioria das tarefas do dia a dia, gemini-2.5-flash oferece um desempenho sólido sem custos elevados.

Use gemini-2.5-flash-lite quando estiver processando um monte de solicitações mais simples.

E use gemini-3-pro-image quando você precisar de imagens com texto que as pessoas possam realmente ler.

Os limites de taxa do nível gratuito variam de 5 a 15 solicitações por minuto, dependendo do modelo que você escolher.

Agora que você já sabe qual modelo usar, vamos ver como interagir com eles pelo modo Chat, onde você pode testar prompts e refinar sua abordagem antes de escrever qualquer código.

Modo de bate-papo e playground do AI Studio

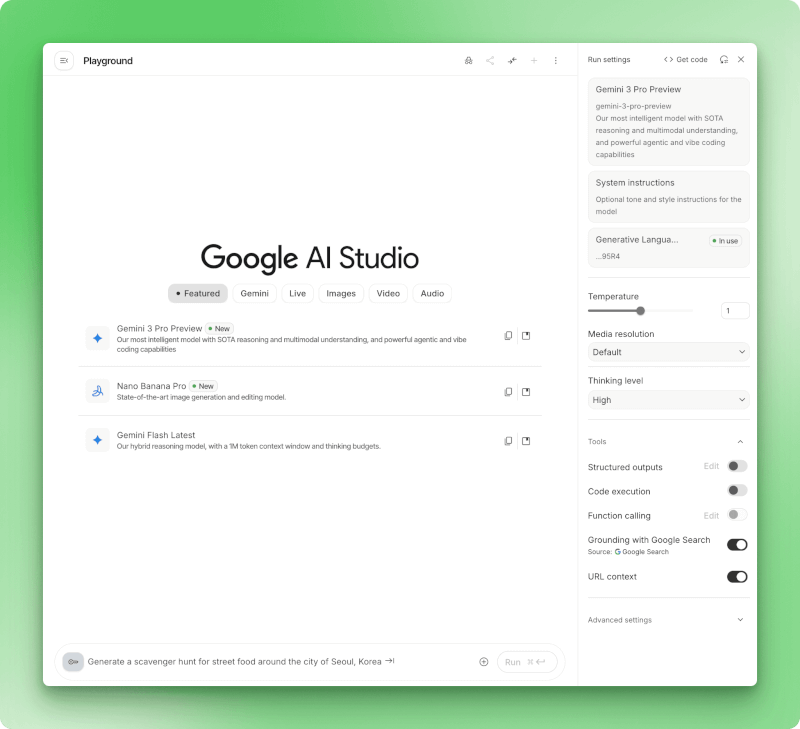

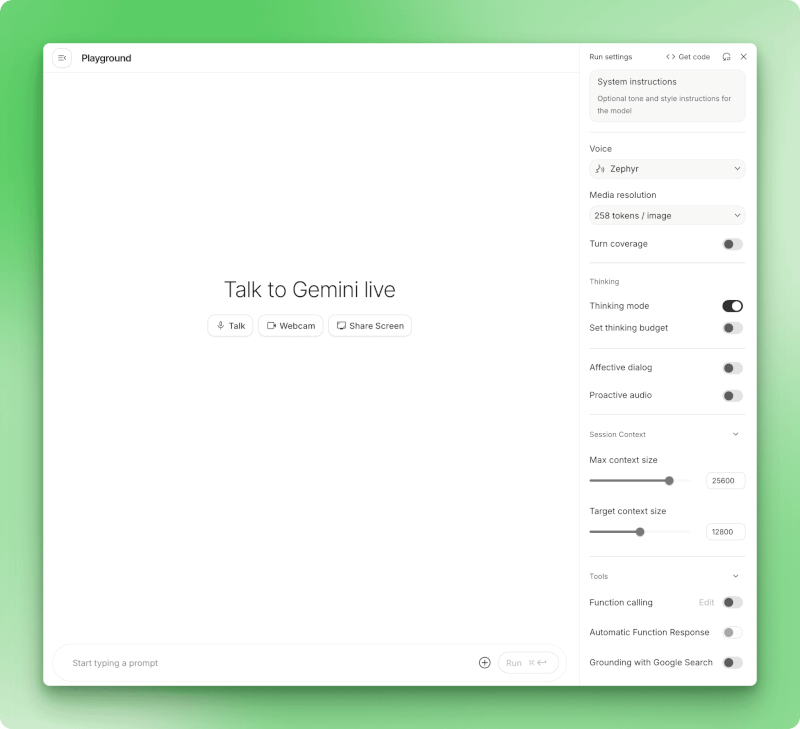

O Playground permite que você teste prompts com controles visuais para cada configuração. Você pode ajustar os parâmetros, ativar e desativar ferramentas e exportar toda a configuração como código funcional quando encontrar algo que funcione.

Interface do Google AI Studio Playground mostrando instruções do sistema, parâmetros do modelo, como temperatura e nível de raciocínio, e ferramentas, incluindo execução de código e base de pesquisa do Google.

As instruções do sistema definem como o modelo vai se comportar durante toda a conversa, pra você não precisar repetir o mesmo contexto em cada prompt. A temperatura controla o grau de aleatoriedade das respostas: valores mais baixos, em torno de 0,3, proporcionam uma formatação consistente, enquanto valores mais altos, em torno de 1,5, funcionam melhor para a escrita criativa. O menu suspenso do nível de raciocínio nos modelos Gemini 3 permite trocar a profundidade do raciocínio pela velocidade.

Mude o modelo para Nano Banana Pro no menu suspenso superior se quiser gerar imagens em vez de texto. Os mesmos controles de parâmetros se aplicam, mas você vai ter imagens de 2K ou 4K com renderização de texto legível.

Além das imagens, o modo Chat também lida com outras mídias. O Veo 3 cria vídeos com áudio nativo e sincronização labial. Para áudio, você pode usar conversão de texto em fala ou Lyria 2 para gerar música. O Lyria RealTime traz criação musical interativa, onde o modelo responde às suas entradas em tempo real.

Ferramentas como o Grounding with Google Search trazem informações atualizadas quando os dados de treinamento do modelo não são suficientes.

A execução do código usa o Python direto pra fazer cálculos ou trabalhar com dados. Os outros botões conectam-se às suas próprias APIs, aplicam esquemas JSON ou inserem URLs na conversa.

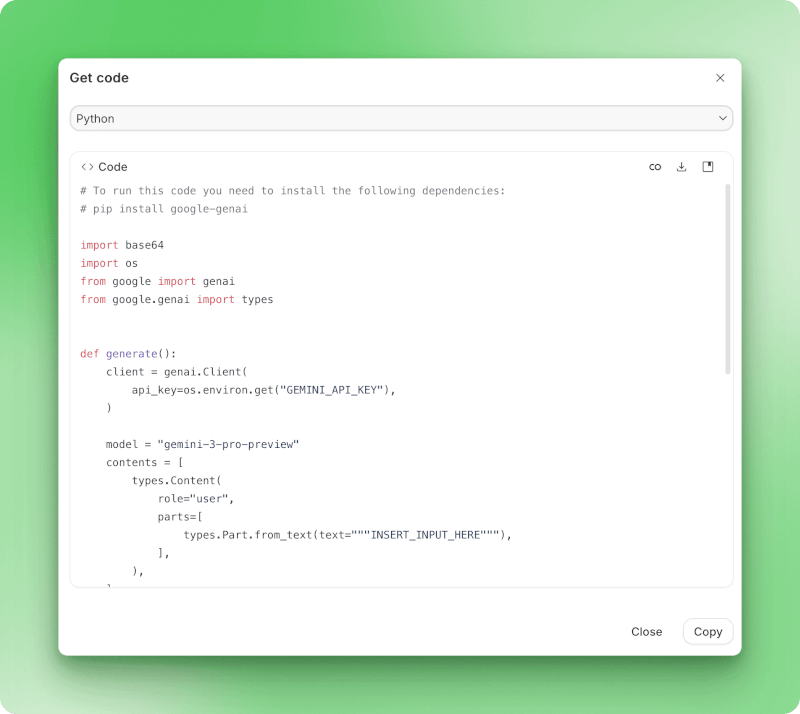

A janela de diálogo “Obter código” no Google AI Studio mostra a exportação do código Python com a implementação da API Gemini.

Quando você estiver pronto para passar do teste para a produção, “Obter código” exporta tudo como código de implementação.

O modo Stream vai além, adicionando interações de voz e vídeo.

Modo Stream do AI Studio (API ao vivo)

O modo Stream transforma mensagens de texto em conversas onde o Gemini pode te ver e ouvir. Você fala com o modelo pelo microfone, mostra sua tela e recebe respostas faladas em tempo real, sem precisar digitar.

Pra acessar o modo stream, dá pra ir até https://aistudio.google.com/live.

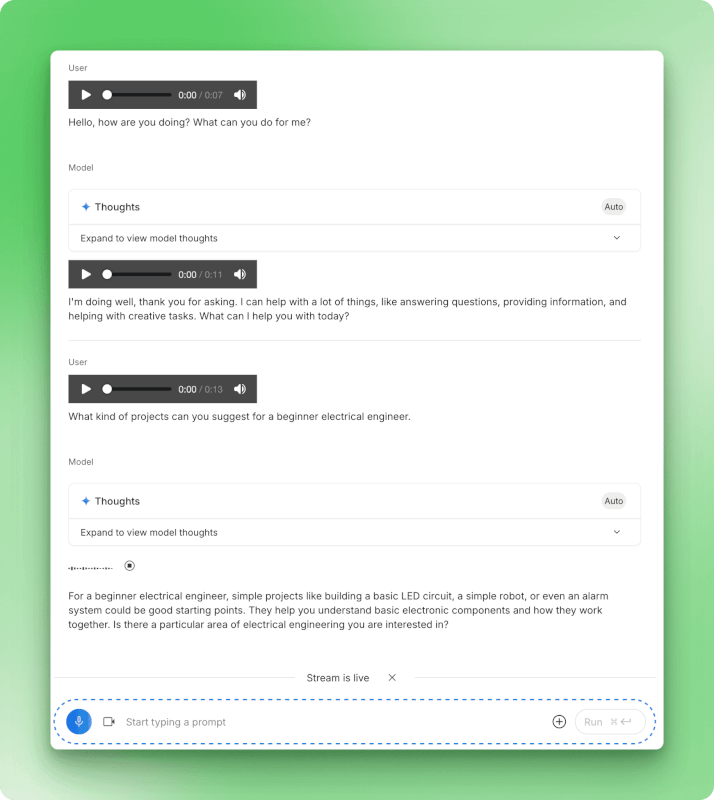

Interface do modo Stream do Google AI Studio mostrando os botões Talk, Webcam e Share Screen com configurações de voz e opções de configuração na barra lateral

A interface oferece três opções: Use o recurso de voz pra interagir só por voz, a webcam pra incluir um vídeo seu ou o recurso de compartilhamento de tela pra mostrar o que tá na sua tela.

A detecção de atividade de voz rola automaticamente. O Gemini espera você fazer uma pausa antes de responder, pra que você possa pensar bem na sua explicação sem clicar em nada entre as jogadas. O modelo processa sua voz, qualquer vídeo da sua webcam e tudo o que você estiver mostrando ao mesmo tempo.

Você pode até escolher vozes diferentes para as respostas do modelo, como a voz “Zephyr” mostrada nas configurações. O raciocínio interno do modelo aparece em seções de Pensamentos expansíveis, permitindo que você veja como ele chegou a cada resposta.

Conversa em modo de transmissão mostrando interação de voz com formas de onda de áudio, pensamentos do modelo e respostas em tempo real entre o usuário e o Gemini.

A interação sem usar as mãos funciona bem para aulas particulares ao vivo, onde você precisa mostrar seu trabalho e receber orientações verbais na hora.

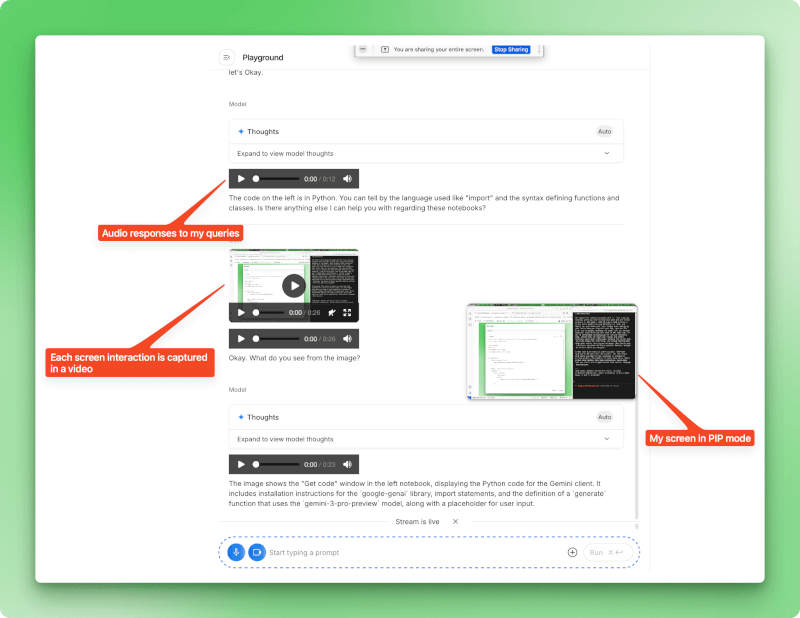

Você pode resolver um problema matemático enquanto explica seu raciocínio em voz alta, e o Gemini pode identificar onde sua lógica falha. A depuração fica mais rápida quando você pode mostrar seu IDE e descrever o erro que está vendo. A sua tela aparece no modo picture-in-picture, para que o Gemini possa ver exatamente o que você está referenciando.

Modo de transmissão com compartilhamento de tela ativo, mostrando a imagem em imagem da tela compartilhada e respostas de áudio enquanto o Gemini analisa o conteúdo exibido.

Se você estiver ensaiando uma apresentação ou fazendo uma demonstração, o modo Stream pode assistir aos seus slides e responder a perguntas sobre o conteúdo. Isso também ajuda quando você está aprendendo a usar um novo software. Você pode mostrar sua interface ao Gemini, perguntar onde encontrar um recurso específico e obter instruções enquanto navega.

O modo Stream é ideal pra quando você quer uma conversa em tempo real com voz e imagens. Para trabalhos com muito texto, em que você precisa copiar respostas ou repetir prompts escritos, o modo Chat ainda faz mais sentido. Enquanto o modo Stream lida com interações em tempo real, o modo Build permite criar aplicativos inteiros a partir de descrições em linguagem natural.

Modo de construção do AI Studio (Vibe Coding)

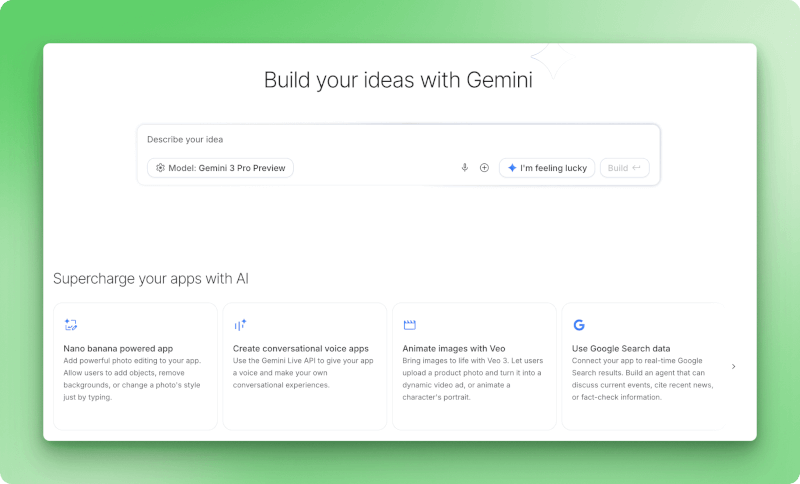

O modo de construção transforma descrições em aplicativos React funcionais. Você digita o que quer e o modelo escreve o código. O Google chama isso de “vibe coding”, mas é só uma questão de criar um protótipo em menos de um minuto.

Página inicial do modo de construção mostrando a caixa de entrada de prompt com o seletor de modelo Gemini 3 Pro Preview, o botão “Estou com sorte” e a seção AI Chips exibindo opções para o aplicativo Nano Banana, aplicativos de voz conversacionais, animação de vídeo Veo e integração de dados do Google Search.

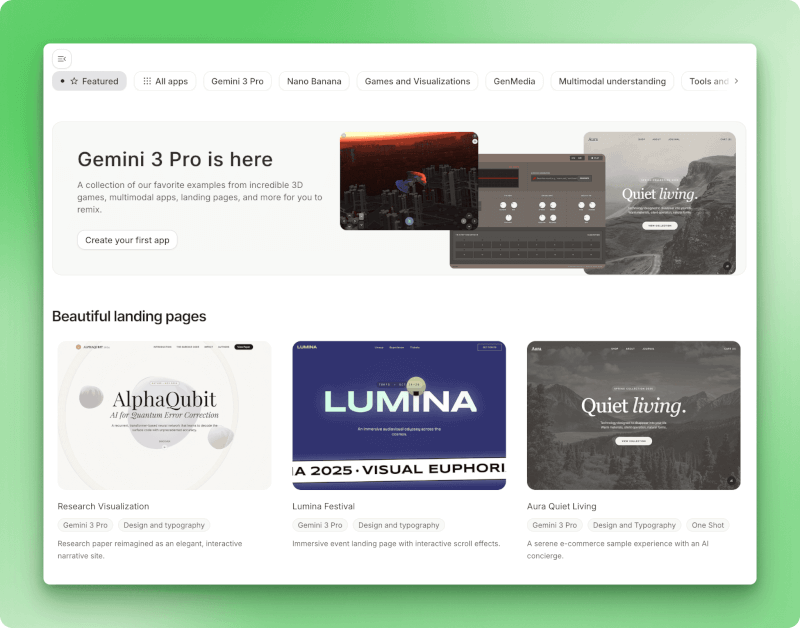

Primeiro, dei uma olhada na galeria inicial. Apps como o Shader Pilot mostram o que é possível fazer: visualizações 3D interativas, páginas de destino com tipografia personalizada e até pequenos jogos. Você pode bifurcar qualquer exemplo e modificar o código através do painel assistente.

Galeria de aplicativos iniciais mostrando exemplos em destaque do Gemini 3 Pro, incluindo jogos 3D, aplicativos multimodais e uma seção de belas páginas iniciais com visualização de pesquisa AlphaQubit, página do evento Lumina Festival e demonstração de comércio eletrônico Aura Quiet Living.

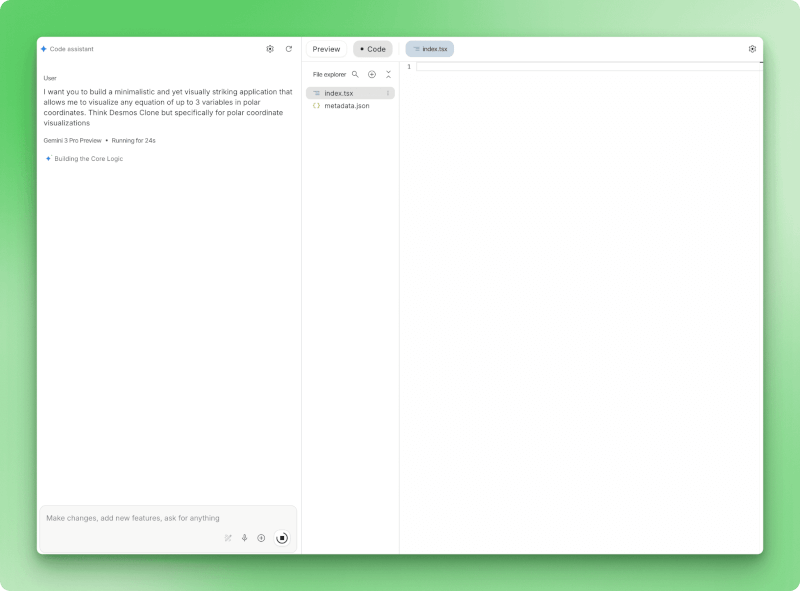

Queria construir do zero, então digitei: “um aplicativo minimalista, mas visualmente impressionante, que me permita visualizar qualquer equação de até 3 variáveis em coordenadas polares”.

O Polar.ai sendo construído, mostrando o prompt do usuário solicitando o visualizador de equações de coordenadas polares, o indicador de status do Gemini 3 Pro Preview exibindo “Em execução há 24 segundos” com a mensagem de progresso “Construindo a lógica central” e o painel do explorador de arquivos mostrando os arquivos index.tsx e metadata.json gerados.

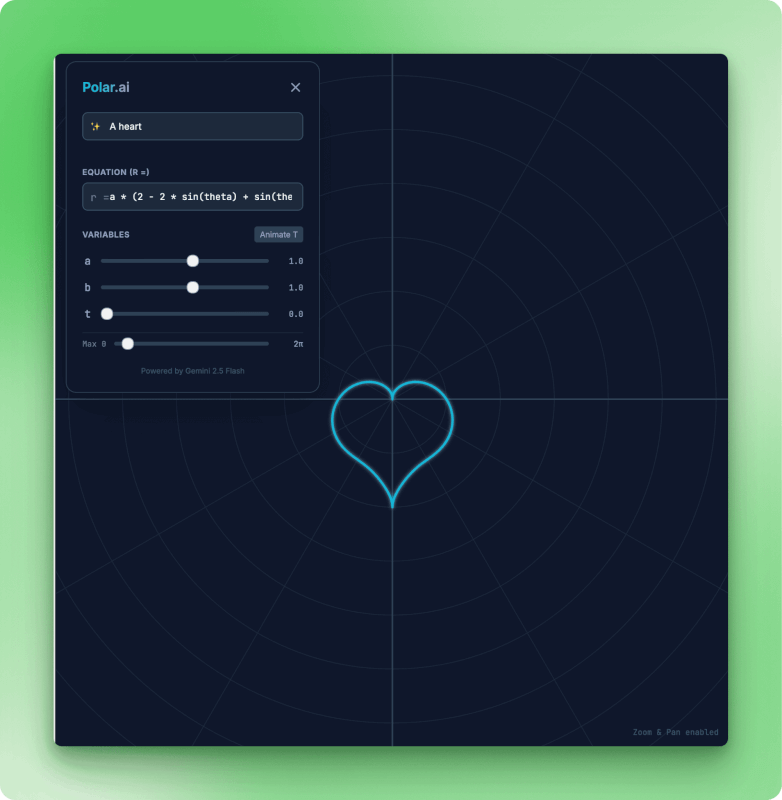

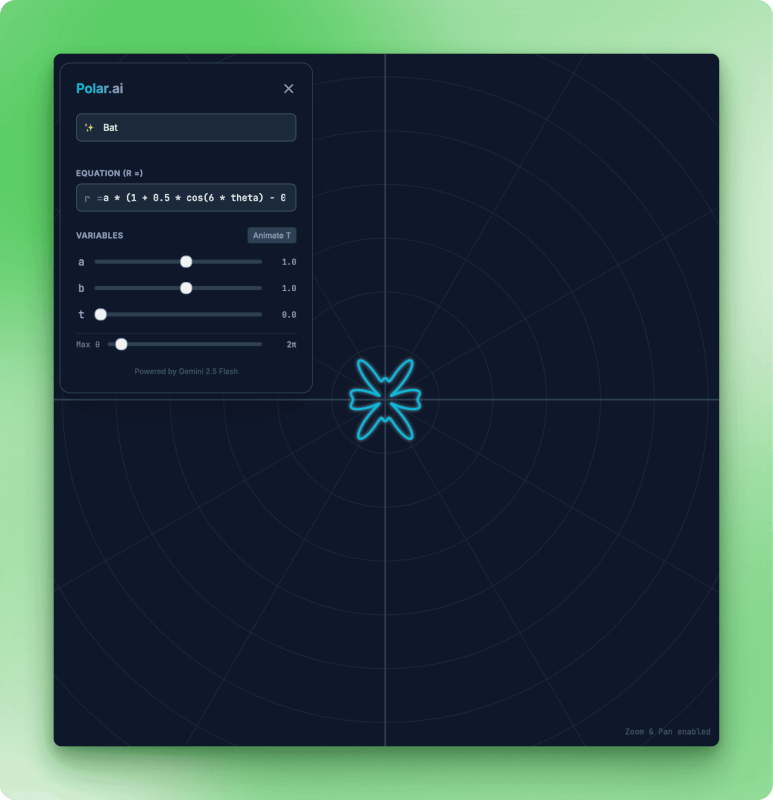

Uns 60 segundos depois, o Polar.ai apareceu. O modelo criou arquivos React (index.tsx, metadata.json), montou um analisador de equações e configurou controles deslizantes de variáveis. Digitei “um coração” e vi como desenhou a curva polar. Mudar para “bat” deu uma forma diferente.

Aplicativo Polar.ai mostrando uma curva polar em forma de coração em ciano sobre um fundo escuro, com um editor de equações mostrando a fórmula r igual a a vezes seno, controles deslizantes variáveis para a, b, t definidos como 1,0, teta máxima em 2 pi, botão Animate T e crédito Powered by Gemini 2.5 Flash.

Aplicativo Polar.ai mostrando visualização polar em forma de morcego com padrão simétrico de seis lóbulos em ciano, editor de equações exibindo fórmula cosseno modificada com controles variáveis para ajustar os parâmetros da curva a definido como 1,0, b em 1,0, t em 0,0 e controle deslizante Max theta.

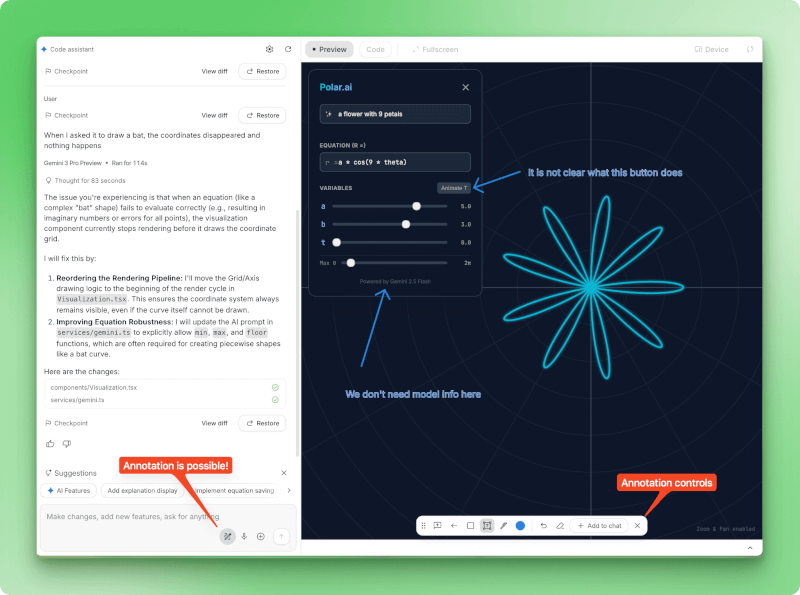

Quando as coordenadas do bastão sumiram no meio da curva, eu falei sobre o problema no chat. O modelo diagnosticou o problema (números imaginários quebrando o renderizador), explicou a correção e criou um ponto de verificação com “Exibir diferenças” para que eu pudesse ver o que mudou.

Sessão de depuração do Polar.ai mostrando o painel esquerdo com o relatório de bug do usuário sobre o desaparecimento das coordenadas do morcego, resposta do modelo analisando o problema do número imaginário na avaliação da equação com 83 segundos de tempo de reflexão, plano detalhado de correção para reordenar o pipeline de renderização, controles de ponto de verificação com os botões Exibir diferenças e Restaurar, e painel direito exibindo visualização ao vivo com barra de ferramentas de anotação na parte inferior mostrando ferramentas de desenho e opção Adicionar ao chat.

A barra de ferramentas de anotação permite que você clique nos elementos da interface para pedir mudanças visuais. Quando seu aplicativo estiver funcionando, exporte-o como um download ZIP, envie para o GitHub ou implante em uma hospedagem na nuvem. O código gerado usa padrões padrão do React, mas você provavelmente precisará refinar antes de implantar na produção.

Barra de ferramentas de exportação mostrando o status Não salvo com seis ícones de ação para salvar o projeto no Google Drive, baixar como arquivo ZIP, enviar para o repositório GitHub, implantar na hospedagem em nuvem, compartilhar por meio de link e opções de gerenciamento de projeto.

Google AI Studio vs Alternatives

Quando você estiver pronto para levar o trabalho de IA além da plataforma do Google, vai encontrar diferentes vantagens e desvantagens nos serviços concorrentes. A biblioteca extensa de plug-ins e a memória entre sessões do chatGPT fizeram dele a escolha padrão para muitos usuários.

Claude mira desenvolvedores com Artifacts que transformam conversas em aplicativos persistentes, conectando-se ao Slack ou Asana por meio de conexões MCP.

O Grok se conecta ao feed em tempo real do X, mas fica para trás em tarefas complexas de raciocínio. Pra ver uma comparação detalhada do desempenho do Gemini e do chatGPT em diferentes benchmarks, dá uma olhada na nossa análise comparativa entre o Gemini e o chatGPT.

|

Plataforma |

Nível gratuito |

Nível pago |

Principais pontos fortes |

Ideal para |

|

Google AI Studio |

Limitado (5-15 RPM, modelos premium pagos) |

Pagamento conforme o uso |

Modo de construção, modo de transmissão, vídeo (Veo 3), mapas de aterramento |

Prototipagem multimodal, experimentando com o Gemini |

|

ChatGPT |

10-60 msgs/5hr (GPT-4o) |

R$ 20/mês |

Memória, plugins, ecossistema maduro |

Tarefas gerais, fluxos de trabalho estabelecidos |

|

Claude |

20-40 mensagens por dia |

R$ 20/mês |

Artefatos, Projetos (200K), bom em programação |

Prototipagem de aplicativos, ajuda com programação |

|

Grok |

2-10 avisos/2 horas |

R$ 40/mês |

Dados X em tempo real, imagens Aurora |

Integração X, uso leve |

A situação do nível gratuito varia bastante entre as plataformas:

- : 5-15 solicitações/minuto para os modelos Gemini 2.5, mas o Gemini 3 Pro precisa de pagamento.

- ChatGPT: 10-60 mensagens GPT-4o a cada 5 horas antes de mudar para mini.

- Claude: Cerca de 20 a 40 mensagens por dia com intervalos de 5 horas entre elas.

- Grok: 2-10 avisos a cada 2 horas.

O chatGPT e o Claude cobram US$ 20 por mês para acesso total à web. A Grok dobrou isso para US$ 40. Mas, pra API, o Grok é o melhor, com US$ 0,20 por milhão de tokens, contra US$ 5 do GPT-4o ou US$ 3 do Claude Sonnet.

O orçamento e as prioridades influenciam essa decisão de maneira diferente para cada pessoa. Se você está criando protótipos de aplicativos multimodais, o modo Build e a geração de vídeo do AI Studio podem justificar seus limites de taxa mais restritos.

O ecossistema chatGPT está bombando: plugins, memória e fluxos de trabalho já estabelecidos fazem com que mudar seja bem complicado. Os projetos de 200 mil tokens de Claude são legais para desenvolvedores que precisam de janelas de contexto grandes para código. A Grok encontrou seu nicho no acesso barato à API (US$ 0,20 por milhão de tokens) e na integração em tempo real com o X, aceitando a troca entre desempenho e custo.

Conclusão

Neste tutorial, mostrei como o Google AI Studio lida com três fluxos de trabalho diferentes: testar prompts no modo Chat, criar aplicativos por meio de linguagem natural no modo Build e discutir problemas por meio de voz e vídeo no modo Stream. A plataforma funciona melhor quando você precisa criar protótipos com modelos Gemini sem escrever código de configuração.

Os limites da tarifa gratuita (5 a 15 solicitações por minuto) são perfeitos para testes iniciais. Quando estiver pronto para integrar o Gemini em aplicativos de produção, recomendo conferir o tutorial da API do Gemini, que fala sobre autenticação, tratamento de erros e padrões de otimização.

O ponto forte da AI Studio é a prototipagem rápida. Você pode testar uma ideia no modo Chat, desenvolvê-la no modo Build e, quando estiver funcionando, exportar o código. A interface baseada no navegador elimina o atrito habitual, mas você ainda precisará de uma integração API adequada para uso em produção.

Perguntas frequentes sobre o Google AI Studio

O que é o Google AI Studio?

O Google AI Studio é uma plataforma gratuita, baseada em navegador, para prototipagem com modelos Gemini AI. Ele oferece o modo Chat para testar prompts, o modo Build para criar aplicativos React a partir de linguagem natural e o modo Stream para interações de voz e vídeo, tudo sem precisar escrever código de configuração.

O Google AI Studio é de graça?

Sim, o Google AI Studio tem um plano gratuito com limites de taxa de 5 a 15 solicitações por minuto, dependendo do modelo. Não precisa de cartão de crédito pra começar. Os modelos Gemini 2.5 estão disponíveis gratuitamente, mas o Gemini 3 Pro é pago.

O que você pode criar com o modo Build do Google AI Studio?

O modo de construção (também chamado de “codificação vibe”) transforma descrições em linguagem natural em aplicativos React funcionais em menos de um minuto. Você pode criar visualizações interativas, páginas de destino, pequenos jogos e aplicativos de dados. O código gerado pode ser exportado como um arquivo ZIP, enviado para o GitHub ou implantado em uma hospedagem na nuvem.

Como o Google AI Studio se compara ao chatGPT?

O Google AI Studio foca em prototipagem e desenvolvimento com recursos como o modo Build para criar aplicativos React e o modo Stream para interações de voz/vídeo. O chatGPT oferece um ecossistema mais maduro com plug-ins e memória entre sessões. O AI Studio funciona melhor para prototipagem multimodal com modelos Gemini, enquanto o chatGPT é mais adequado para tarefas gerais e fluxos de trabalho estabelecidos.

Preciso ter experiência em programação pra usar o Google AI Studio?

Não precisa saber programar pra usar o modo Chat e o modo Stream. O modo de construção gera código para você a partir de descrições em linguagem natural, embora entender o React ajude a refinar as aplicações geradas. A plataforma foi criada pra deixar os modelos Gemini acessíveis tanto pra desenvolvedores quanto pra usuários que não são técnicos.

Sou um criador de conteúdo de ciência de dados com mais de 2 anos de experiência e um dos maiores seguidores no Medium. Gosto de escrever artigos detalhados sobre IA e ML com um estilo um pouco sarcástico, porque você precisa fazer algo para torná-los um pouco menos monótonos. Produzi mais de 130 artigos e um curso DataCamp, e estou preparando outro. Meu conteúdo foi visto por mais de 5 milhões de pessoas, das quais 20 mil se tornaram seguidores no Medium e no LinkedIn.