Kurs

Geleneksel olarak, veri ambarları yapılandırılmış veri ve iş zekâsı için başvurulan çözümdü. Ancak büyük veri, yapay zekâ ve makine öğreniminin yükselişiyle, hem veri ambarlarının hem de veri göllerinin güçlü yanlarını birleştiren daha yeni bir mimari—veri lakehouse—ortaya çıktı.

Bu rehberde şunları inceleyeceğiz:

- Veri ambarları ve veri lakehouse’ların ne olduğu ve nasıl ayrıştığı.

- Her mimarinin başlıca özellikleri, avantajları ve zorlukları.

- Gerçek dünyadan, birinin diğerine tercih edilebileceği kullanım örnekleri.

- Her iki dünyanın en iyilerini kullanan hibrit yaklaşımın ne zaman uygun olduğu.

Haydi başlayalım!

Veri Ambarı Nedir?

Veri ambarı; iş zekâsı (BI), raporlama ve analitik için verileri depolayan, düzenleyen ve analiz eden merkezi bir sistemdir. Birçok kaynaktan yapılandırılmış veriyi entegre eder ve yüksek derecede düzenli bir şema izleyerek tutarlılık ve güvenilirlik sağlar. Veri ambarları, işletmelerin veriye dayalı kararları verimli şekilde almasına yardımcı olmada merkezi bir rol oynar.

Özellikler

- Yazımda şema (schema-on-write): Veriler yüklenmeden önce dönüştürülür ve yapılandırılır; önceden tanımlı bir şemaya uyarlanarak sorgu için optimize edilir.

- Yüksek performans: Karmaşık sorgular için optimize edilmiştir; hızlı toplulaştırmalar, birleştirmeler ve analitik sağlar.

- ACID uyumluluğu: Kritik uygulamalar için güvenilir, tutarlı ve doğru veri sağlar.

- Tarihsel veri yönetimi: Eğilim analizi, tahminleme ve uyumluluk için yıllara yayılan verileri depolar.

- Veri entegrasyonu: Birden çok kaynaktan (ERP, CRM, işlem veritabanları) gelen verileri tek bir havuzda birleştirir.

- Güvenlik ve yönetişim: Roller tabanlı erişim kontrolü (RBAC), veri şifreleme ve kurumsal güvenlik için uyumluluk özellikleri sunar.

Kullanım alanları

- Finansal raporlama ve düzenleyici uyumluluk: SOX, HIPAA ve GDPR gibi düzenlemeler için doğru ve denetlenebilir kayıtlar sağlar.

- İş zekâsı panoları: Veriye dayalı kararlar için gerçek zamanlı ve tarihsel BI panolarını besler.

- Operasyonel raporlama: Günlük iş operasyonları için önceden tanımlı, yapılandırılmış sorguları destekler.

- Müşteri analitiği: Yapılandırılmış veri kümeleriyle müşteri segmentasyonu, davranış analizi ve terk tahmini yapmayı mümkün kılar.

- Tedarik zinciri ve lojistik: Tarihsel eğilimlerle stok yönetimini, talep tahminini ve operasyonel verimliliği optimize eder.

Araç örnekleri

- Snowflake: Ölçeklenebilirliği ve kullanım kolaylığıyla bilinen bulut tabanlı bir veri ambarı.

- Amazon Redshift: AWS’in veri ambarı hizmeti; hızlı sorgu performansı ve diğer AWS araçlarıyla entegrasyon sunar.

- Google BigQuery: Analitik için tasarlanmış sunucusuz, yüksek ölçeklenebilir bir veri ambarı.

Veri Lakehouse Nedir?

Veri lakehouse; veri gölünün ölçeklenebilirliği ve esnekliğini, veri ambarının yapılandırılmış performansı ve güvenilirliğiyle birleştiren modern bir veri mimarisidir. Kuruluşların yapılandırılmış, yarı yapılandırılmış ve yapılandırılmamış verileri tek bir sistemde depolamasına, yönetmesine ve analiz etmesine olanak tanır.

Özellikler

- Okumada şema ve yazımda şema: Esneklik için ham veri alımını ve geleneksel analitik için yapılandırılmış veri kümelerini destekler.

- Çeşitli veri türleri: Yapılandırılmış (veritabanları), yarı yapılandırılmış (JSON, XML) ve yapılandırılmamış (görüntüler, videolar) verileri işler.

- Modern iş yüklerine optimize: Analitik, yapay zekâ, makine öğrenimi ve akış veri alımı için tasarlanmıştır.

- Birleşik depolama: Veri göllerinin ölçeklenebilirliğini veri ambarlarının performansıyla birleştirir.

- Maliyet etkinliği: Depolama ve işlemeyi birleştirerek operasyonel maliyetleri düşürür.

- Yerleşik yönetişim ve güvenlik: Veri bütünlüğü ve mahremiyetini sağlamak için ayrıntılı erişim kontrolü, denetim ve uyumluluk özellikleri sunar.

Kullanım alanları

- Büyük veri analitiği: Büyük ölçekli analiz için muazzam miktarda yapılandırılmış ve yapılandırılmamış veriyi depolar ve işler.

- Yapay zekâ ve makine öğrenimi hatları: Esnek veri alımıyla özellik mühendisliği, model eğitimi ve çıkarım sağlar.

- Gerçek zamanlı veri işleme: Sahtekârlık tespiti, öneri sistemleri ve IoT uygulamaları için akış analitiğini destekler.

- Kurumsal veri konsolidasyonu: Operasyonel ve analitik iş yüklerini birleştirerek veri çoğaltmasını ve karmaşıklığı azaltır.

Araç örnekleri

- Databricks: Delta Lake’i temel alarak lakehouse mimarisini uygulamasıyla bilinen birleşik analitik platformu.

- Delta Lake: Veri göllerine güvenilirlik ve performans iyileştirmeleri sağlayan açık kaynaklı bir depolama katmanı.

- Apache Iceberg: Veri göllerinde büyük ölçekli, çok modlu analitik için tasarlanmış yüksek performanslı bir tablo formatı.

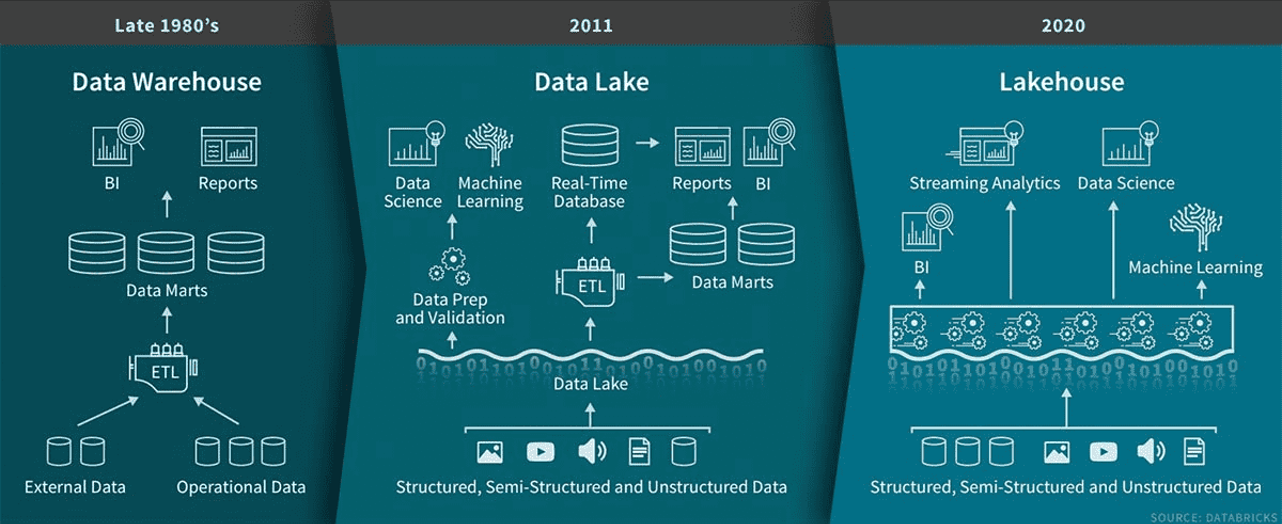

Veri mimarisinin 1980’lerin sonlarındaki veri ambarlarından 2011’de veri göllerine ve nihayet 2020’de lakehouse’lara evrimi. Görsel kaynağı: Databricks.

Veri Lakehouse’lar ve Veri Ambarları Arasındaki Farklar

Veri lakehouse’lar ile veri ambarları arasındaki temel farkları anlamak, hangi çözümün ihtiyaçlarınıza en uygun olduğunu belirlemenize yardımcı olur. Aşağıda temel ayrımlarının bir dökümü yer alıyor.

Desteklenen veri türleri

Veri lakehouse’lar çeşitli veri türlerini ele alır ve bu da onları farklı iş yükleri için ideal kılar. Şunları destekler:

- Yapılandırılmış veri: Satış işlemleri, ilişkisel veritabanları

- Yarı yapılandırılmış veri: JSON kullanıcı profilleri, sensör okumaları

- Yapılandırılmamış veri: IoT günlükleri, görseller, ses dosyaları.

Veri ambarları esas olarak yapılandırılmış ve kısmen yarı yapılandırılmış veriyi depolar; bu da onları finansal raporlama ve analitik gibi geleneksel iş süreçleri için daha uygun kılar.

Örnek: Veri lakehouse kullanan bir perakende şirketi, müşteri duyarlılığını değerlendirmek için tıklama akışı günlüklerini, sosyal medya verilerini ve işlem kayıtlarını analiz edebilir.

Maliyet etkinliği

Veri lakehouse’lar maliyet etkin bulut depolamadan (örn. Amazon S3, Azure Data Lake Storage) yararlanır ve okumada şemayı destekler; bu da ETL ön işleme maliyetlerini azaltır.

Veri ambarları genellikle daha pahalıdır çünkü yapılandırılmış depolama, ETL işleme ve özgün formatlar gerektirir.

Örnek: Ham ve işlenmiş veriler için düşük maliyetli depolama ihtiyacı olan bir girişim, veri lakehouse’un veri ambarına kıyasla daha uygun maliyetli olduğunu görebilir.

Performans

Veri lakehouse’lar gerçek zamanlı ve toplu işlemeyi destekler; bu da onları büyük veri analitiği ve makine öğrenimi için ideal kılar. Dağıtık mimarileri, büyük veri kümelerinin yüksek hızda işlenmesini sağlar.

Veri ambarları, SQL tabanlı sorgularda ve işlem odaklı iş yüklerinde mükemmeldir; yapılandırılmış veri için hızlı ve tutarlı performans sunar.

Örnek: Gerçek zamanlı sahtekârlık tespiti yapan bir finans kurumu, akış verisini işleme becerisi sayesinde veri lakehouse’tan yararlanabilir.

Makine öğrenimiyle entegrasyon

Veri lakehouse’lar ML araçlarıyla yerel olarak entegre olur; TensorFlow, PyTorch ve Databricks ML gibi araçlarla büyük veri kümeleri üzerinde doğrudan model eğitimi sağlar.

Veri ambarlarının ML desteği sınırlıdır ve çoğu zaman analiz için verilerin haricî sistemlere aktarılmasını gerektirir.

Örnek: Databricks kullanan bir teknoloji şirketi, veri lakehouse içinde doğrudan yapay zekâ destekli öneri sistemleri geliştirebilir.

Ölçeklenebilirlik

Veri lakehouse’lar petabaytlarca veriye ölçeklenirken çoklu motor işlemeyi destekler.

Veri ambarları yapılandırılmış veri için iyi ölçeklenir ancak çok büyük yapılandırılmamış veri kümelerinde zorlanır.

Örnek: Bir telekom sağlayıcısı, günde milyarlarca çağrı kaydını işlemek için lakehouse’u ölçekleyebilirken, geleneksel bir ambar IoT günlüklerinde zorlanabilir.

Kullanıcı türleri

Veri lakehouse’lar, gerçek zamanlı analitik, ML hatları ve keşif amaçlı analizle çalışan veri bilimcileri, analistler ve mühendislere hizmet eder.

Veri ambarları ise esas olarak raporlama ve panolar için ön işlenmiş, yapılandırılmış veriye güvenen iş analistlerine ve yöneticilere hitap eder.

Örnek: Bir pazarlama ekibi BI panoları için veri ambarını kullanırken, bir veri bilimi ekibi kestirimsel modelleme için veri lakehouse’u tercih edebilir.

Veri Lakehouse’lar ve Veri Ambarları: Özet

Burada, veri lakehouse ve veri ambarlarını önceki bölümlerde tartışılandan daha teknik ayrıntılarla karşılaştıran detaylı bir tablo yer almaktadır:

|

Özellik |

Veri Lakehouse |

Veri Ambarı |

|

Desteklenen Veri Türleri |

Yapılandırılmış, yarı yapılandırılmış ve yapılandırılmamış (JSON, görseller, videolar, IoT günlükleri) |

Ağırlıkla yapılandırılmış; sınırlı yarı yapılandırılmış destek (JSON, XML) |

|

Depolama Formatı |

Açık formatlar (Parquet, ORC, Delta, Iceberg) |

Özgün (proprietary) yapılandırılmış formatlar |

|

Şema Yönetimi |

Okumada şema & yazımda şema (esnek) |

Yazımda şema (katı) |

|

Sorgu Performansı |

Hem toplu hem gerçek zamanlı sorgular için optimize |

Yapılandırılmış SQL sorguları için optimize |

|

İşleme Motoru |

Birden çok motoru destekler (Spark, Presto, Trino, Dremio) |

SQL tabanlı motorlar (Snowflake, Redshift, BigQuery) |

|

Maliyet Etkinliği |

Ucuz bulut nesne depolaması ve daha az ön işleme sayesinde daha düşük maliyet |

ETL, yapılandırılmış depolama ve özgün formatlar nedeniyle daha yüksek maliyet |

|

Ölçeklenebilirlik |

Çeşitli iş yükleriyle (yapılandırılmış ve yapılandırılmamış) kolayca ölçeklenir |

Yapılandırılmış veri için iyi ölçeklenir ancak çok büyük yapılandırılmamış veri kümelerinde zorlanır |

|

Makine Öğrenimi (ML) Desteği |

TensorFlow, PyTorch ve Databricks ML ile yerleşik ML entegrasyonu |

Sınırlı ML entegrasyonu; sıklıkla veri ihracı gerekir |

|

Gerçek Zamanlı Veri Akışı |

Gerçek zamanlı alım ve analitiği destekler (Kafka, Spark Streaming) |

Sınırlı gerçek zamanlı destek; ağırlıkla toplu işleme |

|

En Uygun Olduğu Alanlar |

AI/ML iş yükleri, gerçek zamanlı analitik, büyük veri, IoT |

İş zekâsı, raporlama, yapılandırılmış analitik |

|

Güvenlik & Yönetişim |

Gelişmiş güvenlik, erişim kontrolü ve denetim |

Yapılandırılmış veri için güçlü güvenlik ve uyumluluk kontrolleri |

|

Örnek Kullanım Senaryoları |

Sahtekârlık tespiti, öneri sistemleri, IoT analitiği, AI model eğitimi |

Finansal raporlama, operasyonel panolar, düzenleyici uyumluluk |

|

Popüler Araçlar & Platformlar |

Databricks, Snowflake (Iceberg/Delta ile), Apache Hudi, Google BigLake |

Amazon Redshift, Google BigQuery, Snowflake, Microsoft Synapse |

Veri Ambarları ve Veri Lakehouse’ların Artıları ve Eksileri

Bu bölümde, dengeli bir bakış sunmak için her mimarinin temel avantaj ve dezavantajlarını ele alıyoruz.

Veri ambarlarının artıları ve eksileri

|

Artılar ✅ |

Eksiler ❌ |

|

Yapılandırılmış veri için optimize – SQL tabanlı sorgu ve analitiklerde yüksek performans sağlar. |

Yapılandırılmamış veri desteği sınırlı – Görseller, videolar, IoT günlükleri gibi formatlarda zorlanır. |

|

Hızlı sorgu performansı – Dizinleme ve sıkıştırmayla toplulaştırmalar, birleştirmeler ve karmaşık sorgular için tasarlanmıştır. |

Yüksek depolama ve işlem maliyetleri – Bulut tabanlı nesne depolamaya kıyasla pahalıdır. |

|

ACID uyumluluğu – Finansal ve düzenleyici uygulamalar için kritik olan veri bütünlüğü, güvenilirlik ve tutarlılık sağlar. |

Katı yazımda şema yaklaşımı – Verinin alımdan önce temizlenip yapılandırılması gerekir; ETL karmaşıklığını artırır. |

|

BI ve raporlama için harika – Power BI, Tableau, Looker ile sorunsuz çalışır ve gerçek zamanlı panoları etkinleştirir. |

Makine öğrenimi için ideal değil – ML iş akışları, ön işleme için verinin haricî platformlara aktarılmasını gerektirir. |

|

Yüksek güvenlik ve yönetişim – Güçlü RBAC, şifreleme ve uyumluluk kontrolleri (örn. GDPR, HIPAA). |

Büyük veri için ölçeklendirmesi zor – Daha ölçeklenebilir mimarilere kıyasla çok büyük veri kümelerinde zorlanır. |

Veri lakehouse’ların artıları ve eksileri

|

Artılar ✅ |

Eksiler ❌ |

|

Tüm veri türlerini destekler – Yapılandırılmış, yarı yapılandırılmış ve yapılandırılmamış veriyi tek bir sistemde işleyebilir. |

Sorgu performansı daha yavaş olabilir – Büyük ölçekli analitik için optimize olsa da, yapılandırılmış veri sorgularında ek ayar gerekebilir. |

|

Esnek okumada/yazımda şema – ML iş yükleri için ham veri alımını desteklerken BI için yapılandırılmış depolamayı mümkün kılar. |

Daha fazla yönetişim çabası ister – Veri her zaman önceden yapılandırılmadığından, veri kalitesi ve erişim kontrolünü uygulamak daha karmaşıktır. |

|

Maliyet etkin depolama – Uygun fiyatlı ve ölçeklenebilir depolama için bulut nesne depolamasını (Amazon S3, Azure Data Lake) kullanır. |

Daha dik öğrenme eğrisi – Apache Iceberg, Delta Lake ve Hudi gibi modern veri araçlarına aşinalık gerektirir. |

|

AI ve ML iş yükleri için optimize – TensorFlow, PyTorch, Databricks ML ve gerçek zamanlı akış çerçeveleriyle sorunsuz entegre olur. |

Veri tutarlılığı zorlukları – Geniş, dağıtık veri kümelerinde ACID uyumluluğu sağlamak ek yapılandırmalar gerektirir. |

|

Gerçek zamanlı veri işleme – IoT cihazları, günlükler ve gerçek zamanlı olay kaynaklarından akış alımını destekler. |

Veri ambarlarına kıyasla daha az olgun – Geleneksel ambarlar, BI ve finansal raporlama için kanıtlanmış güvenilirlik geçmişine sahiptir. |

Ne Zaman Veri Ambarı Kullanmalı

Veri ambarları, yapılandırılmış veri, iş zekâsı ve düzenleyici uyumluluk için en uygunudur. Yüksek derecede düzenli, hızlı ve tutarlı analitiklere dayanıyorsanız doğru seçim veri ambarıdır.

Yapılandırılmış veri analitiği

- İyi tanımlanmış şema gereksinimlerine sahip temiz, yapılandırılmış veri kümeleri için idealdir.

- Analitik ve raporlama için tutarlılık ve performansın kritik olduğu durumlarda kullanın.

Örnek: Geniş mağaza ağından gelen yapılandırılmış satış verilerini analiz etmek için veri ambarı kullanan bir şirket. Bu sayede stok seviyeleri izlenir, en çok satan ürünler belirlenir ve gerçek zamanlı yeniden stoklama süreçleri optimize edilir.

İş zekâsı (BI) raporlaması

- Karar vericiler için panolar ve raporlar üretmek açısından en iyisidir.

- Şu araçları destekler: Power BI ve Tableau; optimize sorgu performansıyla.

Örnek: Paydaşlar için üç aylık kazanç raporları oluşturan bir finans hizmetleri firması.

Düzenleyici uyumluluk

- Sıkı veri doğruluğu ve denetim gereksinimleri olan sektörler için tasarlanmıştır.

- Finansal kayıtlar, sağlık verileri ve uyumluluk raporları için güvenilir depolama sağlar.

Örnek: Bir finans kurumu, Basel III ve GDPR gibi düzenlemelere uyumu sağlamak için işlem verilerini depolamak ve analiz etmek üzere veri ambarı kullanır. Bu merkezi yaklaşım, denetim izlerini yönetmeye ve sahtekârlığı önlemeye yardımcı olur.

Tarihsel veri analizi

- Uzun vadeli eğilim analizi ve stratejik karar alma için kullanın.

- Çok yıllı veri içgörülerine ihtiyaç duyan üretim veya enerji gibi sektörler için idealdir.

Örnek: Üretimi optimize etmek için tarihsel elektrik tüketimini analiz eden bir enerji şirketi.

Ne Zaman Veri Lakehouse Kullanmalı

Veri lakehouse; yapılandırılmış, yarı yapılandırılmış ve yapılandırılmamış veriyi işlerken AI, makine öğrenimi ve gerçek zamanlı analitiği destekleyen ölçeklenebilir, esnek bir sistem gerektiğinde idealdir.

Çeşitli veriler için birleşik depolama

- Yapılandırılmış, yarı yapılandırılmış ve yapılandırılmamış veriyi tek bir platformda birleştirmek için en iyisi.

- Veri silolarını azaltır ve dinamik veri erişimini destekler.

Örnek: Video içeriği, kullanıcı etkinliği günlükleri ve metaveriyi depolayan bir yayın platformu.

Makine öğrenimi ve AI iş akışları

- Ham veri keşfi, model eğitimi ve denemeler için mükemmel.

- Çeşitli veri kümeleri için okumada şema esnekliği sağlar.

Örnek: Bir şirket, ham yolculuk verileri, sürücü puanları ve GPS günlüklerini işlemek için veri lakehouse kullanır. Bu veriler, rota optimizasyonu, dinamik fiyatlandırma ve sahtekârlık tespiti için makine öğrenimi modellerini besler.

Gerçek zamanlı veri akışı

- Anlık veri alımı ve işlemesi gereken uygulamalar için kullanın.

- Sahtekârlık tespiti ve IoT analitiği gibi dinamik kullanım durumlarını destekler.

Örnek: IoT özellikli araçlar, gerçek zamanlı sensör verisini lakehouse mimarisine akıtır. Bu sayede bir şirket, araç performansını izleyebilir, anomalileri tespit edebilir ve kablosuz yazılım güncellemeleri yayımlayabilir.

Maliyet etkin büyük veri depolama

- Kapsamlı ön işleme olmadan ham veriyi depolayarak maliyetleri düşürür.

- Muazzam miktarda veri üreten kuruluşlar için verimli şekilde ölçeklenir.

Örnek: Metinler, görseller ve videolar gibi büyük miktarda ham kullanıcı içeriklerini depolayıp işlemek için veri lakehouse kullanan bir sosyal medya şirketi. Bu kurulum, duygu analizi yapmalarını, trend konuları tespit etmelerini ve reklam hedeflemesini optimize etmelerini sağlar.

Hibrit Çözümler: Veri Ambarları ve Veri Lakehouse’ları Birleştirmek

Veri ambarları ve lakehouse’lar farklı amaçlara hizmet etse de, birçok kuruluş performans, maliyet ve esneklik arasında denge kurmak için bu mimarileri birleştirir.

Hibrit bir yaklaşım, hızlı analitik için yapılandırılmış veriyi bir ambarlarda tutarken büyük veri, AI ve makine öğrenimi için lakehouse’tan yararlanmayı sağlar.

Hibrit yaklaşım iki katmanlı bir stratejiyi izler:

- Ham ve yarı yapılandırılmış veri veri lakehouse’ta (esnek, ölçeklenebilir, maliyet etkin)

-

- Çeşitli verileri (yapılandırılmış, yarı yapılandırılmış, yapılandırılmamış) bulut nesne depolamada (Amazon S3, Azure Data Lake, Google Cloud Storage) depolar.

- Veri bilimcileri ve AI/ML ekipleri için esneklik sağlamak üzere okumada şema kullanır.

- IoT cihazları, olay günlükleri ve akış platformlarından gerçek zamanlı veri alımını destekler.

- Yapılandırılmış ve temizlenmiş veri veri ambarında (hızlı analitik ve BI için optimize)

-

- Veri, bir ambara (Snowflake, Redshift, BigQuery, Synapse) konmadan önce filtrelenir, dönüştürülür ve yapılandırılır.

- Veri tutarlılığını sağlamak ve sorgu performansını optimize etmek için yazımda şema kullanır.

- İş zekâsı, panolar ve operasyonel raporlara hızlı erişim sağlar.

Hibrit bir veri mimarisi şu durumlarda faydalıdır:

- Yüksek hızlı BI raporlamasına ve ML/AI iş yükleri için esnek veri depolamaya ihtiyacınız varsa.

- Şirketiniz hem yapılandırılmış hem yapılandırılmamış verilerle çalışıyor ve yazımda/okumada şema yeteneklerine ihtiyaç duyuyorsa.

- Maliyetleri optimize etmek istiyor, yapılandırılmış ve yüksek değerli analitik için ambarı; maliyet etkin ham veri depolama için lakehouse’u kullanmak istiyorsanız.

- Yönetişimi sağlanmış tarihsel kayıtları korurken gerçek zamanlı veri alımı ve işlemeye ihtiyaç duyuyorsanız.

Sonuç

Bu rehberde veri ambarları ve veri lakehouse’lar arasındaki temel farklar, güçlü ve zayıf yönler ile kullanım alanları ve kuruluşların hibrit bir yaklaşım için sıkça her iki mimariyi nasıl birleştirdiği ele alındı.

Veri mimarileri evrilirken verimli ve geleceğe dönük veri sistemleri kurmak için bu kavramları anlamak kritik önemdedir. Bu konuları daha derinlemesine incelemek için şu kurslara göz atın:

- Data Warehousing Concepts – Veri ambarlarına, bileşenlerine ve analitikteki rolüne dair temel bir rehber.

- Databricks Concepts – Databricks’in ölçeklenebilir veri işleme ve makine öğrenimi için veri lakehouse mimarisini nasıl etkinleştirdiğini öğrenin.

SSS

Veri ambarından veri lakehouse’a nasıl geçiş yaparım?

Geçiş şunları içerir:

- Veri değerlendirme – Yapılandırılmış ve yapılandırılmamış kaynakları belirleyin.

- Platform seçimi – Databricks, Apache Iceberg veya Snowflake gibi araçlar lakehouse’ları destekler.

- ETL hatları oluşturma – Dönüşüm ve alım için Apache Spark veya dbt kullanın.

- Performans optimizasyonu – Dizinleme, önbellekleme ve bölümleme stratejileri uygulayın.

Veri lakehouse’ta yönetişim, veri ambarıyla karşılaştırıldığında nasıl çalışır?

Veri ambarlarında yönetişim; roller tabanlı erişim kontrolü (RBAC) ve önceden tanımlı şemalarla merkezidir.

Veri lakehouse’larda ise şunlar gereklidir:

- Ayrıntılı erişim kontrolleri (örn. AWS Lake Formation, Unity Catalog).

- Depolama katmanları arasında veri kümelerini izlemek için meta veri yönetimi.

- Okumada şema ortamlarında tutarlılık için veri kalitesi izleme.

Veri lakehouse benimserken karşılaşılan en büyük zorluklar nelerdir?

- Sorgu performansı ayarı – Dizinleme ve önbellekleme gibi optimizasyon teknikleri gerektirir.

- Veri tutarlılığı sorunları – ACID işlem desteği gerekir (örn. Delta Lake, Apache Iceberg).

- Öğrenme eğrisi – Ekiplerin geleneksel SQL tabanlı sistemlerin ötesindeki yeni araçları benimsemesi gerekir.

Lakehouse modelinde yapay zekâ ve makine öğreniminin rolü nedir?

Lakehouse’lar AI/ML için idealdir çünkü:

- Model eğitimi için yapılandırılmış, yarı yapılandırılmış ve yapılandırılmamış veriyi depolarlar.

- Databricks ML ve Spark ile gerçek zamanlı özellik mühendisliğine imkân tanır.

- Veri ihracı gerektirmeden isteğe bağlı model eğitimi desteklerler.

Ambarlardan farklı olarak, lakehouse’lar veri bilimcilerin ham verilerle doğrudan çalışmasına olanak tanır.

Veri lakehouse’ların ve ambarlarının geleceği nedir?

Sektör hibrit ve birleşik mimarilere doğru kayıyor.

- Bulut platformları, ambar çözümlerine lakehouse özellikleri entegre ediyor.

- Sunucusuz veri ambarları, ölçeklenebilirliği ve maliyet etkinliğini artırıyor.

- Data mesh mimarileri, veri sahipliğini ekipler arasında dağıtıyor.

Bu eğilimleri anlamak, veri profesyonellerinin önde kalmasına yardımcı olacaktır.

Sai, Python, Java, bulut platformları ve büyük veri analitiği konusunda uzmanlığa sahip bir yazılım mühendisidir ve UMBC’den Yazılım Mühendisliği yüksek lisans derecesine sahiptir. Çeşitli sektörlerde yapay zekâ modelleri, ölçeklenebilir IoT sistemleri ve veri odaklı projeler üzerinde deneyimlidir.