Cursus

Traditioneel waren datawarehouses de standaardoplossing voor gestructureerde data en business intelligence. Maar met de opkomst van big data, AI en machine learning is er een nieuwere architectuur ontstaan: de datalakehouse, die de sterke punten van zowel datawarehouses als datalakes combineert.

In deze gids behandelen we:

- Wat datawarehouses en datalakehouses zijn, en hoe ze van elkaar verschillen.

- Belangrijke features, voordelen en uitdagingen van elke architectuur.

- Use cases uit de praktijk waarin de ene de voorkeur kan hebben boven de andere.

- Wanneer je een hybride aanpak gebruikt die het beste van twee werelden benut.

Laten we erin duiken!

Wat is een datawarehouse?

Een datawarehouse is een gecentraliseerd systeem dat data opslaat, organiseert en analyseert voor business intelligence (BI), rapportage en analytics. Het integreert gestructureerde data uit meerdere bronnen en volgt een sterk georganiseerde schema, wat zorgt voor consistentie en betrouwbaarheid. Datawarehouses spelen een centrale rol bij het helpen van bedrijven om efficiënt datagedreven beslissingen te nemen.

Features

- Schema-on-write: Data wordt vóór het laden getransformeerd en gestructureerd volgens een vooraf gedefinieerd schema, geoptimaliseerd voor query’s.

- Hoge performance: Geoptimaliseerd voor complexe query’s, waardoor snelle aggregaties, joins en analyses mogelijk zijn.

- ACID-naleving: Zorgt voor betrouwbare, consistente en nauwkeurige data voor bedrijfskritische toepassingen.

- Beheer van historische data: Slaat jaren aan data op voor trendanalyse, forecasting en compliance.

- Dataintegratie: Combineert data uit meerdere bronnen (ERP, CRM, transactionele databases) in één centrale opslagplek.

- Beveiliging en governance: Biedt role-based access control (RBAC), dataversleuteling en compliance-features voor enterprisebeveiliging.

Use cases

- Financiële rapportage en wettelijke naleving: Zorgt voor nauwkeurige, controleerbare registraties voor regelgeving zoals SOX, HIPAA en AVG (GDPR).

- Business intelligence-dashboards: Levert realtime en historische BI-dashboards voor datagedreven besluitvorming.

- Operationele rapportage: Ondersteunt vooraf gedefinieerde, gestructureerde query’s voor dagelijkse bedrijfsvoering.

- Klantanalyses: Maakt klantsegmentatie, gedragsanalyse en churn-voorspelling mogelijk met gestructureerde datasets.

- Supply chain en logistiek: Optimaliseert voorraadbeheer, vraagvoorspelling en operationele efficiëntie met historische trends.

Voorbeelden van tools

- Snowflake: Een cloud-native datawarehouse dat bekendstaat om zijn schaalbaarheid en gebruiksgemak.

- Amazon Redshift: De datawarehousingdienst van AWS biedt snelle query-prestaties en integratie met andere AWS-tools.

- Google BigQuery: Een serverloos, zeer schaalbaar datawarehouse dat is ontworpen voor analytics.

Wat is een datalakehouse?

Een datalakehouse is een moderne data-architectuur die de schaalbaarheid en flexibiliteit van een datalake combineert met de gestructureerde performance en betrouwbaarheid van een datawarehouse. Het stelt organisaties in staat om gestructureerde, semi-gestructureerde en ongestructureerde data op te slaan, te beheren en te analyseren in één systeem.

Features

- Schema-on-read en schema-on-write: Ondersteunt het binnenhalen van ruwe data voor flexibiliteit en gestructureerde datasets voor traditionele analytics.

- Diverse datatypes: Verwerkt gestructureerde (databases), semi-gestructureerde (JSON, XML) en ongestructureerde (afbeeldingen, video’s) data.

- Geoptimaliseerd voor moderne workloads: Gebouwd voor analytics, AI, machine learning en streaming data-ingestie.

- Geünificeerde opslag: Combineert de schaalbaarheid van datalakes met de performance van datawarehouses.

- Kostenefficiëntie: Vermindert operationele kosten door opslag en verwerking te consolideren.

- Ingebouwde governance en beveiliging: Biedt fijnmazige toegangscontrole, auditing en compliance-features om dataintegriteit en privacy te waarborgen.

Use cases

- Big data-analytics: Slaat enorme hoeveelheden gestructureerde en ongestructureerde data op en verwerkt deze voor grootschalige analyses.

- AI- en machinelearningpijplijnen: Maakt feature engineering, modeltraining en inferentie mogelijk met flexibele data-ingestie.

- Realtime dataverwerking: Ondersteunt streaming analytics voor fraudedetectie, aanbevelingssystemen en IoT-toepassingen.

- Enterprise-dataconsolidatie: Vereenigt operationele en analytische workloads en vermindert dataduplicatie en complexiteit.

Voorbeelden van tools

- Databricks: Een unified analytics-platform dat bekendstaat om de lakehouse-architectuur met Delta Lake als basis.

- Delta Lake: Een open-source opslaglaag die betrouwbaarheid en performance toevoegt aan datalakes.

- Apache Iceberg: Een high-performance tabelindeling voor grootschalige, multimodale analytics op datalakes.

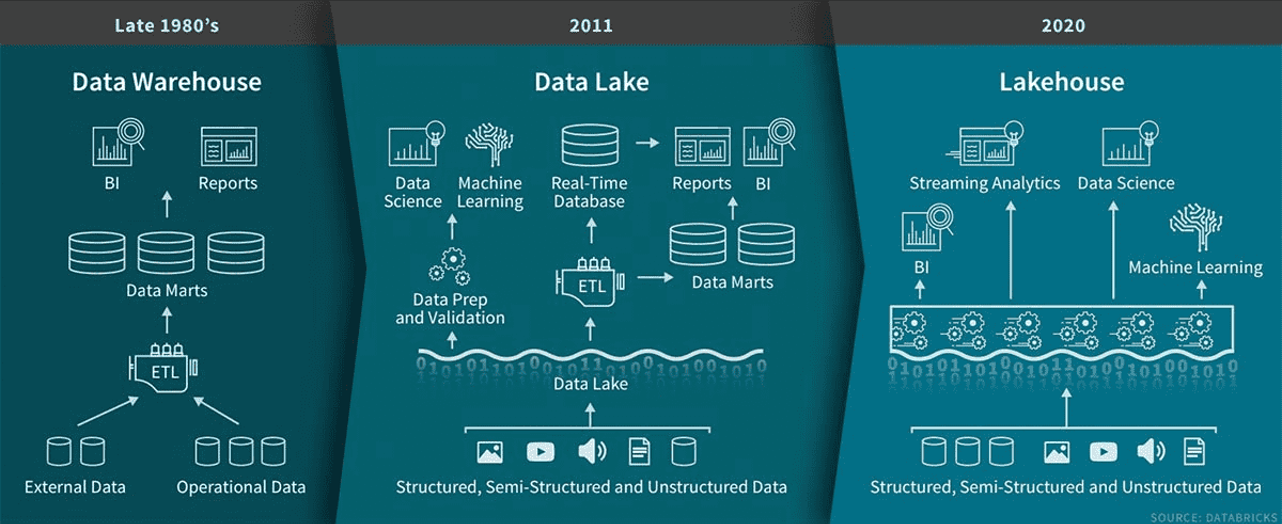

De evolutie van data-architectuur van datawarehouses in de late jaren 80 naar datalakes in 2011 en uiteindelijk lakehouses in 2020. Beeldbron: Databricks.

Verschillen tussen datalakehouses en datawarehouses

Als je de belangrijkste verschillen tussen datalakehouses en datawarehouses begrijpt, kun je beter bepalen welke oplossing bij je past. Hieronder vind je een overzicht van de kerndistincties.

Ondersteunde datatypes

Datalakehouses verwerken diverse datatypes en zijn daardoor ideaal voor uiteenlopende workloads. Ze ondersteunen:

- Gestructureerde data: Verkooptransacties, relationele databases

- Semi-gestructureerde data: JSON-gebruikersprofielen, sensorwaarden

- Ongestructureerde data: IoT-logs, afbeeldingen, audiobestanden.

Datawarehouses slaan vooral gestructureerde en deels semi-gestructureerde data op, waardoor ze beter geschikt zijn voor traditionele bedrijfsprocessen zoals financiële rapportage en analytics.

Voorbeeld: Een retailbedrijf dat een datalakehouse gebruikt, kan clickstream-logs, socialmediadata en transactiegegevens analyseren om klantsentiment te meten.

Kostenefficiëntie

Datalakehouses maken gebruik van kosteneffectieve cloudopslag (bijv. Amazon S3, Azure Data Lake Storage) en ondersteunen schema-on-read, wat ETL-voorverwerkingskosten verlaagt.

Datawarehouses zijn doorgaans duurder door gestructureerde opslag, ETL-verwerking en eigen bestandsformaten.

Voorbeeld: Een startup die goedkope opslag nodig heeft voor ruwe en verwerkte data, vindt een datalakehouse mogelijk betaalbaarder dan een datawarehouse.

Performance

Datalakehouses ondersteunen realtime en batchverwerking en zijn ideaal voor big data-analytics en machine learning. Hun gedistribueerde architectuur zorgt voor snelle verwerking van grote datasets.

Datawarehouses blinken uit in SQL-gebaseerde query’s en transactionele workloads en bieden snelle, consistente prestaties voor gestructureerde data.

Voorbeeld: Een financiële instelling die realtime fraudedetectie uitvoert, profiteert van het vermogen van een datalakehouse om streamingdata te verwerken.

Integratie met machine learning

Datalakehouses integreren native met ML-tools zoals TensorFlow, PyTorch en Databricks ML, waardoor je modellen direct op grote datasets kunt trainen.

Datawarehouses bieden beperkte ML-ondersteuning en vereisen vaak dat data naar externe systemen wordt geëxporteerd voor analyse.

Voorbeeld: Een techbedrijf dat Databricks gebruikt, kan AI-aangedreven aanbevelingssystemen rechtstreeks binnen een datalakehouse ontwikkelen.

Schaalbaarheid

Datalakehouses schalen naar petabytes aan data en ondersteunen verwerking met meerdere engines.

Datawarehouses schalen goed voor gestructureerde data maar hebben moeite met enorme ongestructureerde datasets.

Voorbeeld: Een telecomprovider kan een lakehouse opschalen om dagelijks miljarden belrecords te verwerken, terwijl een traditioneel warehouse moeite kan hebben met IoT-logs.

Types gebruikers

Datalakehouses bedienen datascientists, analisten en engineers die werken met realtime analytics, ML-pijplijnen en exploratieve analyses.

Datawarehouses zijn vooral gericht op businessanalisten en executives die vertrouwen op voorbewerkte, gestructureerde data voor rapportages en dashboards.

Voorbeeld: Een marketingteam gebruikt mogelijk een datawarehouse voor BI-dashboards, terwijl een datascienceteam een datalakehouse verkiest voor voorspellend modelleren.

Datalakehouses vs datawarehouses: een samenvatting

Hier is een gedetailleerde vergelijkingstabel van lakehouses vs. datawarehouses met meer technische details dan eerder besproken:

|

Feature |

Datalakehouse |

Datawarehouse |

|

Ondersteunde datatypes |

Gestructureerd, semi-gestructureerd en ongestructureerd (JSON, afbeeldingen, video’s, IoT-logs) |

Voornamelijk gestructureerd, met beperkte ondersteuning voor semi-gestructureerd (JSON, XML) |

|

Opslagformaat |

Open formaten (Parquet, ORC, Delta, Iceberg) |

Proprietaire gestructureerde formaten |

|

Scheembeheer |

Schema-on-read & schema-on-write (flexibel) |

Schema-on-write (strict) |

|

Query-prestaties |

Geoptimaliseerd voor zowel batch- als realtime query’s |

Geoptimaliseerd voor gestructureerde SQL-query’s |

|

Verwerkingsengine |

Ondersteunt meerdere engines (Spark, Presto, Trino, Dremio) |

SQL-gebaseerde engines (Snowflake, Redshift, BigQuery) |

|

Kostenefficiëntie |

Lagere kosten door goedkope cloud object storage en minder voorbewerking |

Hogere kosten door ETL, gestructureerde opslag en proprietaire formaten |

|

Schaalbaarheid |

Schaalt eenvoudig met diverse workloads (gestructureerd en ongestructureerd) |

Schaalt goed voor gestructureerde data maar heeft moeite met enorme ongestructureerde datasets |

|

Ondersteuning voor machine learning (ML) |

Ingebouwde ML-integratie met TensorFlow, PyTorch en Databricks ML |

Beperkte ML-integratie, vereist vaak data-export |

|

Realtime datastreaming |

Ondersteunt realtime ingestie en analytics (Kafka, Spark Streaming) |

Beperkte realtime ondersteuning, voornamelijk batchverwerking |

|

Beste voor |

AI/ML-workloads, realtime analytics, big data, IoT |

Business intelligence, rapportage, gestructureerde analytics |

|

Beveiliging & governance |

Geavanceerde beveiliging, toegangscontrole en auditing |

Sterke beveiligings- en compliancecontroles voor gestructureerde data |

|

Voorbeeld-use cases |

Fraudedetectie, aanbevelingssystemen, IoT-analytics, AI-modeltraining |

Financiële rapportage, operationele dashboards, wettelijke naleving |

|

Populaire tools & platforms |

Databricks, Snowflake (met Iceberg/Delta), Apache Hudi, Google BigLake |

Amazon Redshift, Google BigQuery, Snowflake, Microsoft Synapse |

Voor- en nadelen van datawarehouses vs. datalakehouses

In dit onderdeel zetten we de belangrijkste voor- en nadelen van elke architectuur op een rij voor een evenwichtig beeld.

Voor- en nadelen van datawarehouses

|

Voordelen ✅ |

Nadelen ❌ |

|

Geoptimaliseerd voor gestructureerde data – Levert hoge performance voor SQL-gebaseerde query’s en analytics. |

Beperkte ondersteuning voor ongestructureerde data – Heeft moeite met formaten zoals afbeeldingen, video’s, IoT-logs. |

|

Snelle query-prestaties – Ontworpen voor aggregaties, joins en complexe query’s met indexing en compressie. |

Hoge opslag- en rekenkosten – Duurder dan cloudgebaseerde objectopslagoplossingen. |

|

ACID-naleving – Waarborgt dataintegriteit, betrouwbaarheid en consistentie; cruciaal voor financiële en regulatoire toepassingen. |

Starre schema-on-write-aanpak – Data moet vóór ingestie opgeschoond en gestructureerd worden, wat ETL-complexiteit verhoogt. |

|

Uitstekend voor BI en rapportage – Werkt naadloos met Power BI, Tableau, Looker en maakt realtime dashboards mogelijk. |

Niet ideaal voor machine learning – ML-workflows vereisen data-export naar externe platforms voor voorbewerking. |

|

Sterk beveiligd en goed geregeld – Sterke RBAC, versleuteling en compliance-controles (bijv. AVG/GDPR, HIPAA). |

Moeilijk te schalen voor big data – Heeft meer moeite met zeer grote datasets dan meer schaalbare architecturen. |

Voor- en nadelen van datalakehouses

|

Voordelen ✅ |

Nadelen ❌ |

|

Ondersteunt alle datatypes – Kan gestructureerde, semi-gestructureerde en ongestructureerde data in één systeem verwerken. |

Query-prestaties kunnen trager zijn – Hoewel geoptimaliseerd voor grootschalige analytics, kan extra tuning nodig zijn voor query’s op gestructureerde data. |

|

Flexibel schema-on-read en schema-on-write – Ondersteunt ingestie van ruwe data voor ML-workloads en gestructureerde opslag voor BI. |

Meer governance-inspanning nodig – Omdat data niet altijd vooraf gestructureerd is, is het afdwingen van datakwaliteit en toegangscontrole complexer. |

|

Kosteneffectieve opslag – Gebruikt cloud object storage (Amazon S3, Azure Data Lake) voor betaalbare, schaalbare opslag. |

Steilere leercurve – Vereist bekendheid met moderne datatools zoals Apache Iceberg, Delta Lake en Hudi. |

|

Geoptimaliseerd voor AI- en ML-workloads – Integreert naadloos met TensorFlow, PyTorch, Databricks ML en realtime streamingframeworks. |

Uitdagingen rond dataconsistentie – ACID-naleving op enorme, gedistribueerde datasets vereist extra configuraties. |

|

Realtime dataverwerking – Ondersteunt streaming ingestie van IoT-apparaten, logs en realtime eventbronnen. |

Minder volwassen dan datawarehouses – Traditionele warehouses hebben een langere historie van bewezen betrouwbaarheid voor BI en financiële rapportage. |

Wanneer gebruik je een datawarehouse

Datawarehouses zijn het meest geschikt voor gestructureerde data, business intelligence en regelgeving. Kies voor een datawarehouse als je afhankelijk bent van sterk georganiseerde, snelle en consistente analytics.

Analytics op gestructureerde data

- Ideaal voor schone, gestructureerde datasets met duidelijke schema-eisen.

- Gebruik wanneer consistentie en performance cruciaal zijn voor analytics en rapportage.

Voorbeeld: Een bedrijf dat een datawarehouse gebruikt om gestructureerde verkoopdata uit een groot winkelnetwerk te analyseren. Dit helpt om voorraaddoelen te volgen, bestsellers te identificeren en realtime bijvulprocessen te optimaliseren.

Business intelligence (BI)-rapportage

- Het beste voor het genereren van dashboards en rapporten voor beslissers.

- Ondersteunt tools zoals Power BI en Tableau met geoptimaliseerde query-prestaties.

Voorbeeld: Een financiële dienstverlener die kwartaalrapportages opstelt voor stakeholders.

Wettelijke naleving

- Ontworpen voor sectoren met strikte eisen aan datanauwkeurigheid en audits.

- Levert betrouwbare opslag voor financiële gegevens, zorgdata en compliance-rapportage.

Voorbeeld: Een financiële instelling gebruikt een datawarehouse om transactionele data op te slaan en te analyseren en zo te voldoen aan regelgeving zoals Basel III en de AVG. Deze gecentraliseerde aanpak helpt bij het beheren van audittrails en het voorkomen van fraude.

Analyse van historische data

- Gebruik voor langetermijntrendanalyses en strategische besluitvorming.

- Ideaal voor sectoren zoals productie of energie die inzichten over meerdere jaren nodig hebben.

Voorbeeld: Een energiebedrijf dat historische stroomconsumptie analyseert om de productie te optimaliseren.

Wanneer gebruik je een datalakehouse

Een datalakehouse is ideaal wanneer je een schaalbaar, flexibel systeem nodig hebt dat gestructureerde, semi-gestructureerde en ongestructureerde data aankan en tegelijkertijd AI, machine learning en realtime analytics ondersteunt.

Geünificeerde opslag voor diverse data

- Het beste om gestructureerde, semi-gestructureerde en ongestructureerde data op één platform te combineren.

- Vermindert silo’s en ondersteunt dynamische datatoegang.

Voorbeeld: Een streamingdienst die videocontent, gebruikersactiviteitslogs en metadata opslaat.

Machine learning- en AI-workflows

- Perfect voor verkenning van ruwe data, modeltraining en experimenten.

- Biedt schema-on-read-flexibiliteit voor diverse datasets.

Voorbeeld: Een bedrijf dat een datalakehouse gebruikt om ruwe ritgegevens, chauffeursbeoordelingen en GPS-logs te verwerken. Deze data voedt ML-modellen voor route-optimalisatie, dynamische prijsstelling en fraudedetectie.

Realtime datastreaming

- Gebruik voor toepassingen die bijna directe ingestie en verwerking van data vereisen.

- Ondersteunt dynamische use cases zoals fraudedetectie en IoT-analytics.

Voorbeeld: IoT-voertuigen sturen realtime sensordata naar een lakehousearchitectuur. Hierdoor kan een bedrijf de voertuigprestaties monitoren, afwijkingen detecteren en over-the-air software-updates uitrollen.

Kosteneffectieve bigdata-opslag

- Verlaagt kosten door ruwe data op te slaan zonder uitgebreide voorbewerking.

- Schaalt efficiënt voor organisaties die enorme hoeveelheden data genereren.

Voorbeeld: Een socialmediabedrijf dat een datalakehouse gebruikt om grote hoeveelheden door gebruikers gegenereerde content op te slaan en te verwerken, zoals teksten, afbeeldingen en video’s. Hiermee kunnen ze sentimentanalyse uitvoeren, trending topics detecteren en advertentietargeting optimaliseren.

Hybride oplossingen: datawarehouses en datalakehouses combineren

Hoewel datawarehouses en lakehouses verschillende doelen dienen, combineren veel organisaties architecturen om performance, kosten en flexibiliteit in balans te brengen.

Met een hybride aanpak sla je gestructureerde data op in een warehouse voor snelle analytics, terwijl je een lakehouse inzet voor big data, AI en machine learning.

Een hybride aanpak volgt een tweelaagse strategie:

- Ruwe en semi-gestructureerde data in het datalakehouse (flexibel, schaalbaar, kosteneffectief)

-

- Slaat diverse data (gestructureerd, semi-gestructureerd, ongestructureerd) op in cloud object storage (Amazon S3, Azure Data Lake, Google Cloud Storage).

- Gebruikt schema-on-read om flexibiliteit te bieden aan datascientists en AI/ML-teams.

- Ondersteunt realtime ingestie van IoT-apparaten, eventlogs en streamingplatforms.

- Gestructureerde en opgeschoonde data in het datawarehouse (geoptimaliseerd voor snelle analytics en BI)

-

- Data wordt gefilterd, getransformeerd en gestructureerd voordat het wordt opgeslagen in een warehouse (Snowflake, Redshift, BigQuery, Synapse).

- Gebruikt schema-on-write om dataconsistentie af te dwingen en query-prestaties te optimaliseren.

- Biedt snelle toegang tot business intelligence, dashboards en operationele rapporten.

Een hybride data-architectuur is nuttig wanneer:

- Je snelle BI-rapportage en flexibele dataopslag voor ML/AI-workloads nodig hebt.

- Je bedrijf zowel gestructureerde als ongestructureerde data verwerkt en dus schema-on-write én schema-on-read nodig heeft.

- Je kosten wilt optimaliseren: een warehouse voor gestructureerde, hoogwaardige analytics en een lakehouse voor kosteneffectieve opslag van ruwe data.

- Je realtime ingestie en verwerking nodig hebt, terwijl je ook beheerde historische gegevens bewaart.

Conclusie

In deze gids hebben we de belangrijkste verschillen tussen datawarehouses en datalakehouses, hun sterke punten, uitdagingen en use cases behandeld, en hoe organisaties beide architecturen vaak combineren in een hybride aanpak.

Deze concepten begrijpen is essentieel om efficiënte, toekomstbestendige datasystemen te bouwen naarmate data-architecturen evolueren. Wil je dieper in deze onderwerpen duiken? Bekijk dan deze cursussen:

- Data Warehousing Concepts – Een basisgids voor datawarehouses, hun componenten en hun rol in analytics.

- Databricks Concepts – Leer hoe Databricks de datalakehouse-architectuur mogelijk maakt voor schaalbare dataverwerking en machine learning.

FAQs

Hoe migreer ik van een datawarehouse naar een datalakehouse?

Migreren omvat:

- Data beoordelen – Identificeer gestructureerde en ongestructureerde bronnen.

- Een platform kiezen – Tools zoals Databricks, Apache Iceberg of Snowflake ondersteunen lakehouses.

- ETL-pijplijnen bouwen – Gebruik Apache Spark of dbt voor transformatie en ingestie.

- Performance optimaliseren – Implementeer indexing-, caching- en partitioneringsstrategieën.

Hoe werkt governance in een datalakehouse vergeleken met een datawarehouse?

Datawarehouses hebben gecentraliseerde governance, met role-based access control (RBAC) en vooraf gedefinieerde schema’s.

Datalakehouses vereisen:

- Fijnmazige toegangscontrole (bijv. AWS Lake Formation, Unity Catalog).

- Metadatabeheer om datasets over opslagniveaus heen te volgen.

- Monitoring van datakwaliteit voor consistentie in schema-on-read-omgevingen.

Wat zijn de grootste uitdagingen bij het adopteren van een datalakehouse?

- Tuning van query-prestaties – Vereist optimalisatietechnieken zoals indexing en caching.

- Problemen met dataconsistentie – Vereist ACID-transactieondersteuning (bijv. Delta Lake, Apache Iceberg).

- Leercurve – Teams moeten nieuwe tools leren naast traditionele SQL-systemen.

Welke rol spelen AI en machine learning in het lakehousemodel?

Lakehouses zijn ideaal voor AI/ML omdat ze:

- Gestructureerde, semi-gestructureerde en ongestructureerde data opslaan voor modeltraining.

- Realtime feature engineering mogelijk maken met Databricks ML en Spark.

- On-demand modeltraining ondersteunen zonder data-exports nodig te hebben.

In tegenstelling tot warehouses kunnen datalakehouses datascientists direct met ruwe data laten werken.

Wat is de toekomst van datalakehouses en datawarehouses?

De sector beweegt richting hybride en geünificeerde architecturen.

- Cloudplatforms integreren lakehouse-features in warehouse-oplossingen.

- Serverless datawarehousing verbetert schaalbaarheid en kostenefficiëntie.

- Datamesh-architecturen decentraliseren eigenaarschap van data over teams.

Deze trends begrijpen helpt dataprofessionals voorop te blijven.

Sai is een software engineer met expertise in Python, Java, cloudplatforms en bigdata-analyse, en heeft een master in Software Engineering van UMBC. Ervaren in AI-modellen, schaalbare IoT-systemen en datagedreven projecten in verschillende sectoren.