Corso

Tradizionalmente, i data warehouse sono stati la soluzione di riferimento per i dati strutturati e la business intelligence. Tuttavia, con l’ascesa di big data, AI e machine learning, è emersa un’architettura più recente — il data lakehouse — che combina i punti di forza sia dei data warehouse sia dei data lake.

In questa guida esploreremo:

- Cosa sono i data warehouse e i data lakehouse e in cosa differiscono.

- Caratteristiche chiave, vantaggi e sfide di ciascuna architettura.

- Casi d’uso reali in cui una soluzione può essere preferibile all’altra.

- Quando usare un approccio ibrido che sfrutta il meglio di entrambi i mondi.

Iniziamo!

Che cos’è un Data Warehouse?

Un data warehouse è un sistema centralizzato che archivia, organizza e analizza i dati per business intelligence (BI), reporting e analytics. Integra dati strutturati da più fonti e segue uno schema altamente organizzato, garantendo coerenza e affidabilità. I data warehouse svolgono un ruolo centrale nell’aiutare le aziende a prendere decisioni data-driven in modo efficiente.

Caratteristiche

- Schema-on-write: i dati vengono trasformati e strutturati prima del caricamento, rispettando uno schema predefinito per query ottimizzate.

- Alte prestazioni: ottimizzati per query complesse, consentono aggregazioni, join e analisi veloci.

- Conformità ACID: garantisce dati affidabili, coerenti e accurati per applicazioni mission-critical.

- Gestione dei dati storici: archivia anni di dati per analisi di trend, forecasting e conformità normativa.

- Integrazione dei dati: combina dati da più fonti (ERP, CRM, database transazionali) in un repository unificato.

- Sicurezza e governance: fornisce controllo degli accessi basato sui ruoli (RBAC), crittografia dei dati e funzionalità di conformità per la sicurezza enterprise.

Casi d’uso

- Reportistica finanziaria e conformità normativa: garantisce registri accurati e verificabili per requisiti come SOX, HIPAA e GDPR.

- Dashboard di business intelligence: alimenta dashboard BI in tempo reale e storiche per decisioni guidate dai dati.

- Reportistica operativa: supporta query predefinite e strutturate per le operazioni quotidiane.

- Analisi dei clienti: abilita segmentazione dei clienti, analisi dei comportamenti e previsione del churn usando dataset strutturati.

- Supply chain e logistica: ottimizza gestione delle scorte, previsione della domanda ed efficienza operativa con trend storici.

Esempi di strumenti

- Snowflake: un data warehouse nativo cloud noto per scalabilità e semplicità d’uso.

- Amazon Redshift: il servizio di data warehousing di AWS offre prestazioni di query rapide e integrazione con altri strumenti AWS.

- Google BigQuery: un data warehouse serverless e altamente scalabile progettato per l’analisi.

Che cos’è un Data Lakehouse?

Un data lakehouse è un’architettura dati moderna che combina la scalabilità e la flessibilità di un data lake con le prestazioni strutturate e l’affidabilità di un data warehouse. Consente alle organizzazioni di archiviare, gestire e analizzare dati strutturati, semi-strutturati e non strutturati in un unico sistema.

Caratteristiche

- Schema-on-read e schema-on-write: supporta l’ingestione di dati grezzi per flessibilità e dataset strutturati per l’analisi tradizionale.

- Tipi di dati diversi: gestisce dati strutturati (database), semi-strutturati (JSON, XML) e non strutturati (immagini, video).

- Ottimizzato per carichi di lavoro moderni: progettato per analytics, AI, machine learning e ingestione di dati in streaming.

- Storage unificato: combina la scalabilità dei data lake con le prestazioni dei data warehouse.

- Convenienza economica: riduce i costi operativi consolidando storage ed elaborazione.

- Governance e sicurezza integrate: offre controllo degli accessi granulare, auditing e funzionalità di conformità per garantire integrità e privacy dei dati.

Casi d’uso

- Big data analytics: archivia ed elabora enormi quantità di dati strutturati e non strutturati per analisi su larga scala.

- Pipeline di AI e machine learning: abilita feature engineering, training dei modelli e inferenza con ingestione dati flessibile.

- Elaborazione dati in tempo reale: supporta analytics in streaming per rilevamento frodi, sistemi di raccomandazione e applicazioni IoT.

- Consolidamento dei dati aziendali: unifica carichi di lavoro operativi e analitici, riducendo duplicazioni e complessità.

Esempi di strumenti

- Databricks: una piattaforma di analytics unificata nota per l’implementazione dell’architettura lakehouse con Delta Lake come base.

- Delta Lake: un livello di storage open source che offre affidabilità e miglioramenti prestazionali ai data lake.

- Apache Iceberg: un formato di tabelle ad alte prestazioni progettato per analytics multimodali su larga scala nei data lake.

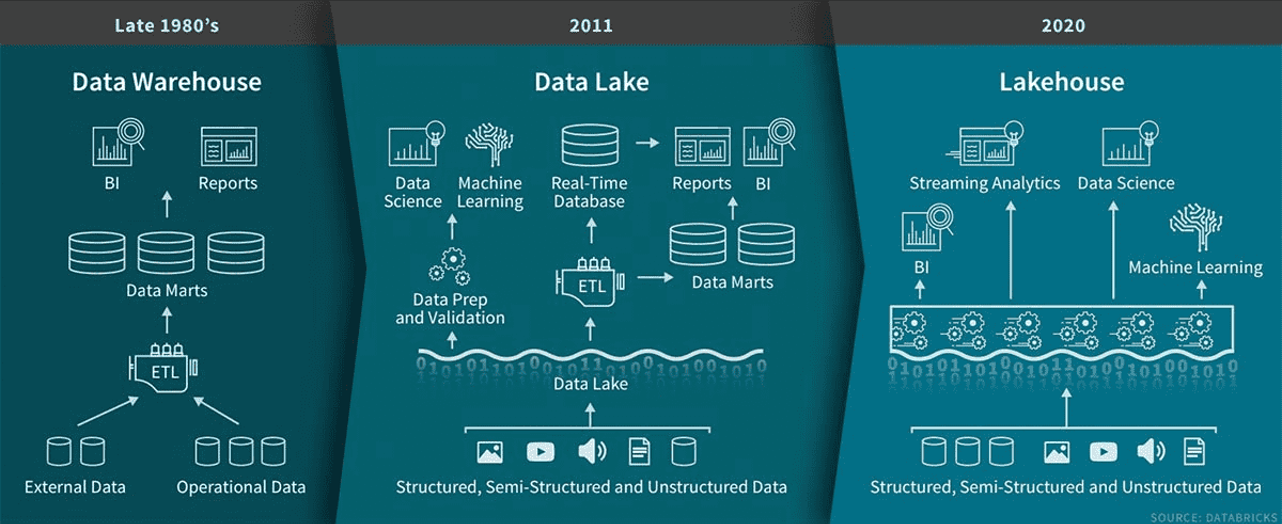

L’evoluzione dell’architettura dei dati dai data warehouse alla fine degli anni ’80 ai data lake nel 2011 e infine ai lakehouse nel 2020. Fonte immagine: Databricks.

Differenze tra Data Lakehouse e Data Warehouse

Capire le differenze chiave tra data lakehouse e data warehouse può aiutarti a determinare quale soluzione si adatta meglio alle tue esigenze. Di seguito una panoramica delle loro distinzioni principali.

Tipi di dati supportati

I data lakehouse gestiscono tipi di dati eterogenei, rendendoli ideali per carichi di lavoro diversificati. Supportano:

- Dati strutturati: transazioni di vendita, database relazionali

- Dati semi-strutturati: profili utente JSON, letture di sensori

- Dati non strutturati: log IoT, immagini, file audio.

I data warehouse archiviano principalmente dati strutturati e in parte semi-strutturati, risultando più adatti ai processi aziendali tradizionali come reporting finanziario e analytics.

Esempio: un’azienda retail che usa un data lakehouse può analizzare log di clickstream, dati dai social media e registri di transazioni per valutare il sentiment dei clienti.

Convenienza economica

I data lakehouse sfruttano storage cloud conveniente (ad es. Amazon S3, Azure Data Lake Storage) e supportano schema-on-read, riducendo i costi di pre-elaborazione ETL.

I data warehouse sono generalmente più costosi a causa dello storage strutturato, dell’elaborazione ETL e di formati proprietari.

Esempio: una startup che necessita di storage a basso costo per dati grezzi ed elaborati può trovare un data lakehouse più conveniente di un data warehouse.

Prestazioni

I data lakehouse supportano elaborazione in tempo reale e batch, rendendoli ideali per big data analytics e machine learning. La loro architettura distribuita garantisce elaborazione ad alta velocità di grandi dataset.

I data warehouse eccellono nelle query basate su SQL e nei carichi transazionali, offrendo prestazioni rapide e costanti per dati strutturati.

Esempio: un istituto finanziario che esegue rilevamento frodi in tempo reale può trarre vantaggio dalla capacità di un data lakehouse di elaborare dati in streaming.

Integrazione con il machine learning

I data lakehouse si integrano nativamente con strumenti ML come TensorFlow, PyTorch e Databricks ML, consentendo il training diretto dei modelli su grandi dataset.

I data warehouse offrono supporto ML limitato e spesso richiedono l’esportazione dei dati verso sistemi esterni per l’analisi.

Esempio: un’azienda tech che usa Databricks può sviluppare sistemi di raccomandazione basati su AI direttamente all’interno di un data lakehouse.

Scalabilità

I data lakehouse scalano fino a petabyte di dati supportando l’elaborazione multi-engine.

I data warehouse scalano bene per dati strutturati ma faticano con dataset non strutturati di dimensioni massive.

Esempio: un operatore telecom può scalare un lakehouse per elaborare miliardi di record di chiamate al giorno, mentre un warehouse tradizionale può avere difficoltà con i log IoT.

Tipi di utenti

I data lakehouse servono data scientist, analyst ed engineer che lavorano con analytics in tempo reale, pipeline ML e analisi esplorativa.

I data warehouse sono pensati principalmente per business analyst e dirigenti che si basano su dati pre-elaborati e strutturati per report e dashboard.

Esempio: un team marketing può usare un data warehouse per dashboard BI, mentre un team di data science preferisce un data lakehouse per la modellazione predittiva.

Data Lakehouse vs Data Warehouse: un riepilogo

Ecco una tabella comparativa dettagliata tra data lakehouse e data warehouse che include ulteriori dettagli tecnici rispetto a quelli trattati in precedenza:

|

Caratteristica |

Data Lakehouse |

Data Warehouse |

|

Tipi di dati supportati |

Strutturati, semi-strutturati e non strutturati (JSON, immagini, video, log IoT) |

Principalmente strutturati, con supporto limitato ai semi-strutturati (JSON, XML) |

|

Formato di archiviazione |

Formati open (Parquet, ORC, Delta, Iceberg) |

Formati strutturati proprietari |

|

Gestione dello schema |

Schema-on-read & schema-on-write (flessibile) |

Schema-on-write (rigido) |

|

Prestazioni di query |

Ottimizzato per query batch e in tempo reale |

Ottimizzato per query SQL su dati strutturati |

|

Motore di elaborazione |

Supporta più motori (Spark, Presto, Trino, Dremio) |

Motori basati su SQL (Snowflake, Redshift, BigQuery) |

|

Convenienza economica |

Costi inferiori grazie allo storage a oggetti nel cloud economico e a minore pre-elaborazione |

Costi più elevati per ETL, storage strutturato e formati proprietari |

|

Scalabilità |

Scala facilmente con carichi di lavoro diversificati (strutturati e non strutturati) |

Scala bene per dati strutturati ma fatica con dataset non strutturati massivi |

|

Supporto al Machine Learning (ML) |

Integrazione ML nativa con TensorFlow, PyTorch e Databricks ML |

Integrazione ML limitata, spesso richiede esportazione dei dati |

|

Streaming dati in tempo reale |

Supporta ingestione e analytics in tempo reale (Kafka, Spark Streaming) |

Supporto limitato al real-time, principalmente elaborazione batch |

|

Ideale per |

Carichi AI/ML, analytics in tempo reale, big data, IoT |

Business intelligence, reporting, analytics su dati strutturati |

|

Sicurezza & governance |

Sicurezza avanzata, controllo accessi e auditing |

Controlli di sicurezza e conformità solidi per dati strutturati |

|

Esempi di casi d’uso |

Rilevamento frodi, sistemi di raccomandazione, analytics IoT, training di modelli AI |

Reportistica finanziaria, dashboard operativi, conformità normativa |

|

Strumenti e piattaforme popolari |

Databricks, Snowflake (con Iceberg/Delta), Apache Hudi, Google BigLake |

Amazon Redshift, Google BigQuery, Snowflake, Microsoft Synapse |

Pro e contro di Data Warehouse e Data Lakehouse

In questa sezione analizziamo i principali vantaggi e svantaggi di ciascuna architettura per offrire una visione equilibrata.

Pro e contro dei data warehouse

|

Pro ✅ |

Contro ❌ |

|

Ottimizzati per dati strutturati – Offrono alte prestazioni per query e analytics basati su SQL. |

Supporto limitato ai dati non strutturati – Difficoltà con formati come immagini, video, log IoT. |

|

Prestazioni di query elevate – Progettati per aggregazioni, join e query complesse con indicizzazione e compressione. |

Alti costi di storage e compute – Più costosi rispetto a soluzioni di object storage nel cloud. |

|

Conformità ACID – Garantisce integrità, affidabilità e coerenza dei dati, cruciale per applicazioni finanziarie e regolamentate. |

Approccio schema-on-write rigido – I dati devono essere puliti e strutturati prima dell’ingestione, aumentando la complessità ETL. |

|

Ottimi per BI e reporting – Si integrano perfettamente con Power BI, Tableau, Looker, abilitando dashboard in tempo reale. |

Non ideali per il machine learning – I workflow ML richiedono l’esportazione dei dati verso piattaforme esterne per la pre-elaborazione. |

|

Altamente sicuri e governati – RBAC, crittografia e controlli di conformità solidi (ad es., GDPR, HIPAA). |

Difficili da scalare per big data – Faticano con dataset enormi rispetto ad architetture più scalabili. |

Pro e contro dei data lakehouse

|

Pro ✅ |

Contro ❌ |

|

Supportano tutti i tipi di dati – Possono gestire dati strutturati, semi-strutturati e non strutturati in un sistema unificato. |

Le prestazioni di query possono essere inferiori – Pur essendo ottimizzati per analytics su larga scala, possono richiedere tuning aggiuntivo per query su dati strutturati. |

|

Schema-on-read e schema-on-write flessibili – Supportano ingestione di dati grezzi per workload ML e storage strutturato per la BI. |

Richiedono maggiore impegno di governance – Poiché i dati non sono sempre pre-strutturati, far rispettare qualità e controlli di accesso è più complesso. |

|

Storage conveniente – Usano object storage nel cloud (Amazon S3, Azure Data Lake) per uno storage economico e scalabile. |

Curva di apprendimento più ripida – Richiedono familiarità con strumenti moderni come Apache Iceberg, Delta Lake e Hudi. |

|

Ottimizzati per carichi AI e ML – Si integrano senza soluzione di continuità con TensorFlow, PyTorch, Databricks ML e framework di streaming in tempo reale. |

Sfide di consistenza dei dati – Ottenere la conformità ACID su dataset vasti e distribuiti richiede configurazioni aggiuntive. |

|

Elaborazione dati in tempo reale – Supportano ingestione in streaming da dispositivi IoT, log ed eventi in tempo reale. |

Meno maturi dei data warehouse – I warehouse tradizionali hanno una storia più lunga di affidabilità provata per BI e reportistica finanziaria. |

Quando usare un Data Warehouse

I data warehouse sono ideali per dati strutturati, business intelligence e conformità normativa. Un data warehouse è la scelta giusta se ti affidi ad analytics altamente organizzati, rapidi e coerenti.

Analytics su dati strutturati

- Ideale per dataset puliti e strutturati con requisiti di schema ben definiti.

- Usalo quando coerenza e prestazioni sono critiche per analytics e reporting.

Esempio: un’azienda che utilizza un data warehouse per analizzare dati di vendita strutturati dalla propria ampia rete di negozi. Questo aiuta a tracciare i livelli di inventario, identificare i prodotti più venduti e ottimizzare i processi di riassortimento in tempo reale.

Reportistica di business intelligence (BI)

- Ideale per generare dashboard e report per i decisori.

- Supporta strumenti come Power BI e Tableau con prestazioni di query ottimizzate.

Esempio: una società di servizi finanziari che crea report trimestrali sugli utili per gli stakeholder.

Conformità normativa

- Progettato per settori con severi requisiti di accuratezza dei dati e audit.

- Offre storage affidabile per registri finanziari, dati sanitari e report di conformità.

Esempio: un istituto finanziario utilizza un data warehouse per archiviare e analizzare dati transazionali, garantendo la conformità a normative come Basilea III e GDPR. Questo approccio centralizzato aiuta a gestire i log di audit e a prevenire le frodi.

Analisi dei dati storici

- Utile per analisi di trend di lungo periodo e decisioni strategiche.

- Ideale per settori come manifattura o energia che necessitano insight su più anni.

Esempio: un’azienda energetica che analizza lo storico dei consumi elettrici per ottimizzare la produzione.

Quando usare un Data Lakehouse

Un data lakehouse è ideale quando ti serve un sistema scalabile e flessibile in grado di gestire dati strutturati, semi-strutturati e non strutturati supportando al contempo AI, machine learning e analytics in tempo reale.

Storage unificato per dati eterogenei

- Ideale per combinare dati strutturati, semi-strutturati e non strutturati in un’unica piattaforma.

- Riduce i silos e supporta accessi ai dati dinamici.

Esempio: un servizio di streaming che archivia contenuti video, log di attività utente e metadati.

Workflow di machine learning e AI

- Perfetto per esplorazione di dati grezzi, training dei modelli e sperimentazione.

- Offre flessibilità schema-on-read per dataset eterogenei.

Esempio: un’azienda che usa un data lakehouse per elaborare dati grezzi sui viaggi, valutazioni dei driver e log GPS. Questi dati alimentano modelli di machine learning per ottimizzazione dei percorsi, pricing dinamico e rilevamento frodi.

Streaming di dati in tempo reale

- Da usare per applicazioni che richiedono ingestione ed elaborazione quasi istantanee.

- Supporta casi d’uso dinamici come rilevamento frodi e analytics IoT.

Esempio: veicoli abilitati IoT trasmettono dati dei sensori in tempo reale verso un’architettura lakehouse. Questo consente a un’azienda di monitorare le prestazioni dei veicoli, rilevare anomalie e distribuire aggiornamenti software over-the-air.

Storage big data conveniente

- Riduce le spese archiviando dati grezzi senza una pre-elaborazione intensiva.

- Scala in modo efficiente per organizzazioni che generano enormi quantità di dati.

Esempio: un’azienda di social media che usa un data lakehouse per archiviare ed elaborare grandi quantità di contenuti generati dagli utenti, come testi, immagini e video. Questo setup consente di eseguire analisi del sentiment, rilevare argomenti di tendenza e ottimizzare il targeting pubblicitario.

Soluzioni ibride: combinare Data Warehouse e Data Lakehouse

Sebbene data warehouse e lakehouse servano scopi diversi, molte organizzazioni combinano le architetture per bilanciare prestazioni, costi e flessibilità.

Un approccio ibrido ti permette di archiviare dati strutturati in un warehouse per analytics rapidi mentre sfrutti un lakehouse per big data, AI e machine learning.

Un approccio ibrido segue una strategia a due livelli:

- Dati grezzi e semi-strutturati nel data lakehouse (flessibile, scalabile, conveniente)

-

- Archivia dati eterogenei (strutturati, semi-strutturati, non strutturati) in object storage cloud (Amazon S3, Azure Data Lake, Google Cloud Storage).

- Usa schema-on-read per fornire flessibilità a data scientist e team AI/ML.

- Supporta ingestione dati in tempo reale da dispositivi IoT, log di eventi e piattaforme di streaming.

- Dati strutturati e puliti nel data warehouse (ottimizzati per analytics veloci e BI)

-

- I dati vengono filtrati, trasformati e strutturati prima di essere archiviati in un warehouse (Snowflake, Redshift, BigQuery, Synapse).

- Usa schema-on-write per imporre coerenza dei dati e ottimizzare le prestazioni delle query.

- Fornisce accesso rapido a business intelligence, dashboard e report operativi.

Un’architettura dati ibrida è utile quando:

- Ti servono report BI ad alta velocità e storage flessibile per workload ML/AI.

- La tua azienda gestisce dati strutturati e non strutturati, richiedendo capacità di schema-on-write e schema-on-read.

- Vuoi ottimizzare i costi, usando un warehouse per analytics strutturati ad alto valore e un lakehouse per storage economico dei dati grezzi.

- Hai bisogno di ingestione ed elaborazione in tempo reale mantenendo registri storici governati.

Conclusione

Questa guida ha esplorato le differenze chiave tra data warehouse e data lakehouse, i loro punti di forza, le sfide e i casi d’uso, e come spesso le organizzazioni combinino entrambe le architetture in un approccio ibrido.

Comprendere questi concetti è essenziale per costruire sistemi dati efficienti e a prova di futuro man mano che le architetture evolvono. Per approfondire, dai un’occhiata a questi corsi:

- Data Warehousing Concepts – Una guida di base ai data warehouse, ai loro componenti e al loro ruolo nell’analytics.

- Databricks Concepts – Scopri come Databricks abilita l’architettura data lakehouse per l’elaborazione dati scalabile e il machine learning.

FAQ

Come posso migrare da un data warehouse a un data lakehouse?

La migrazione prevede:

- Valutazione dei dati – Identifica le fonti strutturate e non strutturate.

- Scelta della piattaforma – Strumenti come Databricks, Apache Iceberg o Snowflake supportano i lakehouse.

- Creazione di pipeline ETL – Usa Apache Spark o dbt per trasformazione e ingestione.

- Ottimizzazione delle prestazioni – Implementa strategie di indicizzazione, caching e partizionamento.

Come funziona la governance in un data lakehouse rispetto a un data warehouse?

I data warehouse hanno una governance centralizzata, con controllo accessi basato sui ruoli (RBAC) e schemi predefiniti.

I data lakehouse richiedono:

- Controlli di accesso granulari (ad es., AWS Lake Formation, Unity Catalog).

- Gestione dei metadati per tracciare i dataset attraverso i livelli di storage.

- Monitoraggio della qualità dei dati per la coerenza in ambienti schema-on-read.

Quali sono le sfide principali nell’adottare un data lakehouse?

- Ottimizzazione delle prestazioni delle query – Richiede tecniche di ottimizzazione come indicizzazione e caching.

- Problemi di consistenza dei dati – Necessita di supporto a transazioni ACID (ad es., Delta Lake, Apache Iceberg).

- Curva di apprendimento – I team devono adottare nuovi strumenti oltre ai sistemi tradizionali basati su SQL.

Qual è il ruolo di AI e machine learning nel modello lakehouse?

I lakehouse sono ideali per AI/ML perché:

- Archiviano dati strutturati, semi-strutturati e non strutturati per l’addestramento dei modelli.

- Abilitano feature engineering in tempo reale con Databricks ML e Spark.

- Supportano training on-demand dei modelli senza necessità di esportare i dati.

A differenza dei warehouse, i lakehouse consentono ai data scientist di lavorare direttamente con i dati grezzi.

Qual è il futuro dei data lakehouse e dei data warehouse?

Il settore si sta spostando verso architetture ibride e unificate.

- Le piattaforme cloud stanno integrando funzionalità lakehouse nelle soluzioni di warehouse.

- Il data warehousing serverless sta migliorando scalabilità ed efficienza dei costi.

- Le architetture data mesh stanno decentralizzando la proprietà dei dati tra i team.

Comprendere questi trend aiuterà i professionisti dei dati a restare al passo.

Sai è un ingegnere software con competenze in Python, Java, piattaforme cloud e analisi di big data, e una laurea magistrale in Ingegneria del Software conseguita presso UMBC. Ha esperienza in modelli di IA, sistemi IoT scalabili e progetti data-driven in diversi settori.