Kursus

Secara tradisional, data warehouse menjadi solusi andalan untuk data terstruktur dan business intelligence. Namun, seiring berkembangnya big data, AI, dan machine learning, muncul arsitektur yang lebih baru—data lakehouse—yang menggabungkan kekuatan data warehouse dan data lake.

Dalam panduan ini, kita akan membahas:

- Apa itu data warehouse dan data lakehouse, serta bagaimana perbedaannya.

- Fitur utama, kelebihan, dan tantangan dari masing-masing arsitektur.

- Kasus penggunaan nyata di mana salah satunya mungkin lebih tepat daripada yang lain.

- Kapan menggunakan pendekatan hibrida yang memanfaatkan keunggulan keduanya.

Mari kita mulai!

Apa Itu Data Warehouse?

Data warehouse adalah sistem terpusat yang menyimpan, mengatur, dan menganalisis data untuk kebutuhan business intelligence (BI), pelaporan, dan analitik. Sistem ini mengintegrasikan data terstruktur dari berbagai sumber dan mengikuti skema yang sangat terorganisasi, sehingga memastikan konsistensi dan keandalan. Data warehouse berperan penting dalam membantu bisnis membuat keputusan berbasis data secara efisien.

Fitur

- Schema-on-write: Data diubah dan distrukturkan sebelum dimuat, mengikuti skema yang telah ditetapkan untuk pengoptimalan kueri.

- Performa tinggi: Dioptimalkan untuk kueri kompleks, memungkinkan agregasi, join, dan analitik yang cepat.

- Kepatuhan ACID: Memastikan data yang andal, konsisten, dan akurat untuk aplikasi yang sangat krusial.

- Manajemen data historis: Menyimpan data bertahun-tahun untuk analisis tren, peramalan, dan kepatuhan.

- Integrasi data: Menggabungkan data dari berbagai sumber (ERP, CRM, basis data transaksional) ke dalam repositori terpadu.

- Keamanan dan tata kelola: Menyediakan kontrol akses berbasis peran (RBAC), enkripsi data, dan fitur kepatuhan untuk keamanan tingkat perusahaan.

Kasus penggunaan

- Pelaporan keuangan dan kepatuhan regulasi: Memastikan catatan yang akurat dan dapat diaudit untuk persyaratan regulasi seperti SOX, HIPAA, dan GDPR.

- Dasbor business intelligence: Mendukung dasbor BI real-time dan historis untuk pengambilan keputusan berbasis data.

- Pelaporan operasional: Mendukung kueri terstruktur yang telah ditentukan untuk operasi bisnis sehari-hari.

- Analitik pelanggan: Memungkinkan segmentasi pelanggan, analisis perilaku, dan prediksi churn menggunakan dataset terstruktur.

- Rantai pasok dan logistik: Mengoptimalkan manajemen persediaan, peramalan permintaan, dan efisiensi operasional dengan tren historis.

Contoh alat

- Snowflake: Data warehouse berbasis cloud yang dikenal karena skalabilitas dan kemudahan penggunaannya.

- Amazon Redshift: Layanan data warehousing AWS yang menawarkan performa kueri cepat dan integrasi dengan alat AWS lainnya.

- Google BigQuery: Data warehouse tanpa server yang sangat skalabel dan dirancang untuk analitik.

Apa Itu Data Lakehouse?

Data lakehouse adalah arsitektur data modern yang menggabungkan skalabilitas dan fleksibilitas data lake dengan performa terstruktur dan keandalan data warehouse. Arsitektur ini memungkinkan organisasi menyimpan, mengelola, dan menganalisis data terstruktur, semi-terstruktur, dan tidak terstruktur dalam satu sistem.

Fitur

- Schema-on-read dan schema-on-write: Mendukung pemasukan data mentah untuk fleksibilitas dan dataset terstruktur untuk analitik tradisional.

- Beragam jenis data: Menangani data terstruktur (basis data), semi-terstruktur (JSON, XML), dan tidak terstruktur (gambar, video).

- Dioptimalkan untuk beban kerja modern: Dibangun untuk analitik, AI, machine learning, dan pemasukan data streaming.

- Penyimpanan terpadu: Menggabungkan skalabilitas data lake dengan performa data warehouse.

- Efisiensi biaya: Mengurangi biaya operasional dengan mengonsolidasikan penyimpanan dan pemrosesan.

- Tata kelola dan keamanan bawaan: Menyediakan kontrol akses mendetail, audit, dan fitur kepatuhan untuk memastikan integritas dan privasi data.

Kasus penggunaan

- Analitik big data: Menyimpan dan memproses sejumlah besar data terstruktur dan tidak terstruktur untuk analisis skala besar.

- Pipa AI dan machine learning: Memungkinkan rekayasa fitur, pelatihan model, dan inferensi dengan pemasukan data yang fleksibel.

- Pemrosesan data real-time: Mendukung analitik streaming untuk deteksi penipuan, sistem rekomendasi, dan aplikasi IoT.

- Konsolidasi data perusahaan: Menyatukan beban kerja operasional dan analitik, mengurangi duplikasi data dan kompleksitas.

Contoh alat

- Databricks: Platform analitik terpadu yang dikenal mengimplementasikan arsitektur lakehouse dengan Delta Lake sebagai fondasinya.

- Delta Lake: Lapisan penyimpanan open-source yang meningkatkan keandalan dan performa data lake.

- Apache Iceberg: Format tabel berkinerja tinggi yang dirancang untuk analitik berskala besar dan multi-modal di atas data lake.

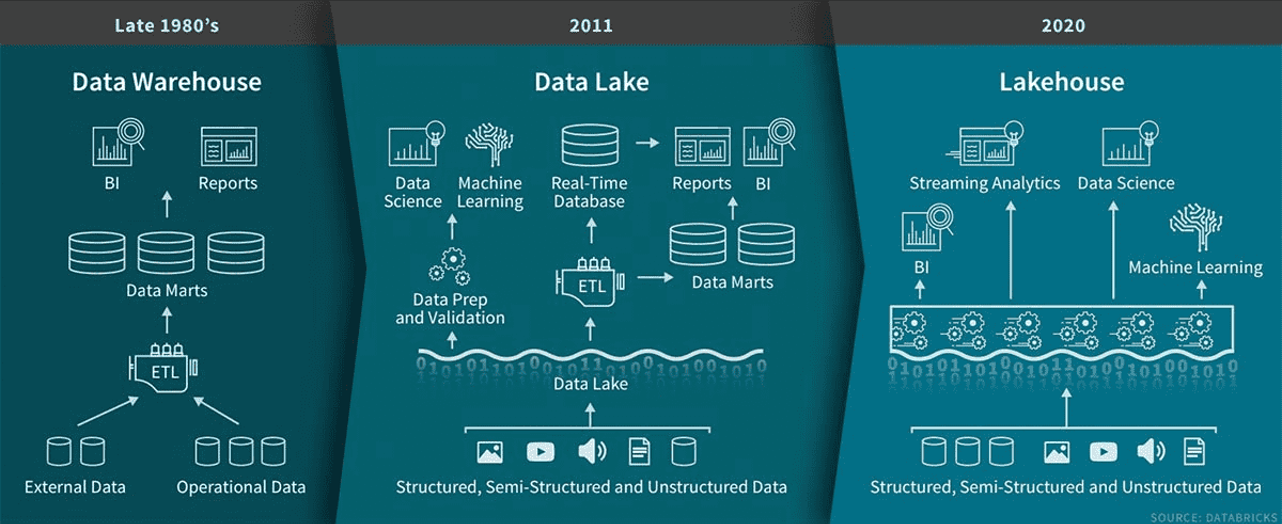

Evolusi arsitektur data dari data warehouse pada akhir 1980-an ke data lake pada 2011 dan akhirnya ke lakehouse pada 2020. Sumber gambar: Databricks.

Perbedaan Antara Data Lakehouse dan Data Warehouse

Memahami perbedaan utama antara data lakehouse dan data warehouse dapat membantu menentukan solusi mana yang paling sesuai dengan kebutuhan Anda. Berikut adalah rincian perbedaan inti keduanya.

Jenis data yang didukung

Data lakehouse menangani beragam jenis data, sehingga ideal untuk berbagai beban kerja. Mendukung:

- Data terstruktur: Transaksi penjualan, basis data relasional

- Data semi-terstruktur: Profil pengguna JSON, pembacaan sensor

- Data tidak terstruktur: Log IoT, gambar, berkas audio.

Data warehouse terutama menyimpan data terstruktur dan sebagian semi-terstruktur, sehingga lebih cocok untuk proses bisnis tradisional seperti pelaporan keuangan dan analitik.

Contoh: Perusahaan ritel yang menggunakan data lakehouse dapat menganalisis log clickstream, data media sosial, dan catatan transaksi untuk menilai sentimen pelanggan.

Efisiensi biaya

Data lakehouse memanfaatkan penyimpanan cloud yang hemat biaya (mis., Amazon S3, Azure Data Lake Storage) dan mendukung schema-on-read, sehingga mengurangi biaya prapemrosesan ETL.

Data warehouse umumnya lebih mahal karena penyimpanan yang terstruktur, pemrosesan ETL, dan format proprietary.

Contoh: Startup yang membutuhkan penyimpanan berbiaya rendah untuk data mentah dan terproses mungkin akan menemukan data lakehouse lebih terjangkau dibanding data warehouse.

Performa

Data lakehouse mendukung pemrosesan real-time dan batch, sehingga ideal untuk analitik big data dan machine learning. Arsitektur terdistribusi memastikan pemrosesan berkecepatan tinggi atas dataset besar.

Data warehouse unggul dalam kueri berbasis SQL dan beban kerja transaksional, memberikan performa cepat dan konsisten untuk data terstruktur.

Contoh: Lembaga keuangan yang menjalankan deteksi penipuan real-time dapat memanfaatkan kemampuan data lakehouse memproses data streaming.

Integrasi dengan machine learning

Data lakehouse terintegrasi secara native dengan alat ML seperti TensorFlow, PyTorch, dan Databricks ML, sehingga memungkinkan pelatihan model langsung pada dataset besar.

Data warehouse memiliki dukungan ML yang terbatas dan sering kali memerlukan ekspor data ke sistem eksternal untuk analisis.

Contoh: Perusahaan teknologi yang menggunakan Databricks dapat mengembangkan sistem rekomendasi berbasis AI langsung di dalam data lakehouse.

Skalabilitas

Data lakehouse dapat diskalakan hingga petabyte data sekaligus mendukung pemrosesan multi-mesin.

Data warehouse berskala baik untuk data terstruktur tetapi kesulitan dengan dataset tidak terstruktur yang masif.

Contoh: Penyedia telekomunikasi dapat menskalakan lakehouse untuk memproses miliaran catatan panggilan per hari, sementara warehouse tradisional mungkin kesulitan dengan log IoT.

Jenis pengguna

Data lakehouse melayani data scientist, analis, dan engineer yang bekerja dengan analitik real-time, pipa ML, dan analisis eksploratif.

Data warehouse terutama ditujukan untuk analis bisnis dan eksekutif yang mengandalkan data terstruktur yang sudah diproses untuk pelaporan dan dasbor.

Contoh: Tim pemasaran mungkin menggunakan data warehouse untuk dasbor BI, sementara tim data science memilih data lakehouse untuk pemodelan prediktif.

Data Lakehouse vs Data Warehouse: Ringkasan

Berikut tabel perbandingan terperinci antara data lakehouse dan data warehouse yang mencakup detail teknis lebih lanjut daripada yang telah dibahas sebelumnya:

|

Fitur |

Data Lakehouse |

Data Warehouse |

|

Jenis Data yang Didukung |

Terstruktur, semi-terstruktur, dan tidak terstruktur (JSON, gambar, video, log IoT) |

Utamanya terstruktur, dengan dukungan semi-terstruktur terbatas (JSON, XML) |

|

Format Penyimpanan |

Format terbuka (Parquet, ORC, Delta, Iceberg) |

Format terstruktur proprietary |

|

Manajemen Skema |

Schema-on-read & schema-on-write (fleksibel) |

Schema-on-write (ketat) |

|

Performa Kueri |

Dioptimalkan untuk kueri batch dan real-time |

Dioptimalkan untuk kueri SQL terstruktur |

|

Mesin Pemrosesan |

Mendukung banyak mesin (Spark, Presto, Trino, Dremio) |

Mesin berbasis SQL (Snowflake, Redshift, BigQuery) |

|

Efisiensi Biaya |

Biaya lebih rendah berkat cloud object storage yang murah dan prapemrosesan minimal |

Biaya lebih tinggi karena ETL, penyimpanan terstruktur, dan format proprietary |

|

Skalabilitas |

Mudah diskalakan untuk beban kerja beragam (terstruktur dan tidak terstruktur) |

Berskala baik untuk data terstruktur namun kesulitan dengan dataset tidak terstruktur yang masif |

|

Dukungan Machine Learning (ML) |

Integrasi ML bawaan dengan TensorFlow, PyTorch, dan Databricks ML |

Integrasi ML terbatas, sering memerlukan ekspor data |

|

Streaming Data Real-Time |

Mendukung pemasukan dan analitik real-time (Kafka, Spark Streaming) |

Dukungan real-time terbatas, terutama pemrosesan batch |

|

Terbaik Untuk |

Beban kerja AI/ML, analitik real-time, big data, IoT |

Business intelligence, pelaporan, analitik terstruktur |

|

Keamanan & Tata Kelola |

Keamanan lanjutan, kontrol akses, dan audit |

Kontrol keamanan dan kepatuhan yang kuat untuk data terstruktur |

|

Contoh Kasus Penggunaan |

Deteksi penipuan, sistem rekomendasi, analitik IoT, pelatihan model AI |

Pelaporan keuangan, dasbor operasional, kepatuhan regulasi |

|

Alat & Platform Populer |

Databricks, Snowflake (dengan Iceberg/Delta), Apache Hudi, Google BigLake |

Amazon Redshift, Google BigQuery, Snowflake, Microsoft Synapse |

Kelebihan dan Kekurangan Data Warehouse vs. Data Lakehouse

Di bagian ini, kami menguraikan keunggulan dan kelemahan utama masing-masing arsitektur untuk memberikan gambaran yang seimbang.

Kelebihan dan kekurangan data warehouse

|

Kelebihan ✅ |

Kekurangan ❌ |

|

Dioptimalkan untuk data terstruktur – Memberikan performa tinggi untuk kueri dan analitik berbasis SQL. |

Dukungan terbatas untuk data tidak terstruktur – Kesulitan dengan format seperti gambar, video, log IoT. |

|

Performa kueri cepat – Dirancang untuk agregasi, join, dan kueri kompleks dengan pengindeksan dan kompresi. |

Biaya penyimpanan dan komputasi tinggi – Lebih mahal dibanding solusi cloud object storage. |

|

Kepatuhan ACID – Menjamin integritas, keandalan, dan konsistensi data, yang krusial untuk aplikasi keuangan dan regulasi. |

Pendekatan schema-on-write yang kaku – Data harus dibersihkan dan distrukturkan sebelum dimasukkan, meningkatkan kompleksitas ETL. |

|

Sangat baik untuk BI dan pelaporan – Bekerja mulus dengan Power BI, Tableau, Looker, memungkinkan dasbor real-time. |

Kurang ideal untuk machine learning – Alur kerja ML memerlukan ekspor data ke platform eksternal untuk prapemrosesan. |

|

Sangat aman dan tertata – RBAC, enkripsi, dan kontrol kepatuhan yang kuat (mis., GDPR, HIPAA). |

Tantangannya saat diskalakan untuk big data – Lebih kesulitan menangani dataset masif dibanding arsitektur yang lebih skalabel. |

Kelebihan dan kekurangan data lakehouse

|

Kelebihan ✅ |

Kekurangan ❌ |

|

Mendukung semua jenis data – Dapat menangani data terstruktur, semi-terstruktur, dan tidak terstruktur dalam satu sistem terpadu. |

Performa kueri bisa lebih lambat – Meski dioptimalkan untuk analitik skala besar, mungkin memerlukan tuning tambahan untuk kueri data terstruktur. |

|

Fleksibel dengan schema-on-read dan schema-on-write – Mendukung pemasukan data mentah untuk beban kerja ML sekaligus memungkinkan penyimpanan terstruktur untuk BI. |

Memerlukan usaha tata kelola lebih besar – Karena data tidak selalu terstruktur sebelumnya, penegakan kualitas data dan kontrol akses menjadi lebih kompleks. |

|

Penyimpanan hemat biaya – Menggunakan cloud object storage (Amazon S3, Azure Data Lake) untuk penyimpanan yang terjangkau dan skalabel. |

Kurva pembelajaran lebih terjal – Memerlukan penguasaan alat modern seperti Apache Iceberg, Delta Lake, dan Hudi. |

|

Dioptimalkan untuk beban kerja AI dan ML – Terintegrasi mulus dengan TensorFlow, PyTorch, Databricks ML, dan kerangka streaming real-time. |

Tantangan konsistensi data – Mencapai kepatuhan ACID di atas dataset yang luas dan terdistribusi memerlukan konfigurasi tambahan. |

|

Pemrosesan data real-time – Mendukung pemasukan data streaming dari perangkat IoT, log, dan sumber peristiwa real-time. |

Kurang matang dibanding data warehouse – Warehouse tradisional memiliki rekam jejak keandalan yang lebih panjang untuk BI dan pelaporan keuangan. |

Kapan Menggunakan Data Warehouse

Data warehouse paling cocok untuk data terstruktur, business intelligence, dan kepatuhan regulasi. Data warehouse adalah pilihan tepat jika Anda mengandalkan analitik yang sangat terorganisasi, cepat, dan konsisten.

Analitik data terstruktur

- Ideal untuk dataset yang bersih dan terstruktur dengan persyaratan skema yang jelas.

- Gunakan saat konsistensi dan performa sangat penting untuk analitik dan pelaporan.

Contoh: Perusahaan yang menggunakan data warehouse untuk menganalisis data penjualan terstruktur dari jaringan tokonya yang luas. Ini membantu melacak tingkat persediaan, mengidentifikasi produk terlaris, dan mengoptimalkan proses restock secara real-time.

Pelaporan business intelligence (BI)

- Terbaik untuk menghasilkan dasbor dan laporan bagi pengambil keputusan.

- Menopang alat seperti Power BI dan Tableau dengan performa kueri yang dioptimalkan.

Contoh: Perusahaan jasa keuangan yang membuat laporan laba triwulanan untuk para pemangku kepentingan.

Kepatuhan regulasi

- Dirancang untuk industri dengan persyaratan akurasi data dan audit yang ketat.

- Menyediakan penyimpanan yang andal untuk catatan keuangan, data kesehatan, dan pelaporan kepatuhan.

Contoh: Lembaga keuangan menggunakan data warehouse untuk menyimpan dan menganalisis data transaksional, memastikan kepatuhan terhadap regulasi seperti Basel III dan GDPR. Pendekatan terpusat ini membantu mengelola jejak audit dan mencegah penipuan.

Analisis data historis

- Gunakan untuk analisis tren jangka panjang dan pengambilan keputusan strategis.

- Ideal untuk industri seperti manufaktur atau energi yang membutuhkan wawasan data multi-tahun.

Contoh: Perusahaan energi menganalisis penggunaan listrik historis untuk mengoptimalkan produksi.

Kapan Menggunakan Data Lakehouse

Data lakehouse ideal saat Anda memerlukan sistem yang skalabel dan fleksibel yang dapat menangani data terstruktur, semi-terstruktur, dan tidak terstruktur sekaligus mendukung AI, machine learning, dan analitik real-time.

Penyimpanan terpadu untuk data beragam

- Terbaik untuk menggabungkan data terstruktur, semi-terstruktur, dan tidak terstruktur dalam satu platform.

- Mengurangi silo dan mendukung akses data yang dinamis.

Contoh: Layanan streaming yang menyimpan konten video, log aktivitas pengguna, dan metadata.

Alur kerja machine learning dan AI

- Sangat cocok untuk eksplorasi data mentah, pelatihan model, dan eksperimen.

- Menyediakan fleksibilitas schema-on-read untuk dataset beragam.

Contoh: Perusahaan yang menggunakan data lakehouse untuk memproses data perjalanan mentah, rating pengemudi, dan log GPS. Data ini menggerakkan model machine learning untuk optimasi rute, penetapan harga dinamis, dan deteksi penipuan.

Streaming data real-time

- Gunakan untuk aplikasi yang membutuhkan pemasukan dan pemrosesan data nyaris seketika.

- Mendukung kasus penggunaan dinamis seperti deteksi penipuan dan analitik IoT.

Contoh: Kendaraan berkemampuan IoT mengalirkan data sensor real-time ke arsitektur lakehouse. Ini memungkinkan perusahaan memantau performa kendaraan, mendeteksi anomali, dan menerapkan pembaruan perangkat lunak over-the-air.

Penyimpanan big data yang hemat biaya

- Mengurangi biaya dengan menyimpan data mentah tanpa prapemrosesan yang ekstensif.

- Berskala efisien untuk organisasi yang menghasilkan data dalam jumlah sangat besar.

Contoh: Perusahaan media sosial yang menggunakan data lakehouse untuk menyimpan dan memproses sejumlah besar konten buatan pengguna mentah, seperti teks, gambar, dan video. Pengaturan ini memungkinkan mereka melakukan analisis sentimen, mendeteksi topik yang sedang tren, dan mengoptimalkan penargetan iklan.

Solusi Hibrida: Menggabungkan Data Warehouse dan Data Lakehouse

Meskipun data warehouse dan lakehouse memiliki tujuan yang berbeda, banyak organisasi menggabungkan arsitektur untuk menyeimbangkan performa, biaya, dan fleksibilitas.

Pendekatan hibrida memungkinkan Anda menyimpan data terstruktur di warehouse untuk analitik cepat sambil memanfaatkan lakehouse untuk big data, AI, dan machine learning.

Pendekatan hibrida mengikuti strategi dua lapis:

- Data mentah dan semi-terstruktur di data lakehouse (fleksibel, skalabel, hemat biaya)

-

- Menyimpan beragam data (terstruktur, semi-terstruktur, tidak terstruktur) di cloud object storage (Amazon S3, Azure Data Lake, Google Cloud Storage).

- Menggunakan schema-on-read untuk memberikan fleksibilitas bagi tim data scientist dan AI/ML.

- Mendukung pemasukan data real-time dari perangkat IoT, log peristiwa, dan platform streaming.

- Data terstruktur dan telah dibersihkan di data warehouse (dioptimalkan untuk analitik dan BI yang cepat)

-

- Data difilter, diubah, dan distrukturkan sebelum disimpan di warehouse (Snowflake, Redshift, BigQuery, Synapse).

- Menggunakan schema-on-write untuk menegakkan konsistensi data dan mengoptimalkan performa kueri.

- Menyediakan akses cepat ke business intelligence, dasbor, dan laporan operasional.

Arsitektur data hibrida bermanfaat ketika:

- Anda memerlukan pelaporan BI berkecepatan tinggi dan penyimpanan data yang fleksibel untuk beban kerja ML/AI.

- Perusahaan Anda menangani data terstruktur dan tidak terstruktur, memerlukan kemampuan schema-on-write dan schema-on-read.

- Anda ingin mengoptimalkan biaya, menggunakan warehouse untuk analitik terstruktur bernilai tinggi dan lakehouse untuk penyimpanan data mentah yang hemat biaya.

- Anda membutuhkan pemasukan dan pemrosesan data real-time sekaligus mempertahankan catatan historis yang tertata.

Kesimpulan

Panduan ini membahas perbedaan utama antara data warehouse dan data lakehouse, kekuatan, tantangan, serta kasus penggunaannya, dan bagaimana organisasi sering menggabungkan keduanya dalam pendekatan hibrida.

Memahami konsep-konsep ini penting untuk membangun sistem data yang efisien dan tahan masa depan seiring evolusi arsitektur data. Untuk mempelajari lebih dalam, lihat kursus berikut:

- Data Warehousing Concepts – Panduan dasar mengenai data warehouse, komponennya, dan perannya dalam analitik.

- Databricks Concepts – Pelajari bagaimana Databricks mewujudkan arsitektur data lakehouse untuk pemrosesan data yang skalabel dan machine learning.

FAQs

Bagaimana cara bermigrasi dari data warehouse ke data lakehouse?

Migrasi meliputi:

- Menilai data – Identifikasi sumber terstruktur dan tidak terstruktur.

- Memilih platform – Alat seperti Databricks, Apache Iceberg, atau Snowflake mendukung lakehouse.

- Membangun pipa ETL – Gunakan Apache Spark atau dbt untuk transformasi dan pemasukan.

- Mengoptimalkan performa – Terapkan strategi pengindeksan, caching, dan partisi.

Bagaimana tata kelola data pada data lakehouse dibandingkan data warehouse?

Data warehouse memiliki tata kelola terpusat, dengan kontrol akses berbasis peran (RBAC) dan skema yang telah ditentukan.

Data lakehouse memerlukan:

- Kontrol akses mendetail (mis., AWS Lake Formation, Unity Catalog).

- Manajemen metadata untuk melacak dataset di berbagai lapisan penyimpanan.

- Pemantauan kualitas data untuk konsistensi dalam lingkungan schema-on-read.

Apa tantangan terbesar saat mengadopsi data lakehouse?

- Penalaan performa kueri – Memerlukan teknik optimasi seperti pengindeksan dan caching.

- Isu konsistensi data – Membutuhkan dukungan transaksi ACID (mis., Delta Lake, Apache Iceberg).

- Kurva pembelajaran – Tim harus mengadopsi alat baru di luar sistem berbasis SQL tradisional.

Apa peran AI dan machine learning dalam model lakehouse?

Lakehouse ideal untuk AI/ML karena:

- Menyimpan data terstruktur, semi-terstruktur, dan tidak terstruktur untuk pelatihan model.

- Memungkinkan rekayasa fitur real-time dengan Databricks ML dan Spark.

- Mendukung pelatihan model on-demand tanpa perlu ekspor data.

Berbeda dengan warehouse, lakehouse memungkinkan data scientist bekerja langsung dengan data mentah.

Bagaimana masa depan data lakehouse dan warehouse?

Industri bergerak ke arah arsitektur hibrida dan terpadu.

- Platform cloud mengintegrasikan fitur lakehouse ke dalam solusi warehouse.

- Data warehousing tanpa server meningkatkan skalabilitas dan efisiensi biaya.

- Arsitektur data mesh mendesentralisasikan kepemilikan data di berbagai tim.

Memahami tren ini akan membantu para profesional data tetap selangkah lebih maju.

Sai adalah insinyur perangkat lunak dengan keahlian dalam Python, Java, platform cloud, serta analitik big data, dan meraih gelar Magister Rekayasa Perangkat Lunak dari UMBC. Berpengalaman dalam model AI, sistem IoT berskala besar, dan proyek berbasis data lintas industri.