Courses

Khi bắt đầu tìm hiểu về các hệ thống retrieval-augmented generation (RAG), tôi nhanh chóng nhận ra một yếu tố thường bị bỏ qua nhưng lại có tính quyết định đến hiệu suất của chúng: chunking.

Về cốt lõi, chunking là quá trình chia các khối thông tin lớn như tài liệu, bản ghi, hoặc sổ tay kỹ thuật thành các đoạn nhỏ hơn, dễ xử lý hơn. Những đoạn này sau đó có thể được hệ thống AI xử lý, nhúng (embed) và truy xuất.

Khi làm việc với các mô hình ngôn ngữ hiện đại và giới hạn ngữ cảnh của chúng, tôi nhận thấy việc hiểu và áp dụng các chiến lược chunking hiệu quả là điều thiết yếu cho bất kỳ ai xây dựng pipeline RAG, hệ thống tìm kiếm ngữ nghĩa, hoặc ứng dụng xử lý tài liệu.

Trong hướng dẫn này, tôi sẽ giải thích khái niệm chunking, vì sao nó quan trọng trong các ứng dụng AI, vai trò của nó trong pipeline RAG, và cách các chiến lược khác nhau ảnh hưởng đến độ chính xác khi truy xuất. Tôi cũng đề cập đến các lưu ý triển khai thực tế, phương pháp đánh giá, các trường hợp sử dụng theo miền, và thực tiễn tốt nhất giúp bạn chọn được cách tiếp cận phù hợp cho dự án.

Nếu bạn mới làm quen với RAG và các ứng dụng AI, tôi khuyến nghị tham gia một trong các khóa học của chúng tôi như Retrieval Augmented Generation (RAG) with LangChain, AI Fundamentals Certification hoặc Artificial Intelligence (AI) Strategy.

Vì sao Chunking quan trọng đối với Ứng dụng AI và RAG

Tầm quan trọng của chunking vượt xa việc tổ chức dữ liệu đơn thuần; nó định hình căn bản cách hệ thống AI hiểu và truy xuất thông tin.

Các mô hình ngôn ngữ lớn và pipeline RAG cần chunking do giới hạn vốn có về cửa sổ ngữ cảnh và ràng buộc tính toán.

Khi tôi xử lý các tài liệu lớn mà không chunking đúng cách, hệ thống thường đánh mất các mối liên hệ ngữ cảnh quan trọng và gặp khó khăn khi xác định thông tin liên quan trong quá trình truy xuất. Chunking hiệu quả trực tiếp nâng cao độ chính xác khi truy xuất bằng cách tạo ra các đoạn mạch lạc về ngữ nghĩa, phù hợp với mẫu truy vấn và ý định của người dùng.

Theo kinh nghiệm của tôi, các chiến lược chunking được triển khai tốt cải thiện đáng kể khả năng tìm kiếm ngữ nghĩa bằng cách duy trì mạch lạc thông tin, đồng thời đảm bảo mỗi đoạn chứa đủ ngữ cảnh để tạo embedding có ý nghĩa. Cách tiếp cận này cho phép mô hình embedding nắm bắt các mối quan hệ tinh tế và cho phép đối sánh tương đồng chính xác hơn khi truy xuất.

Ngược lại, các chiến lược chunking kém tạo ra tác động tiêu cực dây chuyền trong toàn bộ pipeline AI. Việc cắt tách tùy tiện có thể làm đứt gãy các mối quan hệ quan trọng giữa các khái niệm, dẫn đến phản hồi thiếu sót hoặc gây hiểu lầm. Khi đoạn quá lớn, hệ thống truy xuất khó xác định các phần liên quan cụ thể, còn khi đoạn quá nhỏ lại thiếu ngữ cảnh đủ để hiểu chính xác. Những vấn đề này cuối cùng làm giảm sự hài lòng của người dùng và suy giảm độ tin cậy của hệ thống.

Chunking nằm ở đâu trong Pipeline RAG

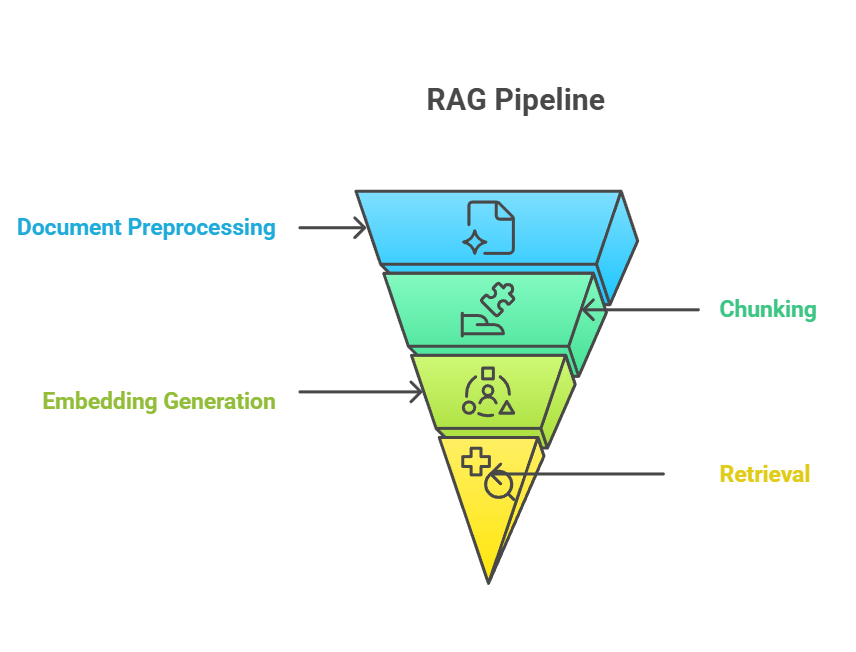

Chunking giữ vị trí then chốt trong pipeline RAG, đóng vai trò cầu nối giữa việc nạp tài liệu thô và truy xuất tri thức có ý nghĩa. Trong pipeline RAG đầu-cuối, chunking thường diễn ra sau tiền xử lý tài liệu nhưng trước khi tạo embedding. Quá trình chunking đi trực tiếp vào bước embedding, nơi mỗi đoạn được chuyển thành các vector nắm bắt ý nghĩa ngữ nghĩa.

Pipeline RAG

Mối quan hệ giữa chunking, embedding và truy xuất tạo thành một hệ thống gắn kết chặt, trong đó hiệu quả của mỗi thành phần phụ thuộc vào hiệu năng của các thành phần còn lại.

Khi tôi tạo các đoạn được cấu trúc tốt, mô hình embedding có thể sinh ra biểu diễn vector phong phú hơn, từ đó cho phép kết quả truy xuất chính xác hơn khi người dùng gửi truy vấn. Sự cộng hưởng này có nghĩa là cải thiện chunking thường chuyển hóa thành các mức tăng hiệu năng đo lường được trên toàn bộ pipeline.

Tuy vậy, một số cách tiếp cận mới đang thách thức thứ tự truyền thống này. Ví dụ, post-chunking nhúng toàn bộ tài liệu trước và chỉ chunk tại thời điểm truy vấn, đồng thời lưu đệm kết quả để truy cập nhanh hơn về sau. Cách này tránh tiền xử lý các tài liệu có thể không bao giờ bị truy vấn, đồng thời cho phép chunking theo từng truy vấn, nhưng gây độ trễ ở lần truy cập đầu và đòi hỏi thêm hạ tầng.

Tương tự, late chunking hoãn việc phân đoạn chi tiết cho đến lúc truy xuất. Thay vì tiền tính embedding cho nhiều đoạn nhỏ, hệ thống lưu các biểu diễn thô hơn (ví dụ: toàn bộ tài liệu hoặc mục) và động chia nhỏ khi có truy vấn. Cách này bảo toàn ngữ cảnh rộng hơn và giảm xử lý ban đầu, nhưng cũng tạo độ trễ ở truy vấn đầu tiên và cần thêm hạ tầng.

Dù theo cách nào, chiến lược chunking phải thích nghi với cửa sổ ngữ cảnh của mô hình ngôn ngữ đang dùng—lượng văn bản tối đa mà mô hình có thể xử lý và xét đến trong một lần.

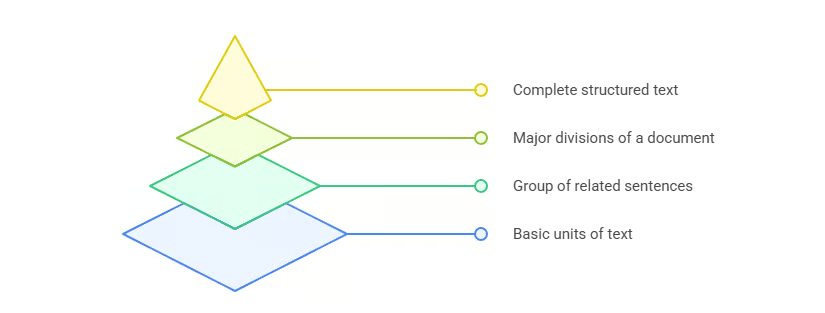

Những điều cơ bản về Chunking tài liệu

Giờ khi bạn đã hình dung chunking là gì và nằm ở đâu trong pipeline, đã đến lúc xem các nguyên tắc cốt lõi dẫn dắt chiến lược chunking hiệu quả. Hiểu những nền tảng này tạo cơ sở để áp dụng chunking cho nhiều ứng dụng AI và RAG.

Chunking là cần thiết vì mô hình ngôn ngữ có cửa sổ ngữ cảnh giới hạn. Mục tiêu chính là tạo các đoạn có ý nghĩa độc lập, đồng thời tập hợp lại vẫn bảo toàn cấu trúc và mục đích tổng thể của tài liệu, tất cả trong giới hạn ngữ cảnh của mô hình.

Tuy nhiên, cửa sổ ngữ cảnh không phải là điều duy nhất cần cân nhắc. Khi thiết kế chiến lược chunking, tôi tập trung vào ba nguyên tắc cốt lõi:

- Tính mạch lạc ngữ nghĩa: Mỗi đoạn nên nhóm các khái niệm liên quan và duy trì mạch logic của thông tin.

- Bảo toàn ngữ cảnh: Một đoạn nên bao gồm đủ thông tin xung quanh để giữ nguyên ý nghĩa khi tách khỏi tài liệu gốc.

- Tối ưu tính toán: Kích thước đoạn cần cân bằng giữa độ phong phú ngữ nghĩa và hiệu suất, đảm bảo hệ thống xử lý nhanh mà không vượt quá giới hạn bộ nhớ hay token.

Các nguyên tắc này phối hợp để khiến các đoạn vừa hữu ích cho mô hình, vừa hiệu quả cho pipeline truy xuất. Với nền tảng này, tôi sẽ trình bày những chiến lược chunking phổ biến nhất trong thực tế.

Tổng quan về các Chiến lược Chunking

Bức tranh chiến lược chunking bao gồm nhiều cách tiếp cận đa dạng, phù hợp với các loại nội dung, ứng dụng và yêu cầu hiệu năng khác nhau. Trong hình dưới, bạn có thể thấy tổng quan các phương pháp chính, tôi sẽ đi sâu hơn ở các phần tiếp theo.

Tổng quan về Chiến lược Chunking

Bức tranh tổng quan này cho thấy sự tiến hóa từ các cách tiếp cận dựa trên quy tắc đơn giản đến các kỹ thuật tinh vi do AI dẫn dắt, mỗi kỹ thuật mang lại lợi thế riêng cho các ứng dụng và yêu cầu hiệu năng cụ thể.

Đào sâu: Những phương pháp Chunking phổ biến

Hãy xem kỹ hơn những chiến lược chunking được dùng rộng rãi nhất. Mỗi phương pháp có điểm mạnh, hạn chế và bối cảnh phù hợp riêng. Hiểu được khác biệt này giúp tôi chọn cách tiếp cận đúng cho từng dự án thay vì mặc định dùng một giải pháp cho tất cả. Chúng ta sẽ bắt đầu với cách đơn giản nhất: chunking kích thước cố định.

Chunking kích thước cố định

Đây là phương pháp đơn giản nhất. Nó chia văn bản thành các đoạn dựa trên số ký tự, từ, hoặc token—không xét đến ý nghĩa hay cấu trúc.

- Theo ký tự: Chia văn bản sau một số ký tự cố định. Hữu ích cho xử lý nhẹ nhưng dễ cắt câu hoặc từ ở chỗ không tự nhiên.

- Theo từ: Tách văn bản sau một số từ nhất định. Tự nhiên hơn theo ký tự, nhưng vẫn có nguy cơ làm vỡ câu.

- Theo token: Dùng cùng sơ đồ token hóa như mô hình đích (ví dụ: tokenizer của OpenAI). Điều này đảm bảo tương thích với giới hạn ngữ cảnh của mô hình, nhưng ranh giới token không phải lúc nào trùng với ranh giới ngữ nghĩa.

Ưu điểm chính của chunking kích thước cố định là hiệu quả tính toán—nhanh, dự đoán được và dễ triển khai. Nhược điểm là thường bỏ qua cấu trúc ngữ nghĩa, có thể làm giảm độ chính xác khi truy xuất. Tôi thường dùng cách này khi sự đơn giản và tốc độ quan trọng hơn độ chuẩn xác ngữ nghĩa, và khi cấu trúc tài liệu không quan trọng. Để cải thiện hiệu năng, tôi thường thêm phần chồng lấp giữa các đoạn để giữ ngữ cảnh qua ranh giới.

Chunking theo câu

Một cách khắc phục một số hạn chế trên là chunking theo câu, tôn trọng ranh giới ngôn ngữ tự nhiên, thường bằng cách phát hiện dấu câu như dấu chấm hoặc chấm hỏi.

Cách tiếp cận này giữ khả năng đọc và đảm bảo mỗi đoạn tự thân đầy đủ. So với kích thước cố định, nó tạo ra các đoạn dễ hiểu hơn cho cả con người và mô hình. Tuy nhiên, độ dài câu thay đổi, nên kích thước đoạn có thể không đều và không phải lúc nào cũng nắm bắt được các mối quan hệ ngữ nghĩa sâu hơn.

Tôi thấy chunking theo câu hữu ích nhất cho các ứng dụng phụ thuộc vào dòng chảy ngôn ngữ tự nhiên, như dịch máy, phân tích cảm xúc, hoặc tóm tắt. Nhưng khi tài liệu có cấu trúc nhiều hơn mức câu đơn giản, chunking đệ quy là lựa chọn linh hoạt.

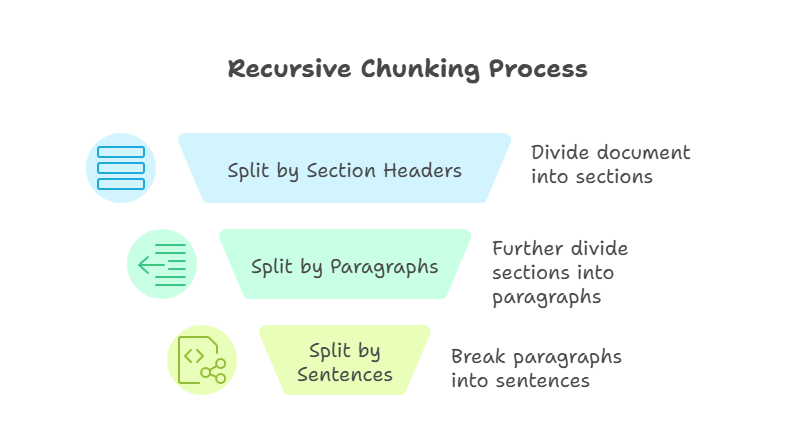

Chunking đệ quy

Chunking đệ quy là kỹ thuật nâng cao hơn so với các phương pháp trước. Nó áp dụng các quy tắc chia tách theo từng bước cho đến khi mỗi đoạn nằm trong ngưỡng kích thước xác định. Ví dụ, tôi có thể tách theo tiêu đề mục trước, rồi theo đoạn, và cuối cùng theo câu. Quá trình tiếp tục cho đến khi mỗi phần vừa phải và trong kích thước định sẵn.

Chunking đệ quy

Ưu thế chính của phương pháp này là tính linh hoạt. Bằng cách đi từ trên xuống, chunking đệ quy vừa bảo toàn cấu trúc tài liệu, vừa đảm bảo tương thích với cửa sổ ngữ cảnh của mô hình. Tuy nhiên, chunking đệ quy có thể phức tạp hơn khi triển khai, và chất lượng kết quả phụ thuộc vào mức độ cấu trúc của tài liệu gốc.

Tôi thường dùng chunking đệ quy khi làm việc với sổ tay kỹ thuật hoặc các tài liệu có hệ thống phân cấp rõ ràng.

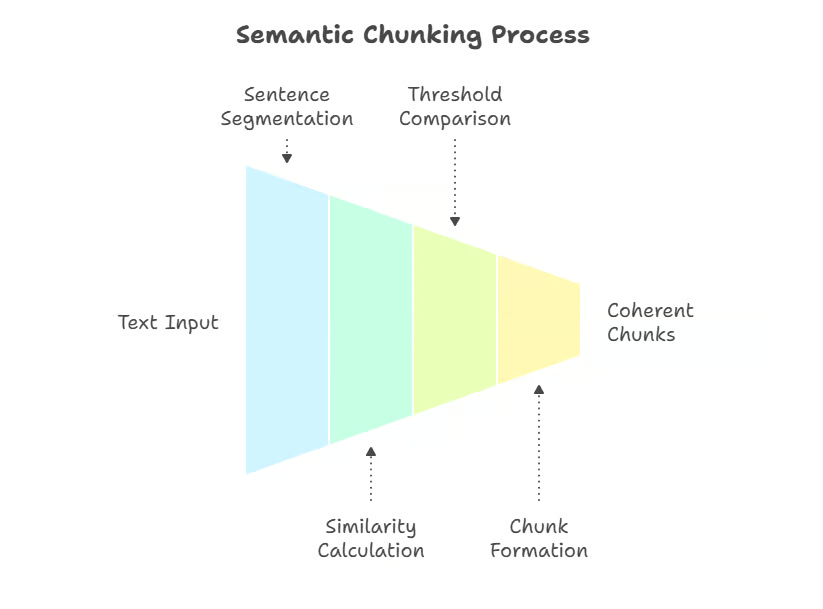

Chunking ngữ nghĩa

Trong khi phương pháp đệ quy dựa vào cấu trúc, chunking ngữ nghĩa chuyển trọng tâm sang ý nghĩa, chia tách văn bản theo ranh giới khái niệm. Đây là kỹ thuật có nhận thức về ý nghĩa, dùng embedding hoặc độ tương đồng ngữ nghĩa để tách văn bản tại chỗ có sự chuyển chủ đề. Thay vì ranh giới tùy tiện, các đoạn được xác định bởi ý nghĩa.

Một cách là chia văn bản thành các câu và đo độ tương đồng ngữ nghĩa giữa chúng (ví dụ, cosine similarity trên embedding), đánh dấu đoạn mới khi tính mạch lạc giảm. Các triển khai nâng cao hơn dùng phương pháp phân cụm hoặc mô hình giám sát phát hiện ranh giới, giúp nắm bắt tốt hơn sự chuyển chủ đề trong tài liệu phức tạp.

Chunking ngữ nghĩa

Phương pháp này duy trì tính mạch lạc ngữ nghĩa, đảm bảo mỗi đoạn bao trùm một ý hoặc chủ đề duy nhất. Kỹ thuật có thể gồm độ tương đồng embedding, phân cụm, hoặc các phép đo khoảng cách ngữ nghĩa khác để phát hiện điểm ngắt tự nhiên.

Ưu điểm lớn nhất là độ chính xác—chunking ngữ nghĩa tạo các đoạn khớp chặt với ý định người dùng khi truy xuất. Hạn chế chính là chi phí tính toán, vì cần embedding văn bản trong giai đoạn tiền xử lý. Tôi dùng chunking ngữ nghĩa khi độ chính xác quan trọng hơn tốc độ, như trong hệ thống RAG theo miền trong lĩnh vực pháp lý hoặc y tế.

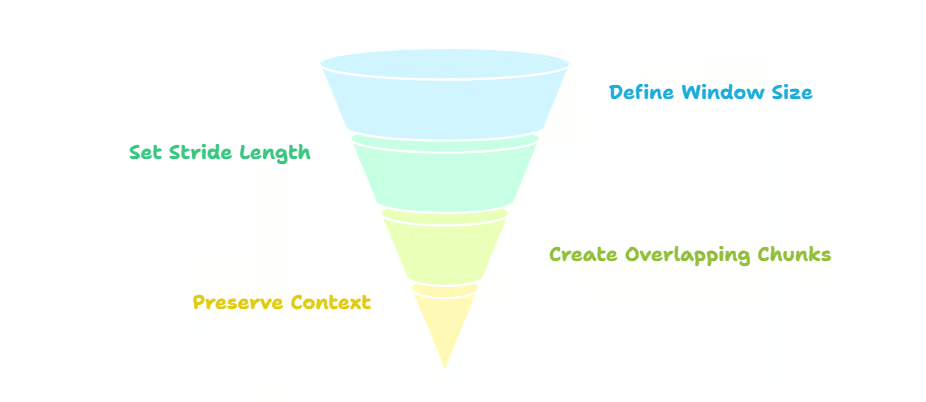

Chunking cửa sổ trượt

Trái ngược với chunking ngữ nghĩa nhấn mạnh tính mạch lạc, chunking cửa sổ trượt nhấn mạnh tính liên tục bằng cách chồng lấp các đoạn, trượt một cửa sổ qua văn bản. Ví dụ, nếu tôi dùng kích thước đoạn (cửa sổ) 500 token với bước trượt 250, mỗi đoạn sẽ chồng lấp một nửa với đoạn trước.

Phần chồng lấp này bảo toàn ngữ cảnh qua ranh giới đoạn, giảm rủi ro mất thông tin quan trọng ở mép đoạn. Nó cũng cải thiện độ chính xác truy xuất, vì nhiều đoạn chồng lấp có thể cùng nổi lên khi trả lời truy vấn. Đổi lại là sự dư thừa—chồng lấp làm tăng chi phí lưu trữ và xử lý. Cửa sổ trượt đặc biệt hữu ích cho văn bản phi cấu trúc như log trò chuyện hoặc bản chép podcast.

Chunking cửa sổ trượt

Khi triển khai chiến lược này, tôi thường dùng phần chồng lấp 20–50% giữa các đoạn để bảo toàn ngữ cảnh, đặc biệt trong văn bản kỹ thuật hoặc hội thoại. Kích thước đoạn 200–400 token là mặc định phổ biến trong các framework như LangChain, dù có thể tinh chỉnh tùy giới hạn ngữ cảnh mô hình và loại tài liệu. Tôi khuyến nghị cách này cho các ứng dụng mà việc bảo toàn ngữ cảnh là tối quan trọng và hiệu quả lưu trữ ít quan trọng hơn.

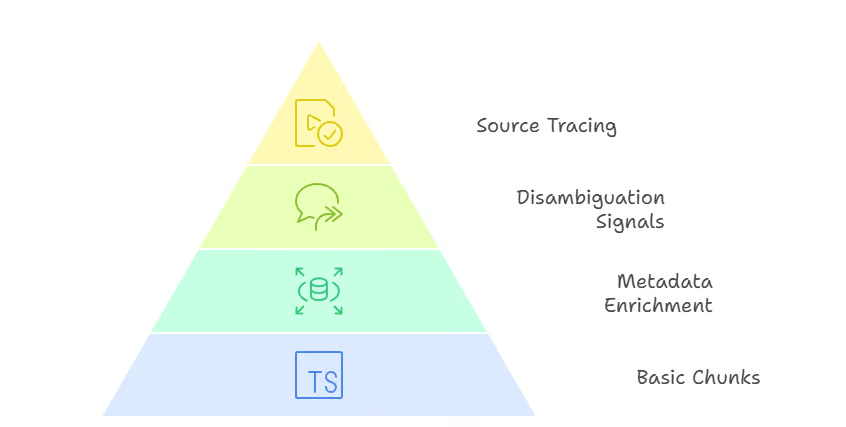

Chunking phân cấp và theo ngữ cảnh

Khi tính liên tục là chưa đủ và cần bảo toàn cấu trúc tài liệu, chunking phân cấp và theo ngữ cảnh phát huy tác dụng.

Chunking phân cấp bảo toàn đầy đủ cấu trúc của tài liệu, từ mục đến câu. Thay vì tạo danh sách phẳng các đoạn, nó xây dựng một cây phản ánh hệ thống phân cấp gốc. Mỗi đoạn có quan hệ cha–con với các cấp trên và dưới. Ví dụ, một mục chứa nhiều đoạn văn (cha → con), và mỗi đoạn có thể chứa nhiều câu.

Trong lúc truy xuất, cấu trúc này cho phép điều hướng linh hoạt. Nếu truy vấn khớp một đoạn cấp câu, hệ thống có thể mở rộng lên để cung cấp ngữ cảnh bổ sung từ đoạn văn cha hoặc thậm chí toàn bộ mục. Ngược lại, nếu một truy vấn rộng khớp với đoạn cấp mục, hệ thống có thể khoan sâu vào đoạn văn hoặc câu con liên quan nhất. Truy xuất đa cấp này cải thiện cả độ chính xác lẫn độ bao phủ, vì mô hình có thể điều chỉnh phạm vi nội dung trả về.

Chunking phân cấp

Chunking theo ngữ cảnh tiến thêm một bước bằng cách làm giàu các đoạn với siêu dữ liệu như tiêu đề, dấu thời gian, hoặc nguồn tham chiếu. Thông tin bổ sung này cung cấp các tín hiệu quan trọng giúp hệ thống truy xuất phân giải kết quả. Chẳng hạn, hai tài liệu có thể chứa các câu gần như giống hệt nhau, nhưng tiêu đề mục hoặc dấu thời gian của chúng có thể quyết định cái nào phù hợp hơn với truy vấn. Siêu dữ liệu cũng giúp truy vết câu trả lời về nguồn, đặc biệt hữu ích trong các miền có yêu cầu tuân thủ.

Chunking theo ngữ cảnh

Lợi ích chính của chunking phân cấp và theo ngữ cảnh là độ chính xác và tính linh hoạt. Đổi lại là tăng độ phức tạp cả ở tiền xử lý lẫn logic truy xuất, vì hệ thống phải quản lý quan hệ giữa các đoạn thay vì xử lý chúng như các đơn vị độc lập. Tôi khuyến nghị các cách này cho các miền như hợp đồng pháp lý, báo cáo tài chính, hoặc đặc tả kỹ thuật, nơi việc bảo toàn cấu trúc và khả năng truy vết là tối quan trọng.

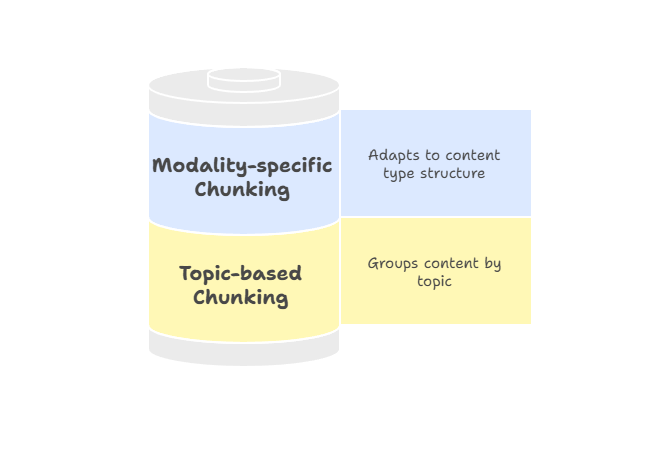

Chunking theo chủ đề và theo phương tiện

Không phải tài liệu nào cũng theo hệ thống phân cấp nghiêm ngặt, vì vậy chunking theo chủ đề hoặc theo phương tiện (modality) mang đến cách linh hoạt hơn để nhóm nội dung liên quan.

Chunking theo chủ đề nhóm văn bản theo đơn vị chủ đề bằng các thuật toán như Latent Dirichlet Allocation (LDA) cho mô hình chủ đề hoặc các phương pháp phân cụm dựa trên embedding để xác định ranh giới ngữ nghĩa.

Thay vì kích thước cố định hoặc dấu hiệu cấu trúc, mục tiêu là giữ tất cả nội dung liên quan đến một chủ đề ở cùng một nơi. Cách này hoạt động tốt với nội dung dài như báo cáo nghiên cứu hoặc bài viết chuyển qua lại giữa các chủ đề riêng biệt. Bởi vì mỗi đoạn tập trung vào một chủ đề, kết quả truy xuất bám sát ý định người dùng hơn và ít có khả năng kèm nội dung ngoài lề.

Chunking theo phương tiện điều chỉnh chiến lược theo loại nội dung, đảm bảo thông tin được chia theo cách tôn trọng cấu trúc của từng phương tiện. Ví dụ:

- Văn bản: Chunking theo câu hoặc ngữ nghĩa giúp các đoạn mạch lạc và phù hợp truy vấn.

- Bảng: Chia theo hàng hoặc nhóm logic để bảo toàn ý nghĩa các mối quan hệ dữ liệu.

- Hình ảnh: Chia theo vùng hoặc nhúng chú thích để cung cấp ngữ cảnh cục bộ cho truy xuất.

Chunking theo chủ đề và theo phương tiện

Siêu dữ liệu đặc biệt quan trọng trong chunking theo phương tiện. Ví dụ, gắn tiêu đề cột vào từng hàng bảng, liên kết chú thích với vùng ảnh, hoặc thêm nhãn người nói và dấu thời gian vào bản chép giúp hệ thống truy xuất vừa xác định đúng đoạn vừa diễn giải chính xác. Việc làm giàu này nâng cao cả độ chính xác lẫn niềm tin của người dùng, vì kết quả đi kèm các tín hiệu ngữ cảnh giải thích tính liên quan.

Tôi khuyến nghị áp dụng chunking theo phương tiện khi làm việc với pipeline đa phương tiện hoặc tài liệu phi truyền thống không phù hợp hoàn toàn với chiến lược dựa trên văn bản. Nó đảm bảo mỗi loại nội dung được biểu diễn theo cách tối đa hóa chất lượng truy xuất và tính hữu dụng.

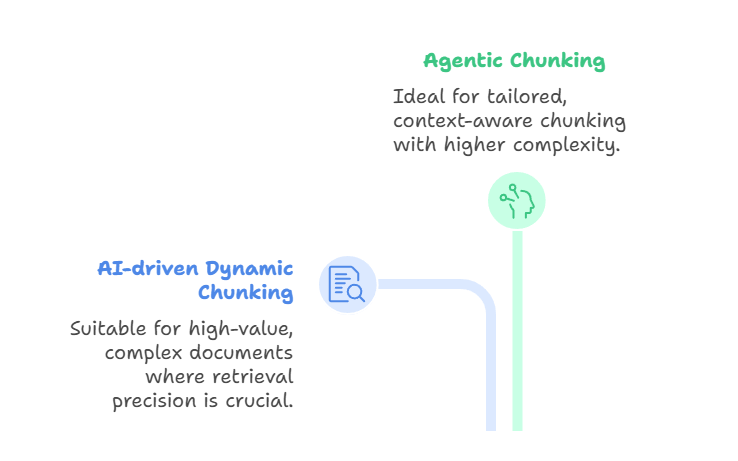

Chunking năng động do AI dẫn dắt và kiểu agentic

Vượt lên trên các phương pháp dựa trên quy tắc và ý nghĩa, những cách tiếp cận tiên tiến như chunking năng động do AI dẫn dắt và chunking kiểu agentic còn tiến xa hơn.

Chunking năng động do AI dẫn dắt sử dụng một mô hình ngôn ngữ lớn để xác định trực tiếp ranh giới đoạn, thay vì dựa vào quy tắc định sẵn. LLM quét tài liệu, nhận diện điểm ngắt tự nhiên và điều chỉnh kích thước đoạn một cách thích ứng.

Những phần dày đặc có thể được tách nhỏ hơn, trong khi phần nhẹ có thể gộp lại. Kết quả là các đoạn mạch lạc về ngữ nghĩa, nắm bắt trọn vẹn khái niệm, nâng cao độ chính xác truy xuất. Phương pháp này phù hợp khi làm việc với tài liệu phức tạp, giá trị cao—như hợp đồng pháp lý, sổ tay tuân thủ, hoặc bài nghiên cứu—nơi độ chính xác truy xuất quan trọng hơn thông lượng hoặc chi phí.

Mặt khác, chunking kiểu agentic phát triển ý tưởng này bằng cách đưa vào tầng suy luận cao hơn. Thay vì chỉ để LLM chia văn bản, một tác tử AI đánh giá tài liệu và ý định người dùng rồi quyết định cách chunking.

Tác tử có thể chọn chiến lược khác nhau cho những phần khác nhau. Ví dụ, chia một báo cáo y tế theo tiền sử bệnh, kết quả xét nghiệm, và ghi chú bác sĩ, đồng thời áp dụng phân đoạn ngữ nghĩa cho phần diễn giải tự sự. Nó cũng có thể làm giàu một số đoạn bằng siêu dữ liệu như dấu thời gian, mã chẩn đoán, hoặc định danh bác sĩ.

Theo cách này, chunking kiểu agentic hoạt động như một lớp điều phối: tác tử chọn hoặc kết hợp các cách chunking một cách linh hoạt, thay vì áp dụng một phương pháp cho toàn bộ tài liệu. Kết quả là chunking phù hợp hơn theo ngữ cảnh, đổi lại là độ phức tạp và nhu cầu tính toán cao hơn.

Chunking năng động do AI dẫn dắt và kiểu agentic

Cả hai phương pháp đều tiên tiến và mạnh mẽ, nhưng giải quyết các vấn đề khác nhau. Chunking năng động do AI dẫn dắt tập trung tạo ranh giới phù hợp ngữ nghĩa trong giai đoạn nạp, còn chunking kiểu agentic tập trung chọn và kết hợp thông minh các chiến lược chunking cho từng tài liệu. Chúng có liên quan đến late chunking, được đề cập đầu bài, hỗ trợ các mô hình ngữ cảnh dài bằng cách nhúng toàn bộ tài liệu trước rồi áp dụng chunking ở mức embedding.

Những cách này tạo ra các đoạn có tính thích nghi cao, nhận thức ngữ nghĩa. Đổi lại là đánh đổi lớn: chunking do AI dẫn dắt tốn kém và có thể chậm hơn, còn chunking kiểu agentic thêm một lớp phức tạp và hạ tầng. Chunking năng động do AI dẫn dắt phù hợp khi nội dung cần được phân đoạn có ý nghĩa theo thời gian thực, còn chunking kiểu agentic tỏa sáng khi tài liệu rất đa dạng và đòi hỏi suy luận ở cấp chiến lược.

Các lưu ý triển khai

Sau khi chọn chiến lược chunking, bước tiếp theo là cân nhắc chi tiết triển khai. Các yếu tố thực tế như kích thước đoạn, quản lý chồng lấp, và đếm token ảnh hưởng trực tiếp đến hiệu năng hệ thống. Quá lớn, đoạn có thể vượt giới hạn ngữ cảnh; quá nhỏ, đoạn mất ý nghĩa.

Tính tương thích cũng là mối quan tâm chính. Các mô hình và giải pháp embedding khác nhau có sơ đồ token hóa và cửa sổ ngữ cảnh riêng, nên tôi đảm bảo quy trình chunking của mình tính đến những khác biệt này.

Về phía hạ tầng, không thể bỏ qua quản lý bộ nhớ và hiệu quả tính toán; chồng lấp làm tăng dư thừa, còn phương pháp đệ quy hoặc ngữ nghĩa có thể thêm chi phí xử lý. Các bước hậu xử lý như mở rộng đoạn hoặc làm giàu siêu dữ liệu có thể giúp khôi phục ngữ cảnh, nhưng cũng làm tăng độ phức tạp.

Với những nền tảng này, điều quan trọng là đo lường xem các chiến lược chunking hiệu quả thế nào trong thực tế.

Đánh giá hiệu năng và Tối ưu hóa

Hiệu quả của chunking không chỉ là lý thuyết—cần được đo bằng các chỉ số rõ ràng.

Ví dụ, độ chính xác ngữ cảnh (context precision) đo bao nhiêu đoạn được truy xuất thực sự liên quan đến truy vấn, trong khi độ bao phủ ngữ cảnh (context recall) đo xem có bao nhiêu đoạn liên quan trong kho tri thức đã được truy xuất thành công.

Kết hợp lại, chúng cho thấy liệu một chiến lược chunking có giúp bộ truy xuất tìm đúng thông tin hay không.

Liên quan chặt chẽ là độ phù hợp ngữ cảnh (context relevancy), tập trung vào mức độ các đoạn truy xuất khớp với ý định của người dùng, đặc biệt hữu ích khi tinh chỉnh tham số truy xuất như top-K.

Các chỉ số riêng ở mức đoạn, như mức sử dụng đoạn (chunk utilization), đo xem mô hình thực sự dùng bao nhiêu nội dung của đoạn để tạo phản hồi; nếu mức sử dụng thấp, đoạn có thể quá rộng hoặc nhiễu.

Mặt khác, gán nguồn đoạn (chunk attribution) đánh giá liệu hệ thống xác định đúng các đoạn đã đóng góp vào câu trả lời cuối cùng hay không. Những đánh giá ở mức đoạn giúp xác nhận rằng các đoạn không chỉ được truy xuất mà còn được áp dụng một cách có ý nghĩa.

Tối ưu hóa cũng đóng vai trò chủ chốt và thường là cân bằng giữa tốc độ và độ chính xác. Thử nghiệm với kích thước đoạn, tỷ lệ chồng lấp, và tham số truy xuất để cải thiện cả hiệu quả tính toán và độ phong phú ngữ nghĩa là điều quan trọng. Bên cạnh đó, A/B testing là cần thiết vì cung cấp phản hồi cụ thể, còn điều chỉnh lặp giúp chiến lược được cải thiện theo thời gian thay vì trì trệ.

Trong khi tinh chỉnh hiệu năng có thể cải thiện hệ thống dùng chung, các ứng dụng đặc thù theo miền lại có những thách thức riêng.

Ứng dụng Chunking theo miền

Các ngành khác nhau đặt ra yêu cầu khác nhau cho chiến lược chunking. Trong tài chính, tài liệu như báo cáo thường niên hoặc hồ sơ nộp cơ quan rất dày và kỹ thuật, nên việc chọn chiến lược chunking bảo toàn bảng số, tiêu đề và chú thích là bắt buộc. Tài liệu pháp lý và kỹ thuật cũng đặt ra thách thức tương tự—độ chính xác và cấu trúc là không thể thương lượng, khiến cách tiếp cận phân cấp hoặc làm giàu ngữ cảnh đặc biệt giá trị.

Tài liệu y tế và đa phương tiện đưa ra những nhu cầu mới. Hồ sơ bệnh nhân có thể kết hợp ghi chú lâm sàng, kết quả xét nghiệm và dữ liệu hình ảnh, trong khi tài liệu đa phương tiện có thể tích hợp văn bản với biểu đồ hoặc bản chép âm thanh. Ở đây, chunking theo phương tiện đảm bảo mỗi loại dữ liệu được phân đoạn theo cách bảo toàn ý nghĩa đồng thời duy trì sự liên kết giữa các phương tiện.

Bất kể miền nào, tuân theo một bộ thực tiễn tốt giúp chiến lược chunking đáng tin cậy hơn và dễ bảo trì hơn.

Thực tiễn tốt nhất và Hướng dẫn

Chọn đúng chiến lược chunking phụ thuộc vào nhiều yếu tố: loại nội dung, độ phức tạp truy vấn, tài nguyên sẵn có, và kích thước cửa sổ ngữ cảnh của mô hình. Tôi hiếm khi dựa vào một phương pháp cho mọi trường hợp—thay vào đó, tôi điều chỉnh cách tiếp cận để phù hợp với nhu cầu hệ thống.

Tối ưu hóa lặp là trung tâm của thành công dài hạn. Hiệu quả chunking cần được kiểm thử liên tục, xác thực kết quả bằng truy vấn thực tế và điều chỉnh dựa trên phản hồi. Cross-validation giúp đảm bảo các cải tiến không chỉ là thắng lợi nhất thời mà còn bền vững qua các trường hợp sử dụng khác nhau.

Cuối cùng, tôi khuyên coi chunking như một hệ thống tiến hóa. Tài liệu hóa tốt, kiểm thử thường xuyên và bảo trì liên tục giúp ngăn trôi lệch và đảm bảo pipeline vẫn vững chắc khi dữ liệu và mô hình thay đổi.

Kết luận

Chunking có thể trông như một chi tiết tiền xử lý, nhưng như bạn đã thấy xuyên suốt hướng dẫn này, nó định hình căn bản cách hệ thống RAG vận hành. Từ phương pháp kích thước cố định và theo câu đến các chiến lược ngữ nghĩa, agentic, và do AI dẫn dắt nâng cao, mỗi cách đều có đánh đổi giữa sự đơn giản, độ chính xác, hiệu quả và khả năng thích ứng.

Không có một phương pháp phù hợp cho mọi kịch bản. Chiến lược chunking đúng phụ thuộc vào loại nội dung, khả năng của mô hình ngôn ngữ, và mục tiêu ứng dụng. Bằng cách chú ý đến các nguyên tắc như tính mạch lạc ngữ nghĩa, bảo toàn ngữ cảnh và hiệu quả tính toán, bạn có thể thiết kế các đoạn giúp cải thiện độ chính xác truy xuất, tối ưu hiệu năng và đảm bảo đầu ra đáng tin cậy hơn.

Nhìn về phía trước, chiến lược chunking có thể sẽ ngày càng năng động, thích ứng và nhận thức mô hình hơn. Khi các mô hình ngữ cảnh dài phát triển và công cụ đánh giá trưởng thành, tôi kỳ vọng chunking sẽ chuyển từ bước tiền xử lý tĩnh sang một quy trình thông minh, nhạy theo ngữ cảnh và liên tục học từ hành vi sử dụng.

Với bất kỳ ai xây dựng hệ thống RAG, nắm vững chunking là điều thiết yếu để tạo pipeline truy xuất chính xác, hiệu quả và sẵn sàng cho tương lai.

Để tiếp tục học hỏi, hãy xem các tài nguyên sau:

Câu hỏi thường gặp về Chunking

Chunking ngữ nghĩa cải thiện độ chính xác của hệ thống RAG như thế nào?

Chunking ngữ nghĩa chia văn bản tại các ranh giới khái niệm tự nhiên bằng độ tương đồng embedding, đảm bảo mỗi đoạn tập trung vào một chủ đề. Sự tương khớp với ý định người dùng này cải thiện đáng kể độ chính xác truy xuất so với các phương pháp chia dựa trên quy tắc.

Bạn có thể giải thích chi tiết hơn về quy trình chunking đệ quy không?

Chunking đệ quy áp dụng các quy tắc chia tách theo hệ thống phân cấp—trước theo mục, sau đó đoạn văn, cuối cùng là câu—cho đến khi các đoạn đáp ứng giới hạn kích thước. Cách tiếp cận từ trên xuống này bảo toàn cấu trúc tài liệu đồng thời đảm bảo tương thích với cửa sổ ngữ cảnh của mô hình.

Khác biệt chính giữa chunking kích thước cố định và chunking ngữ nghĩa là gì?

Chunking kích thước cố định chia văn bản theo số ký tự, từ, hoặc token mà không xét ý nghĩa, ưu tiên tốc độ hơn độ chính xác. Chunking ngữ nghĩa dùng độ tương đồng embedding để nhận diện ranh giới khái niệm, nhấn mạnh độ chính xác truy xuất hơn hiệu quả tính toán.

Chunking kiểu agentic thích nghi với hành vi và ý định người dùng như thế nào?

Chunking kiểu agentic sử dụng các tác tử AI để chọn và kết hợp thông minh các chiến lược chunking khác nhau cho mỗi phần tài liệu dựa trên loại nội dung và cấu trúc. Tác tử động chọn cách tối ưu, như áp dụng phân đoạn ngữ nghĩa cho phần tự sự trong khi bảo toàn tính toàn vẹn của dữ liệu dạng bảng.

Lợi ích chính của việc dùng chunking phân cấp kèm siêu dữ liệu là gì?

Chunking phân cấp bảo toàn cấu trúc tài liệu thông qua quan hệ cha–con, cho phép truy xuất linh hoạt ở nhiều mức độ chi tiết. Làm giàu siêu dữ liệu bổ sung các tín hiệu ngữ cảnh như tiêu đề và dấu thời gian, cải thiện phân giải nhầm lẫn và khả năng truy vết nguồn.

Với vai trò Nhà sáng lập Martin Data Solutions và Nhà khoa học dữ liệu/ Kỹ sư ML & AI tự do, tôi sở hữu danh mục năng lực đa dạng về Hồi quy, Phân loại, Xử lý ngôn ngữ tự nhiên (NLP), LLM, RAG, Mạng nơ-ron, Phương pháp tổ hợp (Ensemble) và Thị giác máy tính.

- Phát triển thành công nhiều dự án ML end-to-end, bao gồm làm sạch dữ liệu, phân tích, xây dựng mô hình và triển khai trên AWS và GCP, mang lại các giải pháp có tác động và khả năng mở rộng.

- Xây dựng các ứng dụng web tương tác, có khả năng mở rộng bằng Streamlit và Gradio cho nhiều bài toán trong các ngành khác nhau.

- Giảng dạy và cố vấn cho học viên về khoa học dữ liệu và phân tích, thúc đẩy sự phát triển nghề nghiệp của họ thông qua phương pháp học tập cá nhân hóa.

- Thiết kế nội dung khóa học cho các ứng dụng retrieval-augmented generation (RAG) được điều chỉnh theo yêu cầu doanh nghiệp.

- Viết các blog kỹ thuật AI & ML có sức ảnh hưởng, bao gồm các chủ đề như MLOps, cơ sở dữ liệu vector và LLM, đạt được mức độ tương tác đáng kể.

Trong mỗi dự án tôi đảm nhận, tôi luôn áp dụng các thực hành cập nhật trong kỹ thuật phần mềm và DevOps như CI/CD, linting mã, định dạng, giám sát mô hình, theo dõi thí nghiệm và xử lý lỗi mạnh mẽ. Tôi cam kết cung cấp các giải pháp hoàn chỉnh, chuyển hóa những hiểu biết từ dữ liệu thành chiến lược thực tiễn giúp doanh nghiệp phát triển và khai thác tối đa giá trị của khoa học dữ liệu, học máy và AI.