Leerpad

dbt (data build tool) is uitgegroeid tot een veelgebruikt ontwikkelkader in moderne data-engineering- en analytics-workflows. Data-analisten zijn vaak afhankelijk van data-engineers om transformaties in SQL te schrijven. Maar met dbt kunnen ze zelf transformaties schrijven en meer controle over data krijgen. Het biedt ook integratie met populaire versiebeheersystemen zoals Git, wat de samenwerking binnen teams verbetert.

Bereid je je voor op een rol in een datawarehouse, zoals data-engineer, data-analist of data scientist, dan moet je goed thuis zijn in basis- en gevorderde dbt-vragen!

In dit artikel heb ik de meest gestelde interviewvragen op een rij gezet om je basisconcepten en gevorderde probleemoplossende vaardigheden op te bouwen.

Wat is dbt?

dbt is een open-source datatransformatiekader waarmee je data kunt transformeren, testen op nauwkeurigheid en wijzigingen kunt bijhouden binnen één platform. In tegenstelling tot andere ETL-tools (extract, transform, load) doet dbt alleen het transformatiegedeelte (de T).

Sommige andere ETL-tools extraheren data uit verschillende bronnen, transformeren die buiten het warehouse en laden het daarna terug. Dit vereist vaak gespecialiseerde codeerkennis en extra tools. dbt maakt dit eenvoudiger — het voert transformaties in het warehouse uit met alleen SQL.

Meer dan 40.000 grote bedrijven gebruiken dbt om data te stroomlijnen — daarom noemen recruiters het een van de belangrijkste skills voor data-gerelateerde rollen. Als je het zelfs als beginnende dataprofessional onder de knie krijgt, kan dat veel carrièrekansen openen!

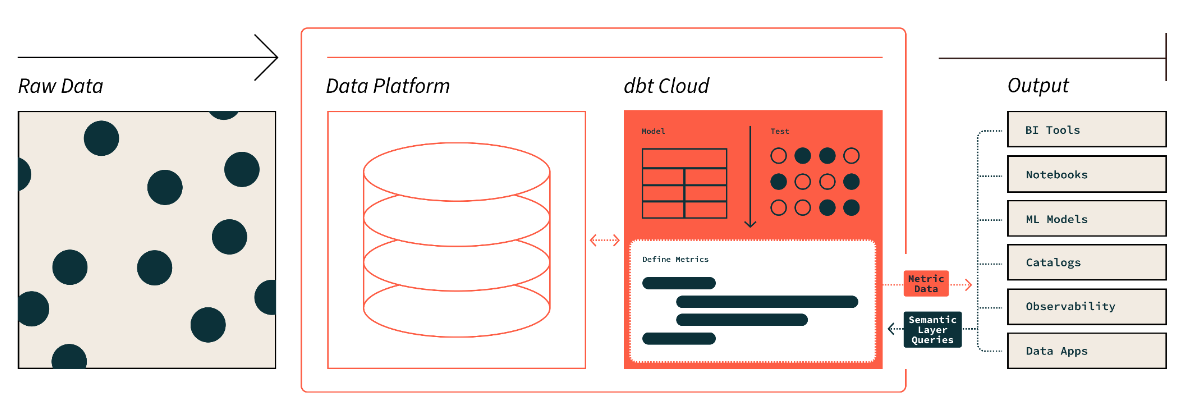

De dbt-semantic layer. Beeldbron: dbt

Basis dbt-sollicitatievragen

Aan het begin van het sollicitatieproces test de interviewer je basiskennis. Daarvoor kunnen ze je enkele fundamentele vragen stellen zoals deze:

Wat zijn de gangbare toepassingen van dbt?

dbt brengt een datateam op één lijn, waar ze hun data kunnen transformeren, documenteren en testen. Het helpt om data betrouwbaar en begrijpelijk te maken. De gangbare toepassingen van dbt zijn onder meer:

- Datatransformatie: Dit is de kern van analytics-werk. dbt beheert alles van het schrijven van SQL-queries tot het onderhouden van technische pijplijnen, wat het werk van data-analisten en -engineers vermindert.

- Testen: Het is essentieel om de code te valideren vóór uitrol. Met dbt kun je meerdere tests uitvoeren om de nauwkeurigheid en betrouwbaarheid van data te waarborgen.

- Documentatie: Hierdoor kunnen andere teamleden de datasets beter begrijpen. We kunnen hier een beschrijving toevoegen van onze code, tabellen, DAG (Directed Acyclic Graph) en de tests die je hebt uitgevoerd.

- Soepele migratie: dbt maakt het eenvoudiger om datamodellen tussen platforms te verplaatsen. Zodra we het model hebben gebouwd, kunnen we het migreren met minimale syntaxisaanpassingen.

Is dbt een programmeertaal?

Nee, dbt is geen programmeertaal. Het is een tool die helpt bij datatransformatietaken in het warehouse. Als je SQL kunt schrijven, kun je eenvoudig met dbt werken. Het is ook begonnen met ondersteuning voor Python voor specifieke taken. Maar in de kern beheert en voert het SQL-gebaseerde transformaties uit.

Kun je uitleggen hoe dbt zich verhoudt tot Spark?

dbt en Spark dienen verschillende doelen en richten zich op verschillende soorten workflows. Hier is een vergelijking van hun rol in de datainfrastructuur:

|

Functie |

dbt |

Spark |

|

Rol |

SQL-gebaseerde datatransformaties en modellering |

Gedistribueerde dataverwerking en analytics |

|

Kern-taal |

SQL-first, met beperkte Python-ondersteuning |

Ondersteunt SQL, Python, Scala, Java, R |

|

Datagovernance |

Documentatie- en lineage-ondersteuning |

Biedt toegangscontrole, auditing en data lineage |

|

Doelgebruikers |

SQL-gebruikers, analisten en teams zonder engineeringskills |

Data-engineers, data scientists, developers |

|

Transformatiecomplexiteit |

Richt zich alleen op SQL-transformaties en modellering |

Kan ook complexe transformaties in andere talen aan |

|

Testen en validatie |

Heeft ingebouwde testmogelijkheden |

Vereist aangepaste teststrategieën (unit en integratie) |

Wat zijn de uitdagingen met dbt?

Hoewel dbt veel waarde biedt voor datateams, kan het ook uitdagingen opleveren, vooral wanneer schaal en complexiteit toenemen. Enkele van de meest voorkomende uitdagingen zijn:

- Steile leercurve: Nieuwe gebruikers kunnen worstelen met concepten als datamodellering, Jinja-templating en projectstructuur.

- Datakwaliteit en testen: Voldoende testdekking waarborgen en tests onderhouden in grote projecten kan complex zijn.

- Schaalproblemen: Prestatieknelpunten kunnen optreden bij grote datasets of complexe transformaties.

- Afhankelijkheidsbeheer: Afhankelijkheden beheren en de DAG troubleshooten naarmate projecten groeien kan uitdagend zijn.

- Orchestratie: dbt integreren in bredere workflows kan lastig zijn, vooral met aangepaste scheduling.

- Documentatie: Documentatie en tests van modellen up-to-date houden kan tijdrovend zijn.

- Databasespecifieke beperkingen: Verschillende dataplatformen kunnen verschillen in compatibiliteit en features.

- Overstappen vanaf legacy-tools: Workflows aanpassen van legacy ETL-tools kan lastig zijn.

- Complexe bedrijfslogica: Geavanceerde logica afhandelen binnen dbt kan macros vereisen, wat extra complexiteit toevoegt.

Weten hoe je met bovenstaande potentiële uitdagingen omgaat, is iets waar werkgevers naar kijken, dus onderschat het belang van deze vraag niet.

Wat is het verschil tussen dbt Core en dbt Cloud?

Er zijn twee hoofdversies van dbt:

dbt Core is de gratis en open-source versie van dbt waarmee gebruikers lokaal SQL-gebaseerde transformaties kunnen schrijven, uitvoeren en beheren. Het biedt een command-line interface (CLI) om dbt-projecten uit te voeren, modellen te testen en datapijplijnen te bouwen. Omdat het open-source is, moeten gebruikers met dbt Core zelf zorgen voor deployment, orchestratie en infrastructuur, meestal integreren met tools als Airflow of Kubernetes voor automatisering.

dbt Cloud daarentegen is een beheerde dienst van de makers van dbt (Fishtown Analytics). Het biedt alle mogelijkheden van dbt Core, plus extra features zoals een webinterface, geïntegreerde scheduling, jobmanagement en samenwerkingstools. dbt Cloud bevat ook built-in CI/CD (continue integratie en uitrol), API-toegang en verbeterde security-compliance zoals SOC 2 en HIPAA voor organisaties met strengere beveiligingseisen.

Gemiddelde dbt-sollicitatievragen

Nu we de basisvragen hebben behandeld, volgen hier enkele dbt-vragen op gemiddeld niveau. Deze richten zich op specifieke technische aspecten en concepten.

Wat zijn sources in dbt?

In dbt zijn sources de ruwe datatabellen. We schrijven niet rechtstreeks SQL-queries op die ruwe tabellen — we specificeren het schema en de tabelnaam en definiëren ze als sources. Dit maakt het eenvoudiger om naar dataobjecten in tabellen te verwijzen.

Stel, je hebt een ruwe datatabel in je database met de naam orders in het sales-schema. In plaats van deze tabel direct te bevragen, definieer je die in dbt als een source, zoals hier:

Definieer de source in je sources.yml-bestand:

version: 2

sources:

- name: sales

tables:

- name: ordersGebruik de source in je dbt-modellen:

Zodra gedefinieerd, kun je naar de ruwe orders-tabel verwijzen in je transformaties zoals dit:

SELECT *

FROM {{ source('sales', 'orders') }}Deze aanpak abstraheert de definitie van de ruwe tabel, waardoor beheer eenvoudiger wordt en je, als de onderliggende tabelstructuur verandert, dit op één plek (de sourcedefinitie) kunt bijwerken in plaats van in elke query.

Voordelen van sources in dbt:

- Organisatie: Sources organiseren je ruwe data en maken beheer binnen een project eenvoudiger.

- Abstractie: Je abstraheert de schemadetails, waardoor fouten afnemen en flexibiliteit toeneemt.

- Documentatie: Sources definiëren helpt betere documentatie te maken voor je ruwe datainvoer.

Wat is een dbt-model?

Een dbt-model is in essentie een SQL- of Python-bestand dat de transformatielogica voor ruwe data definieert. In dbt zijn modellen de kerncomponent waar je je transformaties schrijft, of het nu aggregaties, joins of andere vormen van datamanipulatie zijn.

- SQL-modellen in dbt gebruiken

SELECT-statements om transformaties te definiëren en worden opgeslagen als .sql-bestanden. - Python-modellen, geïntroduceerd met dbt's ondersteuning voor Python, worden opgeslagen als

.py-bestanden en laten je Python-bibliotheken zoals pandas gebruiken om data te manipuleren.

Voorbeeld van een SQL-model:

Een SQL-model transformeert ruwe data met SQL-queries. Bijvoorbeeld, om een samenvatting van orders te maken uit een orders-tabel:

--orders_summary.sql

WITH orders_cte AS (

SELECT

customer_id,

COUNT(order_id) AS total_orders,

SUM(order_amount) AS total_revenue

FROM {{ ref('orders') }}

GROUP BY customer_id

)

SELECT *

FROM orders_cteIn dit voorbeeld:

- Het model

orders_summary.sqlmaakt een samenvatting van het totaal aantal orders en omzet per klant met SQL. - Het model verwijst naar de

orders-tabel (al gedefinieerd als dbt-model of source).

Voorbeeld van een Python-model:

Een Python-model manipuleert ruwe data met Python-code. Dit is vooral handig voor complexe logica die in SQL omslachtig kan zijn.

# orders_summary.py

import pandas as pd

def model(dbt, session):

# Load the source data

orders = dbt.ref("orders").to_pandas()

# Perform transformations using pandas

orders_summary = orders.groupby('customer_id').agg(

total_orders=('order_id', 'count'),

total_revenue=('order_amount', 'sum')

).reset_index()

return orders_summaryIn dit voorbeeld:

- Het Python-model gebruikt pandas om de data te transformeren door orders per klant te groeperen en het totaal aantal orders en omzet te berekenen.

- Het resultaat wordt teruggegeven als een DataFrame, dat dbt kan opnemen in zijn pijplijn.

Hoe maak je een dbt-model?

Zo maak je een dbt-model:

- Maak een map aan onder de

modelsfolder in het dbt-project. - Voeg een nieuw tekstbestand toe met een

.sql-extensie in de map (of.pyals het een Python-model is). - Schrijf nu een SQL-query of code om de ruwe data te transformeren.

- Voer het commando

dbt runuit om de transformatie toe te passen en het model aan te maken.

Hoe gaat dbt om met afhankelijkheden tussen modellen?

dbt beheert modelafhankelijkheden met de functie ref(), die een duidelijke afhankelijkheidsketen tussen modellen creëert.

Wanneer je een transformatie in dbt definieert, verwijs je niet direct naar tabellen in je warehouse, maar naar andere dbt-modellen met de functie ref(). Zo zorgt dbt ervoor dat modellen in de juiste volgorde worden gebouwd door te identificeren welke modellen van andere afhankelijk zijn.

Als je bijvoorbeeld een model orders_summary hebt dat afhankelijk is van het model orders, definieer je het als volgt:

WITH orders AS (

SELECT * FROM {{ ref('orders') }}

)

SELECT

customer_id,

COUNT(order_id) AS total_orders,

SUM(order_amount) AS total_revenue

FROM orders

GROUP BY customer_idIn dit voorbeeld zorgt de functie {{ ref('orders') }} ervoor dat het orders model wordt gebouwd vóór orders_summary, omdat orders_summary afhankelijk is van de data in het orders-model.

Wat zijn macros in dbt en hoe kun je ze uitvoeren?

Macros in dbt zijn herbruikbare blokken SQL-code die zijn geschreven met de Jinja-templating engine. Ze stellen je in staat repetitieve taken te automatiseren, complexe logica te abstraheren en SQL-code te hergebruiken in meerdere modellen, waardoor je dbt-project efficiënter en beter onderhoudbaar wordt.

Macros kunnen worden gedefinieerd in .sql-bestanden binnen de map macros van je dbt-project.

Macros zijn vooral handig als je vergelijkbare transformaties over meerdere modellen moet uitvoeren of om omgevingsspecifieke logica toe te passen, zoals verschillende schema's gebruiken of datumformaten aanpassen op basis van omgevingen (bijv. development, staging of productie).

Voorbeeld van het maken van macros:

- Datumformattering-macro: Je kunt een macro maken om datumformattering in modellen te standaardiseren. In plaats van datumlogica te herhalen, maak je een macro zoals deze:

-- macros/date_format.sql

{% macro format_date(column) %}

FORMAT_TIMESTAMP('%Y-%m-%d', {{ column }})

{% endmacro %}Gebruik in een model:

SELECT

customer_id,

{{ format_date('order_date') }} AS formatted_order_date

FROM {{ ref('orders') }}In dit voorbeeld wordt de macro format_date gebruikt om het formaat van de kolom order_date te standaardiseren in elk model waar deze wordt aangeroepen.

- Aangepaste schemanaam-macro: Deze macro wijzigt dynamisch de schemanamen afhankelijk van de omgeving (bijv. development of productie). Dit helpt om omgevingen te beheren zonder schemanamen handmatig te wijzigen.

-- macros/custom_schema.sql

{% macro custom_schema_name() %}

{% if target.name == 'prod' %}

'production_schema'

{% else %}

'dev_schema'

{% endif %}

{% endmacro %}Gebruik in een model:

SELECT *

FROM {{ custom_schema_name() }}.ordersHier controleert de macro of de omgeving (target.name) "prod" is en geeft op basis daarvan de juiste schemanaam terug.

Hoe voer je macros uit:

Macros worden niet rechtstreeks uitgevoerd zoals SQL-modellen. In plaats daarvan worden ze aangeroepen in je modellen of andere macros en uitgevoerd wanneer het dbt-project draait. Als je bijvoorbeeld een macro in een model gebruikt, wordt de macro uitgevoerd wanneer je het commando dbt run uitvoert.

- Een macro aanroepen binnen een model: Wanneer je een macro in een SQL-model opneemt, wordt de macro uitgevoerd tijdens de run van het model.

- Macros handmatig uitvoeren: Je kunt sommige macros ook handmatig uitvoeren door ze aan te roepen met het commando

dbt run-operation. Dit wordt meestal gebruikt voor eenmalige taken, zoals seeden van data of onderhoudstaken.

Wat zijn de twee typen tests in dbt?

Singular tests en generic tests zijn de twee testtypen in dbt:

- Singular tests richten zich op specifieke voorwaarden in een dbt-model. Als de testvoorwaarde faalt, worden de rijen geretourneerd.

Voorbeeld: Stel dat je wilt garanderen dat er geen orders zijn met een negatieve order_amount. Je kunt een singular test schrijven in de map tests als volgt:

-- tests/no_negative_order_amount.sql

SELECT *

FROM {{ ref('orders') }}

WHERE order_amount < 0Als deze test faalt, retourneert dbt alle rijen uit de orders-tabel waar de order_amount negatief is.

- Generic tests zijn vooraf gedefinieerde tests die argumenten accepteren. Ze zijn verder onderverdeeld in de volgende typen:

|

Generic tests |

Definitie |

|

Unique |

Controleert op unieke waarden in de kolom. |

|

Not null |

Controleert op lege velden. |

|

Available values |

Verifieert dat kolomwaarden overeenkomen met een lijst verwachte waarden om standaardisatie te bewaren. |

|

Relationships |

Controleert referentiële integriteit tussen tabellen om inconsistente data te verwijderen. |

Voorbeeld: Je kunt eenvoudig een generic test toepassen om te garanderen dat customer_id in de tabel customers uniek en niet null is door dit te definiëren in je schema.yml-bestand:

version: 2

models:

- name: customers

columns:

- name: customer_id

tests:

- unique

- not_nullIn dit voorbeeld:

- De unique-test controleert dat elke

customer_idin de tabelcustomersuniek is. - De not_null-test controleert dat er geen

customer_id-waarden ontbreken of null zijn.

Gevorderde dbt-sollicitatievragen

Naarmate je verder komt, kun je complexere scenario's en geavanceerde concepten tegenkomen. Hier zijn een paar uitdagende interviewvragen om je expertise te peilen en je voor te bereiden op senior data-engineeringposities.

Hoe maak je incrementele modellen in dbt, en wanneer gebruik je ze?

Incrementele modellen in dbt worden gebruikt om alleen nieuwe of gewijzigde data te verwerken in plaats van elke keer de volledige dataset opnieuw te verwerken. Dit is vooral nuttig bij grote datasets waarbij het volledig herbouwen van het model tijdrovend en resource-intensief zou zijn.

Een incrementeel model laat dbt alleen nieuwe data toevoegen (of gewijzigde data updaten) op basis van een voorwaarde, meestal een timestamp-kolom (zoals updated_at).

Hoe maak je een incrementeel model:

1. Definieer het model als incrementeel door dit te specificeren in de config van het model:

{{ config(

materialized='incremental',

unique_key='id' -- of een andere unieke kolom

) }}2. Gebruik de functie is_incremental() om nieuwe of gewijzigde rijen te filteren:

SELECT *

FROM source_table

{% if is_incremental() %}

WHERE updated_at > (SELECT MAX(updated_at) FROM {{ this }})

{% endif %}3. Wanneer dbt dit model voor het eerst draait, verwerkt het alle data. Bij volgende runs verwerkt het alleen de rijen waar updated_at groter is dan de meest recente waarde die al in het model staat.

Wanneer gebruik je incrementele modellen:

- Grote datasets: Als je een grote tabel hebt met miljoenen of miljarden rijen, is het inefficiënt om bij elke run de hele tabel opnieuw op te bouwen.

- Frequente updates: Als je datawarehouse vaak updates of nieuwe data krijgt, maar je niet de hele dataset hoeft te herverwerken, kunnen incrementele modellen de verwerkingstijd aanzienlijk verkorten.

- Streamingdata: In gevallen waarin data gestreamd of regelmatig bijgewerkt wordt, helpen incrementele modellen om transformaties up-to-date te houden zonder alles opnieuw uit te voeren.

Hoe gebruik je Jinja om je SQL-code te verbeteren?

Jinja maakt onze SQL-code flexibeler. Met Jinja kunnen we herbruikbare templates definiëren voor veelvoorkomende SQL-patronen. En omdat de vereisten blijven veranderen, kunnen we Jinja's if-statements gebruiken om onze SQL-queries aan te passen afhankelijk van de voorwaarden. Dit verbetert meestal de SQL-code door complexe logica op te delen, waardoor deze begrijpelijker wordt.

Als je bijvoorbeeld het datumformaat wilt omzetten van "YYYY-MM-DD" naar "MM/DD/YYYY", is hier een dbt-macro als voorbeeld, die we eerder zagen:

{% macro change_date_format(column_name) %}

to_char({{ column_name }}::date, 'MM/DD/YYYY')

{% endmacro %}In dit codevoorbeeld is {{ column_name }} de plek waar Jinja de daadwerkelijke kolomnaam invoegt wanneer je de macro gebruikt. Dit wordt tijdens runtime vervangen door de echte kolomnaam. Zoals we in eerdere voorbeelden hebben gezien, gebruikt Jinja {{ }} om aan te geven waar de vervanging plaatsvindt.

Hoe zou je custom materialization in dbt maken?

Zo maak je een custom materialization in dbt:

- Maak het SQL-bestand voor de custom materialization.

- Definieer vervolgens een materialization-macro als

materialization_name:

{% materialization materialization_name, default -%}- Gebruik de vooraf gedefinieerde dbt-macros

adapter.get_relationom de doeltabel in te stellen. Dit is waar data wordt geladen. - Definieer en voer nu de SQL-commando's uit om data te maken en in de tabellen te laden:

{% set sql %}

SELECT * FROM {{ ref('your_source_table') }}

WHERE your_conditions = true

{% endset %}

{{ adapter.execute(sql) }}- Geef tot slot de target relation terug om de cache van dbt bij te werken en query-executie te optimaliseren.

{{ return(target_relation) }}

{% endmaterialization %}Hoe kun je je dbt-modellen debuggen? Noem twee manieren.

Hier zijn twee manieren om onze dbt-modellen te debuggen:

1. Raadpleeg de gecompileerde SQL-bestanden in de target-map om fouten te identificeren en te traceren.

Wanneer je een dbt-project draait, compileert dbt je modellen (geschreven met Jinja-templating) naar ruwe SQL-queries en slaat deze op in de map target. Deze gecompileerde SQL is precies wat dbt uitvoert op je dataplatform, dus het bekijken van deze bestanden kan helpen te achterhalen waar problemen ontstaan:

- Voer je dbt-modellen uit (bijv.

dbt runofdbt test). - Ga naar de map

target/compiled/in je dbt-projectdirectory. - Open het gecompileerde SQL-bestand van het model dat je debugt. Het bestand bevat de ruwe SQL die dbt uitvoerde, inclusief alle transformaties vanuit Jinja-macros en referenties.

- Kopieer de gecompileerde SQL-query en voer die direct uit in de SQL-editor van je dataplatform (bijv. Postgres, BigQuery) om gedetailleerde foutmeldingen te krijgen of het werkelijke gedrag van de query te zien.

2. Gebruik de dbt Power User Extension voor VS Code om queryresultaten direct te bekijken.

De dbt Power User Extension voor Visual Studio Code (VS Code) is een handige tool om dbt-modellen te debuggen. Deze extensie laat je je queries direct in je IDE bekijken en testen, zodat je minder hoeft te wisselen tussen dbt, de terminal en je database.

Hoe compileert dbt queries?

dbt compileert queries via de volgende stappen:

- Parsing: dbt leest alle SQL-bestanden, YAML-configs en macros in het project.

- Contextcreatie: Het bouwt een context voor elk model, inclusief configs en beschikbare macros.

- Jinja-rendering: Vervolgens verwerkt het SQL-bestanden als Jinja-templates om tags en expressies te vervangen door geëvalueerde resultaten.

- SQL-compilatie: Pure SQL-queries worden gegenereerd voor elk model.

- Artifactgeneratie: Gecompileerde SQL wordt opgeslagen in de map

target/compiled. - Voorbereiding op uitvoering: Voor

dbt runworden queries voorbereid op uitvoering, mogelijk met extra omhulling.

Dit proces transformeert modulaire, getemplate SQL naar uitvoerbare queries die specifiek zijn voor je datawarehouse. We kunnen dbt compile gebruiken of de map target/compiled bekijken om de uiteindelijke SQL voor elk model te zien en te debuggen.

Datawarehousing- en integratiegerichte dbt-sollicitatievragen

Het werk van de meeste data-engineers draait om het bouwen en integreren van datawarehouses met dbt. Vragen over deze scenario's komen heel vaak voor in interviews — daarom heb ik de meest gestelde verzameld:

Leg drie voordelen uit van het integreren van dbt met Airflow.

Het integreren van dbt met Airflow helpt bij het bouwen van een gestroomlijnde datapijplijn. Enkele voordelen:

- ETL-proces: Airflow beheert het extraheren en laden van data, zodat dbt zich kan richten op de transformatiefase, wat resulteert in een soepelere workflow.

- Automatisering van dbt-taken: Airflow automatiseert het inplannen en uitvoeren van dbt-modellen, vermindert handmatig werk en verhoogt de efficiëntie van je datatransformaties.

- Parallelle taakwerving: Airflow laat taken parallel draaien, zodat grote datasets verwerkt kunnen worden zonder prestatieverlies, wat helpt om snelle en betrouwbare datapijplijnen te behouden.

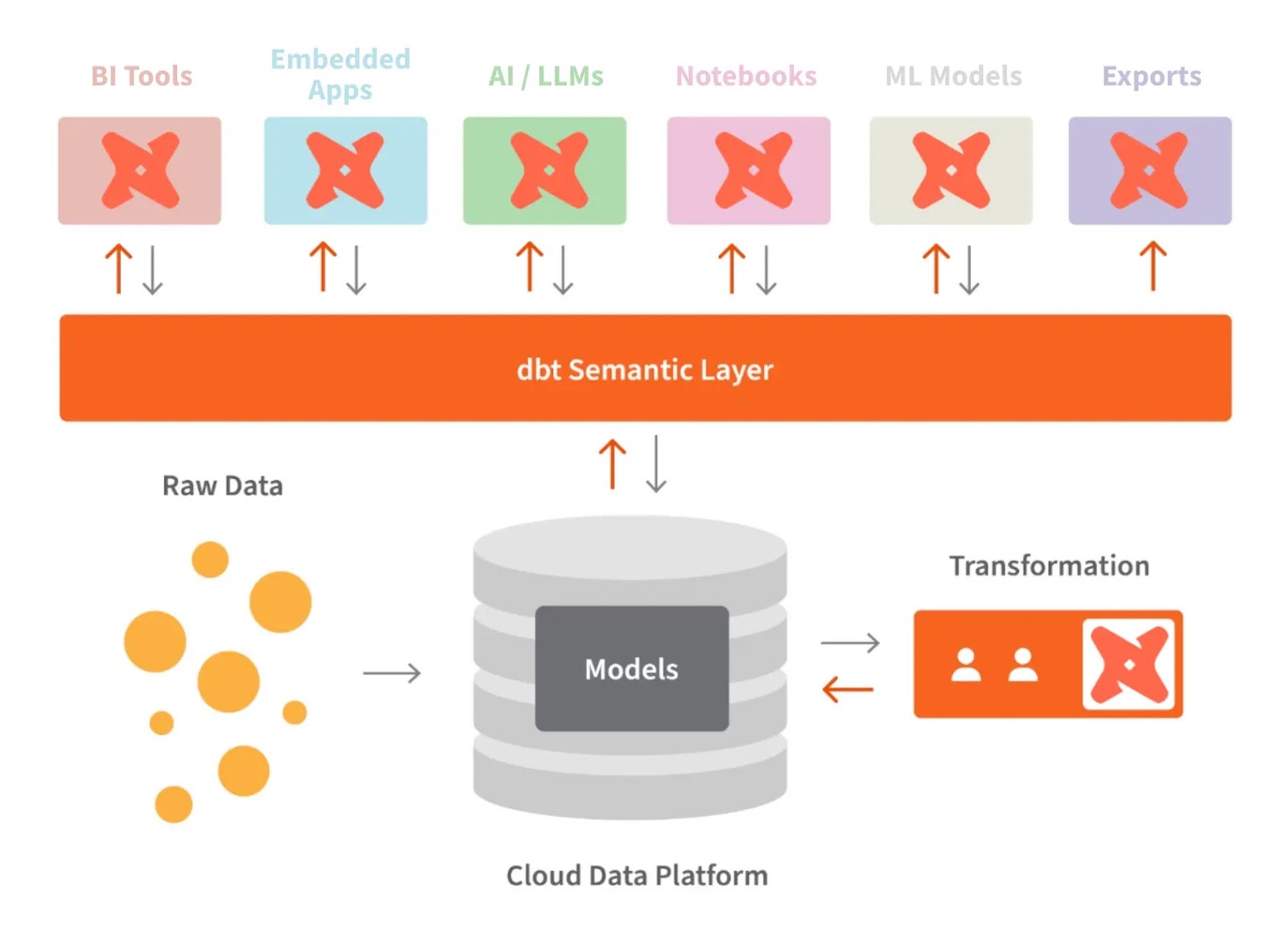

Wat is de semantic layer-architectuur van dbt?

De semantic layer van dbt laat ons ruwe data vertalen naar de taal die we begrijpen. We kunnen ook metrics definiëren en ze opvragen met een command line interface (CLI).

Dit helpt om kosten te optimaliseren omdat datavoorbereiding minder tijd kost. Bovendien werkt iedereen met dezelfde datadefinities omdat metrics organisatiebreed consistent zijn.

dbt en de semantic layer. Beeldbron: dbt

Als je BigQuery gebruikt, is dbt dan een onnodige laag voor datatransformatie?

Hoewel BigQuery erg behulpzaam is en veel transformaties native aankan, kan dbt nog steeds nodig zijn. Daarom:

- dbt laat je je transformaties versiebeheren, wat niet native wordt ondersteund in BigQuery.

- dbt biedt ingebouwde testframeworks en documentatiegeneratie, wat datakwaliteit en begrip verbetert.

- dbt's

ref()-functie en macros maken SQL-code modularer en herbruikbaarder. - dbt maakt het eenvoudiger om meerdere omgevingen (dev, test, prod) in BigQuery te beheren.

- dbt biedt een samenhangende manier om afhankelijkheden tussen transformaties te beheren.

Biedt dbt databeveiliging?

dbt komt in twee versies: dbt Core en dbt Cloud, zoals we eerder zagen. dbt Core is open source en fungeert als een gratis versie. Daarom biedt het geen ingebouwde beveiligingsfeature, en zijn gebruikers verantwoordelijk voor deployment en security.

dbt Cloud is daarentegen ontworpen om volledige beveiliging te bieden. Het voldoet aan HIPAA en andere gangbare raamwerken om privacy te waarborgen. Afhankelijk van onze behoeften kiezen we dus een dbt-versie die past bij onze compliance-eisen.

Hoe kun je de prestaties van dbt-transformaties op grote datasets optimaliseren?

Het optimaliseren van dbt-transformaties voor grote datasets is cruciaal om prestaties te verbeteren en kosten te verlagen, vooral bij cloudgebaseerde datawarehouses zoals Snowflake, BigQuery of Redshift. Hier zijn enkele belangrijke technieken om dbt-prestaties te optimaliseren:

1. Gebruik incrementele modellen

Incrementele modellen laten dbt alleen nieuwe of bijgewerkte data verwerken in plaats van elke keer de volledige dataset te herverwerken. Dit kan de runtimes voor grote datasets aanzienlijk verkorten. Dit beperkt de hoeveelheid verwerkte data en versnelt transformaties.

2. Maak gebruik van partitionering en clustering (voor databases zoals Snowflake en BigQuery)

Partitionering en clustering van grote tabellen in databases zoals Snowflake of BigQuery verbeteren de queryprestaties door data efficiënt te organiseren en de hoeveelheid gescande data te verminderen.

Partitionering zorgt ervoor dat alleen relevante datadelen worden bevraagd, terwijl clustering de fysieke lay-out van de data optimaliseert voor snellere retrieval.

3. Optimaliseer materializations (table, view, incremental)

Gebruik passende materializations om prestaties te optimaliseren:

- Views zijn nuttig voor lichte transformaties, maar niet ideaal voor zware workloads.

- Tables slaan data fysiek op, wat prestaties verbetert maar meer opslag kost.

- Incrementele modellen zijn het best voor grote datasets die regelmatig updates krijgen.

4. Gebruik LIMIT tijdens ontwikkeling

Tijdens het ontwikkelen is het toevoegen van een LIMIT-clausule aan queries handig om het aantal verwerkte rijen te beperken. Dit versnelt ontwikkelingscycli en voorkomt werken met enorme datasets tijdens het testen.

5. Voer queries parallel uit

Maak gebruik van het vermogen van je datawarehouse om queries parallel uit te voeren. dbt Cloud ondersteunt bijvoorbeeld parallelisme, dat je kunt afstemmen op je infrastructuur.

6. Gebruik databasespecifieke optimalisatiefuncties

Veel cloud datawarehouses bieden prestatieoptimalisatie zoals:

- BigQuery: gebruik materialized views of gepartitioneerde tabellen.

- Snowflake: schakel auto-clustering en warehouse-scaling in voor parallelle uitvoering.

Hoe optimaliseer je dbt-runs in Snowflake?

Om dbt-runs in Snowflake te optimaliseren:

1. Gebruik table clustering:

{{ config(

cluster_by = ["date_column", "category_column"]

) }}

SELECT ...2. Benut Snowflake's multi-cluster warehouses voor parallelle modeluitvoering:

models:

my_project:

materialized: table

snowflake_warehouse: transforming_wh3. Gebruik waar passend incrementele modellen:

{{ config(materialized='incremental', unique_key='id') }}

SELECT *

FROM source_table

{% if is_incremental() %}

WHERE updated_at > (SELECT MAX(updated_at) FROM {{ this }})

{% endif %}Deze optimalisaties kunnen de prestaties en kosteneffectiviteit van dbt-runs in Snowflake verbeteren.

Gedrags- en probleemoplossende dbt-sollicitatievragen

Aan het einde van het sollicitatieproces testen interviewers meestal je probleemoplossende vaardigheden. Ze kunnen vragen stellen om te zien hoe je reageert op realistische issues.

Onthoud dit citaat over de soft skills die voor de rol nodig zijn van Deepak Goyal, CEO & Founder bij Azurelib Academy, toen hij sprak in de DataFramed-podcast:

Als Data Engineer moet je kunnen communiceren. Een data-engineer moet communiceren omdat hij of zij met veel stakeholders moet praten om te begrijpen welk soort output of resultaat ze zoeken.

Deepak Goya, CEO & Founder at Azurelib Academy

Hier zijn enkele gedrags- en probleemoplossende vragen:

Hoe zou je dbt-deployment beheren over meerdere omgevingen (dev, staging, productie)?

Zo kun je dbt-deployment over omgevingen beheren:

1. Omgevingsspecifieke configuraties

dbt laat je verschillende configuraties definiëren voor elke omgeving (dev, staging en productie) in het bestand dbt_project.yml. Je kunt verschillende instellingen opgeven voor zaken als schema, database en datawarehouse-configuraties.

Voorbeeld in dbt_project.yml:

models:

my_project:

dev:

schema: dev_schema

staging:

schema: staging_schema

prod:

schema: prod_schemaIn dit voorbeeld selecteert dbt automatisch het juiste schema op basis van de targetomgeving (dev, staging of prod) wanneer het project draait.

2. De variabele target gebruiken

De variabele target in dbt wordt gebruikt om te definiëren in welke omgeving je werkt (dev, staging, productie). Je kunt deze variabele in je modellen of macros gebruiken om gedrag aan te passen op basis van de omgeving.

Voorbeeld in een model:

{% if target.name == 'prod' %}

SELECT * FROM production_table

{% else %}

SELECT * FROM {{ ref('staging_table') }}

{% endif %}Deze logica zorgt ervoor dat verschillende tabellen of schema's worden gebruikt afhankelijk van de omgeving.

3. Branching en versiebeheer

Elke omgeving heeft idealiter een eigen branch in versiebeheer (bijv. Git). Developers werken op de dev-branch, testers en analisten gebruiken staging, en alleen goedgekeurde wijzigingen worden samengevoegd in de prod-branch.

4. Continuous Integration (CI) & Continuous Deployment (CD)

In productie is het belangrijk om een geautomatiseerde deploymentpijplijn te hebben die tests en validaties draait voordat modellen worden uitgerold. In dbt Cloud kun je jobs inplannen om specifieke taken uit te voeren per omgeving. Voor dbt Core kan dit via CI/CD-tools zoals GitHub Actions of Jenkins.

Hoe ga je om met versiebeheer in dbt, zeker als je met meerdere teamleden werkt?

Versiebeheer is essentieel bij het werken aan dbt-projecten, vooral in een teamomgeving waar meerdere mensen bijdragen aan dezelfde codebase. Zo ga ik om met versiebeheer in dbt:

1. Gebruik Git voor versiebeheer

We gebruiken Git als de primaire tool voor versiebeheer in onze dbt-projecten. Elk teamlid werkt op een eigen branch voor wijzigingen of features die ze implementeren. Dit maakt geïsoleerde ontwikkeling mogelijk en voorkomt conflicten tussen teamleden die aan verschillende taken werken.

Voorbeeld: ik maak een nieuwe feature-branch zoals feature/customer_order_transformation wanneer ik aan een nieuw dbt-model werk.

2. Branching-strategie

We volgen een Git-branching-strategie waarbij:

- De

dev-branch wordt gebruikt voor lopende ontwikkeling en testen. - De

staging-branch wordt gebruikt om wijzigingen voor te bereiden op productie. - De

main- ofprodbranch is gereserveerd voor de productieomgeving.

Teamleden pushen hun wijzigingen naar de dev-branch en openen pull requests (PR's) voor code reviews. Zodra de wijzigingen zijn beoordeeld en goedgekeurd, worden ze samengevoegd in staging voor verdere tests en daarna doorgezet naar production.

3. Continuous integration (CI)

We hebben een CI-pijplijn geïntegreerd (bijv. GitHub Actions, CircleCI) die automatisch dbt-tests draait bij elke pull request. Zo zorgen we dat nieuwe code slaagt voor de vereiste tests voordat het wordt samengevoegd in de hoofdbranch.

Het CI-proces draait dbt run om modellen te bouwen en dbt test om de data te valideren en te controleren op fouten of inconsistenties.

4. Mergeconflicten oplossen

Wanneer meerdere teamleden wijzigingen aanbrengen in hetzelfde model of bestand, kunnen mergeconflicten optreden. Om dit te behandelen, bekijk ik eerst de conflictmarkeringen in de code en besluit welke wijzigingen ik behoud:

- Als beide wijzigingen geldig zijn, combineer ik ze tot een nieuwe versie.

- Als slechts één set wijzigingen correct is, behoud ik die en verwerp ik de andere.

Na het oplossen van het conflict draai ik lokaal tests om te zorgen dat de oplossing geen nieuwe fouten heeft geïntroduceerd. Zodra dat bevestigd is, push ik de opgeloste wijzigingen terug naar de branch.

5. Documentatie en samenwerking

We zorgen ervoor dat elke merge of pull request goede documentatie bevat van de aangebrachte wijzigingen. We werken de automatisch gegenereerde dbt-documentatie bij zodat iedereen in het team een duidelijk beeld heeft van de nieuwe of bijgewerkte modellen.

Hoe zou je dbt implementeren in een bestaande datapijplijn?

Zo zou ik dbt implementeren in een bestaande pijplijn:

- Evalueer de huidige pijplijn: Identificeer inefficiënties en onderdelen waar dbt transformatieprocessen kan verbeteren.

- Stel dbt in: Installeer dbt, maak een nieuw project en configureer verbindingen met het datawarehouse.

- Converteer transformaties: Migreer bestaande SQL- of transformatielogica naar dbt-modellen, met aandacht voor modulariteit en duidelijkheid.

- Voeg tests en documentatie toe: Implementeer de ingebouwde tests en documentatie van dbt om datakwaliteit en transparantie te waarborgen.

- Integreer met orchestratie: Plan dbt-runs met bestaande tools zoals Airflow of Prefect.

- Begin klein: Implementeer dbt op een klein deel van de pijplijn om wijzigingen te valideren voordat je opschaalt.

- Monitor en optimaliseer: Monitor continu de prestaties en optimaliseer modellen waar nodig.

Stel dat een dbt-model faalt door de fout "relation does not exist". Hoe debug je zo'n fout?

Wanneer je de fout "relation does not exist" in dbt tegenkomt, betekent dit meestal dat het model probeert te verwijzen naar een tabel of model dat niet is aangemaakt of verkeerd is gespeld. Zo zou ik debuggen:

- Controleer op typfouten: Zorg dat de tabel- of modelnaam correct is gespeld in de functie

ref()en verifieer dat naar het juiste model of de juiste tabel wordt verwezen.

SELECT * FROM {{ ref('orders') }} -- Zorg dat 'orders' de juiste modelnaam is- Verifieer modelafhankelijkheden: Als je model afhankelijk is van andere modellen, controleer dan de dbt DAG (Directed Acyclic Graph) om te zorgen dat de upstream-modellen succesvol zijn gebouwd vóór het falende model draait.

- Draai dbt in debug-modus: Gebruik

dbt debugen bekijk de logs voor gedetailleerde informatie over wat dbt probeerde te doen en waarom het faalde. - Controleer permissies op het dataplatform: Zorg dat dbt de juiste rechten heeft om toegang te krijgen tot de genoemde tabel of het genoemde model in het datawarehouse.

- Draai individuele modellen: Probeer de afhankelijke modellen afzonderlijk te draaien (bijv.

dbt run --models orders) om te verifiëren dat ze bestaan en correct zijn gebouwd voordat het falende model draait.

Tips ter voorbereiding op een dbt-interview

dbt is een nieuw framework dat geleidelijk verbetert. Het kan overweldigend zijn om nieuwe updates bij te houden terwijl je de oude stof nog leert. Neem daarom een gebalanceerde aanpak en begin met de kernfuncties. Zodra je die beheerst, verken je de aanvullingen om te begrijpen wat er is veranderd.

Ik weet dat interviews zenuwslopend kunnen zijn, zeker voor een gespecialiseerde tool als dbt. Maar geen zorgen — ik heb een aantal tips samengesteld om je te helpen voorbereiden en met vertrouwen het gesprek in te gaan:

Beheers dbt-functies

Ik kan het niet genoeg benadrukken — raak vertrouwd met de basisconcepten van dbt, waaronder modellen, tests, documentatie en hoe die samenhangen. Een stevige basis in deze onderwerpen helpt je in technische gesprekken.

DataCamp heeft de perfecte cursus: Introduction to dbt

DataCamp biedt ook enkele beginnersvriendelijke cursussen die andere data-engineeringonderwerpen diepgaand behandelen:

- Voor basiskennis data-engineering: Understanding Data Engineering

- Voor databaseontwerp: Database Design

- Voor basiskennis datawarehousing: Data Warehousing Concepts

- Voor basiskennis Snowflake: Introduction to Snowflake

- Voor data-architectuur: Understanding Modern Data Architecture

- Om ETL en ELT in Python te leren: ETL and ELT in Python

Doe praktijkervaring op met dbt

Lezen is goed, doen is beter. Dit is een van de effectiefste manieren om dbt-skills te beheersen. Je vindt online een enorme lijst met ruwe datasets om transformaties op te doen en tests te draaien. Zet je eigen dbt-project op en experimenteer met verschillende features. Je voelt je veel zekerder over dbt als je er daadwerkelijk mee gewerkt hebt.

Bereid realistische voorbeelden voor

Interviewers horen graag over praktische toepassingen. Kun je een probleem bedenken dat je met dbt hebt opgelost of hoe je het in een hypothetisch scenario zou gebruiken? Zorg dat je een paar van zulke voorbeelden paraat hebt. Om voorbeelden te verzamelen, kun je case studies op de officiële dbt-site bestuderen of ideeën halen uit public dbt projects op Git.

Conclusie

We hebben een breed spectrum aan dbt-sollicitatievragen van basis tot gevorderd behandeld die je helpen in je zoektocht naar een baan. Door te begrijpen hoe je dbt integreert met cloud datawarehouses, ben je uitgerust met geavanceerde datatransformatievaardigheden, de kern van elk dataintegratieproces.

Het leren van dbt en SQL gaat echter hand in hand. Ben je nieuw met SQL, bekijk dan DataCamp's SQL-cursussen.

FAQs

Hoe lang duurt het om dbt te leren?

Het kan enkele maanden duren om dbt volledig te beheersen. Maar als je er dagelijks een paar uur aan wijdt, kun je het snel leren.

Hoe kan ik dbt zelf leren?

Je kunt gebruikmaken van online middelen zoals DataCamp-cursussen, YouTube-tutorials en blogposts. Probeer daarnaast eigen projecten te bouwen door bestaande projecten te herschrijven. Dit versterkt je hands-on vaardigheden.

Elimineert dbt de rol van data-engineers?

Nee, dbt elimineert de rol van data-engineers niet. Het ondersteunt hen juist in hun werk. Ze kunnen dit framework gebruiken om taken zoals transformaties en tests te automatiseren.

Ik ben een contentstrateeg die graag complexe onderwerpen eenvoudig maakt. Ik heb bedrijven als Splunk, Hackernoon en Tiiny Host geholpen om boeiende en informatieve content te maken voor hun doelgroep.