Programma

dbt (data build tool) è diventato un framework di sviluppo ampiamente utilizzato nei moderni flussi di lavoro di data engineering e analytics. Di solito gli analisti dei dati si affidano ai data engineer per scrivere trasformazioni in SQL. Ma con dbt possono scrivere trasformazioni e avere un maggiore controllo sui dati. Permette anche l'integrazione con popolari sistemi di controllo versione come Git, migliorando la collaborazione del team.

Se ti stai preparando per un ruolo in un data warehouse, come data engineer, data analyst o data scientist, dovresti conoscere bene le domande su dbt, sia di base che avanzate!

In questo articolo ho raccolto le domande di colloquio più comuni per aiutarti a costruire i concetti di base e le capacità avanzate di problem-solving.

Che cos'è dbt?

dbt è un framework open-source per la trasformazione dei dati che ti consente di trasformare i dati, testarli per verificarne l'accuratezza e tracciare le modifiche all'interno di un'unica piattaforma. A differenza di altri strumenti ETL (extract, transform, load), dbt si occupa solo della trasformazione (la T).

Altri strumenti ETL estraggono i dati da varie fonti, li trasformano fuori dal warehouse e poi li caricano di nuovo. Questo spesso richiede conoscenze specifiche di programmazione e strumenti aggiuntivi. Ma dbt semplifica il processo: consente di effettuare le trasformazioni direttamente nel warehouse usando solo SQL.

Più di 40.000 grandi aziende usano dbt per semplificare i dati — per questo i recruiter lo indicano come una delle competenze più importanti per i ruoli legati ai dati. Quindi, se lo padroneggi anche come principiante, potrebbe aprirti molte opportunità di carriera!

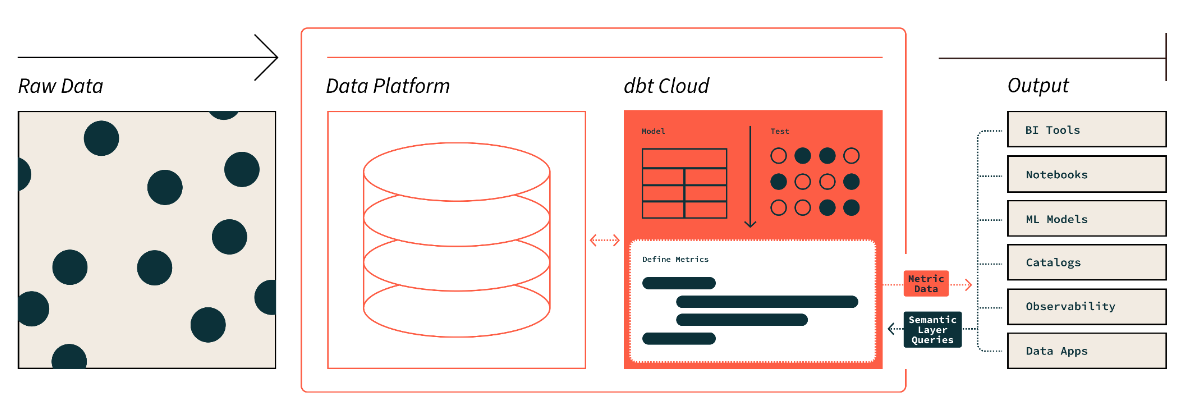

Il semantic layer di dbt. Fonte immagine: dbt

Domande di base su dbt per i colloqui

All'inizio del processo di colloquio ti verranno testate le conoscenze di base. A tal fine, potrebbero farti alcune domande fondamentali come queste:

Quali sono gli usi più comuni di dbt?

dbt mette il team dati sulla stessa linea, dove può trasformare, documentare e testare i dati. Aiuta a garantire che i dati siano affidabili e facili da comprendere. Gli usi più comuni di dbt includono:

- Trasformazione dei dati: è il cuore del lavoro di analytics. dbt gestisce tutto, dalla scrittura delle query SQL alla manutenzione delle pipeline tecniche, riducendo il lavoro per analisti ed engineer.

- Testing: è essenziale validare il codice prima del deploy. Con dbt puoi eseguire più test per assicurare accuratezza e affidabilità dei dati.

- Documentazione: permette agli altri membri del team di comprendere meglio i dataset. Possiamo aggiungere la descrizione del nostro codice, delle tabelle, del DAG (Directed Acyclic Graph) e dei test eseguiti.

- Migrazione agevole: dbt facilita lo spostamento dei modelli di dati tra piattaforme. Una volta costruito il modello, possiamo migrarlo con minimi aggiustamenti di sintassi.

dbt è un linguaggio di programmazione?

No, dbt non è un linguaggio di programmazione. È uno strumento che aiuta nei lavori di trasformazione dei dati nel warehouse. Se sai scrivere SQL, puoi lavorare facilmente con dbt. Ha anche iniziato a supportare Python per attività specifiche. Ma alla base gestisce ed esegue trasformazioni basate su SQL.

Puoi spiegare come si confronta dbt con Spark?

dbt e Spark hanno scopi diversi e mirano a flussi di lavoro differenti. Ecco un confronto del loro ruolo nell'infrastruttura dati:

|

Caratteristica |

dbt |

Spark |

|

Ruolo |

Trasformazioni e modellazione dei dati basate su SQL |

Elaborazione distribuita dei dati e analytics |

|

Linguaggio principale |

SQL al primo posto, con supporto limitato a Python |

Supporta SQL, Python, Scala, Java, R |

|

Data governance |

Documentazione e supporto alla lineage |

Fornisce controllo accessi, auditing e data lineage |

|

Utenti target |

Utenti SQL, analisti e team senza competenze ingegneristiche |

Data engineer, data scientist, sviluppatori |

|

Complessità delle trasformazioni |

Si concentra solo su trasformazioni e modellazione in SQL |

Può gestire trasformazioni complesse anche in altri linguaggi |

|

Testing e validazione |

Ha funzionalità di testing integrate |

Richiede strategie di test personalizzate (unit e integration) |

Quali sono le sfide con dbt?

Sebbene dbt porti molto valore ai team dati, può presentare anche alcune sfide, soprattutto quando aumentano scala e complessità. Le più comuni sono:

- Curva di apprendimento ripida: i nuovi utenti possono avere difficoltà con concetti come data modeling, templating Jinja e strutturazione del progetto.

- Qualità dei dati e test: garantire una copertura di test adeguata e mantenerli in progetti grandi può essere complesso.

- Problemi di scalabilità: possono verificarsi colli di bottiglia delle prestazioni con dataset di grandi dimensioni o trasformazioni complesse.

- Gestione delle dipendenze: man mano che i progetti crescono, gestire le dipendenze e fare troubleshooting del DAG può essere impegnativo.

- Orchestrazione: integrare dbt in flussi di lavoro più ampi può essere complicato, soprattutto con schedulazioni personalizzate.

- Documentazione: mantenere aggiornata la documentazione dei modelli e i test può richiedere tempo.

- Limitazioni specifiche del database: diverse piattaforme dati possono avere compatibilità e funzionalità variabili.

- Transizione da strumenti legacy: adattare i flussi di lavoro da strumenti ETL legacy può essere difficile.

- Logiche di business complesse: gestire logiche avanzate in dbt può richiedere macro, aggiungendo complessità.

Saper aggirare le potenziali sfide sopra è qualcosa che i datori di lavoro cercano, quindi non sottovalutare l'importanza di questa domanda.

Qual è la differenza tra dbt Core e dbt Cloud?

Esistono due versioni principali di dbt:

dbt Core è la versione gratuita e open-source di dbt che permette agli utenti di scrivere, eseguire e gestire trasformazioni basate su SQL in locale. Fornisce una command-line interface (CLI) per eseguire progetti dbt, testare i modelli e costruire pipeline di dati. Essendo open-source, dbt Core richiede agli utenti di gestire autonomamente deployment, orchestrazione e setup dell'infrastruttura, di solito integrandosi con strumenti come Airflow o Kubernetes per l'automazione.

dbt Cloud, invece, è un servizio gestito fornito dai creatori di dbt (Fishtown Analytics). Offre tutte le funzionalità di dbt Core, insieme a caratteristiche aggiuntive come un'interfaccia web, schedulazione integrata, gestione dei job e strumenti di collaborazione. dbt Cloud include inoltre funzionalità CI/CD (continuous integration and deployment) integrate, accesso API e conformità di sicurezza avanzata come SOC 2 e HIPAA per le organizzazioni con esigenze di sicurezza più rigorose.

Domande intermedie su dbt per i colloqui

Ora che abbiamo coperto le domande di base su dbt, ecco alcune domande di livello intermedio. Si concentrano su aspetti e concetti tecnici specifici.

Cosa sono le sources in dbt?

In dbt, le sources sono le tabelle di dati grezzi. Non scriviamo direttamente query SQL su quelle tabelle grezze — specifichiamo lo schema e il nome della tabella e le definiamo come sorgenti. Questo rende più semplice fare riferimento agli oggetti dati nelle tabelle.

Immagina di avere una tabella di dati grezzi nel tuo database chiamata orders nello schema sales. Invece di interrogare direttamente questa tabella, la definiresti come source in dbt così:

Definisci la sorgente nel tuo file sources.yml:

version: 2

sources:

- name: sales

tables:

- name: ordersUsa la source nei tuoi modelli dbt:

Una volta definita, puoi fare riferimento alla tabella grezza orders nelle tue trasformazioni così:

SELECT *

FROM {{ source('sales', 'orders') }}Questo approccio astrae la definizione della tabella grezza, facilitando la gestione e garantendo che, se la struttura sottostante cambia, tu possa aggiornarla in un solo punto (la definizione della source) invece che in ogni query.

Vantaggi dell'uso delle sources in dbt:

- Organizzazione: le sources organizzano i dati grezzi e ne semplificano la gestione all'interno di un progetto.

- Astrazione: astrai i dettagli dello schema, riducendo gli errori e aumentando la flessibilità.

- Documentazione: definire le sources aiuta a creare una migliore documentazione per gli input di dati grezzi.

Che cos'è un modello dbt?

Un modello dbt è essenzialmente un file SQL o Python che definisce la logica di trasformazione dei dati grezzi. In dbt, i modelli sono il componente centrale in cui scrivi le trasformazioni, che si tratti di aggregazioni, join o qualsiasi tipo di manipolazione dei dati.

- Modelli SQL in dbt usano istruzioni

SELECTper definire le trasformazioni e sono salvati come file .sql. - Modelli Python, introdotti con il supporto a Python di dbt, sono salvati come file

.pye ti permettono di usare librerie Python come pandas per manipolare i dati.

Esempio di modello SQL:

Un modello SQL trasforma i dati grezzi usando query SQL. Ad esempio, per creare un riepilogo degli ordini dalla tabella orders:

--orders_summary.sql

WITH orders_cte AS (

SELECT

customer_id,

COUNT(order_id) AS total_orders,

SUM(order_amount) AS total_revenue

FROM {{ ref('orders') }}

GROUP BY customer_id

)

SELECT *

FROM orders_cteIn questo esempio:

- Il modello

orders_summary.sqlcrea un riepilogo del numero totale di ordini e del fatturato per ciascun cliente usando SQL. - Il modello fa riferimento alla tabella

orders(già definita come modello o source di dbt).

Esempio di modello Python:

Un modello Python manipola i dati grezzi usando codice Python. Può essere particolarmente utile per logiche complesse che in SQL sarebbero macchinose.

# orders_summary.py

import pandas as pd

def model(dbt, session):

# Load the source data

orders = dbt.ref("orders").to_pandas()

# Perform transformations using pandas

orders_summary = orders.groupby('customer_id').agg(

total_orders=('order_id', 'count'),

total_revenue=('order_amount', 'sum')

).reset_index()

return orders_summaryIn questo esempio:

- Il modello Python usa pandas per trasformare i dati raggruppando gli ordini per cliente e calcolando numero totale di ordini e fatturato.

- Il risultato viene poi restituito come DataFrame, che dbt può integrare nella sua pipeline.

Come creeresti un modello dbt?

Ecco come creare un modello dbt:

- Crea una directory sotto la cartella

modelsnel progetto dbt. - Aggiungi un nuovo file di testo con estensione

.sqlall'interno della directory (o.pyse è un modello Python). - Ora scrivi una query SQL o del codice per trasformare i dati grezzi.

- Esegui il comando

dbt runper applicare la trasformazione e creare il modello.

Come gestisce dbt le dipendenze tra i modelli?

dbt gestisce le dipendenze tra modelli usando la funzione ref(), che crea una catena di dipendenze chiara tra i modelli.

Quando definisci una trasformazione in dbt, invece di fare riferimento direttamente alle tabelle nel tuo warehouse, fai riferimento ad altri modelli dbt usando la funzione ref(). Questo assicura che dbt costruisca i modelli nell'ordine corretto, identificando quali modelli dipendono da altri.

Per esempio, se hai un modello orders_summary che dipende dal modello orders, lo definiresti così:

WITH orders AS (

SELECT * FROM {{ ref('orders') }}

)

SELECT

customer_id,

COUNT(order_id) AS total_orders,

SUM(order_amount) AS total_revenue

FROM orders

GROUP BY customer_idIn questo esempio, la funzione {{ ref('orders') }} assicura che il orders modello venga costruito prima di orders_summary, poiché orders_summary dipende dai dati nel modello orders.

Cosa sono le macro in dbt e come si eseguono?

Le macro in dbt sono blocchi riutilizzabili di codice SQL scritti utilizzando il motore di template Jinja. Ti permettono di automatizzare attività ripetitive, astrarre logiche complesse e riutilizzare codice SQL in più modelli, rendendo il progetto dbt più efficiente e manutenibile.

Le macro possono essere definite in file .sql all'interno della directory macros del progetto dbt.

Le macro sono particolarmente utili quando devi eseguire trasformazioni simili in più modelli o quando serve logica specifica per l'ambiente, ad esempio usare schemi diversi o modificare i formati di data in base agli ambienti di deploy (sviluppo, staging o produzione).

Esempio di creazione di macro:

- Macro per la formattazione delle date: Puoi creare una macro per standardizzare la formattazione delle date tra i modelli. Invece di ripetere la logica del formato, puoi creare una macro come questa:

-- macros/date_format.sql

{% macro format_date(column) %}

FORMAT_TIMESTAMP('%Y-%m-%d', {{ column }})

{% endmacro %}Uso in un modello:

SELECT

customer_id,

{{ format_date('order_date') }} AS formatted_order_date

FROM {{ ref('orders') }}In questo esempio, la macro format_date viene usata per standardizzare il formato della colonna order_date in qualsiasi modello in cui viene richiamata.

- Macro per il nome dello schema personalizzato: Questa macro cambia dinamicamente i nomi degli schemi a seconda dell'ambiente (ad esempio sviluppo o produzione). Aiuta a gestire gli ambienti senza modificare manualmente i nomi degli schemi.

-- macros/custom_schema.sql

{% macro custom_schema_name() %}

{% if target.name == 'prod' %}

'production_schema'

{% else %}

'dev_schema'

{% endif %}

{% endmacro %}Uso in un modello:

SELECT *

FROM {{ custom_schema_name() }}.ordersQui la macro verifica se l'ambiente (target.name) è "prod" e restituisce il nome dello schema corretto in base a questo.

Come eseguire le macro:

Le macro non vengono eseguite direttamente come i modelli SQL. Invece, vengono richiamate nei tuoi modelli o in altre macro ed eseguite quando gira il progetto dbt. Ad esempio, se usi una macro all'interno di un modello, la macro verrà eseguita quando lanci il comando dbt run.

- Chiamare una macro dentro un modello: quando includi una macro in un modello SQL, viene eseguita durante il run del modello.

- Eseguire manualmente le macro: puoi anche eseguire manualmente alcune macro richiamandole con il comando

dbt run-operation. Si usa tipicamente per attività una tantum, come fare seeding dei dati o operazioni di manutenzione.

Quali sono i due tipi di test in dbt?

I test singolari e i test generici sono i due tipi di test in dbt:

- Test singolari si concentrano su condizioni specifiche in un modello dbt. Se la condizione del test fallisce, restituirà le righe.

Esempio: Diciamo che vuoi assicurarti che nessun ordine abbia un order_amount negativo. Puoi scrivere un test singolare nella directory tests come segue:

-- tests/no_negative_order_amount.sql

SELECT *

FROM {{ ref('orders') }}

WHERE order_amount < 0Se questo test fallisce, dbt restituirà tutte le righe della tabella orders in cui order_amount è negativo.

- Test generici sono test predefiniti che accettano argomenti. Si dividono ulteriormente nei seguenti tipi:

|

Test generici |

Definizione |

|

Unique |

Verifica valori univoci nella colonna. |

|

Not null |

Controlla l'assenza di campi vuoti. |

|

Available values |

Verifica che i valori di colonna corrispondano a un elenco di valori attesi per mantenere la standardizzazione. |

|

Relationships |

Controlla l'integrità referenziale tra tabelle per eliminare dati incoerenti. |

Esempio: puoi applicare facilmente un test generico per assicurarti che customer_id nella tabella customers sia univoco e non nullo definendolo nel tuo file schema.yml:

version: 2

models:

- name: customers

columns:

- name: customer_id

tests:

- unique

- not_nullIn questo esempio:

- Il test unique verifica che ogni

customer_idnella tabellacustomerssia univoco. - Il test not_null controlla che nessun valore di

customer_idsia mancante o nullo.

Domande avanzate su dbt per i colloqui

Man mano che avanzi, potresti imbatterti in scenari più complessi e concetti avanzati. Ecco quindi alcune domande impegnative per aiutarti a valutare la tua esperienza e prepararti per posizioni senior di data engineering.

Come puoi creare modelli incrementali in dbt e quando li useresti?

I modelli incrementali in dbt vengono usati per elaborare solo i dati nuovi o modificati invece di rielaborare ogni volta l'intero dataset. Questo è particolarmente utile quando si lavora con dataset di grandi dimensioni, dove ricostruire da zero l'intero modello sarebbe dispendioso in termini di tempo e risorse.

Un modello incrementale permette a dbt di aggiungere solo nuovi dati (o aggiornare i dati modificati) in base a una condizione, tipicamente una colonna timestamp (come updated_at).

Come creare un modello incrementale:

1. Definisci il modello come incrementale specificandolo nella config del modello:

{{ config(

materialized='incremental',

unique_key='id' -- o un'altra colonna univoca

) }}2. Usa la funzione is_incremental() per filtrare le righe nuove o modificate:

SELECT *

FROM source_table

{% if is_incremental() %}

WHERE updated_at > (SELECT MAX(updated_at) FROM {{ this }})

{% endif %}3. Quando dbt esegue questo modello per la prima volta, elaborerà tutti i dati. Nelle esecuzioni successive, elaborerà solo le righe in cui updated_at è maggiore del valore più recente già presente nel modello.

Quando usare i modelli incrementali:

- Dataset di grandi dimensioni: quando hai una tabella con milioni o miliardi di righe, ricostruire l'intera tabella a ogni run sarebbe inefficiente.

- Aggiornamenti frequenti: se il tuo data warehouse riceve aggiornamenti frequenti o nuovi dati, ma non è necessario rielaborare l'intero dataset, i modelli incrementali possono ridurre significativamente i tempi di elaborazione.

- Dati in streaming: nei casi in cui i dati vengono trasmessi o aggiornati regolarmente, i modelli incrementali aiutano a mantenere aggiornate le trasformazioni senza rieseguire tutto.

Come usi Jinja per migliorare il tuo codice SQL?

Jinja rende il nostro SQL più flessibile. Con Jinja possiamo definire template riutilizzabili per pattern SQL comuni. E poiché i requisiti cambiano, possiamo usare le istruzioni if di Jinja per adattare le query SQL in base alle condizioni. Così facendo, di solito si migliora il codice SQL scomponendo la logica complessa, rendendola più facile da capire.

Per esempio, se vuoi convertire il formato data da "YYYY-MM-DD" a "MM/DD/YYYY", ecco una macro dbt di esempio per questo, che abbiamo visto in una domanda precedente:

{% macro change_date_format(column_name) %}

to_char({{ column_name }}::date, 'MM/DD/YYYY')

{% endmacro %}In questo esempio di codice, {{ column_name }} è dove Jinja inserisce il nome effettivo della colonna quando usi la macro. Verrà sostituito con il nome reale in fase di esecuzione. Come visto in esempi precedenti, Jinja usa {{ }} per indicare dove avverrà la sostituzione.

Come creeresti una materializzazione personalizzata in dbt?

Ecco come creare una materializzazione personalizzata in dbt:

- Crea il file SQL per la materializzazione personalizzata.

- Quindi definisci una macro di materializzazione come

materialization_name:

{% materialization materialization_name, default -%}- Usa le macro predefinite di dbt

adapter.get_relationper impostare la tabella di destinazione. È qui che verranno caricati i dati. - Ora definisci ed esegui i comandi SQL per creare e caricare i dati nelle tabelle:

{% set sql %}

SELECT * FROM {{ ref('your_source_table') }}

WHERE your_conditions = true

{% endset %}

{{ adapter.execute(sql) }}- Alla fine, restituisci la relazione di destinazione per aggiornare la cache di dbt e ottimizzare l'esecuzione delle query.

{{ return(target_relation) }}

{% endmaterialization %}Come puoi fare il debug dei tuoi modelli dbt? Parlaci di due modi.

Ecco due modi per fare debug dei nostri modelli dbt:

1. Accedere ai file SQL compilati nella cartella target per individuare e tracciare gli errori.

Quando esegui un progetto dbt, dbt compila i modelli (scritti usando i template Jinja) in query SQL pure e le salva nella directory target. Questo SQL compilato è esattamente ciò che dbt esegue sulla tua piattaforma dati, quindi rivedere questi file può aiutarti a identificare dove si verificano i problemi:

- Esegui i tuoi modelli dbt (ad es.,

dbt runodbt test). - Vai alla cartella

target/compiled/nella directory del tuo progetto dbt. - Apri il file SQL compilato del modello che stai debuggando. Il file conterrà l'SQL puro eseguito da dbt, incluse tutte le trasformazioni derivanti da macro Jinja e riferimenti.

- Copia la query SQL compilata ed eseguila direttamente nell'editor SQL della tua piattaforma dati (ad es., Postgres, BigQuery) per ottenere messaggi di errore dettagliati o vedere il comportamento reale della query.

2. Usa l'estensione dbt Power User per VS Code per rivedere i risultati delle query direttamente.

L'estensione dbt Power User per Visual Studio Code (VS Code) è uno strumento utile per il debug dei modelli dbt. Questa estensione ti permette di rivedere e testare le query direttamente all'interno dell'IDE, riducendo la necessità di passare tra dbt, terminale e database.

Come compila le query dbt?

dbt compila le query attraverso i seguenti passaggi:

- Parsing: dbt legge tutti i file SQL, le configurazioni YAML e le macro nel progetto.

- Creazione del contesto: costruisce un contesto per ciascun modello, incluse configurazioni e macro disponibili.

- Rendering Jinja: quindi elabora i file SQL come template Jinja per sostituire tag ed espressioni con i risultati valutati.

- Compilazione SQL: vengono generate query SQL pure per ciascun modello.

- Generazione degli artifact: l'SQL compilato viene salvato nella directory

target/compiled. - Preparazione all'esecuzione: per

dbt run, le query sono preparate per l'esecuzione, eventualmente con wrapping aggiuntivo.

Questo processo trasforma SQL modulare e templato in query eseguibili specifiche per il tuo data warehouse. Possiamo usare dbt compile o controllare la directory target/compiled per visualizzare e fare debug dell'SQL finale per ciascun modello.

Domande su data warehousing e integrazione basate su dbt

Il lavoro della maggior parte dei data engineer ruota attorno alla costruzione e integrazione di data warehouse con dbt. Le domande relative a questi scenari sono molto comuni ai colloqui — per questo ho raccolto le più frequenti:

Spiega tre vantaggi dell'integrazione di dbt con Airflow.

Integrare dbt con Airflow aiuta a costruire una pipeline dati snella. Ecco alcuni vantaggi:

- Processo ETL: Airflow gestisce l'estrazione e il caricamento dei dati, garantendo che dbt possa concentrarsi sul passo di trasformazione, con un flusso di lavoro complessivo più fluido.

- Automazione dei task dbt: Airflow automatizza la schedulazione e l'esecuzione dei modelli dbt, riducendo gli interventi manuali e migliorando l'efficienza delle trasformazioni.

- Esecuzione parallela dei task: Airflow consente l'esecuzione parallela dei task, permettendo l'elaborazione di grandi dataset senza compromettere le prestazioni, mantenendo pipeline rapide e affidabili.

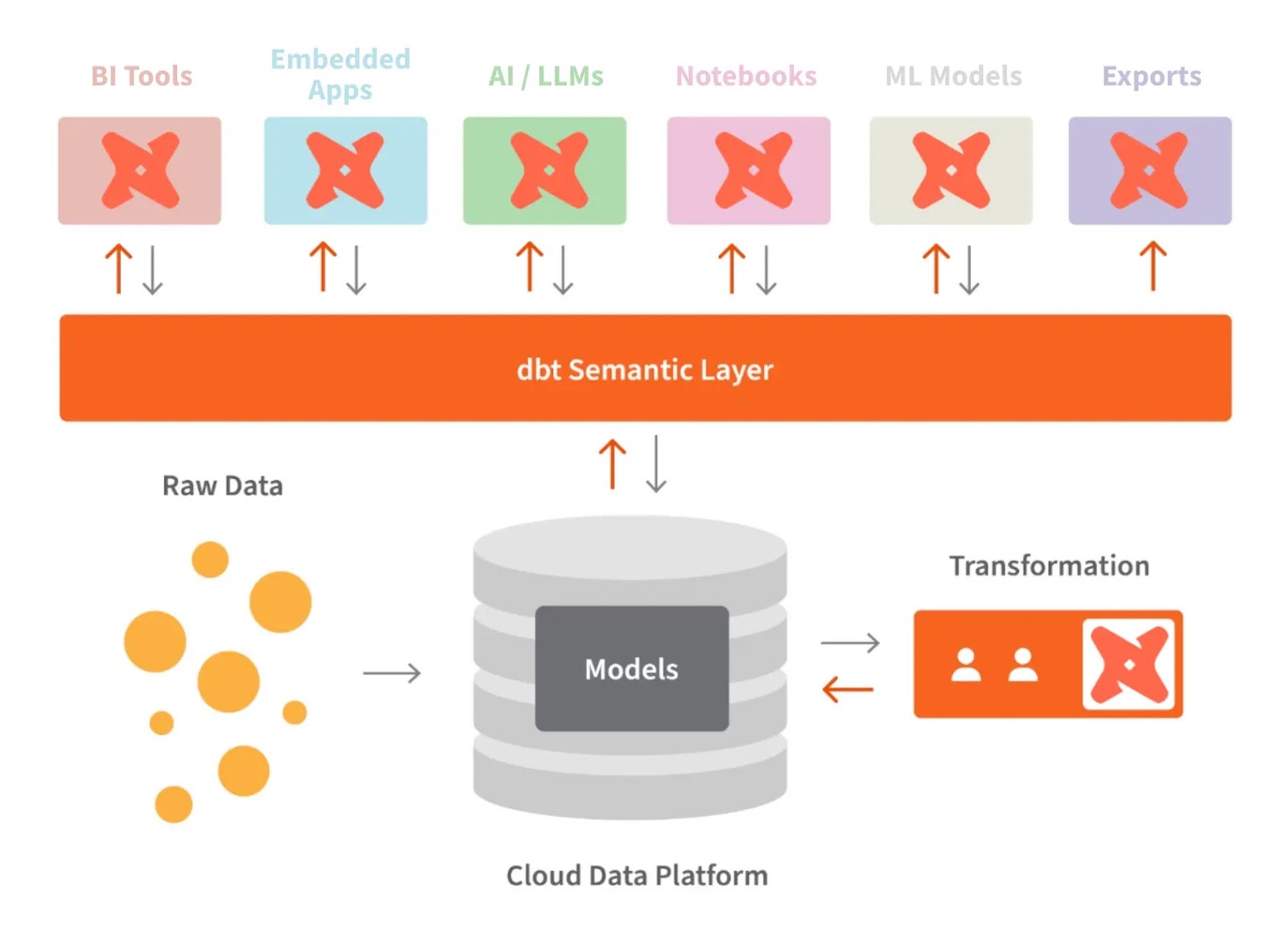

Qual è l'architettura del semantic layer di dbt?

Il semantic layer di dbt ci permette di tradurre i dati grezzi in un linguaggio comprensibile. Possiamo anche definire metriche e interrogarle tramite interfaccia a riga di comando (CLI).

Questo ci permette di ottimizzare i costi poiché la preparazione dei dati richiede meno tempo. Inoltre, tutti lavorano con le stesse definizioni dei dati, perché rende le metriche coerenti in tutta l'organizzazione.

dbt e il semantic layer. Fonte immagine: dbt

Se usi BigQuery, dbt è uno strato di trasformazione dei dati superfluo?

Sebbene BigQuery sia molto utile e possa gestire molte trasformazioni in modo nativo, dbt può essere comunque necessario. Ecco perché:

- dbt ti consente di fare version control delle trasformazioni, cosa non supportata nativamente in BigQuery.

- dbt fornisce framework di testing integrati e generazione di documentazione, migliorando qualità e comprensione dei dati.

- La funzione

ref()e le macro di dbt permettono SQL più modulare e riutilizzabile. - dbt semplifica la gestione di più ambienti (dev, test, prod) in BigQuery.

- dbt fornisce un modo unitario per gestire le dipendenze tra trasformazioni.

dbt fornisce sicurezza dei dati?

dbt è disponibile in due versioni: dbt Core e dbt Cloud, come visto in una domanda precedente. dbt Core è open source e gratuito. Per questo non offre funzionalità di sicurezza integrate, e gli utenti sono responsabili del deployment e della sicurezza.

dbt Cloud, invece, è progettato per fornire sicurezza completa. È conforme a HIPAA e ad altri framework comuni per garantire la tutela della privacy. Quindi, a seconda delle esigenze, dobbiamo scegliere la versione di dbt che si adatta ai requisiti di conformità della nostra azienda.

Come puoi ottimizzare le prestazioni delle trasformazioni dbt su dataset di grandi dimensioni?

Ottimizzare le trasformazioni dbt per grandi dataset è fondamentale per migliorare le prestazioni e ridurre i costi, soprattutto quando si lavora con data warehouse cloud come Snowflake, BigQuery o Redshift. Ecco alcune tecniche chiave per ottimizzare le prestazioni di dbt:

1. Usa modelli incrementali

I modelli incrementali permettono a dbt di elaborare solo i dati nuovi o aggiornati invece di rielaborare ogni volta l'intero dataset. Questo può ridurre notevolmente i tempi di run per dataset grandi. Questo processo limita la quantità di dati elaborati, accelerando i tempi di trasformazione.

2. Sfrutta partitioning e clustering (per database come Snowflake e BigQuery)

Partizionare e clusterizzare grandi tabelle in database come Snowflake o BigQuery aiuta a migliorare le prestazioni delle query organizzando i dati in modo efficiente e riducendo la quantità di dati scansionati durante le interrogazioni.

Il partitioning assicura che vengano interrogate solo le porzioni rilevanti di un dataset, mentre il clustering ottimizza il layout fisico dei dati per un recupero più veloce.

3. Ottimizza le materializzazioni (table, view, incremental)

Usa materializzazioni appropriate per ottimizzare le prestazioni:

- Le view sono utili per trasformazioni leggere ma non ideali per carichi pesanti.

- Le table memorizzano fisicamente i dati, migliorando le prestazioni ma occupando più storage.

- I modelli incrementali sono i migliori per grandi dataset che ricevono aggiornamenti regolari.

4. Usa LIMIT in sviluppo

Durante lo sviluppo delle trasformazioni, aggiungere una clausola LIMIT alle query è utile per limitare il numero di righe elaborate. Questo accelera i cicli di sviluppo ed evita di lavorare con dataset enormi durante i test.

5. Esegui le query in parallelo

Sfrutta la capacità del tuo data warehouse di eseguire query in parallelo. Ad esempio, dbt Cloud supporta il parallelismo, regolabile in base alla tua infrastruttura.

6. Usa funzionalità di ottimizzazione specifiche del database

Molti data warehouse cloud forniscono funzionalità di ottimizzazione delle prestazioni come:

- BigQuery: usa materialized view o tabelle partizionate.

- Snowflake: abilita auto-clustering e scaling del warehouse per esecuzione parallela.

Come ottimizzi i run di dbt in Snowflake?

Per ottimizzare i run di dbt in Snowflake:

1. Usa il clustering delle tabelle:

{{ config(

cluster_by = ["date_column", "category_column"]

) }}

SELECT ...2. Sfrutta i multi-cluster warehouse di Snowflake per l'esecuzione parallela dei modelli:

models:

my_project:

materialized: table

snowflake_warehouse: transforming_wh3. Usa modelli incrementali dove opportuno:

{{ config(materialized='incremental', unique_key='id') }}

SELECT *

FROM source_table

{% if is_incremental() %}

WHERE updated_at > (SELECT MAX(updated_at) FROM {{ this }})

{% endif %}Queste ottimizzazioni possono migliorare le prestazioni e la convenienza economica dei run di dbt in Snowflake.

Domande comportamentali e di problem-solving su dbt

Alla fine del processo di colloquio, di solito vengono testate le tue capacità di problem-solving. Potrebbero farti domande per vedere come risponderesti a problemi reali.

Ricorda questa citazione riguardo alle soft skill richieste per il ruolo di Deepak Goyal, CEO e Founder di Azurelib Academy, durante il suo intervento al podcast DataFramed:

Come Data Engineer, devi saper comunicare. Un data engineer deve comunicare perché deve parlare con molti stakeholder per capire che tipo di output o risultato stanno cercando.

Deepak Goya, CEO & Founder at Azurelib Academy

Ecco alcune domande comportamentali e di problem-solving:

Come gestiresti il deploy di dbt su più ambienti (dev, staging, produzione)?

Ecco come puoi gestire il deploy di dbt tra ambienti:

1. Configurazioni specifiche per ambiente

dbt ti permette di definire configurazioni diverse per ciascun ambiente (dev, staging e produzione) nel file dbt_project.yml. Puoi specificare impostazioni differenti per elementi come schema, database e configurazioni del data warehouse.

Esempio in dbt_project.yml:

models:

my_project:

dev:

schema: dev_schema

staging:

schema: staging_schema

prod:

schema: prod_schemaIn questo esempio, dbt seleziona automaticamente lo schema corretto in base all'ambiente target (dev, staging o prod) durante l'esecuzione del progetto.

2. Uso della variabile target

La variabile target in dbt viene usata per definire in quale ambiente stai lavorando (dev, staging, produzione). Puoi fare riferimento a questa variabile nei tuoi modelli o macro per personalizzare il comportamento in base all'ambiente.

Esempio in un modello:

{% if target.name == 'prod' %}

SELECT * FROM production_table

{% else %}

SELECT * FROM {{ ref('staging_table') }}

{% endif %}Questa logica assicura che vengano usate tabelle o schemi diversi a seconda dell'ambiente.

3. Branching e controllo versione

Ogni ambiente dovrebbe avere il suo branch nel sistema di version control (ad es., Git). Gli sviluppatori lavorano sul branch dev, tester e analisti usano staging e solo le modifiche approvate vengono fuse nel branch prod.

4. Continuous Integration (CI) & Continuous Deployment (CD)

In produzione è importante avere una pipeline di deploy automatizzata che esegua test e validazioni prima di distribuire i modelli. In dbt Cloud puoi impostare schedulazioni di job per eseguire task specifici in base all'ambiente. Con dbt Core, questo può essere ottenuto tramite strumenti CI/CD come GitHub Actions o Jenkins.

Come gestisci il version control in dbt, soprattutto lavorando con più membri del team?

Il version control è essenziale quando si lavora su progetti dbt, specialmente in team dove più persone contribuiscono allo stesso codebase. Ecco come gestisco il version control in dbt:

1. Usa Git per il version control

Usiamo Git come strumento principale per il version control nei nostri progetti dbt. Ogni membro del team lavora su un proprio branch per qualsiasi modifica o funzionalità in implementazione. Questo consente uno sviluppo isolato ed evita conflitti tra membri che lavorano su task differenti in parallelo.

Esempio: creo un nuovo branch feature come feature/customer_order_transformation quando lavoro a un nuovo modello dbt.

2. Strategia di branching

Seguiamo una strategia di branching Git in cui:

- Il branch

devè usato per sviluppo e test in corso. - Il branch

stagingè usato per preparare le modifiche alla produzione. - Il branch

mainoprodè riservato all'ambiente di produzione.

I membri del team spingono le loro modifiche sul dev e aprono pull request (PR) per il code review. Una volta che le modifiche sono state revisionate e approvate, vengono fuse su staging per ulteriori test e poi promosse in production.

3. Continuous integration (CI)

Abbiamo integrato una pipeline CI (ad es., GitHub Actions, CircleCI) che esegue automaticamente i test dbt su ogni pull request. Questo garantisce che ogni nuovo codice superi i test richiesti prima di essere fuso nel branch principale.

Il processo CI esegue dbt run per costruire i modelli e dbt test per validare i dati e controllare errori o incoerenze.

4. Risoluzione dei conflitti di merge

Quando più membri del team apportano modifiche allo stesso modello o file, possono verificarsi conflitti di merge. Per gestirli, prima esamino i marker di conflitto nel codice e decido quali modifiche mantenere:

- Se entrambe le modifiche sono valide, le combino in una nuova versione.

- Se è corretta solo una delle due, mantengo quella e scarto l'altra.

Dopo aver risolto il conflitto, eseguo i test in locale per assicurarmi che la risoluzione non abbia introdotto nuovi errori. Una volta verificato, mando le modifiche risolte di nuovo sul branch.

5. Documentazione e collaborazione

Ci assicuriamo che ogni merge o pull request includa un'adeguata documentazione delle modifiche effettuate. Aggiorniamo la documentazione generata automaticamente da dbt in modo che tutti nel team abbiano una chiara comprensione dei modelli nuovi o aggiornati.

Come implementeresti dbt in una pipeline di dati esistente?

Ecco come implementerei dbt in una pipeline esistente:

- Valutare la pipeline attuale: identificare inefficienze e aree in cui dbt può migliorare i processi di trasformazione.

- Impostare dbt: installare dbt, creare un nuovo progetto e configurare le connessioni al data warehouse.

- Convertire le trasformazioni: migrare la logica SQL o di trasformazione esistente in modelli dbt, garantendo modularità e chiarezza.

- Aggiungere test e documentazione: implementare i test e la documentazione integrati di dbt per assicurare qualità e trasparenza dei dati.

- Integrare con l'orchestrazione: schedulare i run di dbt usando strumenti esistenti come Airflow o Prefect.

- Partire in piccolo: implementare dbt su una piccola parte della pipeline per validare le modifiche prima di estendere la portata.

- Monitorare e ottimizzare: monitorare continuamente le prestazioni e ottimizzare i modelli quando necessario.

Immagina che un modello dbt fallisca per l'errore "relation does not exist". Come effettueresti il debug di un errore del genere?

Quando si incontra un errore "relation does not exist" in dbt, di solito significa che il modello sta cercando di fare riferimento a una tabella o a un modello che non è stato creato o è scritto in modo errato. Ecco come lo debuggerei:

- Controllare i typo: assicurarsi che il nome della tabella o del modello sia scritto correttamente nella funzione

ref()e verificare che venga referenziato il modello o la tabella corretta.

SELECT * FROM {{ ref('orders') }} -- Assicurati che 'orders' sia il nome corretto del modello- Verificare le dipendenze dei modelli: se il tuo modello dipende da altri modelli, controlla il DAG di dbt (Directed Acyclic Graph) per assicurarti che i modelli a monte siano stati costruiti correttamente prima dell'esecuzione del modello che fallisce.

- Eseguire dbt in modalità debug: usa

dbt debuge controlla i log per informazioni dettagliate su cosa dbt ha provato a fare e perché è fallito. - Controllare i permessi sulla piattaforma dati: assicurati che dbt abbia i permessi necessari per accedere alla tabella o al modello referenziato nel data warehouse.

- Eseguire i singoli modelli: prova a eseguire i modelli dipendenti singolarmente (ad es.,

dbt run --models orders) per verificare che esistano e siano costruiti correttamente prima del modello che fallisce.

Consigli per prepararsi a un colloquio su dbt

dbt è un framework nuovo che migliora gradualmente. Può essere travolgente stare al passo con i nuovi aggiornamenti continuando a imparare il materiale precedente. Per questo dovresti adottare un approccio bilanciato e partire dalle funzionalità core. Una volta padroneggiate, esplora le novità per capire cosa è cambiato.

So che i colloqui possono mettere ansia, soprattutto per uno strumento specializzato come dbt. Ma non preoccuparti — ho raccolto alcuni consigli per aiutarti a prepararti e sentirti sicuro:

Padroneggia le funzionalità di dbt

Non lo dirò mai abbastanza — prenditi confidenza con i concetti fondamentali di dbt, inclusi modelli, test, documentazione e come si incastrano tra loro. Una solida padronanza di queste basi ti aiuterà nelle discussioni tecniche.

DataCamp ha il corso perfetto: Introduction to dbt

DataCamp offre anche corsi per principianti che coprono in profondità altri argomenti di data engineering:

- Per le basi del data engineering: Understanding Data Engineering

- Per la progettazione di database: Database Design

- Per le basi del data warehousing: Data Warehousing Concepts

- Per le basi di Snowflake: Introduction to Snowflake

- Per l'architettura dei dati: Understanding Modern Data Architecture

- Per imparare ETL ed ELT in Python: ETL and ELT in Python

Fai esperienza pratica con dbt

Leggere è utile, ma fare è ancora meglio. È uno dei modi più efficaci per padroneggiare dbt. Puoi trovare online un'enorme lista di dataset grezzi su cui fare trasformazioni ed eseguire test. Allestisci un tuo progetto dbt e prova le diverse funzionalità. Ti sentirai molto più sicuro a parlare di dbt quando lo avrai usato davvero.

Prepara esempi reali

Agli intervistatori piace sentire applicazioni pratiche. Riesci a pensare a un problema che hai risolto con dbt o a come potresti usarlo in uno scenario ipotetico? Tieni pronti alcuni di questi esempi. Per raccoglierne, puoi anche studiare vari case study dal sito ufficiale di dbt o prendere spunto da progetti dbt pubblici su Git.

Conclusione

Abbiamo coperto un ampio spettro di domande su dbt, dalle basi agli argomenti avanzati, che ti aiuteranno nella ricerca di lavoro. Capendo come integrare dbt con i data warehouse cloud, sarai ben attrezzato con competenze avanzate di trasformazione dei dati, il cuore di qualsiasi processo di integrazione dei dati.

Tuttavia, l'apprendimento di dbt e SQL vanno di pari passo. Quindi, se sei nuovo a SQL, dai un'occhiata ai corsi SQL di DataCamp.

FAQ

Quanto tempo ci vuole per imparare dbt?

Potrebbero volerci alcuni mesi per padroneggiare completamente le competenze su dbt. Ma se dedichi qualche ora al giorno, puoi impararlo velocemente.

Come posso imparare dbt da autodidatta?

Puoi usare risorse online come i corsi di DataCamp, tutorial su YouTube e articoli di blog. Inoltre, prova a costruire i tuoi progetti riscrivendo progetti esistenti. Questo rafforzerà le tue abilità pratiche.

dbt elimina il ruolo dei data engineer?

No, dbt non elimina il ruolo dei data engineer. Al contrario, li supporta nel loro lavoro. Possono usare questo framework per automatizzare attività come trasformazioni e test.

Sono una content strategist: mi piace semplificare argomenti complessi. Ho aiutato aziende come Splunk, Hackernoon e Tiiny Host a creare contenuti coinvolgenti e informativi per il loro pubblico.