Kurs

Azure Data Factory (ADF), Microsoft’un modern kuruluşlara yönelik bulut tabanlı veri entegrasyonu hizmetidir. Kurumsal ölçekte veri taşıma ve dönüştürme görevlerini yöneten iş akışlarını tasarlamayı, yönetmeyi ve otomatikleştirmeyi sağlar.

ADF, hem teknik hem de teknik olmayan kullanıcıların kolayca veri hatları oluşturmasına olanak tanıyan kullanıcı dostu, kod yazmadan kullanım arayüzüyle öne çıkar. Geniş entegrasyon yetenekleri, şirket içi sistemler ve bulut tabanlı hizmetler de dahil olmak üzere farklı kaynaklar arasında veri akışını mümkün kılan 90’dan fazla yerel bağlayıcıyı destekler.

Bu rehberde, Azure Data Factory’ye kapsamlı bir giriş sunuyor, bileşenlerini ve özelliklerini ele alıyor ve ilk veri hattınızı oluşturmanıza yardımcı olacak uygulamalı bir eğitim sağlıyorum.

Azure Data Factory nedir?

Azure Data Factory (ADF), veri iş akışlarını düzenlemek ve otomatikleştirmek üzere tasarlanmış bulut tabanlı bir veri entegrasyonu hizmetidir.

Analiz ve karar verme için içgörülerin kolayca erişilebilir olmasını sağlayacak şekilde verileri toplamak, dönüştürmek ve teslim etmek için kullanılır.

Ölçeklenebilir ve sunucusuz mimarisi sayesinde ADF, basit veri taşımalarından karmaşık veri dönüşüm hatlarına kadar her boyuttaki iş akışını yönetebilir.

ADF, veri siloları arasındaki boşluğu kapatarak kullanıcıların şirket içi sistemler, bulut hizmetleri ve harici platformlar arasında verileri taşımasına ve dönüştürmesine olanak tanır. Büyük veri, operasyonel veritabanları veya API’lerle çalışıyor olun, Azure Data Factory verileri verimli şekilde bağlamak, işlemek ve birleştirmek için gerekli araçları sunar.

Azure Data Factory’nin Özellikleri

ADF’nin sunduğu en önemli özelliklerden bazıları şunlardır.

1. Veri entegrasyonu

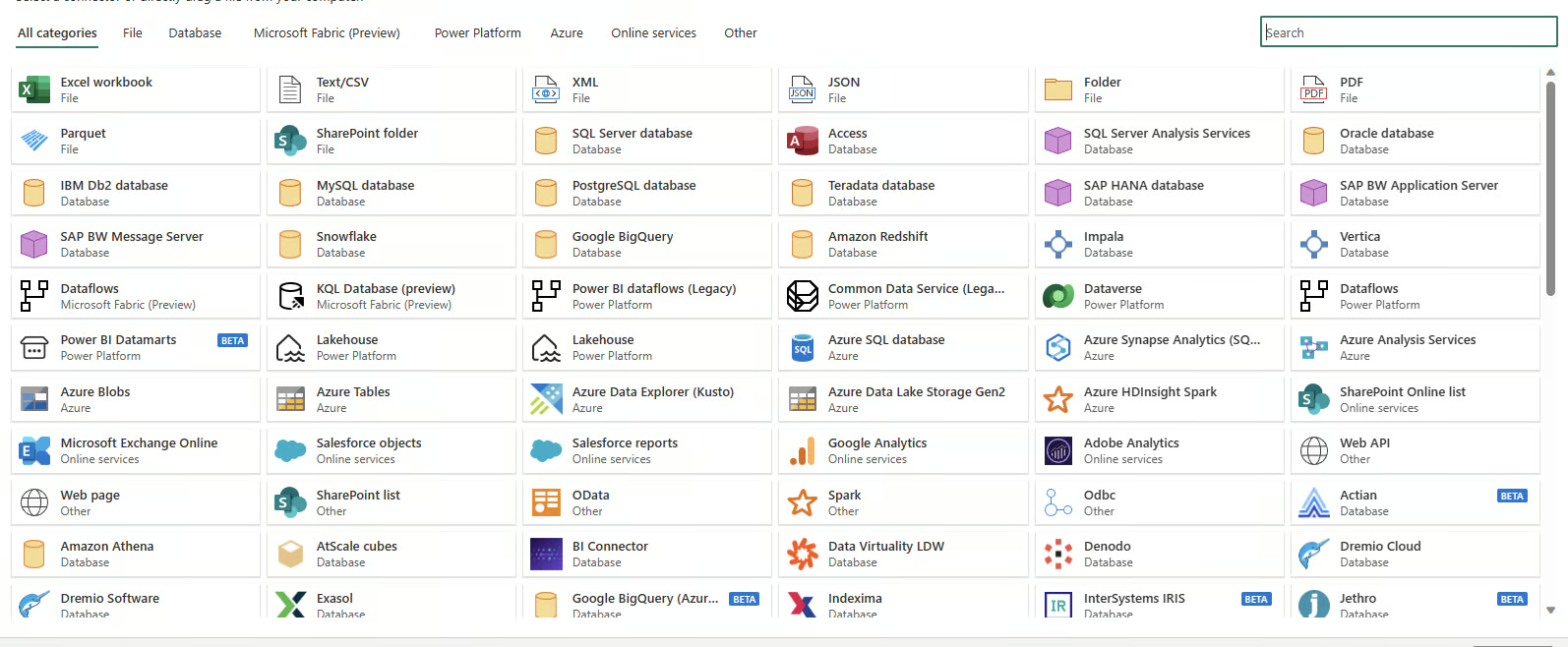

Azure Data Factory, bulut tabanlı ve şirket içi sistemler dahil olmak üzere 100’den fazla yerel bağlayıcıyla entegrasyonu destekler. SQL veritabanları, NoSQL sistemleri, REST API’ler ve dosya tabanlı veri kaynaklarını destekleyerek, kaynağı veya biçimi ne olursa olsun veri iş akışlarını birleştirmenizi sağlar. Ayrıca, Microsoft’un birleşik veri platformu olan Microsoft Fabric’teki veri entegrasyonu yeteneklerini de güçlendiren temel motordur.

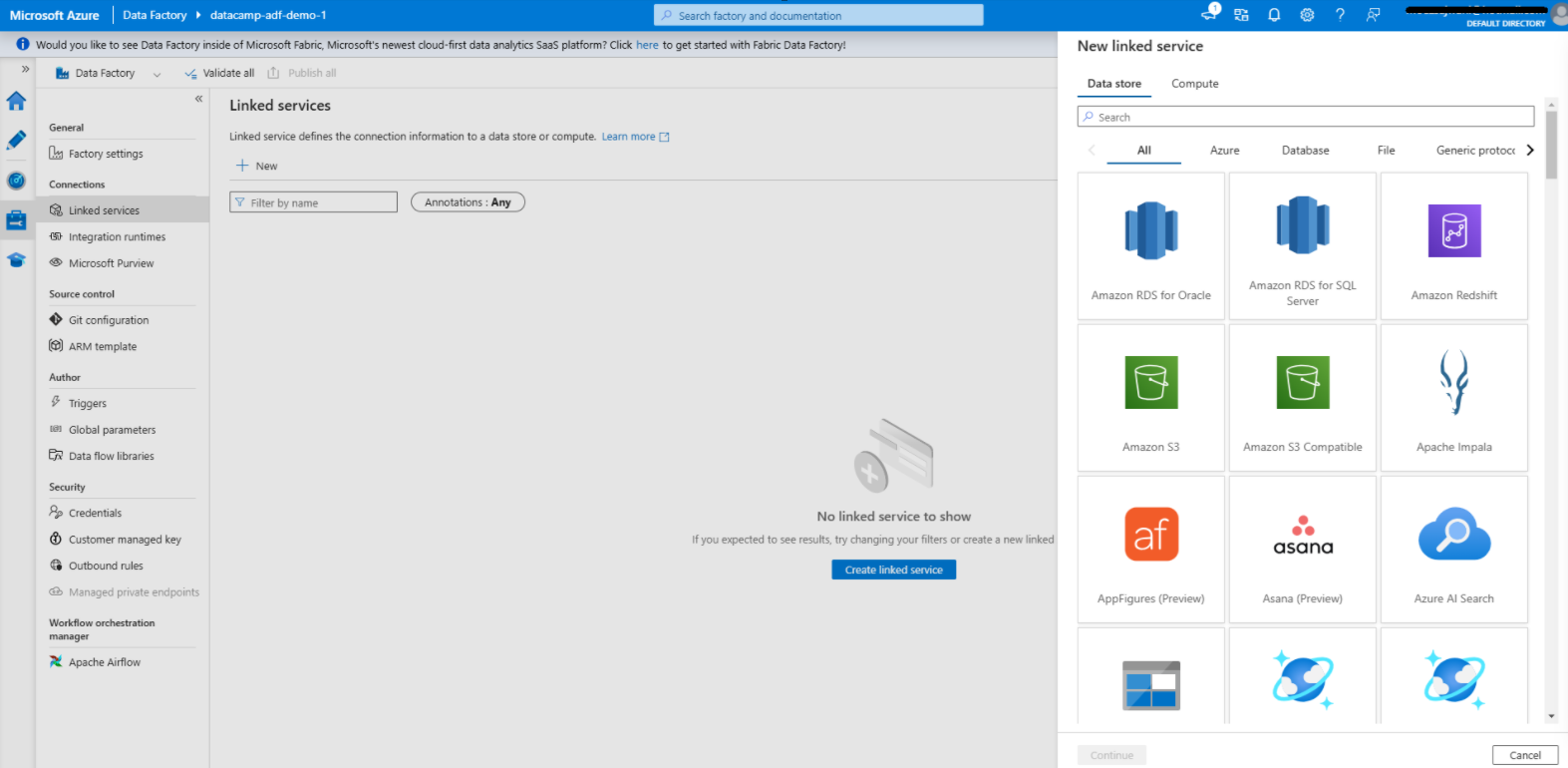

Azure Data Factory’de kullanılabilen veri bağlayıcıları

2. Kodsuz hat oluşturma

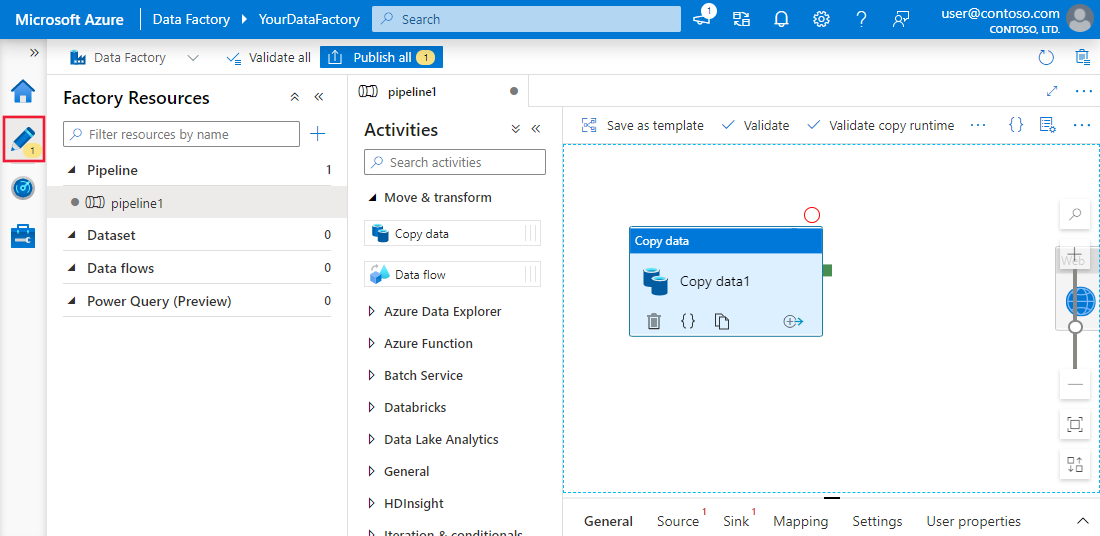

ADF’nin sürükle-bırak arayüzü, kullanıcıların veri hatlarını oluşturmasını kolaylaştırır. Hazır şablonlar, yönlendirmeli yapılandırma sihirbazları ve sezgisel görsel düzenleyici sayesinde, kodlama bilgisi olmayan kullanıcılar bile uçtan uca kapsamlı iş akışları tasarlayabilir.

Azure Data Factory’de kodsuz oluşturma deneyimi

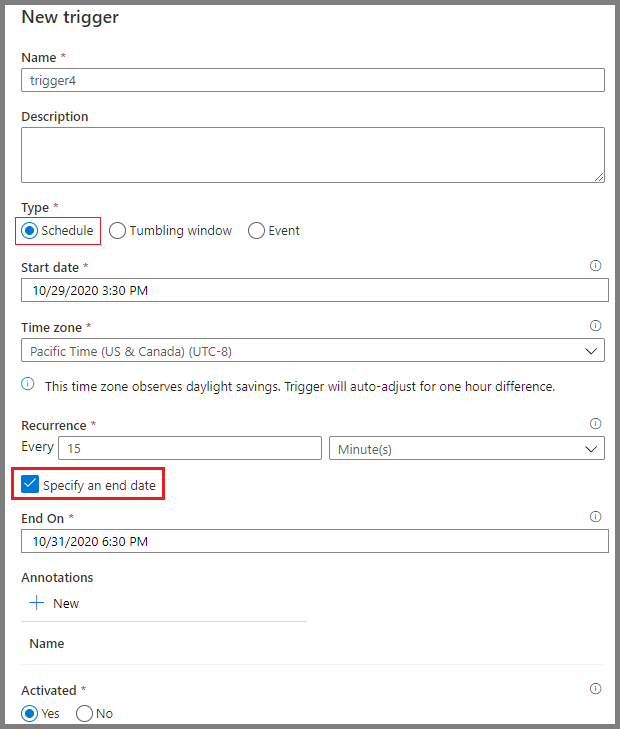

3. Zamanlama

Azure Data Factory’nin zamanlama araçları iş akışı otomasyonu sunar. Kullanıcılar, bulut depolamada bir dosyanın gelmesi veya planlanmış zaman aralıkları gibi belirli koşullara dayalı tetikleyiciler ayarlayabilir. Bu zamanlama seçenekleri, manuel müdahale ihtiyacını ortadan kaldırır ve iş akışlarının tutarlı ve güvenilir biçimde yürütülmesini sağlar.

Azure Data Factory’de hatların zamanlanması

Azure Data Factory’nin Temel Bileşenleri

Azure Data Factory’nin temel bileşenlerini anlamak, verimli iş akışları oluşturmak için kritik öneme sahiptir.

1. Hatlar (Pipelines)

Hatlar, Azure Data Factory’nin omurgasıdır. Verilerin taşınması ve dönüştürülmesi için gereken adımları tanımlayan, veri odaklı iş akışlarını temsil ederler.

Her hat, istenen veri akışını sağlamak için ardışık veya paralel olarak yürütülen bir veya daha fazla etkinlik için bir kap görevi görür.

Bu hatlar, veri mühendislerinin ham veriyi içeri alma, kullanılabilir bir formata dönüştürme ve hedef sistemlere yükleme gibi uçtan uca süreçler oluşturmasını sağlar.

Azure Data Factory’de basit hat örneği

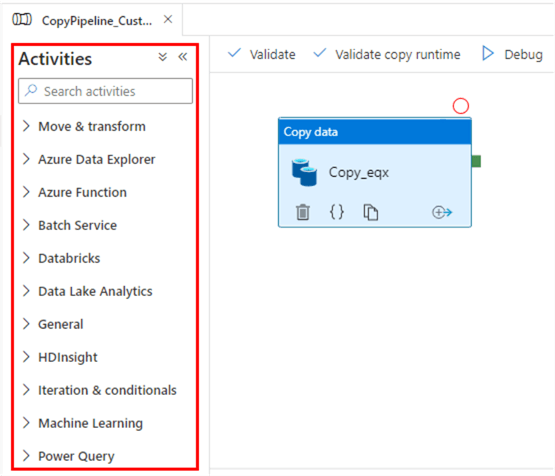

2. Etkinlikler (Activities)

Etkinlikler, her biri belirli bir işlemi gerçekleştiren hatların işlevsel yapı taşlarıdır. Genel olarak şu şekilde sınıflandırılırlar:

- Veri taşıma etkinlikleri: Bu etkinlikler, farklı depolama sistemleri arasında veri transferini sağlar. Örneğin, "Copy data" etkinliği, verileri Azure Blob Storage’dan Azure SQL Database’e taşır.

- Veri dönüştürme etkinlikleri: Bu etkinlikler, veriyi değiştirme ya da işleme imkânı sağlar. Örneğin, veri akışları veya özel betikler veri formatlarını dönüştürmek, değerleri toplamak ya da veri kümelerini temizlemek için kullanılabilir.

- Denetim akışı etkinlikleri: Bunlar, hatlar içindeki yürütmenin mantıksal akışını yönetir. Örnekler arasında koşullu dallanma, döngüler ve paralel yürütme yer alır; karmaşık iş akışlarını ele alırken esneklik sağlar.

Azure Data Factory’de etkinlikler

3. Veri kümeleri (Datasets)

Veri kümeleri, etkinliklerde kullanılan verilerin temsilleridir. İçeri alınan veya işlenen verinin şemasını, biçimini ve konumunu tanımlarlar.

Örneğin, bir veri kümesi Azure Blob Storage’daki bir CSV dosyasını veya Azure SQL Database’deki bir tabloyu tanımlayabilir. Veri kümeleri, etkinlikleri gerçek veri kaynakları ve hedeflerle bağlayan ara katmandır.

Azure Data Factory’de veri kümeleri

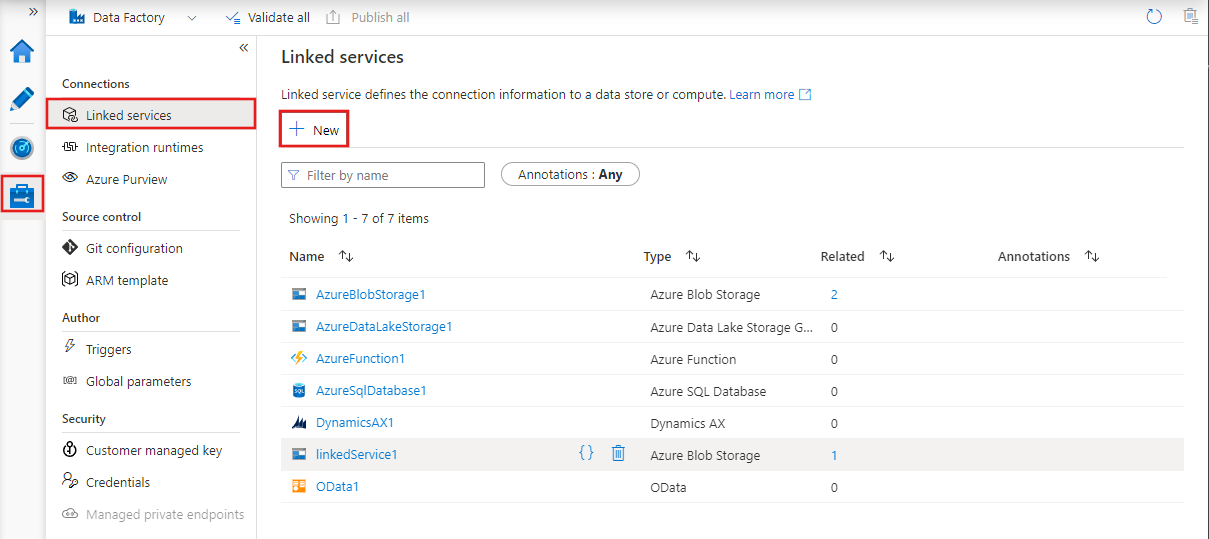

4. Bağlı hizmetler (Linked services)

Bağlı hizmetler, etkinliklerin ve veri kümelerinin harici sistem ve hizmetlere erişmesini sağlayan bağlantı dizeleridir.

Veritabanları, depolama hesapları veya işlem ortamları gibi Azure Data Factory ile etkileşime giren harici kaynaklar arasında köprü görevi görürler.

Örneğin, bir bağlı hizmet şirket içindeki bir SQL Server’a veya bulut tabanlı bir veri gölüne bağlanabilir.

Azure Data Factory’de bağlı hizmetler

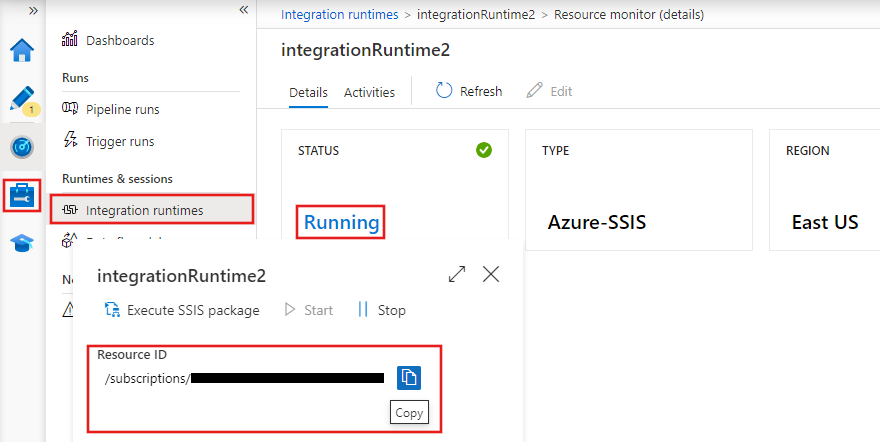

5. Entegrasyon çalışma zamanları (Integration runtimes)

Entegrasyon çalışma zamanları (IR), Azure Data Factory içinde veri taşıma, dönüştürme ve etkinlik yürütmesini sağlayan işlem ortamlarıdır. ADF üç tür entegrasyon çalışma zamanı sunar:

- Azure IR: Bulut tabanlı veri entegrasyonu görevlerini ele alır ve tamamen Azure tarafından yönetilir.

- Self-hosted IR: Şirket içi sistemler ile bulut arasında veri taşımayı destekler; hibrit senaryolar için idealdir.

- SSIS IR: Azure içinde SQL Server Integration Services (SSIS) paketlerinin çalıştırılmasını sağlar, mevcut SSIS iş akışlarınızı bulutta yeniden kullanmanıza imkân tanır.

Azure Data Factory’de entegrasyon çalışma zamanları

Azure Data Factory’yi Kurma

Şimdi bu rehberin uygulamalı kısmına geçelim!

1. Ön koşullar

1. Aktif bir Azure aboneliği.

2. Azure kaynaklarını yönetmek için bir kaynak grubu.

2. Azure Data Factory örneği oluşturma

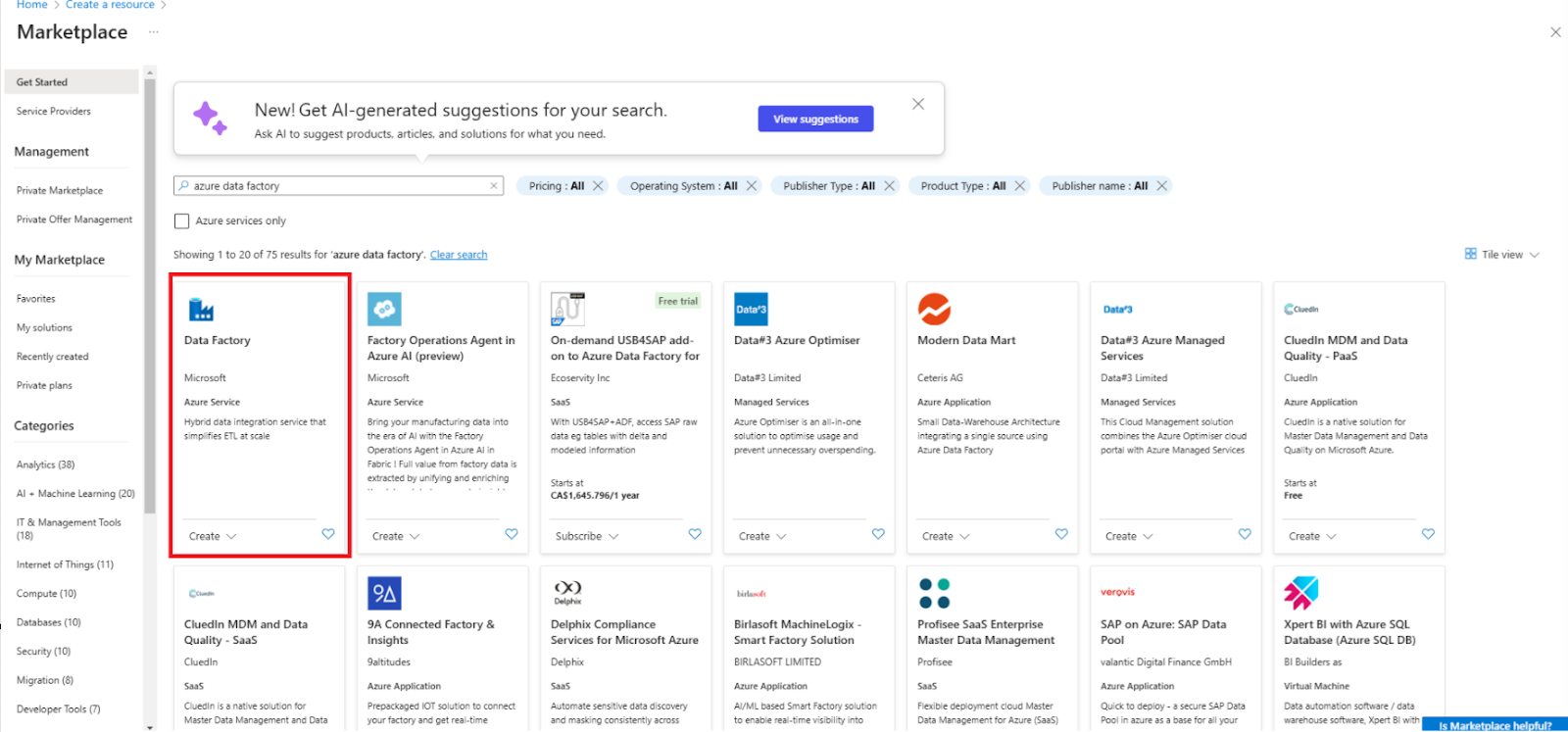

1. Azure portalına giriş yapın.

2. Kaynak oluştur bölümüne gidin ve Data Factory’yi seçin.

Yeni bir Data Factory kaynağı oluşturun

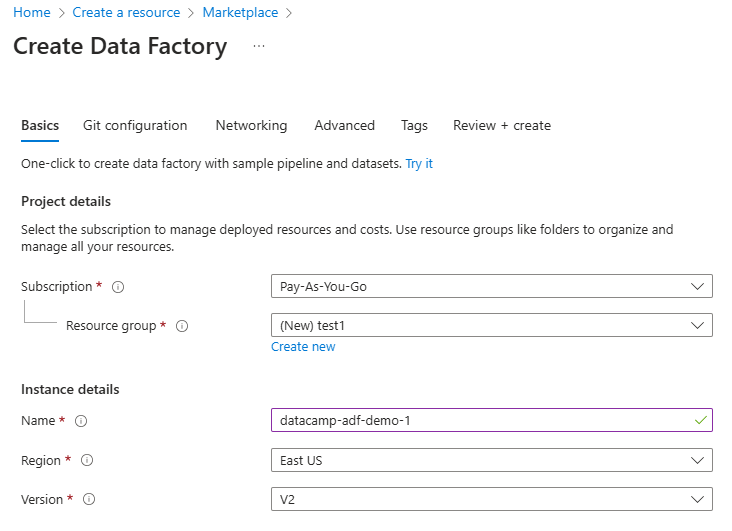

3. Abonelik, kaynak grubu ve bölge dâhil gerekli alanları doldurun.

Data Factory kaynağını yapılandırın

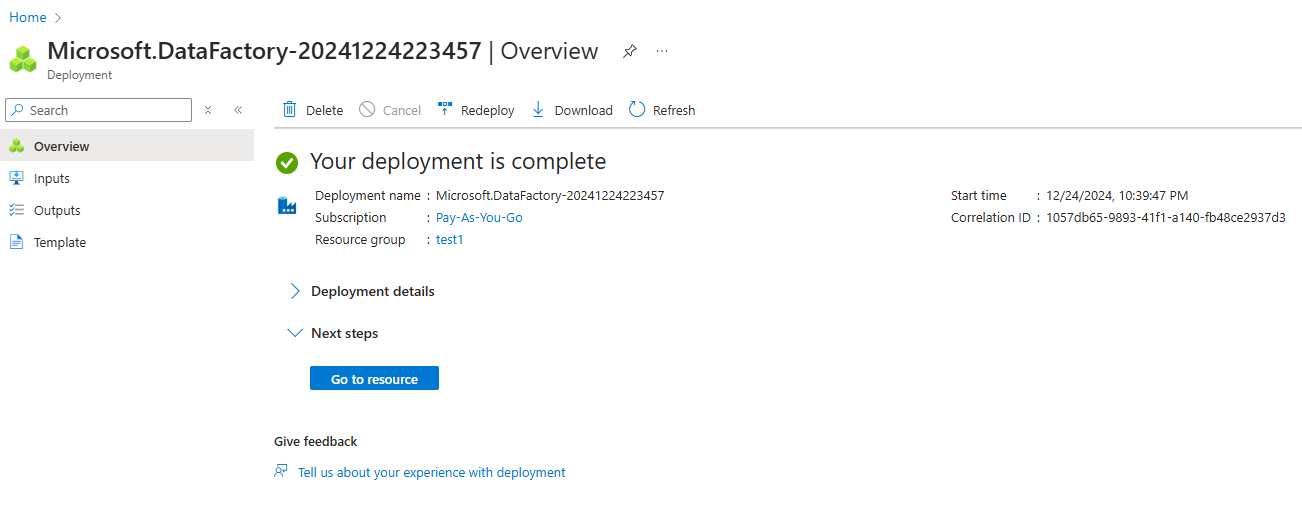

4. Gözden geçirin ve örneği oluşturun.

Azure Data Factory örneği oluşturuldu

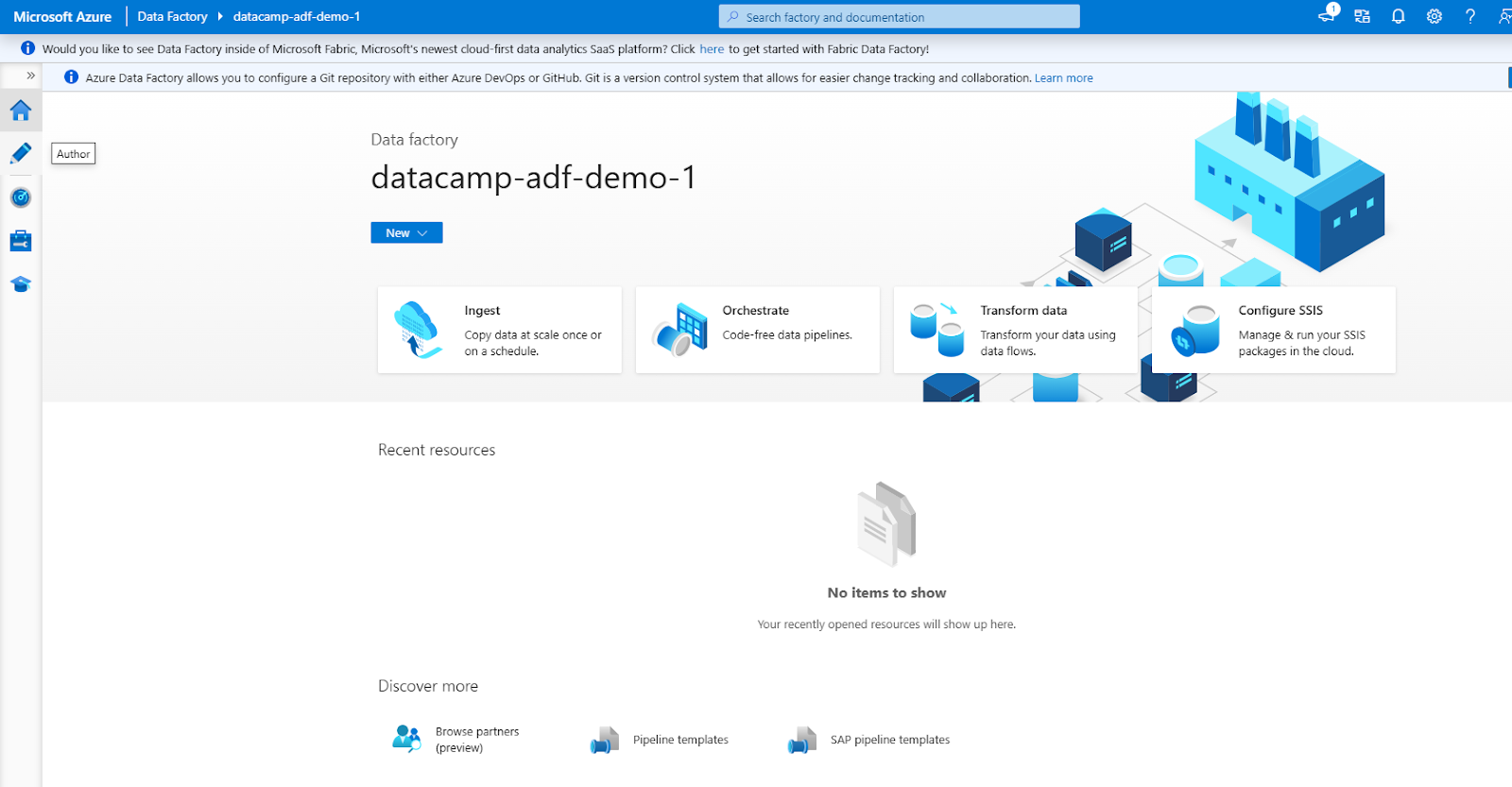

3. ADF arayüzünde gezinme

ADF arayüzü (sol taraftaki gezinme menüsünden erişilir) aşağıdaki ana bölümlerden oluşur

1. Author: Hatları oluşturmak ve yönetmek için.

2. Monitor: Hat çalıştırmalarını izlemek ve sorun gidermek için.

3. Manage: Bağlı hizmetler ve entegrasyon çalışma zamanlarını yapılandırmak için.

Azure Data Factory Arayüzü

Azure Data Factory’de İlk Hattınızı Oluşturma

Basit bir veri hattı oluşturmak için adımları birlikte inceleyelim.

Adım 1: Bağlı hizmetler oluşturun

Azure Data Factory’de bağlı hizmet oluşturma

1. Manage sekmesine gidin

- Azure Data Factory örneğinizi açın ve ADF arayüzünde Manage sekmesine gidin. Veri kaynaklarınızı ve hedeflerinizi bağlayan bağlı hizmetleri burada tanımlarsınız.

2. Veri kaynağı için bir bağlı hizmet ekleyin

- Manage sekmesi altında Linked services’i tıklayın.

- Yeni bir bağlı hizmet oluşturmak için + New’i seçin.

- Mevcut seçenekler listesinden bağlanmak istediğiniz veri kaynağını seçin; örneğin Azure Blob Storage.

- Depolama hesabı adı ve kimlik doğrulama yöntemi (ör. hesap anahtarı veya yönetilen kimlik) gibi gereken bağlantı ayrıntılarını sağlayın.

- Her şeyin doğru kurulduğundan emin olmak için bağlantıyı test edin ve Create’e tıklayın.

3. Veri hedefi için bir bağlı hizmet ekleyin

- Veri hedefi için (ör. Azure SQL Database) aynı işlemi tekrarlayın.

- Uygun hedef türünü seçin, bağlantı ayarlarını yapılandırın (ör. sunucu adı, veritabanı adı ve kimlik doğrulama yöntemi) ve bağlantıyı test edin.

- Doğrulandıktan sonra bağlı hizmeti kaydedin.

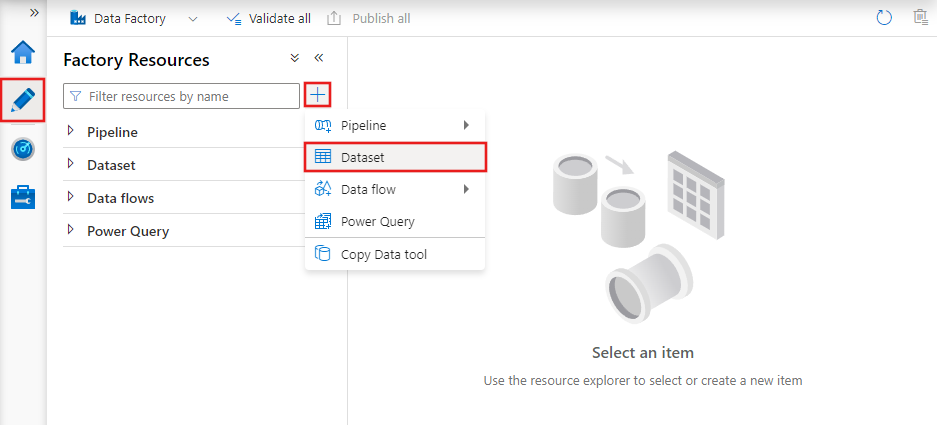

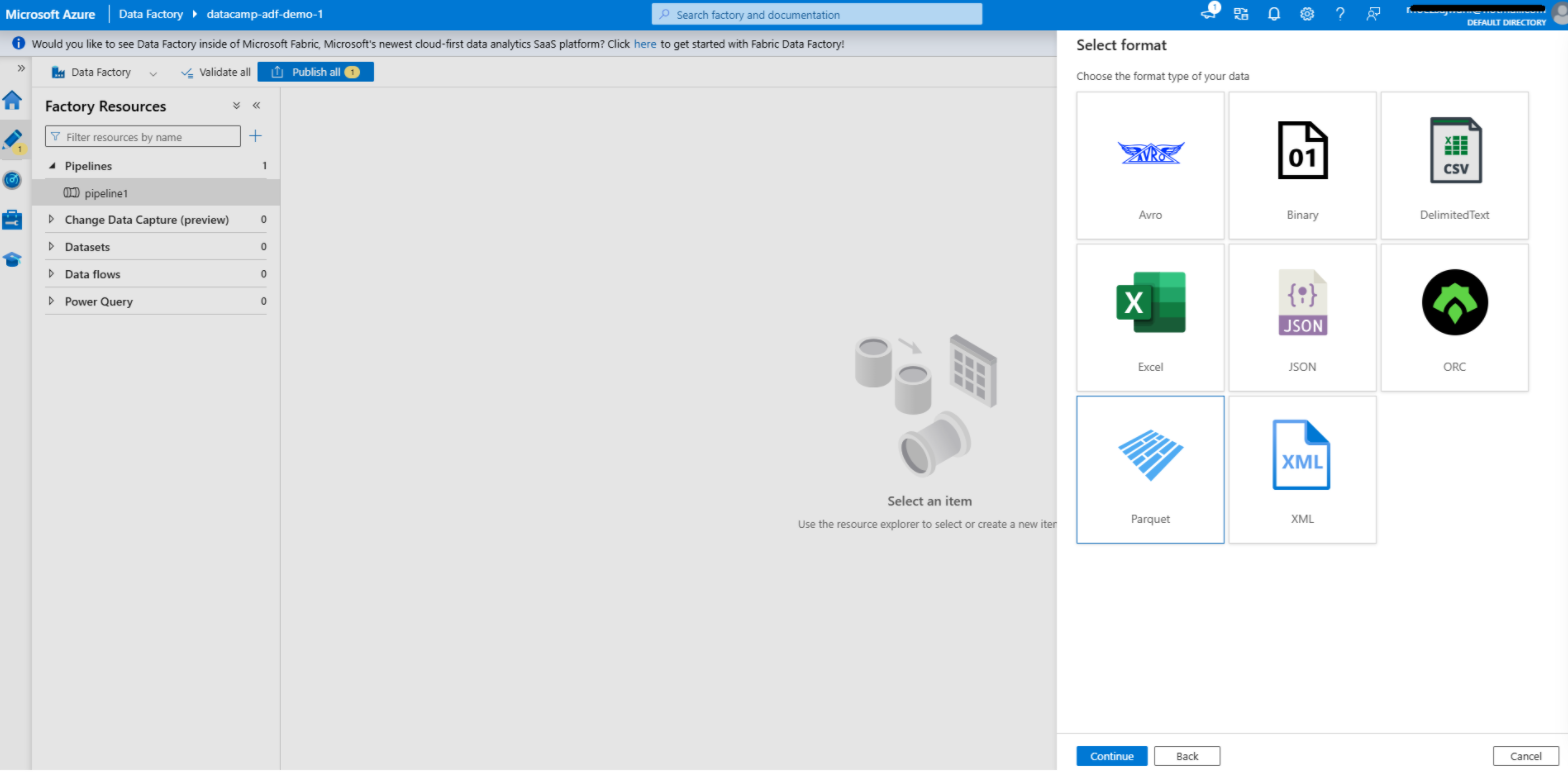

Adım 2: Bir veri kümesi oluşturun

Azure Data Factory’de veri kümesi oluşturma

1. Author sekmesine gidin

- Azure Data Factory arayüzünüzde Author sekmesini açın. Hatlarınızı, veri kümelerinizi ve diğer iş akışı bileşenlerini burada tasarlar ve yönetirsiniz.

2. Kaynak için bir veri kümesi ekleyin

- + düğmesine tıklayın ve açılır menüden Dataset’i seçin.

- Kaynak bağlı hizmetinizle eşleşen veri deposu türünü seçin. Örneğin kaynağınız Azure Blob Storage ise, Delimited Text, Parquet veya ilgili başka bir seçeneği belirleyin.

- Veri kümesini yapılandırın:

- Linked service: Daha önce veri kaynağı için oluşturduğunuz bağlı hizmeti seçin.

- Dosya yolu: Kaynak verinizin bulunduğu yol veya kapsayıcıyı belirtin.

- Şema ve biçim: Veri biçimini (ör. CSV, JSON) tanımlayın ve uygunsa şemayı içe aktarın. Bu, ADF’nin verinizin yapısını anlamasını sağlar.

- Veri kümesini kaydetmek için OK’e tıklayın.

3. Hedef için bir veri kümesi ekleyin

- Hedef veri kümesi için aynı işlemi tekrarlayın.

- Hedef bağlı hizmetinizle eşleşen veri deposu türünü seçin. Örneğin hedefiniz Azure SQL Database ise, Table gibi uygun türü seçin.

- Veri kümesini yapılandırın:

- Linked service: Hedef için oluşturduğunuz bağlı hizmeti seçin.

- Tablo adı veya yol: Verilerin yazılacağı tabloyu veya hedef yolunu belirtin.

- Şema: Kaynak verilerle uyumluluğu sağlamak için hedef veri kümesi şemasını isteğe bağlı olarak tanımlayın veya içe aktarın.

- Veri kümesini kaydedin.

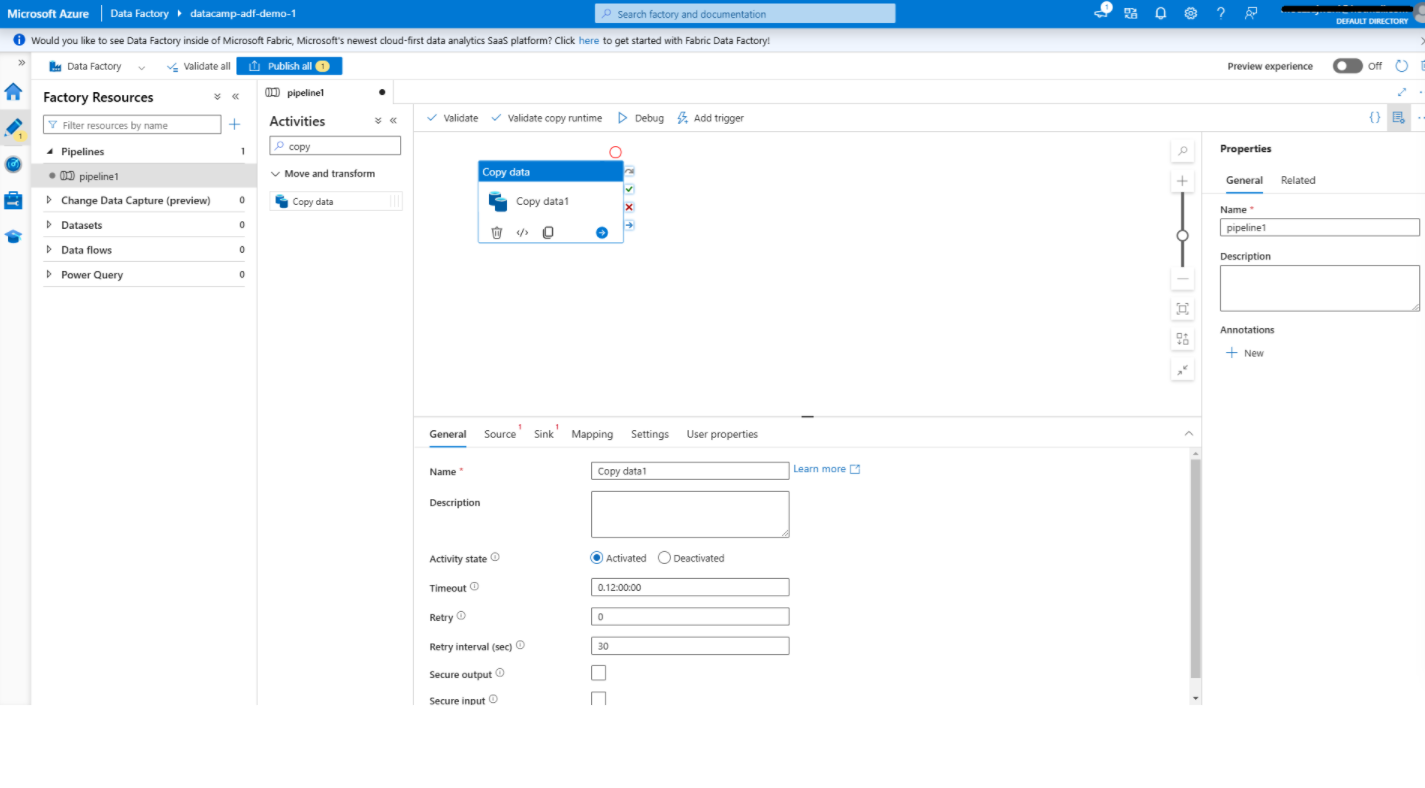

Adım 3: Etkinlikler ekleyin

Azure Data Factory’de kopyalama etkinliği ekleme

1. Hat düzenleyicisini açın

- Author sekmesinde, +’ya tıklayarak ve Pipeline’ı seçerek yeni bir hat oluşturun.

- Bu işlem, veri iş akışlarınızı tasarlayabileceğiniz görsel bir arayüz olan hat düzenleyicisini açar.

2. Kopyalama etkinliğini ekleyin

- Soldaki araç kutusunda, Move & Transform kategorisi altında Copy data etkinliğini bulun.

- Copy data etkinliğini tuvale sürükleyin. Bu etkinlik, verileri kaynaktan hedefe taşır.

3. Kopyalama etkinliğini yapılandırın

- Ayarlar bölmesini açmak için Copy data etkinliğine tıklayın.

- Source sekmesi altında:

- Daha önce oluşturduğunuz kaynak veri kümesini seçin.

- Gerekirse dosya veya klasör filtreleri gibi ek seçenekleri yapılandırın.

- Sink sekmesi altında:

- Hedef veri kümesini seçin.

- Hedefte mevcut verilerin nasıl ele alınacağı gibi ek ayarları belirtin (ör. overwrite veya append).

- Kaynak ve hedeften alanları/sütunları hizalamak ve veri uyumluluğunu sağlamak için Mapping sekmesini kullanın.

- Yapılandırmanızı kaydedin.

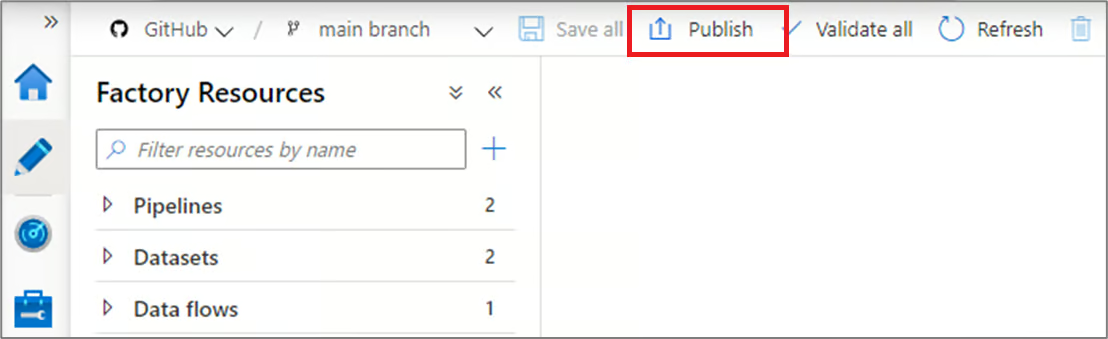

Adım 4: Hatları yayımlayın ve çalıştırın

Azure Data Factory’de hatları yayımlama

1. Hattınızı yayımlayın

- Hattınız yapılandırıldıktan sonra, araç çubuğundan Publish’e tıklayın.

- Bu işlem, hattınızı kaydeder ve çalıştırmaya hazır hâle getirir. Yayımlanmamış değişiklikler taslak olarak kalır ve çalıştırılamaz.

2. Hattı çalıştırın

- Hattınızı test etmek için üstteki Add Trigger’a tıklayın ve manuel çalıştırma için Trigger Now’ı seçin. Bu, hattın beklendiği gibi çalıştığını doğrulamanıza olanak tanır.

- Alternatif olarak, otomatik bir zamanlama ayarlayın:

- Triggers sekmesine gidin ve yeni bir tetikleyici oluşturun.

- Zaman tabanlı bir plan (ör. her gün 08:00) veya olay tabanlı bir koşul (ör. Azure Blob Storage’a dosya gelişi) gibi tetikleyici koşullarını tanımlayın.

- Otomasyonu etkinleştirmek için tetikleyiciyi hattınızla ilişkilendirin.

Azure Data Factory Entegrasyon ve Dönüşüm Yetenekleri

Azure Data Factory, karmaşık iş akışlarını sadeleştiren ve verimliliği artıran güçlü veri entegrasyonu ve dönüşüm özellikleri sunar. Bu bölümde bu özellikleri gözden geçireceğiz.

1. Data flows

Data flows, karmaşık kod yazmadan verileri dönüştürmeyi ve işlemeyi kolaylaştıran görsel bir dönüşüm mantığı tanımlama ortamı sağlar. Data flow’larla gerçekleştirilen yaygın görevler şunlardır:

- Toplamalar (Aggregations): Toplam satışlar veya ortalama performans metrikleri gibi anlamlı içgörüler elde etmek için verileri özetleyin.

- Birleştirmeler (Joins): Aşağı akış süreçleri için zenginleştirilmiş veri kümeleri oluşturmak üzere birden çok kaynaktan verileri birleştirin.

- Filtreler (Filters): Tanımlı kriterlere göre belirli veri alt kümelerini seçin ve ilgili bilgilere odaklanın.

Data flow’lar ayrıca sütun türetmeleri, veri türü dönüşümleri ve koşullu dönüşümler gibi gelişmiş işlemleri de destekler; bu da onları farklı veri gereksinimlerini karşılayabilecek esnek araçlar hâline getirir.

2. Azure Synapse Analytics ile entegrasyon

ADF, Azure Synapse Analytics ile sorunsuz biçimde bütünleşerek büyük veri işleme ve gelişmiş analiz için birleşik bir platform sunar. Bu entegrasyon, kullanıcılara şunları sağlar:

- Veri alımı, hazırlığı ve analizi dâhil uçtan uca veri iş akışlarını düzenlemek.

- Büyük veri kümelerini verimli şekilde işlemek için Synapse’in güçlü sorgu motorundan yararlanmak.

- Veri hatlarını doğrudan Synapse Analytics’e besleyerek makine öğrenimi ve raporlama kullanım senaryolarını desteklemek.

ADF ve Synapse arasındaki bu uyum, iş akışlarını sadeleştirir ve veri entegrasyonu ile analiz için ayrı araçlar yönetmenin karmaşıklığını azaltır.

3. Hatların zamanlanması ve izlenmesi

- Zamanlama: Belirtildiği gibi, ADF’nin zamanlama yetenekleri güçlü otomasyon özellikleri sunar. Kullanıcılar zaman aralıklarına (ör. saatlik, günlük) veya olaylara (ör. Azure Blob Storage’a dosya gelişi) dayalı tetikleyiciler tanımlayabilir.

- İzleme: Azure Data Factory’deki Monitor sekmesi, Azure Monitor ile birlikte, hat yürütmeleri için gerçek zamanlı takip ve tanılama sağlar. Kullanıcılar ayrıntılı günlükleri görüntüleyebilir, ilerlemeyi izleyebilir ve darboğazları veya hataları hızla tespit edebilir. Uyarılar ve bildirimler de kolayca yapılandırılabilir.

Azure Data Factory Kullanım Senaryıları

ADF’nin özelliklerini ve bileşenlerini ayrıntılı olarak inceledikten sonra, onu hangi amaçlarla kullanabileceğimize bakalım.

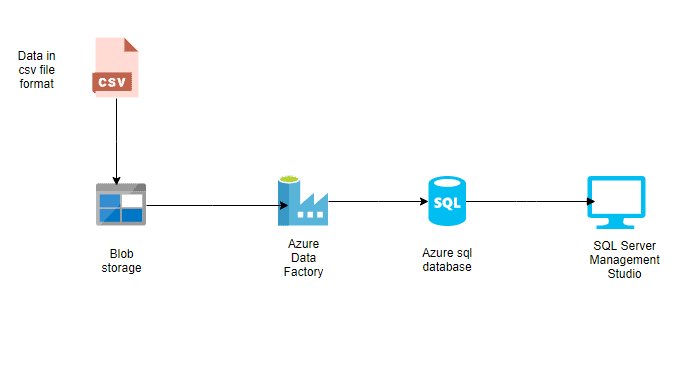

1. Veri taşımayı (migrasyon) gerçekleştirme

ADF, verileri şirket içi sistemlerden bulut tabanlı platformlara taşımak için güçlü bir araçtır. Veri taşımayı otomatikleştirerek karmaşık geçişleri basitleştirir, veri bütünlüğünü sağlar ve kesinti süresini en aza indirir.

Örneğin, ADF’yi kullanarak verileri şirket içindeki bir SQL Server’dan Azure SQL Database’e asgari manuel müdahaleyle taşıyabilirsiniz. Yerleşik bağlayıcılardan ve entegrasyon çalışma zamanlarından yararlanan ADF, hem yapılandırılmış hem de yapılandırılmamış verileri kapsayarak güvenli ve verimli bir geçiş süreci sağlar.

2. Veri ambarı için ETL

Extract, transform, and load (ETL) süreçleri modern veri ambarcılığının kalbinde yer alır. Azure Data Factory, birden çok kaynaktan verileri entegre edip dönüşüm mantığını uygulayarak ve veri ambarına yükleyerek bu iş akışlarını sadeleştirir.

Örneğin, ADF farklı bölgelerden satış verilerini bir araya getirip tek tip bir formata dönüştürerek Azure Synapse Analytics’e yükleyebilir. Bu sadeleştirilmiş süreç, raporlama ve karar verme için güncel ve yüksek kaliteli veriyi korumanıza olanak tanır.

|

2024’ün En İyi 23 ETL Aracını ve neden tercih edilmesi gerektiğini inceleyin. |

3. Veri gölleri için veri entegrasyonu

Veri gölleri, gelişmiş analiz ve makine öğrenimi için çeşitli veri kümelerine merkezi bir depo görevi görür. ADF, Azure Data Lake Storage’a farklı kaynaklardan veri alımını kolaylaştırır; toplu ve akış senaryolarını destekler.

Örneğin, ADF ile günlük dosyalarını, sosyal medya akışlarını ve IoT sensör verilerini tek bir veri gölünde toplayabilirsiniz. Veri dönüşümü ve entegrasyon araçları sağlayarak ADF, veri gölünün düzenli olmasını ve aşağı akış analiz ve yapay zekâ iş yüklerine hazır hâle gelmesini sağlar.

Azure Data Factory için En İyi Uygulamalar

Son olarak, ADF’yi etkili kullanmaya yönelik bazı en iyi uygulamaları gözden geçirmek faydalı olacaktır.

1. Modüler hat tasarımı

Sürdürülebilir ve ölçeklenebilir iş akışları oluşturmak için hatları yeniden kullanılabilir bileşenlerle tasarlayın. Modüler tasarım, tek tek hat bölümlerinin hata ayıklamasını, testini ve güncellenmesini kolaylaştırır. Örneğin, dönüşüm mantığını her hatta gömmek yerine, birden çok iş akışında çağrılabilecek yeniden kullanılabilir bir hat oluşturun. Bu, yinelenmeyi azaltır ve projeler arasında tutarlılığı artırır.

2. Veri taşımayı optimize edin

- Sıkıştırma kullanın: Veri aktarım sürelerini en aza indirmek ve ağ bant genişliği kullanımını azaltmak için büyük veri kümelerini taşımadan önce sıkıştırın. Örneğin gzip veya benzeri yöntemleri kullanmak, büyük dosyaların taşınmasını önemli ölçüde hızlandırabilir.

- Doğru entegrasyon çalışma zamanını seçin: Performansı optimize etmek için entegrasyon çalışma zamanı seçimi (Azure IR, Self-hosted IR veya SSIS IR) kritik öneme sahiptir. Örneğin, self-hosted IR şirket içi veri taşımaları için güvenli ve verimli transferler sağlar; Azure IR ise bulut-yerel işlemler için idealdir.

3. Sağlam hata yönetimi uygulayın

- Yeniden deneme ilkeleri: Geçici hatalar (ör. geçici ağ kesintileri veya sunucu zaman aşımları) için yeniden deneme ilkeleri yapılandırın. Bu, hatların manuel müdahaleye gerek kalmadan toparlanıp başarıyla tamamlanmasını sağlar.

- Uyarıları ayarlayın: Ekiplerinizi hat hataları veya performans sorunları hakkında proaktif olarak bilgilendirmek için uyarılar ve bildirimler uygulayın. Belirli hata türlerine veya yürütme gecikmelerine dayalı özel uyarılar yapılandırmak için Azure Monitor gibi araçları kullanın; bu sayede hızlı çözüm ve asgari kesinti sağlanır.

Peki, Azure Data Factory Databricks’ten nasıl farklıdır? Merak ediyor ve Azure Data Factory ile Databricks arasındaki farkları keşfetmek istiyorsanız, Azure Data Factory vs Databricks: Ayrıntılı Karşılaştırma bloguna göz atın.

Azure Data Factory ve Microsoft Fabric

Azure Data Factory’de ustalaşırken, evrimini anlamak kritik önemdedir: Microsoft Fabric.

Azure Data Factory (ADF) kurumsal alanda yaygın olarak kullanılan, sağlam ve bağımsız bir Platform-as-a-Service (PaaS) çözümü olmaya devam ederken, Microsoft veri ekosisteminin geleceği olarak Fabric’i tanıttı. Fabric; Data Factory, Synapse Analytics ve Power BI’ı tek bir ortamda birleştiren hepsi bir arada bir SaaS platformudur.

ADF mi, Fabric mi kullanmalısınız?

- ADF ile devam edin: Eski şirket içi sistemlerle derin entegrasyona sahip, olgun ve yüksek düzeyde özelleştirilebilir bir PaaS çözümüne ihtiyacınız varsa veya altyapı üzerinde ayrıntılı kontrol (örneğin özel Integration Runtime’lar) gerekiyorsa.

- Fabric’e bakın: Yeni ve modern bir veri platformu kuruyor ve veri mühendisliği, veri ambarı ve Power BI görselleştirmenin tek bir çalışma alanında veri taşımadan (OneLake sayesinde) gerçekleştiği birleşik bir deneyim istiyorsanız.

Not: ADF hatları ile Fabric Data Factory hatları büyük ölçüde benzerdir; dolayısıyla bugün ADF’de öğrendiğiniz beceriler doğrudan Fabric’e aktarılabilir. Daha fazlasını öğrenmek için Introduction to Microsoft Fabric kursumuzu alabilirsiniz.

Sonuç

Azure Data Factory, bulutta veri hatları oluşturma, yönetme ve ölçeklendirme sürecini basitleştirir. Hem teknik hem de teknik olmayan kullanıcılar için sezgisel bir platform sunarak, farklı kaynaklardan verileri verimli bir şekilde entegre edip dönüştürmelerini sağlar.

Kodsuz hat oluşturma, entegrasyon yetenekleri ve izleme araçları gibi özelliklerinden yararlanarak kullanıcılar, ölçeklenebilir ve güvenilir iş akışlarını kolayca oluşturabilir.

Azure Data Factory hakkında daha fazla bilgi edinmek için Top 27 Azure Data Factory Mülakat Sorusu ve Cevabı içeriğine göz atmanızı öneririm.

Azure’un altyapısını; konteynerler, sanal makineler ve daha fazlası dâhil olmak üzere keşfetmek isterseniz, Understanding Microsoft Azure Architecture and Services isimli bu harika ücretsiz kursu öneririm.

Azure Data Factory SSS

Azure Data Factory bir ETL mi yoksa ELT aracı mı?

İkisini de destekler. ADF geleneksel olarak, ham verilerin işlenmeden önce bulut hedefine yüklendiği ELT (Extract, Load, Transform) yaklaşımıyla kullanılır. Ancak Mapping Data Flows ile, kod yazmadan verileri aktarım sırasında dönüştürmenizi sağlayan tam görsel ETL yetenekleri sunar.

Azure Data Factory ile Microsoft Fabric arasındaki fark nedir?

Azure Data Factory (ADF), tamamen veri entegrasyonuna odaklanan bağımsız bir PaaS (Hizmet Olarak Platform) aracıdır. Microsoft Fabric ise, tek bir ortamda Data Factory yeteneklerinin yanı sıra Power BI, Synapse ve Veri Bilimi araçlarını da içeren birleşik bir SaaS (Hizmet Olarak Yazılım) platformudur.

Azure Data Factory’yi kullanmak için kodlama becerilerine ihtiyacım var mı?

Hayır. ADF, hat oluşturmaya yönelik sürükle-bırak arayüzüyle öncelikle düşük kod/kodsuz bir platformdur. Ancak veritabanı etkileşimleri için SQL bilmek şiddetle tavsiye edilir ve Airflow gibi gelişmiş orkestrasyon özelliklerini kullanmayı planlıyorsanız Python faydalıdır.

Azure Data Factory fiyatlandırması nasıl çalışır?

ADF, kullandıkça öde tüketim modeli kullanır. Aylık sabit bir ücret ödemezsiniz; maliyetler, etkinlik çalıştırma sayısı, veri taşıma saatleri ve data flow yürütme süresine göre hesaplanır. Bu, hem küçük hem de büyük iş yükleri için maliyet etkin bir çözümdür.

Azure Data Factory, şirket içi verilere bağlanabilir mi?

Evet. Self-Hosted Integration Runtime’ı ağınız içindeki yerel bir makineye kurarak şirket içi sunuculara (SQL Server, Oracle veya dosya sistemleri gibi) güvenli şekilde bağlanabilirsiniz. Bu, güvenli bir ağ geçidi/köprü görevi görür ve güvenlik duvarı bağlantı noktalarını açmadan buluta erişim sağlar.

ADF ile Databricks arasındaki fark nedir?

ADF, iş akışlarını zamanlamak ve yönetmek için tasarlanmış bir orkestratördür. Databricks ise Spark ve Python kullanarak yoğun veri işleme için optimize edilmiş bir hesaplama motorudur. Birçok mimaride, ADF karmaşık dönüşümleri gerçekleştirmek üzere Databricks not defterlerini tetikler.

ADF güvenliği nasıl ele alır?

Azure Data Factory, kurumsal düzeyde güvenlik sunar; kimlik bilgilerini yönetmeden sorunsuz kimlik doğrulama için Managed Identity, sırları depolamak için Azure Key Vault desteği ve veri trafiğinin genel internete çıkmamasını sağlayan Özel Uç Noktalar (Azure Private Link aracılığıyla) bunlara dahildir.