Kurs

OLS (en küçük kareler) regresyonu öğrenmeye kesinlikle değerdir; çünkü istatistik ve makine öğreniminin büyük bir parçasıdır. Değişkenler arasındaki ilişkileri analiz etmek veya sonuçları tahmin etmek için kullanılır ve bu iki kullanımın uygulamaları hipotez testinden tahminlemeye kadar her şeyi kapsar.

Bu yazıda, OLS regresyonunun temellerini, uygulamalarını, varsayımlarını ve Excel, R ve Python’da nasıl uygulanabileceğini anlamanıza yardımcı olacağım. Öğrenecek çok şey var; bitirdiğinizde Python ile Regresyona Giriş ve R ile Regresyona Giriş gibi belirlenmiş regresyon kurslarımızı alın ve Excel’de Doğrusal Regresyon gibi eğitimlerimizi inceleyin.

OLS Regresyonu Nedir?

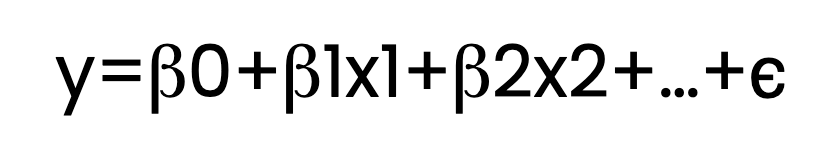

OLS regresyonu, bir veya daha fazla bağımsız değişken (yordayıcı) ile bağımlı değişken (yanıt) arasındaki ilişkiyi tahmin eder. Bunu, gözlenen verilere bir doğrusal denklem uydurarak yapar. Denklem şu şekildedir:

Burada:

- y bağımlı değişkendir.

- x1, x2,… bağımsız değişkenlerdir.

- β0 sabit terimdir (intercept).

- β1, β2, …, katsayılardır.

- ϵ hata terimini temsil eder.

Yukarıdaki denklemde, β terimlerinden birkaçını, örneğin β1 ve β2’yi gösteriyorum. Ancak açık olmak gerekirse, regresyon denklemi, β0 dışında yalnızca bir β terimi içerebilir; bu durumda buna basit doğrusal regresyon deriz. İki veya daha fazla yordayıcı olduğunda, örneğin β1 ve β2, buna çoklu doğrusal regresyon deriz. Sıradan en küçük kareler tahmin edicisi kullanılıyorsa her ikisi de OLS regresyonu sayılır.

OLS minimizasyon problemi nedir?

OLS regresyonunun merkezinde bir optimizasyon sorunu yatar: verilere en iyi uyan doğruyu (veya daha yüksek boyutlarda hiper düzlemi) bulmak. Peki “en iyi uyum” ne demektir? Burada “en iyi uyum”, artık kareleri toplamının en aza indirilmesi anlamına gelir.

Minimuma indirme problemini, artık kavramını da açıklayarak anlatmaya çalışayım.

- Artıklar Nedir? Artıklar, gözlenen gerçek değerler ile regresyon modelinin tahmin ettiği değerler arasındaki farklardır. Her veri noktası için artık, tahminimizin ne kadar saptığını gösterir.

- Artıklar Neden Karelenir? Her artığı karesini alarak pozitif ve negatif farkların birbirini götürmesini engelleriz. Kare alma, büyük hatalara daha fazla ağırlık verir; yani model, büyük hataları azaltmaya öncelik tanır.

Artıkların kareleri toplamını en aza indirerek, regresyon doğrusu bağımsız ve bağımlı değişkenler arasındaki ilişkinin doğru bir temsili haline gelir. Aslında, kareler toplamını en aza indirdiğimizde, modelimizin tahminlerindeki toplam hata olabilecek en küçük düzeydedir. Artıklar ve regresyon ayrıştırması hakkında daha fazla bilgi edinmek için Kareler Toplamını Anlamak: SST, SSR ve SSE Rehberi başlıklı eğitimimizi okuyun.

Sıradan en küçük kareler tahmin edicisi nedir?

Regresyon bağlamında, bağımsız değişkenlerle bağımlı değişken arasındaki ilişkiyi tanımlayan katsayıları hesaplamak için tahmin ediciler kullanılır. Sıradan en küçük kareler (OLS) tahmin edicisi de bu yöntemlerden biridir. Gözlenen değerlerle modelin tahmin ettiği değerler arasındaki kare farkların toplamını en aza indiren katsayı değerlerini bulur.

Bu konuyu, terimlerin net olması için gündeme getiriyorum. Regresyon başka tahmin edicilerle de yapılabilir; her biri veriye ve analiz hedeflerine bağlı olarak farklı avantajlar sunar. Örneğin, bazı tahmin ediciler aykırı değerlere daha dayanıklıdır; bazıları ise model parametrelerini düzenlileştirerek aşırı uyumu önlemeye yardımcı olur.

OLS regresyon parametreleri nasıl tahmin edilir?

Regresyon modeline en iyi uyan katsayıları belirlemek için OLS tahmin edicisi, artıkların kareleri toplamını en aza indiren matematiksel teknikler kullanır. Olası yöntemlerden biri, veriye dayalı bir denklem sistemi kurup gözlenen ve tahmin edilen değerler arasındaki kare farkların toplamını en aza indiren katsayıları doğrudan çözen normal denklemdir.

Ancak, normal denklemin çözümü özellikle büyük veri kümelerinde hesaplama açısından zorlayıcı olabilir. Bunu aşmak için sıklıkla QR ayrıştırması adlı bir teknik kullanılır. QR ayrıştırması, bağımsız değişkenler matrisini, bir ortonormal matris (Q) ve bir üst üçgensel matris (R) olmak üzere iki daha basit matrise ayırır. Bu basitleştirme hesaplamaları daha verimli hale getirir ve sayısal kararlılığı da artırır.

OLS Regresyonu Ne Zaman Kullanılır

OLS regresyonunu ne zaman kullanacağımıza nasıl karar veririz? Bu kararı verirken hem veri setimizin özelliklerini değerlendirmeli hem de çözmeye çalıştığımız spesifik problemi tanımlamalıyız.

OLS regresyonunun varsayımları

OLS regresyonunu uygulamadan önce, güvenilir sonuçlar elde etmek için verimizin aşağıdaki varsayımları karşıladığından emin olmalıyız:

- Doğrusallık: Bağımsız ve bağımlı değişkenler arasındaki ilişki doğrusal olmalıdır.

- Hata bağımsızlığı: Artıklar birbiriyle ilişkisiz olmalıdır.

- Homoskedastisite: Artıklar, bağımsız değişkenlerin tüm seviyelerinde sabit varyansa sahip olmalıdır.

- Hata normalliği: Artıklar normal dağılım göstermelidir.

Bu varsayımların ciddi ihlalleri, yanlı tahminlere veya güvenilmez öngörülere yol açabilir. Bu nedenle, daha ileri gitmeden önce potansiyel sorunları değerlendirmemiz ve ele almamız gerekir.

OLS regresyonunun uygulamaları

Varsayımlar sağlandığında, OLS regresyonu farklı amaçlarla kullanılabilir:

- Tahmine dayalı modelleme: Satış, gelir veya eğilimler gibi sonuçları öngörme.

- İlişki analizi: Bağımsız değişkenlerin bağımlı değişken üzerindeki etkisini anlama.

- Hipotez testi: Belirli yordayıcıların sonuç değişkenini anlamlı biçimde etkileyip etkilemediğini değerlendirme.

R, Python ve Excel’de OLS Regresyonu

Şimdi OLS regresyonunun R, Python ve Excel’de nasıl yapıldığına bakalım.

R’da OLS regresyonu

R, OLS regresyonu için lm() fonksiyonunu sağlar. İşte bir örnek:

# Let's create sample data

predictor_variable <- c(1, 2, 3, 4, 5)

response_variable <- c(2, 4, 5, 4, 5)

# We now fit the OLS regression model using the lm() function from base R

ols_regression_model <- lm(response_variable ~ predictor_variable)

# OLS regression model summary

summary(ols_regression_model)OLS regresyonunu R’da gerçekleştirmek için herhangi bir ek paketi içe aktarmamız gerekmediğine dikkat edin.

Python’da OLS regresyonu

Python, OLS regresyonu için statsmodels ve scikit-learn gibi kütüphaneler sunar. statsmodels kullanarak bir örnek deneyelim:

import statsmodels.api as sm

# We can create some sample data

ols_regression_predictor = [1, 2, 3, 4, 5]

ols_regression_response = [2, 4, 5, 4, 5]

# Adding a constant for the intercept

ols_regression_predictor = sm.add_constant(ols_regression_predictor)

# We now fit our OLS regression model

ols_regression_model = sm.OLS(ols_regression_response, ols_regression_predictor).fit()

# Summary of our OLS regression

print(ols_regression_model.summary())Excel’de OLS regresyonu

Excel de yerleşik araçlarıyla OLS regresyonu yapma imkânı sunar. Şu adımları izleyin:

Verinizi hazırlayın

Verinizi iki sütun halinde düzenleyin: biri bağımsız değişken(ler), diğeri bağımlı değişken için. Veri kümenizde boş hücre olmadığından emin olun.

Veri Analizi Araç Paketi’ni etkinleştirin

Şuraya gidin: File > Options > Add-Ins. Manage kutusunda Excel Add-ins öğesini seçin ve Go’ya tıklayın. Analysis ToolPak kutusunu işaretleyin ve OK’ye tıklayın.

Regresyon analizini çalıştırın

Şuraya gidin: Data > Data Analysis ve seçenekler listesinden Regression’ı seçin. OK’ye tıklayın.

Regression ileti kutusunda:

- Input Y Range’i bağımlı değişken sütununuza ayarlayın.

- Input X Range’i bağımsız değişken(ler)inize ayarlayın.

- Girdi aralığınız sütun başlıklarını içeriyorsa Labels seçeneğini işaretleyin.

- Çıktı için bir aralık veya yeni bir çalışma sayfası seçin.

OLS Regresyon Modelleri Nasıl Değerlendirilir

Artık bir OLS regresyon modeli oluşturduk. Sıradaki adım, model tanılamaları ve istatistiklerine bakarak etkili olup olmadığını görmektir.

Tanılama grafikleri

Model varsayımlarını ve uyum kalitesini değerlendirmek için görsel araçlar kullanabiliriz. Seçenekler arasında, doğrusal olmama veya heteroskedastisite işareti olabilecek desenleri kontrol eden artıklar vs. uyarlanmış değerler grafiği veya artıkların bir normal dağılım gibi bir dağılımı izleyip izlemediğini inceleyen Q-Q grafiği yer alır.

Model istatistikleri

Model performansı ve yordayıcıların anlamlılığına ilişkin içgörüler sunan istatistiksel ölçütlerle de modeli değerlendirebiliriz. Yaygın model istatistikleri arasında, modelin açıkladığı varyans oranını ölçen R-kare ve düzeltilmiş R-kare bulunur. Ayrıca, modelin genel anlamlılığını ve tek tek yordayıcıların anlamlılığını test eden F-istatistiğine ve p-değerlerine de bakabiliriz.

Eğitim/test iş akışı

Son olarak, veri analistlerinin bir modelin öngörü yeteneğini doğrulamak için yapılandırılmış bir süreç izlemeyi de sevdiğini söylemeliyiz. Bu, verinin eğitim ve test alt kümelerine bölündüğü bir veri ayrıştırma sürecini, modeli uyarlamak için bir eğitim sürecini ve ardından görünmeyen test verileri üzerinde model performansını değerlendirmek için bir test sürecini içerir. Bu süreç, k-katlı çapraz doğrulama gibi adımları da içerebilir.

Daha Derin OLS Regresyon İçgörüleri

Artık OLS regresyonunun temellerini ele aldığımıza göre, biraz daha ileri kavramları inceleyelim.

OLS regresyonu ve maksimum olabilirlik tahmini

Maksimum olabilirlik tahmini (MLE), iyi bir nedenle OLS regresyonuyla birlikte anılan bir başka kavramdır. Şimdiye kadar, OLS’nin katsayıları tahmin etmek için artıkların kareleri toplamını nasıl en aza indirdiğinden bahsettik. Şimdi bir adım geri atıp MLE’den söz edelim.

MLE, modelimiz altında verilen veriyi gözlemleme olasılığını maksimize eder. Hata terimi için belirli bir olasılık dağılımı varsayarak çalışır. Bu olasılık dağılımı genellikle bir normal (Gaussian) dağılımdır. Bu dağılımı kullanarak, gözlenen veriyi en olası kılan parametre değerlerini buluruz.

Maksimum olabilirlik tahmininden şimdi bahsetmemin nedeni, OLS regresyonu bağlamında, hataların normal dağıldığı varsayımı altında MLE yaklaşımının, kareler toplamını en aza indirdiğimizde elde ettiğimizle aynı katsayı tahminlerine ulaşmasıdır.

OLS regresyonunu ağırlıklı ortalama olarak yorumlamak

OLS regresyonuna dair ilginç bir başka bakış açısı da onu bir ağırlıklı ortalama olarak yorumlamaktır. Prof. Andrew Gelman, OLS regresyonundaki katsayıların, ağırlıkların yordayıcıların varyansı ve modelin yapısı tarafından belirlendiği, gözlenen veri noktalarının ağırlıklı ortalaması olarak düşünülebileceği fikrini tartışır.

Bu bakış açısı, regresyon sürecinin nasıl çalıştığına ve neden bu şekilde davrandığına dair içgörü sunar; çünkü OLS regresyonu aslında varyansı daha küçük olan ya da modelin tahminlerine daha yakın gözlemlere daha fazla ağırlık verir. Ayrıca Prof. Gelman’ın seçim anketlerinde regresyon kullanımına dair söylediklerini duymak için DataFramed podcast bölümümüz Seçim Tahmini ve Anketler’e de göz atabilirsiniz.

OLS Regresyonu ve Benzer Regresyon Yöntemleri

Başka bazı regresyon yöntemlerinin adları benzer gelebilir; ancak farklı amaçlara hizmet ederler veya farklı varsayımlar altında çalışırlar. Benzer görünen bazılarına bakalım:

OLS vs. ağırlıklı en küçük kareler (WLS)

WLS, gözlemlerin varyansına göre her veri noktasına farklı ağırlıklar atayan OLS’nin bir uzantısıdır. Artıkların sabit varyans varsayımı ihlal edildiğinde özellikle kullanışlıdır. Gözlemleri varyanslarıyla ters orantılı olarak ağırlıklandırarak, WLS heteroskedastik verilerle çalışırken daha güvenilir tahminler sağlar.

OLS vs. kısmi en küçük kareler (PLS) regresyonu

PLS, yordayıcılarla yanıt değişkeni arasındaki kovaryansı maksimize eden örtük değişkenleri çıkararak temel bileşenler analizi ve çoklu regresyon özelliklerini birleştirir. Çoklu doğrusal bağlantı durumlarında veya yordayıcı sayısının gözlem sayısını aştığı durumlarda avantaj sağlar. Boyutu azaltırken aynı zamanda yordama gücünü maksimize eder; OLS ise bunu doğası gereği ele almaz.

OLS vs. genelleştirilmiş en küçük kareler (GLS)

WLS’ye benzer şekilde, GLS artıkların ilişkili olmasına ve/veya sabit olmayan varyansa sahip olmasına izin vererek OLS’yi genelleştirir. OLS’nin artıklarla ilgili varsayımlarının ihlallerini hesaba katacak şekilde tahmin sürecini ayarlar ve bu tür senaryolarda daha verimli ve yanlı olmayan tahminler sağlar.

OLS vs. toplam en küçük kareler (TLS)

Ortogonal regresyon olarak da bilinen TLS, OLS’nin minimize ettiği düşey mesafeler yerine, veri noktalarından regresyon doğrusuna olan dik mesafeleri minimize eder. TLS, hata hem bağımsız hem de bağımlı değişkende mevcut olduğunda kullanışlıdır; OLS ise yalnızca bağımlı değişkende ölçüm hatası olduğunu varsayar.

OLS Regresyonuna Alternatifler

Değişkenler arasındaki ilişki karmaşık veya doğrusal değilse, parametrik olmayan regresyon yöntemleri, regresyon fonksiyonunun şeklini verinin belirlemesine izin vererek OLS’ye esnek alternatifler sunar. Önceki örneklerin tümü ("benzer görünenler") parametrik modeller kategorisine aittir. Ancak parametrik varsayımların kısıtları olmadan desenleri modellemek istediğinizde parametrik olmayan modeller de kullanılabilir.

| Yöntem | Açıklama | Avantajlar | Yaygın Kullanım Alanları |

|---|---|---|---|

| Çekirdek Regresyonu | Veriyi düzleştirmek için çekirdek ile ağırlıklı ortalamalar kullanır. | Doğrusal olmayan ilişkileri yakalar Esnek düzleştirme |

Keşifsel analiz Bilinmeyen değişken ilişkileri |

| Yerel Regresyon | Pürüzsüz bir eğri için verinin alt kümelerine yerel polinomlar uydurur. | Karmaşık desenleri işler Uyarlanabilir düzleştirme |

Eğilim görselleştirme Saçılım grafiği düzleştirme |

| Regresyon Ağaçları | Veriyi dallara ayırarak her bölümde basit modeller uydurur. | Yorumlaması kolay Etkileşimleri ele alır |

Veri segmentasyonu Farklı veri rejimlerini belirleme |

| Spayn Regresyonu | Veriyi modellemek için düğümlerde süreklilik sağlayan parça parça polinomlar kullanır. | Pürüzsüz doğrusal olmayan eğilimleri modeller Esnek uyarlama |

Zaman serileri Büyüme eğrileri |

Son Düşünceler

OLS regresyonu, veri ilişkilerini anlamak ve tahminlerde bulunmak için temel bir araçtır. OLS’yi öğrendiğinizde, gelişmiş model ve teknikleri keşfetmek için sağlam bir temel oluşturursunuz. Beceri setinizi genişletmek için DataCamp’in R ve Python’da regresyon kurslarını keşfedin: Python’da statsmodels ile Regresyona Giriş ve R ile Regresyona Giriş). Ayrıca, çok popüler Python ile Makine Öğrenimi Bilimcisi kariyer yolumuzu da değerlendirin.

Bilimsel dergilerde yayımlanan araştırma makalelerine katkıları olan bir veri bilimi yazarı ve editörüyüm. Özellikle lineer cebir, istatistik, R ve benzeri konularla ilgileniyorum. Aynı zamanda epey satranç da oynarım!

OLS Regresyon SSS

OLS regresyonu nedir?

Sıradan En Küçük Kareler (OLS) regresyonu, bir veya daha fazla bağımsız değişken ile bir bağımlı değişken arasındaki ilişkiyi tahmin etmek için kullanılan istatistiksel bir yöntemdir. Bunu, gözlenen ve tahmin edilen değerler arasındaki kare farkların toplamını en aza indiren bir doğrusal denklem uydurarak yapar; bu da onu tahmin ve analiz için istatistik ve makine öğreniminde temel bir araç haline getirir.

OLS regresyonunun sınırlamaları nelerdir?

OLS regresyonu doğrusal bir ilişki varsayar; bu da verideki karmaşık desenleri yakalamayabilir. Aykırı değerlere duyarlıdır ve sonuçları saptırabilir; ayrıca, bağımsız değişkenlerin yüksek derecede ilişkili olduğu çoklu doğrusal bağlantı ile başa çıkmakta zorlanır. Ek olarak, OLS, tüm varsayımların (doğrusallık, bağımsızlık, homoskedastisite, normallik) sağlanmasını gerektirir; ihlaller yanlı veya verimsiz tahminlere yol açabilir.

Nedensel çıkarım için OLS regresyonu kullanılabilir mi?

OLS regresyonu değişkenler arasında ilişkiler belirleyebilse de, nedenselliğin kurulması çalışma tasarımı ve olası karıştırıcıların dikkatle ele alınmasını gerektirir. OLS tek başına nedenselliği kanıtlamaz. Nedensel çıkarım yapmak için, genellikle OLS ile birlikte rastgele kontrollü deneyler, araç değişkenleri veya eğilim puanı eşleştirme gibi ek yöntemler gerekir.