Lernpfad

Ein verantwortungsvoller Umgang mit KI ist nicht nur ein schönes Ziel, sondern eine wichtige Priorität. Es ist wichtig, dass die Entwicklung, der Einsatz und die Nutzung von KI im Einklang mit den Grundsätzen von responsible AI (RAI) erfolgt, um die Risiken in der Gesellschaft in allen Sektoren zu verringern.

Da KI weiterhin schnell wächst, hat sie das Potenzial, bei verantwortungsvollem Einsatz große Vorteile zu bringen und dazu beizutragen, die Ziele für nachhaltige Entwicklung der Vereinten Nationenzu erreichen, die Menschenrechte zu schützen und das Wohlergehen der Menschheit stets in den Vordergrund zu stellen.

In diesem Blog führe ich dich in die Prinzipien der verantwortungsvollen KI ein, indem ich eine vergleichende Studie über die Arbeit in diesem Bereich in der Literatur, in der Wissenschaft, in internationalen Organisationen und in der Industrie vorstelle.

Wenn du dich eingehender mit diesem Thema beschäftigen möchtest, solltest du dir diesen Kurs über Verantwortungsvolle KI-Praktiken.

Was ist verantwortungsvolle KI?

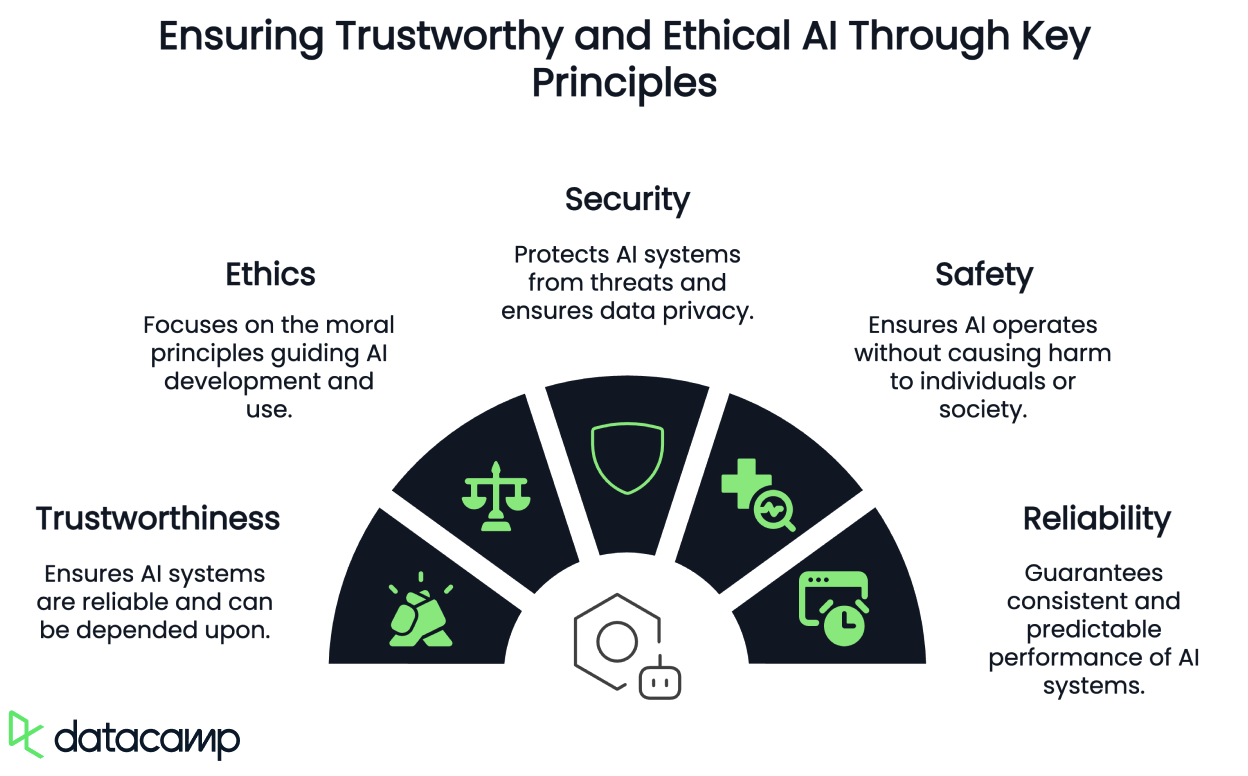

Wir haben noch keine allgemeingültige Definition von "verantwortungsvoller KI". In manchen Fällen wird sie auch als vertrauenswürdige, ethische, sichere oder geschützte KI bezeichnet. In anderen Fällen werden diese Prinzipien lediglich unter einem breiteren Begriff von RAI subsumiert oder als ganz andere Kategorien bezeichnet.

Der wachsende Fokus auf verantwortungsvolle, ethische, vertrauenswürdige und sichere KI resultiert aus der weit verbreiteten Besorgnis über ihre möglichen negativen Auswirkungen, sowohl beabsichtigt als auch unbeabsichtigt.

Die Institute of Electrical and Electronics Engineers (IEEE) führt dies auf den traditionellen Ausschluss ethischer Analysen aus der Ingenieurspraxis zurück, bei dem grundlegende ethische Standards in Bezug auf Sicherheit, Funktionalität, Gerechtigkeit, Voreingenommenheit, Sucht und indirekte gesellschaftliche Schäden oft als außer Acht gelassen wurden.

Angesichts der Skalierbarkeit und des weitreichenden Einflusses von KI auf jeden Aspekt der Gesellschaft und unseres täglichen Lebens ist es jedoch unerlässlich, ethische Risiken zu antizipieren und abzumildern als Standardverfahren. Der derzeitige Ansatz, Technologien ohne ausreichende Kontrolle in die Welt zu entlassen und andere mit den Folgen zu konfrontieren, ist nicht länger akzeptabel.

Der Übergang von ethischen Theorien und Grundsätzen zu einer kontextspezifischen, umsetzbaren Praxis ist jedoch nach wie vor ein großes Hindernis für die breite Einführung einer systematischen ethischen Folgenabschätzung in der Softwareentwicklung.

Grundsätze für verantwortungsvolle KI

Wenn wir uns die Literatur ansehen, können wir feststellen, dass die Prinzipien der RAI schon seit einiger Zeit diskutiert werden. Wir wollen sie kurz besprechen.

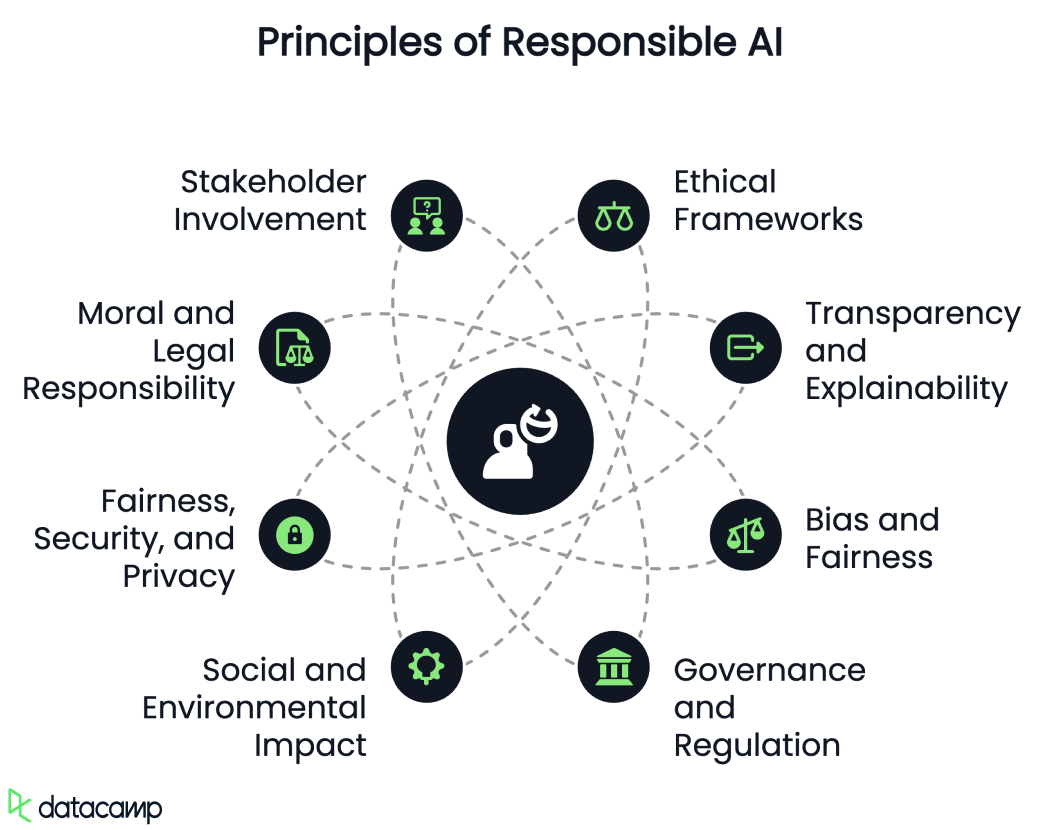

Ethische Rahmenbedingungen

Verantwortungsvolle KI betont die Verwendung ethischer Rahmenbedingungen, um Rechenschaftspflicht, Verantwortung und Transparenz in KI-Systemen zu gewährleisten. Dazu gehört auch die Auseinandersetzung mit Themen wie Privatsphäre, Autonomie und Befangenheit.

Transparenz und Erklärbarkeit

Die Transparenz von KI-Algorithmen und Entscheidungsprozessen ist entscheidend für den Aufbau von Vertrauen unter den Beteiligten. Erklärbare KI (XAI) zielt darauf ab, Modelle zu erstellen, die interpretierbar und verständlich sind und so Transparenz und Vertrauen fördern.

Vorurteile und Fairness

Verantwortungsvolle KI zielt darauf ab, Vorurteile in KI-Algorithmen zu erkennen und zu korrigieren, um gerechte Entscheidungen zu fördern. Dazu gehört die Verwendung vielfältiger und inklusiver Datensätze, um diskriminierende Ergebnisse zu verhindern.

Wenn du mehr über Voreingenommenheit in der KI erfahren möchtest, hör dir diesen Podcast auf Fighting for Algorithmic Justice mit Dr. Joy Buolamwini.

Governance und Regulierung

Die Entwicklung von Standards und Rahmenwerken für KI-Governance ist wichtig, um den verantwortungsvollen Einsatz von KI zu steuern. Dazu gehört auch die Entwicklung strukturierter Ansätze zur Risikominderung auf verschiedenen Ebenen, von einzelnen Forschern bis hin zu staatlichen Vorschriften.

Soziale und ökologische Auswirkungen

Verantwortungsvolle KI berücksichtigt die breiteren sozioökonomischen und ökologischen Auswirkungen von KI, wie z.B. ihre Auswirkungen auf Beschäftigung, Ungleichheit und Ressourcenverbrauch und ihr Potenzial, unfaire digitale Märkte oder Umweltschäden durch die Nutzung von Ressourcen zu verursachen.

Fairness, Sicherheit und Privatsphäre

Die Die Bemühungen der Europäischen Kommission Die Bemühungen der Europäischen Kommission, KI zu regulieren, unterstreichen die Bedeutung von Fairness, Sicherheit, Datenschutz, Erklärbarkeit, Schutz und Reproduzierbarkeit als Bestandteile verantwortungsvoller KI.

Moralische und rechtliche Verantwortung

Bei Diskussionen über verantwortungsvolle KI geht es oft um moralische Verantwortung, die kausale und epistemische Bedingungen umfasst. Das bedeutet, dass KI-Aktionen zu Ergebnissen führen sollten und dass sich die Agenten der moralischen Konsequenzen bewusst sein sollten. Rechtliche Rahmenbedingungen befassen sich auch mit der Verantwortlichkeit, Haftung und Schuldzuweisung für KI-Systeme.

Einbeziehung von Stakeholdern

Ein verantwortungsvoller KI-Rahmen beinhaltet oft, dass alle Beteiligten zur Verantwortung gezogen werden, einschließlich der Entwickler, Nutzer und möglicherweise der KI-Systeme selbst.

Alternative Taxonomien für verantwortungsvolle KI-Prinzipien in der Wissenschaft

Im akademischen Bereich sind einige der am meisten systematischen Überprüfungen von KI-Ethikgrundsätzen zu etwas unterschiedlichen Taxonomien geführt, zum Beispiel, Jobin et al. 84 ethische Richtlinien überprüft und 11 Grundsätze vorgeschlagen:

- Transparenz

- Gerechtigkeit und Fairness

- Unantastbarkeit

- Verantwortung

- Datenschutz

- Wohltätigkeit

- Freiheit und Autonomie

- Vertrauen

- Würdigkeit

- Nachhaltigkeit

- Solidarität

Natürlich gab es große Unterschiede in der Auslegung dieser Grundsätze und in der Art und Weise, wie sie in den Empfehlungen umgesetzt werden sollten. Sie stellten jedoch einige Anzeichen für eine Konvergenz bei fünf Kernprinzipien fest:

- Transparenz

- Gerechtigkeit und Fairness

- Unantastbarkeit

- Verantwortung

- Datenschutz

Wie auch immer, andere Befürworter schlagen vor, dass die Vielzahl der ethischen KI-Rahmenwerke in nur fünf Meta-Prinzipien zusammengefasst werden kann:

- Respekt vor der Autonomie

- Wohltätigkeit

- Unantastbarkeit

- Gerechtigkeit

- Erklärbarkeit

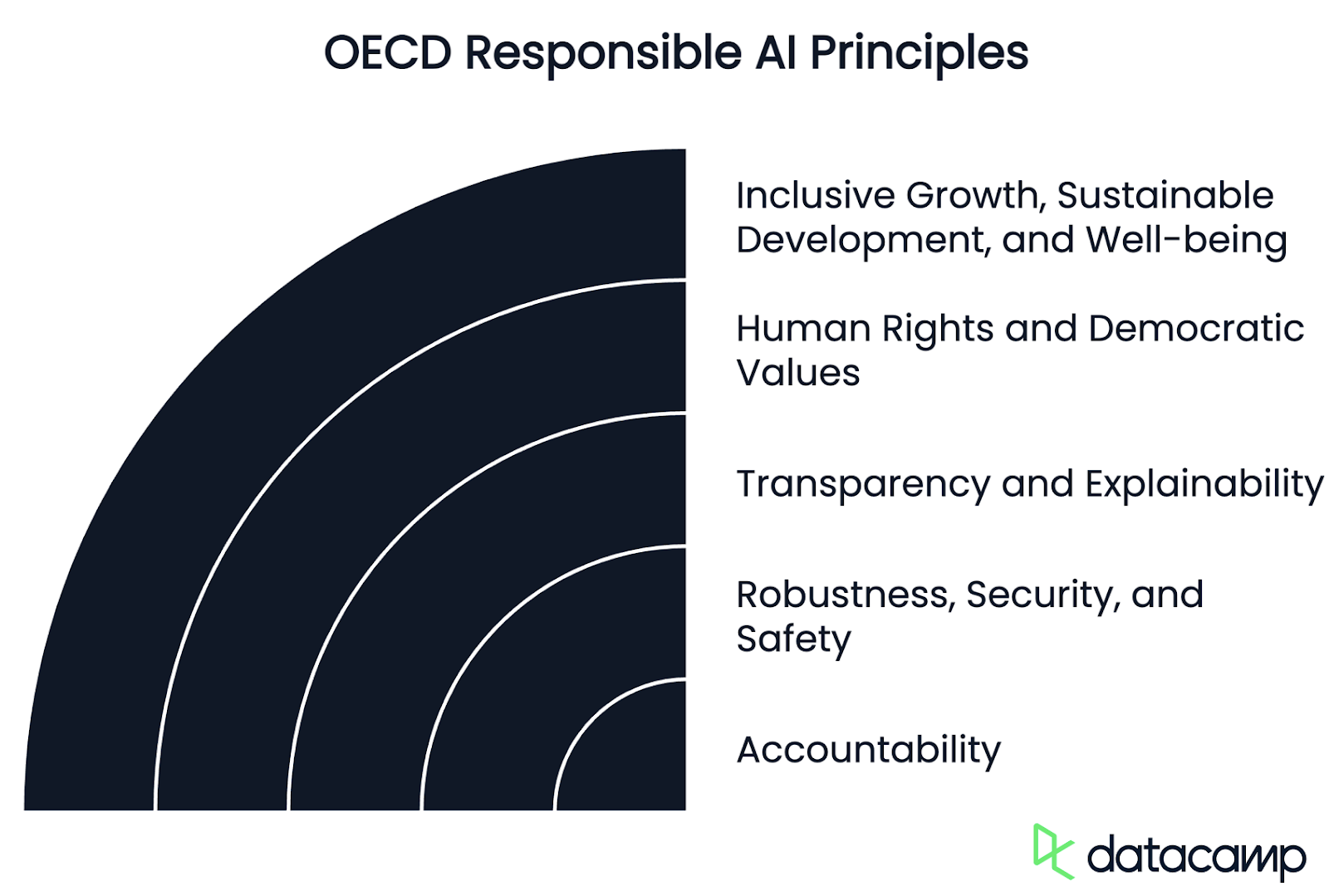

OECD-Prinzipien für verantwortungsvolle KI

Auch internationale Organisationen haben sich aktiv an den weltweiten Diskussionen darüber beteiligt, wie diese Definitionen zu politischen und Harmonisierungszwecken gestaltet werden.

Die Organisation für wirtschaftliche Zusammenarbeit und Entwicklung (OECD) - bei der ich als AI-Experte für Risiken und Rechenschaftspflicht sowie für die Überwachung von Vorfällen zuständig bin, hat eine eine umfassende Liste von Prinzipien für vertrauenswürdige KI vorgelegt.

Diese Grundsätze fördern den Einsatz von KI, die innovativ und vertrauenswürdig ist und die Menschenrechte und demokratischen Werte respektiert. Ursprünglich Im Jahr 2019 wurdenwurden sie im Mai 2024 aktualisiert um sicherzustellen, dass sie angesichts neuer technologischer und politischer Entwicklungen robust und zweckmäßig bleiben.

Heute ist die Europäische Union, der Europarat, die Vereinigten Staaten, die Vereinten NationenDie Europäische Union, der Europarat, die Vereinigten Staaten, die Vereinten Nationen und andere Länder verwenden die Definition der OECD für ein KI-System und den nachstehenden Lebenszyklus in ihren Rechts- und Verwaltungsvorschriften und Leitlinien.

Kurz gesagt handelt es sich dabei um wertebasierte Grundsätze, die in die folgenden Kategorien eingeteilt werden:

Inklusives Wachstum, nachhaltige Entwicklung und Wohlstand

KI-Akteure sollten sich proaktiv für einen verantwortungsvollen Umgang mit vertrauenswürdiger KI engagieren, um positive Ergebnisse für die Menschen und den Planeten zu erzielen, wie z. B. die Erweiterung menschlicher Fähigkeiten und die Steigerung der Kreativität, die Förderung der Eingliederung unterrepräsentierter Bevölkerungsgruppen, den Abbau wirtschaftlicher, sozialer, geschlechtsspezifischer und anderer Ungleichheiten und den Schutz der natürlichen Umwelt, um so integratives Wachstum, Wohlbefinden, nachhaltige Entwicklung und ökologische Nachhaltigkeit zu fördern.

Menschenrechte und demokratische Werte, einschließlich Fairness und Privatsphäre

KI-Akteure sollten während des gesamten Lebenszyklus von KI-Systemen die Rechtsstaatlichkeit, die Menschenrechte und demokratische, menschenzentrierte Werte achten. Dazu gehören Nichtdiskriminierung und Gleichheit, Freiheit, Würde, Autonomie des Einzelnen, Privatsphäre und Datenschutz, Vielfalt, Fairness, soziale Gerechtigkeit und international anerkannte Arbeitnehmerrechte.

Transparenz und Erklärbarkeit

KI-Akteure sollten sich zu Transparenz und verantwortungsvoller Offenlegung ihrer Systeme verpflichten. Zu diesem Zweck sollten sie aussagekräftige Informationen liefern, die dem Kontext angemessen sind und dem Stand der Technik entsprechen, um ein allgemeines Verständnis von KI-Systemen, einschließlich ihrer Fähigkeiten und Grenzen, zu fördern.

Robustheit, Sicherheit und Schutz

KI-Systeme sollten während ihres gesamten Lebenszyklus robust, sicher und geschützt sein, so dass sie bei normaler Nutzung, vorhersehbarer Nutzung oder Missbrauch oder anderen ungünstigen Bedingungen angemessen funktionieren und keine unangemessenen Sicherheitsrisiken bergen.

Rechenschaftspflicht

KI-Akteure sollten für das ordnungsgemäße Funktionieren von KI-Systemen und für die Einhaltung der oben genannten Grundsätze verantwortlich sein, je nach ihrer Rolle, dem Kontext und dem Stand der Technik. Zu diesem Zweck sollten die KI-Akteure die Rückverfolgbarkeit sicherstellen, auch in Bezug auf Datensätze, Prozesse und Entscheidungen, die während des gesamten Lebenszyklus des KI-Systems getroffen werden. Diese Nachvollziehbarkeit sollte es ermöglichen, die Ergebnisse des KI-Systems und die Antworten auf Anfragen zu analysieren, die dem Kontext angemessen sind und dem Stand der Technik entsprechen.

ISO-Prinzipien für verantwortungsvolle KI

Auf der anderen Seite, für die Internationalen Normungsorganisation (ISO) gibt es drei Schlüsselbereiche, die berücksichtigt werden müssen, damit ein KI-System vertrauenswürdig ist:

- Fütterung mit guten, vielfältigen Daten

- Sicherstellen, dass die Algorithmen mit dieser Vielfalt umgehen können

- Und das Testen der resultierenden Software auf falsche Beschriftungen oder schlechte Korrelationen

Die Organisation stellt die folgenden Richtlinien zur Verfügung, um dies zu erreichen:

- Entwirf für Menschen, indem du eine Vielzahl von Nutzern und Anwendungsszenarien berücksichtigst und dieses Feedback vor und während des Lebenszyklus der KI einbeziehst.

- Nutze mehrere Messgrößen, um die Schulung und Überwachung zu bewerten, z. B. Nutzerumfragen, allgemeine Leistungsindikatoren für das System sowie Falsch-Positiv- und Falsch-Negativ-Raten, die für verschiedene Untergruppen ermittelt werden.

- Überprüfe die Rohdaten auf Fehler (z. B. fehlende oder unausgerichtete Werte, falsche Beschriftungen, Stichproben), Trainingsverzerrungen (z. B. Datenerhebungsmethoden oder inhärente soziale Vorurteile) und Redundanzen - all das ist wichtig, um die RAI-Prinzipien der Fairness, Gerechtigkeit und Genauigkeit in KI-Systemen zu gewährleisten.

- Verstehe die Grenzen eines jeden Modells, um Verzerrungen zu verringern, die Verallgemeinerung zu verbessern und eine zuverlässige Leistung in kinetischen Szenarien zu gewährleisten, und kommuniziere diese an Entwickler und Nutzer.

- Teste dein Modell kontinuierlich anhand von verantwortungsvollen KI-Prinzipien, um sicherzustellen, dass es die Leistung in der realen Welt und das Feedback der Nutzer/innen angemessen berücksichtigt, um sowohl kurz- als auch langfristige Lösungen für die Probleme zu verbessern.

Die Meinung von Branchenführern zu verantwortungsvoller KI

Wenn wir uns konkrete Beispiele von Branchenführern ansehen, können wir deutliche Kontraste in der Nomenklatur und den Taxonomien beobachten, mit unterschiedlichen Verständnissen der Konzepte von RAI, vertrauenswürdiger KI, ethischer KI und anderen verschiedenen Interpretationen, die für ihre Tätigkeiten oder Anwendungen geprägt wurden.

Microsoft

Microsoft, steht zum Beispiel zu den folgenden Grundsätzen für verantwortungsvolle KI:

- Fairness

- Verlässlichkeit und Sicherheit

- Datenschutz und Sicherheit

- Eingliederung

- Transparenz und Rechenschaftspflicht

Apple

Auf der anderen Seite, Apple behauptet, dass seine KI auf der Grundlage seiner Grundwerte und bahnbrechenden Datenschutzinnovationen entwickelt wurde und hat eine Reihe von verantwortungsvollen KI-Prinzipien aufgestellt, um die Entwicklung von KI-Tools und die ihnen zugrunde liegenden Modelle zu steuern:

- Befähige die Nutzer mit intelligenten Tools: Identifizierung von Bereichen, in denen KI verantwortungsbewusst eingesetzt werden kann, um Werkzeuge für bestimmte Nutzerbedürfnisse zu schaffen, wobei zu respektieren ist, wie die Nutzer diese Werkzeuge zur Erreichung ihrer Ziele einsetzen wollen.

- Benutzer vertreten: Wir bauen sehr persönliche Produkte mit dem Ziel, Nutzerinnen und Nutzer rund um den Globus authentisch zu repräsentieren, um Stereotypen und systemische Vorurteile in KI-Tools und -Modellen zu vermeiden.

- Gestalte mit Sorgfalt: Wir treffen in jeder Phase unseres Prozesses Vorsichtsmaßnahmen, einschließlich Design, Modelltraining, Funktionsentwicklung und Qualitätsbewertung, um zu erkennen, wie unsere KI-Tools missbraucht werden oder zu potenziellem Schaden führen können.

- Schütze die Privatsphäre: Dies erreichen wir durch eine leistungsstarke geräteinterne Verarbeitung und eine bahnbrechende Infrastruktur, die sicherstellt, dass sie beim Training ihrer Basismodelle keine privaten Daten oder Nutzerinteraktionen unserer Nutzerinnen und Nutzer verwenden.

Nvidia

Nvidia Nvidia nennt es vertrauenswürdige KI und ist der Meinung, dass KI die Vorschriften zum Schutz der Privatsphäre und des Datenschutzes respektieren, sicher und geschützt arbeiten, transparent und verantwortungsvoll sein, unerwünschte Vorurteile und Diskriminierung vermeiden und ihre vier Kernprinzipien signalisieren sollte:

- Datenschutz

- Sicherheit und Schutz

- Transparenz

- Nicht-Diskriminierung

Etwas unterschiedlich, Google spricht über "Ziele für KI-Anwendungen" zu sein:

- Sei gesellschaftlich nützlich.

- Vermeide es, unfaire Vorurteile zu schaffen oder zu verstärken.

- gebaut und auf Sicherheit geprüft werden.

- Sei den Menschen gegenüber rechenschaftspflichtig.

- Berücksichtige die Grundsätze des Datenschutzes.

- Halte hohe Standards für wissenschaftliche Exzellenz ein.

- in Übereinstimmung mit diesen Grundsätzen zur Verfügung gestellt werden, um potenziell schädliche oder missbräuchliche Anwendungen zu begrenzen.

Fazit

Es gibt noch keinen Konsens darüber, was genau verantwortungsvolle KI, vertrauenswürdige KI, ethische KI, sichere KI und sichere KI ausmacht und ob es sich dabei um eigenständige Begriffe handelt oder ob sie miteinander vereinbar sind. Es ist jedoch ermutigend zu sehen, dass die Elemente dieser Begriffe in der Wissenschaft, in internationalen Organisationen und in der Industrie weit verbreitet sind und - zumindest in der Theorie - auf denselben Grundprinzipien beruhen.

Im Großen und Ganzen können wir sagen, dass RAI eine aufstrebende Disziplin ist, die sicherstellen soll, dass die Entwicklung, der Einsatz und die Nutzung von künstlicher Intelligenz auf eine menschenfreundliche Art und Weise erfolgt, die in der Praxis sowohl ethisch als auch rechtlich mit den grundlegenden Menschenrechten in Einklang steht.

Jimena Viveros ist derzeit Stabschefin und leitende Rechtsberaterin von Richterin Loretta Ortiz am Obersten Gerichtshof Mexikos. Zuvor bekleidete sie nationale Führungspositionen im Bundesjustizrat, im Sicherheitsministerium und im Finanzministerium, wo sie die Position der Generaldirektorin innehatte. Jimena ist Juristin und KI-Expertin und verfügt über einen breiten und vielfältigen internationalen Hintergrund. Sie steht kurz vor dem Abschluss ihrer Doktorarbeit, die sich mit den Auswirkungen von KI und autonomen Waffen auf das internationale Friedens- und Sicherheitsrecht und die internationale Sicherheitspolitik befasst und konkrete Vorschläge für eine globale Governance aus verschiedenen rechtlichen Perspektiven liefert. Ihre umfangreiche Arbeit auf dem Gebiet der KI und anderen Rechtsgebieten wurde vielfach veröffentlicht und anerkannt.