Vous travaillez dans le domaine de l'intelligence artificielle (IA) ou de l'apprentissage machine (ML) et vous avez besoin d'un moteur de synthèse vocale ? Dans ce cas, vous aurez besoin d'une solution à code source ouvert. Voyons comment fonctionnent les moteurs de synthèse vocale (TTS) et quelles sont les meilleures options open-source.

Dans ce guide simple, je vous en dirai plus sur les moteurs TTS et vous présenterai quelques-unes des meilleures options disponibles.

Qu'est-ce qu'un moteur de synthèse vocale ?

Avant de commencer la liste, définissons rapidement ce qu'est un moteur de synthèse vocale.

Un moteur de synthèse vocale est un logiciel qui convertit un texte écrit en mots parlés. Il utilise le traitement du langage naturel (NLP) pour analyser et interpréter le texte écrit et utilise ensuite un synthétiseur vocal pour générer une parole semblable à celle d'un être humain.

Les moteurs TTS sont couramment utilisés dans des applications telles que les assistants virtuels, les systèmes de navigation et les outils d'accessibilité.

Vous souhaitez travailler avec la PNL ? Le cursus de compétences Traitement du langage naturel en Python de DataCamp vous permettra de mettre à niveau votre savoir-faire technique.

Qu'est-ce qu'un moteur de synthèse vocale open-source ?

Les moteurs de synthèse vocale (TTS) open source sont des outils précieux pour convertir un texte écrit en mots parlés, permettant des applications dans le domaine de l'accessibilité, des réponses vocales automatisées et des assistants virtuels, entre autres.

Ils sont généralement développés par une communauté de développeurs et publiés sous une licence open-source, permettant à quiconque d'utiliser, de modifier et de distribuer le logiciel librement.

Les 7 meilleurs moteurs de synthèse vocale (TTS) open source

Voici quelques moteurs TTS open-source bien connus :

1. MaryTTS (Architecture d'interaction multimodale)

Une architecture flexible et modulaire pour la construction de systèmes TTS, comprenant un outil de construction de voix pour générer de nouvelles voix à partir de données audio enregistrées.

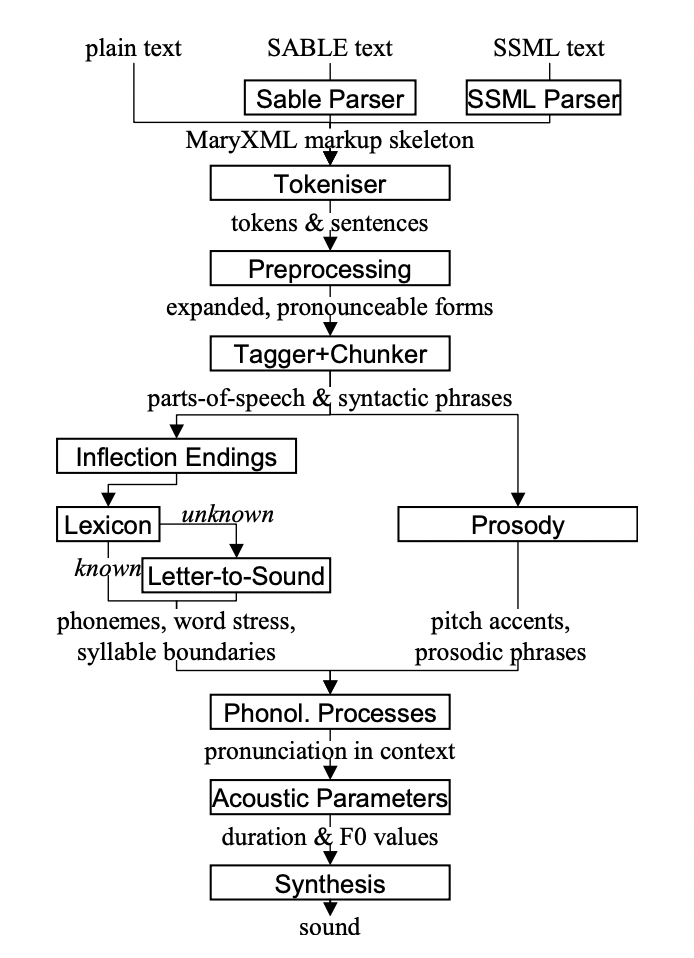

Voici une vue d'ensemble de l'architecture de ce moteur :

Source : MaryTTS GitHub

Cette architecture comprend des composants de base tels que

- Un analyseur de langage de balisage : Composant qui lit et interprète le langage de balisage utilisé dans le champ de texte.

- Un processeur : Composant qui prend en charge le texte analysé et effectue toutes les actions nécessaires, telles que la conversion en parole ou la génération d'une sortie visuelle.

- Un synthétiseur : Composant responsable de la production du résultat final, qu'il soit audio ou visuel. Il permet d'ajouter des caractéristiques de la parole, telles que l'intonation et l'inflexion, afin de rendre la sortie plus naturelle.

Pour : L'architecture de MaryTTS est hautement personnalisable, ce qui permet aux développeurs de créer leurs propres analyseurs, processeurs et synthétiseurs pour répondre à leurs besoins spécifiques. Cela permet également d'intégrer le logiciel dans différentes plates-formes et applications.

Cons : En raison de sa nature hautement personnalisable, il peut y avoir une courbe d'apprentissage pour les développeurs qui ne sont pas familiers avec le langage de balisage et la technologie de synthèse vocale.

2. eSpeak

synthétiseur vocal logiciel compact à source ouverte pour l'anglais et d'autres langues, eSpeak produit une parole claire et intelligible dans un large éventail de langues. Il est connu pour sa simplicité et son faible encombrement.

synthétiseur vocal logiciel compact à source ouverte pour l'anglais et d'autres langues, eSpeak produit une parole claire et intelligible dans un large éventail de langues. Il est connu pour sa simplicité et son faible encombrement.

eSpeak peut être exécuté sur différentes plateformes, notamment Windows, Linux, macOS et Android.

Pour : Facile à utiliser, il prend en charge de nombreuses langues et voix.

Cons : Fonctionnalités et options de personnalisation limitées, et écrites en C.

Lien : GitHub

3. Système de synthèse vocale pour les festivals

Développé par l'université d'Édimbourg, Festival offre un cadre général pour la construction de systèmes de synthèse vocale et comprend des exemples de différents modules. Il est largement utilisé à des fins de recherche et d'éducation.

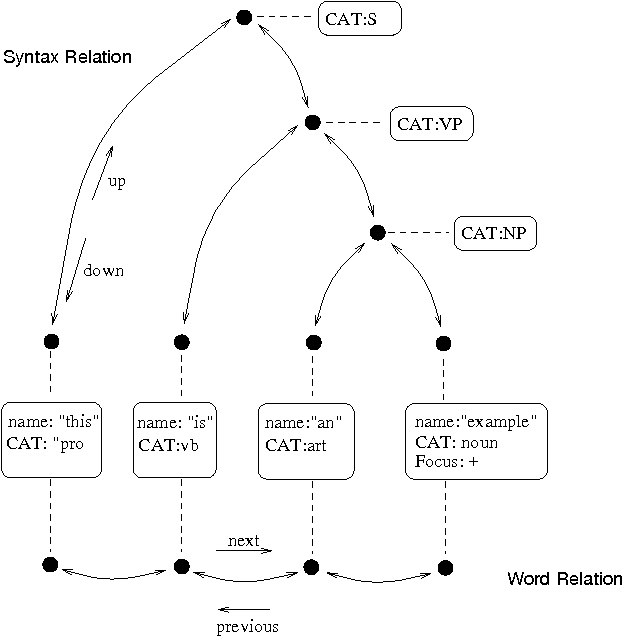

La figure ci-dessous montre la structure générale de l'énoncé de Festival. Il s'agit d'une forme d'arbre avec des liens entre les nœuds montrant une relation.

Pour : Hautement personnalisable, il convient à des fins de recherche.

Cons : Difficile à utiliser pour les débutants, nécessite des connaissances en codage.

Lien : GitHub

4. Mimic

Source : Mimic

Développé par Mycroft AI, Mimic est capable de produire une parole très naturelle. Il comprend Mimic 1, basé sur le système de synthèse vocale du Festival, et Mimic 2, qui utilise des réseaux neuronaux profonds pour la synthèse vocale.

Pour : Il propose des méthodes de synthèse vocale traditionnelles et modernes et prend en charge plusieurs langues.

Cons : Documentation limitée.

Lien : GitHub

5. Mozilla TTS

Un moteur TTS basé sur l'apprentissage profond qui vise à créer une synthèse vocale plus naturelle et plus proche de l'humain. Il s'appuie sur des architectures de réseaux neuronaux modernes, en particulier des modèles de séquence à séquence.

Pour : Il utilise une technologie avancée pour une parole plus naturelle et son utilisation est gratuite.

Cons : Soutien linguistique limité.

Lien : GitHub

6. Tacotron 2 (par NVIDIA)

Bien qu'il ne s'agisse pas d'un moteur à proprement parler, Tacotron 2 est un modèle d'architecture de réseau neuronal permettant de générer de la parole naturelle. Des implémentations libres de Tacotron 2 sont disponibles, et il a inspiré de nombreux développements dans le domaine de la technologie de la synthèse vocale.

Ce système permet aux utilisateurs de synthétiser la parole à partir de transcriptions brutes sans aucune information supplémentaire sur la prosodie.

Pour : Développé par NVIDIA, il peut être utilisé comme modèle de réseau neuronal.

Cons : La mise en œuvre nécessite quelques connaissances techniques.

Bien que ce moteur puisse être techniquement difficile à maîtriser, vous pouvez toujours vous familiariser avec les modèles de réseaux neuronaux apparentés grâce à des ressources en ligne. Vous pouvez par exemple consulter notre guide des réseaux neuronaux ou notre tutoriel sur les réseaux neuronaux.

Lien : GitHub

7. ESPnet-TTS

Faisant partie du projet ESPnet, ce moteur TTS est conçu pour le traitement de la parole de bout en bout, y compris la reconnaissance et la synthèse vocales. Il utilise des techniques modernes d'apprentissage profond pour générer de la parole.

Pour : Moderne et flexible, il prend en charge plusieurs langues.

Cons : La mise en œuvre nécessite quelques connaissances techniques.

Lien : GitHub

Comparaison des moteurs TTS open-source

|

Système TTS |

Architecture/Technologie |

Pour |

Cons |

Cas d'utilisation |

|

MaryTTS |

Architecture modulaire avec des composants personnalisables |

Intégration flexible et hautement personnalisable |

Courbe d'apprentissage pour les développeurs |

Idéal pour les développeurs et les chercheurs qui créent des applications TTS personnalisées, notamment dans le cadre de projets éducatifs et d'accessibilité. |

|

eSpeak |

Synthétiseur logiciel compact à source ouverte |

Simple, compatible avec de nombreuses langues |

Fonctionnalités et personnalisation limitées, écrites en C |

Convient aux applications nécessitant un large éventail de langues et un minimum de ressources système, telles que les systèmes embarqués ou les technologies d'assistance. |

|

Système de synthèse vocale pour les festivals |

Cadre général et exemples de modules |

Hautement personnalisable, adapté à la recherche |

Difficile pour les débutants, nécessite des connaissances en codage |

Idéal pour les projets de recherche et de développement universitaires nécessitant une personnalisation poussée et des configurations expérimentales. |

|

Mimic |

Synthèse vocale traditionnelle et basée sur un réseau neuronal |

Sonorité naturelle, prise en charge de plusieurs langues |

Documentation limitée |

Il convient parfaitement aux projets nécessitant une synthèse vocale de haute qualité, tels que les assistants virtuels ou les applications multimédias. |

|

Mozilla TTS |

Modèles séquence à séquence basés sur l'apprentissage profond |

Technologie avancée pour une parole plus naturelle, libre d'utilisation |

Soutien linguistique limité |

Idéal pour les projets open-source et les développeurs intéressés par l'utilisation de techniques d'apprentissage profond de pointe pour un TTS à la sonorité naturelle. |

|

Tacotron 2 (NVIDIA) |

Modèle de réseau neuronal pour la génération de parole naturelle |

Bon comme modèle de réseau neuronal |

Connaissances techniques requises |

Parfait pour la recherche et le développement dans le domaine de la synthèse vocale basée sur les réseaux neuronaux, il offre une base pour des applications TTS innovantes. |

|

ESPnet-TTS |

Traitement de la parole de bout en bout grâce à l'apprentissage profond |

Moderne et flexible, prend en charge plusieurs langues |

Connaissances techniques requises |

Destiné aux développeurs et aux chercheurs travaillant sur des projets avancés de synthèse et de reconnaissance vocales, en particulier ceux qui nécessitent une prise en charge multilingue. |

Applications des moteurs TTS

Voici quelques exemples d'utilisation des moteurs TTS mentionnés ci-dessus :

1. Assistants virtuels

L'utilisation de moteurs de synthèse vocale comme ceux mentionnés ci-dessus permet de créer des assistants virtuels. Ces assistants virtuels peuvent être similaires aux assistants vocaux d'entreprise tels que Siri et Alexa.

Certains d'entre eux peuvent même servir d'aide à l'accessibilité pour les utilisateurs souffrant de déficiences visuelles, en leur permettant d'entendre un texte écrit au lieu de le lire.

2. Réponses vocales automatiques avec l'IA

Les moteurs TTS sont également utilisés dans les systèmes de réponse automatisés, tels que les assistants téléphoniques ou les chatbots. Ces moteurs peuvent lire des réponses basées sur des invites et des interactions spécifiques, offrant ainsi aux utilisateurs une expérience plus humaine.

3. Voix off vidéo/image

La technologie de synthèse vocale peut également générer des voix off pour des vidéos ou des images, ce qui permet d'obtenir un contenu plus dynamique et plus attrayant.

Par exemple, le moteur eSpeak peut être utilisé pour ajouter des voix off à des vidéos dans différentes langues, ce qui les rend plus accessibles et plus attrayantes pour un public plus large.

Ceci est particulièrement utile pour les applications dans les secteurs du marketing, de l'apprentissage en ligne et du divertissement.

Défis liés à l'utilisation de moteurs TTS open-source

L'utilisation d'un logiciel libre peut s'avérer rentable et offre une plus grande souplesse de personnalisation. Cependant, l'utilisation de ces moteurs présente certains défis :

1. Soutien linguistique limité

De nombreux moteurs TTS open-source ont une prise en charge linguistique limitée par rapport aux solutions commerciales.

Cette limitation peut constituer un obstacle pour les utilisateurs qui ont besoin d'un TTS dans des langues moins courantes.

2. Personnalisation et mise en œuvre

La personnalisation et la mise en œuvre de la plupart des moteurs TTS à code source ouvert nécessitent des connaissances en matière de codage. Il est donc difficile pour les acteurs habituels de l'entreprise de les utiliser sans assistance technique.

Cela peut représenter un défi pour les personnes ou les organisations qui n'ont pas d'expertise technique.

3. Considérations sur les coûts

Bien que les moteurs à code source ouvert soient gratuits, leur personnalisation et leur mise en œuvre peuvent nécessiter des ressources et du temps supplémentaires.

En outre, un ingénieur ou un analyste possédant le savoir-faire nécessaire en matière de moteurs TTS doit être engagé ou formé.

Par conséquent, dans certains cas, les solutions commerciales peuvent être plus rentables à long terme.

4. Assistance et documentation

Disposant de ressources limitées et étant menés par la communauté, les projets à code source ouvert ne disposent pas toujours d'une assistance et d'une documentation complètes.

Source : Documentation ESPnet

Cela peut compliquer la tâche des utilisateurs qui doivent résoudre des problèmes ou apprendre à utiliser le moteur de manière efficace.

Toutefois, à mesure que ces moteurs gagnent en popularité et que de plus en plus de développeurs y contribuent, ce défi pourrait s'atténuer au fil du temps.

5. Sécurité et performance

Étant donné que les moteurs à code source ouvert sont développés et entretenus par une communauté, il peut y avoir des problèmes de sécurité et de performance.

Toutefois, ces risques peuvent être atténués par un contrôle et une surveillance appropriés du code et des mises à jour du moteur.

En outre, le choix de projets open-source fiables et réputés peut contribuer à atténuer ces préoccupations.

Choisir le meilleur moteur pour l'intégration TTS

Voyons maintenant comment choisir le bon moteur pour votre modèle de synthèse vocale.

Voici quelques facteurs à prendre en considération :

1. Objectif et cas d'utilisation

Commencez par identifier votre cas d'utilisation spécifique et l'objectif de l'utilisation de TTS. Comprenez quelles sont les fonctionnalités et les options de personnalisation nécessaires à votre projet, puis choisissez un moteur en conséquence.

2. Soutien linguistique

Si vous avez besoin de la prise en charge d'une langue particulière ou de plusieurs langues, veillez à choisir un moteur qui offre de telles capacités.

Dans ce cas, le moteur eSpeak peut être une meilleure option pour vous.

3. Coût et budget

Tenez compte de votre budget et de vos ressources avant de choisir un moteur. Si les options libres peuvent être rentables à long terme, elles peuvent nécessiter des ressources supplémentaires pour la personnalisation et la mise en œuvre.

4. Expertise technique

Évaluez le niveau de compétence de votre équipe ou de vous-même lorsque vous travaillez avec des moteurs TTS. Si vous ne disposez pas d'une expertise technique, vous pouvez opter pour une solution commerciale qui offre des interfaces conviviales et une assistance.

5. Performance et qualité

Veillez à ce que le moteur que vous choisissez fournisse une sortie vocale de haute qualité et à la sonorité naturelle. Vous pouvez également tester différents moteurs pour déterminer celui qui correspond le mieux au niveau de performance que vous souhaitez atteindre.

Réflexions finales

La technologie de synthèse vocale a beaucoup progressé pour fournir des résultats vocaux plus naturels et plus proches de ceux de l'homme. Grâce aux nombreuses options open-source disponibles, il est désormais plus accessible et plus rentable d'intégrer le TTS dans diverses applications.

Cependant, avant de prendre une décision, vous devrez également vous attendre à certaines limitations et à certains défis liés à l'utilisation de moteurs à code source ouvert. J'espère que ce guide vous a permis de mieux comprendre les moteurs TTS et qu'il vous a aidé à choisir celui qui répond le mieux à vos besoins.

Vous cherchez des moyens d'inverser le processus ? Consultez notre cours de traitement du langage parlé en Python.

Je m'appelle Austin, je suis blogueur et rédacteur technique et j'ai des années d'expérience en tant que data scientist et data analyst dans le domaine de la santé. J'ai commencé mon parcours technologique avec une formation en biologie et j'aide maintenant les autres à faire la même transition grâce à mon blog technologique. Ma passion pour la technologie m'a conduit à écrire pour des dizaines d'entreprises SaaS, inspirant les autres et partageant mes expériences.