Cours

Dans ce tutoriel, je vous propose une comparaison détaillée de trois frameworks multi-agents de référence : CrewAI, LangGraph et AutoGen. Au cours de l’année écoulée, l’intérêt pour les systèmes multi-agents a fortement augmenté, et pour de bonnes raisons. Avec la maturité de l’IA, concevoir des applications autour d’un seul agent intelligent atteint vite ses limites. Les développeurs découvrent qu’orchestrer plusieurs agents, chacun doté de rôles et responsabilités spécifiques, permet d’obtenir des solutions plus adaptatives et fiables.

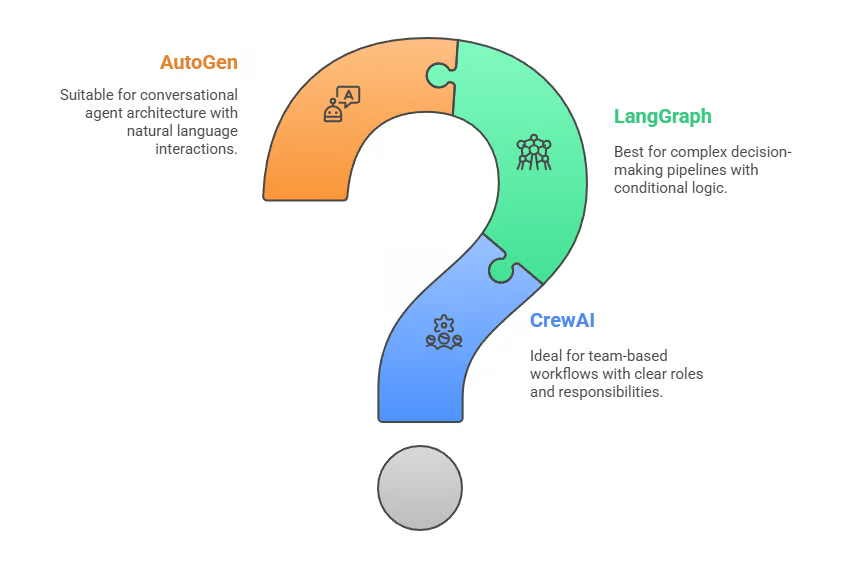

L’enjeu de cette comparaison tient à la façon dont chaque framework aborde la coordination multi-agent. CrewAI adopte un modèle fondé sur les rôles, inspiré des organisations réelles, LangGraph privilégie une approche de workflow en graphe, et AutoGen met l’accent sur la collaboration conversationnelle. Chaque framework apporte sa philosophie de conception, ses atouts et ses compromis.

Mon objectif est de mettre en lumière ces différences à travers des explications pratiques et des exemples concis, afin que vous puissiez choisir en connaissance de cause celui qui convient à votre projet.

Si vous débutez dans les applications d’IA, nous vous recommandons l’un de nos cours, par exemple AI Fundamentals, Developing AI Applications ou Retrieval Augmented Generation (RAG) with LangChain.

Qu’est-ce qu’un agent d’IA ?

Avant d’entrer dans le détail des frameworks, posons le cadre. Dans les frameworks multi-agents, un agent est bien plus qu’un simple « enveloppe de prompt » autour d’un grand modèle de langage. C’est une entité autonome avec un rôle défini, des outils à sa disposition, une mémoire accessible et des comportements préétablis. Les agents peuvent travailler en autonomie ou collaborer pour résoudre des problèmes trop complexes pour un seul agent.

Je vois un agent à la fois comme un décideur et un collaborateur. Il reçoit une entrée, raisonne, exécute des actions (parfois via des outils externes) et communique avec d’autres agents si nécessaire.

Par exemple, un agent peut se charger de la collecte de données, un autre de l’analyse, et un troisième de la restitution. Ensemble, ils forment un système d’intelligence collaborative.

Toutefois, les agents ne sont pas toujours la meilleure option. Si votre flux est linéaire — par exemple, appeler une API unique puis afficher un résultat — un simple script ou un seul agent peut suffire. Les systèmes multi-agents brillent quand il faut coordonner, spécialiser ou s’adapter dynamiquement.

Comprendre les frameworks d’IA multi-agents

Les frameworks multi-agents étendent le paradigme mono-agent vers des systèmes qui favorisent la collaboration, la délégation et des workflows adaptatifs. Ils concrétisent l’intelligence collaborative, où des agents spécialisés sur une partie d’un problème communiquent pour atteindre un objectif global.

Cette approche reflète le fonctionnement des équipes en entreprise, avec des spécialistes coordonnés par une couche d’orchestration.

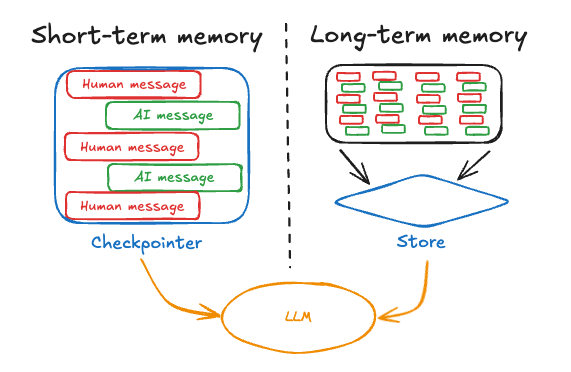

Les composants clés incluent généralement la gestion d’état, les protocoles de communication et les systèmes de mémoire. La mémoire mérite une attention particulière : elle permet aux agents de se souvenir des interactions passées et de décider en connaissance de cause.

La mémoire à court terme conserve le contexte des échanges immédiats. La mémoire à long terme capitalise les expériences et construit des bases de connaissances. La mémoire persistante garantit que les informations importantes survivent aux redémarrages et restent accessibles d’une session à l’autre.

En combinant ces briques, les frameworks multi-agents permettent des architectures souples, capables de traiter des cas allant de l’automatisation de workflows à l’analyse de recherche. Le choix du framework dépendra du degré de contrôle, de flexibilité et de scalabilité requis.

Panorama de CrewAI, LangGraph et AutoGen

Maintenant que nous partageons une même définition des agents et des frameworks multi-agents, présentons brièvement nos trois sujets de comparaison.

CrewAI met l’accent sur la collaboration par rôles, dans une métaphore proche du monde de l’entreprise. Chaque agent dispose d’un rôle, de responsabilités et d’outils, ce qui rend le système intuitif pour des workflows en équipe.

Le framework excelle dans la collaboration orientée tâches, où des rôles clairs amènent une exécution efficace. Sa force : une coordination d’agents intuitive et un support intégré pour les schémas de workflow métier courants.

LangGraph adopte un design de workflow en graphe, où les interactions des agents sont des nœuds d’un graphe orienté. Cette architecture offre une flexibilité exceptionnelle pour des chaînes de décision complexes avec logique conditionnelle, branches et adaptation dynamique.

LangGraph brille quand l’orchestration exige de multiples points de décision et du parallélisme.

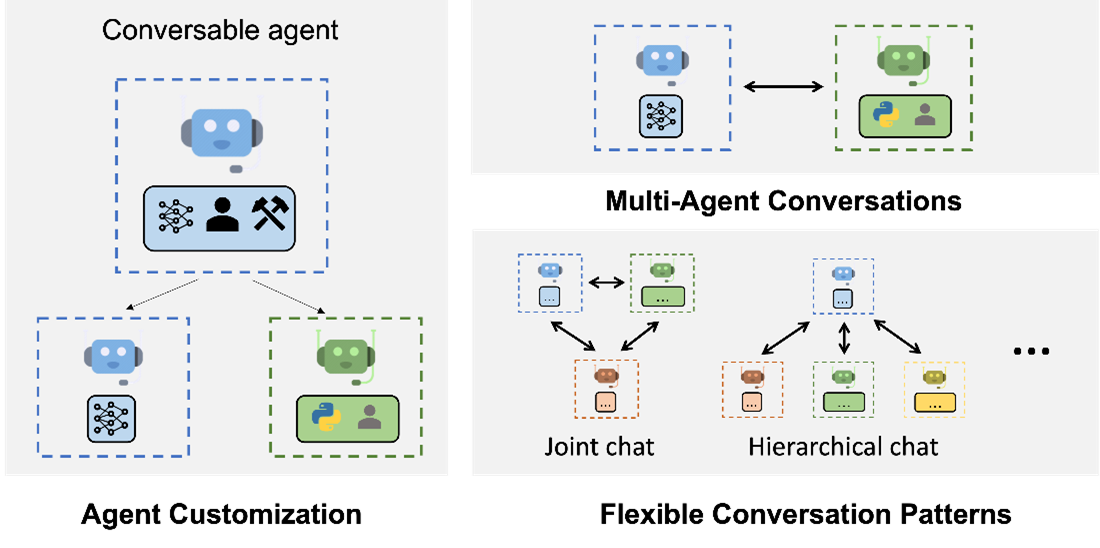

AutoGen s’appuie sur une architecture conversationnelle, avec des interactions en langage naturel et des jeux de rôles dynamiques. Il excelle pour des workflows pilotés par la conversation, où les agents adaptent leurs rôles selon le contexte. Sa force : le prototypage rapide et les scénarios avec humain dans la boucle, où l’interaction en langue naturelle est centrale.

Vue d’ensemble de CrewAI, LangGraph et AutoGen

Comparaison approfondie : CrewAI vs LangGraph vs AutoGen

Chaque framework aborde l’orchestration multi-agent sous un angle différent : CrewAI met l’accent sur l’attribution des rôles, LangGraph sur la structure du workflow et AutoGen sur la conversation.

Ces différences influencent la conception, la gestion et la montée en charge des systèmes ; les comprendre est essentiel avant de choisir.

Décomposons-les selon plusieurs dimensions clés, en commençant par l’architecture.

Différences architecturales

L’architecture est la fondation de chaque framework. CrewAI suit un modèle fondé sur les rôles, où les agents se comportent comme des collaboratrices et collaborateurs avec des responsabilités précises, ce qui facilite la visualisation des workflows en termes de travail d’équipe.

LangGraph, à l’inverse, se concentre sur l’orchestration en graphe : les workflows y sont représentés par des nœuds et des arêtes, pour une exécution hautement modulaire et conditionnelle.

AutoGen adopte une autre voie en modélisant les interactions sous forme de conversations entre agents ou entre agents et humains, pour un flux guidé par le dialogue.

Prise en main

Côté facilité d’usage, CrewAI est très intuitif si vous pensez en termes de rôles et de tâches : vous définissez des agents avec des objectifs, puis vous les laissez collaborer.

LangGraph demande une meilleure maîtrise de la conception de graphes, ce qui ajoute une courbe d’apprentissage mais offre un contrôle accru sur la logique de workflow.

AutoGen est intrinsèquement conversationnel, ce qui facilite les petits projets tout en restant souple pour des développements itératifs.

Outils et intégrations

Côté intégrations, les trois frameworks proposent un large support d’APIs et d’outils externes. CrewAI intègre nativement des services cloud et des outils courants.

LangGraph bénéficie de tout l’écosystème LangChain, avec de nombreuses intégrations aux APIs et systèmes externes.

AutoGen, de son côté, valorise l’usage d’outils dans la conversation et permet l’intervention directe d’humains, ce qui renforce la flexibilité pour des workflows itératifs ou fortement orientés relecture.

Gestion de la mémoire

La prise en charge de la mémoire varie sensiblement. CrewAI propose une mémoire structurée par rôle avec support RAG pour un comportement contextuel des agents.

LangGraph fournit une mémoire fondée sur l’état, avec checkpointing pour assurer la continuité du workflow.

AutoGen mise sur une mémoire conversationnelle, conservant l’historique des dialogues pour des interactions multi-tours. Chaque approche est alignée sur la philosophie du framework.

Sorties structurées

La gestion des sorties structurées diffère également. CrewAI impose une structure via sa logique de rôles : les agents produisent des livrables conformes à leurs responsabilités définies.

LangGraph excelle grâce à ses graphes d’état, qui peuvent faire respecter des formats de sortie et des transitions stricts.

AutoGen, plus axé sur la conversation, génère des sorties flexibles, dont la cohérence varie selon l’orchestration du dialogue.

Support multi-agents

Les trois frameworks gèrent le multi-agent, mais selon des modèles de collaboration différents.

CrewAI se concentre sur l’attribution de rôles, avec des responsabilités claires pour chaque agent, dans un environnement très structuré.

LangGraph favorise la collaboration au niveau du workflow en traitant chaque agent ou fonction comme un nœud de graphe, avec des transitions d’état structurées et des branches conditionnelles.

AutoGen met en avant des modèles de « group chat », où agents et humains conversent en langage naturel : une collaboration plus dynamique et moins rigide, mais aussi moins prévisible.

Humain dans la boucle

La supervision humaine est un différenciateur clé. CrewAI intègre des points de contrôle humains directement dans l’exécution des tâches, pour valider ou affiner les sorties avant de poursuivre.

LangGraph prévoit des hooks « human-in-the-loop » dans ses graphes, permettant de mettre en pause, de recueillir un input utilisateur et de reprendre à l’identique.

AutoGen inclut l’humain au cœur du flux conversationnel, via un agent proxy utilisateur pouvant intervenir à tout moment pour guider ou réorienter l’échange.

Cette flexibilité rend AutoGen particulièrement performant pour les workflows interactifs ou centrés relecture, tandis que CrewAI et LangGraph proposent des mécanismes d’intervention plus structurés.

Cache et relecture

Pour le cache et la relecture, CrewAI inclut un outil complet de mise en cache avec gestion des erreurs afin d’assurer la bonne continuité des tâches.

LangGraph prend en charge un cache au niveau des nœuds, avec des backends comme la mémoire ou SQLite, et propose relecture et débogage via LangGraph Studio.

AutoGen se concentre sur la mise en cache LLM, avec des backends tels que disque ou Redis, permettant un cache partagé entre agents pour réduire les coûts et améliorer la répétabilité.

Exécution de code

Côté exécution de code, CrewAI passe par des outils assignés (CodeInterpreterTool), conforme à sa philosophie centrée rôles.

LangGraph permet l’exécution de code natif ou externe au sein de ses nœuds, offrant plus de liberté pour les workflows computationnels.

AutoGen intègre l’exécution directement dans les conversations, où des agents (CodeExecutorAgent) peuvent lancer et évaluer des extraits dans le cadre du dialogue.

Personnalisation

Côté personnalisation, les trois frameworks sont solides, mais de manières différentes. CrewAI est très personnalisable, mais au sein de son paradigme centré rôles.

LangGraph offre la plus grande modularité, permettant de conçevoir des workflows hautement spécialisés avec logique conditionnelle.

AutoGen propose une flexibilité conversationnelle, idéale pour créer des dialogues multi-agents, au prix d’une structure moins formelle.

Scalabilité

La montée en charge diffère aussi. CrewAI la gère via la parallélisation des tâches et la réplication horizontale d’agents au sein de rôles définis.

LangGraph est conçu pour être scalable dès le départ : les workflows en graphe peuvent s’étendre en systèmes distribués de grande ampleur.

AutoGen fait évoluer les conversations en permettant à de multiples agents de collaborer en grands groupes, avec toutefois des limites pour les applications à très grande échelle.

Documentation et communauté

Enfin, la documentation et la communauté comptent pour la pérennité d’un framework.

CrewAI agrège progressivement une base de développeurs, avec de plus en plus de projets orientés rôles et des cas d’usage partagés par les premiers adoptants.

LangGraph profite de l’écosystème LangChain, riche en documentation, tutoriels et support communautaire actif.

AutoGen, bien que moins mature, offre une documentation claire, une communauté active et de nombreux tutoriels.

Tableau comparatif

Le tableau suivant résume les principales différences entre CrewAI, LangGraph et AutoGen sur les dimensions clés pour vous aider à choisir.

|

Fonctionnalité |

CrewAI |

LangGraph |

AutoGen |

|

Architecture |

Structure organisationnelle par rôles |

Workflows en graphe (nœuds et arêtes) |

Interactions conversationnelles multi-agents |

|

Prise en main |

Attribution des rôles intuitive |

Courbe d’apprentissage modérée (conception de graphes) |

Mise en place conversationnelle simple |

|

Mémoire |

Mémoire par rôle Court/long terme Entités Contextuelle |

Fondée sur l’état Court/long terme Checkpointing |

Basée messages Court terme Historique de conversation |

|

Intégrations |

Outils cloud Workflows métier |

LangChain Écosystème Plateforme/Studio |

Intégrations d’outils |

|

Support multi-agents |

Oui |

Oui |

Oui |

|

Sorties structurées |

Imposées par les rôles |

Solide, fondée sur l’état Format strict |

Flexibles |

|

Cache & relecture |

Cache au niveau des outils |

Cache au niveau des nœuds |

Cache LLM |

|

Exécution de code |

Basée sur des outils |

Natif/externe |

Intégrée |

|

Humain dans la boucle |

Oui |

Oui |

Oui |

|

Personnalisation |

Elevée dans le cadre des rôles |

Modularité maximale Conception à logique conditionnelle |

Flexibilité conversationnelle |

|

Scalabilité |

Parallélisation des tâches |

Exécution de graphes distribués |

Support limité à très grande échelle |

|

Documentation communauté |

Base de développeurs en croissance |

Écosystème LangChain bien établi |

Docs claires Croissance régulière |

Tableau comparatif : CrewAI vs LangGraph vs Autogen

Quand choisir chacun

-

Choisissez CrewAI si votre projet se prête naturellement aux rôles et responsabilités (par ex. : une personne chargée de la recherche qui transmet à une personne chargée de la rédaction). C’est intuitif pour des workflows de type équipe, avec mémoire structurée et points de contrôle humains faciles à insérer.

-

Choisissez LangGraph si vous avez besoin d’orchestration complexe avec logique de branchement. La conception en graphe est idéale pour des workflows adaptatifs, des exécutions conditionnelles et des projets susceptibles de monter en charge vers des systèmes distribués.

-

Choisissez AutoGen si vous souhaitez une collaboration pilotée par la conversation avec une supervision flexible « human-in-the-loop ». Idéal pour les tâches itératives, le brainstorming ou les workflows très axés relecture, où le langage naturel structure le processus.

Après cette comparaison globale, examinons chaque framework en détail, en commençant par l’approche par rôles de CrewAI.

Zoom sur le framework CrewAI

CrewAI repose sur la métaphore de l’organisation. Les agents sont considérés comme des employés, chacun avec un rôle et un périmètre de responsabilités.

Par exemple, un agent peut jouer le « researcher » et collecter des données, tandis qu’un autre joue le « writer » et prépare des rapports. Cette division du travail rend CrewAI particulièrement intuitif lorsque rôles et responsabilités existent naturellement.

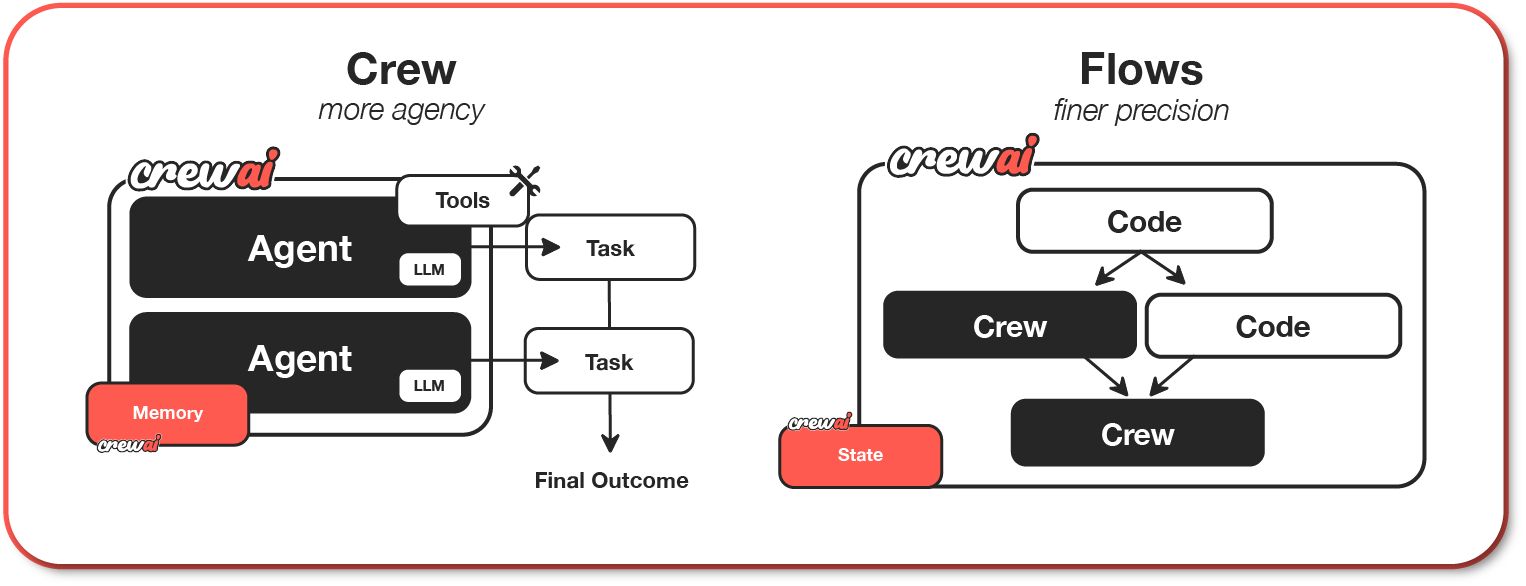

Architecture CrewAI

Le système de mémoire de CrewAI reflète cette structure. Chaque agent maintient une mémoire spécifique à son rôle, incluant le contexte des tâches, les relations entre entités et les connaissances accumulées.

Le framework gère plusieurs couches : mémoire à court terme pour le contexte immédiat, mémoire à long terme pour capitaliser d’une session à l’autre, mémoire des entités pour suivre personnes et concepts, et mémoire contextuelle qui relie le tout.

Concrètement, un agent « researcher » peut bâtir un socle de connaissances au fil du temps, tandis qu’un agent « writer » conserve ses préférences stylistiques et son historique de rédaction. Le support human-in-the-loop est intégré : une supervision humaine peut approuver ou modifier les sorties avant de poursuivre.

Voici un court extrait CrewAI où je définis un agent de recherche :

from crewai import Agent, Task, Crew

# Environment variables

os.environ["OPENAI_API_KEY"] = "your-api-key"

os.environ["OPENAI_API_BASE"] = "https://api.your-provider.com/v1"

os.environ["OPENAI_MODEL_NAME"] = "your-model-name"

# Define agents

researcher = Agent(

role="Researcher",

goal="Gather information on AI frameworks",

backstory="Expert in technical research and summarization",

)

writer = Agent(

role="Writer",

goal="Prepare well-structured reports",

backstory="Skilled technical writer who explains concepts clearly",

)

# Define tasks

research_task = Task(

description="Find details on CrewAI, LangGraph, and AutoGen",

expected_output="A structured summary of each framework, including use cases and differences.",

agent=researcher,

output_file="output/research_notes.md",

human_input=True

)

writing_task = Task(

description="Turn the research notes into a polished article section",

expected_output="A readable, clear article comparing the three frameworks.",

agent=writer,

output_file="output/final_article.md",

human_input=True

)

# Create a crew with both agents and tasks

crew = Crew(

agents=[researcher, writer],

tasks=[research_task, writing_task]

)

# Run the crew

result = crew.kickoff()

print(result)Dans ce flux, l’agent researcher collecte des informations et produit des notes structurées, enregistrées dans un fichier. Une personne peut intervenir pour revoir ou affiner ces notes avant la suite. L’agent writer transforme ensuite ces notes en une section d’article aboutie, avec là encore une relecture humaine optionnelle avant finalisation.

CrewAI coordonne l’ensemble, en maintenant les agents alignés sur leurs rôles tandis que les humains gardent la main aux moments clés. On a l’impression d’une petite équipe éditoriale en action : c’est précisément ce que CrewAI cherche à modéliser.

CrewAI introduit également les Flows, qui complètent les Crews pour un contrôle fin des workflows. Les Crews représentent des équipes autonomes d’agents, tandis que les Flows sont des pipelines événementiels, prêts pour la production, qui gèrent les chemins d’exécution, l’état et les branches.

Vous pouvez ainsi combiner la flexibilité de la prise de décision autonome des Crews avec la précision d’une orchestration structurée via les Flows.

Alors que CrewAI cadre la collaboration par rôles et responsabilités, LangGraph met l’accent sur la structure et la logique, en traitant les workflows comme des nœuds interconnectés dans un graphe.

Zoom sur le framework LangGraph

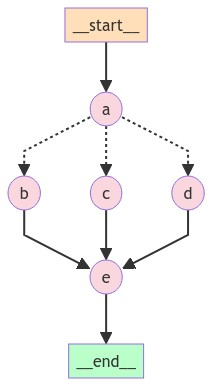

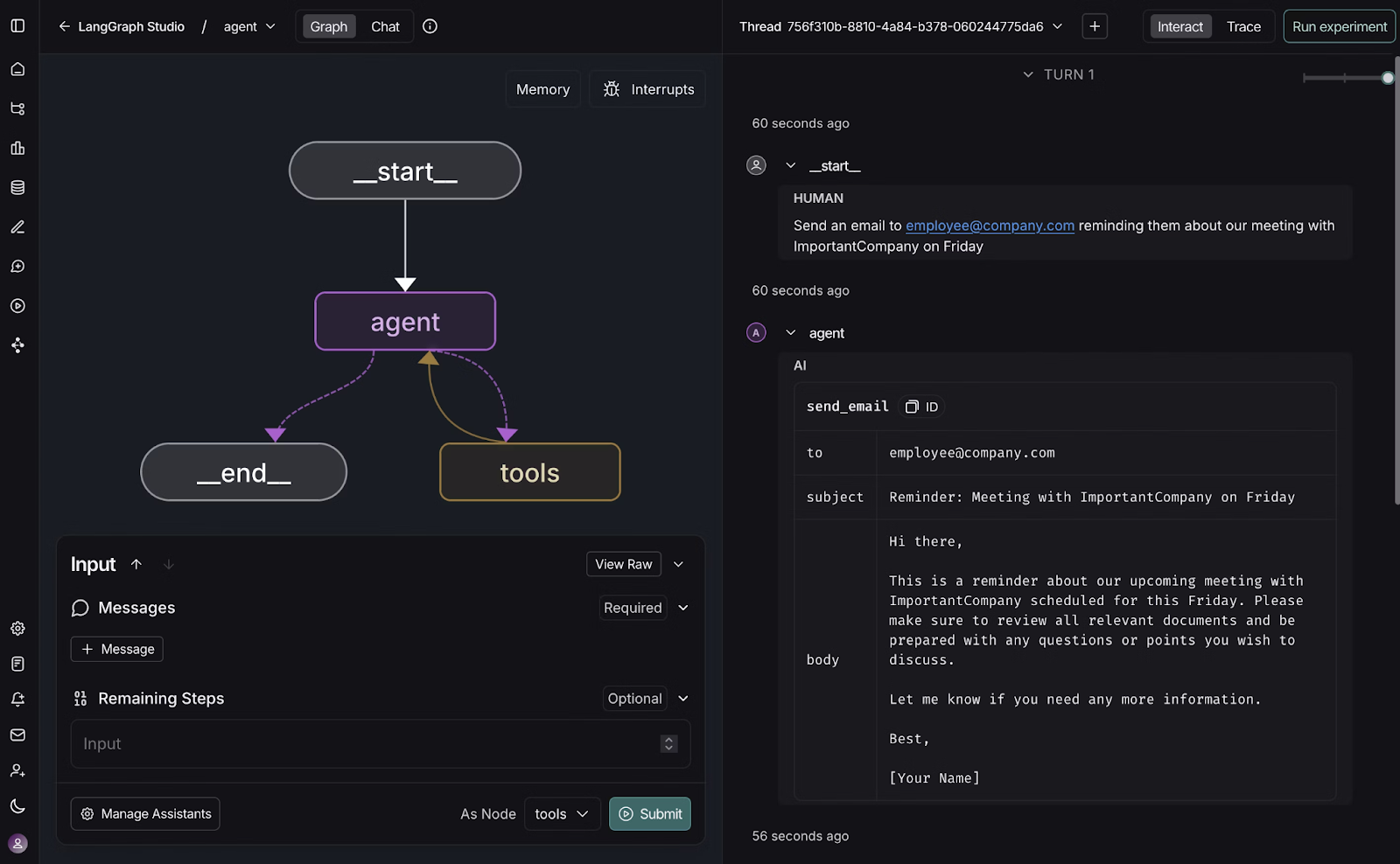

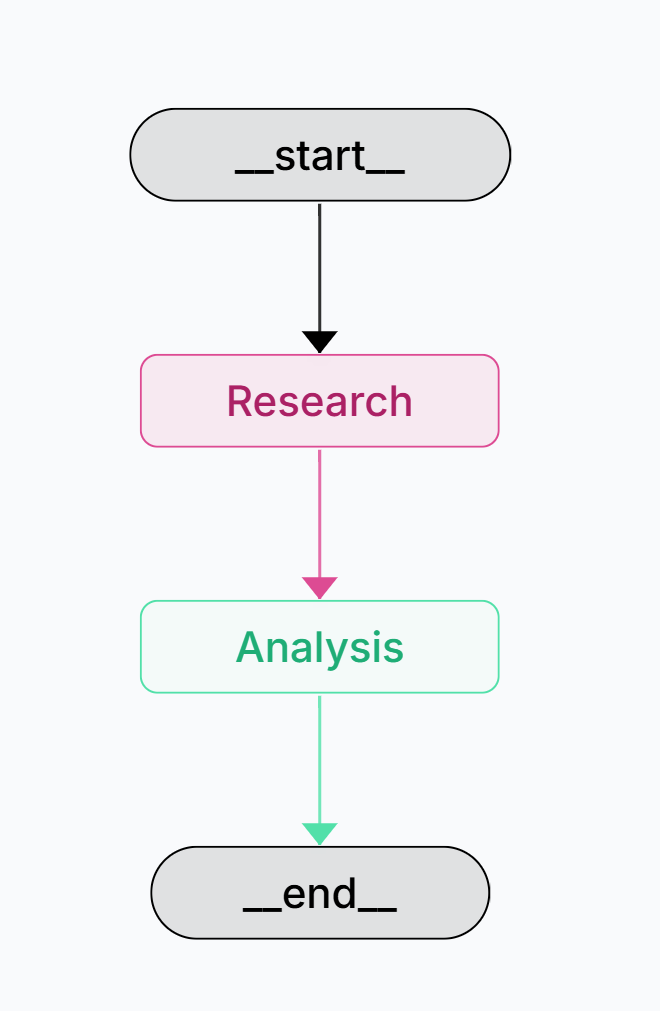

LangGraph adopte une approche différente en représentant les workflows comme des graphes de nœuds. Chaque nœud peut être un agent, une fonction ou un point de décision. Le système gère les branches conditionnelles pour s’adapter aux résultats. C’est puissant pour orchestrer des chaînes de décision complexes où les tâches dépendent des étapes précédentes.

Architecture de branchement LangGraph

LangGraph propose également de solides capacités mémoire, qui font partie de l’état du graphe. La mémoire à court terme persiste au sein des threads actifs et peut être checkpointée à n’importe quel nœud, ce qui permet de mettre en pause et de reprendre les workflows.

La mémoire à long terme conserve des données propres à l’utilisateur ou à l’application, persistantes entre exécutions. Cette approche fondée sur l’état est redoutable pour des workflows où des décisions à un nœud influencent des comportements ultérieurs, y compris d’une session à l’autre.

LangGraph Studio, son environnement visuel de développement, facilite encore la création et le débogage de ces workflows.

Voici un extrait LangGraph mettant en place un workflow avec deux agents : un nœud de recherche qui récupère l’information et un nœud d’analyse qui l’interprète.

from langchain_openai import ChatOpenAI

from typing import Annotated

from typing_extensions import TypedDict

import os

from langchain.schema import HumanMessage

from langgraph.graph import StateGraph, START, END

from langgraph.graph.message import add_messages

# Environment variables

os.environ["OPENAI_API_KEY"] = "your-api-key"

llm = ChatOpenAI(

model="gpt-4o-mini",

)

# Define the graph state

class State(TypedDict):

messages: Annotated[list, add_messages]

# Define nodes powered by the LLM

def research_node(state: State):

"""Research agent: collects information using the LLM."""

prompt = "You are a researcher. Collect detailed information.\nUser query: "

user_query = state["messages"][-1].content

response = llm.invoke(prompt + user_query)

return {"messages": [response]}

def analysis_node(state: State):

"""Analysis agent: analyzes research results with the LLM."""

research_output = state["messages"][-1].content

prompt = "You are an analyst. Provide insights based on this research:\n"

response = llm.invoke(prompt + research_output)

return {"messages": [response]}

# Build the graph

graph_builder = StateGraph(State)

# Add nodes

graph_builder.add_node("Research", research_node)

graph_builder.add_node("Analysis", analysis_node)

# Add edges (workflow order)

graph_builder.add_edge(START, "Research")

graph_builder.add_edge("Research", "Analysis")

graph_builder.add_edge("Analysis", END)

# Compile the graph

graph = graph_builder.compile()

# Run the workflow

if __name__ == "__main__":

initial_messages = [HumanMessage(content="Please draft a comparison of CrewAI, LangGraph, and AutoGen.")]

result = graph.invoke({"messages": initial_messages})

print(f"Research and Analysis Complete. {result}")

print("\nFinal Report:")

for msg in result["messages"]:

print(f"{type(msg).__name__}: {msg.content}")

Workflow « recherche → analyse »

Dans ce flux, le nœud de recherche collecte l’information brute liée à la requête de l’utilisateur, puis le nœud d’analyse en dégage des enseignements. Les arêtes définissent l’ordre d’exécution : une fois la recherche terminée, le graphe route automatiquement la sortie vers l’analyste.

Cela illustre la manière dont LangGraph formalise des workflows modulaires, facilitant la conception de pipelines où chaque étape dépend des résultats de la précédente. Contrairement à la métaphore des rôles de CrewAI ou aux conversations plus libres d’AutoGen, LangGraph vous donne un contrôle structurel très fin sur la collaboration entre agents.

Tandis que LangGraph mise sur des workflows structurels, AutoGen considère la conversation comme principe organisateur.

Zoom sur le framework AutoGen

AutoGen met l’accent sur la conversation. Les workflows sont modélisés comme des dialogues entre agents, et parfois avec des humains. Cette approche est particulièrement utile pour les tâches nécessitant un raisonnement itératif, de la négociation ou de la supervision. Par exemple, un agent propose une solution, un autre la critique, et une personne supervise peut intervenir pour orienter la discussion.

La mémoire d’AutoGen est centrée sur la conversation : l’historique complet des échanges est conservé pour maintenir le contexte sur plusieurs tours. Cette mémoire basée sur les messages permet de se référer aux étapes précédentes et de bâtir sur les échanges antérieurs.

Moins structurée que celle des autres frameworks, cette approche excelle quand le flux naturel de la conversation pilote le travail et que les agents doivent garder en tête l’ensemble du contexte.

La fonctionnalité RoundRobinGroupChat est particulièrement puissante. Elle permet à plusieurs agents de collaborer à tour de rôle, chaque réponse étant diffusée à tous pour maintenir un contexte partagé. C’est idéal pour implémenter le motif de « réflexion », où un agent rédige un brouillon et un autre l’évalue.

Voici un extrait AutoGen configurant un group chat avec un rédacteur, un relecteur et un proxy utilisateur :

import asyncio

from autogen_agentchat.conditions import TextMentionTermination

from autogen_agentchat.agents import UserProxyAgent, AssistantAgent

from autogen_agentchat.conditions import MaxMessageTermination

from autogen_agentchat.messages import TextMessage

from autogen_ext.models.openai import OpenAIChatCompletionClient

from autogen_agentchat.teams import RoundRobinGroupChat

from autogen_agentchat.ui import Console

async def simple_user_agent():

# Model client

model_client = OpenAIChatCompletionClient(model="gpt-4o")

# Writer agent

writer = AssistantAgent(

"Writer",

model_client=model_client,

system_message=(

"You are a professional writer. "

"Always respond with a detailed draft when asked. "

),

)

# Reviewer agent

reviewer = AssistantAgent(

"Reviewer",

model_client=model_client,

system_message=(

"You are a reviewer who critiques drafts and suggests improvements. "

),

)

# User proxy agent

user_proxy = UserProxyAgent("User")

# Termination conditions

termination = MaxMessageTermination(max_messages=8)

text_termination = TextMentionTermination("TERMINATE")

# Group chat with Writer, Reviewer, and User

team = RoundRobinGroupChat(

[writer, reviewer, user_proxy],

termination_condition=termination | text_termination,

max_turns=8,

)

# Run the group chat

await Console(

team.run_stream(

task=TextMessage(

source=user_proxy.name,

content="Please draft a comparison of CrewAI, LangGraph, and AutoGen."

),

)

)

if __name__ == "__main__":

asyncio.run(simple_user_agent())Ici, l’agent rédacteur produit un premier jet, l’agent relecteur évalue et propose des améliorations, et l’agent proxy représente la personne utilisatrice.

RoundRobinGroupChat garantit un tour de parole ordonné pour chaque participant, gardant la discussion structurée. Des conditions d’arrêt — comme une limite de messages ou un mot-clé — vous donnent la main sur la fin de l’échange. Cet exemple illustre la force conversationnelle d’AutoGen : une collaboration dynamique, avec possibilité d’intervention humaine à tout moment pour superviser ou recadrer.

Cas d’usage et applications

Pour choisir le bon framework, je le rapproche souvent de la nature du problème. Pour une automatisation simple avec des rôles clairs — par exemple, un agent « data fetcher » qui transmet ses résultats à un agent « writer » — CrewAI est le choix le plus naturel. Sa métaphore organisationnelle colle parfaitement.

Pour des pipelines de décision complexes avec embranchements, LangGraph excelle. Imaginez un système de support client en plusieurs étapes, où le chemin varie selon le type de problème ou le niveau d’escalade. Le design en graphe de LangGraph est idéal pour ces workflows adaptatifs.

Enfin, pour les systèmes avec humain dans la boucle, AutoGen s’impose. Si je conçois un assistant de recherche collaboratif où des agents brainstorment ensemble sous supervision humaine, l’architecture conversationnelle d’AutoGen est naturelle et efficace.

Points techniques à considérer

Côté implémentation, la performance, la scalabilité et l’intégration sont cruciales. CrewAI passe à l’échelle via la réplication horizontale d’agents et la parallélisation des tâches dans des hiérarchies de rôles. LangGraph s’étend via l’exécution distribuée du graphe et le traitement parallèle des nœuds. AutoGen évolue par sharding des conversations et gestion distribuée des chats, au prix de défis spécifiques pour conserver le contexte.

Côté intégration, LangGraph profite de l’écosystème LangChain, tandis qu’AutoGen met le focus sur les interfaces conversationnelles et peut nécessiter des couches d’abstraction supplémentaires pour les APIs traditionnelles. CrewAI s’intègre bien aux systèmes métiers via son approche structurée des workflows par rôles.

Préparation à l’entreprise et production

En contexte entreprise, licences et conformité sont incontournables. CrewAI propose des licences commerciales avec support entreprise. LangGraph, adossé à LangChain, offre un accompagnement de niveau entreprise. AutoGen bénéficie d’un support Microsoft via son intégration avec Azure AI.

La flexibilité de déploiement est tout aussi importante. CrewAI se déploie on-premise ou dans le cloud, ce qui convient aux exigences strictes de gouvernance des données.

L’architecture de LangGraph s’intègre aisément aux systèmes et APIs d’entreprise, et propose deux services complémentaires : LangGraph Studio pour conçoir et déboguer les workflows, et la LangGraph Platform pour gérer des déploiements à l’échelle.

AutoGen tire parti de ses liens natifs avec Microsoft, ce qui en fait un choix naturel pour les équipes déjà investies dans l’écosystème Azure. Il propose aussi Autogen Studio, encore en développement, une interface low-code pour le prototypage rapide.

Au final, chaque framework propose une voie de déploiement différente ; le bon choix dépend de vos priorités : contrôle local, intégration modulaire ou adoption cloud sans friction.

Avec ces considérations en tête, récapitulons et donnons des repères pour choisir.

Conclusion

Tout au long de ce tutoriel, nous avons passé en revue les fondamentaux des frameworks d’IA multi-agents et exploré trois approches distinctes : CrewAI, LangGraph et AutoGen. CrewAI se distingue par la collaboration fondée sur les rôles, LangGraph excelle dans l’orchestration pilotée par des graphes et AutoGen s’épanouit dans les systèmes conversationnels avec humain dans la boucle.

La leçon clé : aucun framework n’est « meilleur en toute circonstance ». Le choix dépend de vos besoins. Si vous valorisez des rôles structurés, CrewAI peut être le bon choix. Si votre workflow requiert des embranchements adaptatifs, LangGraph sera sans doute idéal. Si vous voulez des agents qui collaborent par la conversation, AutoGen offre un environnement très flexible.

Je vous encourage à expérimenter avec chacun. Le meilleur moyen de comprendre leurs forces et faiblesses est de construire de petits prototypes et d’observer leur comportement sur vos cas d’usage. Vous déterminerez ainsi lequel s’accorde le mieux à vos workflows et à vos objectifs long terme.

Pour continuer à apprendre, consultez :

CrewAI vs LangGraph vs AutoGen : FAQ

Comment CrewAI gère-t-il la délégation des tâches par rapport à LangGraph et AutoGen ?

CrewAI délègue les tâches selon des rôles, en associant agents et responsabilités. LangGraph utilise des graphes de workflow, tandis qu’AutoGen s’appuie sur des tours de conversation.

Quelles sont les principales différences de collaboration entre agents entre CrewAI et LangGraph ?

CrewAI collabore via l’attribution de rôles, tandis que LangGraph connecte les agents comme des nœuds dans un graphe de workflow avec branches conditionnelles et état structuré.

En quoi l’approche d’AutoGen pour les discussions entre agents diffère-t-elle du design par rôles de CrewAI ?

AutoGen met en avant des discussions de groupe où les agents se critiquent et enrichissent mutuellement leurs réponses. CrewAI impose des échanges structurés, régis par les rôles.

Quel framework offre le meilleur support pour les systèmes avec humain dans la boucle ?

Les trois frameworks supportent l’implication humaine, mais CrewAI intègre des points de vérification dans les workflows, LangGraph propose des hooks pause/reprise, et AutoGen intègre directement les humains dans les conversations.

Comment les capacités de gestion de la mémoire de LangGraph se comparent-elles à celles de CrewAI et AutoGen ?

LangGraph fournit une mémoire fondée sur l’état avec checkpointing et persistance. CrewAI utilise une mémoire structurée par rôle avec RAG, tandis qu’AutoGen stocke l’historique conversationnel.

En tant que fondateur de Martin Data Solutions et Data Scientist freelance, ingénieur ML et AI, j'apporte un portefeuille diversifié en régression, classification, NLP, LLM, RAG, réseaux neuronaux, méthodes d'ensemble et vision par ordinateur.

- A développé avec succès plusieurs projets de ML de bout en bout, y compris le nettoyage des données, l'analyse, la modélisation et le déploiement sur AWS et GCP, en fournissant des solutions impactantes et évolutives.

- Création d'applications web interactives et évolutives à l'aide de Streamlit et Gradio pour divers cas d'utilisation dans l'industrie.

- Enseigne et encadre des étudiants en science des données et en analyse, en favorisant leur développement professionnel par le biais d'approches d'apprentissage personnalisées.

- Conception du contenu des cours pour les applications de génération augmentée par récupération (RAG) adaptées aux exigences de l'entreprise.

- Rédaction de blogs techniques à fort impact sur l'IA et le ML, couvrant des sujets tels que les MLOps, les bases de données vectorielles et les LLM, avec un engagement significatif.

Dans chaque projet que je prends en charge, je m'assure d'appliquer des pratiques actualisées en matière d'ingénierie logicielle et de DevOps, comme le CI/CD, le linting de code, le formatage, la surveillance des modèles, le suivi des expériences et la gestion robuste des erreurs. Je m'engage à fournir des solutions complètes, en transformant les connaissances sur les données en stratégies pratiques qui aident les entreprises à se développer et à tirer le meilleur parti de la science des données, de l'apprentissage automatique et de l'IA.