Kurs

In diesem Tutorial führe ich dich durch einen ausführlichen Vergleich von drei führenden Multi-Agenten-KI-Frameworks: CrewAI, LangGraph und AutoGen. In den letzten zwölf Monaten hat die Diskussion um Multi-Agenten-Systeme rasant an Fahrt aufgenommen – aus gutem Grund. Mit der Reife von KI reicht ein einzelner Agent in vielen Anwendungen nicht mehr aus. Stattdessen zeigt sich: Die Orchestrierung mehrerer spezialiserter Agenten mit klaren Rollen und Verantwortlichkeiten führt zu anpassungsfähigeren und verlässlicheren Lösungen.

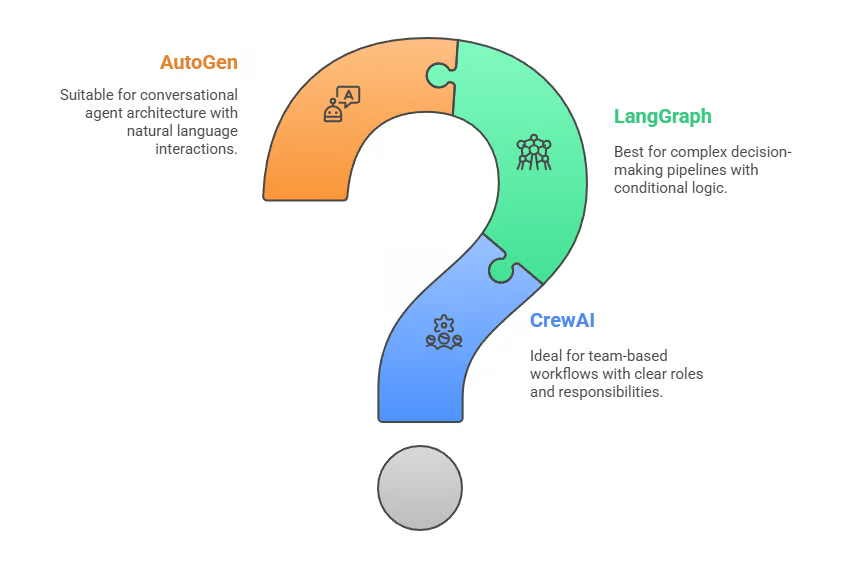

Der Wert dieses Vergleichs liegt darin, wie jedes Framework die Herausforderung der Koordination mehrerer Agenten angeht. CrewAI setzt auf ein rollenbasiertes Modell, das von realen Organisationsstrukturen inspiriert ist, LangGraph verfolgt einen graphbasierten Workflow-Ansatz, und AutoGen fokussiert sich auf konversationsbasierte Zusammenarbeit. Jedes Framework bringt eigene Designprinzipien, Stärken und Abwägungen mit.

Mein Ziel ist es, diese Unterschiede anhand praxisnaher Erklärungen und kompakter Beispiele herauszuarbeiten, damit du eine fundierte Entscheidung für dein Projekt treffen kannst.

Wenn du neu in KI-Anwendungen bist, schau dir unsere Kurse an, z. B. AI Fundamentals, Developing AI Applications oder Retrieval Augmented Generation (RAG) with LangChain.

Was ist ein KI-Agent?

Bevor wir in die Frameworks einsteigen, klären wir, was ein Agent in diesem Kontext bedeutet. In Multi-Agenten-KI-Frameworks ist ein Agent mehr als nur ein Prompt-Wrapper um ein großes Sprachmodell. Er ist eine autonome Einheit mit definierter Rolle, verfügbaren Tools, zugänglichem Speicher und vorgegebenen Verhaltensweisen. Agenten können eigenständig arbeiten oder mit anderen zusammenarbeiten, um Probleme zu lösen, die für einen einzelnen Agenten zu komplex wären.

Ich betrachte einen Agenten sowohl als Entscheider als auch als Teamplayer. Er nimmt Eingaben entgegen, schlussfolgert, führt Aktionen aus (teilweise über externe Tools) und kommuniziert bei Bedarf mit anderen Agenten.

Ein Beispiel: Ein Agent sammelt Daten, ein anderer analysiert sie, ein dritter bereitet die Ergebnisse auf. Gemeinsam bilden sie ein System kollaborativer Intelligenz.

Allerdings sind Agenten nicht immer die beste Wahl. Ist dein Workflow geradlinig – etwa Daten aus einer einzelnen API abrufen und anzeigen –, ist ein einfaches Skript oder die Orchestrierung mit einem einzelnen Agenten oft effizienter. Multi-Agenten-Systeme spielen ihre Stärken aus, wenn Aufgaben Koordination, Spezialisierung oder dynamische Anpassung erfordern.

Multi-Agenten-KI-Frameworks verstehen

Multi-Agenten-Frameworks erweitern das Single-Agent-Paradigma zu Systemen, die Zusammenarbeit, Delegation und adaptive Workflows unterstützen. Sie setzen die Idee kollaborativer Intelligenz um, in der spezialisierte Agenten Teilprobleme lösen und über Kommunikation ein Gesamtziel erreichen.

Dieser Ansatz spiegelt Arbeitsweisen in Unternehmen wider: Spezialistinnen und Spezialisten arbeiten unter einer Orchestrierungsschicht zusammen.

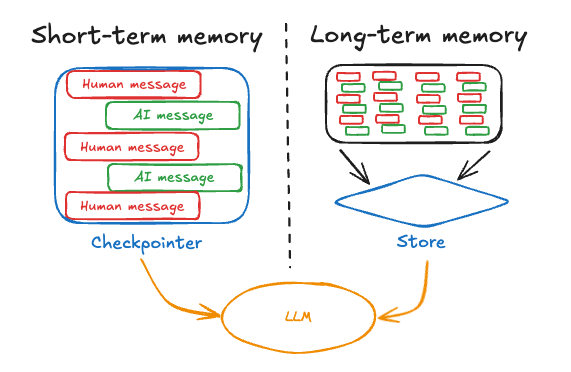

Zentrale Bausteine dieser Frameworks sind meist Zustandsverwaltung, Kommunikationsprotokolle und Speichersysteme. Besonders wichtig ist der Speicher: Er erlaubt Agenten, frühere Interaktionen zu erinnern und fundierte Entscheidungen zu treffen.

Kurzzeitspeicher hält Kontext während unmittelbarer Interaktionen. Langzeitspeicher ermöglicht Lernen aus Erfahrungen und den Aufbau von Wissensbasen. Persistenter Speicher stellt sicher, dass wichtige Informationen Neustarts überdauern und über Sitzungen hinweg verfügbar sind.

Durch diese Komponenten unterstützen Multi-Agenten-Frameworks flexible Architekturen – von Workflow-Automatisierung bis Research-Analyse. Die Wahl des Frameworks hängt davon ab, wie viel Kontrolle, Flexibilität und Skalierbarkeit dein Projekt braucht.

Überblick über CrewAI, LangGraph und AutoGen

Jetzt, da wir ein gemeinsames Verständnis von Agenten und Multi-Agenten-Frameworks haben, stellen wir die drei Kandidaten kurz vor.

CrewAI betont rollenbasierte Zusammenarbeit mit einer an den Arbeitsplatz angelehnten Metapher. Jeder Agent hat eine definierte Rolle, Zuständigkeiten und Zugriff auf Tools – ideal für teamähnliche Workflows.

Das Framework punktet bei aufgabenorientierter Zusammenarbeit, in der klare Rollen und Verantwortlichkeiten effiziente Umsetzung treiben. Die Stärke von CrewAI liegt in der intuitiven Koordination und der integrierten Unterstützung typischer Business-Workflows.

LangGraph setzt auf graphbasierte Workflows, in denen Interaktionen als Knoten in einem gerichteten Graphen modelliert werden. Diese Architektur bietet außergewöhnliche Flexibilität für komplexe Entscheidungs-Pipelines mit bedingter Logik, verzweigten Pfaden und dynamischer Anpassung.

LangGraph glänzt überall dort, wo anspruchsvolle Orchestrierung mit vielen Entscheidungspunkten und Parallelisierung gefragt ist.

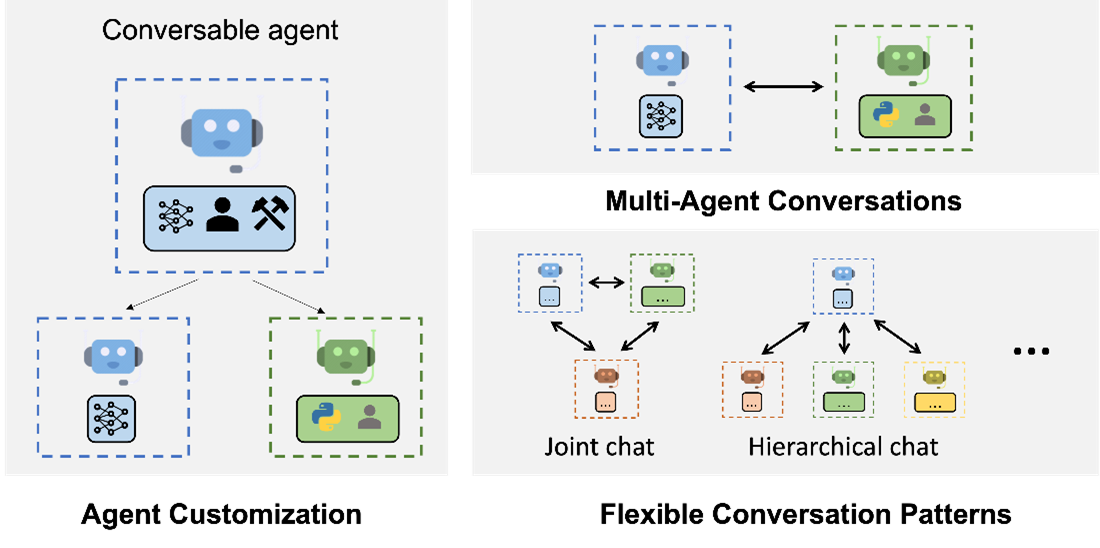

AutoGen fokussiert eine konversationale Agentenarchitektur mit natürlichen Sprachinteraktionen und dynamischem Rollenspiel. Das Framework überzeugt bei flexiblen, gesprächsgetriebenen Workflows, in denen Agenten ihre Rollen kontextabhängig anpassen. AutoGen spielt seine Stärke besonders beim schnellen Prototyping und in Human-in-the-Loop-Szenarien aus, in denen natürliche Sprache zentral ist.

Überblick über CrewAI, LangGraph und AutoGen

Der detaillierte Vergleich: CrewAI vs LangGraph vs AutoGen

Jedes Framework nähert sich der Orchestrierung aus einem anderen Blickwinkel. CrewAI betont Rollenzuordnung, LangGraph die Workflow-Struktur und AutoGen die Konversation.

Diese Unterschiede beeinflussen, wie Entwickler Systeme entwerfen, steuern und skalieren – das zu verstehen, ist vor der Wahl entscheidend.

Lass uns die wichtigsten Dimensionen durchgehen – beginnend mit der Architektur.

Architektonische Unterschiede

Die Architektur ist das Fundament. CrewAI folgt einem rollenbasierten Modell: Agenten verhalten sich wie Mitarbeitende mit klaren Zuständigkeiten. So lassen sich Workflows leicht als Teamarbeit visualisieren.

LangGraph konzentriert sich dagegen auf graphbasierte Orchestrierung: Workflows werden als Knoten und Kanten dargestellt – modular und mit bedingter Ausführung.

AutoGen wählt einen anderen Weg und modelliert Interaktionen als Gespräche zwischen Agenten oder zwischen Agenten und Menschen – ein natürlicher, dialoggetriebener Fluss.

Benutzerfreundlichkeit

Bei der Bedienbarkeit fühlt sich CrewAI für alle intuitiv an, die in Rollen und Aufgaben denken. Du definierst Agenten mit Zielen – und lässt sie zusammenarbeiten.

LangGraph erfordert ein Verständnis von Graph-Design. Das ist eine Lernkurve, zahlt sich aber mit deutlich mehr Kontrolle über die Logik aus.

AutoGen ist von Natur aus konversational, damit schnell für kleine Projekte startklar – und flexibel für iterative Entwicklung.

Tools und Integrationen

Bei Integrationen bieten alle drei umfangreiche API-Anbindungen und externe Tools. CrewAI bringt integrierte Anbindungen für gängige Cloud-Dienste und Werkzeuge mit.

LangGraph profitiert vom gesamten LangChain-Ökosystem und bietet breite Integrationen in APIs und externe Systeme.

AutoGen priorisiert Tool-Nutzung innerhalb von Gesprächen und lässt Menschen direkt teilnehmen – ideal für iterative oder reviewlastige Workflows.

Speicherunterstützung und -arten

Beim Speicher unterscheiden sich die Frameworks deutlich. CrewAI nutzt strukturierten, rollenbasierten Speicher mit RAG-Unterstützung für kontextuelles Agentenverhalten.

LangGraph bietet zustandsbasierten Speicher mit Checkpointing für nahtlose Workflow-Fortsetzung.

AutoGen setzt auf konversationsbasierten Speicher und hält den Dialogverlauf für mehrstufige Interaktionen. Jede Lösung spiegelt die jeweilige Philosophie wider.

Strukturierte Ausgaben

Auch beim Umgang mit strukturierten Ausgaben gibt es Unterschiede. CrewAI erzwingt Struktur über die Rollenlogik – Ausgaben orientieren sich an den Zuständigkeiten der Agenten.

LangGraph ist hier sehr stark: Zustandsgraphen können strikte Ausgabeformate und Übergänge durchsetzen.

AutoGen produziert als gesprächsgetriebenes System flexiblere Ausgaben, deren Konsistenz je nach Orchestrierung variieren kann.

Multi-Agenten-Unterstützung

Alle drei unterstützen mehrere Agenten, aber die Kollaborationsmodelle unterscheiden sich.

CrewAI setzt auf Rollenzuordnung mit klaren Verantwortlichkeiten – die Koordination wirkt wie in einem strukturierten Team.

LangGraph ermöglicht Zusammenarbeit auf Workflow-Ebene, indem Agenten oder Funktionen als Knoten interagieren – über Zustandsübergänge und Verzweigungen.

AutoGen betont Gruppenchats: Agenten und Menschen sprechen in natürlicher Sprache – dynamisch, weniger starr, aber auch weniger vorhersehbar.

Human-in-the-Loop-Funktionen

Menschliche Aufsicht ist ein zentrales Unterscheidungsmerkmal. CrewAI integriert Prüfpunkte direkt in die Aufgabenbearbeitung, damit Ergebnisse vor dem nächsten Schritt geprüft oder verfeinert werden können.

LangGraph bietet Hooks für Human-in-the-Loop innerhalb des Graphen: Ausführung pausieren, Nutzereingaben einholen, im selben Zustand fortsetzen.

AutoGen verankert menschliche Beteiligung direkt im Gespräch: Ein User-Proxy-Agent kann jederzeit die Richtung vorgeben oder eingreifen.

Damit ist AutoGen besonders stark für interaktive oder prüflastige Workflows, während CrewAI und LangGraph strukturiertere Eingriffsmöglichkeiten bieten.

Caching und Replay

Beim Caching und Replay bietet CrewAI ein umfassendes Tool-Caching mit integriertem Fehlermanagement für reibungslose Abläufe.

LangGraph unterstützt Caching auf Knotenebene mit Backends wie Memory oder SQLite und ermöglicht Replay und Debugging über LangGraph Studio.

AutoGen konzentriert sich auf LLM-Caching mit Backends wie Festplatte oder Redis – gemeinsame Caches über Agenten hinweg sparen Kosten und erhöhen die Reproduzierbarkeit.

Codeausführung

Bei der Codeausführung erlaubt CrewAI die Ausführung über zugewiesene Tools (CodeInterpreterTool) – im Einklang mit der rollenbasierten Philosophie.

LangGraph erlaubt native und externe Codeausführung in Knoten und bietet mehr Flexibilität für rechnerische Workflows.

AutoGen integriert Ausführung direkt in die Konversation: Agenten (CodeExecutorAgent) können Code-Snippets als Teil des Dialogs ausführen und bewerten.

Anpassbarkeit

Alle drei sind stark anpassbar – auf unterschiedliche Weise. CrewAI ist sehr anpassbar innerhalb des Rollenparadigmas.

LangGraph bietet maximale Modularität und erlaubt hochspezialisierte Workflows mit bedingter Logik.

AutoGen liefert konversationale Flexibilität – kreatives Multi-Agenten-Dialog-Design, aber weniger formale Struktur.

Skalierbarkeit

Auch die Skalierung unterscheidet sich. CrewAI unterstützt Parallelisierung von Aufgaben und horizontale Replikation von Agenten innerhalb von Rollen.

LangGraph ist von Grund auf für Skalierung ausgelegt: Graphbasierte Workflows lassen sich in große, verteilte Systeme ausbauen.

AutoGen skaliert konversational – mehrere Agenten können in größeren Gruppen kooperieren, stoßen aber bei wirklich großen Anwendungen an Grenzen.

Dokumentation und Community

Auch Doku und Community sind für den langfristigen Erfolg wichtig.

CrewAI baut kontinuierlich eine Entwicklerbasis auf – mit mehr rollengetriebenen Projekten und frühen Praxisbeispielen.

LangGraph profitiert vom größeren LangChain-Ökosystem – mit umfangreicher Dokumentation, Tutorials und aktiver Community.

AutoGen ist zwar weniger ausgereift, bietet aber klare Doku, eine aktive Community und viele Tutorials.

Vergleichstabelle

Die folgende Tabelle fasst die wichtigsten Unterschiede zwischen CrewAI, LangGraph und AutoGen zusammen und hilft dir bei der Auswahl.

|

Feature |

CrewAI |

LangGraph |

AutoGen |

|

Architektur |

Rollenbasierte Organisationsstruktur |

Graphbasierte Workflows mit Knoten und Kanten |

Konversationale Multi-Agenten-Interaktionen |

|

Benutzerfreundlichkeit |

Intuitive Rollenzuordnung |

Mittlere Lernkurve (Graph-Design) |

Einfaches konversationales Setup |

|

Speicherunterstützung |

Rollenbasierter Speicher Kurz-/Langzeit Entitäten Kontextuell |

Zustandsbasiert Kurz-/Langzeit Checkpointing |

Nachrichtenbasiert Kurzzeit Verlauf der Konversation |

|

Integrationen |

Cloud-Tools Business-Workflows |

LangChain Ökosystem Plattform/Studio |

Tool-Integrationen |

|

Multi-Agenten-Unterstützung |

Ja |

Ja |

Ja |

|

Strukturierte Ausgabe |

Durch Rollen erzwungen |

Stark zustandsbasiert Striktes Format |

Flexibel |

|

Caching & Replay |

Tool-Caching |

Caching auf Knotenebene |

LLM-Caching |

|

Codeausführung |

Tool-basiert |

Native/extern |

Integriert |

|

Human-in-the-Loop |

Ja |

Ja |

Ja |

|

Anpassbarkeit |

Hoch im Rollenparadigma |

Maximale Modularität Bedingte Logik |

Konversationale Flexibilität |

|

Skalierbarkeit |

Aufgaben-Parallelisierung |

Verteilte Graphausführung |

Begrenzte Großskaligkeit |

|

Dokumentation Community |

Wachsende Entwicklerbasis |

Etabliertes LangChain-Ökosystem |

Klare Doku Stetig wachsend |

Vergleichstabelle: CrewAI vs. LangGraph vs. AutoGen

Wann welches Framework?

-

Wähle CrewAI, wenn dein Projekt sich natürlich auf Rollen und Verantwortlichkeiten abbilden lässt (z. B. ein Researcher übergibt an eine:n Writer). Es ist intuitiv für teamähnliche Workflows, unterstützt strukturierten Speicher und erleichtert menschliche Prüfpunkte.

-

Wähle LangGraph, wenn du komplexe Orchestrierung mit Verzweigungslogik brauchst. Das Graph-Design ist ideal für adaptive Workflows, bedingte Ausführung und Projekte, die in verteilte Systeme skalieren sollen.

-

Wähle AutoGen, wenn du gesprächsgetriebene Zusammenarbeit mit flexibler Human-in-the-Loop-Aufsicht willst. Es überzeugt bei iterativen Aufgaben, Brainstorming oder reviewlastigen Workflows, in denen natürliche Sprache den Rahmen vorgibt.

Nachdem wir die Frameworks auf hoher Ebene verglichen haben, schauen wir uns jedes im Detail an – beginnend mit dem rollenbasierten Ansatz von CrewAI.

CrewAI Framework: Deep Dive

CrewAI ist rund um die Metapher einer Organisation gebaut. Agenten werden wie Mitarbeitende behandelt – jeweils mit Rolle und Zuständigkeiten.

Ein Agent kann etwa als „Researcher“ Daten sammeln, ein anderer als „Writer“ Berichte verfassen. Diese Arbeitsteilung macht CrewAI besonders intuitiv, wenn Rollen und Verantwortlichkeiten ohnehin gegeben sind.

CrewAI-Architektur

Das Speichersystem von CrewAI spiegelt diese Struktur wider. Jeder Agent führt rollenspezifischen Speicher mit Aufgabenkontext, Entitäten-Beziehungen und angesammeltem Wissen.

Unterstützt werden mehrere Ebenen: Kurzzeitspeicher für unmittelbaren Kontext, Langzeitspeicher für Erkenntnisse über Sitzungen hinweg, Entitätenspeicher für Personen und Konzepte sowie kontextueller Speicher, der alles zusammenführt.

So kann ein Researcher-Agent Wissen aufbauen, während ein Writer-Agent seinen Stil und seine Historie pflegt. Human-in-the-Loop ist integriert: Aufsichten können Ausgaben freigeben oder anpassen, bevor es weitergeht.

Hier ein einfaches CrewAI-Snippet, in dem ich einen Research-Agenten definiere:

from crewai import Agent, Task, Crew

# Environment variables

os.environ["OPENAI_API_KEY"] = "your-api-key"

os.environ["OPENAI_API_BASE"] = "https://api.your-provider.com/v1"

os.environ["OPENAI_MODEL_NAME"] = "your-model-name"

# Define agents

researcher = Agent(

role="Researcher",

goal="Gather information on AI frameworks",

backstory="Expert in technical research and summarization",

)

writer = Agent(

role="Writer",

goal="Prepare well-structured reports",

backstory="Skilled technical writer who explains concepts clearly",

)

# Define tasks

research_task = Task(

description="Find details on CrewAI, LangGraph, and AutoGen",

expected_output="A structured summary of each framework, including use cases and differences.",

agent=researcher,

output_file="output/research_notes.md",

human_input=True

)

writing_task = Task(

description="Turn the research notes into a polished article section",

expected_output="A readable, clear article comparing the three frameworks.",

agent=writer,

output_file="output/final_article.md",

human_input=True

)

# Create a crew with both agents and tasks

crew = Crew(

agents=[researcher, writer],

tasks=[research_task, writing_task]

)

# Run the crew

result = crew.kickoff()

print(result)In diesem Workflow sammelt der Researcher Informationen und erstellt strukturierte Notizen, die in einer Datei gespeichert werden. Ein Mensch kann die Notizen prüfen oder verfeinern. Anschließend verwandelt der Writer die Notizen in einen ausformulierten Artikelabschnitt – optional wieder mit menschlicher Review vor der Finalisierung.

CrewAI koordiniert den Prozess, hält die Agenten in ihren Rollen auf Kurs und ermöglicht Kontrolle an zentralen Prüfpunkten. Es fühlt sich an wie ein kleines Redaktionsteam – genau das bildet CrewAI ab.

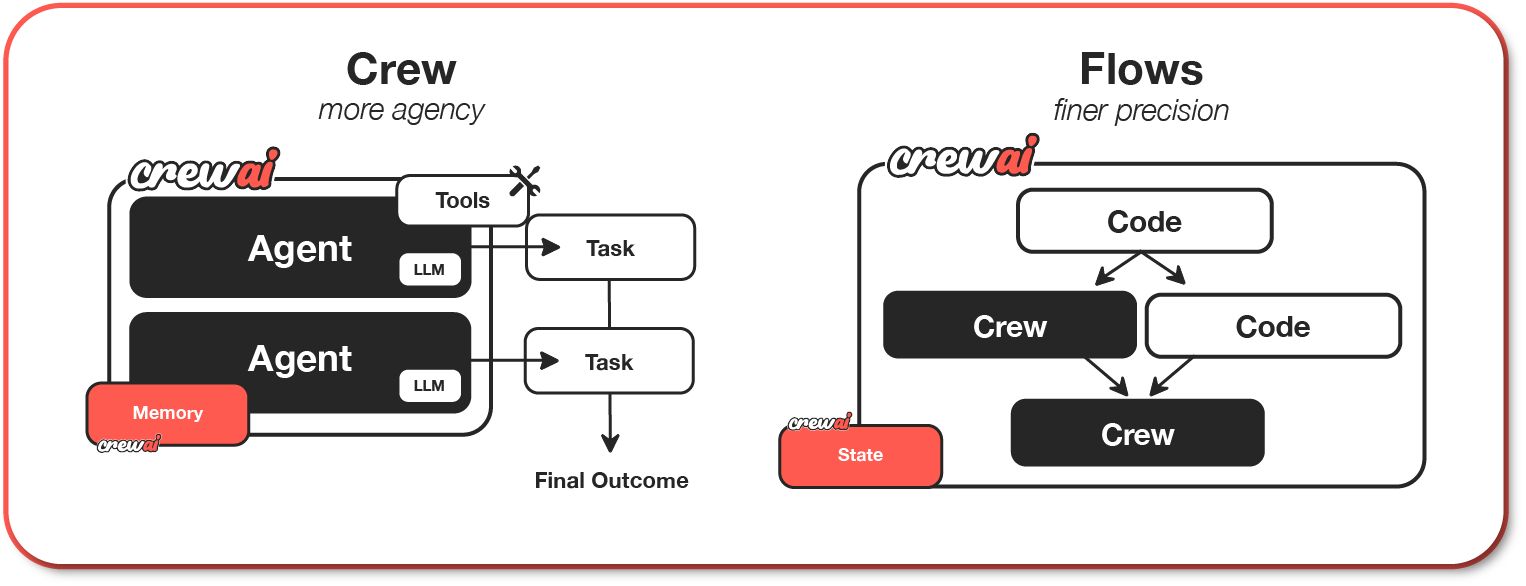

CrewAI führt außerdem Flows ein, die Crews ergänzen und feingranulare Workflow-Steuerung bieten. Während Crews autonome Teams von Agenten repräsentieren, sind Flows ereignisgetriebene, produktionsreife Pipelines, die Ausführungspfade, Zustand und Verzweigungen managen.

So kombinierst du die Flexibilität autonomer Entscheidungen in Crews mit der Präzision strukturierter Orchestrierung in Flows.

Während CrewAI Zusammenarbeit über Rollen und Verantwortlichkeiten rahmt, legt LangGraph den Fokus auf Struktur und Logik und behandelt Workflows als miteinander verbundene Knoten im Graphen.

LangGraph Framework: Deep Dive

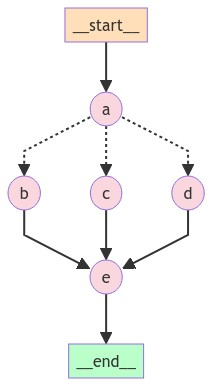

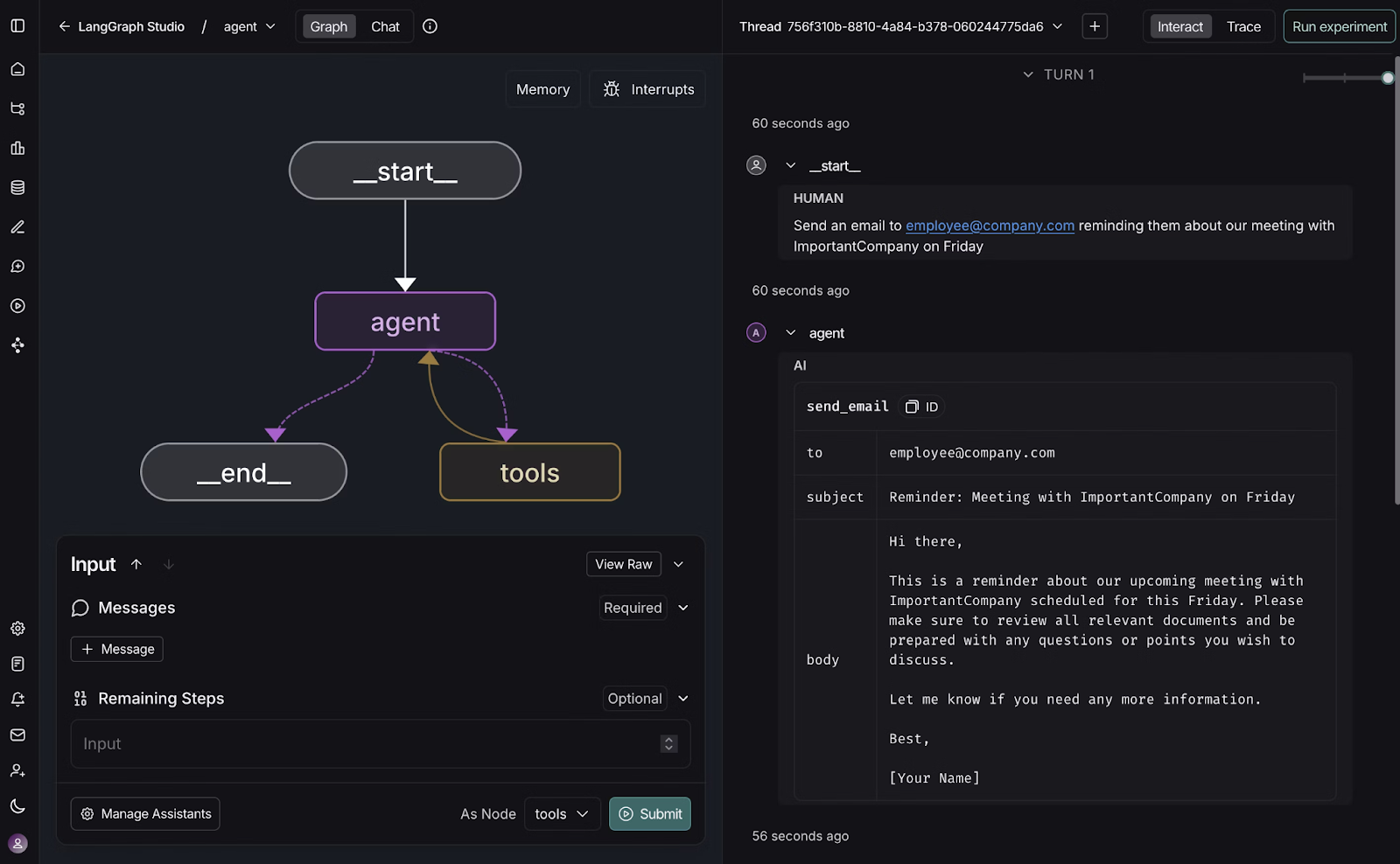

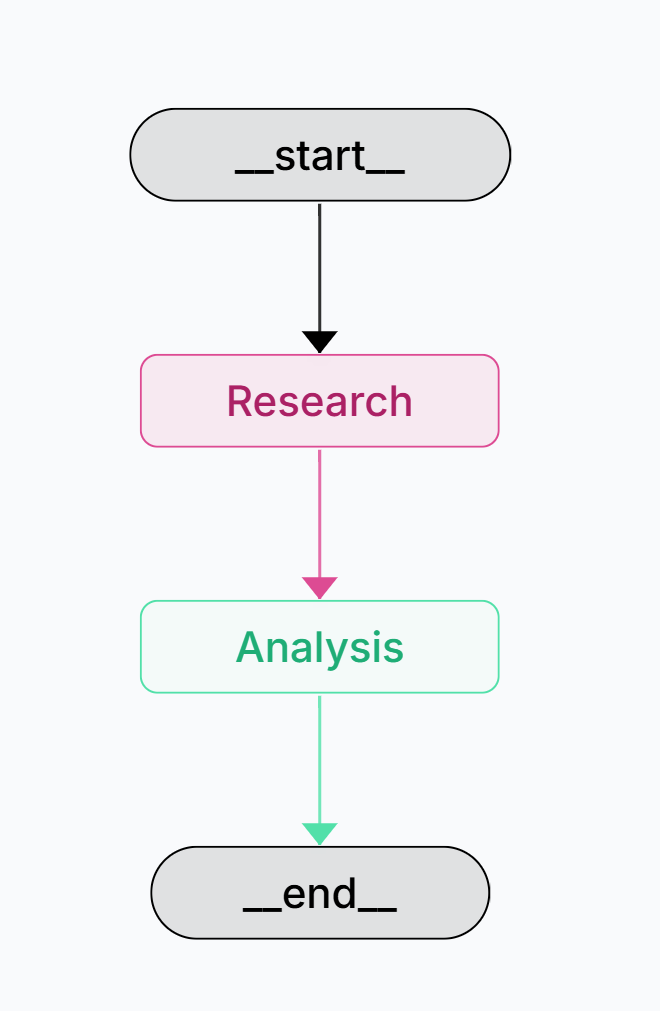

LangGraph stellt Workflows als Graphen aus Knoten dar. Jeder Knoten kann ein Agent, eine Funktion oder ein Entscheidungspunkt sein. Das System unterstützt bedingte Verzweigungen und passt sich dynamisch an Ergebnisse an. So eignet sich LangGraph hervorragend, um komplexe Entscheidungs-Pipelines zu orchestrieren, in denen Schritte von vorherigen Resultaten abhängen.

LangGraph-Verzweigungsarchitektur

LangGraph bringt starke Speicherfunktionen mit, die als Teil des Graphzustands arbeiten. Kurzzeitspeicher bleibt in aktiven Threads erhalten und kann an jedem Knoten als Checkpoint gesichert werden – Workflows lassen sich pausieren und fortsetzen.

Langzeitspeicher hält benutzerspezifische oder anwendungsweite Daten über verschiedene Ausführungen hinweg. Dieser zustandsbasierte Ansatz ist besonders stark, wenn Entscheidungen an einem Knoten das spätere Verhalten beeinflussen – auch über Sitzungen hinweg.

LangGraph Studio, die visuelle Entwicklungsumgebung, vereinfacht Aufbau und Debugging zusätzlich.

Hier ein LangGraph-Snippet mit zwei Agenten: ein Research-Knoten sammelt Informationen, ein Analyse-Knoten interpretiert sie.

from langchain_openai import ChatOpenAI

from typing import Annotated

from typing_extensions import TypedDict

import os

from langchain.schema import HumanMessage

from langgraph.graph import StateGraph, START, END

from langgraph.graph.message import add_messages

# Environment variables

os.environ["OPENAI_API_KEY"] = "your-api-key"

llm = ChatOpenAI(

model="gpt-4o-mini",

)

# Define the graph state

class State(TypedDict):

messages: Annotated[list, add_messages]

# Define nodes powered by the LLM

def research_node(state: State):

"""Research agent: collects information using the LLM."""

prompt = "You are a researcher. Collect detailed information.\nUser query: "

user_query = state["messages"][-1].content

response = llm.invoke(prompt + user_query)

return {"messages": [response]}

def analysis_node(state: State):

"""Analysis agent: analyzes research results with the LLM."""

research_output = state["messages"][-1].content

prompt = "You are an analyst. Provide insights based on this research:\n"

response = llm.invoke(prompt + research_output)

return {"messages": [response]}

# Build the graph

graph_builder = StateGraph(State)

# Add nodes

graph_builder.add_node("Research", research_node)

graph_builder.add_node("Analysis", analysis_node)

# Add edges (workflow order)

graph_builder.add_edge(START, "Research")

graph_builder.add_edge("Research", "Analysis")

graph_builder.add_edge("Analysis", END)

# Compile the graph

graph = graph_builder.compile()

# Run the workflow

if __name__ == "__main__":

initial_messages = [HumanMessage(content="Please draft a comparison of CrewAI, LangGraph, and AutoGen.")]

result = graph.invoke({"messages": initial_messages})

print(f"Research and Analysis Complete. {result}")

print("\nFinal Report:")

for msg in result["messages"]:

print(f"{type(msg).__name__}: {msg.content}")

Research-Analyse-Workflow

Hier sammelt der Research-Knoten Rohinformationen zur Nutzerfrage, der Analyse-Knoten leitet daraus Erkenntnisse ab. Die Kanten definieren die Ausführungsreihenfolge: Nach dem Research routet der Graph automatisch zum Analysten.

So formalisiert LangGraph Workflows als modulare Graphen. Das erleichtert Pipelines, in denen jeder Schritt vom vorherigen abhängt. Anders als CrewAIs Rollenmetapher oder AutoGens freiere Gespräche gibt dir LangGraph feingranulare strukturelle Kontrolle über die Zusammenarbeit.

Während LangGraph auf Struktur setzt, stellt AutoGen die Konversation ins Zentrum.

AutoGen Framework: Deep Dive

AutoGen setzt auf Gespräche. Workflows werden als Dialoge zwischen Agenten – und teils zwischen Agenten und Menschen – modelliert. Das ist besonders hilfreich für iterative Schlussfolgerung, Aushandlung oder Supervision. Beispiel: Ein Agent schlägt eine Lösung vor, ein anderer kritisiert sie, eine Aufsichtsperson lenkt nach.

Der Speicher von AutoGen ist dialogzentriert und hält den vollständigen Gesprächsverlauf für mehrstufige Interaktionen. Diese nachrichtenbasierte Erinnerung erlaubt es, auf frühere Teile zurückzugreifen und darauf aufzubauen.

Das ist einfacher als strukturierter Speicher anderer Frameworks, spielt aber seine Stärke aus, wenn der natürliche Gesprächsfluss den Workflow bestimmt und Agenten den gesamten Kontext benötigen.

Die RoundRobinGroupChat-Funktion ist besonders stark: Mehrere Agenten wechseln sich ab, und jede Antwort wird an alle Teilnehmenden gesendet – so bleibt der Kontext konsistent. Ideal für das Reflection-Pattern, bei dem ein Agent entwirft und ein anderer bewertet oder kritisiert.

Hier ein AutoGen-Snippet mit einem Writer, einem Reviewer und einem User-Proxy im Gruppenchat:

import asyncio

from autogen_agentchat.conditions import TextMentionTermination

from autogen_agentchat.agents import UserProxyAgent, AssistantAgent

from autogen_agentchat.conditions import MaxMessageTermination

from autogen_agentchat.messages import TextMessage

from autogen_ext.models.openai import OpenAIChatCompletionClient

from autogen_agentchat.teams import RoundRobinGroupChat

from autogen_agentchat.ui import Console

async def simple_user_agent():

# Model client

model_client = OpenAIChatCompletionClient(model="gpt-4o")

# Writer agent

writer = AssistantAgent(

"Writer",

model_client=model_client,

system_message=(

"You are a professional writer. "

"Always respond with a detailed draft when asked. "

),

)

# Reviewer agent

reviewer = AssistantAgent(

"Reviewer",

model_client=model_client,

system_message=(

"You are a reviewer who critiques drafts and suggests improvements. "

),

)

# User proxy agent

user_proxy = UserProxyAgent("User")

# Termination conditions

termination = MaxMessageTermination(max_messages=8)

text_termination = TextMentionTermination("TERMINATE")

# Group chat with Writer, Reviewer, and User

team = RoundRobinGroupChat(

[writer, reviewer, user_proxy],

termination_condition=termination | text_termination,

max_turns=8,

)

# Run the group chat

await Console(

team.run_stream(

task=TextMessage(

source=user_proxy.name,

content="Please draft a comparison of CrewAI, LangGraph, and AutoGen."

),

)

)

if __name__ == "__main__":

asyncio.run(simple_user_agent())In diesem Setup erstellt der Writer einen Entwurf, der Reviewer bewertet ihn und gibt Feedback, und der User-Proxy repräsentiert die menschliche Teilnahme.

RoundRobinGroupChat sorgt dafür, dass alle der Reihe nach sprechen – die Diskussion bleibt strukturiert. Abbruchbedingungen wie Nachrichtenlimit oder Schlüsselwort steuern, wann der Chat endet. Das zeigt die Stärke von AutoGen: dynamische Agenten-Kollaboration, bei der Menschen jederzeit eingreifen können.

Use Cases und Anwendungen

Bei der Einordnung denke ich vom Problem her. Für einfache Automatisierung mit klaren Rollen – etwa ein „Data Fetcher“-Agent übergibt an einen „Writer“-Agent – ist CrewAI die naheliegendste Wahl. Die Organisationsmetapher passt perfekt.

Für komplexe Entscheidungs-Pipelines mit Verzweigungen ist LangGraph ideal. Stell dir ein mehrstufiges Support-System vor, dessen Pfad von Bedingungen wie Anliegen-Typ oder Eskalationsstufe abhängt. LangGraphs Graph-Design ist wie gemacht dafür.

Für Human-in-the-Loop-Systeme wiederum überzeugt AutoGen. Baue ich z. B. einen kollaborativen Research-Assistenten, der gemeinsam brainstormt und menschlich beaufsichtigt wird, fühlt sich AutoGens Konversationsarchitektur natürlich und effektiv an.

Technische Implementierungsaspekte

Aus Implementierungssicht zählen Performance, Skalierung und Integration. CrewAI skaliert über horizontale Agentenreplikation und Aufgabenparallelisierung innerhalb von Rollen. LangGraph skaliert über verteilte Graphausführung und parallele Knotenverarbeitung. AutoGen skaliert über Sharding von Gesprächen und verteiltes Chat-Management – mit der Herausforderung, Kontext konsistent zu halten.

Auch Integration ist wichtig: LangGraph profitiert vom LangChain-Ökosystem, während AutoGen auf Konversationsschnittstellen fokussiert und für klassische API-Integrationen ggf. zusätzliche Abstraktionen braucht. CrewAI integriert sich dank strukturierter, rollenbasierter Workflows gut in bestehende Geschäftssysteme.

Enterprise- und Produktionsreife

Im Enterprise-Kontext sind Lizenzierung und Compliance essenziell. CrewAI bietet kommerzielle Lizenzen mit Enterprise-Support. LangGraph, gestützt von LangChain, liefert Enterprise-Support und Consulting. AutoGen profitiert von Microsoft-Unterstützung über die Integration mit Azure AI Services.

Ebenso wichtig ist die Bereitstellung. CrewAI kann on-premises oder in der Cloud laufen – passend für strenge Data-Governance-Anforderungen.

LangGraphs Architektur integriert sich reibungslos in bestehende Enterprise-Systeme und APIs und bietet zwei ergänzende Services – LangGraph Studio für Design und Debugging sowie die LangGraph Platform für das Management von Deployments in großem Maßstab.

AutoGen profitiert von seiner Nähe zu Microsoft – ideal für Teams im Azure-Ökosystem. Außerdem gibt es Autogen Studio – noch in Entwicklung – als Low-Code-Oberfläche für schnelles Prototyping.

Letztlich bieten alle drei unterschiedliche Wege zum Deployment. Die richtige Wahl hängt davon ab, ob du lokale Kontrolle, modulare Integration oder nahtlose Cloud-Nutzung priorisierst.

Mit diesen Enterprise-Aspekten im Hinterkopf fassen wir zusammen und geben eine Auswahlhilfe.

Fazit

In diesem Tutorial hast du die Grundlagen von Multi-Agenten-KI-Frameworks kennengelernt und drei Ansätze erkundet: CrewAI, LangGraph und AutoGen. CrewAI überzeugt bei rollenbasierter Zusammenarbeit, LangGraph bei graphgesteuerter Orchestrierung, und AutoGen bei konversationalen, Human-in-the-Loop-Systemen.

Die Kernaussage: Es gibt kein Framework, das immer „besser“ ist. Es hängt von deinem Bedarf ab. Schätzt du klare Rollen, passt CrewAI. Braucht dein Workflow adaptive Verzweigungen, ist LangGraph stark. Sollen Agenten konversational kooperieren, bietet AutoGen viel Flexibilität.

Probier alle drei aus. Kleine Prototypen zeigen am schnellsten, wo Stärken und Grenzen liegen – und was sich für deine Workflows am natürlichsten anfühlt und zu deinen Zielen passt.

Zum Weiterlesen empfehle ich:

CrewAI vs LangGraph vs AutoGen FAQs

Wie unterscheidet sich die Aufgabenverteilung in CrewAI von LangGraph und AutoGen?

CrewAI nutzt rollenbasierte Aufgabenverteilung und mappt Agenten auf Verantwortlichkeiten. LangGraph arbeitet mit Workflow-Graphen, AutoGen mit Gesprächsrunden.

Was sind die Hauptunterschiede in der Agenten-Zusammenarbeit zwischen CrewAI und LangGraph?

CrewAI kollaboriert über Rollenzuteilung, während LangGraph Agenten als Knoten in einem Workflow-Graphen mit Verzweigungen und strukturiertem Zustand verbindet.

Wie unterscheidet sich AutoGens Agent-zu-Agent-Chat vom rollenbasierten Design von CrewAI?

AutoGen setzt auf konversationale Gruppenchats, in denen Agenten sich gegenseitig entwerfen und kritisieren. CrewAI erzwingt strukturierte, rollenbasierte Übergaben.

Welches Framework bietet die beste Unterstützung für Human-in-the-Loop-Systeme?

Alle drei unterstützen menschliche Beteiligung: CrewAI integriert Prüfpunkte, LangGraph bietet Pause-/Resume-Hooks, AutoGen bindet Menschen direkt in Gespräche ein.

Wie vergleichen sich die Speicherfunktionen von LangGraph mit denen von CrewAI und AutoGen?

LangGraph liefert zustandsbasierten Speicher mit Checkpointing und Persistenz. CrewAI nutzt strukturierten, rollenbasierten Speicher mit RAG, AutoGen speichert den Gesprächsverlauf.

Als Gründer von Martin Data Solutions und freiberuflicher Datenwissenschaftler, ML- und KI-Ingenieur bringe ich ein vielfältiges Portfolio in den Bereichen Regression, Klassifizierung, NLP, LLM, RAG, Neuronale Netze, Ensemble-Methoden und Computer Vision mit.

- Er hat erfolgreich mehrere End-to-End-ML-Projekte entwickelt, einschließlich Datenbereinigung, Analyse, Modellierung und Bereitstellung auf AWS und GCP, und dabei wirkungsvolle und skalierbare Lösungen geliefert.

- Du hast mit Streamlit und Gradio interaktive und skalierbare Webanwendungen für verschiedene Branchen entwickelt.

- Er unterrichtete und betreute Studierende in den Bereichen Datenwissenschaft und Analytik und förderte ihre berufliche Entwicklung durch personalisierte Lernansätze.

- Entwickelte Kursinhalte für Retrieval-Augmented-Generating (RAG)-Anwendungen, die auf die Anforderungen von Unternehmen zugeschnitten sind.

- Er hat hochwirksame technische Blogs zu Themen wie MLOps, Vektordatenbanken und LLMs verfasst und damit ein hohes Maß an Engagement erzielt.

Bei jedem Projekt, das ich übernehme, achte ich darauf, dass ich die neuesten Praktiken des Software-Engineerings und der DevOps anwende, wie CI/CD, Code Linting, Formatierung, Modellüberwachung, Experiment-Tracking und robuste Fehlerbehandlung. Ich biete Komplettlösungen an und verwandle Datenerkenntnisse in praktische Strategien, die Unternehmen dabei helfen, zu wachsen und das Beste aus Data Science, maschinellem Lernen und KI herauszuholen.