Curso

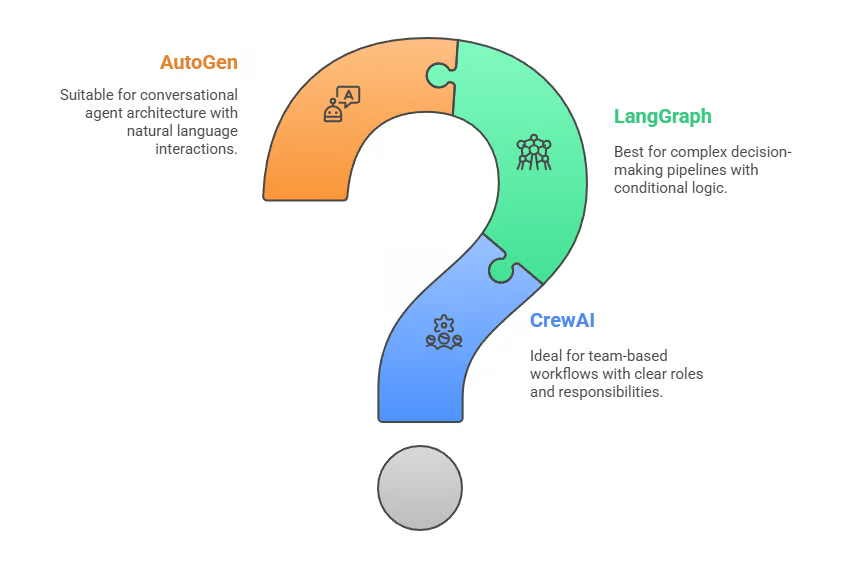

Neste tutorial, vou apresentar uma comparação detalhada de três dos principais frameworks de IA multiagente: CrewAI, LangGraph e AutoGen. No último ano, a discussão sobre sistemas multiagentes cresceu rápido — e com razão. À medida que a IA evolui, construir aplicativos com um único agente inteligente muitas vezes não é suficiente. Em vez disso, desenvolvedores estão percebendo que orquestrar vários agentes, cada um com papéis e responsabilidades específicas, gera soluções mais adaptáveis e confiáveis.

A importância desta comparação está na forma como cada framework encara o desafio da coordenação multiagente. CrewAI adota um modelo baseado em papéis, inspirado em estruturas organizacionais reais, LangGraph abraça um fluxo de trabalho baseado em grafos, e AutoGen foca na colaboração por conversas. Cada framework traz filosofias de design, forças e trade-offs próprios.

Meu objetivo aqui é destacar essas diferenças com explicações práticas e exemplos concisos, para você tomar uma decisão informada ao escolher um para o seu projeto.

Se você está começando com aplicativos de IA, vale a pena conferir nossos cursos, como AI Fundamentals, Developing AI Applications ou Retrieval Augmented Generation (RAG) with LangChain.

O que é um agente de IA?

Antes de mergulhar nos frameworks, vale alinhar o que significa “agente” neste contexto. Em frameworks de IA multiagente, um agente é mais do que um simples wrapper de prompt em torno de um grande modelo de linguagem. Ele é uma entidade autônoma, com um papel definido, ferramentas que pode usar, memória a que pode acessar e comportamentos que segue. Agentes podem trabalhar de forma independente ou colaborar com outros agentes para resolver problemas que seriam complexos demais para um único agente.

Eu enxergo um agente como tomador de decisão e colaborador ao mesmo tempo. Ele recebe entradas, raciocina sobre elas, executa ações (às vezes por meio de ferramentas externas) e se comunica com outros agentes quando necessário.

Por exemplo, um agente pode ser responsável por coletar dados, outro por analisá-los e outro por reportar resultados. Juntos, formam um sistema de inteligência colaborativa.

No entanto, agentes nem sempre são a melhor escolha. Se seu fluxo é direto — como buscar dados de uma única API e exibir resultados — um script simples ou a orquestração com um único agente pode ser mais eficiente. Sistemas multiagentes brilham quando as tarefas exigem coordenação, especialização ou adaptação dinâmica.

Entendendo frameworks de IA multiagente

Frameworks multiagentes expandem o paradigma de agente único para sistemas que suportam colaboração, delegação e fluxos de trabalho adaptativos. Eles dão vida à ideia de inteligência colaborativa, em que diferentes agentes se especializam em partes de um problema e se comunicam para alcançar um objetivo comum.

Essa abordagem reflete como times funcionam nas organizações, com especialistas trabalhando juntos sob uma camada de orquestração.

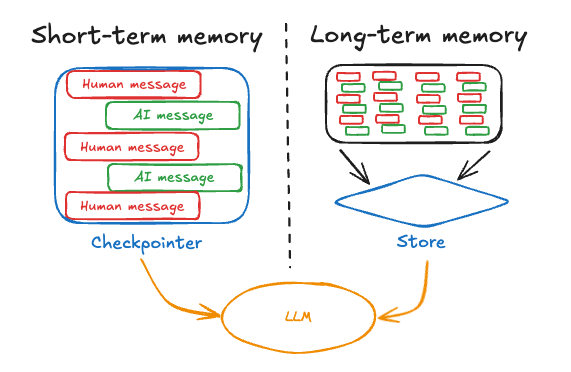

Os componentes-chave desses frameworks costumam incluir gerenciamento de estado, protocolos de comunicação e sistemas de memória. Memória merece atenção especial porque permite que agentes relembrem interações anteriores e tomem decisões mais informadas.

A memória de curto prazo permite manter o contexto durante interações imediatas. A de longo prazo possibilita aprender com experiências passadas e construir bases de conhecimento. Já a memória persistente garante que informações importantes sobrevivam a reinícios do sistema e possam ser acessadas entre sessões.

Habilitando esses componentes, frameworks multiagentes suportam arquiteturas flexíveis para problemas que vão de automação de workflows a análises de pesquisa. A escolha do framework depende do nível de controle, flexibilidade e escalabilidade que seu projeto precisa.

Visão geral: CrewAI, LangGraph e AutoGen

Agora que temos uma base comum sobre agentes e frameworks multiagentes, vamos apresentar rapidamente nossos três alvos de comparação.

O CrewAI destaca a colaboração guiada por papéis com uma metáfora inspirada no ambiente de trabalho. Cada agente tem um papel, responsabilidades e acesso a ferramentas, tornando o sistema intuitivo para fluxos de trabalho em equipe.

O framework se destaca em colaboração orientada a tarefas, quando papéis e responsabilidades claros impulsionam a execução eficiente. A força do CrewAI está em sua abordagem intuitiva de coordenação entre agentes e no suporte nativo a padrões comuns de workflows de negócios.

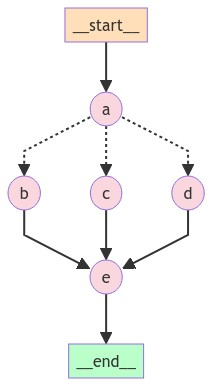

O LangGraph adota um design de workflow baseado em grafos que trata interações entre agentes como nós em um grafo direcionado. Essa arquitetura oferece flexibilidade excepcional para pipelines complexos de decisão com lógica condicional, ramificações e adaptação dinâmica.

O LangGraph brilha em cenários que exigem orquestração sofisticada, com múltiplos pontos de decisão e processamento em paralelo.

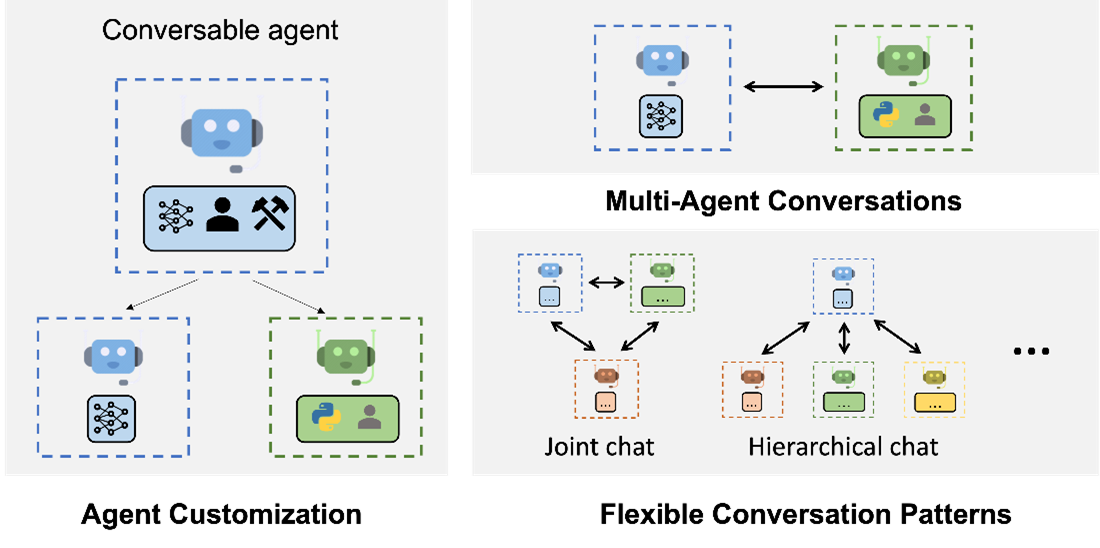

AutoGen foca na arquitetura de agentes conversacionais, enfatizando interações em linguagem natural e dinâmicas de role-playing. O framework se destaca na criação de fluxos de trabalho guiados por conversas, em que agentes podem adaptar seus papéis conforme o contexto. A força do AutoGen está no protótipo rápido e em cenários com humano-no-loop, onde a interação em linguagem natural é essencial.

Visão geral de CrewAI, LangGraph e AutoGen

Comparação detalhada: CrewAI vs LangGraph vs AutoGen

Cada framework aborda a orquestração multiagente por um ângulo diferente. O CrewAI enfatiza a atribuição de papéis, o LangGraph enfatiza a estrutura do workflow e o AutoGen enfatiza a conversa.

Essas diferenças afetam como desenvolvedores projetam, gerenciam e escalam seus sistemas — entender isso é essencial antes de escolher.

Vamos destrinchar essas diferenças em várias dimensões importantes, começando pela arquitetura.

Diferenças de arquitetura

A arquitetura é a base de cada framework. O CrewAI segue um modelo baseado em papéis, no qual agentes se comportam como colaboradores com responsabilidades específicas. Isso facilita visualizar os fluxos como trabalho em equipe.

O LangGraph, por contraste, foca na orquestração baseada em grafos, em que fluxos são representados como nós e arestas, permitindo execução altamente modular e condicional.

O AutoGen segue por outro caminho, modelando interações como conversas entre agentes ou entre agentes e humanos, criando um fluxo natural guiado por diálogos.

Facilidade de uso

Em facilidade de uso, o CrewAI é intuitivo para quem pensa em termos de papéis e tarefas. Você define agentes com objetivos e deixa que colaborem.

O LangGraph exige um entendimento mais profundo de design de grafos — tem uma curva de aprendizado, mas recompensa com mais controle sobre a lógica do workflow.

O AutoGen é conversacional na essência, o que facilita começar projetos pequenos, mantendo flexibilidade para evoluir iterativamente.

Ferramentas e integrações suportadas

Em integrações, os três frameworks oferecem amplo suporte a APIs e ferramentas externas. O CrewAI traz integrações nativas com serviços e ferramentas de nuvem comuns.

O LangGraph se beneficia de todo o ecossistema LangChain, com integrações amplas com APIs e sistemas externos.

Já o AutoGen prioriza o uso de ferramentas dentro das conversas e permite participação humana direta, o que aumenta a flexibilidade em fluxos iterativos ou com revisões frequentes.

Suporte e tipos de memória

O suporte à memória varia bastante entre os frameworks. O CrewAI usa memória estruturada, baseada em papéis, com suporte a RAG para comportamento contextual de agentes.

O LangGraph oferece memória baseada em estado, com checkpointing para continuidade do workflow.

O AutoGen foca em memória baseada em conversas, mantendo o histórico de diálogos para interações de múltiplos turnos. Cada abordagem reflete a filosofia central do framework.

Saída estruturada

Tratar saídas estruturadas é outro ponto de contraste. O CrewAI impõe estrutura pela sua lógica de papéis — agentes produzem resultados alinhados às suas responsabilidades.

O LangGraph se destaca aqui graças aos grafos de estado, que podem impor formatos e transições bem definidos.

O AutoGen, por ser mais orientado à conversa, gera saídas flexíveis, cuja consistência pode variar conforme a orquestração do diálogo.

Suporte multiagente

Os três frameworks oferecem capacidades multiagentes, mas os modelos de colaboração diferem.

O CrewAI foca na atribuição de papéis, com responsabilidades bem definidas para cada agente — a coordenação parece um time estruturado.

O LangGraph habilita colaboração no nível do workflow, tratando cada agente ou função como um nó do grafo, permitindo interações por transições de estado estruturadas e ramificações condicionais.

O AutoGen enfatiza modelos de chat em grupo, nos quais agentes conversam entre si e com humanos em linguagem natural — colaboração dinâmica, menos rígida, mas também menos previsível.

Recursos de humano-no-loop

Supervisão humana é um diferencial importante entre esses frameworks. O CrewAI integra checkpoints humanos diretamente na execução das tarefas, permitindo revisão ou ajuste antes de avançar.

O LangGraph fornece ganchos de humano-no-loop nos seus grafos de workflow, permitindo pausar a execução, coletar input do usuário e retomar do mesmo estado.

O AutoGen torna a participação humana parte do próprio fluxo conversacional, com um agente proxy do usuário que pode intervir a qualquer momento para orientar ou redirecionar o diálogo.

Essa flexibilidade torna o AutoGen especialmente forte para fluxos interativos ou centrados em revisão, enquanto CrewAI e LangGraph oferecem mecanismos mais estruturados de intervenção.

Cache e replay

Para cache e replay, o CrewAI inclui uma ferramenta abrangente de cache com tratamento de erros embutido para manter as tarefas em execução suave.

O LangGraph suporta cache em nível de nó com back-ends como memória ou SQLite e oferece replay e depuração via LangGraph Studio.

O AutoGen foca em cache de LLM com back-ends como disco ou Redis, permitindo caches compartilhados entre agentes para reduzir custos e aumentar a reprodutibilidade.

Execução de código

Em execução de código, o CrewAI permite executar por meio de ferramentas atribuídas (CodeInterpreterTool), mantendo sua filosofia baseada em papéis.

O LangGraph permite execução de código nativa e externa dentro de seus nós, oferecendo mais flexibilidade para workflows computacionais.

O AutoGen integra a execução diretamente nas conversas, onde agentes (CodeExecutorAgent) podem rodar e avaliar trechos como parte do diálogo.

Personalização

Em personalização, os três são fortes, mas de formas diferentes. O CrewAI é altamente customizável — dentro do seu paradigma centrado em papéis.

O LangGraph oferece a modularidade máxima, permitindo desenhar workflows altamente especializados com lógica condicional.

O AutoGen traz flexibilidade conversacional para criar diálogos multiagentes criativos, embora com menos formalidade estrutural.

Escalabilidade

A escalabilidade também varia. O CrewAI suporta escalar por execução paralela de tarefas e replicação horizontal de agentes dentro de papéis definidos.

O LangGraph é desenhado para escalar desde o início, já que workflows baseados em grafos podem se expandir para sistemas distribuídos de grande porte.

O AutoGen escala pelo lado conversacional, permitindo que múltiplos agentes colaborem em grupos maiores, embora tenha limitações para aplicações em larga escala.

Documentação e comunidade

Por fim, documentação e comunidade são vitais para o sucesso de longo prazo de qualquer framework.

O CrewAI vem construindo uma base de desenvolvedores, com mais projetos orientados a papéis e primeiros casos práticos sendo compartilhados.

O LangGraph se beneficia de fazer parte do ecossistema LangChain, com documentação extensa, tutoriais e uma comunidade ativa.

O AutoGen, embora menos maduro, oferece documentação clara, comunidade ativa e uma lista ampla de tutoriais.

Tabela comparativa

A tabela a seguir resume as principais diferenças entre CrewAI, LangGraph e AutoGen nas dimensões mais importantes, para apoiar sua decisão de escolha.

|

Recurso |

CrewAI |

LangGraph |

AutoGen |

|

Arquitetura |

Estrutura organizacional baseada em papéis |

Workflows em grafo com nós e arestas |

Interações conversacionais multiagente |

|

Facilidade de uso |

Atribuição de papéis intuitiva |

Curva de aprendizado moderada (design de grafos) |

Configuração conversacional simples |

|

Suporte a memória |

Memória por papel Curto/Longo prazo Entidades Contextual |

Baseada em estado Curto/Longo prazo Checkpointing |

Baseada em mensagens Curto prazo Histórico de conversa |

|

Integrações |

Ferramentas de nuvem Workflows de negócios |

LangChain Ecossistema Plataforma/Studio |

Integrações de ferramentas |

|

Suporte multiagente |

Sim |

Sim |

Sim |

|

Saída estruturada |

Imposta por papéis |

Forte, baseada em estado Formato estrito |

Flexível |

|

Cache e replay |

Cache de ferramentas |

Cache em nível de nó |

Cache de LLM |

|

Execução de código |

Baseada em ferramentas |

Nativo/externo |

Integrada |

|

Humano-no-loop |

Sim |

Sim |

Sim |

|

Personalização |

Alta, dentro do paradigma de papéis |

Modularidade máxima Design com lógica condicional |

Flexibilidade conversacional |

|

Escalabilidade |

Paralelização de tarefas |

Execução distribuída do grafo |

Suporte limitado em larga escala |

|

Documentação Comunidade |

Base de devs em crescimento |

Ecossistema LangChain bem estabelecido |

Docs claras Crescimento contínuo |

Tabela comparativa: CrewAI vs LangGraph vs Autogen

Quando escolher cada um

-

Escolha o CrewAI se seu projeto se encaixa naturalmente em papéis e responsabilidades (ex.: um pesquisador repassando o trabalho a um redator). Ele é intuitivo para fluxos parecidos com equipes, suporta memória estruturada e facilita inserir checkpoints humanos.

-

Escolha o LangGraph se você precisa de orquestração complexa com lógica de ramificação. Seu design em grafo é ideal para workflows adaptativos, execução condicional e projetos que podem escalar para sistemas distribuídos.

-

Escolha o AutoGen se você quer colaboração guiada por conversas com supervisão humana flexível. Ele é ótimo para tarefas iterativas, brainstorming ou fluxos com muita revisão, em que a linguagem natural organiza o trabalho.

Agora que comparamos os frameworks em alto nível, vamos examinar cada um em detalhe, começando pela abordagem baseada em papéis do CrewAI.

CrewAI em profundidade

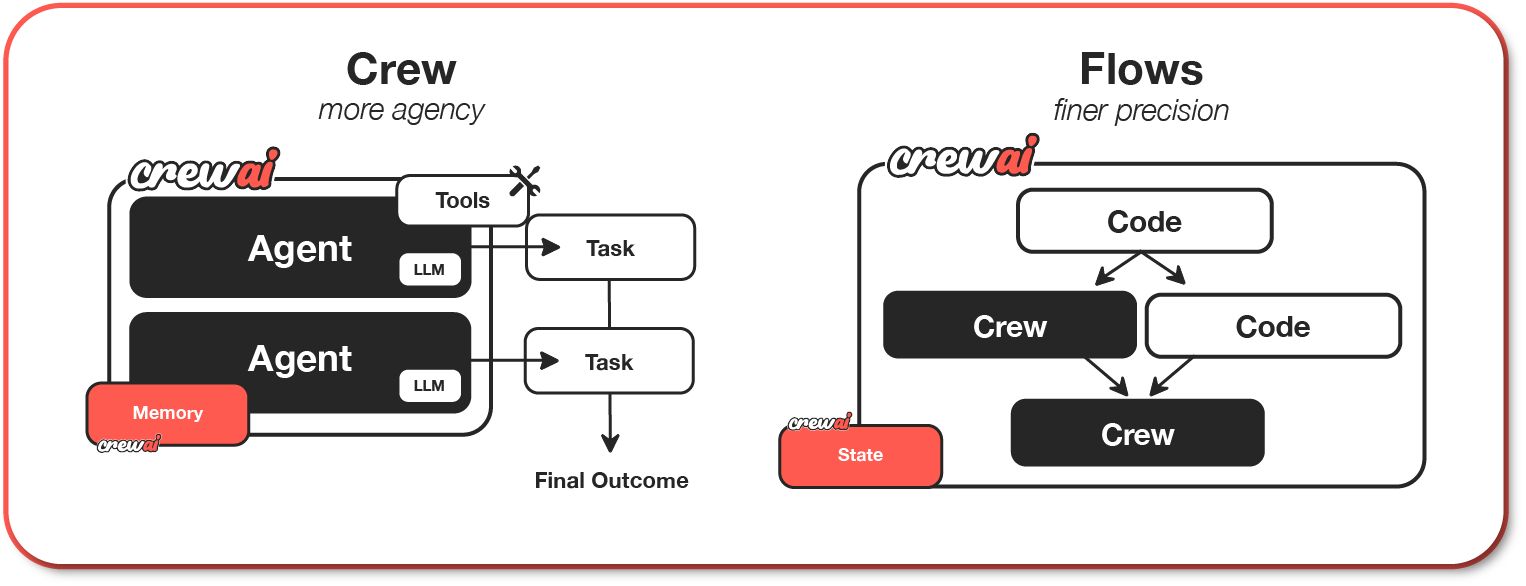

O CrewAI é construído em torno da metáfora de uma organização. Agentes são tratados como colaboradores, cada um com um papel e um conjunto de responsabilidades.

Por exemplo, um agente pode atuar como “pesquisador”, coletando dados, enquanto outro atua como “redator”, preparando relatórios. Essa divisão de trabalho torna o CrewAI particularmente intuitivo em cenários onde papéis e responsabilidades já existem.

Arquitetura do CrewAI

O sistema de memória do CrewAI reflete essa estrutura organizacional. Cada agente mantém uma memória específica do seu papel, incluindo contexto de tarefas, relações entre entidades e conhecimento acumulado.

O framework suporta múltiplas camadas de memória: curto prazo para o contexto imediato, longo prazo para aprendizados entre sessões, memória de entidades para rastrear pessoas e conceitos, e memória contextual que conecta tudo.

Essa abordagem estruturada permite que um agente pesquisador construa conhecimento ao longo do tempo enquanto um agente redator mantém preferências de estilo e histórico de escrita. O suporte a humano-no-loop também é nativo, permitindo que supervisores aprovem ou modifiquem saídas antes de avançar.

Aqui vai um snippet simples do CrewAI em que eu defino um agente de pesquisa:

from crewai import Agent, Task, Crew

# Environment variables

os.environ["OPENAI_API_KEY"] = "your-api-key"

os.environ["OPENAI_API_BASE"] = "https://api.your-provider.com/v1"

os.environ["OPENAI_MODEL_NAME"] = "your-model-name"

# Define agents

researcher = Agent(

role="Researcher",

goal="Gather information on AI frameworks",

backstory="Expert in technical research and summarization",

)

writer = Agent(

role="Writer",

goal="Prepare well-structured reports",

backstory="Skilled technical writer who explains concepts clearly",

)

# Define tasks

research_task = Task(

description="Find details on CrewAI, LangGraph, and AutoGen",

expected_output="A structured summary of each framework, including use cases and differences.",

agent=researcher,

output_file="output/research_notes.md",

human_input=True

)

writing_task = Task(

description="Turn the research notes into a polished article section",

expected_output="A readable, clear article comparing the three frameworks.",

agent=writer,

output_file="output/final_article.md",

human_input=True

)

# Create a crew with both agents and tasks

crew = Crew(

agents=[researcher, writer],

tasks=[research_task, writing_task]

)

# Run the crew

result = crew.kickoff()

print(result)Nesse fluxo, o agente pesquisador reúne informações e produz notas estruturadas, que são salvas em arquivo. Um humano pode revisar ou lapidar as notas antes de seguir. Em seguida, o agente redator transforma as notas em uma seção de artigo finalizada, novamente com opção de revisão humana antes da conclusão.

O CrewAI coordena o processo, garantindo que os agentes se mantenham alinhados aos seus papéis enquanto humanos mantêm o controle em pontos-chave. A sensação é de uma pequena equipe editorial trabalhando junta — exatamente o que o CrewAI se propõe a modelar.

O CrewAI também introduz Flows, que complementam as Crews para oferecer controle de workflow mais granular. Enquanto Crews representam times autônomos de agentes trabalhando juntos, Flows são pipelines orientados a eventos, prontos para produção, que gerenciam caminhos de execução, estado e lógica de ramificação.

Isso significa combinar a flexibilidade de decisões autônomas nas Crews com a precisão da orquestração estruturada nos Flows.

Enquanto o CrewAI enquadra a colaboração em termos de papéis e responsabilidades, o LangGraph enfatiza estrutura e lógica, tratando workflows como nós interconectados em um grafo.

LangGraph em profundidade

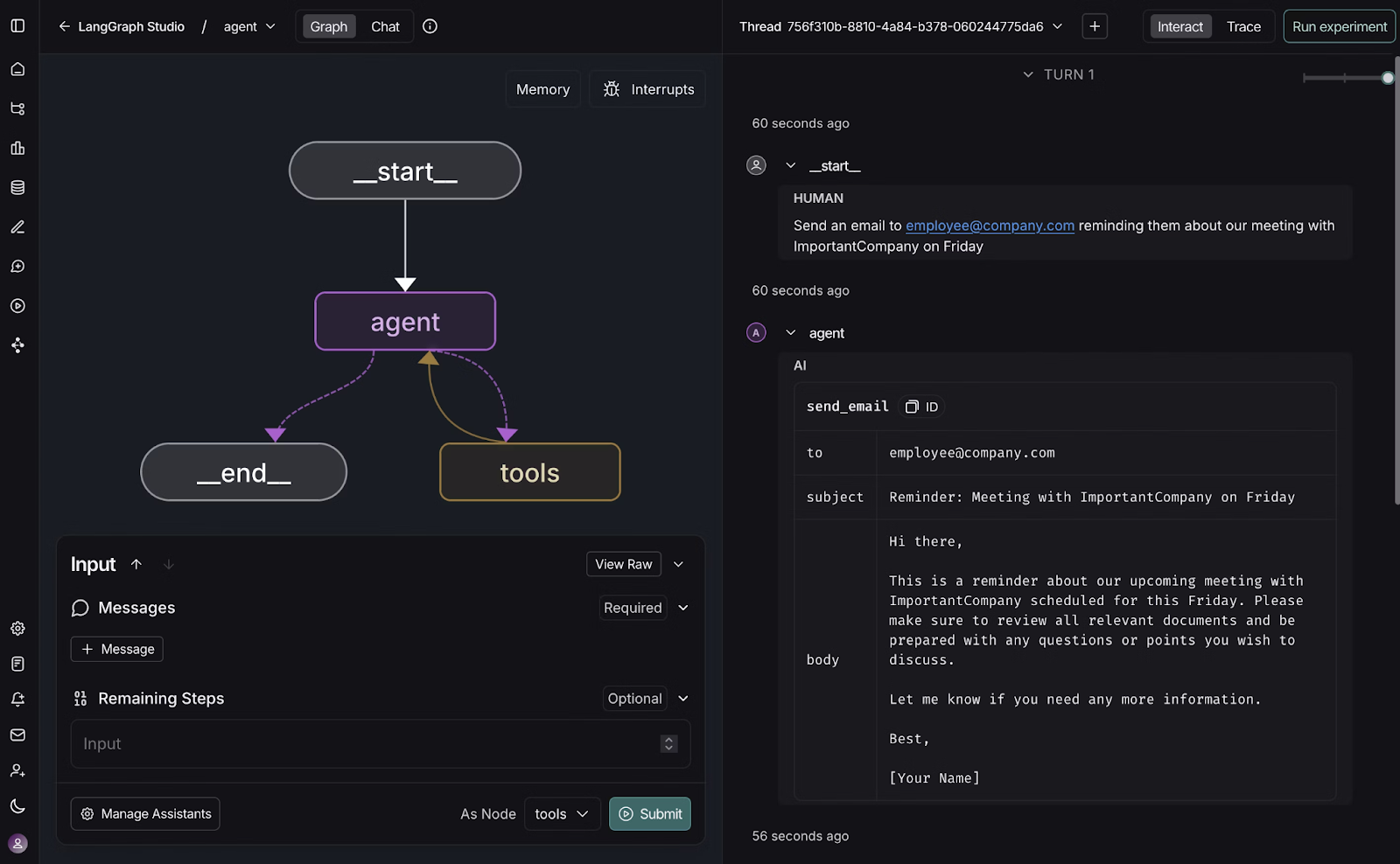

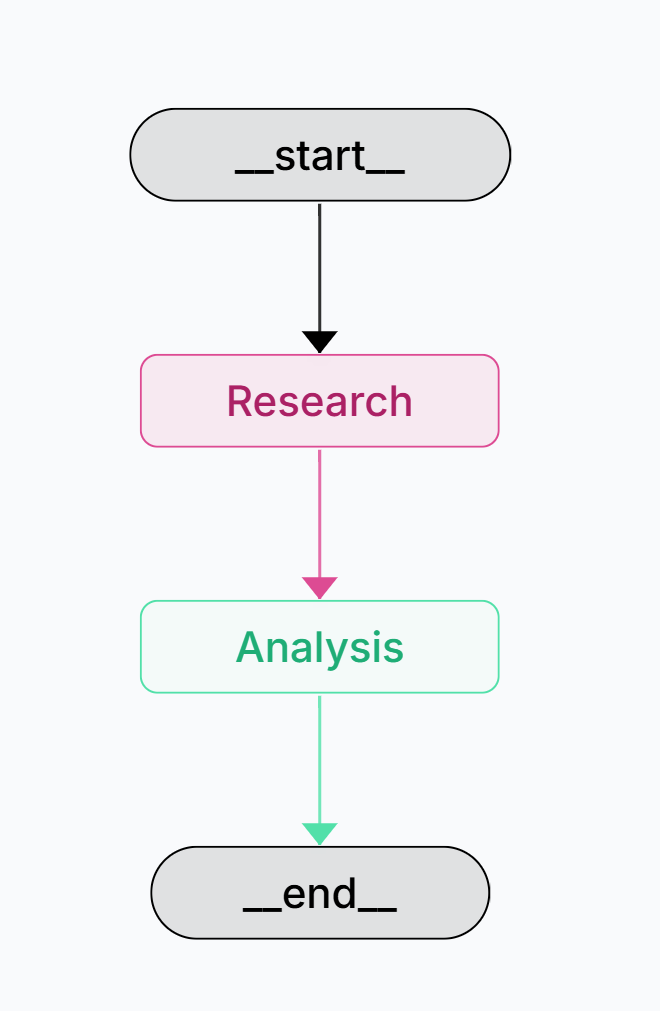

O LangGraph adota uma abordagem diferente, representando workflows como grafos de nós. Cada nó pode ser um agente, uma função ou um ponto de decisão. O sistema suporta ramificações condicionais, permitindo adaptação dinâmica com base nos resultados. Isso torna o LangGraph poderoso para orquestrar pipelines complexos de decisão, em que tarefas dependem de resultados anteriores.

Arquitetura de ramificação do LangGraph

O LangGraph também oferece recursos fortes de memória, que operam como parte do estado do grafo. A memória de curto prazo persiste dentro de threads ativas e pode ser checkpointada em qualquer nó, permitindo pausar e retomar workflows.

A memória de longo prazo armazena dados específicos do usuário ou de nível de aplicação, que persistem em diferentes execuções de workflow. Essa abordagem baseada em estado é poderosa para workflows complexos em que decisões em um nó influenciam o comportamento em nós posteriores, inclusive entre sessões.

Sistema de memória do LangGraph

LangGraph Studio, seu ambiente visual de desenvolvimento, facilita ainda mais a construção e depuração desses workflows.

Aqui vai um snippet do LangGraph que configura um workflow com dois agentes: um nó de pesquisa que coleta informações e um nó de análise que interpreta os resultados.

from langchain_openai import ChatOpenAI

from typing import Annotated

from typing_extensions import TypedDict

import os

from langchain.schema import HumanMessage

from langgraph.graph import StateGraph, START, END

from langgraph.graph.message import add_messages

# Environment variables

os.environ["OPENAI_API_KEY"] = "your-api-key"

llm = ChatOpenAI(

model="gpt-4o-mini",

)

# Define the graph state

class State(TypedDict):

messages: Annotated[list, add_messages]

# Define nodes powered by the LLM

def research_node(state: State):

"""Research agent: collects information using the LLM."""

prompt = "You are a researcher. Collect detailed information.\nUser query: "

user_query = state["messages"][-1].content

response = llm.invoke(prompt + user_query)

return {"messages": [response]}

def analysis_node(state: State):

"""Analysis agent: analyzes research results with the LLM."""

research_output = state["messages"][-1].content

prompt = "You are an analyst. Provide insights based on this research:\n"

response = llm.invoke(prompt + research_output)

return {"messages": [response]}

# Build the graph

graph_builder = StateGraph(State)

# Add nodes

graph_builder.add_node("Research", research_node)

graph_builder.add_node("Analysis", analysis_node)

# Add edges (workflow order)

graph_builder.add_edge(START, "Research")

graph_builder.add_edge("Research", "Analysis")

graph_builder.add_edge("Analysis", END)

# Compile the graph

graph = graph_builder.compile()

# Run the workflow

if __name__ == "__main__":

initial_messages = [HumanMessage(content="Please draft a comparison of CrewAI, LangGraph, and AutoGen.")]

result = graph.invoke({"messages": initial_messages})

print(f"Research and Analysis Complete. {result}")

print("\nFinal Report:")

for msg in result["messages"]:

print(f"{type(msg).__name__}: {msg.content}")

Workflow de pesquisa e análise

Nesse fluxo, o nó de pesquisa coleta informações brutas sobre a solicitação do usuário, e o nó de análise constrói insights a partir desses resultados. As arestas definem a ordem de execução — concluída a pesquisa, o grafo encaminha automaticamente a saída para o analista.

Isso ilustra como o LangGraph formaliza workflows como grafos modulares, facilitando projetar pipelines em que cada etapa depende do resultado da anterior. Diferente da metáfora de papéis do CrewAI ou das conversas livres do AutoGen, o LangGraph dá controle estrutural fino sobre como os agentes colaboram.

Enquanto o LangGraph enfatiza workflows estruturados, o AutoGen foca a conversa como princípio organizador.

AutoGen em profundidade

O AutoGen enfatiza a conversa. Ele modela workflows como diálogos entre agentes — e às vezes entre agentes e humanos. Essa abordagem conversacional é especialmente útil para tarefas que exigem raciocínio iterativo, negociação ou supervisão. Por exemplo, um agente propõe uma solução, outro a critica, e um supervisor humano pode intervir para orientar a discussão.

A memória do AutoGen é centrada na conversa, armazenando todo o histórico do diálogo para manter o contexto em interações de vários turnos. Essa memória baseada em mensagens permite que agentes façam referência a partes anteriores da conversa e construam sobre trocas anteriores.

Embora mais simples que a memória estruturada de outros frameworks, essa abordagem se destaca quando o fluxo natural da conversa guia o trabalho e os agentes precisam manter consciência de todo o contexto do diálogo.

O recurso RoundRobinGroupChat é especialmente poderoso. Ele permite colaboração entre vários agentes em turnos, com cada resposta transmitida a todos os participantes para manter contexto consistente. Esse design facilita implementar o padrão de reflexão, em que um agente cria um rascunho e outro o avalia ou critica.

Aqui vai um snippet do AutoGen que configura um chat em grupo com um redator, um revisor e um proxy de usuário:

import asyncio

from autogen_agentchat.conditions import TextMentionTermination

from autogen_agentchat.agents import UserProxyAgent, AssistantAgent

from autogen_agentchat.conditions import MaxMessageTermination

from autogen_agentchat.messages import TextMessage

from autogen_ext.models.openai import OpenAIChatCompletionClient

from autogen_agentchat.teams import RoundRobinGroupChat

from autogen_agentchat.ui import Console

async def simple_user_agent():

# Model client

model_client = OpenAIChatCompletionClient(model="gpt-4o")

# Writer agent

writer = AssistantAgent(

"Writer",

model_client=model_client,

system_message=(

"You are a professional writer. "

"Always respond with a detailed draft when asked. "

),

)

# Reviewer agent

reviewer = AssistantAgent(

"Reviewer",

model_client=model_client,

system_message=(

"You are a reviewer who critiques drafts and suggests improvements. "

),

)

# User proxy agent

user_proxy = UserProxyAgent("User")

# Termination conditions

termination = MaxMessageTermination(max_messages=8)

text_termination = TextMentionTermination("TERMINATE")

# Group chat with Writer, Reviewer, and User

team = RoundRobinGroupChat(

[writer, reviewer, user_proxy],

termination_condition=termination | text_termination,

max_turns=8,

)

# Run the group chat

await Console(

team.run_stream(

task=TextMessage(

source=user_proxy.name,

content="Please draft a comparison of CrewAI, LangGraph, and AutoGen."

),

)

)

if __name__ == "__main__":

asyncio.run(simple_user_agent())Nesse fluxo, o agente redator gera um rascunho, o revisor avalia e fornece feedback, e o proxy do usuário representa o participante humano.

O RoundRobinGroupChat garante que cada participante fale por turno, mantendo a discussão organizada. Condições de término, como limite de mensagens ou palavra-chave específica, dão controle sobre quando o chat termina. Esse setup ilustra a força conversacional do AutoGen: agentes colaboram de forma dinâmica, enquanto humanos podem intervir a qualquer momento para orientar.

Cenários de uso e aplicações

Ao pensar onde cada framework se encaixa melhor, costumo mapear pela natureza do problema. Se preciso de automação simples de workflow com papéis claros — por exemplo, um agente “buscador de dados” repassando resultados a um agente “redator” — o CrewAI é o mais natural. Sua metáfora organizacional combina perfeitamente com esses cenários.

Para pipelines complexos de tomada de decisão que exigem lógica de ramificação, o LangGraph se sobressai. Imagine orquestrar um sistema de suporte ao cliente em múltiplas etapas, em que o caminho depende de condições como tipo de problema ou nível de escalonamento. O design em grafo do LangGraph é ideal para esses workflows adaptativos.

Por fim, para sistemas com humano-no-loop, o AutoGen brilha. Se estou construindo um assistente de pesquisa colaborativo, em que agentes fazem brainstorming juntos e um humano supervisiona, a arquitetura conversacional do AutoGen é natural e eficiente.

Considerações técnicas de implementação

Do ponto de vista de implementação, desempenho, escalabilidade e integração são cruciais. O CrewAI escala por replicação horizontal de agentes e paralelização de tarefas dentro de hierarquias de papéis. O LangGraph escala por execução distribuída do grafo e processamento paralelo de nós. O AutoGen escala por sharding de conversas e gestão distribuída de chats — com desafios próprios para manter o contexto.

Integração é outro fator. O LangGraph se beneficia do ecossistema LangChain, enquanto o AutoGen foca interfaces conversacionais e pode exigir camadas adicionais de abstração para integrações de API tradicionais. O CrewAI integra bem com sistemas de negócios existentes graças à sua abordagem estruturada de workflows baseados em papéis.

Prontidão para enterprise e produção

Em contextos enterprise, licenciamento e compliance não podem ser ignorados. O CrewAI oferece licenciamento comercial com opções de suporte corporativo. O LangGraph, respaldado pela LangChain, fornece suporte enterprise e serviços de consultoria. O AutoGen conta com suporte da Microsoft por meio de sua integração com os serviços Azure AI.

Igualmente importante é a flexibilidade de deployment. O CrewAI pode ser implantado on-premises ou na nuvem, o que é ideal para organizações com exigências rígidas de governança de dados.

A arquitetura do LangGraph integra-se suavemente a sistemas e APIs corporativos existentes e oferece dois serviços complementares — o LangGraph Studio para design e depuração de workflows e a LangGraph Platform para gerenciar deployments em escala.

O AutoGen se beneficia de seus laços nativos com a Microsoft, sendo uma escolha natural para times já investidos no ecossistema Azure. Ele também oferece o Autogen Studio, ainda em desenvolvimento, uma interface low-code para prototipagem rápida.

No fim, cada framework oferece um caminho de deployment diferente — a opção certa depende de a organização priorizar controle local, integração modular ou adoção fluida em nuvem.

Com essas considerações para enterprise em mente, vamos resumir os aprendizados e indicar como escolher.

Conclusão

Ao longo deste tutorial, percorremos as bases dos frameworks de IA multiagente e exploramos três abordagens distintas: CrewAI, LangGraph e AutoGen. O CrewAI se destaca pela colaboração baseada em papéis; o LangGraph brilha na orquestração guiada por grafos; e o AutoGen prospera em sistemas conversacionais com humano-no-loop.

A principal lição é: não existe um framework universalmente melhor. A escolha depende das necessidades do seu projeto. Se você valoriza papéis estruturados, o CrewAI pode ser o ideal. Se seu fluxo exige ramificações adaptativas, o LangGraph deve te atender bem. Se quer colaboração conversacional entre agentes, o AutoGen oferece um ambiente flexível.

Recomendo experimentar cada framework. A melhor forma de entender forças e limitações é criar pequenos protótipos e observar o comportamento nas suas tarefas. Assim, você vai descobrir qual se encaixa melhor nos seus fluxos e nos seus objetivos de longo prazo.

Para continuar aprendendo, confira estes recursos:

CrewAI vs LangGraph vs AutoGen: perguntas frequentes

Como o CrewAI lida com a delegação de tarefas em comparação ao LangGraph e ao AutoGen?

O CrewAI usa delegação de tarefas baseada em papéis, mapeando agentes para responsabilidades. O LangGraph usa grafos de workflow, enquanto o AutoGen se baseia em turnos conversacionais.

Quais são as principais diferenças na colaboração entre agentes no CrewAI e no LangGraph?

O CrewAI colabora por atribuição de papéis, enquanto o LangGraph conecta agentes como nós em um grafo de workflow, com ramificações condicionais e estado estruturado.

Como a abordagem de chat entre agentes do AutoGen difere do design baseado em papéis do CrewAI?

O AutoGen enfatiza chats em grupo conversacionais, nos quais agentes criticam e constroem sobre as respostas uns dos outros. O CrewAI impõe trocas estruturadas, guiadas por papéis.

Qual framework oferece o melhor suporte a sistemas com humano-no-loop?

Os três frameworks suportam envolvimento humano, mas o CrewAI integra checkpoints nos workflows, o LangGraph fornece ganchos de pausar/retomar e o AutoGen incorpora humanos diretamente nas conversas.

Como as capacidades de gerenciamento de memória do LangGraph se comparam às do CrewAI e do AutoGen?

O LangGraph fornece memória baseada em estado com checkpointing e persistência. O CrewAI usa memória estruturada por papéis com RAG, enquanto o AutoGen armazena o histórico da conversa.

Como fundador da Martin Data Solutions e cientista de dados freelancer, engenheiro de ML e IA, tenho um portfólio diversificado em regressão, classificação, PNL, LLM, RAG, redes neurais, métodos de conjunto e visão computacional.

- Desenvolveu com sucesso vários projetos de ML de ponta a ponta, incluindo limpeza de dados, análise, modelagem e implantação no AWS e no GCP, fornecendo soluções impactantes e dimensionáveis.

- Criou aplicativos da Web interativos e dimensionáveis usando Streamlit e Gradio para diversos casos de uso do setor.

- Ensinou e orientou alunos em ciência e análise de dados, promovendo seu crescimento profissional por meio de abordagens de aprendizagem personalizadas.

- Projetou o conteúdo do curso para aplicativos RAG (retrieval-augmented generation) adaptados aos requisitos da empresa.

- Criou blogs técnicos de IA e ML de alto impacto, abordando tópicos como MLOps, bancos de dados vetoriais e LLMs, obtendo um envolvimento significativo.

Em cada projeto que assumo, certifico-me de aplicar práticas atualizadas em engenharia de software e DevOps, como CI/CD, code linting, formatação, monitoramento de modelos, rastreamento de experimentos e tratamento robusto de erros. Tenho o compromisso de fornecer soluções completas, transformando insights de dados em estratégias práticas que ajudam as empresas a crescer e tirar o máximo proveito da ciência de dados, do machine learning e da IA.