Banyak organisasi saat ini ingin menggunakan data untuk memandu keputusan mereka, tetapi membutuhkan bantuan untuk mengelola sumber data yang semakin bertambah. Lebih penting lagi, ketika mereka tidak dapat mengubah data mentah menjadi format yang bisa digunakan, ketersediaan data bisa menjadi buruk dan menghambat pengembangan budaya data.

Alat ETL (Extract, Transform, Load) adalah bagian penting dalam memecahkan masalah ini. Ada banyak alat ETL yang dapat dipilih, memberi perusahaan keleluasaan untuk menentukan opsi terbaik. Namun, meninjau semua opsi yang tersedia bisa memakan waktu.

Dalam artikel ini, kami telah menyusun daftar 24 alat ETL teratas, merinci beberapa opsi terbaik di pasaran.

Ringkasnya

- Alat ETL (Extract, Transform, Load) mengotomatiskan perpindahan data dari sistem sumber ke data warehouse — mereka adalah tulang punggung infrastruktur data modern.

- Pada 2026, alat yang paling banyak diadopsi adalah Fivetran dan Airbyte untuk ingestion data, Apache Airflow untuk orkestrasi, dbt untuk transformasi, dan Matillion untuk ETL cloud-native.

- Pilih alat open-source (Airbyte, Airflow, Hadoop) demi fleksibilitas dan penghematan biaya; pilih alat SaaS terkelola (Fivetran, Hevo, Stitch) untuk kecepatan dan perawatan rendah.

- ELT menggantikan ETL untuk data warehouse cloud — muat dulu, transformasi di dalam warehouse.

- Kriteria evaluasi utama: jumlah konektor, kompatibilitas cloud, kemudahan penggunaan, skalabilitas, dan total biaya kepemilikan.

Untuk pengantar ETL yang terstruktur, lihat kursus ETL dan ELT di Python.

Apa itu ETL?

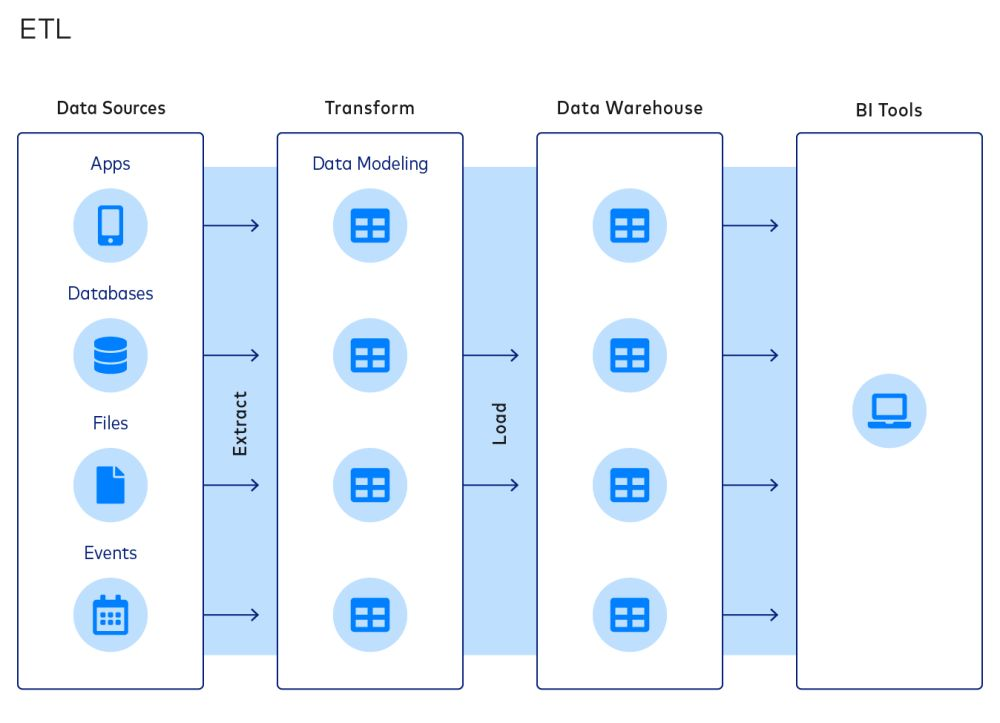

ETL adalah pendekatan umum untuk mengintegrasikan data dan menata tumpukan data. Proses ETL tipikal mencakup tahapan berikut:

- Ekstraksi data dari sumber

- Transformasi data menjadi model data

- Memuat data ke dalam data warehouse

Paradigma ETL populer karena memungkinkan perusahaan mengurangi ukuran data warehouse mereka, yang dapat menghemat biaya komputasi, penyimpanan, dan bandwidth.

Namun, penghematan biaya ini menjadi kurang penting seiring berkurangnya kendala-kendala tersebut. Akibatnya, ELT (Extract, Load, Transform) semakin populer. Dalam proses ELT, data dimuat ke tujuan setelah diekstraksi, dan transformasi menjadi langkah terakhir. Meski begitu, banyak perusahaan masih bergantung pada ETL.

Apa itu Alat ETL?

Sesuai namanya, alat ETL adalah seperangkat perangkat lunak yang digunakan untuk mengekstrak, mentransformasi, dan memuat data dari satu atau lebih sumber ke sistem atau basis data target. Alat ETL dirancang untuk mengotomatiskan dan menyederhanakan proses ekstraksi data dari berbagai sumber, mengubahnya menjadi format yang konsisten dan bersih, serta memuatnya ke sistem target secara tepat waktu dan efisien. Pada bagian berikutnya, kita akan melihat pertimbangan kunci yang perlu diterapkan tim data ketika memilih alat ETL.

Pertimbangan Saat Memilih Alat ETL

Berikut tiga pertimbangan utama saat memilih alat ETL:

- Tingkat integrasi data. Alat ETL dapat terhubung ke berbagai sumber dan tujuan data. Tim data sebaiknya memilih alat ETL yang menawarkan beragam integrasi. Misalnya, tim yang ingin memindahkan data dari Google Sheets ke Amazon Redshift harus memilih alat ETL yang mendukung konektor tersebut.

- Tingkat kustomisasi. Perusahaan harus memilih alat ETL berdasarkan kebutuhan kustomisasi dan keahlian teknis tim TI-nya. Startup mungkin merasa konektor dan transformasi bawaan pada sebagian besar alat ETL sudah cukup; perusahaan besar dengan pengumpulan data khusus kemungkinan membutuhkan fleksibilitas untuk membuat transformasi kustom dengan dukungan tim engineer yang kuat.

- Struktur biaya. Saat memilih alat ETL, organisasi perlu mempertimbangkan bukan hanya biaya alat itu sendiri tetapi juga biaya infrastruktur dan sumber daya manusia yang dibutuhkan untuk memelihara solusi dalam jangka panjang. Dalam beberapa kasus, alat ETL dengan biaya awal lebih tinggi tetapi waktu henti dan kebutuhan perawatan lebih rendah bisa lebih hemat biaya dalam jangka panjang. Sebaliknya, ada alat ETL open-source gratis yang bisa memiliki biaya perawatan tinggi.

Pertimbangan lainnya mencakup:

- Tingkat otomatisasi yang disediakan

- Tingkat keamanan dan kepatuhan

- Kinerja dan keandalan alat.

Jenis-Jenis Alat ETL

Sebelum membahas alat tertentu, ada baiknya memahami kategori utamanya. Alat ETL terbagi ke beberapa jenis, masing-masing cocok untuk kasus penggunaan dan struktur tim yang berbeda:

| Jenis | Deskripsi | Contoh |

|---|---|---|

| ETL open-source | Gratis digunakan, sangat dapat dikustomisasi, didukung komunitas. Membutuhkan lebih banyak upaya engineering untuk penerapan dan pemeliharaan. | Apache Airflow, Airbyte, Hadoop, Pentaho PDI |

| ETL berbasis cloud / SaaS | Terkelola sepenuhnya, tanpa infrastruktur untuk dijalankan. Harga berlangganan atau bayar sesuai pakai. Overhead operasional rendah. | Fivetran, Stitch, Hevo, Matillion |

| ETL enterprise | Penuh fitur, dibuat untuk lingkungan berskala besar dan kompleks. Tata kelola kuat, manajemen metadata, dan kemampuan kepatuhan. | Informatica PowerCenter, IBM Infosphere Datastage, SAP Data Services |

| ETL cloud-native (ELT) | Dirancang untuk data warehouse cloud. Mendorong logika transformasi ke engine warehouse alih-alih di tengah pipeline. | AWS Glue, Azure Data Factory, Google Cloud Dataflow, Databricks DLT |

| ETL tanpa kode / berkode rendah | Antarmuka drag-and-drop yang memungkinkan non-engineer membangun pipeline. Cepat disetel, tetapi kurang fleksibel untuk transformasi kompleks. | Integrate.io, Astera Centerprise, Portable.io, Hevo |

| ETL real-time / streaming | Memproses data saat tiba, bukan dalam batch terjadwal. Esensial untuk analitik sensitif waktu. | Estuary, Hevo, AWS Glue (mode streaming) |

24 Alat ETL Teratas

Dengan pertimbangan tersebut, berikut kami sajikan 24 alat ETL teratas di pasar pada 2026. Perlu dicatat, alat-alat ini tidak diurutkan berdasarkan kualitas, karena masing-masing memiliki kelebihan dan kekurangan.

1. Apache Airflow

Apache Airflow adalah platform open-source untuk menyusun, menjadwalkan, dan memantau workflow secara terprogram. Platform ini memiliki antarmuka pengguna berbasis web dan antarmuka baris perintah untuk mengelola dan memicu workflow.

Workflow didefinisikan menggunakan directed acyclic graph (DAG), yang memungkinkan visualisasi dan pengelolaan tugas serta dependensi secara jelas. Airflow juga terintegrasi dengan alat lain yang umum digunakan dalam rekayasa data dan data science, seperti Apache Spark dan Pandas.

Perusahaan yang menggunakan Airflow dapat memanfaatkan kemampuannya untuk melakukan skala dan mengelola workflow yang kompleks, serta komunitas open-source yang aktif dan dokumentasi yang luas. Pelajari lebih lanjut di tutorial Membangun ETL Pipeline dengan Airflow atau kursus Pengantar Apache Airflow di Python.

2. Databricks Delta Live Tables

Databricks Delta Live Tables (DLT) adalah kerangka ETL yang dibangun di atas Apache Spark yang mengotomatiskan pipeline data (membangun dan mengelolanya). Ini memungkinkan tim data membangun pipeline yang andal, mudah dirawat, dan deklaratif dengan upaya minimal.

Delta Live Tables menyederhanakan ETL dengan pendekatan deklaratif: pengguna mendefinisikan apa (transformasi dan dependensi), dan sistem menangani bagaimana (eksekusi, optimasi, dan pemulihan).

Kekuatan utama DLT terletak pada kemampuannya memastikan kualitas dan keandalan data. Ekspektasi bawaan memungkinkan pengguna mendefinisikan aturan kualitas data yang memvalidasi rekaman secara real-time. Rekaman yang gagal dapat diisolasi untuk ditinjau nanti.

3. Portable.io

Portable.io menggambarkan dirinya sebagai "platform ELT pertama yang membangun konektor on-demand untuk tim data." Sesuai misinya, tim Portable membangun integrasi tanpa kode khusus, mengasup data dari penyedia SaaS dan banyak sumber data lain yang mungkin tidak didukung karena terlewat oleh penyedia ETL lain. Calon pelanggan dapat melihat sendiri katalog konektor mereka yang luas dengan lebih dari 1.300 konektor ETL yang sulit ditemukan.

Portable berangkat dari keyakinan bahwa perusahaan harus memiliki data dari setiap aplikasi bisnis di ujung jari tanpa menulis kode. Tim Portable menciptakan produk yang memungkinkan pengelolaan data secara efisien dan tepat waktu serta menawarkan skalabilitas yang tangguh dan performa tinggi. Selain itu, harganya hemat biaya untuk berbagai ukuran bisnis dan memiliki fitur keamanan canggih untuk memastikan perlindungan data dan kepatuhan terhadap standar umum.

4. IBM Infosphere Datastage

Infosphere Datastage adalah alat ETL yang ditawarkan IBM sebagai bagian dari ekosistem Infosphere Information Server. Dengan kerangka kerja grafisnya, pengguna dapat merancang pipeline data yang mengekstrak data dari berbagai sumber, melakukan transformasi kompleks, dan menyampaikan data ke aplikasi target.

IBM Infosphere dikenal akan kecepatannya, berkat fitur seperti load balancing dan paralelisasi. Ia juga mendukung metadata, deteksi kegagalan otomatis, dan beragam layanan data, mulai dari data warehousing hingga aplikasi AI.

Seperti alat ETL enterprise lainnya, Infosphere Datastage menawarkan beragam konektor untuk mengintegrasikan berbagai sumber data. Alat ini juga terintegrasi mulus dengan komponen lain dari IBM Infosphere Information Server, memungkinkan pengguna mengembangkan, menguji, menerapkan, dan memantau pekerjaan ETL.

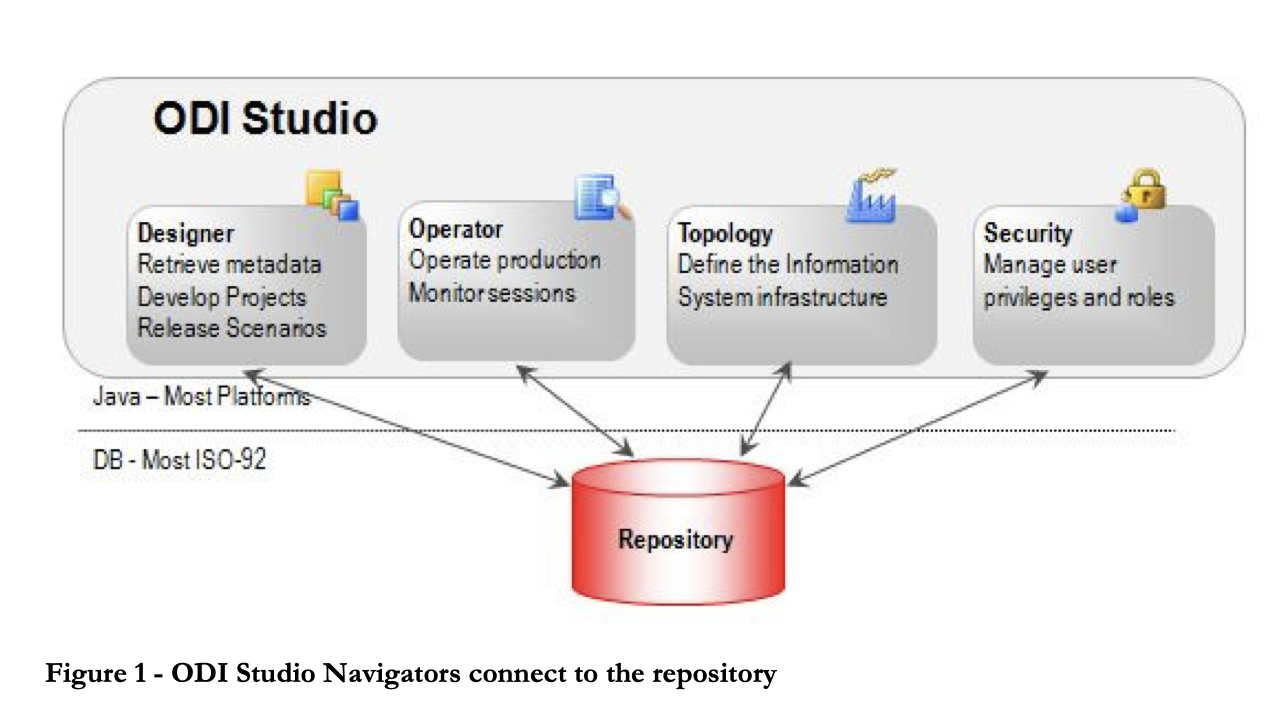

5. Oracle Data Integrator

Oracle Data Integrator adalah alat ETL yang membantu pengguna membangun, menerapkan, dan mengelola data warehouse yang kompleks. Alat ini dilengkapi konektor siap pakai untuk banyak basis data, termasuk Hadoop, EREP, CRM, XML, JSON, LDAP, JDBC, dan ODBC.

ODI menyertakan Data Integrator Studio, yang menyediakan akses bagi pengguna bisnis dan pengembang ke berbagai artefak melalui antarmuka grafis. Artefak ini mencakup semua elemen integrasi data, dari perpindahan dan sinkronisasi data hingga kualitas dan manajemen.

6. Microsoft SQL Server Integration Services (SSIS)

SSIS adalah platform tingkat enterprise untuk integrasi dan transformasi data. Alat ini dilengkapi konektor untuk mengekstrak data dari sumber seperti file XML, file flat, dan basis data relasional. Praktisi dapat menggunakan antarmuka grafis SSIS designer untuk membangun aliran data dan transformasi.

Platform ini mencakup pustaka transformasi bawaan yang meminimalkan jumlah kode yang diperlukan untuk pengembangan. SSIS juga menawarkan dokumentasi komprehensif untuk membangun workflow kustom. Namun, kurva belajar dan kompleksitas platform yang tinggi dapat membuat pemula enggan untuk cepat membuat pipeline ETL.

7. dbt (data build tool)

dbt (data build tool) telah menjadi standar industri untuk lapisan transformasi pada pipeline ELT modern. Alih-alih mentransformasi data di tengah proses ekstraksi, dbt mentransformasi data di dalam data warehouse menggunakan SQL — pendekatan yang kini dikenal sebagai “T dalam ELT.”

dbt memungkinkan data engineer dan analytics engineer menulis model SQL yang modular, terkontrol versi, dan teruji. Setiap model didokumentasikan, dependensi dilacak, dan setiap run menghasilkan grafik garis keturunan data yang menunjukkan secara persis bagaimana data mengalir dari sumber mentah ke tabel akhir. Pelajari lebih lanjut dalam pengantar dbt, panduan konsep dbt untuk data engineer, dan panduan dbt Cloud.

dbt tersedia sebagai open-source (dbt Core, gratis) atau sebagai layanan cloud terkelola penuh (dbt Cloud). Ia terintegrasi dengan setiap data warehouse cloud utama — Snowflake, BigQuery, Redshift, dan Databricks — dan berpadu alami dengan alat ingestion seperti Fivetran dan Airbyte untuk membentuk tumpukan ELT modern yang lengkap.

8. Pentaho Data Integration (PDI)

Pentaho Data Integration (PDI) adalah alat ETL yang ditawarkan oleh Hitachi. Alat ini menangkap data dari berbagai sumber, membersihkannya, dan menyimpannya dalam format yang seragam dan konsisten.

Sebelumnya dikenal sebagai Kettle, PDI memiliki beberapa antarmuka grafis untuk mendefinisikan pipeline data. Pengguna dapat merancang pekerjaan dan transformasi data menggunakan klien PDI, Spoon, lalu menjalankannya menggunakan Kitchen. Misalnya, klien PDI dapat digunakan untuk ETL real-time dengan Pentaho Reporting.

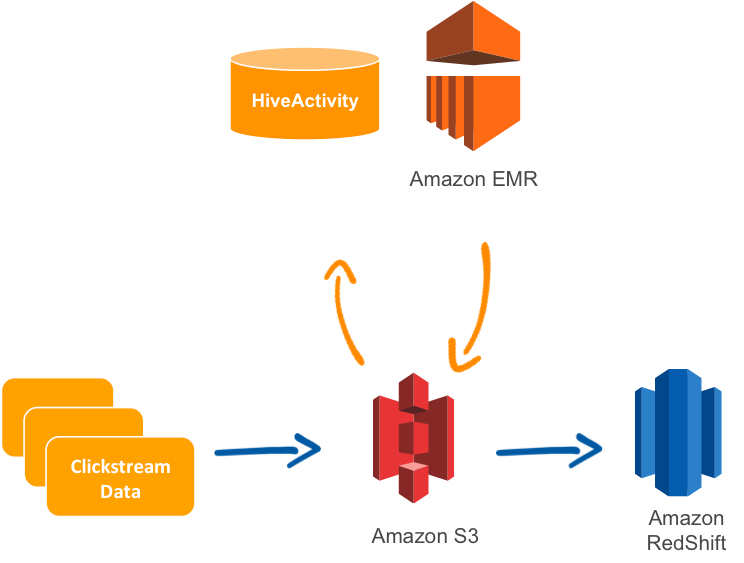

9. Hadoop

Hadoop adalah kerangka kerja open-source untuk memproses dan menyimpan big data dalam kluster server komputer. Ia dianggap sebagai fondasi big data dan memungkinkan penyimpanan serta pemrosesan data dalam jumlah besar.

Kerangka Hadoop terdiri dari beberapa modul, termasuk Hadoop Distributed File System (HDFS) untuk menyimpan data, MapReduce untuk membaca dan mentransformasi data, dan YARN untuk manajemen sumber daya. Hive biasa digunakan untuk mengonversi kueri SQL menjadi operasi MapReduce.

Perusahaan yang mempertimbangkan Hadoop perlu menyadari biayanya. Porsi signifikan dari biaya implementasi Hadoop berasal dari daya komputasi yang dibutuhkan untuk pemrosesan dan keahlian untuk memelihara ETL Hadoop, bukan dari alat atau penyimpanannya sendiri.

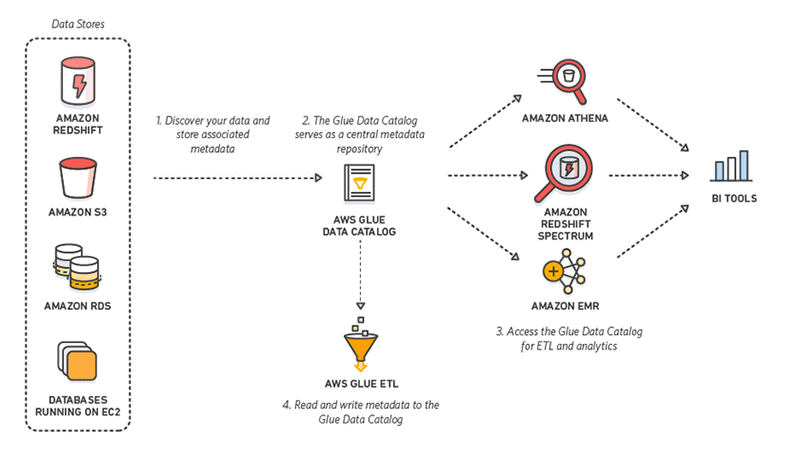

10. AWS Glue

AWS Glue adalah alat ETL tanpa server (serverless) yang ditawarkan oleh Amazon. Ia menemukan, menyiapkan, mengintegrasikan, dan mentransformasi data dari berbagai sumber untuk kasus penggunaan analitik. Tanpa perlu menyiapkan atau mengelola infrastruktur, AWS Glue menjanjikan pengurangan biaya integrasi data yang besar.

Lebih baik lagi, saat berinteraksi dengan AWS Glue, praktisi dapat memilih antara GUI drag-and-drop, Jupyter notebook, atau kode Python/Scala. AWS Glue juga mendukung berbagai pemrosesan dan beban kerja data yang memenuhi beragam kebutuhan bisnis, termasuk ETL, ELT, batch, dan streaming.

11. AWS Data Pipeline

AWS Data Pipeline adalah layanan ETL terkelola yang memungkinkan perpindahan data di berbagai layanan AWS atau sumber daya on-premise. Pengguna dapat menentukan data yang akan dipindahkan, pekerjaan atau kueri transformasi, dan jadwal untuk menjalankan transformasi.

Data Pipeline dikenal karena keandalan, fleksibilitas, dan skalabilitasnya, serta toleransi kesalahan dan konfigurasinya. Platform ini juga memiliki konsol drag-and-drop untuk kemudahan penggunaan. Selain itu, biayanya relatif murah.

Kasus penggunaan umum untuk AWS Data Pipeline adalah mereplikasi data dari Relational Database Service (RDS) dan memuatnya ke Amazon Redshift.

Namun, penting untuk dicatat bahwa AWS secara bertahap mengalihkan fokus dari AWS Data Pipeline ke solusi yang lebih modern seperti AWS Glue. AWS Glue menawarkan integrasi data tanpa server yang otomatis dengan dukungan untuk beban kerja batch dan streaming. Selain itu, AWS mengeksplorasi konsep zero-ETL (dan Reverse ETL), di mana layanan seperti Amazon Aurora dan Amazon Redshift dapat terintegrasi tanpa memerlukan pipeline ETL tradisional. Seiring berlanjutnya kemajuan ini, AWS Data Pipeline diperkirakan akan dihentikan, mendorong pengguna untuk mengadopsi solusi yang lebih inovatif dan efisien dalam ekosistem AWS.

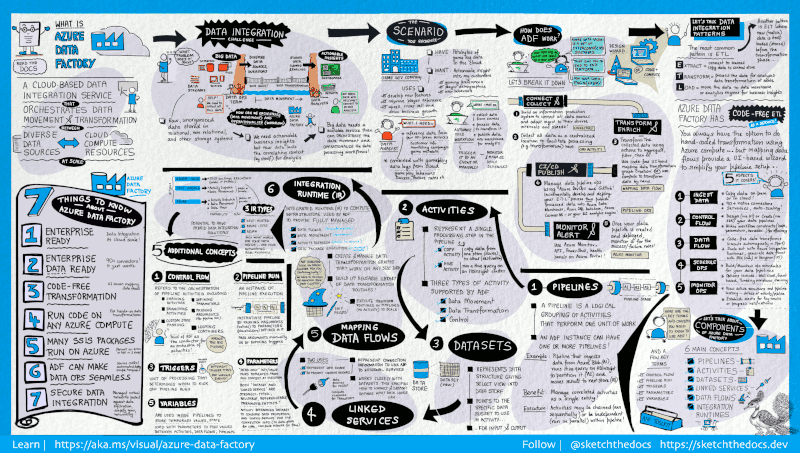

12. Azure Data Factory

Azure Data Factory adalah layanan ETL berbasis cloud dari Microsoft yang digunakan untuk membuat workflow yang memindahkan dan mentransformasi data dalam skala besar.

Ia terdiri dari serangkaian sistem yang saling terhubung. Bersama-sama, sistem ini memungkinkan engineer tidak hanya mengasup dan mentransformasi data tetapi juga merancang, menjadwalkan, dan memantau pipeline data.

Kekuatan Data Factory terletak pada banyaknya konektor yang tersedia, mulai dari MySQL hingga AWS, MongoDB, Salesforce, dan SAP. Alat ini juga dipuji karena fleksibilitasnya; pengguna dapat memilih berinteraksi melalui antarmuka grafis tanpa kode atau antarmuka baris perintah.

13. Google Cloud Dataflow

Dataflow adalah layanan ETL tanpa server dari Google Cloud. Ia mendukung pemrosesan data stream dan batch serta tidak mengharuskan perusahaan memiliki server atau kluster. Sebaliknya, pengguna hanya membayar sumber daya yang dikonsumsi, yang diskalakan secara otomatis berdasarkan kebutuhan dan beban kerja.

Google Dataflow menjalankan pipeline Apache Beam dalam ekosistem Google Cloud Platform. Apache menyediakan SDK Java, Python, dan Go untuk merepresentasikan dan mentransfer set data, baik batch maupun streaming. Ini memungkinkan pengguna memilih SDK yang sesuai untuk mendefinisikan pipeline data mereka.

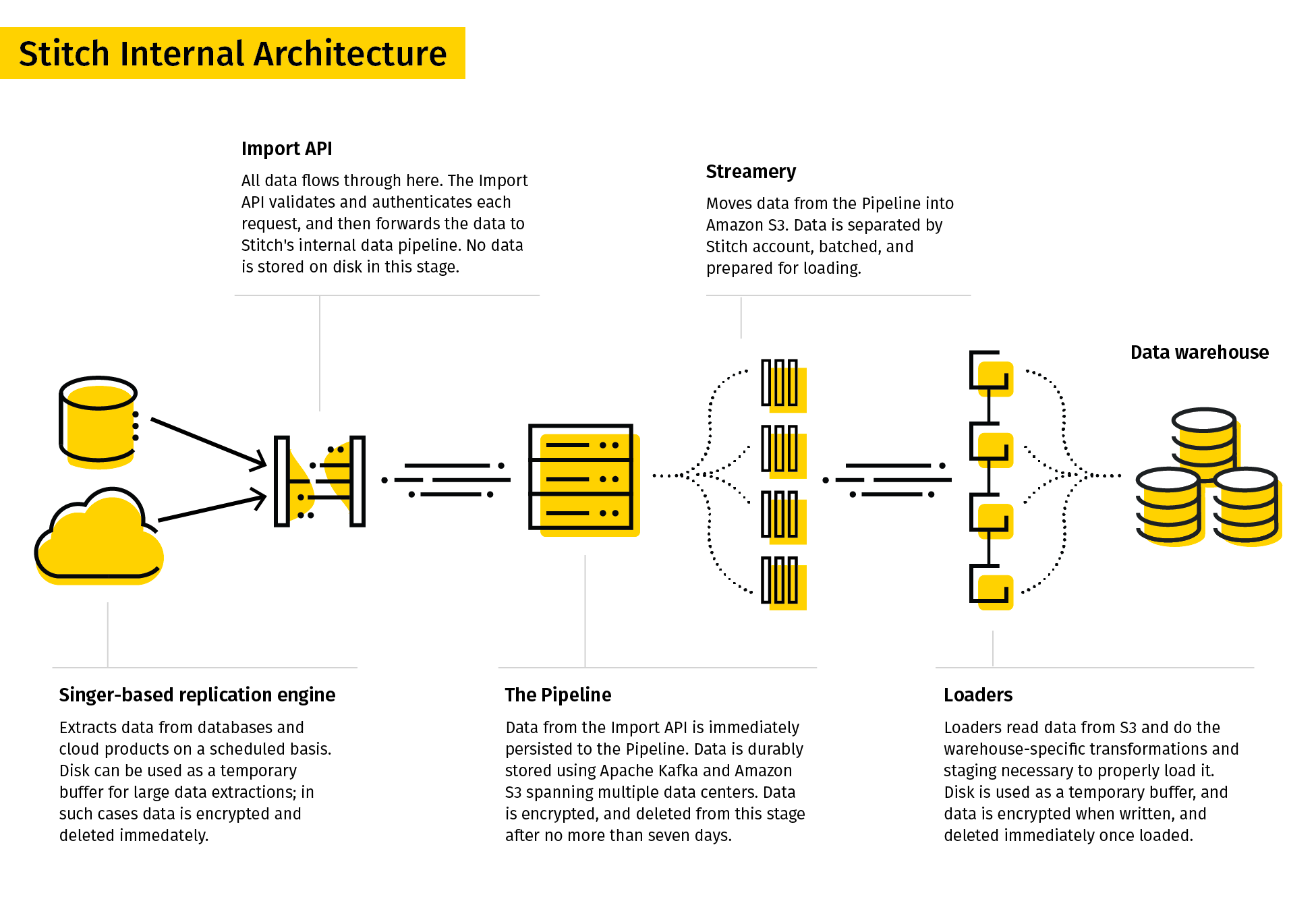

14. Stitch

Stitch menggambarkan dirinya sebagai alat ETL yang sederhana dan dapat diperluas, dibuat untuk tim data.

Proses replikasi Stitch mengekstrak data dari berbagai sumber data, mentransformasinya ke format mentah yang berguna, dan memuatnya ke tujuan. Konektor datanya mencakup basis data dan aplikasi SaaS. Tujuan dapat mencakup data lake, data warehouse, dan platform penyimpanan.

Mengingat kesederhanaannya, Stitch hanya mendukung transformasi sederhana dan bukan transformasi yang ditentukan pengguna.

15. SAP BusinessObjects Data Services

SAP BusinessObjects Data Services adalah alat ETL tingkat enterprise yang memungkinkan pengguna mengekstrak data dari banyak sistem, mentransformasinya, dan memuatnya ke data warehouse.

Data Services Designer menyediakan antarmuka grafis untuk mendefinisikan pipeline data dan menentukan transformasi data. Aturan dan metadata disimpan dalam repositori, dan server job menjalankan job dalam mode batch atau real-time.

Namun, SAP Data Services bisa mahal, karena biaya alat, server, perangkat keras, dan tim engineering dapat dengan cepat bertambah.

SAP Data Services cocok untuk perusahaan yang menggunakan SAP sebagai sistem Enterprise Resource Planning (ERP), karena terintegrasi mulus dengan SAP Data Services

16. Hevo

Hevo adalah platform integrasi data untuk ETL dan ELT yang hadir dengan lebih dari 150 konektor untuk mengekstrak data dari berbagai sumber. Ini adalah alat low-code, sehingga memudahkan pengguna merancang pipeline data tanpa perlu pengalaman coding yang luas.

Hevo menawarkan beragam fitur dan manfaat, termasuk integrasi data real-time, deteksi skema otomatis, dan kemampuan menangani volume data yang besar. Platform ini juga dilengkapi antarmuka yang ramah pengguna dan dukungan pelanggan 24/7.

17. Qlik Compose

Qlik Compose adalah solusi data warehousing yang secara otomatis merancang data warehouse dan menghasilkan kode ETL. Alat ini mengotomatiskan pengembangan dan pemeliharaan ETL yang membosankan dan rentan kesalahan, sehingga memperpendek waktu tunggu proyek data warehousing.

Untuk itu, Qlik Compose menjalankan kode yang dihasilkan otomatis, yang memuat data dari sumber dan memindahkannya ke data warehouse. Workflow semacam ini dapat dirancang dan dijadwalkan menggunakan Workflow Designer dan Scheduler.

Qlik Compose juga memiliki kemampuan untuk memvalidasi data dan memastikan kualitas data. Praktisi yang membutuhkan data real-time juga dapat mengintegrasikan Compose dengan Qlik Replicate.

18. Integrate.io

Integrate.io, sebelumnya dikenal sebagai Xplenty, meraih tempat yang layak di daftar alat ETL teratas kami. Antarmukanya yang ramah dan intuitif membuka pintu ke manajemen data yang komprehensif, bahkan bagi anggota tim dengan kemampuan teknis lebih sedikit. Sebagai platform berbasis cloud, Integrate.io menghapus kebutuhan instalasi perangkat keras atau perangkat lunak yang besar dan menyediakan solusi yang sangat skalabel yang berkembang seiring kebutuhan bisnis Anda.

Kemampuannya terhubung dengan beragam sumber data, dari basis data hingga sistem CRM, menjadikannya pilihan serbaguna untuk kebutuhan integrasi data yang beragam. Dengan memprioritaskan keamanan data, ia menawarkan fitur seperti enkripsi tingkat field dan patuh standar kunci seperti GDPR dan HIPAA. Dengan kemampuan transformasi data yang kuat, pengguna dapat dengan mudah membersihkan, memformat, dan memperkaya data sebagai bagian dari proses ETL.

19. Airbyte

Airbyte adalah platform ELT open-source terdepan. Airbyte menawarkan lebih dari 400 konektor data — dan terus bertambah — serta digunakan oleh lebih dari 40.000 data engineer.

Airbyte berintegrasi dengan dbt untuk transformasi data dan Airflow / Prefect / Dagster untuk orkestrasi. Ia memiliki antarmuka pengguna yang mudah digunakan serta API dan Terraform Provider yang tersedia.

Airbyte membedakan dirinya melalui sifat open-source; hanya perlu 20 menit untuk membuat konektor baru dengan pembuat konektor tanpa kode mereka, dan Anda dapat mengedit konektor siap pakai apa pun selama memiliki akses ke kodenya. Selain versi open-source, Airbyte menawarkan versi cloud-hosted (Airbyte Cloud) dan versi self-hosted berbayar (Airbyte Enterprise) ketika Anda ingin memproduksi pipeline Anda.

20. Astera Centerprise

Astera Centerprise adalah alat ETL/ELT tingkat enterprise yang 100% tanpa kode. Sebagai bagian dari Astera Data Stack, Centerprise memiliki antarmuka yang intuitif dan ramah pengguna dengan kurva belajar singkat dan memungkinkan pengguna di semua tingkat teknis membangun pipeline data dalam hitungan menit.

Alat integrasi data otomatis ini menawarkan berbagai kapabilitas, seperti konektivitas siap pakai ke beberapa sumber dan tujuan data, ekstraksi data bertenaga AI, pemetaan otomatis berbasis AI, transformasi lanjutan bawaan, dan fitur kualitas data. Pengguna dapat dengan mudah mengekstrak data tidak terstruktur dan terstruktur, mentransformasinya, dan memuatnya ke tujuan pilihan menggunakan dataflow. Dataflow ini dapat diautomasi untuk berjalan pada interval, kondisi, atau saat file masuk dengan menggunakan penjadwal job bawaan.

21. Informatica PowerCenter

Informatica PowerCenter adalah salah satu alat ETL terbaik di pasar. Alat ini memiliki beragam konektor untuk data warehouse dan data lake berbasis cloud, termasuk AWS, Azure, Google Cloud, dan Salesforce. Alat low-code dan no-code-nya dirancang untuk menghemat waktu dan menyederhanakan workflow.

Informatica PowerCenter mencakup beberapa layanan yang memungkinkan pengguna merancang, menerapkan, dan memantau pipeline data. Misalnya, Repository Manager membantu manajemen pengguna, Designer memungkinkan pengguna menentukan aliran data dari sumber ke target, dan Workflow Manager mendefinisikan urutan tugas.

22. Estuary

Estuary adalah platform integrasi data real-time mutakhir yang menyederhanakan pembuatan dan pengelolaan pipeline data. Dirancang untuk menangani data batch dan streaming, Estuary memungkinkan Anda membangun workflow ETL yang tangguh. Antarmuka pengguna yang intuitif membuatnya mudah diakses baik oleh pengguna teknis maupun non-teknis, sehingga tim dapat fokus mengekstrak nilai dari data alih-alih berkutat dengan konfigurasi kompleks.

Kemampuan otomasi platform ini menonjol, secara otomatis mengelola evolusi skema dan beradaptasi dengan perubahan struktur data dengan mudah. Dengan integrasi ke beragam sumber dan tujuan data, Estuary cocok bagi tim yang mencari analitik real-time, baik untuk memantau tren penjualan e-commerce maupun menganalisis data sensor pada aplikasi IoT.

23. Fivetran

Fivetran telah muncul sebagai solusi ETL terdepan untuk integrasi data yang sepenuhnya otomatis, memungkinkan perusahaan memusatkan data mereka. Dengan memanfaatkan pustaka konektor siap pakai, Fivetran meminimalkan waktu penyiapan, menghubungkan basis data, aplikasi SaaS, dan event stream ke data warehouse cloud. Platform ini unggul dalam menangani perubahan skema secara otomatis, memastikan aliran data tetap lancar meski sistem sumber berevolusi.

Dengan kemampuan replikasi real-time, Fivetran mendukung ketersediaan data hampir seketika. Dioptimalkan untuk lingkungan cloud-native seperti Snowflake, BigQuery, dan Redshift, Fivetran menjadi pilihan utama bagi tim yang ingin menyederhanakan pipeline data sambil mempertahankan skalabilitas. Ini sangat berharga bagi tim pemasaran dan penjualan yang perlu mengintegrasikan beragam sumber data ke dalam dasbor analitik terpadu.

24. Matillion

Matillion adalah alat ETL cloud-native yang dirancang untuk mentransformasi data langsung di dalam data warehouse cloud. Disesuaikan untuk platform seperti Snowflake, AWS Redshift, Google BigQuery, dan Azure Synapse, Matillion menyediakan cara untuk melakukan transformasi data dalam skala besar. Antarmuka visualnya memudahkan pengguna merancang workflow melalui lingkungan drag-and-drop, sementara pengguna tingkat lanjut dapat memanfaatkan transformasi berbasis SQL untuk menangani tugas data yang kompleks.

Dengan fokus pada skalabilitas dan performa, Matillion sangat cocok bagi tim yang perlu memproses transformasi berskala besar secara efisien. Dari membuat tampilan customer 360 yang mendetail hingga mengoptimalkan analitik rantai pasok, Matillion memberdayakan profesional data untuk membuka potensi penuh infrastruktur data berbasis cloud tanpa hambatan khas proses ETL tradisional.

Perbandingan Alat ETL Teratas

Tabel berikut membandingkan alat ETL yang disebutkan secara berdampingan dalam berbagai kategori:

| Alat ETL | Ketersediaan open-source | Kompatibilitas cloud | Kemudahan penggunaan | Jumlah integrasi | Fitur dan pertimbangan | Kasus penggunaan ideal |

|---|---|---|---|---|---|---|

| Apache Airflow | Ya | Ya | Sedang | Tinggi | Workflow berbasis DAG, skalabilitas, dukungan komunitas luas | Workflow kompleks dan orkestrasi pipeline data multi-langkah berskala besar |

| Databricks Delta Live Tables | Tidak | Ya | Tinggi | Tinggi | Desain pipeline deklaratif, manajemen dependensi otomatis, pemeriksaan kualitas data bawaan | Perusahaan yang menggunakan Databricks Lakehouse dan mencari ETL otomatis, andal, dengan kualitas data terintegrasi dan pemrosesan real-time |

| Portable.io | Tidak | Ya | Tinggi | Sangat tinggi | Konektor on-demand, tanpa kode, harga hemat biaya | Perusahaan kecil hingga menengah yang membutuhkan konektor kustom untuk sumber data yang kurang umum |

| IBM Infosphere Datastage | Tidak | Ya | Sedang | Tinggi | Pemrosesan berkecepatan tinggi, dukungan metadata, tingkat enterprise | Perusahaan dengan pipeline data beragam dan bervolume tinggi yang memerlukan manajemen metadata yang tangguh |

| Oracle Data Integrator | Tidak | Ya | Sedang | Tinggi | Konektor ekstensif, antarmuka grafis, manajemen andal | Perusahaan yang menggunakan ekosistem Oracle atau memerlukan dukungan basis data yang luas |

| Microsoft SSIS | Tidak | Terbatas | Sedang | Sedang | Transformasi bawaan, dokumentasi komprehensif | Organisasi yang sudah berinvestasi di Microsoft SQL Server |

| dbt (data build tool) | Ya | Ya | Tinggi | Tinggi | Transformasi SQL di dalam warehouse, model terkontrol versi, garis keturunan data, dbt Core (gratis) + dbt Cloud (terkelola) | Tim data yang membutuhkan lapisan transformasi yang dapat diuji dan didokumentasikan di dalam data warehouse cloud (berpasangan dengan Fivetran atau Airbyte) |

| Pentaho Data Integration | Ya | Ya | Sedang | Tinggi | ETL real-time, antarmuka grafis, klien Spoon/Kitchen | Pemrosesan ETL real-time untuk perusahaan yang membutuhkan workflow berbasis GUI yang fleksibel |

| Hadoop | Ya | Ya | Rendah | Tinggi | Pemrosesan big data, HDFS, MapReduce, biaya implementasi tinggi | Perusahaan besar yang menangani dataset masif dan memerlukan penyimpanan serta pemrosesan data terdistribusi |

| AWS Glue | Tidak | Ya | Tinggi | Tinggi | Serverless, dukungan Python/Scala, beban kerja pemrosesan fleksibel | Perusahaan cloud-native yang membutuhkan ETL tanpa server untuk data terstruktur dan tidak terstruktur |

| AWS Data Pipeline | Tidak | Ya | Tinggi | Sedang | Layanan terkelola, toleran kesalahan, murah | Proses ETL dasar dalam AWS (namun pengguna yang bertransisi sebaiknya menjajaki AWS Glue atau solusi zero-ETL) |

| Azure Data Factory | Tidak | Ya | Tinggi | Sangat tinggi | Banyak konektor, antarmuka fleksibel, berbasis cloud | Perusahaan dengan sumber data beragam yang menggunakan ekosistem Azure dari Microsoft |

| Google Cloud Dataflow | Tidak | Ya | Tinggi | Tinggi | Serverless, integrasi Apache Beam, hemat biaya | Pemrosesan data stream atau batch dalam ekosistem Google Cloud |

| Stitch | Tidak | Ya | Tinggi | Sedang | Transformasi sederhana, konektor SaaS, ramah pengguna | Startup dan tim kecil yang berfokus pada replikasi data sederhana ke data warehouse |

| SAP BusinessObjects | Tidak | Ya | Sedang | Tinggi | Tingkat enterprise, terintegrasi dengan SAP, mahal | Pengguna sistem ERP SAP yang mencari integrasi tanpa hambatan |

| Hevo | Tidak | Ya | Tinggi | Tinggi | Low-code, integrasi real-time, deteksi skema otomatis | Bisnis kecil hingga menengah yang membutuhkan analitik real-time |

| Qlik Compose | Tidak | Ya | Sedang | Tinggi | Mengotomatiskan pengembangan ETL, integrasi real-time dengan Qlik Replicate | Bisnis yang membutuhkan pipeline ETL otomatis dan integrasi dengan Qlik Replicate |

| Integrate.io | Tidak | Ya | Tinggi | Tinggi | Antarmuka intuitif, tanpa perangkat keras, fitur keamanan kuat | Perusahaan yang memprioritaskan kemudahan penggunaan dan keamanan data |

| Airbyte | Ya | Ya | Tinggi | Sangat tinggi | Open-source, pembuatan konektor mudah, terintegrasi dengan dbt | Organisasi yang mencari solusi ELT open-source yang dapat dikustomisasi |

| Astera Centerprise | Tidak | Ya | Tinggi | Tinggi | Tanpa kode, ekstraksi data bertenaga AI, ramah pengguna | Perusahaan yang mencari alat ETL no-code dengan otomasi bertenaga AI |

| Informatica PowerCenter | Tidak | Ya | Tinggi | Sangat tinggi | Alat low/no-code, beragam konektor, tingkat enterprise | Perusahaan yang menangani pipeline data kompleks dengan kebutuhan konektor luas |

| Estuary | Tidak | Ya | Tinggi | Sedang | Integrasi data real-time, otomasi, evolusi skema, dukungan batch dan streaming | Bisnis yang membutuhkan analitik real-time untuk data IoT atau e-commerce |

| Fivetran | Tidak | Ya | Tinggi | Sangat tinggi | Pembaruan skema otomatis, konektor siap pakai, replikasi real-time, dioptimalkan untuk cloud | Perusahaan yang membutuhkan replikasi data otomatis dan andal dengan intervensi manual minimal |

| Matillion | Tidak | Ya | Tinggi | Tinggi | Cloud-native, antarmuka drag-and-drop, transformasi SQL kompleks, menskalakan sesuai infrastruktur cloud | Tim yang memaksimalkan workflow transformasi data berbasis cloud |

Cara Memilih Alat ETL yang Tepat

Dengan 24 alat dalam daftar ini, mempersempit opsi Anda bisa terasa menakutkan. Berikut kerangka keputusan berdasarkan profil tim yang paling umum:

- Baru mulai / tim kecil: Mulai dengan Stitch atau Airbyte untuk ingestion dan dbt Core untuk transformasi. Keduanya gratis untuk self-host dan memiliki overhead operasional minimal.

- Berkembang / perusahaan menengah: Fivetran + dbt Cloud adalah tumpukan produksi paling populer pada 2026. Tambahkan Apache Airflow untuk orkestrasi.

- Enterprise / lingkungan kompleks: Informatica PowerCenter, IBM Infosphere Datastage, atau Azure Data Factory untuk organisasi dengan sistem warisan, kepatuhan ketat, dan tim engineering besar.

- Ekosistem AWS: AWS Glue untuk ETL tanpa server; evaluasi integrasi zero-ETL antara Amazon Aurora dan Redshift untuk menghilangkan pipeline sepenuhnya.

- Ekosistem Google Cloud: Google Cloud Dataflow untuk pemrosesan stream dan batch di GCP.

- Ekosistem Microsoft / Azure: Azure Data Factory untuk orkestrasi dan pemindahan, dipasangkan dengan Azure Synapse untuk transformasi.

- Pengguna non-teknis / no-code: Hevo, Integrate.io, atau Astera Centerprise menawarkan antarmuka drag-and-drop dengan kebutuhan pemrograman minimal.

Meningkatkan Keahlian ETL Tim Anda

Seiring data menjadi pusat operasi bisnis, proses ETL yang efektif sangat krusial. Untuk tetap kompetitif, penting untuk terus meningkatkan keterampilan tim Anda dalam rekayasa data dan manajemen. DataCamp for Business menawarkan solusi yang disesuaikan untuk membantu organisasi meningkatkan keterampilan karyawan, memastikan mereka siap menangani kompleksitas analitik data modern. Dengan DataCamp for Business, tim Anda dapat mengakses:

- Jalur pembelajaran terfokus: Berikan tim Anda pelatihan terarah pada alat ETL seperti Apache Airflow, AWS, dan lainnya untuk meningkatkan kemampuan merancang dan mengelola pipeline data yang efisien.

- Pengalaman praktis: Dorong proyek langsung yang mencerminkan tantangan data organisasi Anda, membantu tim membangun kepercayaan diri dan keahlian yang dibutuhkan untuk menangani tugas data kompleks.

- Solusi pelatihan yang dapat diskalakan: Pilih platform pelatihan yang dapat diskalakan dengan beragam sumber daya dalam ETL dan manajemen data, memastikan tim dapat beradaptasi seiring pertumbuhan organisasi Anda.

- Pelacakan kemajuan: Manfaatkan alat untuk memantau perkembangan tim Anda, memberikan umpan balik rutin guna memastikan perbaikan berkelanjutan.

Berinvestasi pada keterampilan tim data Anda tidak hanya meningkatkan efisiensi ETL tetapi juga mendorong strategi data yang lebih baik, berkontribusi pada kesuksesan organisasi Anda. Minta demo hari ini untuk mengetahui lebih lanjut.

Sumber Daya Tambahan

Kesimpulannya, ada banyak alat ETL dan integrasi data yang tersedia, masing-masing dengan fitur dan kapabilitas unik. Beberapa opsi populer mencakup SSIS, Talend Open Studio, Pentaho Data Integration, Hadoop, Airflow, AWS Data Pipeline, Google Dataflow, SAP BusinessObjects Data Services, dan Hevo. Perusahaan yang mempertimbangkan alat-alat ini harus dengan cermat mengevaluasi kebutuhan spesifik dan anggaran mereka untuk memilih solusi yang tepat. Untuk sumber daya lebih lanjut tentang alat ETL dan lainnya, lihat tautan berikut:

- ETL vs ELT: Memahami Perbedaannya dan Membuat Pilihan yang Tepat

- ELT Dijelaskan: Integrasi Data untuk Era Cloud

- Apa itu Reverse ETL? Panduan yang Bermanfaat

- Apa itu Zero-ETL? Memperkenalkan Pendekatan Baru untuk Integrasi Data

- Arsitektur Data Warehouse: Tren, Alat, dan Teknik

- 17 Pertanyaan dan Jawaban Wawancara ETL Teratas

- Membangun ETL Pipeline dengan Airflow

FAQ

Apa itu ETL?

ETL adalah singkatan dari Extract, Transform, Load. Ini adalah proses mengekstrak data dari berbagai sumber, mentransformasinya ke format yang berguna, dan memuatnya ke sistem tujuan, seperti data warehouse.

Apa manfaat menggunakan alat ETL?

Alat ETL mengotomatiskan proses integrasi data, mengurangi waktu dan upaya yang dibutuhkan untuk membangun dan memelihara pipeline data. Alat ini juga membantu memastikan keakuratan dan konsistensi data, meningkatkan kualitas data, serta memungkinkan pengambilan keputusan yang lebih cepat.

Apa saja kasus penggunaan umum untuk ETL?

Kasus penggunaan umum untuk ETL mencakup data warehousing, business intelligence, migrasi data, integrasi data, dan konsolidasi data.

Apa saja alat ETL yang populer?

Beberapa alat ETL populer mencakup IBM Infosphere Information Server, Oracle Data Integrator, Microsoft SQL Server Integration Services (SSIS), Talend Open Studio, Pentaho Data Integration (PDI), Hadoop, AWS Glue, AWS Data Pipeline, Azure Data Factory, Google Cloud Dataflow, Stitch, SAP BusinessObjects Data Services, dan Hevo.

Apa yang harus saya pertimbangkan saat memilih alat ETL?

Saat memilih alat ETL, pertimbangkan faktor seperti kebutuhan spesifik Anda, anggaran, sumber dan tujuan data, skalabilitas, kemudahan penggunaan, serta dukungan dan dokumentasi yang tersedia.

Apakah ada alat ETL open-source yang tersedia?

Ya, ada beberapa alat ETL open-source yang tersedia, termasuk Talend Open Studio, Pentaho Data Integration (PDI), dan Apache NiFi.

Apa perbedaan antara ETL dan ELT?

ETL adalah singkatan dari Extract, Transform, Load, sedangkan ELT adalah Extract, Load, Transform. Pada ETL, data ditransformasi sebelum dimuat ke sistem tujuan, sementara pada ELT, data dimuat terlebih dahulu ke sistem tujuan lalu ditransformasi.

Bisakah saya menggunakan alat ETL untuk integrasi data real-time?

Ya, beberapa alat ETL seperti AWS Glue dan Hevo mendukung integrasi data real-time.

Apa saja praktik terbaik untuk pengembangan ETL?

Beberapa praktik terbaik untuk pengembangan ETL mencakup perancangan yang dapat diskalakan, mengoptimalkan kualitas dan performa data, pengujian dan debug menyeluruh, serta mendokumentasikan proses ETL dan garis keturunan data.