Corso

La tecnologia di data warehousing è stata recentemente consolidata per diventare più scalabile e meno costosa grazie alla diffusione dei servizi cloud. Una delle soluzioni più comuni è BigQuery, il data warehouse di Google Cloud Platform.

Il sondaggio Stack Overflow 2024 conferma la sua crescente popolarità, avendo raggiunto una percentuale di adozione del 24,1% tra gli utenti cloud di tutto il mondo. La domanda di competenze su BigQuery è aumentata in modo significativo in vari settori, rendendo la comprensione dei suoi fondamentali una necessità professionale tra i data professional.

In questo articolo troverai una raccolta di domande su BigQuery spesso poste durante i colloqui, per aiutarti a prepararti. Se stai iniziando ora a conoscere BigQuery, ti suggerisco prima di consultare questa guida sul Data Warehousing su GCP.

Domande di base su BigQuery

Conoscere le basi di BigQuery prima di affrontare argomenti complessi è essenziale. Queste domande valutano la tua comprensione dei concetti chiave, dell'architettura e delle funzionalità. Se non riesci a rispondere alle domande seguenti, ti incoraggio a partire dall'inizio consultando la Guida per principianti a BigQuery e iscrivendoti al nostro corso introduttivo su BigQuery.

Che cos'è BigQuery e in cosa differisce dai database tradizionali?

Perché viene chiesto: per valutare la tua comprensione dei moderni data warehouse e dei loro vantaggi rispetto ai database tradizionali.

BigQuery è un data warehouse completamente gestito e serverless su Google Cloud, progettato per l'analisi di dati su larga scala. Permette di eseguire query SQL ad alta velocità su dataset enormi senza dover gestire l'infrastruttura, consentendo agli utenti di concentrarsi sugli insight invece che sulla manutenzione.

A differenza dei database relazionali on-premise tradizionali, tipicamente basati su righe e limitati dall'hardware, BigQuery è un sistema cloud-native con storage colonnare che offre una scalabilità quasi infinita. La sua architettura distribuita e il modello di prezzo pay-as-you-go lo rendono più efficiente nella gestione dei carichi analitici rispetto ai database convenzionali.

Che cos'è un dataset in BigQuery?

Perché viene chiesto: per testare la tua conoscenza dell'organizzazione dei dati e della struttura di BigQuery.

Un dataset, in BigQuery, è definito come il contenitore di livello più alto che organizza tabelle, viste e altre risorse. Ciò consente il controllo degli accessi e l'individuazione dei dati. Strutturando i dati in modo efficiente, i dataset garantiscono migliori prestazioni delle query e una gestione ottimale degli accessi, rendendoli un componente fondamentale dell'architettura di BigQuery.

Come carichi i dati in BigQuery?

Perché viene chiesto: per testare la tua conoscenza dei diversi metodi di ingestione dei dati.

BigQuery offre diversi metodi di ingestione dei dati pensati per scopi differenti.

- Modalità di caricamento batch usata in genere per caricare un ampio dataset storico in BigQuery tramite l'interfaccia web di BigQuery, lo strumento a riga di comando bq o chiamate API.

- Ingestione in streaming che abilita l'elaborazione dei dati in tempo reale inviando singoli record o piccoli batch tramite la BigQuery Streaming API.

- Il servizio di trasferimento dati di BigQuery può semplificare importazioni pianificate da Google Cloud Storage, Google Ads e fonti SaaS.

Per workflow ETL avanzati, Google Cloud Dataflow e altri strumenti di pipeline facilitano il trasferimento fluido dei dati in BigQuery. La scelta del metodo di ingestione più adatto dipende da volume dei dati, latenza e necessità di elaborazione.

Quali tipi di dati supporta BigQuery?

Perché viene chiesto: per testare la tua conoscenza delle capacità di gestione dei dati di BigQuery.

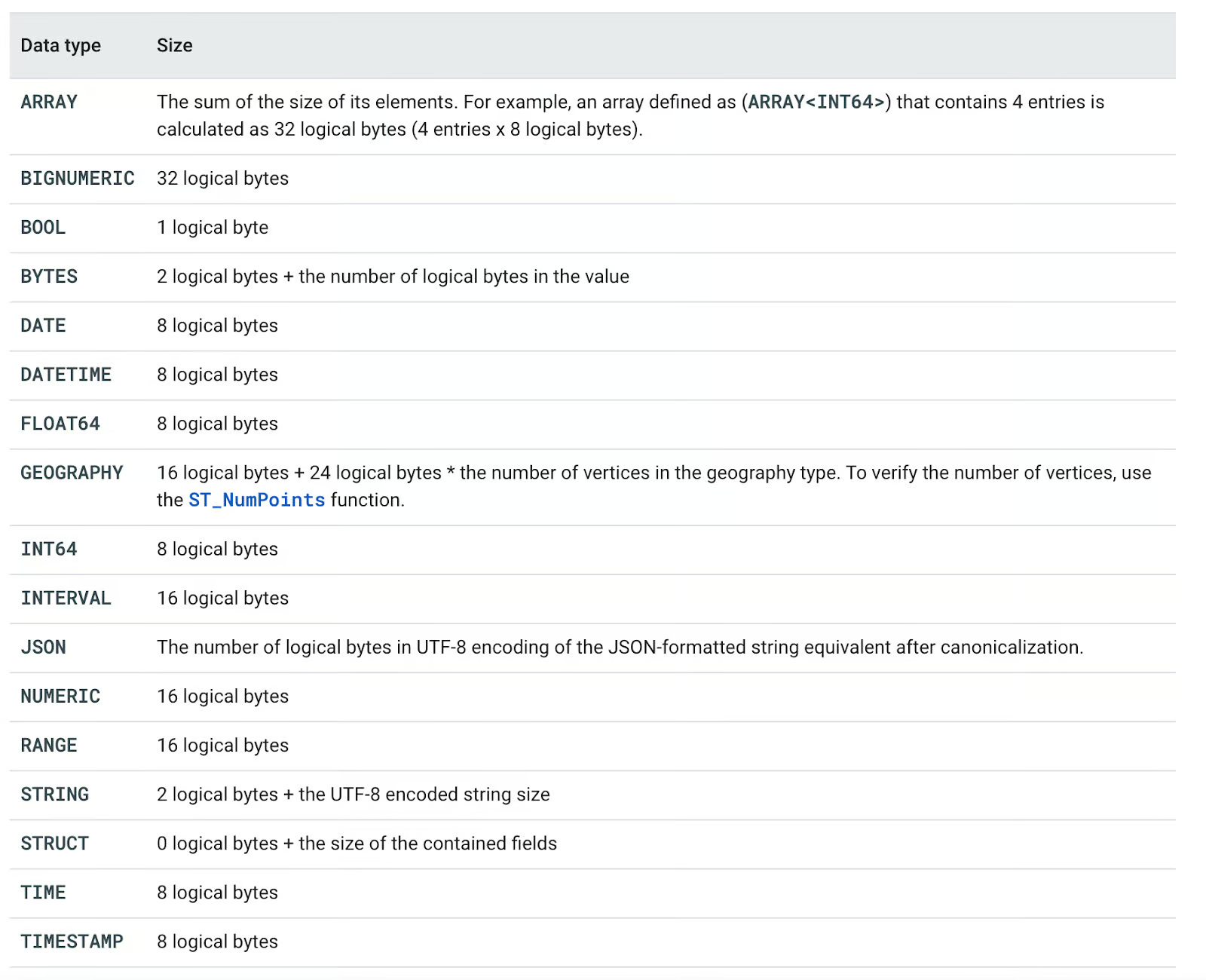

BigQuery supporta una varietà di tipi di dati, categorizzati in:

- Tipi di base: BOOL, INT64, FLOAT64, STRING, BYTES, DATE, DATETIME, TIME, TIMESTAMP

- Tipi complessi: ARRAY, STRUCT, JSON

- Tipi specializzati: NUMERIC, BIGNUMERIC, INTERVAL, GEOGRAPHY, RANGE

Ogni tipo di dato ha una dimensione logica di archiviazione definita, che influisce sulle prestazioni delle query e sui costi. Ad esempio, l'archiviazione di STRING dipende dalla lunghezza codificata in UTF-8, mentre ARRAY<INT64> richiede 8 byte per elemento. Comprendere questi tipi aiuta a ottimizzare le query e gestire i costi in modo efficiente.

Puoi consultare tutti i tipi di dati supportati nella seguente tabella.

Tipi di dati di BigQuery. Immagine da Google Cloud Documentation.

Quali sono i principali vantaggi dell'utilizzo di BigQuery?

Perché viene chiesto: per assicurarsi che tu capisca i principali benefici dell'uso di BigQuery come Data Warehouse.

Usare i servizi BigQuery porta cinque benefici principali rispetto alle soluzioni autogestite tradizionali:

- Scalabilità: tutti gli investimenti in hardware sono inizialmente rimandati. Ti permette di scalare facilmente le risorse in alto o in basso, a seconda delle esigenze di business.

- Flessibilità: l'infrastruttura può essere modificata in base alle necessità del business.

- Alta sicurezza: backup automatici e funzionalità di disaster recovery sono caratteristiche predefinite di soluzioni cloud come GCP.

- Convenienza economica: le opzioni pay-as-you-go consentono di pagare solo per i servizi effettivamente utilizzati.

- Condivisione dei dati e collaborazione: l'uso di servizi basati sul cloud favorisce la condivisione dei dati e la collaborazione.

Vantaggi di BigQuery. Immagine dell'autore.

Domande tecniche su BigQuery

Una volta compresi i fondamenti di BigQuery, è il momento di approfondire gli aspetti più tecnici che gli intervistatori valutano di frequente.

Queste domande vanno oltre le definizioni di base e testano la tua capacità di ottimizzare le prestazioni, gestire i costi e lavorare con funzionalità avanzate come partizionamento, clustering e sicurezza.

Che cos'è il partizionamento in BigQuery e come migliora le prestazioni?

Perché viene chiesto: per valutare la tua conoscenza delle tecniche di organizzazione dei dati e del loro impatto sull'efficienza delle query.

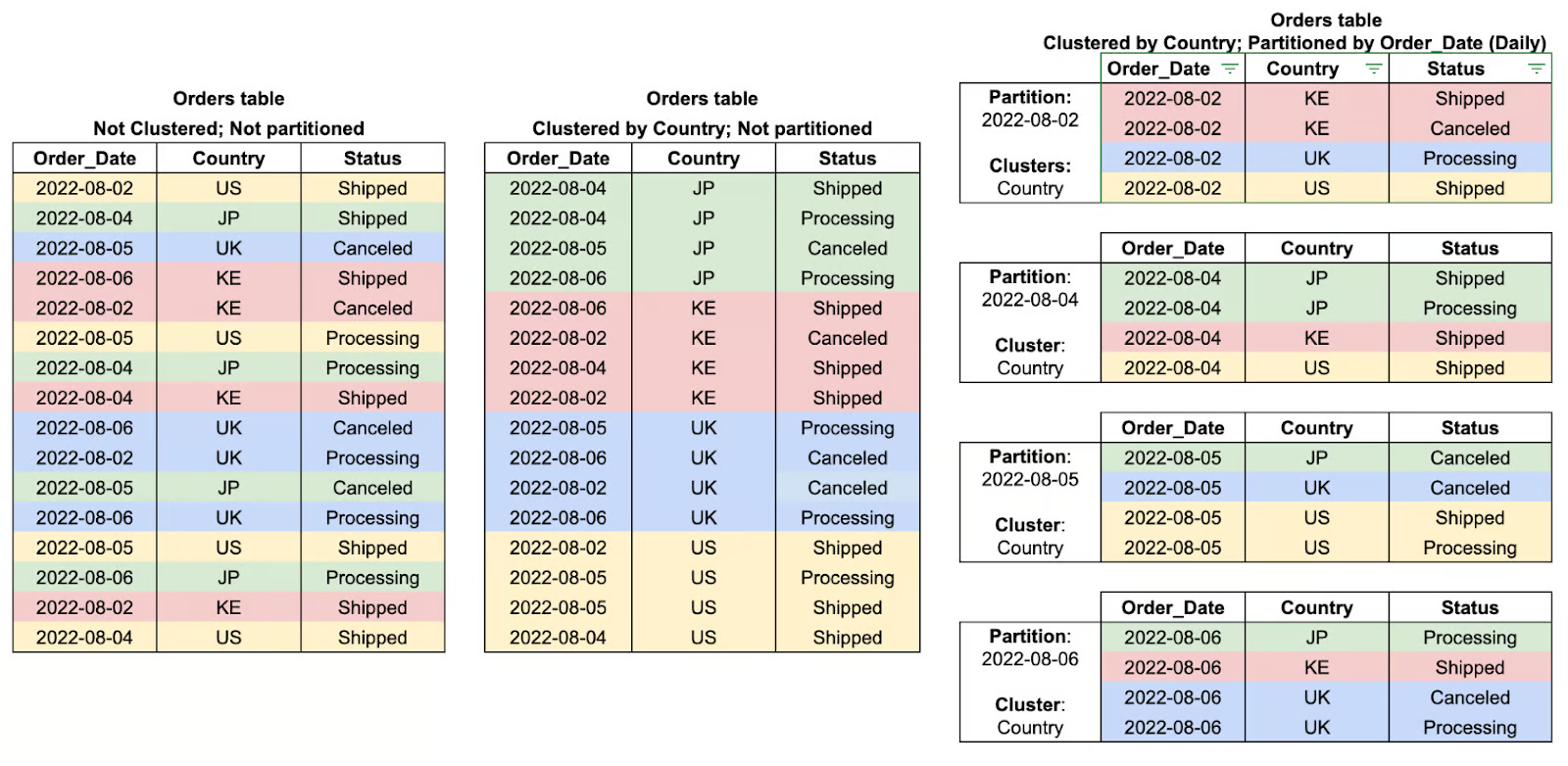

Il partizionamento in BigQuery è un metodo per suddividere tabelle grandi in parti più piccole e gestibili in base a un determinato criterio, come data, tempo di ingestione o valori interi. Segmentando i dati in partizioni, BigQuery può limitare la quantità di dati scansionati durante le query, aumentando le prestazioni e riducendo notevolmente i costi.

Ad esempio, una tabella partizionata che archivia i dati delle transazioni giornaliere consente alle query di filtrare in modo efficiente intervalli di date specifici invece di scansionare l'intero dataset. Questo rende il partizionamento particolarmente utile per l'analisi di serie temporali e i carichi analitici su larga scala.

Che cos'è il clustering in BigQuery e come migliora le prestazioni delle query?

Perché viene chiesto: per valutare la tua comprensione delle strategie di organizzazione dei dati che ottimizzano l'efficienza e i costi delle query.

Il clustering in BigQuery si riferisce all'organizzazione dei dati all'interno delle partizioni in base ai valori di una o più colonne specificate. Raggruppando di fatto le righe correlate, il clustering riduce la quantità di dati scansionati, migliorando così le prestazioni delle query e diminuendo i costi di elaborazione complessivi.

Questo tipo di ottimizzazione delle query è particolarmente efficace quando si filtrano, ordinano o aggregano dati in base alle colonne clusterizzate, dove il motore di query può ignorare del tutto i dati non pertinenti anziché eseguire una scansione completa della partizione. Il clustering dà il meglio se combinato con il partizionamento e offre ulteriori vantaggi prestazionali quando si lavora con grandi dataset.

Qual è la differenza tra una tabella e una vista in BigQuery?

Perché viene chiesto: per valutare la tua comprensione delle strutture dati di BigQuery e dei loro casi d'uso.

In BigQuery, una tabella è un'unità di archiviazione strutturata che contiene fisicamente i dati, mentre una vista è una tabella virtuale che recupera dinamicamente i dati in base a una query SQL predefinita. La distinzione chiave è che le viste non possono contenere dati di per sé, ma servono come base per scrivere query complesse o per applicare regole di sicurezza sull'accesso ai dati offrendo l'accesso a un sottoinsieme di dati senza duplicarli. Le viste migliorano anche i tempi di esecuzione delle query permettendo di riaccedere ai dati senza dover ricaricare o riorganizzare le tabelle, risultando potenti per analisi, astrazione dei dati e applicazione della sicurezza.

In parole semplici:

- Una tabella è un'unità di archiviazione strutturata che contiene fisicamente i dati

- Una vista è una tabella virtuale che recupera dinamicamente i dati in base a una query SQL predefinita senza archiviarli

Come gestisce BigQuery la sicurezza dei dati?

Perché viene chiesto: per verificare la tua conoscenza della sicurezza in BigQuery unita alla protezione dei dati sensibili.

BigQuery adotta un approccio stratificato alla sicurezza dei dati, partendo da un modello sicuro progettato per salvaguardare i dati a tutti i livelli del ciclo di vita.

- Crittografia dei dati a riposo con chiavi gestite da Google per impostazione predefinita o con chiavi gestite dal cliente se si desidera mantenerne il controllo.

- Crittografia dei dati in transito tramite HTTPS/TLS e durante il transito tra i client e BigQuery.

- Identity and Access Management (IAM) consente un controllo granulare degli accessi fornendo ruoli e assegnazioni a utenti e service account per garantire che solo le parti autorizzate possano accedere o modificare i dati. .

- Audit logging per tracciare l'attività di utenti e sistemi, fornendo una traccia di audit utile per monitoraggio e compliance.

Queste funzionalità di sicurezza integrate aiutano le organizzazioni a mantenere riservatezza, integrità e conformità normativa dei dati.

Che cos'è il BigQuery Data Transfer Service e come semplifica l'ingestione dei dati?

Perché viene chiesto: per valutare la tua comprensione della movimentazione e integrazione automatizzata dei dati in BigQuery.

Il BigQuery Data Transfer Service (BQ DTS) automatizza e pianifica le importazioni di dati da varie fonti esterne in BigQuery, eliminando la necessità di processi ETL manuali. Si integra nativamente con i servizi Google come Google Ads, YouTube e Google Cloud Storage, oltre che con applicazioni SaaS di terze parti.

Abilitando trasferimenti di dati automatici e pianificati, BQ DTS garantisce che i dati rimangano aggiornati per l'analisi senza richiedere intervento dell'utente. Questo servizio è particolarmente utile per le organizzazioni che gestiscono workflow ricorrenti di ingestione dati su larga scala, migliorando l'efficienza e riducendo l'overhead operativo.

Cosa sono i campi annidati e ripetuti in BigQuery e perché sono utili?

Perché viene chiesto: per valutare la tua comprensione del supporto di BigQuery ai dati semi-strutturati e dei suoi vantaggi rispetto ai modelli relazionali tradizionali.

BigQuery consente campi annidati e ripetuti, abilitando un'archiviazione e una interrogazione più efficienti di dati gerarchici o basati su array. I campi annidati usano il tipo di dato STRUCT, permettendo a una colonna di contenere sotto-campi, simile a un oggetto JSON.

I campi ripetuti funzionano come ARRAY, consentendo a una singola colonna di archiviare valori multipli. Queste strutture aiutano a eliminare la necessità di JOIN complessi, migliorano le prestazioni delle query e rendono BigQuery particolarmente adatto all'elaborazione di dati semi-strutturati come log, flussi di eventi e dataset in stile NoSQL.

Come puoi pianificare e automatizzare job in BigQuery?

Perché viene chiesto: per valutare la tua conoscenza dell'automazione dell'esecuzione delle query e della gestione dei workflow in BigQuery.

BigQuery offre diversi metodi per pianificare e automatizzare i job, assicurando che le attività ricorrenti vengano eseguite senza intervento manuale.

- Query pianificate che consentono di definire esecuzioni ricorrenti di query direttamente tramite l'interfaccia web di BigQuery o API.

- Cloud Scheduler fornisce un servizio completamente gestito simile a cron che attiva le query a intervalli predefiniti.

- Per l'automazione event-driven, Cloud Functions può eseguire job di BigQuery in risposta a trigger di altri servizi Google Cloud.

Questi strumenti di automazione aiutano a semplificare le pipeline di dati, ridurre il lavoro manuale e garantire un'elaborazione puntuale dei dati per analisi e reportistica.

Come gestisce Big Query il partizionamento e il clustering dei dati?

Perché viene chiesto: per valutare la tua comprensione delle strategie di organizzazione dei dati in BigQuery e del loro impatto su prestazioni e costi.

Partizionamento suddivide grandi tabelle in segmenti più piccoli, migliorando le prestazioni delle query scansionando solo i dati rilevanti.

-

Basato sul tempo: per DATE, TIMESTAMP, DATETIME (es., partizioni giornaliere su sales_date).

-

Intervallo di interi: per valori INTEGER (es., intervalli di

user_id). -

Tempo di ingestione: per timestamp di caricamento dati (

_PARTITIONDATE).

È ideale per dati di serie temporali e per ridurre i costi delle query quando si filtra per intervalli di date o numerici.

Clustering organizza i dati all'interno di una tabella o partizione ordinandoli in base a colonne selezionate, velocizzando le query.

È ideale per filtrare e aggregare in base a campi interrogati di frequente come regione o user_id.

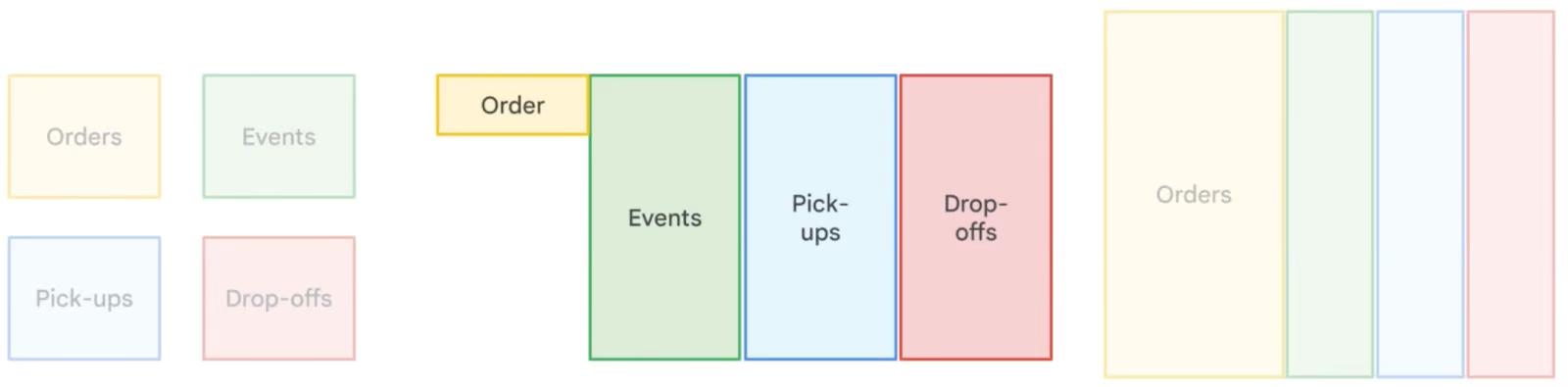

Esempi di cluster e partizioni di tabelle. Immagine di Google Cloud.

Domande sull'architettura di BigQuery

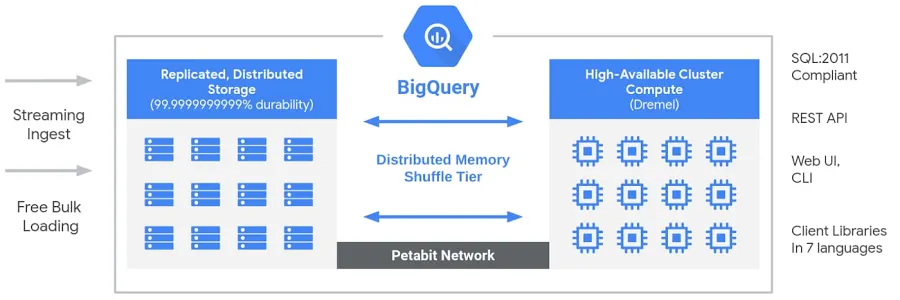

Com'è progettata l'architettura di Google BigQuery e cosa la rende unica?

Perché viene chiesto: per valutare la tua comprensione dell'architettura serverless di BigQuery e di come differisce dai data warehouse tradizionali.

BigQuery presenta un'architettura serverless completamente gestita che disaccoppia storage e compute, permettendo loro di scalare indipendentemente in base alla domanda. A differenza dei tradizionali data warehouse cloud o dei sistemi on-premise MPP (massively parallel processing), questa separazione offre flessibilità, convenienza economica e alta disponibilità senza richiedere la gestione dell'infrastruttura da parte degli utenti. Il motore di calcolo di BigQuery è alimentato da Dremel, un cluster multi-tenant che esegue efficientemente query SQL, mentre i dati sono archiviati in Colossus, il sistema di archiviazione distribuita globale di Google. Questi componenti comunicano tramite Jupiter, la rete su scala petabit di Google, garantendo trasferimenti di dati ultra veloci. L'intero sistema è orchestrato da Borg, il sistema interno di gestione dei cluster di Google e precursore di Kubernetes. Questa architettura consente di eseguire analisi ad alte prestazioni e scalabili su dataset massivi senza doversi preoccupare della gestione dell'infrastruttura.

Architettura di Big Query. Immagine di Google.

Come BigQuery separa storage e compute e perché questo è vantaggioso?

Perché viene chiesto: questa domanda valuta la tua comprensione dell'architettura di BigQuery, in particolare come il suo modello disaccoppiato di storage e compute migliori scalabilità, costi e prestazioni.

BigQuery segue un'architettura serverless completamente gestita in cui storage e compute sono completamente separati:

- Storage: i dati sono archiviati in Colossus, il sistema di storage distribuito globale di Google. Ciò garantisce alta disponibilità, durabilità e una scalabilità quasi infinita senza richiedere la gestione dell'infrastruttura.

- Compute: l'esecuzione delle query è gestita da Dremel, un motore distribuito che alloca dinamicamente le risorse computazionali (slot) in base al carico di lavoro.

Vantaggi chiave della separazione storage-compute:

- Scalabilità indipendente: puoi scalare lo storage senza influire sul compute e viceversa.

- Convenienza economica: paghi solo per i dati scansionati durante le query, evitando costi di compute non necessari.

- Prestazioni ottimizzate: le query sono più veloci perché lo storage non fa da collo di bottiglia al calcolo.

- Storage multiregione: i dati possono essere archiviati in posizioni diverse senza impattare sulla velocità delle query.

Questo design consente a BigQuery di elaborare query su scala petabyte in modo efficiente mantenendo bassi i costi, rendendolo una scelta ideale per l'analisi nel cloud.

Questa flessibilità architetturale è cruciale mentre il settore sposta l'attenzione verso una potenza computazionale massiva. Come osservato nel podcast DataFramed riguardo ai trend dei dati per il 2025:

C'è sicuramente una scommessa che stanno facendo tutti i grandi player. Stanno costruendo più capacità di calcolo e quindi scaleranno attraverso più compute il prossimo anno. Poi la domanda è: OK, ci sono più dati? Ed è qui che diventa più sfumato. E penso sia uno spettro. Non è bianco o nero.

Jonathan Cornelissen, Co-founder & CEO of DataCamp

Che cos'è Dremel e come abilita le prestazioni rapide delle query di BigQuery?

Perché viene chiesto: per valutare la tua conoscenza di Dremel, il motore di query sottostante di BigQuery, e di come il suo modello di esecuzione ad albero e colonnare abiliti analisi dei dati ad alte prestazioni.

Dremel è un motore distribuito di esecuzione delle query che alimenta BigQuery. A differenza dei database tradizionali che usano l'elaborazione basata su righe, Dremel utilizza un formato di archiviazione colonnare e un modello di esecuzione delle query ad albero per ottimizzare velocità ed efficienza.

Come Dremel rende le query veloci:

- Archiviazione colonnare: invece di leggere intere righe, Dremel scansiona solo le colonne necessarie, riducendo la quantità di dati elaborati.

- Esecuzione ad albero: le query sono suddivise in frammenti ed eseguite in parallelo su migliaia di nodi. I risultati sono aggregati in una struttura ad albero gerarchica, minimizzando la latenza.

- Allocazione serverless delle risorse: Dremel assegna dinamicamente slot di calcolo alle query in base alla complessità, garantendo un uso efficiente delle risorse.

Benefici chiave di Dremel:

- Query velocissime su dataset in scala petabyte.

- Elaborazione conveniente eseguendo la scansione delle sole colonne rilevanti.

- Parallelizzazione automatica per carichi di lavoro elevati senza tuning manuale.

Puoi saperne di più su Dremel nella documentazione ufficiale di Google.

Come funziona la denormalizzazione in BigQuery e quando andrebbe usata?

Perché viene chiesto: per valutare la tua comprensione delle strategie di modellazione dei dati e del loro impatto sulle prestazioni delle query nei database analitici.

La denormalizzazione in BigQuery introduce intenzionalmente ridondanza unendo tabelle e duplicando dati per ottimizzare le prestazioni delle query. A differenza della normalizzazione, che minimizza la ridondanza tramite tabelle più piccole e correlate, la denormalizzazione riduce la necessità di join complessi, con conseguenti tempi di lettura più rapidi. Questo approccio è particolarmente utile in data warehousing e analytics, dove le operazioni di lettura sono più frequenti delle scritture. Tuttavia, la denormalizzazione aumenta i requisiti di storage, motivo per cui BigQuery raccomanda di usare campi annidati e ripetuti per strutturare in modo efficiente i dati denormalizzati riducendo al minimo l'overhead di archiviazione.

Confronto tra diverse strategie di normalizzazione dei dati. Immagine di Google Cloud.

Domande specifiche su SQL

Una volta che hai una solida comprensione dell'architettura di BigQuery e delle tecniche di ottimizzazione, la prossima area critica su cui concentrarsi è la padronanza di SQL. SQL è la spina dorsale del lavoro con BigQuery e spesso gli intervistatori testano la tua capacità di scrivere, ottimizzare e risolvere i problemi delle query. Per prepararti al meglio, ti incoraggio a iscriverti ai corsi SQL di DataCamp.

Come esegui un'operazione di JOIN in BigQuery?

Perché viene chiesto: per valutare la tua capacità di combinare dati da più tabelle usando le operazioni SQL JOIN.

BigQuery supporta vari tipi di JOIN per combinare dati da più tabelle in base a una colonna condivisa. Ad esempio, per recuperare i dettagli dei prodotti insieme alle relative informazioni di vendita, puoi usare un INNER JOIN tra la TABELLA DELLE VENDITE e la TABELLA DEI PRODOTTI sulla Product_Id:

SELECT

s.Id AS Sales_Id,

p.Product,

p.Price,

s.Purchase_date

FROM sales_table s

JOIN product_table p

ON s.Product_Id = p.Id;Per ulteriori dettagli, come le date di consegna, puoi unire la TABELLA DELLE CONSEGNE:

SELECT

s.Id AS Sales_Id,

p.Product,

p.Price,

s.Purchase_date,

d.Deliver_date

FROM sales_table s

JOIN product_table p ON s.Product_Id = p.Id

JOIN delivery_table d ON s.Id = d.Sales_Id;Scrivi una query SQL per selezionare i 10 prodotti più costosi.

Perché viene chiesto: per valutare la tua capacità di recuperare e ordinare i dati in modo efficiente.

Per trovare i 10 prodotti più costosi, usa ORDER BY per ordinare per prezzo in ordine decrescente e LIMIT per limitare il risultato:

SELECT

Product,

Price

FROM product_table

ORDER BY Price DESC

LIMIT 10;Scrivi una query SQL per calcolare il numero medio di vendite al mese.

Perché viene chiesto: per valutare la tua capacità di eseguire aggregazioni basate sul tempo.

Per calcolare il numero medio di vendite al mese, usa la funzione EXTRACT per raggruppare le vendite per mese e COUNT per contare il numero di vendite al mese:

SELECT

EXTRACT(MONTH FROM Purchase_date) AS Month,

COUNT(Id) AS Total_Sales,

AVG(COUNT(Id)) OVER () AS Average_Sales

FROM sales_table

GROUP BY Month;Scrivi una query SQL per trovare il numero totale di consegne per prodotto.

Perché viene chiesto: per valutare la tua capacità di aggregare i dati utilizzando GROUP BY e COUNT.

Per contare le consegne per ciascun prodotto:

SELECT

p.Product,

COUNT(d.Id) AS Total_Deliveries

FROM delivery_table d

JOIN product_table p

ON d.Product_Id = p.Id

GROUP BY p.Product;Scrivi una query SQL per trovare il numero totale di consegne per ciascun prodotto.

Perché viene chiesto: per valutare la tua capacità di filtrare dati basati sul tempo.

Per ottenere i record di vendita degli ultimi 30 giorni:

SELECT *

FROM sales_table

WHERE Purchase_date >= DATE_SUB(CURRENT_DATE(), INTERVAL 30 DAY);Scrivi una query SQL per contare il numero di prodotti unici venduti nell'ultima settimana.

Perché viene chiesto: per valutare la tua capacità di eseguire conteggi distinti su dati basati sul tempo.

Per contare i prodotti distinti venduti negli ultimi 7 giorni:

SELECT COUNT(DISTINCT Product_Id) AS Unique_Products_Sold

FROM sales_table

WHERE Purchase_date >= DATE_SUB(CURRENT_DATE(), INTERVAL 7 DAY);Scrivi una query SQL per raggruppare i dati di vendita per prodotto e calcolare il ricavo totale per ciascuno.

Perché viene chiesto: per testare la tua capacità di usare GROUP BY e di aggregare le vendite.

Per calcolare il ricavo totale per prodotto:

SELECT

p.Product,

SUM(p.Price) AS Total_Revenue

FROM sales_table s

JOIN product_table p

ON s.Product_Id = p.Id

GROUP BY p.Product;Scrivi una query SQL per calcolare la percentuale delle vendite totali attribuita a ciascun prodotto.

Perché viene chiesto: per valutare la tua capacità di calcolare percentuali con SQL.

Per determinare la percentuale delle vendite totali per prodotto:

SELECT

p.Product,

SUM(p.Price) AS Product_Sales,

(SUM(p.Price) / (SELECT SUM(Price) FROM product_table)) * 100 AS Sales_Percentage

FROM sales_table s

JOIN product_table p

ON s.Product_Id = p.Id

GROUP BY p.Product;Scrivi una query SQL per classificare i prodotti in base alle vendite totali.

Perché viene chiesto: per valutare la tua capacità di usare funzioni finestra per il ranking.

Per classificare i prodotti in base alle vendite totali:

SELECT

p.Product,

SUM(p.Price) AS Total_Sales,

RANK() OVER (ORDER BY SUM(p.Price) DESC) AS Sales_Rank

FROM sales_table s

JOIN product_table p

ON s.Product_Id = p.Id

GROUP BY p.Product;Scrivi una query SQL per calcolare il tempo medio di consegna per ciascun prodotto.

Perché viene chiesto: per valutare la tua capacità di lavorare con differenze di date in SQL.

Per calcolare il tempo medio di consegna per prodotto:

SELECT

p.Product,

AVG(DATE_DIFF(d.Deliver_date, s.Purchase_date, DAY)) AS Avg_Delivery_Time

FROM sales_table s

JOIN delivery_table d

ON s.Id = d.Sales_Id

JOIN product_table p

ON s.Product_Id = p.Id

GROUP BY p.Product;Domande avanzate e basate su scenari

Oltre alle conoscenze di base e alla padronanza di SQL, le capacità di problem solving nel mondo reale sono cruciali per lavorare con BigQuery su larga scala.

Le domande avanzate dei colloqui si concentrano spesso sulla gestione di grandi dataset, sull'ottimizzazione delle prestazioni, sulla gestione delle pipeline di dati e sulla risoluzione dei problemi più comuni negli ambienti di produzione.

Puoi descrivere la tua esperienza nell'implementazione di pipeline di dati in BigQuery?

Perché viene chiesto: per valutare la tua conoscenza pratica nella creazione, gestione e ottimizzazione di pipeline di dati in BigQuery, inclusi ingestione, trasformazione, orchestrazione e monitoraggio.

L'intervistatore cerca indicazioni sulla tua esperienza pratica nella progettazione e implementazione di pipeline di dati in BigQuery. Dovresti parlare di:

- Ingestione dei dati: metodi usati (BigQuery Data Transfer Service, Cloud Storage, ingestione in streaming).

- Trasformazione dei dati: uso di trasformazioni basate su SQL, query pianificate o strumenti come Dataflow e dbt.

- Orchestrazione: come gestisci i workflow di pipeline usando Cloud Composer (Apache Airflow), Cloud Functions o Cloud Scheduler.

- Monitoraggio e ottimizzazione: come tracci le prestazioni della pipeline, risolvi i problemi e ottimizzi i costi delle query.

Una risposta solida dovrebbe includere esempi reali di sfide affrontate e di come le hai risolte, come la gestione di grandi dataset, l'ottimizzazione delle prestazioni delle query o la garanzia dell'integrità dei dati nelle pipeline di produzione.

Alcune buone risorse per implementare un progetto di questo tipo sono:

- La seguente guida YouTube su pipeline ETL batch con BigQuery.

- Il seguente repo GitHub di pipeline end-to-end.

- Il seguente repo GitHub di una pipeline ETL con Airflow e BigQuery.

Come puoi rimuovere record duplicati da una colonna in una grande tabella BigQuery mantenendo il nome della tabella?

Perché viene chiesto: per valutare la tua capacità di gestire in modo efficiente dati duplicati in BigQuery senza modificare la struttura della tabella.

Quando lavori con una tabella contenente milioni di righe e valori duplicati in una specifica colonna, l'approccio migliore è usare la funzione finestra ROW_NUMBER() per identificare e mantenere solo la prima occorrenza di ciascun duplicato, rimuovendo le altre.

Puoi ottenere questo risultato sovrascrivendo la tabella con una versione deduplicata usando un'istruzione CREATE OR REPLACE TABLE:

CREATE OR REPLACE TABLE tableX AS

SELECT * EXCEPT(row_number)

FROM (

SELECT *,

ROW_NUMBER() OVER (PARTITION BY troubleColumn ORDER BY someOtherColumn) AS row_number

FROM tableX

)

WHERE row_number = 1;Ecco come funziona:

-

ROW_NUMBER()assegna un numero di riga univoco a ciascun record all'interno dello stesso valore ditroubleColumn, garantendo che venga mantenuto un solo record per gruppo di duplicati. -

La clausola

PARTITION BYtroubleColumnraggruppa le righe in base ai duplicati in quella colonna. -

La clausola

ORDER BYsomeOtherColumn(ad es.,Purchase_date) garantisce che venga mantenuto un record specifico. -

La query esterna filtra solo la prima occorrenza (

row_number = 1), rimuovendo di fatto i duplicati. -

L'istruzione

CREATE OR REPLACE TABLEgarantisce che la tabella mantenga lo stesso nome sostituendola con i dati puliti.

Questo approccio elimina in modo efficiente i duplicati senza creare una nuova tabella o influire sulla struttura complessiva della tabella.

Come usi BigQuery per la visualizzazione dei dati e la reportistica, e quali sono gli strumenti più comuni?

Perché viene chiesto: per valutare la tua capacità di integrare BigQuery con strumenti di visualizzazione e comunicare efficacemente gli insight tramite reportistica.

BigQuery funge da potente backend per la visualizzazione dei dati e la reportistica, consentendo connessioni dirette con strumenti come Google Looker Studio (ex Data Studio), Tableau e Power BI.

Questi strumenti permettono di interrogare i dati in tempo reale e creare dashboard, grafici e report personalizzati senza esportazioni manuali dei dati. Le tecniche chiave per la visualizzazione includono:

- Aggregare e trasformare i dati in BigQuery usando SQL prima della visualizzazione.

- Costruire dashboard interattivi con filtri dinamici e funzionalità di drill-down.

- Ottimizzare query e viste materializzate per migliorare le prestazioni dei dashboard.

Una risposta efficace dovrebbe evidenziare casi d'uso reali, come:

- Monitoraggio delle KPI aziendali

- Monitoraggio dei trend

- Generazione di report automatici

Per implementare un tuo progetto di Data Visualization, puoi seguire i progetti specializzati di DataCamp sull'Analisi delle abitudini di ricarica dei veicoli elettrici e sull'Esplorazione della rete di trasporti di Londra con BigQuery.

Domande sulle best practice e sull'ottimizzazione in BigQuery

Lavorare in modo efficiente con BigQuery va oltre la scrittura di query SQL: richiede di ottimizzare le prestazioni, gestire i costi e implementare best practice per garantire operazioni sui dati fluide. Poiché BigQuery opera con un modello a consumo, capire come minimizzare le scansioni dei dati, sfruttare partizionamento e clustering e ottimizzare l'esecuzione delle query è cruciale sia per le prestazioni che per l'efficienza dei costi.

Quali sono le best practice per gestire in modo efficiente i costi di BigQuery?

Perché viene chiesto: per valutare la tua capacità di ottimizzare i costi lavorando con grandi dataset in BigQuery.

Per gestire efficacemente i costi di BigQuery, dovresti:

-

Ottimizzare le query per scansionare solo le colonne e le righe necessarie, evitando

SELECT *. -

Usare tabelle partizionate e clusterizzate per minimizzare la scansione dei dati e migliorare le prestazioni delle query.

-

Sfruttare gli strumenti di monitoraggio dei costi come budget, avvisi e policy di controllo dei costi in Google Cloud.

-

Sfruttare le prenotazioni di slot per una tariffazione più prevedibile e risparmi sui costi.

-

Pulire regolarmente tabelle e partizioni inutilizzate per ottimizzare i costi di archiviazione.

Una strategia di gestione dei costi ben strutturata aiuta a controllare le spese mantenendo efficiente l'esecuzione delle query.

Quali sono le best practice per ottimizzare le prestazioni delle query in BigQuery?

Perché viene chiesto: per valutare la tua capacità di scrivere query efficienti che riducano tempi di esecuzione e costi.

Per ottimizzare le prestazioni delle query in BigQuery:

-

Progetta uno schema efficiente, selezionando tipi di dati appropriati ed evitando una normalizzazione eccessiva.

-

Usa partizionamento e clustering per ridurre la quantità di dati scansionati.

-

Evita

SELECT *, recuperando solo le colonne necessarie. -

Ottimizza le operazioni di JOIN e GROUP BY, assicurandoti di seguire le best practice per query su larga scala.

-

Sfrutta caching e viste materializzate per archiviare risultati precomputati e migliorare le prestazioni.

-

Usa funzioni di aggregazione approssimative, come

APPROX_COUNT_DISTINCT, quando non è richiesta precisione assoluta.

Seguendo queste pratiche, puoi velocizzare le query, ridurre i costi di calcolo e migliorare l'efficienza complessiva.

Cosa sono gli slot di BigQuery e come influiscono sulle prestazioni delle query?

Perché viene chiesto: per valutare la tua comprensione delle risorse computazionali di BigQuery e del loro effetto sull'esecuzione delle query.

Gli slot di BigQuery sono unità di capacità computazionale usate per elaborare query SQL. Vengono allocati dinamicamente in base alle esigenze del carico di lavoro, garantendo un utilizzo efficiente delle risorse. Le organizzazioni possono scegliere tra:

- Slot on-demand, che si adattano automaticamente in base alle necessità delle query.

- Slot riservati, che offrono prestazioni più prevedibili e risparmi per carichi di lavoro costanti.

Una gestione efficiente degli slot può ridurre i tempi di esecuzione delle query, ottimizzare l'allocazione delle risorse e abbassare i costi complessivi.

Come puoi monitorare e ottimizzare efficacemente i costi di BigQuery?

Perché viene chiesto: per valutare la tua capacità di tracciare e controllare le spese di BigQuery.

Per monitorare e ottimizzare i costi in BigQuery:

- Analizza l'esecuzione delle query usando la cronologia delle query e i piani EXPLAIN per identificare operazioni costose.

- Abilita i log di audit per tracciare i pattern di utilizzo e individuare query inefficienti.

- Imposta budget e avvisi sui costi per prevenire spese impreviste.

- Ottimizza l'uso degli slot, sfruttando slot riservati per carichi stabili per ridurre i costi.

- Pulisci regolarmente tabelle e partizioni inutilizzate per evitare costi di storage non necessari.

Implementando queste strategie, puoi assicurare un'elaborazione dei dati conveniente mantenendo prestazioni e scalabilità.

Suggerimenti aggiuntivi per superare il tuo colloquio su BigQuery

Ecco alcuni ultimi consigli per affrontare al meglio il tuo prossimo colloquio su BigQuery.

Padroneggia i fondamenti. Comprendi l'architettura di BigQuery, incluso il design serverless, la separazione tra storage e compute e il motore di query Dremel con il nostro corso introduttivo su BigQuery. Impara dataset, tabelle, viste e viste materializzate per gestire e strutturare i dati in modo efficiente. Il nostro tutorial sulle viste materializzate in SQL ti sarà d'aiuto.

Affina le tue abilità in SQL e nell'ottimizzazione delle query. Esercitati con le funzioni SQL specifiche di BigQuery (ARRAY, STRUCT, funzioni finestra) per query complesse con il nostro code-along Getting Started with BigQuery. Ottimizza le query con partizionamento, clustering e funzioni approssimative per ridurre i costi e migliorare le prestazioni seguendo la documentazione ufficiale di Google.

Fai esperienza pratica. Lavora su progetti reali usando dataset pubblici e crea report con Looker Studio, Tableau o Power BI con i progetti DataCamp. Provare Analyzing Electric Vehicle Charging Habits e Exploring London's Travel Network sono entrambi ottimi modi per migliorare le tue abilità SQL.

Josep è un Data Scientist freelance specializzato in progetti europei, con competenze in archiviazione e processamento dei dati, analisi avanzate e data storytelling efficace.

Come docente, insegna Big Data nel corso di laurea magistrale dell’Università di Navarra e condivide le sue idee tramite articoli su piattaforme come Medium, KDNuggets e DataCamp. Josep scrive anche di Data e Tech nella sua newsletter Databites (databites.tech).

Ha conseguito una laurea in Ingegneria Fisica presso la Università Politecnica della Catalogna e un master in Intelligent Interactive Systems presso la Università Pompeu Fabra.

FAQs

Che cos'è BigQuery e in cosa differisce dai database tradizionali?

BigQuery è un data warehouse completamente gestito e serverless su Google Cloud, progettato per l'analisi di dati su larga scala. A differenza dei database relazionali on-premise tradizionali, tipicamente basati su righe e limitati dall'hardware, BigQuery è un sistema cloud-native con storage colonnare che offre una scalabilità quasi infinita. La sua architettura distribuita e il modello di prezzo pay-as-you-go lo rendono più efficiente nella gestione dei carichi analitici rispetto ai database convenzionali.

Quali sono i principali vantaggi dell'utilizzo di BigQuery?

BigQuery offre cinque vantaggi chiave: (1) Scalabilità – scala automaticamente le risorse in alto o in basso, (2) Flessibilità – l'infrastruttura si adatta alle esigenze di business, (3) Alta sicurezza – crittografia e controllo degli accessi integrati, (4) Convenienza economica – pricing pay-as-you-go, e (5) Condivisione dei dati e collaborazione – le soluzioni cloud consentono un accesso fluido tra i team.

Che cos'è il partizionamento in BigQuery e come migliora le prestazioni?

Il partizionamento in BigQuery divide grandi tabelle in parti più piccole e gestibili in base a criteri come data, tempo di ingestione o valori numerici. Ciò migliora le prestazioni delle query scansionando solo le partizioni rilevanti invece dell'intera tabella, riducendo i costi e i tempi di esecuzione. È particolarmente utile per l'analisi di serie temporali e grandi dataset.

Qual è la differenza tra una tabella e una vista in BigQuery?

Una tabella archivia fisicamente i dati, mentre una vista è una tabella virtuale che recupera dinamicamente i dati in base a una query SQL predefinita. Le viste aiutano a semplificare query complesse, applicare controlli di accesso ai dati e migliorare i tempi di esecuzione senza duplicare i dati.

Come gestisce BigQuery la sicurezza dei dati?

BigQuery impiega più livelli di sicurezza: (1) crittografia dei dati a riposo e in transito, (2) Identity and Access Management (IAM) per un controllo granulare degli accessi, (3) audit logging per monitorare l'uso e la conformità, e (4) chiavi di crittografia gestite dal cliente per un controllo di sicurezza avanzato.