Track

Po miesiącach plotek i tuż po premierach nowych GPT-5.5 i Claude Opus 4.7, DeepSeek wreszcie udostępnił DeepSeek V4. Wydanie obejmuje dwa modele w wersji preview: V4-Pro i V4-Flash, które trafiają na rynek z agresywnymi cenami i wydajnością niemal na poziomie czołówki.

DeepSeek V4-Pro oferuje łącznie 1,6 biliona parametrów oraz domyślne okno kontekstu o wielkości 1 miliona tokenów. DeepSeek twierdzi, że pozostaje w tyle za najnowocześniejszymi zamkniętymi modelami jedynie o 3–6 miesięcy, kosztując przy tym ułamek ceny konkurentów, takich jak OpenAI i Anthropic.

W tym artykule omawiam wydanie DeepSeek V4, przyglądając się kluczowym funkcjom, wynikom testów i porównaniom z konkurencją. Zachęcam również do zapoznania się z naszymi przewodnikami po GPT-5.5 i Claude Opus 4.7. Po szczegółowe porównania sięgnij do artykułów: DeepSeek V4 vs GPT-5.5, Claude Opus 4.7 vs DeepSeek V4 oraz DeepSeek V4 Flash vs GPT-5.4 mini i nano.

DeepSeek V4 w pigułce

- V4 występuje w dwóch wersjach: Pro (1,6T parametrów) i Flash (284B parametrów).

- Oba modele mają domyślne okno kontekstu liczące 1 milion tokenów.

- Pro kosztuje $1,74 za wejście / $3,48 za wyjście za milion tokenów, znacznie taniej niż GPT-5.5 i Opus 4.7.

- Dostępny przez API, interfejs webowy oraz w formie otwartych wag (licencja MIT).

Czym jest DeepSeek V4?

DeepSeek V4 to długo oczekiwana nowa seria modeli językowych z otwartymi wagami od chińskiego laboratorium AI DeepSeek. Wydany 24 kwietnia 2026 r., zestaw V4 obejmuje dwie wersje: DeepSeek-V4-Pro i DeepSeek-V4-Flash. Oba modele wykorzystują architekturę Mixture of Experts (MoE) i oferują domyślnie ogromne okno kontekstu na poziomie 1 miliona tokenów.

Tym, co czyni DeepSeek V4 przełomowym wydaniem dla branży, jest połączenie wydajności bliskiej czołówce z wyjątkowo konkurencyjną ceną. Model V4-Pro ma łącznie 1,6 biliona parametrów (49 miliardów aktywnych), co czyni go największym obecnie dostępnym modelem z otwartymi wagami.

Pomimo rozmiaru, DeepSeek twierdzi, że pozostaje w tyle za najnowocześniejszymi zamkniętymi modelami jedynie o 3–6 miesięcy, kosztując przy tym ułamek ceny konkurentów, takich jak OpenAI i Anthropic.

Kluczowe funkcje DeepSeek V4

Przyjrzyjmy się najważniejszym elementom najnowszego wydania:

Innowacje strukturalne i efektywność kontekstu 1M

Najmocniejszą stroną DeepSeek V4 jest wyjątkowo efektywna obsługa długiego kontekstu.

Zgodnie z notatkami technicznymi, seria V4 wykorzystuje hybrydową architekturę uwagi, łączącą Compressed Sparse Attention (CSA) i Heavily Compressed Attention (HCA).

Dzięki tym zmianom strukturalnym, okno kontekstu 1 miliona tokenów stało się standardem we wszystkich usługach DeepSeek.

DeepSeek twierdzi, że w scenariuszu kontekstu 1M tokenów DeepSeek-V4-Pro wymaga jedynie 27% FLOPs inferencji dla pojedynczego tokena i zaledwie 10% pamięci podręcznej KV w porównaniu z poprzednikiem, DeepSeek-V3.2.

Trzy tryby intensywności rozumowania

Aby dać użytkownikom precyzyjną kontrolę nad opóźnieniami i wydajnością, DeepSeek V4 oferuje trzy tryby rozumowania:

- Non-think: Szybkie, intuicyjne odpowiedzi do rutynowych zadań i niskiego ryzyka decyzji.

- Think High: Świadoma analiza logiczna, wolniejsza, ale bardzo dokładna w złożonym rozwiązywaniu problemów.

- Think Max: Wypycha możliwości rozumowania do absolutnych granic w celu eksploracji możliwości modelu.

Udoskonalone możliwości agentowe

DeepSeek V4 jest najwyraźniej zoptymalizowany pod kątem agentowego kodowania. W notatkach wydawniczych czytamy, że integruje się bezszwowo z wiodącymi agentami AI, takimi jak Claude Code, OpenClaw i OpenCode, a także zasila wewnętrzną infrastrukturę agentowego kodowania DeepSeek.

Zaawansowane optymalizacje treningowe

Pod maską DeepSeek wprowadził Manifold-Constrained Hyper-Connections (mHC), aby wzmocnić połączenia rezydualne i ustabilizować propagację sygnału. Przełączono się także na optymalizator Muon dla szybszej zbieżności i większej stabilności uczenia, wstępnie trenując modele na ponad 32 bilionach zróżnicowanych tokenów.

Wyniki testów DeepSeek V4

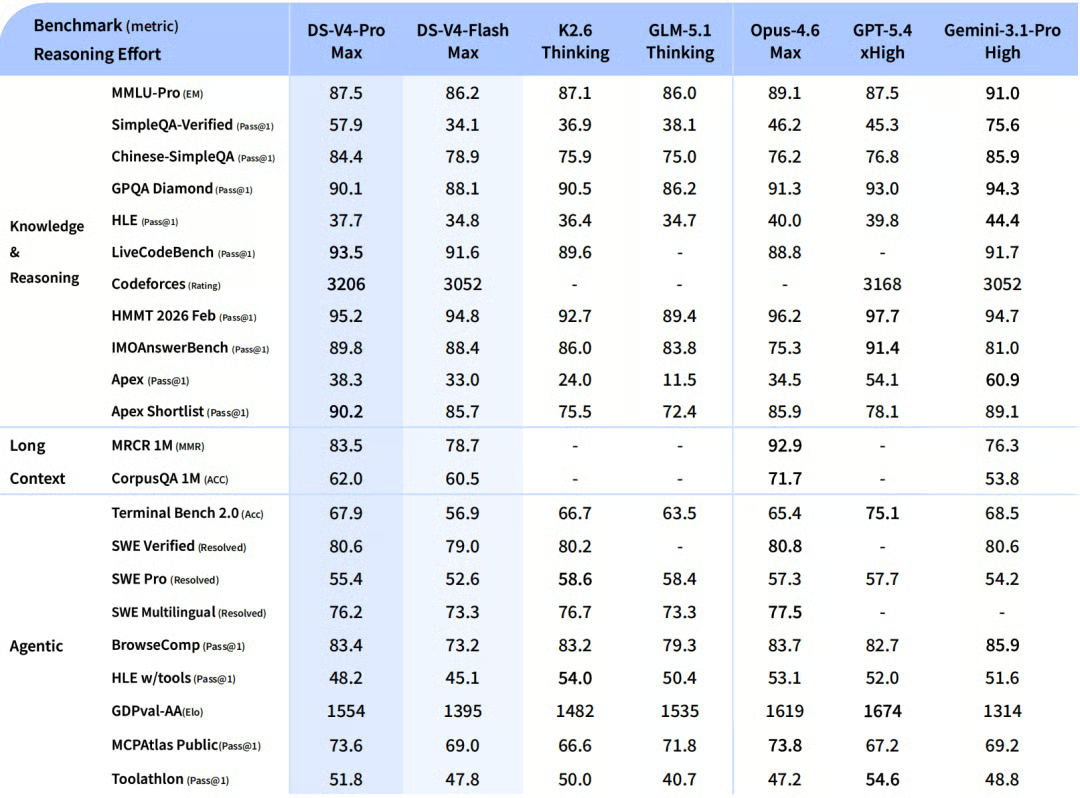

Według wewnętrznych wyników DeepSeek, DeepSeek V4 osiąga imponującą wydajność, zwłaszcza przy maksymalnym poziomie rozumowania (DeepSeek-V4-Pro-Max).

Zgodnie z oficjalnymi notatkami wydawniczymi, tak model wypada na tle branży:

Wiedza i rozumowanie

Pro-Max z łatwością prześciga inne modele open-source i pokonuje starsze modele czołowe, takie jak GPT-5.2. Osiąga bardzo konkurencyjne 87,5% w MMLU-Pro i 90,1% w GPQA Diamond, a także imponujące 92,6% w GSM8K dla matematyki. Choć wciąż minimalnie ustępuje absolutnej czołówce (GPT-5.4 i Gemini-3.1-Pro) o kilka miesięcy, znacząco zmniejsza lukę wiedzy.

Zadania agentowe

Pro-Max dorównuje wiodącym modelom otwartym, osiągając 67,9% w Terminal Bench 2.0 oraz 55,4% w SWE-Bench Pro. Choć na publicznych listach wyników nieznacznie ustępuje najnowszym modelom zamkniętym, testy wewnętrzne pokazują, że przewyższa Claude Sonnet 4.5 i zbliża się do poziomu Opus 4.5.

Długi kontekst

Okno 1 miliona tokenów to nie tylko chwyt. Pro-Max osiąga tu bardzo mocne wyniki, uzyskując 83,5% w testach wyszukiwania „igły w stogu siana” MRCR 1M (MMR). Wynik ten faktycznie przewyższa Gemini-3.1-Pro w akademickich benchmarkach długiego kontekstu.

DeepSeek V4 Pro vs Flash

Ze względu na mniejszy rozmiar, Flash-Max naturalnie uzyskuje niższe wyniki w zakresie czystej wiedzy i ma trudności z najbardziej złożonymi przepływami agentowymi. Jednak przy zwiększonym „budżecie myślenia” osiąga wyniki rozumowania porównywalne ze starszymi modelami czołowymi, co czyni go niezwykle opłacalną opcją przy dużych obciążeniach.

Jak uzyskać dostęp do DeepSeek V4?

Obecnie istnieje kilka sposobów dostępu do DeepSeek V4:

- Interfejs webowy: Oba modele można od razu wypróbować na chat.deepseek.com w trybie Instant lub Expert.

- Dostęp przez API: API jest dostępne już dziś. Programiści muszą jedynie ustawić parametr modelu na

deepseek-v4-prolubdeepseek-v4-flash. API zachowuje zgodność zarówno z formatem OpenAI ChatCompletions, jak i Anthropic. (Uwaga: przestarzałe modeledeepseek-chatideepseek-reasonerzostaną wycofane 24 lipca 2026 r.). - Otwarte wagi: Oba modele są wydane na licencji MIT. Wagi można pobrać bezpośrednio z Hugging Face lub ModelScope. Pro to pobranie o rozmiarze 865 GB, natomiast Flash jest znacznie bardziej poręczny — 160 GB.

DeepSeek V4 na tle konkurencji

W ostatnim tygodniu ukazały się modele GPT-5.5 od OpenAI i Claude Opus 4.7 od Anthropic. Choć modele te oferują najwyższy poziom możliwości — zwłaszcza w zakresie rozumowania w długim kontekście i agentowego kodowania — DeepSeek V4 mocno konkuruje pod względem wartości i otwartej dostępności.

Oto jak DeepSeek-V4-Pro wypada na tle nowych flagowców OpenAI i Anthropic:

|

Funkcja/Benchmark |

DeepSeek V4 Pro |

GPT-5.5 |

Claude Opus 4.7 |

|

Ceny API (wejście/wyjście za 1M) |

$1,74 / $3,48 |

$5,00 / $30,00 |

$5,00 / $25,00 |

|

Okno kontekstu |

1M tokenów |

~1M tokenów |

~1M tokenów |

|

SWE-bench Pro (kodowanie) |

55,4% |

58,6% |

64,3% |

|

Terminal-Bench 2.0 (agentowe) |

67,9% |

82,7% |

69,4% |

|

Otwarte wagi |

Tak (licencja MIT) |

Nie (zamknięty) |

Nie (zamknięty) |

Uwaga: dla użytkowników stawiających na budżet, DeepSeek V4 Flash kosztuje jedynie $0,14 za 1M tokenów wejściowych i $0,28 za 1M tokenów wyjściowych, przebijając cenowo nawet małe modele, takie jak GPT-5.4 Nano.

Jak dobry jest DeepSeek V4?

DeepSeek V4 to niezwykle wywrotowe wydanie. Według samoopisowych benchmarków DeepSeek, model Pro pozostaje w tyle za najnowocześniejszymi modelami czołowymi (takimi jak GPT-5.4 i Gemini-3.1-Pro) tylko o 3–6 miesięcy w trajektorii rozwoju.

Jednak w szerszym kontekście branży surowa wydajność to tylko połowa historii. Najważniejszą wiadomością o DeepSeek V4 jest jego wyjątkowo wysoka efektywność w długim kontekście i bardzo niska cena.

Dostarczając możliwości bliskie czołówce — w tym okno kontekstu 1M tokenów — za ułamek kosztów GPT-5.5 czy Opus 4.7, DeepSeek V4 staje się najciekawszą opcją dla zadań korporacyjnych o dużej skali, badaczy open-source i deweloperów wrażliwych na koszty.

Zastosowania DeepSeek V4

Mając te atuty na uwadze, oto kilka obszarów, w których V4 szczególnie się wyróżnia:

- Automatyczne inżynieria oprogramowania: Mocne wyniki w zadaniach agentowych i integracja z narzędziami takimi jak OpenClaw czynią V4-Pro solidnym kandydatem do autonomicznego refaktoryzowania baz kodu i debugowania.

- Przetwarzanie dokumentów na dużą skalę: Obniżone koszty obliczeń w kontekście 1M tokenów sprawiają, że analitycy finansowi i działy prawne mogą za grosze przetwarzać góry plików PDF, formularzy 10-K i umów.

- Lokalne wdrożenia i badania: Dzięki licencji MIT badacze mogą przeprowadzać kwantyzację (zwłaszcza w modelu Flash o rozmiarze 160 GB), aby eksperymentować z AI na poziomie czołówki lokalnie na wysokiej klasy sprzęcie konsumenckim.

Wnioski końcowe

DeepSeek V4 to ogromny krok naprzód dla społeczności open-source AI. Choć GPT-5.5 i Claude Opus 4.7 mogą minimalnie wyprzedzać go w najtrudniejszych benchmarkach kodowania i rozumowania, DeepSeek V4 demokratyzuje dostęp do okien kontekstu liczących 1 milion tokenów oraz złożonych przepływów agentowych.

Jeśli chce Pan/Pani wyprzedzać trendy i nauczyć się wdrażać te najnowocześniejsze modele we własnych procesach, warto zajrzeć do naszych materiałów. W szczególności do kursu Understanding Prompt Engineering, aby udoskonalić sposób komunikacji z modelami takimi jak DeepSeek, lub do ścieżki umiejętności AI Agent Fundamentals, jeśli chce Pan/Pani zacząć budować skalowalne systemy agentowe.

Najczęstsze pytania o DeepSeek V4

Czy DeepSeek V4 jest open-source?

Tak. Zarówno DeepSeek-V4-Pro, jak i DeepSeek-V4-Flash to modele z otwartymi wagami, wydane na bardzo liberalnej licencji MIT. Pozwala ona programistom i badaczom na komercyjne użycie, modyfikację i wdrażanie modeli.

Jakie jest okno kontekstu w DeepSeek V4?

Zarówno model Pro, jak i Flash mają domyślne okno kontekstu liczące 1 milion tokenów. Dzięki nowej hybrydowej architekturze uwagi DeepSeek V4 obsługuje ten ogromny kontekst przy ułamku kosztów obliczeniowych i pamięciowych starszych modeli.

Ile kosztuje API DeepSeek V4?

Cennik jest bardzo konkurencyjny. DeepSeek-V4-Flash kosztuje jedynie $0,14 za 1M tokenów wejściowych i $0,28 za 1M tokenów wyjściowych. DeepSeek-V4-Pro kosztuje $1,74 za 1M tokenów wejściowych i $3,48 za 1M tokenów wyjściowych.

Jak duże są modele DeepSeek V4?

DeepSeek wykorzystuje architekturę Mixture of Experts (MoE). Model Pro zawiera łącznie 1,6 biliona parametrów (49 miliardów aktywnych) i wymaga pobrania 865 GB. Model Flash zawiera 284 miliardy parametrów (13 miliardów aktywnych) i wymaga pobrania 160 GB.

Czy DeepSeek V4 pokonuje GPT-5.5 i Claude Opus 4.7?

Jeśli chodzi o czyste możliwości — nie. Dane podawane przez DeepSeek sugerują, że model V4-Pro pozostaje w tyle za najnowocześniejszymi modelami zamkniętymi o około 3–6 miesięcy w najtrudniejszych benchmarkach kodowania i rozumowania. Dostarcza jednak możliwości bliskie czołówce przy około jednej trzeciej kosztów API, co jest wysoce wywrotowe.