Programma

Dopo mesi di indiscrezioni e sulla scia dei nuovi GPT-5.5 e Claude Opus 4.7, DeepSeek ha finalmente rilasciato DeepSeek V4. Il lancio arriva sotto forma di due modelli in anteprima, V4-Pro e V4-Flash, che arrivano sul mercato con prezzi aggressivi e prestazioni quasi da frontiera.

DeepSeek V4-Pro vanta 1,6 trilioni di parametri totali con una finestra di contesto di 1 milione di token di default. DeepSeek afferma che è indietro rispetto ai modelli chiusi allo stato dell'arte solo di 3-6 mesi, pur costando una frazione del prezzo di concorrenti come OpenAI e Anthropic.

In questo articolo, tratterò il rilascio di DeepSeek V4, analizzando le sue funzionalità chiave, le prestazioni nei benchmark e come si confronta con la concorrenza. Puoi anche consultare le nostre guide a GPT-5.5 e Claude Opus 4.7. Per un confronto dettagliato, leggi i nostri articoli su DeepSeek V4 vs GPT-5.5, Claude Opus 4.7 vs DeepSeek V4 e DeepSeek V4 Flash vs GPT-5.4 mini e nano.

DeepSeek V4 in breve

- V4 è disponibile in due versioni: Pro (1,6T parametri) e Flash (284B parametri).

- Entrambi i modelli offrono una finestra di contesto di default da 1 milione di token.

- Pro costa $1,74 in input / $3,48 in output per milione di token, con prezzi molto inferiori a GPT-5.5 e Opus 4.7.

- Disponibile via API, interfaccia web e pesi aperti (Licenza MIT).

Che cos'è DeepSeek V4?

DeepSeek V4 è la nuova e molto attesa serie di modelli linguistici di grandi dimensioni a pesi aperti del laboratorio di IA cinese DeepSeek. Rilasciata il 24 aprile 2026, la serie V4 arriva in due versioni: DeepSeek-V4-Pro e DeepSeek-V4-Flash. Entrambi i modelli utilizzano un'architettura Mixture of Experts (MoE) e offrono una finestra di contesto enorme da 1 milione di token di default.

Ciò che rende DeepSeek V4 un rilascio importante per il settore è la combinazione di prestazioni quasi da frontiera e prezzi super competitivi. Il modello V4-Pro vanta 1,6 trilioni di parametri totali (49 miliardi attivi), rendendolo il più grande modello a pesi aperti attualmente disponibile.

Nonostante le dimensioni, DeepSeek afferma che è indietro rispetto ai modelli chiusi allo stato dell'arte solo di 3-6 mesi, pur costando una frazione del prezzo di concorrenti come OpenAI e Anthropic.

Funzionalità chiave di DeepSeek V4

Vediamo alcune delle caratteristiche più rilevanti dell'ultimo rilascio:

Innovazione strutturale ed efficienza del contesto da 1M

La caratteristica distintiva di DeepSeek V4 è la gestione altamente efficiente del contesto lungo.

Secondo le note tecniche, la serie V4 utilizza una Hybrid Attention Architecture che combina Compressed Sparse Attention (CSA) e Heavily Compressed Attention (HCA).

Grazie a questi cambiamenti strutturali, un contesto da 1 milione di token è ora lo standard su tutti i servizi DeepSeek.

DeepSeek afferma che, in uno scenario da 1M token di contesto, DeepSeek-V4-Pro richiede solo il 27% dei FLOPs di inferenza a token singolo e appena il 10% della cache KV rispetto al suo predecessore, DeepSeek-V3.2.

Tre modalità di ragionamento

Per offrire un controllo granulare su latenza e prestazioni, DeepSeek V4 include tre modalità di ragionamento:

- Non-think: Risposte rapide e intuitive per attività quotidiane e decisioni a basso rischio.

- Think High: Analisi logica consapevole, più lenta ma molto accurata per la risoluzione di problemi complessi.

- Think Max: Spinge le capacità di ragionamento al massimo per esplorare il limite delle possibilità del modello.

Capacità agentiche avanzate

DeepSeek V4 è apparentemente ottimizzato per l'agentic coding. Le note di rilascio affermano che si integra perfettamente con agenti IA leader come Claude Code, OpenClaw e OpenCode, ed è già alla base dell'infrastruttura interna di DeepSeek per l'agentic coding.

Ottimizzazioni avanzate dell'addestramento

Sotto il cofano, DeepSeek ha introdotto le Manifold-Constrained Hyper-Connections (mHC) per rafforzare le connessioni residue e stabilizzare la propagazione del segnale. Hanno anche adottato il Muon Optimizer per una convergenza più rapida e una maggiore stabilità in addestramento, pre-addestrando i modelli su oltre 32 trilioni di token eterogenei.

Benchmark di DeepSeek V4

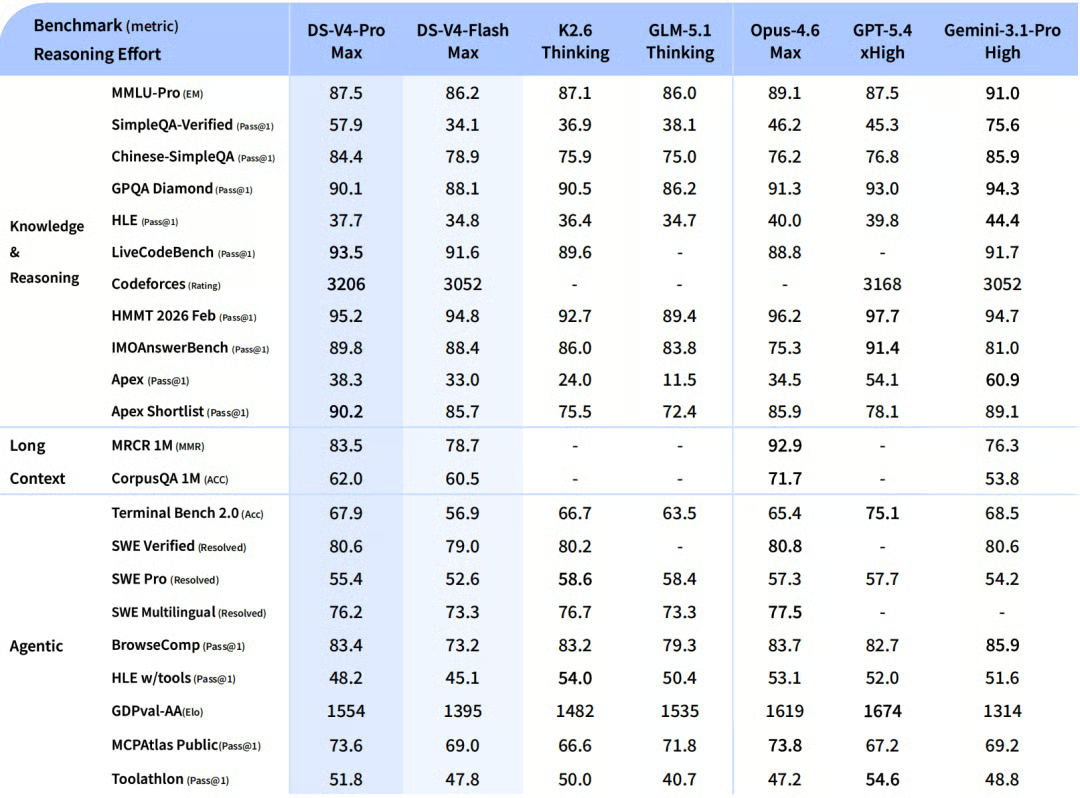

Secondo i risultati interni di DeepSeek, DeepSeek V4 mostra prestazioni notevoli, in particolare quando spinto ai suoi limiti massimi di ragionamento (DeepSeek-V4-Pro-Max).

Secondo le note ufficiali di rilascio, ecco come il modello si posiziona rispetto al panorama più ampio del settore:

Conoscenza e ragionamento

Pro-Max supera facilmente altri modelli open-source e batte modelli d'avanguardia meno recenti come GPT-5.2. Ottiene un 87,5% su MMLU-Pro e 90,1% su GPQA Diamond, insieme a un notevole 92,6% su GSM8K per la matematica. Pur restando ancora indietro di qualche mese rispetto al taglio più avanzato (GPT-5.4 e Gemini-3.1-Pro), ha ridotto significativamente il divario di conoscenza.

Attività agentiche

Pro-Max è in linea con i principali modelli aperti, raggiungendo il 67,9% su Terminal Bench 2.0 e il 55,4% su SWE-Bench Pro. Sebbene sia leggermente inferiore ai modelli chiusi più recenti nelle classifiche pubbliche, i test interni mostrano che supera Claude Sonnet 4.5 e si avvicina ai livelli di Opus 4.5.

Contesto lungo

La finestra da 1 milione di token non è solo sulla carta. Pro-Max offre risultati estremamente solidi qui, con un punteggio dell'83,5% nei test MRCR 1M (MMR) di needle-in-a-haystack. Questo in realtà supera Gemini-3.1-Pro nei benchmark accademici di contesto lungo.

DeepSeek V4 Pro vs Flash

Per via delle dimensioni inferiori, Flash-Max ottiene naturalmente punteggi più bassi sulla pura conoscenza e fatica con i workflow agentici più complessi. Tuttavia, se gli concedi un maggiore "budget di pensiero", raggiunge punteggi di ragionamento paragonabili ai modelli d'avanguardia meno recenti, rendendolo un'opzione estremamente conveniente per carichi di lavoro pesanti.

Come posso accedere a DeepSeek V4?

Ci sono diversi modi per accedere a DeepSeek V4 già da ora:

- Interfaccia web: Puoi provare entrambi i modelli subito su chat.deepseek.com tramite Instant Mode o Expert Mode.

- Accesso API: L'API è disponibile oggi. Gli sviluppatori devono solo aggiornare il parametro del modello a

deepseek-v4-proodeepseek-v4-flash. L'API mantiene la compatibilità con i formati OpenAI ChatCompletions e Anthropic API. (Nota: i modelli legacydeepseek-chatedeepseek-reasonersaranno dismessi il 24 luglio 2026). - Pesi aperti: Entrambi i modelli sono rilasciati sotto licenza MIT. Puoi scaricare i pesi direttamente da Hugging Face o ModelScope. Pro richiede un download da 865GB, mentre Flash è molto più gestibile, da 160GB.

DeepSeek V4 vs concorrenti

Nell'ultima settimana abbiamo visto il rilascio di GPT-5.5 di OpenAI e Claude Opus 4.7 di Anthropic. Sebbene questi modelli vantino capacità di primo livello, soprattutto nel ragionamento a contesto lungo e nell'agentic coding, DeepSeek V4 compete fortemente in termini di valore e accessibilità aperta.

Ecco come DeepSeek-V4-Pro si confronta con i nuovi modelli di punta di OpenAI e Anthropic:

|

Funzionalità/Benchmark |

DeepSeek V4 Pro |

GPT-5.5 |

Claude Opus 4.7 |

|

Prezzi API (Input / Output per 1M) |

$1,74 / $3,48 |

$5,00 / $30,00 |

$5,00 / $25,00 |

|

Finestra di contesto |

1M token |

~1M token |

~1M token |

|

SWE-bench Pro (Coding) |

55,4% |

58,6% |

64,3% |

|

Terminal-Bench 2.0 (Agentico) |

67,9% |

82,7% |

69,4% |

|

Pesi aperti |

Sì (Licenza MIT) |

No (Chiuso) |

No (Chiuso) |

Nota: Per chi dà priorità al budget, DeepSeek V4 Flash costa solo $0,14 per 1M token in input e $0,28 per 1M token in output, con prezzi inferiori persino a modelli piccoli come GPT-5.4 Nano.

Quanto è valido DeepSeek V4?

DeepSeek V4 è un rilascio estremamente dirompente. Secondo i benchmark auto-riferiti di DeepSeek, il modello Pro è indietro rispetto ai modelli di frontiera allo stato dell'arte (come GPT-5.4 e Gemini-3.1-Pro) di soli 3-6 mesi nella traiettoria di sviluppo.

Tuttavia, guardando al contesto più ampio del settore, le prestazioni pure sono solo metà della storia. Il vero titolo di DeepSeek V4 sta nella sua efficienza del contesto altissima e nei prezzi bassissimi.

Offrendo capacità quasi da frontiera, incluso un contesto da 1M token, a una frazione del costo di GPT-5.5 o Opus 4.7, DeepSeek V4 è l'opzione più convincente per attività enterprise ad alto volume, ricercatori open-source e sviluppatori attenti al budget.

Casi d'uso di DeepSeek V4

Considerando questi punti di forza, ecco alcune aree in cui vedo V4 eccellere:

- Ingegneria del software automatizzata: Solidi benchmark agentici e l'integrazione con strumenti come OpenClaw rendono V4-Pro un'ottima scelta per il refactoring e il debug autonomi delle codebase.

- Elaborazione documentale ad alto volume: I costi ridotti nel computing con contesti da 1M token consentono ad analisti finanziari e team legali di elaborare montagne di PDF, 10-K e contratti spendendo pochissimo.

- Deploy locale e ricerca: Grazie alla licenza MIT, i ricercatori possono eseguire quantizzazione (soprattutto sul modello Flash da 160GB) per sperimentare localmente con IA di livello frontier su hardware consumer di fascia alta.

Considerazioni finali

DeepSeek V4 rappresenta un enorme passo avanti per la comunità dell'IA open-source. Anche se GPT-5.5 e Claude Opus 4.7 potrebbero superarlo nei benchmark più difficili di coding e ragionamento, DeepSeek V4 democratizza l'accesso a finestre di contesto da 1 milione di token e a workflow agentici complessi.

Se vuoi stare al passo e imparare a implementare questi modelli all'avanguardia nei tuoi workflow, ti consiglio di dare un'occhiata ad alcune delle nostre risorse. In particolare, il nostro corso Understanding Prompt Engineering per affinare il modo in cui comunichi con modelli come DeepSeek, o il nostro percorso di competenze AI Agent Fundamentals, se vuoi iniziare a creare sistemi agentici scalabili.

DeepSeek V4 - Domande frequenti

DeepSeek V4 è open-source?

Sì. Sia DeepSeek-V4-Pro che DeepSeek-V4-Flash sono modelli a pesi aperti rilasciati sotto la licenza MIT, altamente permissiva. Questo consente a sviluppatori e ricercatori di utilizzare, modificare e distribuire i modelli anche a fini commerciali.

Qual è la finestra di contesto di DeepSeek V4?

Sia il modello Pro che il modello Flash offrono una finestra di contesto di default da 1 milione di token. Grazie alla nuova Hybrid Attention Architecture, DeepSeek V4 gestisce questo contesto enorme con una frazione dei costi computazionali e di memoria rispetto ai modelli più vecchi.

Quanto costa l'API di DeepSeek V4?

I prezzi sono altamente competitivi. DeepSeek-V4-Flash costa solo $0,14 per 1M token in input e $0,28 per 1M token in output. DeepSeek-V4-Pro costa $1,74 per 1M token in input e $3,48 per 1M token in output.

Quanto sono grandi i modelli DeepSeek V4?

DeepSeek utilizza un'architettura Mixture of Experts (MoE). Il modello Pro contiene 1,6 trilioni di parametri totali (49 miliardi attivi) e richiede un download da 865GB. Il modello Flash contiene 284 miliardi di parametri (13 miliardi attivi) e richiede un download da 160GB.

DeepSeek V4 supera GPT-5.5 e Claude Opus 4.7?

In termini di pura capacità, no. I dati auto-riferiti di DeepSeek suggeriscono che il modello V4-Pro è indietro rispetto ai modelli chiusi allo stato dell'arte di circa 3-6 mesi sui benchmark più difficili di coding e ragionamento. Tuttavia, offre prestazioni quasi da frontiera a circa un terzo del costo API, risultando altamente dirompente.

Senior editor nell’ambito dell’AI e dell’edtech. Impegnata a esplorare le tendenze in tema di dati e intelligenza artificiale.