Lernpfad

Nach Monaten voller Gerüchte und direkt im Fahrwasser von GPT-5.5 und Claude Opus 4.7 hat DeepSeek endlich DeepSeek V4 veröffentlicht. Der Start erfolgt mit zwei Preview-Modellen, V4-Pro und V4-Flash, die mit aggressiver Preisgestaltung und nahezu Spitzenleistung auf den Markt kommen.

DeepSeek V4-Pro bietet insgesamt 1,6 Billionen Parameter und standardmäßig ein Kontextfenster von 1 Million Tokens. Laut DeepSeek liegt das Modell nur 3 bis 6 Monate hinter den führenden Closed-Source-Modellen zurück, kostet aber nur einen Bruchteil der Angebote von OpenAI und Anthropic.

In diesem Artikel gehe ich auf das Release von DeepSeek V4 ein, zeige die wichtigsten Funktionen, die Benchmark-Ergebnisse und wie es im Vergleich zur Konkurrenz abschneidet. Sieh dir auch unsere Guides zu GPT-5.5 und Claude Opus 4.7 an. Für detaillierte Vergleiche lies unsere Artikel zu DeepSeek V4 vs GPT-5.5, Claude Opus 4.7 vs DeepSeek V4 und DeepSeek V4 Flash vs GPT-5.4 mini und nano.

DeepSeek V4 auf einen Blick

- V4 kommt in zwei Varianten: Pro (1,6T Parameter) und Flash (284B Parameter).

- Beide Modelle haben standardmäßig ein Kontextfenster mit 1 Million Tokens.

- Pro kostet $1,74 für Input / $3,48 für Output pro Million Tokens und unterbietet GPT-5.5 und Opus 4.7 deutlich.

- Verfügbar über API, Weboberfläche und offene Gewichte (MIT-Lizenz).

Was ist DeepSeek V4?

DeepSeek V4 ist die mit Spannung erwartete neue Serie von Open-Weights-Sprachmodellen des chinesischen KI-Labs DeepSeek. Veröffentlicht am 24. April 2026, erscheint die V4-Serie in zwei Versionen: DeepSeek-V4-Pro und DeepSeek-V4-Flash. Beide Modelle setzen auf eine Mixture-of-Experts (MoE)-Architektur und bieten standardmäßig ein riesiges Kontextfenster mit 1 Million Tokens.

Das Besondere an DeepSeek V4 ist die Kombination aus nahezu führender Performance und sehr wettbewerbsfähigen Preisen. Das V4-Pro-Modell verfügt über insgesamt 1,6 Billionen Parameter (49 Milliarden aktiv) und ist damit das aktuell größte Open-Weights-Modell.

Trotz der Größe liegt es laut DeepSeek nur 3 bis 6 Monate hinter den neuesten Closed-Source-Modellen zurück, kostet aber nur einen Bruchteil der Konkurrenz von OpenAI und Anthropic.

Die wichtigsten Funktionen von DeepSeek V4

Werfen wir einen Blick auf die Highlights des neuesten Releases:

Strukturelle Innovation und 1M-Kontexteffizienz

Das herausragende Merkmal von DeepSeek V4 ist der hocheffiziente Umgang mit langen Kontexten.

Den technischen Notizen zufolge nutzt die V4-Serie eine Hybrid-Attention-Architektur, die Compressed Sparse Attention (CSA) und Heavily Compressed Attention (HCA) kombiniert.

Durch diese strukturellen Änderungen ist ein Kontextfenster mit 1 Million Tokens nun Standard in allen DeepSeek-Services.

DeepSeek gibt an, dass DeepSeek-V4-Pro in 1M-Token-Kontexten nur 27% der FLOPs für Einzeltoken-Inferenz und lediglich 10% des KV-Caches im Vergleich zum Vorgänger DeepSeek-V3.2 benötigt.

Drei Reasoning-Modi

Um dir feine Kontrolle über Latenz und Leistung zu geben, bietet DeepSeek V4 drei Reasoning-Modi:

- Non-think: Schnelle, intuitive Antworten für Routinetätigkeiten und risikoarme Entscheidungen.

- Think High: Bewusste, logische Analyse, langsamer, aber sehr präzise bei komplexer Problemlösung.

- Think Max: Reizt die Reasoning-Fähigkeiten maximal aus, um die Grenzen des Modells auszuloten.

Erweiterte agentische Fähigkeiten

DeepSeek V4 ist offenbar für agentisches Coding optimiert. Den Release Notes zufolge integriert es sich nahtlos in führende KI-Agenten wie Claude Code, OpenClaw und OpenCode und treibt bereits DeepSeeks eigene agentische Coding-Infrastruktur an.

Fortgeschrittene Trainingsoptimierungen

Unter der Haube führte DeepSeek Manifold-Constrained Hyper-Connections (mHC) ein, um Residualverbindungen zu stärken und die Signalweitergabe zu stabilisieren. Außerdem wechselte das Team zum Muon Optimizer für schnellere Konvergenz und höhere Trainingsstabilität und prä-trainierte die Modelle auf über 32 Billionen vielfältigen Tokens.

DeepSeek V4 Benchmarks

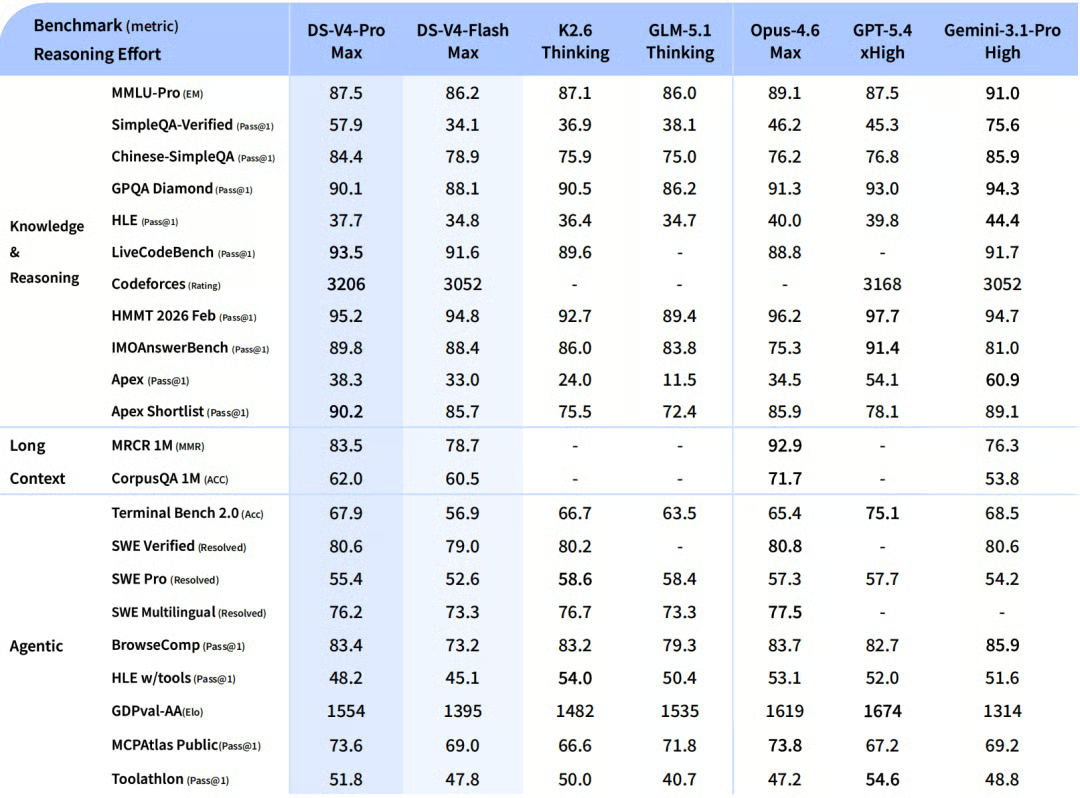

Laut DeepSeeks internen Ergebnissen zeigt DeepSeek V4 beeindruckende Leistung, besonders wenn es bis an seine Reasoning-Grenzen hochgefahren wird (DeepSeek-V4-Pro-Max).

Den offiziellen Release Notes zufolge schneidet das Modell so im Branchenvergleich ab:

Wissen und Reasoning

Pro-Max übertrifft mühelos andere Open-Source-Modelle und schlägt ältere Spitzenmodelle wie GPT-5.2. Es erreicht starke 87,5% auf MMLU-Pro und 90,1% auf GPQA Diamond sowie beeindruckende 92,6% auf GSM8K in Mathe. Zwar liegt es noch ein paar Monate hinter der absoluten Spitze (GPT-5.4 und Gemini-3.1-Pro), aber die Wissenslücke schrumpft deutlich.

Agentische Aufgaben

Pro-Max liegt auf Augenhöhe mit führenden offenen Modellen und erreicht 67,9% auf Terminal Bench 2.0 und 55,4% auf SWE-Bench Pro. Auf öffentlichen Leaderboards reicht es nicht ganz an die neuesten Closed-Source-Modelle heran, doch interne Tests zeigen, dass es Claude Sonnet 4.5 schlägt und sich Opus 4.5 annähert.

Langer Kontext

Das 1-Millionen-Token-Fenster ist nicht nur Show. Pro-Max liefert hier sehr starke Ergebnisse und erreicht 83,5% bei MRCR 1M (MMR) Needle-in-a-Haystack-Retrieval-Tests. Damit übertrifft es Gemini-3.1-Pro in akademischen Long-Context-Benchmarks.

DeepSeek V4 Pro vs Flash

Aufgrund der geringeren Größe erzielt Flash-Max naturgemäß niedrigere Wissensscores und tut sich bei sehr komplexen Agent-Workflows schwer. Gibst du ihm jedoch ein größeres „Thinking-Budget“, erreicht es Reasoning-Werte auf dem Niveau älterer Spitzenmodelle und ist damit eine äußerst kosteneffiziente Option für hohe Lasten.

Wie kann ich auf DeepSeek V4 zugreifen?

Es gibt derzeit mehrere Möglichkeiten, DeepSeek V4 zu nutzen:

- Weboberfläche: Du kannst beide Modelle sofort auf chat.deepseek.com im Instant- oder Expert-Mode ausprobieren.

- API-Zugriff: Die API ist ab sofort verfügbar. Entwickelnde müssen lediglich den Modellparameter auf

deepseek-v4-prooderdeepseek-v4-flashsetzen. Die API ist kompatibel mit den Formaten der OpenAI ChatCompletions und der Anthropic API. (Hinweis: Die Legacy-Modelledeepseek-chatunddeepseek-reasonerwerden am 24. Juli 2026 eingestellt). - Offene Gewichte: Beide Modelle werden unter der MIT-Lizenz veröffentlicht. Du kannst die Gewichte direkt von Hugging Face oder ModelScope herunterladen. Pro ist ein Download von 865 GB, Flash deutlich handlichere 160 GB.

DeepSeek V4 im Vergleich zur Konkurrenz

In der vergangenen Woche wurden OpenAIs GPT-5.5 und Anthrophics Claude Opus 4.7 veröffentlicht. Diese Modelle glänzen vor allem bei Long-Context-Reasoning und agentischem Coding. DeepSeek V4 punktet dagegen mit starkem Preis-Leistungs-Verhältnis und offener Zugänglichkeit.

So schlägt sich DeepSeek-V4-Pro im Vergleich zu den neuen Flaggschiffen von OpenAI und Anthropic:

|

Feature/Benchmark |

DeepSeek V4 Pro |

GPT-5.5 |

Claude Opus 4.7 |

|

API-Preise (Input / Output pro 1M) |

$1,74 / $3,48 |

$5,00 / $30,00 |

$5,00 / $25,00 |

|

Kontextfenster |

1M Tokens |

~1M Tokens |

~1M Tokens |

|

SWE-bench Pro (Coding) |

55,4% |

58,6% |

64,3% |

|

Terminal-Bench 2.0 (Agentisch) |

67,9% |

82,7% |

69,4% |

|

Offene Gewichte |

Ja (MIT-Lizenz) |

Nein (geschlossen) |

Nein (geschlossen) |

Hinweis: Für Nutzerinnen und Nutzer mit knappem Budget kostet DeepSeek V4 Flash nur $0,14 pro 1M Input-Tokens und $0,28 pro 1M Output-Tokens und unterbietet damit sogar kleine Modelle wie GPT-5.4 Nano.

Wie gut ist DeepSeek V4?

DeepSeek V4 ist ein extrem disruptives Release. Laut DeepSeeks eigenen Benchmarks liegt das Pro-Modell in der Entwicklungsdynamik nur 3 bis 6 Monate hinter den modernsten Spitzenmodellen (wie GPT-5.4 und Gemini-3.1-Pro).

Im größeren Branchenkontext ist reine Leistung jedoch nur die halbe Wahrheit. Die eigentliche Schlagzeile bei DeepSeek V4 sind die extrem hohe Kontexteffizienz und die sehr niedrigen Preise.

Nahezu Spitzenfähigkeiten, inklusive 1M-Token-Kontextfenster, zu einem Bruchteil der Kosten von GPT-5.5 oder Opus 4.7 machen DeepSeek V4 zur attraktivsten Option für umfangreiche Enterprise-Aufgaben, Open-Source-Forschung und kostenbewusste Entwickler.

DeepSeek V4: Anwendungsfälle

Ausgehend von diesen Stärken sehe ich V4 insbesondere in folgenden Bereichen vorne:

- Automatisierte Softwareentwicklung: Gute agentische Benchmarks und die Integration mit Tools wie OpenClaw machen V4-Pro zu einem soliden Kandidaten für autonome Code-Refaktorierung und Debugging.

- Dokumentenverarbeitung in großem Stil: Durch die geringeren Kosten im 1M-Token-Kontext können Finanzanalysten und Rechtsteams Berge an PDFs, 10-Ks und Verträgen für Cent-Beträge verarbeiten.

- Lokale Bereitstellung und Forschung: Dank MIT-Lizenz können Forschende Quantisierung durchführen (insbesondere beim 160-GB-Flash-Modell), um mit KI auf Spitzeniveau lokal auf starker Consumer-Hardware zu experimentieren.

Fazit

DeepSeek V4 ist ein gewaltiger Schritt für die Open-Source-KI-Community. Auch wenn GPT-5.5 und Claude Opus 4.7 bei den allerschwierigsten Coding- und Reasoning-Benchmarks knapp die Nase vorn haben, demokratisiert DeepSeek V4 den Zugang zu Kontextfenstern mit 1 Million Tokens und komplexen agentischen Workflows.

Wenn du die Nase vorn behalten und lernen willst, wie du diese Topmodelle in deine eigenen Workflows einbaust, empfehle ich dir unsere Ressourcen. Besonders unseren Kurs Understanding Prompt Engineering, um deine Kommunikation mit Modellen wie DeepSeek zu verfeinern, oder unseren AI Agent Fundamentals-Lernpfad, wenn du skalierbare agentische Systeme aufbauen möchtest.

DeepSeek V4 FAQs

Ist DeepSeek V4 Open Source?

Ja. Sowohl DeepSeek-V4-Pro als auch DeepSeek-V4-Flash sind Open-Weights-Modelle unter der sehr freizügigen MIT-Lizenz. Das erlaubt Entwickelnden und Forschenden, die Modelle kommerziell zu nutzen, zu verändern und bereitzustellen.

Wie groß ist das Kontextfenster von DeepSeek V4?

Beide Modelle haben standardmäßig ein Kontextfenster mit 1 Million Tokens. Dank der neuen Hybrid-Attention-Architektur verarbeitet DeepSeek V4 diesen riesigen Kontext mit nur einem Bruchteil der Rechen- und Speicherkosten älterer Modelle.

Was kostet die DeepSeek V4 API?

Die Preise sind sehr wettbewerbsfähig. DeepSeek-V4-Flash kostet nur $0,14 pro 1M Input-Tokens und $0,28 pro 1M Output-Tokens. DeepSeek-V4-Pro kostet $1,74 pro 1M Input-Tokens und $3,48 pro 1M Output-Tokens.

Wie groß sind die DeepSeek V4 Modelle?

DeepSeek setzt auf eine Mixture-of-Experts (MoE)-Architektur. Das Pro-Modell umfasst 1,6 Billionen Gesamtparameter (49 Milliarden aktiv) und erfordert einen Download von 865 GB. Das Flash-Modell umfasst 284 Milliarden Parameter (13 Milliarden aktiv) und benötigt 160 GB Download.

Schlägt DeepSeek V4 GPT-5.5 und Claude Opus 4.7?

In der reinen Leistungsfähigkeit: nein. Laut DeepSeeks eigenen Daten liegt V4-Pro bei den schwierigsten Coding- und Reasoning-Benchmarks etwa 3 bis 6 Monate hinter den neuesten Closed-Source-Modellen. Allerdings liefert es nahezu Spitzenleistung zu etwa einem Drittel der API-Kosten und ist damit hochgradig disruptiv.

Autorin und Redakteurin im Bereich der Bildungstechnologie. Engagiert bei der Erforschung von Datentrends und begeistert davon, Data Science zu lernen.