Tracks

หลังจากมีข่าวลือมาหลายเดือน และต่อเนื่องจากการเปิดตัว GPT-5.5 และ Claude Opus 4.7 ล่าสุด DeepSeek ได้ปล่อย DeepSeek V4 ออกมาแล้ว โดยมาในรูปแบบรุ่นพรีวิวสองรุ่นคือ V4-Pro และ V4-Flash เปิดตลาดด้วยราคาที่ดุเดือดและประสิทธิภาพใกล้เคียงแนวหน้า

DeepSeek V4-Pro มีจำนวนพารามิเตอร์รวม 1.6 ล้านล้าน พร้อมหน้าต่างบริบท 1 ล้านโทเค็นเป็นค่าเริ่มต้น DeepSeek ระบุว่าประสิทธิภาพตามหลังโมเดลปิดระดับแนวหน้าเพียง 3 ถึง 6 เดือน แต่มีค่าใช้จ่ายเพียงเสี้ยวหนึ่งของคู่แข่งอย่าง OpenAI และ Anthropic

ในบทความนี้ จะพูดถึงการเปิดตัว DeepSeek V4 โดยเจาะคุณสมบัติหลัก ผลการทดสอบ และการเปรียบเทียบกับคู่แข่ง นอกจากนี้ยังดูคู่มือของเราเกี่ยวกับ GPT-5.5 และ Claude Opus 4.7 ได้ด้วย หากต้องการการเปรียบเทียบเชิงลึก โปรดอ่านบทความ DeepSeek V4 เทียบกับ GPT-5.5, Claude Opus 4.7 เทียบกับ DeepSeek V4 และ DeepSeek V4 Flash เทียบกับ GPT-5.4 mini และ nano

DeepSeek V4 โดยสรุป

- V4 มีสองรุ่น: Pro (พารามิเตอร์ 1.6T) และ Flash (พารามิเตอร์ 284B)

- ทั้งสองรุ่นมีหน้าต่างบริบท 1 ล้านโทเค็นเป็นค่าเริ่มต้น

- Pro มีค่าใช้จ่าย $1.74 สำหรับอินพุต / $3.48 สำหรับเอาต์พุต ต่อ 1 ล้านโทเค็น ต่ำกว่า GPT-5.5 และ Opus 4.7 อย่างมาก

- เข้าถึงได้ผ่าน API อินเทอร์เฟซเว็บ และน้ำหนักโมเดลแบบเปิด (สัญญาอนุญาต MIT)

DeepSeek V4 คืออะไร?

DeepSeek V4 คือชุดโมเดลภาษาขนาดใหญ่แบบน้ำหนักเปิดรุ่นใหม่ที่หลายคนรอคอยจากห้องปฏิบัติการ AI ของจีน DeepSeek เปิดตัวเมื่อวันที่ 24 เมษายน 2026 ซีรีส์ V4 มีสองเวอร์ชันคือ DeepSeek-V4-Pro และ DeepSeek-V4-Flash ทั้งสองโมเดลใช้สถาปัตยกรรม Mixture of Experts (MoE) และมีหน้าต่างบริบทขนาด 1 ล้านโทเค็นเป็นค่าเริ่มต้น

สิ่งที่ทำให้ DeepSeek V4 เป็นรุ่นที่สำคัญในอุตสาหกรรม คือการผสานประสิทธิภาพระดับใกล้แนวหน้ากับราคาที่แข่งขันสูง รุ่น V4-Pro มีพารามิเตอร์รวม 1.6 ล้านล้าน (เปิดใช้งาน 49 พันล้าน) ทำให้เป็นโมเดลน้ำหนักเปิดที่ใหญ่ที่สุดในปัจจุบัน

แม้จะมีขนาดใหญ่ DeepSeek ระบุว่าตามหลังโมเดลปิดที่ล้ำสมัยเพียง 3 ถึง 6 เดือน ในขณะที่มีต้นทุนเพียงเศษเสี้ยวของคู่แข่งอย่าง OpenAI และ Anthropic

คุณสมบัติเด่นของ DeepSeek V4

มาดูจุดเด่นของรุ่นล่าสุดกัน:

นวัตกรรมเชิงโครงสร้างและประสิทธิภาพบริบท 1M

จุดเด่นของ DeepSeek V4 คือการจัดการบริบทยาวได้อย่างมีประสิทธิภาพสูง

ตามบันทึกเชิงเทคนิค ซีรีส์ V4 ใช้สถาปัตยกรรม Hybrid Attention ที่ผสาน Compressed Sparse Attention (CSA) และ Heavily Compressed Attention (HCA)

ด้วยการเปลี่ยนแปลงเชิงโครงสร้างนี้ หน้าต่างบริบท 1 ล้านโทเค็นจึงกลายเป็นมาตรฐานสำหรับบริการของ DeepSeek ทั้งหมด

DeepSeek ระบุว่า ในสถานการณ์บริบท 1M โทเค็น DeepSeek-V4-Pro ต้องการ FLOPs สำหรับอนุมานต่อโทเค็นเพียง 27% และ KV cache เพียง 10% เมื่อเทียบกับรุ่นก่อนหน้า DeepSeek-V3.2

โหมดการให้เหตุผล 3 ระดับ

เพื่อให้ควบคุมเวลาแฝงและประสิทธิภาพได้ละเอียดขึ้น DeepSeek V4 มีโหมดการให้เหตุผล 3 โหมด:

- Non-think: คำตอบรวดเร็วแบบสัญชาตญาณ เหมาะกับงานประจำและการตัดสินใจความเสี่ยงต่ำ

- Think High: การวิเคราะห์เชิงตรรกะแบบตระหนักรู้ ช้าลงแต่แม่นยำสูงสำหรับการแก้ปัญหาซับซ้อน

- Think Max: ผลักดันศักยภาพการให้เหตุผลถึงขีดสุด เพื่อสำรวจขอบเขตความสามารถของโมเดล

ความสามารถเชิงเอเจนต์ที่พัฒนาขึ้น

DeepSeek V4 ดูเหมือนจะถูกปรับแต่งสำหรับการโค้ดแบบเอเจนต์ หมายเหตุการเปิดตัวระบุว่ารวมเข้ากับเอเจนต์ AI ชั้นนำอย่าง Claude Code, OpenClaw และ OpenCode ได้อย่างไร้รอยต่อ และกำลังขับเคลื่อนโครงสร้างพื้นฐานการโค้ดเชิงเอเจนต์ภายในของ DeepSeek อยู่แล้ว

การปรับแต่งการฝึกขั้นสูง

ภายในเบื้องหลัง DeepSeek ได้แนะนำ Manifold-Constrained Hyper-Connections (mHC) เพื่อเสริมความแข็งแรงของ residual connections และทำให้การส่งสัญญาณเสถียรขึ้น อีกทั้งเปลี่ยนไปใช้ตัวปรับเหมาะ Muon เพื่อให้ลู่เข้าเร็วขึ้นและการฝึกมีเสถียรภาพมากขึ้น โดยพรีเทรนโมเดลด้วยโทเค็นที่หลากหลายกว่า 32 ล้านล้านโทเค็น

ผลการทดสอบของ DeepSeek V4

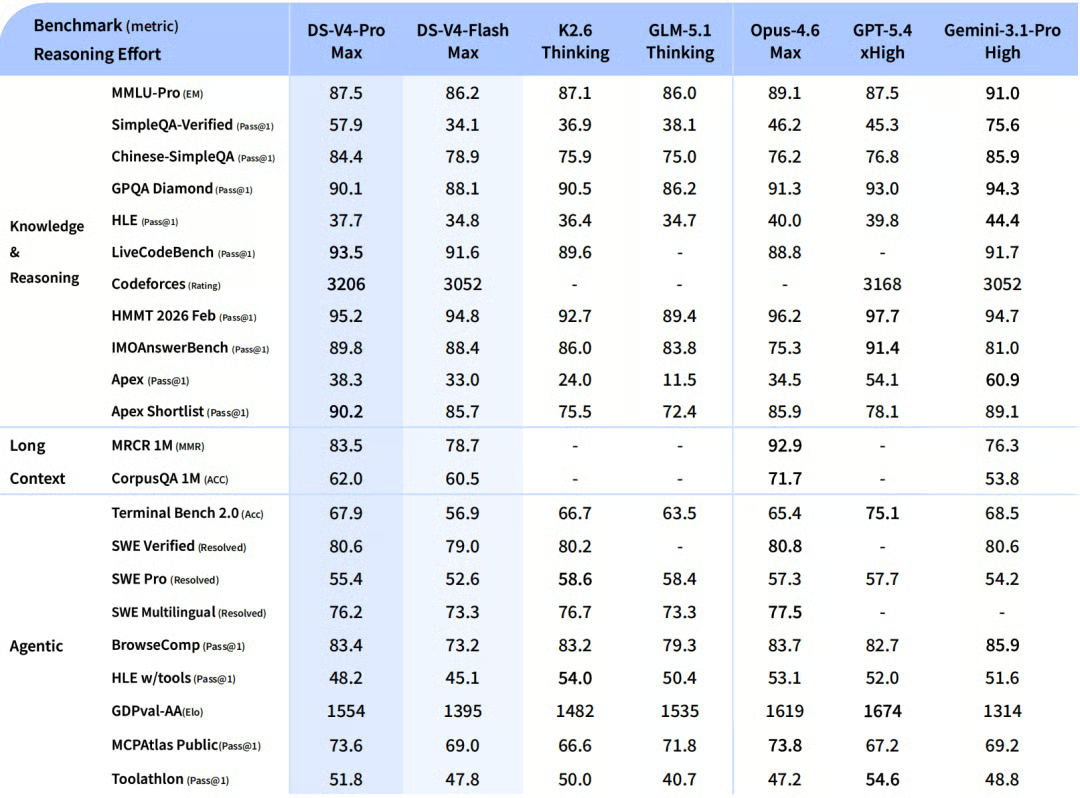

ตามผลภายในของ DeepSeek นั้น DeepSeek V4 แสดงประสิทธิภาพที่น่าประทับใจ โดยเฉพาะเมื่อใช้งานในโหมดให้เหตุผลสูงสุด (DeepSeek-V4-Pro-Max)

จากหมายเหตุการเปิดตัวอย่างเป็นทางการ นี่คือภาพรวมการเปรียบเทียบกับอุตสาหกรรมโดยรวม:

ความรู้และการให้เหตุผล

รุ่น Pro-Max เหนือกว่าโมเดลโอเพ่นซอร์สอื่นๆ ได้อย่างง่ายดาย และชนะโมเดลแนวหน้าเก่าอย่าง GPT-5.2 ทำคะแนนได้ 87.5% บน MMLU-Pro และ 90.1% บน GPQA Diamond พร้อมกับคะแนนมหาศาล 92.6% บน GSM8K สำหรับคณิตศาสตร์ แม้จะยังตามหลังสุดขอบเทคโนโลยี (GPT-5.4 และ Gemini-3.1-Pro) อยู่ไม่กี่เดือน แต่ช่องว่างด้านความรู้ก็แคบลงอย่างมาก

งานเชิงเอเจนต์

Pro-Max อยู่ในระดับเดียวกับโมเดลเปิดชั้นนำ โดยทำได้ 67.9% บน Terminal Bench 2.0 และ 55.4% บน SWE-Bench Pro แม้จะด้อยกว่ารุ่นปิดล่าสุดเล็กน้อยบนกระดานจัดอันดับสาธารณะ แต่การทดสอบภายในแสดงให้เห็นว่าสามารถชนะ Claude Sonnet 4.5 และเข้าใกล้ระดับ Opus 4.5

บริบทยาว

หน้าต่าง 1 ล้านโทเค็นไม่ได้มีไว้เพื่อโชว์เท่านั้น Pro-Max ทำผลงานได้แข็งแกร่งมาก โดยได้ 83.5% บน MRCR 1M (MMR) สำหรับการดึงข้อมูลแบบเข็มในกองฟาง ซึ่งจริงๆ แล้วแซงหน้า Gemini-3.1-Pro บนเกณฑ์วัดบริบทยาวเชิงวิชาการ

DeepSeek V4 Pro เทียบกับ Flash

ด้วยขนาดที่เล็กกว่า Flash-Max จึงทำคะแนนด้านความรู้ล้วนๆ ได้ต่ำกว่าโดยธรรมชาติ และลำบากกับเวิร์กโฟลว์เอเจนต์ที่ซับซ้อนที่สุด อย่างไรก็ตาม หากเพิ่ม "งบคิด" ให้มากขึ้น ก็ทำคะแนนการให้เหตุผลได้ใกล้เคียงโมเดลแนวหน้าเก่ากว่า ทำให้เป็นตัวเลือกคุ้มค่ามากสำหรับงานปริมาณมาก

จะเข้าถึง DeepSeek V4 ได้อย่างไร?

ขณะนี้มีหลายวิธีในการเข้าถึง DeepSeek V4:

- อินเทอร์เฟซเว็บ: ทดลองใช้ทั้งสองโมเดลได้ทันทีที่ chat.deepseek.com ผ่านโหมด Instant หรือโหมด Expert

- การเข้าถึง API: API พร้อมใช้งานแล้ววันนี้ นักพัฒนาเพียงอัปเดตพารามิเตอร์โมเดลเป็น

deepseek-v4-proหรือdeepseek-v4-flashAPI รองรับรูปแบบทั้ง OpenAI ChatCompletions และ Anthropic (หมายเหตุ: โมเดลเดิมdeepseek-chatและdeepseek-reasonerจะยุติให้บริการในวันที่ 24 กรกฎาคม 2026) - น้ำหนักโมเดลแบบเปิด: ทั้งสองโมเดลเผยแพร่ภายใต้สัญญาอนุญาต MIT สามารถดาวน์โหลดน้ำหนักได้โดยตรงจาก Hugging Face หรือ ModelScope รุ่น Pro ต้องดาวน์โหลด 865GB ส่วน Flash จัดการได้ง่ายกว่าที่ 160GB

DeepSeek V4 เทียบกับคู่แข่ง

ตลอดสัปดาห์ที่ผ่านมา มีการเปิดตัว GPT-5.5 ของ OpenAI และ Claude Opus 4.7 ของ Anthropic แม้โมเดลเหล่านั้นจะโดดเด่นด้านศักยภาพ โดยเฉพาะการให้เหตุผลบริบทยาวและการโค้ดเชิงเอเจนต์ แต่ DeepSeek V4 แข่งขันหนักในด้านความคุ้มค่าและความเปิดกว้างในการเข้าถึง

นี่คือการเปรียบเทียบระหว่าง DeepSeek-V4-Pro กับรุ่นเรือธงใหม่จาก OpenAI และ Anthropic:

|

คุณสมบัติ/เกณฑ์วัด |

DeepSeek V4 Pro |

GPT-5.5 |

Claude Opus 4.7 |

|

ราคา API (อินพุต / เอาต์พุต ต่อ 1M) |

$1.74 / $3.48 |

$5.00 / $30.00 |

$5.00 / $25.00 |

|

หน้าต่างบริบท |

1M โทเค็น |

~1M โทเค็น |

~1M โทเค็น |

|

SWE-bench Pro (การโค้ด) |

55.4% |

58.6% |

64.3% |

|

Terminal-Bench 2.0 (เชิงเอเจนต์) |

67.9% |

82.7% |

69.4% |

|

น้ำหนักโมเดลแบบเปิด |

มี (สัญญาอนุญาต MIT) |

ไม่มี (ปิด) |

ไม่มี (ปิด) |

หมายเหตุ: สำหรับผู้ใช้ที่ให้ความสำคัญกับงบประมาณ DeepSeek V4 Flash มีค่าใช้จ่ายเพียง $0.14 ต่อ 1M โทเค็นอินพุต และ $0.28 ต่อ 1M โทเค็นเอาต์พุต ต่ำกว่ากระทั่งโมเดลขนาดเล็กอย่าง GPT-5.4 Nano

DeepSeek V4 ดีแค่ไหน?

DeepSeek V4 คือการเปิดตัวที่พลิกวงการ ตามผลทดสอบที่ DeepSeek รายงานเอง รุ่น Pro ตามหลังโมเดลแนวหน้าล่าสุด (เช่น GPT-5.4 และ Gemini-3.1-Pro) เพียงประมาณ 3 ถึง 6 เดือนในเส้นทางการพัฒนา

อย่างไรก็ตาม เมื่อมองภาพรวมของอุตสาหกรรม สมรรถนะดิบเป็นเพียงครึ่งเรื่อง ไฮไลต์ของ DeepSeek V4 อยู่ที่ประสิทธิภาพบริบทสูงมากและราคาที่ต่ำเป็นพิเศษ

การมอบความสามารถใกล้ระดับแนวหน้า รวมถึงหน้าต่างบริบท 1M โทเค็น ที่มีต้นทุนเพียงเสี้ยวของ GPT-5.5 หรือ Opus 4.7 ทำให้ DeepSeek V4 เป็นตัวเลือกที่น่าสนใจที่สุดสำหรับงานระดับองค์กรปริมาณมาก นักวิจัยโอเพ่นซอร์ส และนักพัฒนาที่คำนึงถึงงบประมาณ

กรณีการใช้งาน DeepSeek V4

เมื่อคำนึงถึงจุดแข็งเหล่านี้ ต่อไปนี้คือบางด้านที่ V4 น่าจะทำได้ดี:

- วิศวกรรมซอฟต์แวร์อัตโนมัติ: คะแนนเชิงเอเจนต์ที่แข็งแกร่งและการผสานกับเครื่องมืออย่าง OpenClaw ทำให้ V4-Pro เป็นตัวเลือกที่ดีสำหรับการปรับโครงสร้างโค้ดเบสอัตโนมัติและการดีบัก

- ประมวลผลเอกสารปริมาณมาก: ต้นทุนที่ลดลงในการคำนวณบริบท 1M โทเค็น หมายความว่านักวิเคราะห์การเงินและทีมกฎหมายสามารถประมวลผล PDF รายงาน 10-K และสัญญาจำนวนมากได้ในต้นทุนต่ำมาก

- การปรับใช้ภายในเครื่องและงานวิจัย: ด้วยสัญญาอนุญาตแบบ MIT นักวิจัยสามารถทำการควอนไทซ์ (โดยเฉพาะบนรุ่น Flash ขนาด 160GB) เพื่อทดลอง AI ระดับแนวหน้าในเครื่องบนฮาร์ดแวร์ผู้ใช้ระดับสูงได้

ข้อสรุป

DeepSeek V4 เป็นก้าวกระโดดครั้งใหญ่สำหรับชุมชน AI สายโอเพ่นซอร์ส แม้ GPT-5.5 และ Claude Opus 4.7 อาจยังได้เปรียบบางด้านในเกณฑ์การโค้ดและการให้เหตุผลที่ยากที่สุด แต่ DeepSeek V4 ได้ทำให้การเข้าถึงหน้าต่างบริบท 1 ล้านโทเค็นและเวิร์กโฟลว์เชิงเอเจนต์ที่ซับซ้อนเป็นประชาธิปไตยมากขึ้น

หากต้องการก้าวให้นำหน้า และเรียนรู้วิธีนำโมเดลล้ำสมัยเหล่านี้ไปใช้ในเวิร์กโฟลว์ของตนเอง ขอแนะนำให้ดูทรัพยากรของเรา โดยเฉพาะคอร์ส Understanding Prompt Engineering เพื่อปรับวิธีการสื่อสารกับโมเดลอย่าง DeepSeek หรือ เส้นทางทักษะ AI Agent Fundamentals หากต้องการเริ่มสร้างระบบเอเจนต์ที่ปรับขยายได้

DeepSeek V4 คำถามที่พบบ่อย

DeepSeek V4 เป็นโอเพ่นซอร์สหรือไม่?

ใช่ ทั้ง DeepSeek-V4-Pro และ DeepSeek-V4-Flash เป็นโมเดลแบบน้ำหนักเปิดที่เผยแพร่ภายใต้สัญญาอนุญาต MIT ซึ่งเปิดกว้างมาก นักพัฒนาและนักวิจัยสามารถใช้งาน แก้ไข และปรับใช้เชิงพาณิชย์ได้

หน้าต่างบริบทของ DeepSeek V4 คือเท่าไร?

ทั้งรุ่น Pro และ Flash มีหน้าต่างบริบท 1 ล้านโทเค็นเป็นค่าเริ่มต้น ด้วยสถาปัตยกรรม Hybrid Attention แบบใหม่ DeepSeek V4 จัดการบริบทขนาดใหญ่นี้ได้ด้วยต้นทุนการคำนวณและหน่วยความจำเพียงเศษเสี้ยวเมื่อเทียบกับรุ่นก่อน

ค่าใช้จ่ายของ DeepSeek V4 API เท่าไร?

ราคามีความสามารถในการแข่งขันสูง DeepSeek-V4-Flash มีค่าใช้จ่ายเพียง $0.14 ต่อ 1M โทเค็นอินพุต และ $0.28 ต่อ 1M โทเค็นเอาต์พุต ส่วน DeepSeek-V4-Pro อยู่ที่ $1.74 ต่อ 1M โทเค็นอินพุต และ $3.48 ต่อ 1M โทเค็นเอาต์พุต

ขนาดของโมเดล DeepSeek V4 เป็นเท่าไร?

DeepSeek ใช้สถาปัตยกรรม Mixture of Experts (MoE) รุ่น Pro มีพารามิเตอร์รวม 1.6 ล้านล้าน (เปิดใช้งาน 49 พันล้าน) และต้องดาวน์โหลด 865GB รุ่น Flash มีพารามิเตอร์ 284 พันล้าน (เปิดใช้งาน 13 พันล้าน) และต้องดาวน์โหลด 160GB

DeepSeek V4 เหนือกว่า GPT-5.5 และ Claude Opus 4.7 หรือไม่?

หากพูดถึงความสามารถดิบๆ ยังไม่ใช่ โมเดล V4-Pro ตามข้อมูลที่ DeepSeek รายงานเอง ตามหลังโมเดลปิดระดับแนวหน้าประมาณ 3 ถึง 6 เดือนในเกณฑ์การโค้ดและการให้เหตุผลที่ยากที่สุด อย่างไรก็ตาม มอบประสิทธิภาพใกล้ระดับแนวหน้าที่มีค่าใช้จ่าย API ราวหนึ่งในสาม จึงสร้างแรงสั่นสะเทือนอย่างมาก