Tracks

Sau nhiều tháng đồn đoán và ngay sau khi GPT-5.5 cùng Claude Opus 4.7 ra mắt, DeepSeek cuối cùng cũng đã phát hành DeepSeek V4. Bản phát hành gồm hai mô hình xem trước, V4-Pro và V4-Flash, gia nhập thị trường với mức giá cạnh tranh mạnh và hiệu năng tiệm cận nhóm dẫn đầu.

DeepSeek V4-Pro có tổng 1,6 nghìn tỷ tham số với cửa sổ ngữ cảnh mặc định 1 triệu token. DeepSeek cho biết mô hình này chỉ chậm hơn các mô hình đóng tiên tiến nhất từ 3 đến 6 tháng, trong khi chi phí chỉ bằng một phần nhỏ so với các đối thủ như OpenAI và Anthropic.

Trong bài viết này, tôi sẽ điểm lại bản phát hành DeepSeek V4, xem các tính năng chính, hiệu năng điểm chuẩn và so sánh với đối thủ. Bạn cũng có thể xem hướng dẫn về GPT-5.5 và Claude Opus 4.7. Để có so sánh chi tiết, hãy đọc các bài viết DeepSeek V4 vs GPT-5.5, Claude Opus 4.7 vs DeepSeek V4 và DeepSeek V4 Flash vs GPT-5.4 mini and nano.

Tóm tắt DeepSeek V4

- V4 có hai phiên bản: Pro (1,6T tham số) và Flash (284B tham số).

- Cả hai mô hình đều có cửa sổ ngữ cảnh mặc định 1 triệu token.

- Pro có giá $1,74 đầu vào / $3,48 đầu ra trên mỗi triệu token, rẻ hơn đáng kể so với GPT-5.5 và Opus 4.7.

- Cung cấp qua API, giao diện web và trọng số mở (Giấy phép MIT).

DeepSeek V4 là gì?

DeepSeek V4 là dòng mô hình ngôn ngữ lớn trọng số mở mới được mong đợi từ phòng thí nghiệm AI Trung Quốc DeepSeek. Phát hành ngày 24 tháng 4 năm 2026, dòng V4 có hai phiên bản: DeepSeek-V4-Pro và DeepSeek-V4-Flash. Cả hai mô hình đều sử dụng Mixture of Experts (MoE) và cung cấp cửa sổ ngữ cảnh mặc định cực lớn 1 triệu token.

Điều khiến DeepSeek V4 trở thành một bản phát hành quan trọng là sự kết hợp giữa hiệu năng tiệm cận hàng đầu và mức giá siêu cạnh tranh. Mô hình V4-Pro có tổng 1,6 nghìn tỷ tham số (49 tỷ kích hoạt), khiến nó trở thành mô hình trọng số mở lớn nhất hiện có.

Dù có quy mô lớn, DeepSeek cho biết mô hình này chỉ chậm hơn các mô hình đóng tiên tiến nhất khoảng 3 đến 6 tháng, trong khi chi phí chỉ bằng một phần so với OpenAI và Anthropic.

Các tính năng chính của DeepSeek V4

Cùng xem một số điểm nổi bật của bản phát hành mới nhất:

Đổi mới cấu trúc và hiệu quả ngữ cảnh 1M

Điểm nổi bật của DeepSeek V4 là khả năng xử lý ngữ cảnh dài cực kỳ hiệu quả.

Theo ghi chú kỹ thuật, dòng V4 dùng Kiến trúc Attention Lai, kết hợp Compressed Sparse Attention (CSA) và Heavily Compressed Attention (HCA).

Nhờ những thay đổi cấu trúc này, ngữ cảnh 1 triệu token nay trở thành tiêu chuẩn trên tất cả dịch vụ của DeepSeek.

DeepSeek cho biết trong kịch bản ngữ cảnh 1M token, DeepSeek-V4-Pro chỉ cần 27% FLOPs suy luận một token và chỉ 10% bộ nhớ đệm KV so với phiên bản tiền nhiệm, DeepSeek-V3.2.

Ba chế độ lập luận

Để cho phép người dùng kiểm soát chi tiết độ trễ và hiệu năng, DeepSeek V4 bao gồm ba chế độ lập luận:

- Non-think: Phản hồi nhanh, trực giác cho tác vụ thường nhật và quyết định rủi ro thấp.

- Think High: Phân tích logic có ý thức, chậm hơn nhưng rất chính xác cho bài toán phức tạp.

- Think Max: Đẩy khả năng lập luận đến mức tối đa để khám phá giới hạn của mô hình.

Năng lực agent nâng cao

DeepSeek V4 có vẻ được tối ưu cho lập trình theo hướng agent. Ghi chú phát hành cho biết nó tích hợp trơn tru với các agent AI hàng đầu như Claude Code, OpenClaw và OpenCode, và đã vận hành hạ tầng lập trình agent nội bộ của DeepSeek.

Tối ưu hóa huấn luyện nâng cao

Ở tầng bên dưới, DeepSeek giới thiệu Manifold-Constrained Hyper-Connections (mHC) để tăng cường kết nối dư và ổn định truyền tín hiệu. Họ cũng chuyển sang Trình tối ưu Muon để hội tụ nhanh hơn và ổn định huấn luyện cao hơn, tiền huấn luyện mô hình trên hơn 32 nghìn tỷ token đa dạng.

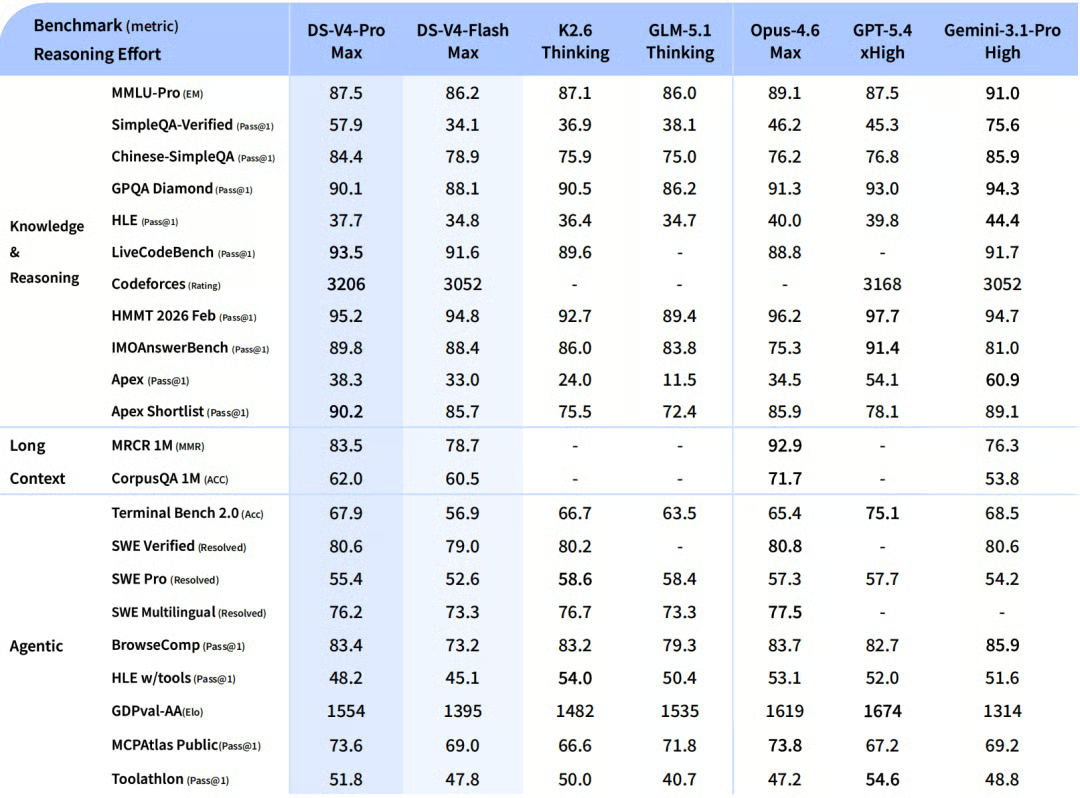

Điểm chuẩn DeepSeek V4

Theo kết quả nội bộ của DeepSeek, DeepSeek V4 cho thấy hiệu năng ấn tượng, đặc biệt khi được đẩy tới giới hạn lập luận tối đa (DeepSeek-V4-Pro-Max).

Theo ghi chú phát hành chính thức, đây là cách mô hình so kè với ngành:

Kiến thức và lập luận

Pro-Max dễ dàng vượt các mô hình mã nguồn mở khác và đánh bại những mô hình tiên phong cũ hơn như GPT-5.2. Nó đạt 87,5% trên MMLU-Pro và 90,1% trên GPQA Diamond, cùng với 92,6% trên GSM8K cho toán học. Dù vẫn tụt nhẹ so với nhóm mũi nhọn (GPT-5.4 và Gemini-3.1-Pro) vài tháng, khoảng cách kiến thức đã được thu hẹp đáng kể.

Tác vụ agent

Pro-Max ngang tầm các mô hình mở dẫn đầu, đạt 67,9% trên Terminal Bench 2.0 và 55,4% trên SWE-Bench Pro. Dù hơi kém hơn các mô hình đóng mới nhất trên bảng xếp hạng công khai, thử nghiệm nội bộ cho thấy nó vượt Claude Sonnet 4.5 và tiệm cận Opus 4.5.

Ngữ cảnh dài

Cửa sổ 1 triệu token không chỉ là con số. Pro-Max cho kết quả rất mạnh, đạt 83,5% trên bài kiểm tra truy xuất kim trong đống rơm MRCR 1M (MMR). Thực tế, điều này vượt Gemini-3.1-Pro trên các điểm chuẩn ngữ cảnh dài học thuật.

DeepSeek V4 Pro vs Flash

Do kích thước nhỏ hơn, Flash-Max tự nhiên có điểm thấp hơn về kiến thức thuần và gặp khó với quy trình agent phức tạp nhất. Tuy nhiên, nếu cấp cho nó “ngân sách suy nghĩ” lớn hơn, nó đạt điểm lập luận tương đương các mô hình tiên phong cũ, trở thành lựa chọn tiết kiệm chi phí đáng kể cho khối lượng công việc lớn.

Tôi có thể truy cập DeepSeek V4 như thế nào?

Hiện có một số cách để truy cập DeepSeek V4:

- Giao diện web: Bạn có thể thử cả hai mô hình ngay tại chat.deepseek.com qua Chế độ Nhanh hoặc Chế độ Chuyên gia.

- Truy cập API: API đã sẵn sàng. Nhà phát triển chỉ cần cập nhật tham số mô hình thành

deepseek-v4-prohoặcdeepseek-v4-flash. API vẫn tương thích với cả định dạng OpenAI ChatCompletions và Anthropic. (Lưu ý: các mô hình cũdeepseek-chatvàdeepseek-reasonersẽ ngừng hoạt động vào ngày 24/7/2026). - Trọng số mở: Cả hai mô hình phát hành theo Giấy phép MIT. Bạn có thể tải trọng số trực tiếp từ Hugging Face hoặc ModelScope. Pro dung lượng 865GB, trong khi Flash dễ quản lý hơn nhiều với 160GB.

DeepSeek V4 so với đối thủ

Tuần qua, chúng ta chứng kiến OpenAI ra mắt GPT-5.5 và Anthropic ra mắt Claude Opus 4.7. Dù các mô hình đó có năng lực hàng đầu, đặc biệt trong lập luận ngữ cảnh dài và lập trình agent, DeepSeek V4 cạnh tranh mạnh về giá trị và khả năng tiếp cận mở.

Dưới đây là so sánh DeepSeek-V4-Pro với các mô hình đầu bảng mới từ OpenAI và Anthropic:

|

Tính năng/Điểm chuẩn |

DeepSeek V4 Pro |

GPT-5.5 |

Claude Opus 4.7 |

|

Giá API (Đầu vào / Đầu ra trên 1M) |

$1,74 / $3,48 |

$5,00 / $30,00 |

$5,00 / $25,00 |

|

Cửa sổ ngữ cảnh |

1M token |

~1M token |

~1M token |

|

SWE-bench Pro (Lập trình) |

55,4% |

58,6% |

64,3% |

|

Terminal-Bench 2.0 (Agent) |

67,9% |

82,7% |

69,4% |

|

Trọng số mở |

Có (Giấy phép MIT) |

Không (Đóng) |

Không (Đóng) |

Lưu ý: Với người dùng ưu tiên ngân sách, DeepSeek V4 Flash chỉ có giá $0,14 cho mỗi 1M token đầu vào và $0,28 cho mỗi 1M token đầu ra, rẻ hơn cả các mô hình nhỏ như GPT-5.4 Nano.

DeepSeek V4 tốt đến mức nào?

DeepSeek V4 là một bản phát hành gây xáo trộn mạnh. Theo dữ liệu điểm chuẩn tự báo cáo của DeepSeek, bản Pro chỉ chậm hơn các mô hình tiên phong hàng đầu (như GPT-5.4 và Gemini-3.1-Pro) khoảng 3 đến 6 tháng trên quỹ đạo phát triển.

Tuy nhiên, xét rộng hơn trong ngành, hiệu năng thuần chỉ là một nửa câu chuyện. Tiêu đề lớn của DeepSeek V4 nằm ở hiệu quả ngữ cảnh cực cao và mức giá “chạm đáy”.

Cung cấp khả năng tiệm cận nhóm dẫn đầu, bao gồm cửa sổ ngữ cảnh 1M token, với chi phí chỉ bằng một phần so với GPT-5.5 hay Opus 4.7, khiến DeepSeek V4 trở thành lựa chọn hấp dẫn nhất cho tác vụ doanh nghiệp khối lượng lớn, nhà nghiên cứu nguồn mở và nhà phát triển tiết kiệm chi phí.

Trường hợp sử dụng DeepSeek V4

Với những điểm mạnh đó, đây là vài lĩnh vực V4 có thể vượt trội:

- Kỹ thuật phần mềm tự động hóa: Điểm chuẩn agent mạnh và tích hợp với công cụ như OpenClaw khiến V4-Pro là ứng viên vững chắc cho tái cấu trúc và gỡ lỗi mã tự động.

- Xử lý tài liệu khối lượng lớn: Chi phí giảm trong tính toán ngữ cảnh 1M token giúp nhà phân tích tài chính và đội ngũ pháp lý xử lý hàng núi PDF, 10-K và hợp đồng với chi phí rất thấp.

- Triển khai cục bộ và nghiên cứu: Nhờ giấy phép MIT, nhà nghiên cứu có thể lượng tử hóa (đặc biệt trên mẫu Flash 160GB) để thử nghiệm AI cấp tiên phong cục bộ trên phần cứng tiêu dùng cao cấp.

Kết luận

DeepSeek V4 là một bước tiến lớn cho cộng đồng AI nguồn mở. Dù GPT-5.5 và Claude Opus 4.7 có thể nhỉnh hơn ở những điểm chuẩn lập trình và lập luận khó nhất, DeepSeek V4 giúp dân chủ hóa khả năng truy cập cửa sổ ngữ cảnh 1 triệu token và quy trình agent phức tạp.

Nếu bạn muốn đón đầu xu hướng và học cách triển khai những mô hình tối tân này vào quy trình của mình, tôi khuyến nghị xem qua một số tài nguyên của chúng tôi. Đặc biệt, khóa Understanding Prompt Engineering để trau dồi cách bạn giao tiếp với các mô hình như DeepSeek, hoặc lộ trình kỹ năng AI Agent Fundamentals nếu bạn muốn bắt đầu xây dựng hệ thống agent có thể mở rộng.

Câu hỏi thường gặp về DeepSeek V4

DeepSeek V4 có phải mã nguồn mở không?

Có. Cả DeepSeek-V4-Pro và DeepSeek-V4-Flash đều là mô hình trọng số mở, phát hành theo Giấy phép MIT rất thoáng. Điều này cho phép nhà phát triển và nhà nghiên cứu sử dụng, sửa đổi và triển khai mô hình cho mục đích thương mại.

Cửa sổ ngữ cảnh của DeepSeek V4 là bao nhiêu?

Cả bản Pro và Flash đều có cửa sổ ngữ cảnh mặc định 1 triệu token. Nhờ Kiến trúc Attention Lai mới, DeepSeek V4 xử lý ngữ cảnh khổng lồ này với chi phí tính toán và bộ nhớ chỉ bằng một phần so với các mô hình cũ.

API DeepSeek V4 có giá bao nhiêu?

Mức giá rất cạnh tranh. DeepSeek-V4-Flash chỉ tốn $0,14 cho mỗi 1M token đầu vào và $0,28 cho mỗi 1M token đầu ra. DeepSeek-V4-Pro có giá $1,74 cho mỗi 1M token đầu vào và $3,48 cho mỗi 1M token đầu ra.

Kích thước mô hình DeepSeek V4 là bao nhiêu?

DeepSeek sử dụng kiến trúc Mixture of Experts (MoE). Bản Pro có tổng 1,6 nghìn tỷ tham số (49 tỷ kích hoạt) và cần tải 865GB. Bản Flash có 284 tỷ tham số (13 tỷ kích hoạt) và cần tải 160GB.

DeepSeek V4 có vượt GPT-5.5 và Claude Opus 4.7 không?

Về năng lực thuần túy thì không. Dữ liệu tự báo cáo của DeepSeek cho thấy V4-Pro chậm hơn các mô hình đóng tiên tiến khoảng 3 đến 6 tháng ở những điểm chuẩn lập trình và lập luận khó nhất. Tuy vậy, nó mang lại hiệu năng tiệm cận nhóm dẫn đầu với chi phí API chỉ khoảng một phần ba, nên rất gây xáo trộn.

Biên tập viên cấp cao trong lĩnh vực AI và công nghệ giáo dục. Cam kết khám phá các xu hướng dữ liệu và AI.