programa

Tras meses de rumores, y justo después de los nuevos GPT-5.5 y Claude Opus 4.7, DeepSeek por fin ha lanzado DeepSeek V4. El lanzamiento llega en forma de dos modelos en vista previa, V4-Pro y V4-Flash, que aterrizan con precios muy agresivos y un rendimiento cercano al de la frontera tecnológica.

DeepSeek V4-Pro presume de 1,6 billones de parámetros totales y una ventana de contexto de 1 millón de tokens por defecto. DeepSeek asegura que va solo 3 a 6 meses por detrás de los modelos cerrados más avanzados, a una fracción del precio de competidores como OpenAI y Anthropic.

En este artículo, repaso el lanzamiento de DeepSeek V4: sus funciones clave, su rendimiento en benchmarks y cómo se compara con la competencia. También puedes consultar nuestras guías de GPT-5.5 y Claude Opus 4.7. Para una comparativa detallada, lee nuestros artículos DeepSeek V4 vs GPT-5.5, Claude Opus 4.7 vs DeepSeek V4 y DeepSeek V4 Flash vs GPT-5.4 mini and nano.

DeepSeek V4 en pocas palabras

- V4 llega en dos variantes: Pro (1,6T de parámetros) y Flash (284B de parámetros).

- Ambos modelos incluyen una ventana de contexto de 1 millón de tokens por defecto.

- Pro cuesta $1,74 de entrada / $3,48 de salida por millón de tokens, muy por debajo de GPT-5.5 y Opus 4.7.

- Disponible vía API, interfaz web y pesos abiertos (licencia MIT).

¿Qué es DeepSeek V4?

DeepSeek V4 es la esperada nueva serie de modelos de lenguaje de pesos abiertos del laboratorio chino de IA DeepSeek. Publicado el 24 de abril de 2026, la serie V4 llega en dos versiones: DeepSeek-V4-Pro y DeepSeek-V4-Flash. Ambos modelos utilizan una arquitectura Mixture of Experts (MoE) y ofrecen por defecto una enorme ventana de contexto de 1 millón de tokens.

Lo que convierte a DeepSeek V4 en un lanzamiento clave para el sector es su combinación de rendimiento casi de vanguardia y precios muy competitivos. El modelo V4-Pro cuenta con 1,6 billones de parámetros totales (49.000 millones activos), lo que lo convierte en el mayor modelo de pesos abiertos disponible actualmente.

Pese a su tamaño, DeepSeek afirma que va solo 3 a 6 meses por detrás de los modelos cerrados más punteros, mientras cuesta una fracción de lo que cobran OpenAI y Anthropic.

Funciones clave de DeepSeek V4

Veamos algunas de las características más destacadas de esta versión:

Innovación estructural y eficiencia con contextos de 1M

La gran baza de DeepSeek V4 es su manejo extremadamente eficiente de contextos largos.

Según las notas técnicas, la serie V4 usa una arquitectura de atención híbrida que combina Compressed Sparse Attention (CSA) y Heavily Compressed Attention (HCA).

Gracias a estos cambios estructurales, el contexto de 1 millón de tokens es ahora el estándar en todos los servicios de DeepSeek.

DeepSeek afirma que, en un escenario de 1M de tokens de contexto, DeepSeek-V4-Pro requiere solo el 27% de los FLOPs de inferencia por token y apenas el 10% de la caché KV en comparación con su predecesor, DeepSeek-V3.2.

Tres modos de razonamiento

Para darte un control granular sobre latencia y rendimiento, DeepSeek V4 incluye tres modos de razonamiento:

- Non-think: Respuestas rápidas e intuitivas para tareas diarias y decisiones de bajo riesgo.

- Think High: Análisis lógico consciente, más lento pero muy preciso para resolver problemas complejos.

- Think Max: Lleva el razonamiento al máximo para explorar el límite de las capacidades del modelo.

Capacidades agenticas mejoradas

DeepSeek V4 está, al parecer, optimizado para programación agentica. Las notas de la versión afirman que se integra sin fricciones con agentes de IA líderes como Claude Code, OpenClaw y OpenCode, y que ya impulsa la infraestructura agentica interna de DeepSeek.

Optimizaciones avanzadas de entrenamiento

Bajo el capó, DeepSeek introdujo Manifold-Constrained Hyper-Connections (mHC) para reforzar las conexiones residuales y estabilizar la propagación de señal. También cambiaron al optimizador Muon para una convergencia más rápida y mayor estabilidad en el entrenamiento, preentrenando los modelos con más de 32 billones de tokens diversos.

Benchmarks de DeepSeek V4

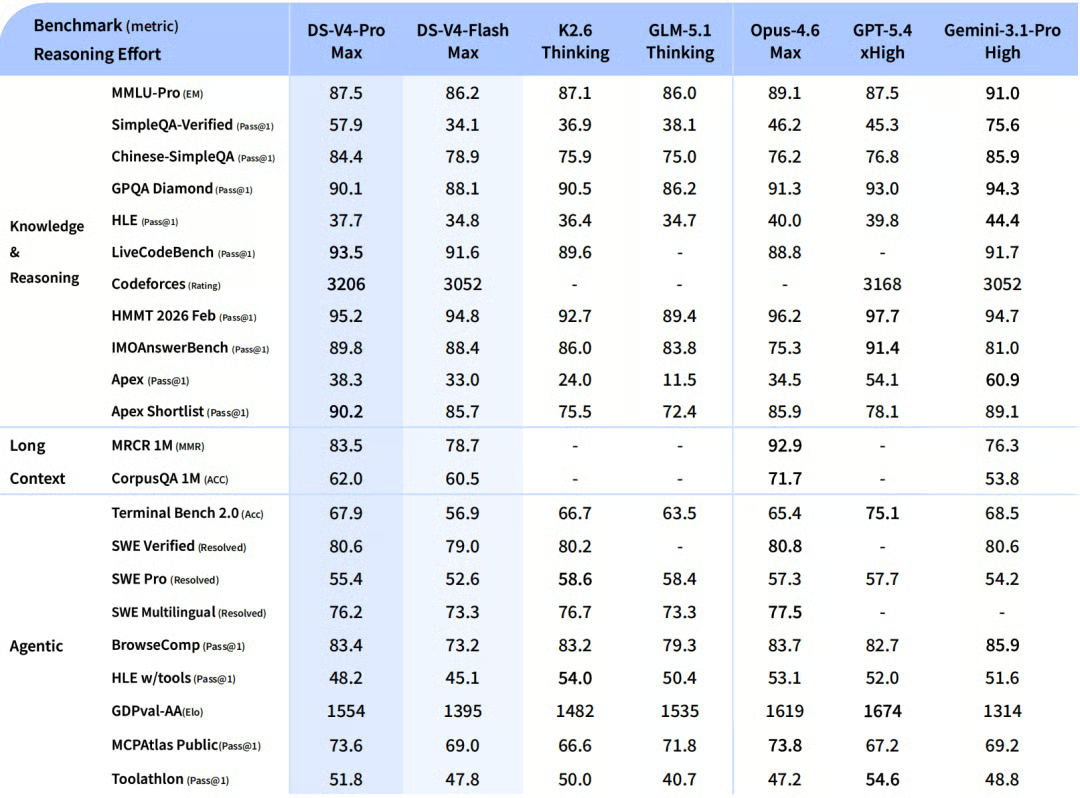

Según los resultados internos de DeepSeek, DeepSeek V4 ofrece un rendimiento muy sólido, especialmente cuando se impulsa al máximo de razonamiento (DeepSeek-V4-Pro-Max).

De acuerdo con las notas oficiales, así se posiciona el modelo frente al resto del sector:

Conocimiento y razonamiento

Pro-Max supera con facilidad a otros modelos de código abierto y bate a modelos punteros anteriores como GPT-5.2. Logra un competitivo 87,5% en MMLU-Pro y 90,1% en GPQA Diamond, junto a un notable 92,6% en GSM8K para matemáticas. Aunque aún está unos meses por detrás del filo absoluto (GPT-5.4 y Gemini-3.1-Pro), ha recortado de forma significativa la brecha de conocimiento.

Tareas agenticas

Pro-Max está a la altura de los modelos abiertos líderes, con 67,9% en Terminal Bench 2.0 y 55,4% en SWE-Bench Pro. Aunque queda un poco por debajo de los modelos cerrados más recientes en los rankings públicos, pruebas internas muestran que supera a Claude Sonnet 4.5 y se acerca a los niveles de Opus 4.5.

Contexto largo

La ventana de 1 millón de tokens no es solo marketing. Pro-Max ofrece resultados muy sólidos aquí, con 83,5% en las pruebas MRCR 1M (MMR) de búsqueda de aguja en un pajar. Esto incluso supera a Gemini-3.1-Pro en benchmarks académicos de contexto largo.

DeepSeek V4 Pro vs Flash

Por su menor tamaño, Flash-Max puntúa naturalmente más bajo en conocimiento puro y le cuesta con los flujos agenticos más complejos. Sin embargo, si le das un mayor "presupuesto de pensamiento", alcanza puntuaciones de razonamiento comparables a modelos punteros anteriores, lo que lo convierte en una opción muy rentable para cargas intensivas.

¿Cómo puedo acceder a DeepSeek V4?

Ahora mismo tienes varias formas de acceder a DeepSeek V4:

- Interfaz web: Puedes probar ambos modelos al instante en chat.deepseek.com mediante Instant Mode o Expert Mode.

- Acceso por API: La API ya está disponible. Los desarrolladores solo tienen que actualizar el parámetro del modelo a

deepseek-v4-proodeepseek-v4-flash. La API mantiene compatibilidad con los formatos de OpenAI ChatCompletions y de la API de Anthropic. (Nota: los modelos heredadosdeepseek-chatydeepseek-reasonerse retirarán el 24 de julio de 2026). - Pesos abiertos: Ambos modelos se publican bajo licencia MIT. Puedes descargar los pesos directamente desde Hugging Face o ModelScope. Pro son 865 GB de descarga, mientras que Flash es mucho más manejable con 160 GB.

DeepSeek V4 frente a sus competidores

En la última semana hemos visto el lanzamiento de GPT-5.5 de OpenAI y Claude Opus 4.7 de Anthropic. Aunque estos modelos presumen de capacidades de primer nivel, especialmente en razonamiento con contexto largo y programación agentica, DeepSeek V4 compite con fuerza en valor y accesibilidad abierta.

Así se compara DeepSeek-V4-Pro con los nuevos buques insignia de OpenAI y Anthropic:

|

Característica/benchmark |

DeepSeek V4 Pro |

GPT-5.5 |

Claude Opus 4.7 |

|

Precio API (entrada / salida por 1M) |

$1,74 / $3,48 |

$5,00 / $30,00 |

$5,00 / $25,00 |

|

Ventana de contexto |

1M tokens |

~1M tokens |

~1M tokens |

|

SWE-bench Pro (código) |

55,4% |

58,6% |

64,3% |

|

Terminal-Bench 2.0 (agentico) |

67,9% |

82,7% |

69,4% |

|

Pesos abiertos |

Sí (licencia MIT) |

No (cerrado) |

No (cerrado) |

Nota: si tu prioridad es el presupuesto, DeepSeek V4 Flash cuesta solo $0,14 por 1M de tokens de entrada y $0,28 por 1M de tokens de salida, por debajo incluso de modelos pequeños como GPT-5.4 Nano.

¿Qué tal es DeepSeek V4?

DeepSeek V4 es un lanzamiento tremendamente disruptivo. Según los benchmarks autoinformados por DeepSeek, el modelo Pro va solo 3 a 6 meses por detrás de los modelos de vanguardia (como GPT-5.4 y Gemini-3.1-Pro) en su trayectoria de desarrollo.

Ahora bien, en el contexto más amplio del sector, el rendimiento bruto es solo la mitad de la historia. El gran titular de DeepSeek V4 está en su altísima eficiencia con contextos largos y sus precios mínimos.

Ofrecer capacidades cercanas a la frontera —incluida una ventana de contexto de 1M de tokens— a una fracción del coste de GPT-5.5 u Opus 4.7 convierte a DeepSeek V4 en la opción más atractiva para tareas empresariales de gran volumen, investigadores de código abierto y desarrolladores con presupuesto ajustado.

Casos de uso de DeepSeek V4

Con estas fortalezas en mente, aquí van algunos ámbitos donde veo que V4 destaca:

- Ingeniería de software automatizada: Sus buenos resultados en benchmarks agenticos y la integración con herramientas como OpenClaw convierten a V4-Pro en un candidato sólido para la refactorización y depuración autónoma de bases de código.

- Procesamiento masivo de documentos: Los menores costes con contextos de 1M de tokens permiten que analistas financieros y equipos legales procesen montones de PDF, 10-K y contratos por céntimos.

- Despliegue local e investigación: Gracias a la licencia MIT, los investigadores pueden ejecutar cuantización (especialmente en el modelo Flash de 160 GB) para experimentar con IA de nivel frontera en local con hardware de consumo de gama alta.

Reflexiones finales

DeepSeek V4 es un gran paso adelante para la comunidad de IA de código abierto. Aunque GPT-5.5 y Claude Opus 4.7 puedan superarlo en los benchmarks más exigentes de código y razonamiento, DeepSeek V4 democratiza el acceso a ventanas de contexto de 1 millón de tokens y a flujos agenticos complejos.

Si quieres mantenerte a la vanguardia y aprender a implementar estos modelos punteros en tus propios flujos de trabajo, te recomiendo explorar algunos de nuestros recursos. En particular, nuestro curso Understanding Prompt Engineering para afinar cómo te comunicas con modelos como DeepSeek, o nuestro AI Agent Fundamentals skill track, si quieres empezar a construir sistemas agenticos escalables.

DeepSeek V4: preguntas frecuentes

¿DeepSeek V4 es de código abierto?

Sí. Tanto DeepSeek-V4-Pro como DeepSeek-V4-Flash son modelos de pesos abiertos publicados bajo la permisiva licencia MIT. Esto permite a desarrolladores e investigadores usar, modificar y desplegar los modelos comercialmente.

¿Cuál es la ventana de contexto de DeepSeek V4?

Tanto el modelo Pro como el Flash incluyen por defecto una ventana de contexto de 1 millón de tokens. Gracias a su nueva arquitectura de atención híbrida, DeepSeek V4 maneja este enorme contexto con una fracción del cómputo y la memoria de modelos anteriores.

¿Cuánto cuesta la API de DeepSeek V4?

El precio es muy competitivo. DeepSeek-V4-Flash cuesta solo $0,14 por 1M de tokens de entrada y $0,28 por 1M de tokens de salida. DeepSeek-V4-Pro cuesta $1,74 por 1M de tokens de entrada y $3,48 por 1M de tokens de salida.

¿Qué tamaño tienen los modelos DeepSeek V4?

DeepSeek utiliza una arquitectura Mixture of Experts (MoE). El modelo Pro contiene 1,6 billones de parámetros totales (49.000 millones activos) y requiere una descarga de 865 GB. El modelo Flash contiene 284.000 millones de parámetros (13.000 millones activos) y requiere una descarga de 160 GB.

¿DeepSeek V4 supera a GPT-5.5 y Claude Opus 4.7?

En capacidad pura, no. Los datos autoinformados por DeepSeek sugieren que el modelo V4-Pro va unos 3 a 6 meses por detrás de los modelos cerrados más avanzados en los benchmarks más duros de código y razonamiento. Sin embargo, ofrece un rendimiento cercano a la vanguardia por alrededor de un tercio del coste de la API, lo que lo hace muy disruptivo.

Escritora y editora de contenidos en el ámbito de la tecnología educativa. Comprometido con la exploración de tendencias de datos y entusiasmado con el aprendizaje de la ciencia de datos.