Track

После месяцев слухов и сразу вслед за выходом новых GPT-5.5 и Claude Opus 4.7 компания DeepSeek наконец выпустила DeepSeek V4. Релиз представлен двумя превью-моделями — V4-Pro и V4-Flash — с агрессивным ценообразованием и производительностью, близкой к уровню лидеров.

DeepSeek V4-Pro насчитывает 1,6 триллиона общих параметров и по умолчанию поддерживает контекстное окно в 1 миллион токенов. По словам DeepSeek, модель отстаёт от новейших закрытых решений всего на 3–6 месяцев, при этом стоит лишь малую долю от цен конкурентов, таких как OpenAI и Anthropic.

В этой статье я расскажу о релизе DeepSeek V4, рассмотрю ключевые возможности, результаты бенчмарков и сравнение с конкурентами. Также смотрите наши обзоры GPT-5.5 и Claude Opus 4.7. Для подробного сравнения прочитайте статьи DeepSeek V4 vs GPT-5.5, Claude Opus 4.7 vs DeepSeek V4 и DeepSeek V4 Flash vs GPT-5.4 mini и nano.

Коротко о DeepSeek V4

- V4 доступен в двух версиях: Pro (1,6T параметров) и Flash (284B параметров).

- Обе модели по умолчанию поддерживают контекстное окно в 1 миллион токенов.

- Pro стоит $1,74 за ввод / $3,48 за вывод на миллион токенов, значительно дешевле GPT-5.5 и Opus 4.7.

- Доступен через API, веб-интерфейс и открытые веса (лицензия MIT).

Что такое DeepSeek V4?

DeepSeek V4 — это давно ожидаемая новая серия моделей большого языка с открытыми весами от китайской лаборатории DeepSeek. Выпущенная 24 апреля 2026 года серия V4 представлена в двух версиях: DeepSeek-V4-Pro и DeepSeek-V4-Flash. Обе модели используют архитектуру Mixture of Experts (MoE) и по умолчанию предлагают огромное контекстное окно в 1 миллион токенов.

Значимость DeepSeek V4 для индустрии — в сочетании производительности, близкой к фронтирным моделям, и сверхконкурентных цен. Модель V4-Pro насчитывает 1,6 триллиона общих параметров (49 миллиардов активных), что делает её крупнейшей моделью с открытыми весами на данный момент.

Несмотря на размер, по утверждению DeepSeek, отставание от новейших закрытых моделей составляет всего 3–6 месяцев, при этом стоимость — лишь часть цены конкурентов вроде OpenAI и Anthropic.

Ключевые особенности DeepSeek V4

Рассмотрим некоторые примечательные особенности последнего релиза:

Структурные нововведения и эффективность 1M-контекста

Главная особенность DeepSeek V4 — чрезвычайно эффективная работа с длинным контекстом.

Согласно техническим примечаниям, серия V4 использует гибридную архитектуру внимания, сочетающую Compressed Sparse Attention (CSA) и Heavily Compressed Attention (HCA).

Благодаря этим структурным изменениям контекст в 1 миллион токенов стал стандартом для всех сервисов DeepSeek.

По данным DeepSeek, в сценарии с 1M-контекстом DeepSeek-V4-Pro требует лишь 27% FLOPs для инференса одного токена и всего 10% KV-кэша по сравнению с предшественником, DeepSeek-V3.2.

Три режима вычислительного рассуждения

Чтобы дать пользователям тонкий контроль над задержкой и качеством, в DeepSeek V4 предусмотрены три режима рассуждения:

- Non-think: Быстрые интуитивные ответы для повседневных задач и решений с низкими рисками.

- Think High: Осознанный логический разбор — медленнее, но очень точен для сложного решения задач.

- Think Max: Максимально задействует возможности рассуждения, чтобы исследовать пределы модели.

Расширенные агентные возможности

DeepSeek V4, по всей видимости, оптимизирован для агентного программирования. В заметках к релизу говорится, что он интегрируется без швов с ведущими ИИ-агентами, такими как Claude Code, OpenClaw и OpenCode, и уже лежит в основе собственной агентной инфраструктуры DeepSeek.

Продвинутые оптимизации обучения

Под капотом DeepSeek внедрила Manifold-Constrained Hyper-Connections (mHC) для усиления резидуальных связей и стабилизации распространения сигнала. Также был выбран оптимизатор Muon для более быстрой сходимости и устойчивости обучения; предобучение проводилось на более чем 32 триллионах разнообразных токенов.

Бенчмарки DeepSeek V4

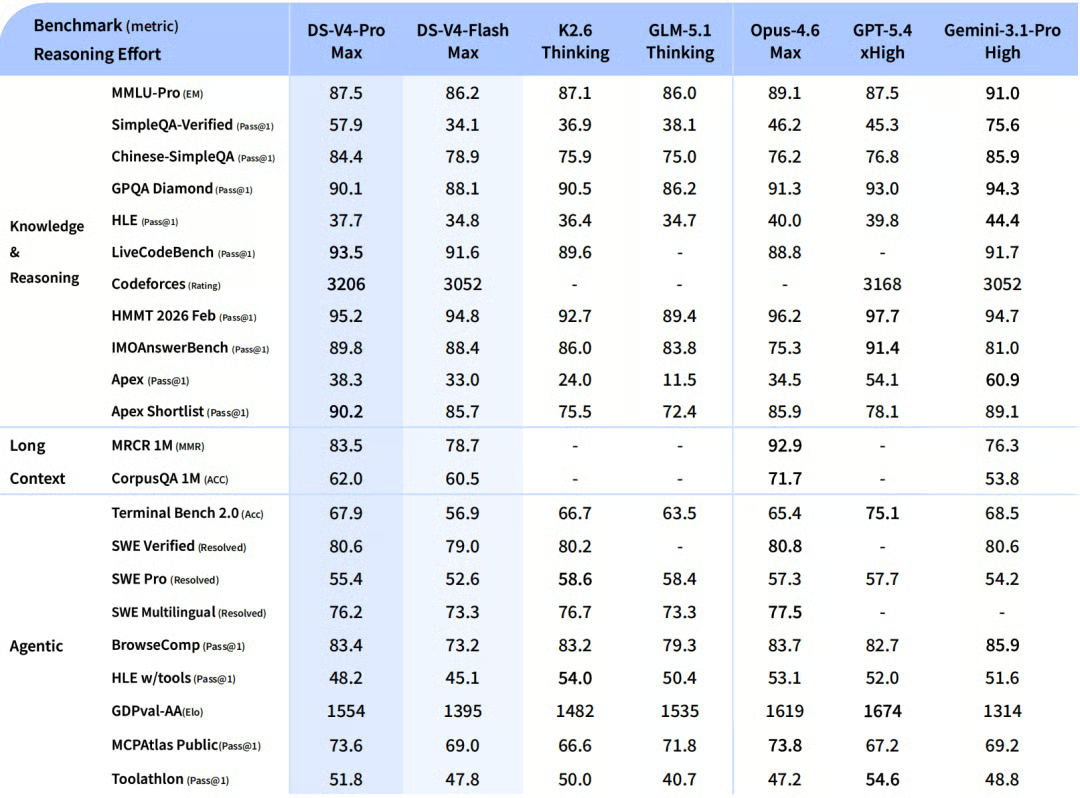

По внутренним данным DeepSeek, DeepSeek V4 демонстрирует впечатляющую производительность, особенно при работе на максимальных режимах рассуждения (DeepSeek-V4-Pro-Max).

Согласно официальным заметкам к релизу, вот как модель смотрится на фоне отрасли:

Знания и рассуждение

Pro-Max уверенно превосходит другие модели с открытым кодом и опережает более ранние фронтирные модели, такие как GPT-5.2. Она набирает конкурентные 87,5% на MMLU-Pro и 90,1% на GPQA Diamond, а также впечатляющие 92,6% на GSM8K по математике. Хотя до самой передовой кромки (GPT-5.4 и Gemini-3.1-Pro) ей ещё несколько месяцев, разрыв в знаниях заметно сокращён.

Агентные задачи

Pro-Max сравнима с ведущими открытыми моделями, показывая 67,9% на Terminal Bench 2.0 и 55,4% на SWE-Bench Pro. Хотя на публичных лидербордах она немного уступает новым закрытым моделям, внутренние тесты показывают преимущество над Claude Sonnet 4.5 и приближение к уровню Opus 4.5.

Длинный контекст

Окно в 1 миллион токенов — не просто для вида. Pro-Max показывает здесь очень сильные результаты, набирая 83,5% на MRCR 1M (MMR) в тестах «иголка в стоге сена». Это фактически превосходит Gemini-3.1-Pro на академических бенчмарках длинного контекста.

DeepSeek V4 Pro vs Flash

Из-за меньшего размера Flash-Max ожидаемо набирает меньше по «чистым» знаниям и испытывает трудности с наиболее сложными агентными сценариями. Однако при увеличении «бюджета на размышления» он достигает показателей рассуждения, сопоставимых с более ранними фронтирными моделями, что делает его крайне экономичным выбором для больших объёмов задач.

Как получить доступ к DeepSeek V4?

Сегодня есть несколько способов воспользоваться DeepSeek V4:

- Веб-интерфейс: Обе модели можно опробовать сразу на chat.deepseek.com в режиме Instant или Expert.

- Доступ к API: API доступен уже сейчас. Разработчикам нужно лишь указать модель

deepseek-v4-proилиdeepseek-v4-flash. API совместим с форматами OpenAI ChatCompletions и Anthropic. (Примечание: устаревшие моделиdeepseek-chatиdeepseek-reasonerбудут выведены из эксплуатации 24 июля 2026 года). - Открытые веса: Обе модели распространяются по лицензии MIT. Вы можете скачать веса напрямую с Hugging Face или ModelScope. Размер загрузки для Pro — 865 ГБ, для Flash — более удобные 160 ГБ.

DeepSeek V4 и конкуренты

За последнюю неделю вышли GPT-5.5 от OpenAI и Claude Opus 4.7 от Anthropic. Эти модели демонстрируют высочайшие возможности, особенно в рассуждении на длинном контексте и агентном программировании, однако DeepSeek V4 делает сильную ставку на выгоду и открытую доступность.

Вот как DeepSeek-V4-Pro сравнивается с новыми флагманами OpenAI и Anthropic:

|

Характеристика/бенчмарк |

DeepSeek V4 Pro |

GPT-5.5 |

Claude Opus 4.7 |

|

Цены API (ввод / вывод за 1М) |

$1,74 / $3,48 |

$5,00 / $30,00 |

$5,00 / $25,00 |

|

Контекстное окно |

1M токенов |

~1M токенов |

~1M токенов |

|

SWE-bench Pro (код) |

55,4% |

58,6% |

64,3% |

|

Terminal-Bench 2.0 (агентность) |

67,9% |

82,7% |

69,4% |

|

Открытые веса |

Да (лицензия MIT) |

Нет (закрыто) |

Нет (закрыто) |

Примечание: Если для вас на первом месте бюджет, DeepSeek V4 Flash стоит всего $0,14 за 1М входных токенов и $0,28 за 1М выходных — дешевле даже небольших моделей вроде GPT-5.4 Nano.

Насколько хорош DeepSeek V4?

DeepSeek V4 — крайне дисруптивный релиз. По собственным бенчмаркам DeepSeek, модель Pro отстаёт от передовых фронтирных моделей (таких как GPT-5.4 и Gemini-3.1-Pro) всего на 3–6 месяцев по траектории развития.

Однако в широком контексте индустрии «голая» производительность — лишь часть картины. Главный козырь DeepSeek V4 — сверхвысокая эффективность работы с длинным контекстом и минимальные цены.

Предоставляя возможности уровня почти фронтира, включая 1M-контекст, при цене, составляющей малую долю стоимости GPT-5.5 или Opus 4.7, DeepSeek V4 становится наиболее убедительным вариантом для крупнообъёмных корпоративных задач, исследователей open-source и разработчиков с ограниченным бюджетом.

Сценарии использования DeepSeek V4

Учитывая эти сильные стороны, вот несколько областей, где V4 особенно силён:

- Автоматизированная разработка ПО: Высокие агентные метрики и интеграция с инструментами вроде OpenClaw делают V4-Pro отличным кандидатом для автономного рефакторинга и отладки кодовой базы.

- Потоковая обработка документов: Снижение затрат при вычислениях с 1M-контекстом означает, что финансовые аналитики и юристы могут за копейки обрабатывать горы PDF, 10-K и договоров.

- Локальный деплой и исследования: Благодаря лицензии MIT исследователи могут проводить квантизацию (особенно для 160‑гигабайтной модели Flash), чтобы экспериментировать с ИИ уровня фронтира локально на топовом потребительском «железе».

Итоги

DeepSeek V4 — огромный шаг вперёд для сообщества open-source ИИ. Хотя GPT-5.5 и Claude Opus 4.7 могут немного опережать его в самых сложных бенчмарках по коду и рассуждению, DeepSeek V4 демократизирует доступ к контекстным окнам на 1 миллион токенов и сложным агентным пайплайнам.

Если вы хотите опережать тренды и внедрять эти передовые модели в свои рабочие процессы, рекомендуем наши материалы. В частности, курс Understanding Prompt Engineering, чтобы улучшить взаимодействие с моделями вроде DeepSeek, и наш трек навыков AI Agent Fundamentals, если вы хотите начать строить масштабируемые агентные системы.

Частые вопросы о DeepSeek V4

Является ли DeepSeek V4 open-source?

Да. И DeepSeek-V4-Pro, и DeepSeek-V4-Flash — модели с открытыми весами, выпущенные по максимально либеральной лицензии MIT. Это позволяет разработчикам и исследователям использовать, модифицировать и развертывать модели в коммерческих целях.

Какое контекстное окно у DeepSeek V4?

И у Pro, и у Flash по умолчанию контекстное окно составляет 1 миллион токенов. Благодаря новой гибридной архитектуре внимания DeepSeek V4 обрабатывает такой огромный контекст с существенно меньшими вычислительными и памятьными затратами, чем более ранние модели.

Сколько стоит API DeepSeek V4?

Цены очень конкурентные. DeepSeek-V4-Flash стоит всего $0,14 за 1М входных токенов и $0,28 за 1М выходных. DeepSeek-V4-Pro стоит $1,74 за 1М входных токенов и $3,48 за 1М выходных.

Насколько велики модели DeepSeek V4?

DeepSeek использует архитектуру Mixture of Experts (MoE). Модель Pro содержит 1,6 триллиона общих параметров (49 миллиардов активных) и требует загрузки в 865 ГБ. Модель Flash содержит 284 миллиарда параметров (13 миллиардов активных) и требует 160 ГБ.

Превосходит ли DeepSeek V4 GPT-5.5 и Claude Opus 4.7?

По абсолютным возможностям — нет. По собственным данным DeepSeek, модель V4-Pro отстаёт от самых современных закрытых моделей на 3–6 месяцев в самых сложных бенчмарках по коду и рассуждению. Однако она обеспечивает почти фронтирную производительность примерно за треть стоимости API, что делает её крайне дисруптивной.