Programa

Depois de meses de rumores e logo após os novos GPT-5.5 e Claude Opus 4.7, a DeepSeek finalmente lançou o DeepSeek V4. O lançamento chega em forma de dois modelos em prévia, V4-Pro e V4-Flash, com preços agressivos e desempenho próximo ao estado da arte.

O DeepSeek V4-Pro traz 1,6 trilhão de parâmetros no total com uma janela de contexto de 1 milhão de tokens por padrão. A DeepSeek afirma que ele fica apenas de 3 a 6 meses atrás dos modelos fechados mais avançados, custando uma fração do preço de concorrentes como OpenAI e Anthropic.

Neste artigo, vou analisar o lançamento do DeepSeek V4, destacando seus principais recursos, desempenho em benchmarks e como ele se compara à concorrência. Você também pode conferir nossos guias sobre GPT-5.5 e Claude Opus 4.7. Para uma comparação detalhada, leia nossos artigos sobre DeepSeek V4 vs GPT-5.5, Claude Opus 4.7 vs DeepSeek V4 e DeepSeek V4 Flash vs GPT-5.4 mini e nano.

DeepSeek V4 em poucas palavras

- O V4 vem em duas versões: Pro (1,6T de parâmetros) e Flash (284B de parâmetros).

- Ambos os modelos oferecem uma janela de contexto padrão de 1 milhão de tokens.

- O Pro custa US$ 1,74 de entrada / US$ 3,48 de saída por milhão de tokens, muito abaixo do GPT-5.5 e do Opus 4.7.

- Disponível via API, interface web e pesos abertos (licença MIT).

O que é o DeepSeek V4?

DeepSeek V4 é a nova e aguardada série de modelos de linguagem de pesos abertos do laboratório chinês de IA DeepSeek. Lançada em 24 de abril de 2026, a série V4 chega em duas versões: DeepSeek-V4-Pro e DeepSeek-V4-Flash. Ambos os modelos usam uma arquitetura Mixture of Experts (MoE) e oferecem por padrão uma enorme janela de contexto de 1 milhão de tokens.

O que torna o DeepSeek V4 um grande marco para o setor é a combinação de desempenho perto da fronteira e preços supercompetitivos. O modelo V4-Pro conta com 1,6 trilhão de parâmetros totais (49 bilhões ativos), sendo o maior modelo de pesos abertos disponível atualmente.

Apesar do tamanho, a DeepSeek afirma que ele está apenas de 3 a 6 meses atrás dos modelos fechados mais avançados, custando uma fração do preço de concorrentes como OpenAI e Anthropic.

Principais recursos do DeepSeek V4

Vamos ver alguns dos destaques desta nova versão:

Inovação estrutural e eficiência com contexto de 1M

O grande diferencial do DeepSeek V4 é o manuseio extremamente eficiente de contextos longos.

Segundo as notas técnicas, a série V4 usa uma arquitetura de atenção híbrida que combina Compressed Sparse Attention (CSA) e Heavily Compressed Attention (HCA).

Graças a essas mudanças estruturais, o contexto de 1 milhão de tokens agora é padrão em todos os serviços DeepSeek.

A DeepSeek afirma que, em um cenário com 1M de tokens em contexto, o DeepSeek-V4-Pro exige apenas 27% dos FLOPs de inferência por token único e apenas 10% do cache KV em comparação com seu antecessor, o DeepSeek-V3.2.

Três modos de esforço de raciocínio

Para dar ao usuário controle fino entre latência e performance, o DeepSeek V4 inclui três modos de raciocínio:

- Non-think: Respostas rápidas e intuitivas para tarefas rotineiras e decisões de baixo risco.

- Think High: Análise lógica consciente, mais lenta porém muito precisa para problemas complexos.

- Think Max: Leva as capacidades de raciocínio ao máximo para explorar os limites do modelo.

Capacidades agentic aprimoradas

O DeepSeek V4 aparentemente é otimizado para codificação agentic. As notas de versão afirmam que ele se integra de forma sem atritos a agentes de IA líderes como Claude Code, OpenClaw e OpenCode, e já impulsiona a infraestrutura interna de codificação agentic da DeepSeek.

Otimizações avançadas de treinamento

Nos bastidores, a DeepSeek introduziu Manifold-Constrained Hyper-Connections (mHC) para fortalecer conexões residuais e estabilizar a propagação de sinal. A empresa também passou a usar o otimizador Muon para convergência mais rápida e maior estabilidade de treinamento, pré-treinando os modelos em mais de 32 trilhões de tokens diversos.

Benchmarks do DeepSeek V4

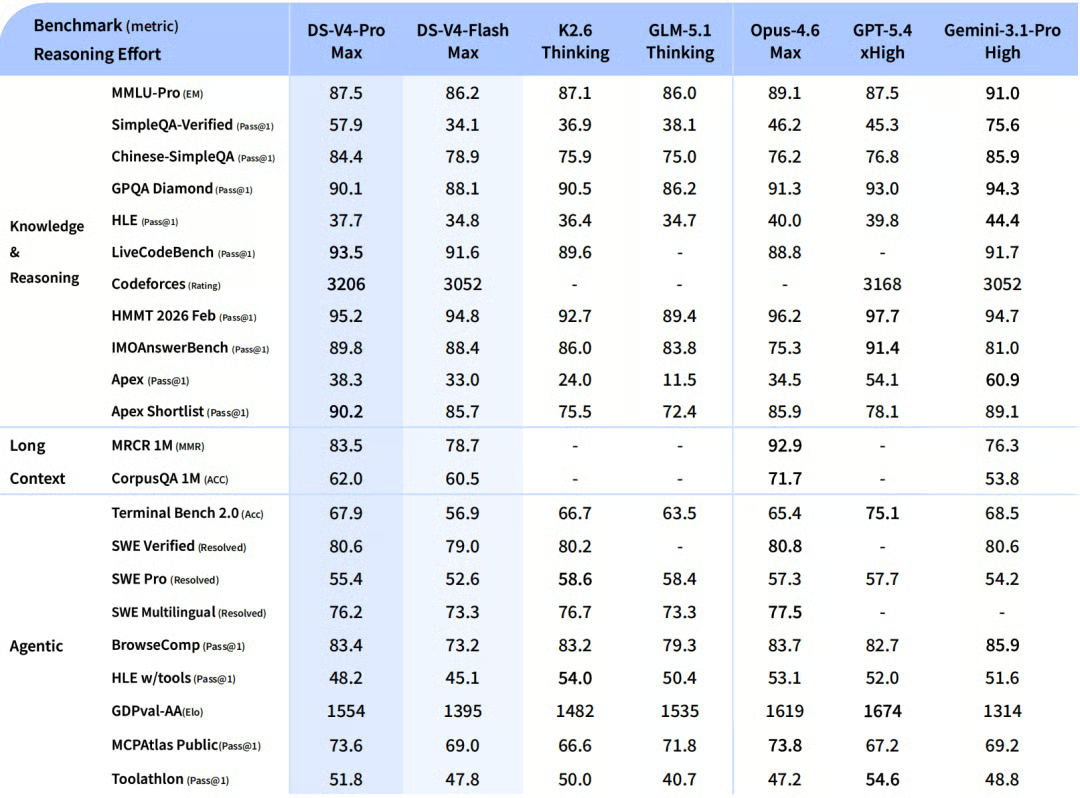

Segundo resultados internos da DeepSeek, o DeepSeek V4 apresenta desempenho impressionante, especialmente quando levado ao limite máximo de raciocínio (DeepSeek-V4-Pro-Max).

De acordo com as notas oficiais de lançamento, é assim que o modelo se posiciona frente ao restante do mercado:

Conhecimento e raciocínio

O Pro-Max supera com folga outros modelos de código aberto e vence modelos de ponta mais antigos como o GPT-5.2. Ele marca 87,5% no MMLU-Pro e 90,1% no GPQA Diamond, além de 92,6% no GSM8K em matemática. Embora ainda fique alguns meses atrás do que há de mais avançado (GPT-5.4 e Gemini-3.1-Pro), a distância vem diminuindo rapidamente.

Tarefas agentic

O Pro-Max está no mesmo nível dos principais modelos abertos, alcançando 67,9% no Terminal Bench 2.0 e 55,4% no SWE-Bench Pro. Embora fique um pouco abaixo dos modelos fechados mais novos nos rankings públicos, testes internos mostram que ele supera o Claude Sonnet 4.5 e se aproxima dos níveis do Opus 4.5.

Contexto longo

A janela de 1 milhão de tokens não é só marketing. O Pro-Max entrega resultados muito fortes aqui, marcando 83,5% nos testes MRCR 1M (MMR) de recuperação tipo agulha-no-palheiro. Isso inclusive supera o Gemini-3.1-Pro em benchmarks acadêmicos de contexto longo.

DeepSeek V4 Pro vs Flash

Por ser menor, o Flash-Max naturalmente pontua menos em conhecimento puro e tem mais dificuldade com os fluxos agentic mais complexos. Porém, se você der a ele um "orçamento de pensamento" maior, ele atinge pontuações de raciocínio comparáveis às de modelos de ponta mais antigos, tornando-se uma opção extremamente econômica para cargas pesadas.

Como acessar o DeepSeek V4?

Há várias formas de acessar o DeepSeek V4 agora mesmo:

- Interface web: Você pode testar os dois modelos imediatamente em chat.deepseek.com pelos modos Instant ou Expert.

- Acesso via API: A API já está disponível. Desenvolvedores só precisam atualizar o parâmetro do modelo para

deepseek-v4-prooudeepseek-v4-flash. A API mantém compatibilidade com os formatos OpenAI ChatCompletions e Anthropic. (Observação: os modelos legadosdeepseek-chatedeepseek-reasonerserão descontinuados em 24 de julho de 2026). - Pesos abertos: Ambos os modelos são lançados sob a licença MIT. Você pode baixar os pesos diretamente no Hugging Face ou ModelScope. O Pro tem 865GB de download, enquanto o Flash é bem mais leve, com 160GB.

DeepSeek V4 vs concorrentes

Na última semana, vimos os lançamentos do GPT-5.5 da OpenAI e do Claude Opus 4.7 da Anthropic. Embora esses modelos tragam recursos de primeira linha, especialmente em raciocínio com contexto longo e codificação agentic, o DeepSeek V4 compete fortemente em valor e acessibilidade aberta.

Veja como o DeepSeek-V4-Pro se compara aos novos carros-chefe da OpenAI e da Anthropic:

|

Recurso/benchmark |

DeepSeek V4 Pro |

GPT-5.5 |

Claude Opus 4.7 |

|

Preço da API (entrada / saída por 1M) |

US$ 1,74 / US$ 3,48 |

US$ 5,00 / US$ 30,00 |

US$ 5,00 / US$ 25,00 |

|

Janela de contexto |

1M tokens |

~1M tokens |

~1M tokens |

|

SWE-bench Pro (código) |

55,4% |

58,6% |

64,3% |

|

Terminal-Bench 2.0 (agentic) |

67,9% |

82,7% |

69,4% |

|

Pesos abertos |

Sim (licença MIT) |

Não (fechado) |

Não (fechado) |

Observação: para quem prioriza orçamento, o DeepSeek V4 Flash custa apenas US$ 0,14 por 1M de tokens de entrada e US$ 0,28 por 1M de tokens de saída, mais barato até que modelos pequenos como o GPT-5.4 Nano.

Quão bom é o DeepSeek V4?

O DeepSeek V4 é um lançamento altamente disruptivo. Segundo os próprios benchmarks da DeepSeek, o modelo Pro fica apenas de 3 a 6 meses atrás dos modelos de fronteira mais avançados (como GPT-5.4 e Gemini-3.1-Pro) na trajetória de desenvolvimento.

Mas, olhando para o mercado como um todo, desempenho puro é só metade da história. O grande destaque do DeepSeek V4 está na altíssima eficiência de contexto e no preço extremamente baixo.

Entregar capacidades próximas ao estado da arte, incluindo janela de 1M de tokens, por uma fração do custo do GPT-5.5 ou do Opus 4.7 torna o DeepSeek V4 a opção mais atraente para tarefas corporativas de alto volume, pesquisadores open-source e desenvolvedores com orçamento enxuto.

Casos de uso do DeepSeek V4

Com esses pontos fortes em mente, aqui vão algumas áreas em que vejo o V4 se destacando:

- Engenharia de software automatizada: Benchmarks agentic robustos e integração com ferramentas como o OpenClaw fazem do V4-Pro um forte candidato para refatoração e depuração autônomas de bases de código.

- Processamento de documentos em grande escala: Os custos reduzidos em computação com contexto de 1M de tokens permitem que analistas financeiros e times jurídicos processem montanhas de PDFs, 10-Ks e contratos gastando centavos.

- Implantação local e pesquisa: Como usa licença MIT, pesquisadores podem rodar quantização (especialmente no modelo Flash de 160GB) para experimentar IA de nível de fronteira localmente em hardwares de consumo avançados.

Considerações finais

O DeepSeek V4 é um passo enorme para a comunidade de IA open-source. Embora GPT-5.5 e Claude Opus 4.7 possam levar vantagem nos benchmarks mais difíceis de código e raciocínio, o DeepSeek V4 democratiza o acesso a janelas de contexto de 1 milhão de tokens e a fluxos agentic complexos.

Se você quer sair na frente e aprender a implementar esses modelos de ponta nos seus próprios fluxos de trabalho, recomendo explorar alguns dos nossos recursos. Em especial, o curso Understanding Prompt Engineering para aprimorar como você se comunica com modelos como o DeepSeek, ou a nossa trilha de habilidades AI Agent Fundamentals, se você quer começar a construir sistemas agentic em escala.

Perguntas frequentes sobre o DeepSeek V4

O DeepSeek V4 é open-source?

Sim. Tanto o DeepSeek-V4-Pro quanto o DeepSeek-V4-Flash são modelos de pesos abertos lançados sob a licença MIT, altamente permissiva. Isso permite que desenvolvedores e pesquisadores usem, modifiquem e implantem os modelos comercialmente.

Qual é a janela de contexto do DeepSeek V4?

Os modelos Pro e Flash oferecem, por padrão, uma janela de contexto de 1 milhão de tokens. Graças à nova arquitetura de atenção híbrida, o DeepSeek V4 lida com esse contexto massivo usando uma fração do custo de computação e memória de modelos anteriores.

Quanto custa a API do DeepSeek V4?

Os preços são altamente competitivos. O DeepSeek-V4-Flash custa apenas US$ 0,14 por 1M de tokens de entrada e US$ 0,28 por 1M de tokens de saída. O DeepSeek-V4-Pro custa US$ 1,74 por 1M de tokens de entrada e US$ 3,48 por 1M de tokens de saída.

Qual é o tamanho dos modelos DeepSeek V4?

A DeepSeek usa uma arquitetura Mixture of Experts (MoE). O modelo Pro tem 1,6 trilhão de parâmetros no total (49 bilhões ativos) e requer um download de 865GB. O modelo Flash tem 284 bilhões de parâmetros (13 bilhões ativos) e requer um download de 160GB.

O DeepSeek V4 supera o GPT-5.5 e o Claude Opus 4.7?

Em capacidade pura, não. Dados autodeclarados pela DeepSeek sugerem que o modelo V4-Pro fica de 3 a 6 meses atrás dos modelos fechados mais avançados nos benchmarks mais difíceis de código e raciocínio. No entanto, ele entrega desempenho próximo ao estado da arte por cerca de um terço do custo da API, o que é altamente disruptivo.

Escritor e editor de conteúdo na área de edtech. Comprometido com a exploração de tendências de dados e entusiasmado com o aprendizado da ciência de dados.