Tracks

在数月传闻之后,紧随全新 GPT-5.5 和 Claude Opus 4.7 的发布,DeepSeek 终于推出了 DeepSeek V4。本次发布以两款预览模型的形式亮相:V4-Pro 和 V4-Flash,凭借激进的定价与接近前沿的性能进入市场。

DeepSeek V4-Pro 号称拥有 1.6 万亿总参数,默认提供 100 万 token 的上下文窗口。DeepSeek 表示,该模型距离最先进的闭源模型仅有 3 到 6 个月的差距,而成本只是 OpenAI 和 Anthropic 等竞争对手的一小部分。

在本文中,我将介绍 DeepSeek V4 的发布概况,重点关注其核心功能、基准表现,以及与竞品的对比。您也可以查看我们的 GPT-5.5 和 Claude Opus 4.7 指南。若需详细对比,请阅读我们的文章:DeepSeek V4 与 GPT-5.5 对比、Claude Opus 4.7 与 DeepSeek V4 对比,以及 DeepSeek V4 Flash 对比 GPT-5.4 mini 与 nano。

DeepSeek V4 一图读懂

- V4 提供两种版本:Pro(1.6T 参数)与 Flash(284B 参数)。

- 两款模型均默认提供 100 万 token 的上下文窗口。

- Pro 价格为每 100 万 token 输入 $1.74 / 输出 $3.48,明显低于 GPT-5.5 与 Opus 4.7。

- 可通过 API、网页端以及开放权重(MIT 许可)获取。

什么是 DeepSeek V4?

DeepSeek V4 是中国 AI 实验室 DeepSeek 推出的备受期待的开放权重大语言模型新系列。于 2026 年 4 月 24 日发布,V4 系列包含两个版本:DeepSeek-V4-Pro 和 DeepSeek-V4-Flash。两者均采用 Mixture of Experts(MoE)架构,并默认提供高达 100 万 token 的上下文窗口。

DeepSeek V4 之所以成为行业重磅发布,在于其将接近前沿的性能与极具竞争力的价格相结合。V4-Pro 模型拥有 1.6 万亿总参数(激活 490 亿),是当前可用的体量最大的开放权重模型。

尽管规模庞大,DeepSeek 声称其与最先进的闭源模型仅相差 3 至 6 个月,同时成本远低于 OpenAI 与 Anthropic 等对手。

DeepSeek V4 的关键功能

以下是本次版本的一些亮点:

结构创新与 100 万上下文效率

DeepSeek V4 的一大亮点是其对长上下文的高效处理。

根据技术说明,V4 系列采用混合注意力架构(Hybrid Attention Architecture),结合了 Compressed Sparse Attention(CSA)与 Heavily Compressed Attention(HCA)。

得益于这些结构变更,100 万 token 的上下文已成为所有 DeepSeek 服务的标准配置。

DeepSeek 声称,在 100 万 token 上下文场景下,DeepSeek-V4-Pro 的单 token 推理 FLOPs 仅为前代 DeepSeek-V3.2 的 27%,KV 缓存仅为其 10%。

三种推理力度模式

为便于用户在时延与性能之间精细取舍,DeepSeek V4 提供三种推理模式:

- Non-think:用于日常任务与低风险决策的快速直觉式回复。

- Think High:有意识的逻辑分析,速度较慢,但在复杂问题求解上准确度高。

- Think Max:将推理能力推至极限,用于探索模型能力的边界。

强化的 Agent 能力

DeepSeek V4 据称针对 Agent 型编码做了优化。发布说明称其可无缝集成 Claude Code、OpenClaw 与 OpenCode 等主流 AI Agent,且已驱动 DeepSeek 内部的 Agent 式编码基础设施。

先进的训练优化

在底层优化上,DeepSeek 引入了 Manifold-Constrained Hyper-Connections(mHC),以增强残差连接并稳定信号传播。同时切换至 Muon Optimizer,以实现更快的收敛与更高的训练稳定性;在超过 32 万亿的多样化 token 上完成预训练。

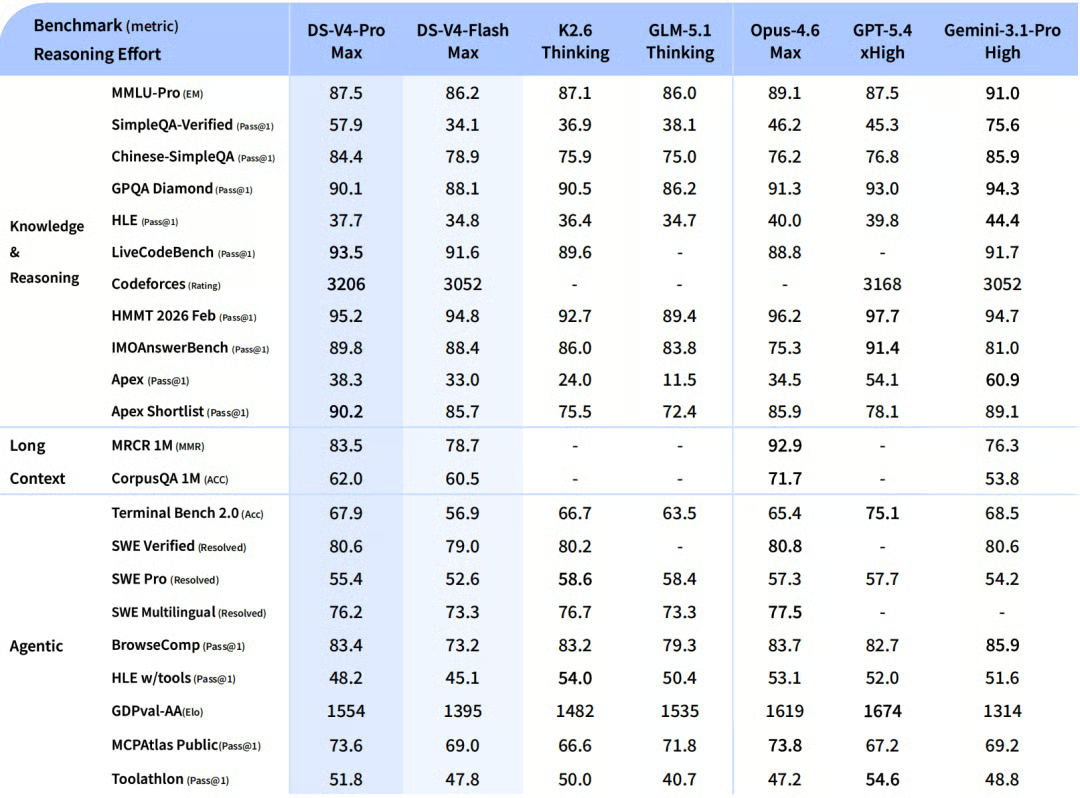

DeepSeek V4 基准测试

根据 DeepSeek 的内部结果,DeepSeek V4 的表现相当亮眼,尤其是在将推理能力拉满(DeepSeek-V4-Pro-Max)时。

根据官方发布说明,该模型与更广泛行业对比如下:

知识与推理

Pro-Max 轻松超越其他开源模型,并击败诸如 GPT-5.2 等较早的前沿模型。其在 MMLU-Pro 上得分 87.5%,在 GPQA Diamond 上得分 90.1%,数学任务 GSM8K 得分 92.6%。尽管与最前沿(GPT-5.4 与 Gemini-3.1-Pro)相比仍落后数月,但已显著缩小知识差距。

Agent 任务

Pro-Max 与领先的开源模型大致相当,在 Terminal Bench 2.0 上达到 67.9%,在 SWE-Bench Pro 上达到 55.4%。尽管在公开榜单上略逊于最新闭源模型,内部测试显示其可超越 Claude Sonnet 4.5,并逼近 Opus 4.5 的水平。

长上下文

100 万 token 的窗口并非噱头。Pro-Max 在该项上表现极强,在 MRCR 1M(MMR)大海捞针检索测试中取得 83.5%。这在学术长上下文基准上实际上超过了 Gemini-3.1-Pro。

DeepSeek V4 Pro vs Flash

由于规模更小,Flash-Max 在纯知识项上得分自然偏低,并在最复杂的 Agent 工作流中更易受限。然而,如果给予其更大的“思考预算”,它能达到与较早前沿模型相当的推理分数,使其成为高负载场景中极具性价比的选择。

如何获取 DeepSeek V4?

目前有多种方式可以使用 DeepSeek V4:

- 网页端:您可在 chat.deepseek.com 通过即时模式或专家模式立即试用两款模型。

- API 访问:API 已可用。开发者只需将模型参数更新为

deepseek-v4-pro或deepseek-v4-flash。该 API 兼容 OpenAI ChatCompletions 与 Anthropic API 格式。(注意:旧版deepseek-chat与deepseek-reasoner模型将于 2026 年 7 月 24 日停用。) - 开放权重:两款模型均以 MIT 许可发布。您可直接从 Hugging Face 或 ModelScope 下载权重。Pro 的下载大小为 865GB,而 Flash 更为易于管理,为 160GB。

DeepSeek V4 与竞品对比

过去一周内,OpenAI 发布了 GPT-5.5,Anthropic 发布了 Claude Opus 4.7。尽管这些模型在长上下文推理与 Agent 式编码方面具备顶级能力,DeepSeek V4 则在价值与开放可及性方面竞争力十足。

以下是 DeepSeek-V4-Pro 与 OpenAI 与 Anthropic 新旗舰模型的对比:

|

功能/基准 |

DeepSeek V4 Pro |

GPT-5.5 |

Claude Opus 4.7 |

|

API 定价(每 100 万:输入 / 输出) |

$1.74 / $3.48 |

$5.00 / $30.00 |

$5.00 / $25.00 |

|

上下文窗口 |

100 万 tokens |

约 100 万 tokens |

约 100 万 tokens |

|

SWE-bench Pro(编码) |

55.4% |

58.6% |

64.3% |

|

Terminal-Bench 2.0(Agent) |

67.9% |

82.7% |

69.4% |

|

开放权重 |

是(MIT 许可) |

否(闭源) |

否(闭源) |

注:若您更关注预算,DeepSeek V4 Flash 每 100 万输入 token 仅 $0.14、每 100 万输出 token 仅 $0.28,甚至低于如 GPT-5.4 Nano 等小模型。

DeepSeek V4 表现如何?

DeepSeek V4 是一款极具颠覆性的发布。根据 DeepSeek 自报的基准,Pro 模型在研发演进上距离最前沿模型(如 GPT-5.4 与 Gemini-3.1-Pro)仅有 3 到 6 个月。

不过从更广阔的行业背景看,裸性能只是故事的一半。DeepSeek V4 的最大看点在于其超高的上下文效率与极低的价格。

在成本仅为 GPT-5.5 或 Opus 4.7 一小部分的情况下,仍能提供接近前沿的能力(包括 100 万 token 上下文窗口),使 DeepSeek V4 成为高吞吐企业任务、开源研究者以及注重预算的开发者的极具吸引力之选。

DeepSeek V4 的适用场景

基于上述优势,我认为 V4 在以下领域尤为出色:

- 自动化软件工程:强劲的 Agent 基准与与 OpenClaw 等工具的集成,使 V4-Pro 成为自主代码库重构与调试的有力候选。

- 高容量文档处理:在 100 万 token 上下文计算中显著降低的成本,意味着财务分析师与法务团队只需极低费用即可处理海量 PDF、10-K 与合同。

- 本地部署与研究:得益于 MIT 许可,研究人员可在本地进行量化(尤其是 160GB 的 Flash 模型),在高端消费级硬件上探索接近前沿水平的 AI。

总结

DeepSeek V4 为开源 AI 社区带来了巨大的前进步伐。尽管在最困难的编码与推理基准上,GPT-5.5 与 Claude Opus 4.7 可能略胜一筹,但 DeepSeek V4 将 100 万 token 上下文窗口与复杂的 Agent 工作流更广泛地普及开来。

如果您希望走在前沿,并学习如何将这些尖端模型应用到您的工作流中,建议查看我们的资源。尤其是 Understanding Prompt Engineering 课程,帮助您优化与 DeepSeek 等模型的沟通方式;或我们的 AI Agent Fundamentals 技能路径,如果您计划开始构建可扩展的 Agent 系统。

DeepSeek V4 常见问答

DeepSeek V4 是否开源?

是的。DeepSeek-V4-Pro 与 DeepSeek-V4-Flash 均为开放权重模型,并以非常宽松的 MIT 许可发布。这允许开发者与研究人员在商业环境中使用、修改并部署这些模型。

DeepSeek V4 的上下文窗口是多少?

Pro 与 Flash 两款模型均默认提供 100 万 token 的上下文窗口。得益于全新的混合注意力架构(Hybrid Attention Architecture),DeepSeek V4 能以远低于旧模型的算力与内存成本处理如此庞大的上下文。

DeepSeek V4 API 多少钱?

定价具有很强竞争力。DeepSeek-V4-Flash 每 100 万输入 token 仅 $0.14、每 100 万输出 token 仅 $0.28。DeepSeek-V4-Pro 每 100 万输入 token 为 $1.74、每 100 万输出 token 为 $3.48。

DeepSeek V4 模型有多大?

DeepSeek 采用 Mixture of Experts(MoE)架构。Pro 模型拥有 1.6 万亿总参数(激活 490 亿),下载大小为 865GB。Flash 模型拥有 2840 亿参数(激活 130 亿),下载大小为 160GB。

DeepSeek V4 是否超越了 GPT-5.5 与 Claude Opus 4.7?

就纯能力而言,并非如此。根据 DeepSeek 自报的数据,V4-Pro 在最困难的编码与推理基准上较最先进的闭源模型约落后 3 到 6 个月。不过,它以大约三分之一的 API 成本提供接近前沿的性能,因而极具颠覆性。