Program

Setelah berbulan-bulan rumor dan menyusul peluncuran GPT-5.5 dan Claude Opus 4.7, DeepSeek akhirnya merilis DeepSeek V4. Rilis ini hadir dalam bentuk dua model pratinjau, V4-Pro dan V4-Flash, memasuki pasar dengan harga agresif dan performa mendekati frontier.

DeepSeek V4-Pro memiliki total 1,6 triliun parameter dengan jendela konteks 1 juta token secara default. DeepSeek mengklaim hanya tertinggal 3 hingga 6 bulan dari model tertutup tercanggih, sambil mematok harga yang jauh lebih rendah dibanding pesaing seperti OpenAI dan Anthropic.

Dalam artikel ini, saya akan membahas rilis DeepSeek V4, meninjau fitur utamanya, performa tolok ukurnya, dan bagaimana perbandingannya dengan kompetitor. Anda juga dapat melihat panduan kami untuk GPT-5.5 dan Claude Opus 4.7. Untuk perbandingan terperinci, baca artikel kami tentang DeepSeek V4 vs GPT-5.5, Claude Opus 4.7 vs DeepSeek V4, dan DeepSeek V4 Flash vs GPT-5.4 mini dan nano.

Sekilas tentang DeepSeek V4

- V4 hadir dalam dua varian: Pro (1,6T parameter) dan Flash (284B parameter).

- Kedua model memiliki jendela konteks 1 juta token secara default.

- Biaya Pro adalah $1,74 input / $3,48 output per satu juta token, jauh lebih murah daripada GPT-5.5 dan Opus 4.7.

- Tersedia melalui API, antarmuka web, dan bobot terbuka (Lisensi MIT).

Apa itu DeepSeek V4?

DeepSeek V4 adalah seri baru model bahasa besar berbobot terbuka yang sangat dinantikan dari lab AI Tiongkok, DeepSeek. Dirilis pada 24 April 2026, seri V4 hadir dalam dua versi: DeepSeek-V4-Pro dan DeepSeek-V4-Flash. Keduanya menggunakan arsitektur Mixture of Experts (MoE) dan menawarkan jendela konteks 1 juta token secara default.

Yang membuat DeepSeek V4 menjadi rilis besar bagi industri adalah kombinasi performa mendekati frontier dan harga yang sangat kompetitif. Model V4-Pro memiliki total 1,6 triliun parameter (49 miliar aktif), menjadikannya model berbobot terbuka terbesar yang tersedia saat ini.

Meski berukuran besar, DeepSeek mengklaim hanya tertinggal 3 hingga 6 bulan dari model tertutup tercanggih, sambil mematok harga yang jauh lebih rendah dibanding pesaing seperti OpenAI dan Anthropic.

Fitur Utama DeepSeek V4

Mari kita lihat beberapa fitur menonjol dari rilis terbaru ini:

Inovasi struktural dan efisiensi konteks 1M

Fitur paling menonjol dari DeepSeek V4 adalah kemampuannya yang sangat efisien dalam menangani konteks panjang.

Menurut catatan teknis, seri V4 menggunakan Arsitektur Perhatian Hibrida yang menggabungkan Compressed Sparse Attention (CSA) dan Heavily Compressed Attention (HCA).

Berkat perubahan struktural ini, konteks 1 juta token kini menjadi standar di seluruh layanan DeepSeek.

DeepSeek mengklaim bahwa, dalam skenario konteks 1M token, DeepSeek-V4-Pro hanya memerlukan 27% FLOPs inferensi per token tunggal dan hanya 10% KV cache dibanding pendahulunya, DeepSeek-V3.2.

Tiga mode upaya penalaran

Untuk memberi pengguna kontrol granular atas latensi dan performa, DeepSeek V4 menyertakan tiga mode penalaran:

- Non-think: Respons cepat dan intuitif untuk tugas harian rutin dan keputusan berisiko rendah.

- Think High: Analisis logis sadar yang lebih lambat tetapi sangat akurat untuk pemecahan masalah kompleks.

- Think Max: Mendorong kemampuan penalaran hingga batas maksimal untuk mengeksplorasi batas kemampuan model.

Kemampuan agen yang ditingkatkan

DeepSeek V4 tampaknya dioptimalkan untuk coding berbasis agen. Catatan rilis menyatakan bahwa ini terintegrasi mulus dengan agen AI terkemuka seperti Claude Code, OpenClaw, dan OpenCode, dan sudah mendukung infrastruktur coding berbasis agen internal DeepSeek.

Optimasi pelatihan tingkat lanjut

Di balik layar, DeepSeek memperkenalkan Manifold-Constrained Hyper-Connections (mHC) untuk memperkuat koneksi residual dan menstabilkan propagasi sinyal. Mereka juga beralih ke Muon Optimizer untuk konvergensi yang lebih cepat dan stabilitas pelatihan yang lebih baik, melakukan pra-pelatihan model pada lebih dari 32 triliun token yang beragam.

Tolok Ukur DeepSeek V4

Menurut hasil internal DeepSeek, DeepSeek V4 menunjukkan performa yang mengesankan, terutama saat didorong ke batas penalaran maksimalnya (DeepSeek-V4-Pro-Max).

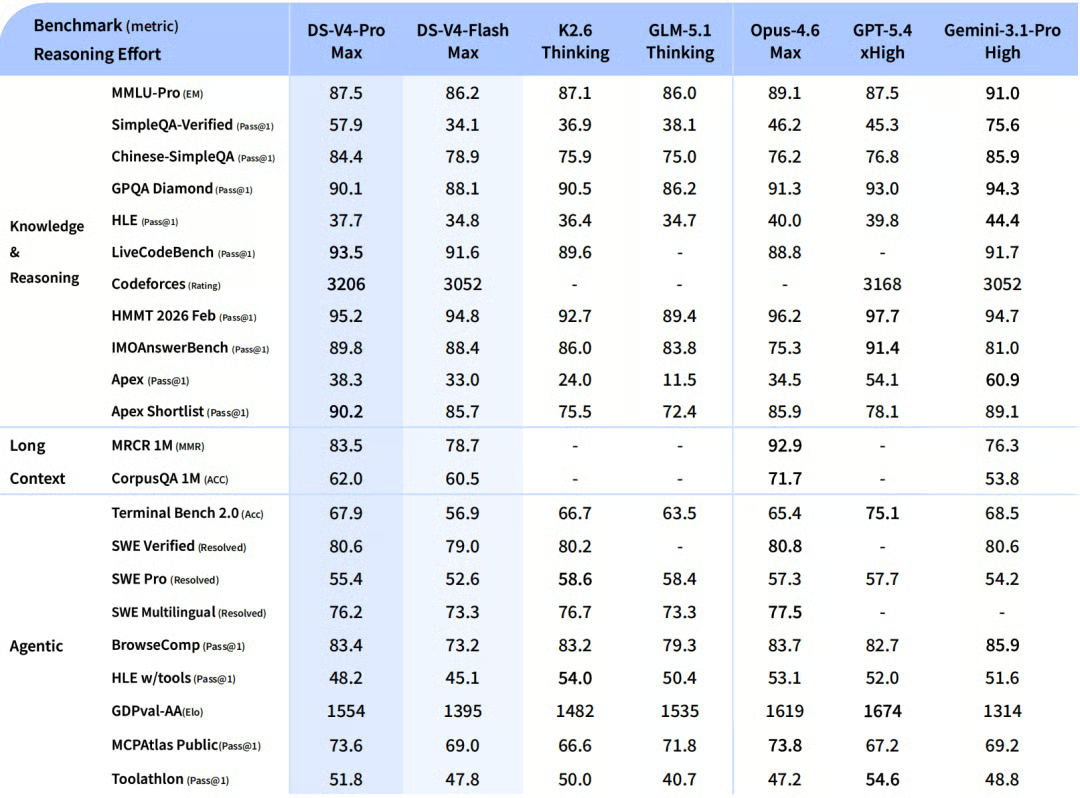

Menurut catatan rilis resmi, berikut perbandingan model ini dengan industri secara umum:

Pengetahuan dan penalaran

Pro-Max dengan mudah melampaui model open-source lain dan mengalahkan model frontier yang lebih lama seperti GPT-5.2. Skornya sangat kompetitif, yaitu 87,5% pada MMLU-Pro dan 90,1% pada GPQA Diamond, serta 92,6% pada GSM8K untuk matematika. Meski masih tertinggal dari yang paling mutakhir (GPT-5.4 dan Gemini-3.1-Pro) beberapa bulan, celah pengetahuannya telah menyempit secara signifikan.

Tugas berbasis agen

Pro-Max sekelas dengan model terbuka terdepan, meraih 67,9% pada Terminal Bench 2.0 dan 55,4% pada SWE-Bench Pro. Meski sedikit di bawah model tertutup terbaru di papan peringkat publik, uji internal menunjukkan ini mengalahkan Claude Sonnet 4.5 dan mendekati level Opus 4.5.

Konteks panjang

Jendela 1 juta token bukan sekadar gimmick. Pro-Max memberikan hasil yang sangat kuat di sini, mencetak 83,5% pada uji pengambilan "jarum di tumpukan jerami" MRCR 1M (MMR). Ini bahkan melampaui Gemini-3.1-Pro pada tolok ukur konteks panjang akademik.

DeepSeek V4 Pro vs Flash

Karena ukurannya yang lebih kecil, Flash-Max secara alami mencetak nilai lebih rendah pada pengetahuan murni dan kesulitan dengan alur kerja agen yang paling kompleks. Namun, jika Anda memberinya "anggaran berpikir" yang lebih besar, hasil penalarannya setara dengan model frontier yang lebih lama, menjadikannya opsi yang sangat hemat biaya untuk beban kerja berat.

Bagaimana Cara Mengakses DeepSeek V4?

Ada beberapa cara untuk mengakses DeepSeek V4 saat ini:

- Antarmuka web: Anda dapat mencoba kedua model langsung di chat.deepseek.com melalui Instant Mode atau Expert Mode.

- Akses API: API tersedia hari ini. Pengembang hanya perlu memperbarui parameter model menjadi

deepseek-v4-proataudeepseek-v4-flash. API mempertahankan kompatibilitas dengan format OpenAI ChatCompletions dan Anthropic. (Catatan: model lawasdeepseek-chatdandeepseek-reasonerakan dihentikan pada 24 Juli 2026). - Bobot terbuka: Kedua model dirilis di bawah Lisensi MIT. Anda dapat mengunduh bobotnya langsung dari Hugging Face atau ModelScope. Pro berukuran unduhan 865GB, sedangkan Flash jauh lebih ringan, 160GB.

DeepSeek V4 vs Pesaing

Dalam sepekan terakhir, kita melihat rilis GPT-5.5 dari OpenAI dan Claude Opus 4.7 dari Anthropic. Meski model tersebut menawarkan kemampuan kelas atas, terutama dalam penalaran konteks panjang dan coding berbasis agen, DeepSeek V4 bersaing ketat dalam hal nilai dan akses terbuka.

Berikut perbandingan DeepSeek-V4-Pro dengan model andalan baru dari OpenAI dan Anthropic:

|

Fitur/Tolok Ukur |

DeepSeek V4 Pro |

GPT-5.5 |

Claude Opus 4.7 |

|

Harga API (Input / Output per 1M) |

$1,74 / $3,48 |

$5,00 / $30,00 |

$5,00 / $25,00 |

|

Jendela Konteks |

1M token |

~1M token |

~1M token |

|

SWE-bench Pro (Coding) |

55,4% |

58,6% |

64,3% |

|

Terminal-Bench 2.0 (Agen) |

67,9% |

82,7% |

69,4% |

|

Bobot Terbuka |

Ya (Lisensi MIT) |

Tidak (Tertutup) |

Tidak (Tertutup) |

Catatan: Bagi pengguna yang memprioritaskan anggaran, DeepSeek V4 Flash hanya berharga $0,14 per 1M token input dan $0,28 per 1M token output, bahkan lebih murah daripada model kecil seperti GPT-5.4 Nano.

Seberapa Baik DeepSeek V4?

DeepSeek V4 adalah rilis yang sangat disruptif. Menurut tolok ukur yang dilaporkan sendiri oleh DeepSeek, model Pro tertinggal dari model frontier tercanggih (seperti GPT-5.4 dan Gemini-3.1-Pro) hanya 3 hingga 6 bulan dalam lintasan pengembangan.

Namun, melihat konteks industri yang lebih luas, performa mentah hanyalah separuh cerita. Sorotan utama DeepSeek V4 terletak pada efisiensi konteks yang sangat tinggi dan harga yang sangat rendah.

Menyediakan kemampuan mendekati frontier, termasuk jendela konteks 1M token, dengan biaya sebagian kecil dari GPT-5.5 atau Opus 4.7 menjadikan DeepSeek V4 opsi paling menarik untuk tugas perusahaan berskala besar, peneliti open-source, dan pengembang yang sensitif terhadap biaya.

Use Case DeepSeek V4

Dengan kekuatan tersebut, berikut beberapa area di mana saya melihat V4 unggul:

- Rekayasa perangkat lunak otomatis: Tolok ukur agen yang kuat dan integrasi dengan alat seperti OpenClaw menjadikan V4-Pro kandidat solid untuk refaktorisasi basis kode dan debugging secara otonom.

- Pemrosesan dokumen berskala besar: Biaya yang lebih rendah dalam komputasi konteks 1M token berarti analis keuangan dan tim legal dapat memproses tumpukan PDF, 10-K, dan kontrak dengan biaya sangat kecil.

- Penerapan lokal dan riset: Karena menggunakan lisensi MIT, peneliti dapat menjalankan kuantisasi (terutama pada model Flash 160GB) untuk bereksperimen dengan AI level frontier secara lokal pada perangkat keras konsumen kelas atas.

Penutup

DeepSeek V4 adalah langkah besar bagi komunitas AI open-source. Meski GPT-5.5 dan Claude Opus 4.7 mungkin unggul pada tolok ukur coding dan penalaran yang paling sulit, DeepSeek V4 mendemokratisasi akses ke jendela konteks 1 juta token dan alur kerja agen yang kompleks.

Jika Anda ingin tetap berada di garis depan dan mempelajari cara menerapkan model mutakhir ini dalam alur kerja Anda sendiri, saya sarankan meninjau beberapa sumber daya kami. Khususnya, kursus Understanding Prompt Engineering untuk menyempurnakan cara Anda berkomunikasi dengan model seperti DeepSeek, atau AI Agent Fundamentals skill track, jika Anda ingin mulai membangun sistem agen yang dapat diskalakan.

DeepSeek V4 FAQs

Apakah DeepSeek V4 open-source?

Ya. Baik DeepSeek-V4-Pro maupun DeepSeek-V4-Flash adalah model berbobot terbuka yang dirilis di bawah Lisensi MIT yang sangat permisif. Ini memungkinkan pengembang dan peneliti untuk menggunakan, memodifikasi, dan menerapkan model secara komersial.

Berapa jendela konteks untuk DeepSeek V4?

Baik model Pro maupun Flash memiliki jendela konteks 1 juta token secara default. Berkat Arsitektur Perhatian Hibrida yang baru, DeepSeek V4 menangani konteks masif ini dengan sebagian kecil dari biaya komputasi dan memori dibanding model lama.

Berapa biaya API DeepSeek V4?

Harganya sangat kompetitif. DeepSeek-V4-Flash hanya berharga $0,14 per 1M token input dan $0,28 per 1M token output. DeepSeek-V4-Pro berharga $1,74 per 1M token input dan $3,48 per 1M token output.

Seberapa besar model DeepSeek V4?

DeepSeek menggunakan arsitektur Mixture of Experts (MoE). Model Pro berisi total 1,6 triliun parameter (49 miliar aktif) dan memerlukan unduhan 865GB. Model Flash berisi 284 miliar parameter (13 miliar aktif) dan memerlukan unduhan 160GB.

Apakah DeepSeek V4 mengungguli GPT-5.5 dan Claude Opus 4.7?

Dalam kemampuan murni, tidak. Data yang dilaporkan DeepSeek menunjukkan bahwa model V4-Pro tertinggal dari model tertutup tercanggih sekitar 3 hingga 6 bulan pada tolok ukur coding dan penalaran yang paling sulit. Namun, model ini menghadirkan performa mendekati frontier dengan biaya API sekitar sepertiga, sehingga sangat disruptif.

Editor senior di bidang AI dan edtech. Berkomitmen mengeksplorasi tren data dan AI.