Cursus

Après des mois de rumeurs, et dans le sillage de GPT-5.5 et de Claude Opus 4.7, DeepSeek a enfin lancé DeepSeek V4. Cette sortie prend la forme de deux modèles en préversion, V4-Pro et V4-Flash, qui arrivent sur le marché avec des prix très agressifs et des performances proches de l’état de l’art.

DeepSeek V4-Pro revendique 1,6 billion de paramètres au total, avec par défaut une fenêtre de contexte d’1 million de tokens. DeepSeek affirme ne se situer qu’à 3 à 6 mois des meilleurs modèles fermés, tout en coûtant une fraction du prix de concurrents comme OpenAI et Anthropic.

Dans cet article, je reviens sur la sortie de DeepSeek V4 : principales fonctionnalités, performances aux benchmarks et comparaison avec la concurrence. Consultez aussi nos guides sur GPT-5.5 et Claude Opus 4.7. Pour une comparaison détaillée, lisez nos articles DeepSeek V4 vs GPT-5.5, Claude Opus 4.7 vs DeepSeek V4 et DeepSeek V4 Flash vs GPT-5.4 mini and nano.

DeepSeek V4 en bref

- V4 existe en deux variantes : Pro (1,6 billion de paramètres) et Flash (284 milliards de paramètres).

- Les deux modèles proposent par défaut une fenêtre de contexte d’1 million de tokens.

- Pro coûte 1,74 $ en entrée / 3,48 $ en sortie par million de tokens, avec des prix nettement inférieurs à GPT-5.5 et Opus 4.7.

- Disponible via API, interface web et poids ouverts (licence MIT).

Qu’est-ce que DeepSeek V4 ?

DeepSeek V4 est la nouvelle série très attendue de grands modèles de langue à poids ouverts du laboratoire d’IA chinois DeepSeek. Publié le 24 avril 2026, la série V4 comprend deux versions : DeepSeek-V4-Pro et DeepSeek-V4-Flash. Les deux modèles utilisent une architecture Mixture of Experts (MoE) et offrent par défaut une immense fenêtre de contexte d’1 million de tokens.

Ce qui fait de DeepSeek V4 une sortie marquante pour le secteur, c’est sa combinaison de performances proches de l’avant-garde et de tarifs ultra-compétitifs. Le modèle V4-Pro revendique 1,6 billion de paramètres au total (49 milliards actifs), ce qui en fait le plus grand modèle à poids ouverts actuellement disponible.

Malgré sa taille, DeepSeek affirme ne se situer qu’à 3 à 6 mois des meilleurs modèles fermés, tout en coûtant une fraction du prix de concurrents comme OpenAI et Anthropic.

Fonctionnalités clé de DeepSeek V4

Voici quelques points saillants de cette dernière version :

Innovation structurelle et efficacité sur 1M de contexte

La capacité phare de DeepSeek V4, c’est sa gestion très efficace des longs contextes.

D’après les notes techniques, la série V4 utilise une architecture d’attention hybride combinant Compressed Sparse Attention (CSA) et Heavily Compressed Attention (HCA).

Grâce à ces évolutions structurelles, le contexte à 1 million de tokens devient la nouvelle norme sur l’ensemble des services DeepSeek.

DeepSeek indique que, dans un scénario à 1 million de tokens, DeepSeek-V4-Pro ne requiert que 27 % des FLOPs d’inference pour un seul token et seulement 10 % du cache KV par rapport à son prédécesseur, DeepSeek-V3.2.

Trois modes d’effort de raisonnement

Pour donner un contrôle fin entre latence et performance, DeepSeek V4 propose trois modes de raisonnement :

- Non-think : réponses rapides et intuitives pour les tâches courantes et les décisions peu risquées.

- Think High : analyse logique consciente, plus lente mais très précise pour la résolution de problèmes complexes.

- Think Max : pousse les capacités de raisonnement à leur maximum pour explorer les limites du modèle.

Capacités agentiques renforcées

DeepSeek V4 serait optimisé pour le coding agentique. Les notes de version indiquent qu’il s’intègre sans couture avec des agents d’IA de référence comme Claude Code, OpenClaw et OpenCode, et qu’il propulse déjà l’infrastructure interne de coding agentique de DeepSeek.

Optimisations d’entraînement avancées

Sous le capot, DeepSeek a introduit les Manifold-Constrained Hyper-Connections (mHC) pour renforcer les connexions résiduelles et stabiliser la propagation du signal. L’équipe est également passée à l’optimiseur Muon pour une convergence plus rapide et une stabilité accrue, avec un pré-entraînement sur plus de 32 billions de tokens diversifiés.

Benchmarks de DeepSeek V4

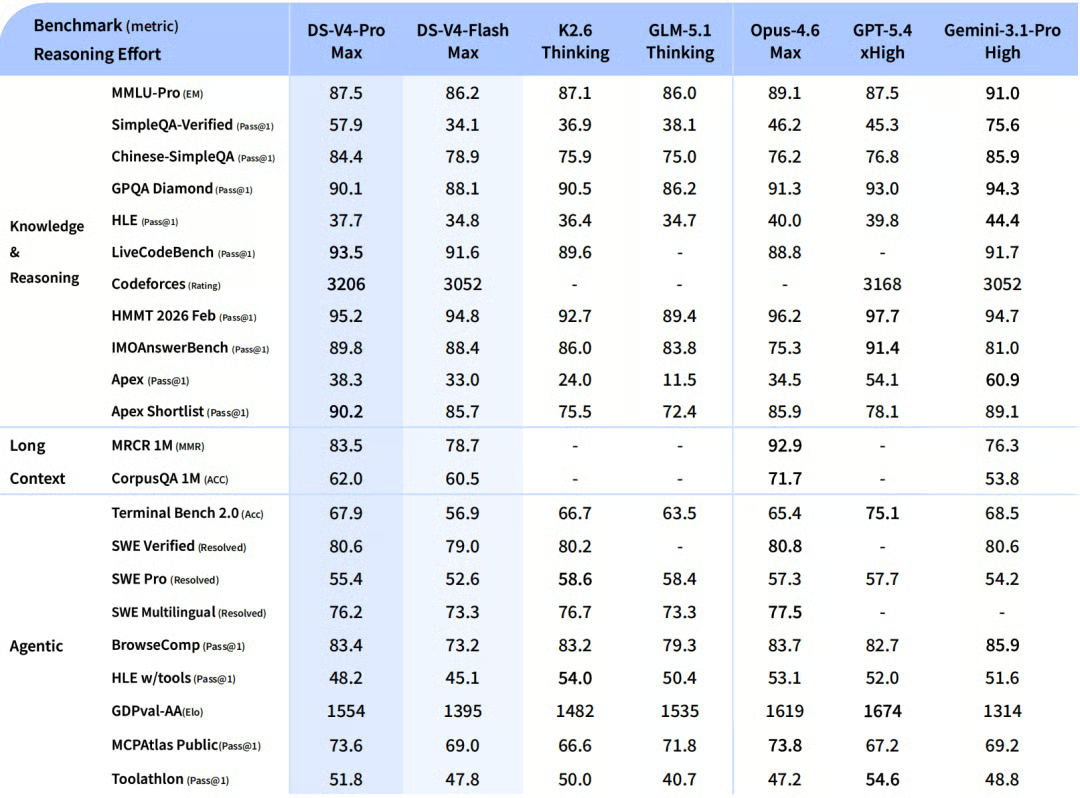

D’après les résultats internes de DeepSeek, DeepSeek V4 affiche des performances impressionnantes, en particulier lorsqu’on pousse ses limites de raisonnement (DeepSeek-V4-Pro-Max).

Voici, selon les notes de version officielles, comment le modèle se situe par rapport au marché :

Connaissances et raisonnement

Pro-Max surpasse facilement les autres modèles open source et bat des modèles de pointe plus anciens comme GPT-5.2. Il obtient un très solide 87,5 % sur MMLU-Pro et 90,1 % sur GPQA Diamond, ainsi qu’un 92,6 % sur GSM8K en mathématiques. Même s’il reste à quelques mois du tout dernier cri (GPT-5.4 et Gemini-3.1-Pro), l’écart de connaissances se réduit nettement.

Tâches agentiques

Pro-Max est au niveau des meilleurs modèles ouverts, avec 67,9 % sur Terminal Bench 2.0 et 55,4 % sur SWE-Bench Pro. S’il est légèrement en deçà des nouveaux modèles fermés dans les classements publics, des tests internes montrent qu’il devance Claude Sonnet 4.5 et se rapproche des niveaux d’Opus 4.5.

Long contexte

La fenêtre d’1 million de tokens n’est pas qu’un argument marketing. Pro-Max réalise ici des scores très élevés, avec 83,5 % sur les tests de recherche "aiguille dans une botte de foin" MRCR 1M (MMR). Cela dépasse même Gemini-3.1-Pro sur des benchmarks académiques de long contexte.

DeepSeek V4 Pro vs Flash

En raison de sa taille plus réduite, Flash-Max obtient logiquement des scores plus bas en pure connaissance et peine sur les workflows agentiques les plus complexes. Toutefois, en lui accordant un plus grand "budget de réflexion", il atteint des scores de raisonnement comparables à ceux d’anciens modèles de pointe, ce qui en fait une option extrêmement économique pour des charges massives.

Comment accéder à DeepSeek V4 ?

Plusieurs options sont d’ores et déjà disponibles :

- Interface web : vous pouvez essayer les deux modèles immédiatement sur chat.deepseek.com en mode Instant ou Expert.

- Accès API : l’API est disponible dès aujourd’hui. Les développeurs doivent simplement renseigner

deepseek-v4-prooudeepseek-v4-flashcomme paramètre de modèle. L’API reste compatible avec les formats OpenAI ChatCompletions et Anthropic. (Remarque : les anciens modèlesdeepseek-chatetdeepseek-reasonerseront retirés le 24 juillet 2026). - Poids ouverts : les deux modèles sont publiés sous licence MIT. Vous pouvez télécharger les poids directement depuis Hugging Face ou ModelScope. Pro pèse 865 Go, tandis que Flash est bien plus gérable avec 160 Go.

DeepSeek V4 face aux concurrents

Au cours de la dernière semaine, OpenAI a lancé GPT-5.5 et Anthropic a présenté Claude Opus 4.7. Si ces modèles affichent des capacités de tout premier plan, notamment en raisonnement sur long contexte et en coding agentique, DeepSeek V4 mise fortement sur la valeur et l’ouverture.

Voici comment DeepSeek-V4-Pro se compare aux nouveaux fleurons d’OpenAI et d’Anthropic :

|

Fonctionnalité / Benchmark |

DeepSeek V4 Pro |

GPT-5.5 |

Claude Opus 4.7 |

|

Tarification API (Entrée / Sortie par 1M) |

1,74 $ / 3,48 $ |

5,00 $ / 30,00 $ |

5,00 $ / 25,00 $ |

|

Fenêtre de contexte |

1M tokens |

~1M tokens |

~1M tokens |

|

SWE-bench Pro (Code) |

55,4 % |

58,6 % |

64,3 % |

|

Terminal-Bench 2.0 (Agentique) |

67,9 % |

82,7 % |

69,4 % |

|

Poids ouverts |

Oui (licence MIT) |

Non (fermé) |

Non (fermé) |

Remarque : pour les budgets serrés, DeepSeek V4 Flash coûte seulement 0,14 $ par 1M de tokens en entrée et 0,28 $ par 1M en sortie, moins cher même que des petits modèles comme GPT-5.4 Nano.

Quelle est la valeur de DeepSeek V4 ?

DeepSeek V4 est une sortie particulièrement disruptive. Selon les benchmarks auto-déclarés par DeepSeek, le modèle Pro se situe à 3 à 6 mois des modèles de pointe (comme GPT-5.4 et Gemini-3.1-Pro) en trajectoire de développement.

Cependant, à l’échelle du secteur, la performance brute n’est que la moitié de l’équation. Le fait marquant de DeepSeek V4 réside dans son efficacité de contexte très élevée et ses prix planchers.

Offrir des capacités proches de l’avant-garde, dont une fenêtre de 1M de tokens, pour une fraction du coût de GPT-5.5 ou d’Opus 4.7, fait de DeepSeek V4 une option de premier plan pour les tâches d’entreprise à grand volume, les chercheurs open source et les développeurs attentifs aux coûts.

Cas d’usage de DeepSeek V4

Compte tenu de ses atouts, voici quelques domaines où V4 excelle :

- Ingénierie logicielle automatisée : dé bons scores agentiques et une intégration avec des outils comme OpenClaw font de V4-Pro un candidat crédible pour le refactoring et le débogage autonomes de bases de code.

- Traitement massif de documents : les coûts réduits pour le calcul sur 1M de tokens permettent aux analystes financiers et aux équipes juridiques de passer au crible des montagnes de PDF, 10-K et contrats pour quelques centimes.

- Déploiement local et recherche : grâce à la licence MIT, les chercheurs peuvent effectuer de la quantification (surtout sur le modèle Flash de 160 Go) pour expérimenter localement une IA de niveau avant-garde sur du matériel grand public haut de gamme.

Conclusion

DeepSeek V4 marque une avancée majeure pour la communauté IA open source. Même si GPT-5.5 et Claude Opus 4.7 le devancent peut-être sur les benchmarks de code et de raisonnement les plus ardus, DeepSeek V4 démocratise l’accès à des fenêtres de contexte d’1 million de tokens et à des workflows agentiques complexes.

Si vous souhaitez garder une longueur d’avance et apprendre à intégrer ces modèles de pointe dans vos propres workflows, nous vous recommandons de consulter nos ressources. En particulier, notre cours Understanding Prompt Engineering pour optimiser votre façon de dialoguer avec des modèles comme DeepSeek, ou notre parcours de compétences AI Agent Fundamentals si vous voulez commencer à bâtir des systèmes agentiques à l’échelle.

DeepSeek V4 : FAQ

DeepSeek V4 est-il open source ?

Oui. DeepSeek-V4-Pro et DeepSeek-V4-Flash sont tous deux des modèles à poids ouverts publiés sous la licence MIT, très permissive. Les développeurs et chercheurs peuvent les utiliser, les modifier et les déployer à des fins commerciales.

Quelle est la fenêtre de contexte de DeepSeek V4 ?

Les modèles Pro et Flash proposent par défaut une fenêtre de contexte d’1 million de tokens. Grâce à sa nouvelle architecture d’attention hybride, DeepSeek V4 gère ce contexte massif avec une fraction des coûts de calcul et de mémoire des anciens modèles.

Combien coûte l’API DeepSeek V4 ?

La tarification est très compétitive. DeepSeek-V4-Flash coûte seulement 0,14 $ par 1M de tokens en entrée et 0,28 $ par 1M en sortie. DeepSeek-V4-Pro coûte 1,74 $ par 1M de tokens en entrée et 3,48 $ par 1M en sortie.

Quelle est la taille des modèles DeepSeek V4 ?

DeepSeek utilise une architecture Mixture of Experts (MoE). Le modèle Pro contient 1,6 billion de paramètres au total (49 milliards actifs) et nécessite un téléchargement de 865 Go. Le modèle Flash contient 284 milliards de paramètres (13 milliards actifs) et nécessite 160 Go de téléchargement.

DeepSeek V4 dépasse-t-il GPT-5.5 et Claude Opus 4.7 ?

En capacité brute, non. D’après les données auto-déclarées par DeepSeek, le modèle V4-Pro accuse un retard d’environ 3 à 6 mois sur les meilleurs modèles fermés pour les benchmarks de code et de raisonnement les plus ardus. En revanche, il offre des performances proches de l’avant-garde pour environ un tiers du coût API, ce qui est hautement disruptif.

Rédacteur et éditeur de contenu dans le domaine des technologies de l'information et de la communication. Vous êtes déterminé à explorer les tendances en matière de données et enthousiaste à l'idée d'apprendre la science des données.