track

După luni de zvonuri și imediat după lansarea noilor GPT-5.5 și Claude Opus 4.7, DeepSeek a lansat în sfârșit DeepSeek V4. Lansarea vine sub forma a două modele de previzualizare, V4-Pro și V4-Flash, care intră pe piață cu prețuri agresive și performanță aproape de nivelul frontierelor tehnologice.

DeepSeek V4-Pro se laudă cu 1,6 trilioane de parametri în total și, în mod implicit, cu o fereastră de context de 1 milion de tokeni. DeepSeek afirmă că este cu doar 3 până la 6 luni în urma modelelor închise de ultimă generație, în timp ce costă doar o fracțiune din prețul concurenților precum OpenAI și Anthropic.

În acest articol, voi acoperi lansarea DeepSeek V4, analizând caracteristicile sale cheie, performanța în benchmarkuri și modul în care se compară cu concurența. Puteți consulta și ghidurile noastre pentru GPT-5.5 și Claude Opus 4.7. Pentru o comparație detaliată, citiți articolele noastre despre DeepSeek V4 vs GPT-5.5, Claude Opus 4.7 vs DeepSeek V4 și DeepSeek V4 Flash vs GPT-5.4 mini and nano.

DeepSeek V4, pe scurt

- V4 vine în două variante: Pro (1,6T parametri) și Flash (284B parametri).

- Ambele modele au, în mod implicit, o fereastră de context de 1 milion de tokeni.

- Pro costă 1,74 $ input / 3,48 $ output per milion de tokeni, mult sub GPT-5.5 și Opus 4.7.

- Disponibil prin API, interfață web și greutăți deschise (licență MIT).

Ce este DeepSeek V4?

DeepSeek V4 este noua serie mult așteptată de modele lingvistice mari cu greutăți deschise de la laboratorul chinez de IA DeepSeek. Lansată pe 24 aprilie 2026, seria V4 vine în două versiuni: DeepSeek-V4-Pro și DeepSeek-V4-Flash. Ambele modele utilizează o Mixture of Experts (MoE) arhitectură și oferă, în mod implicit, o fereastră de context uriașă, de 1 milion de tokeni.

Ceea ce face din DeepSeek V4 o lansare majoră pentru industrie este combinația dintre performanța aproape de frontieră și prețurile extrem de competitive. Modelul V4-Pro se laudă cu 1,6 trilioane de parametri în total (49 de miliarde activi), fiind cel mai mare model cu greutăți deschise disponibil în prezent.

În ciuda dimensiunii sale, DeepSeek susține că este cu doar 3 până la 6 luni în urma modelelor închise de ultimă generație, în timp ce costă doar o fracțiune din prețul concurenților precum OpenAI și Anthropic.

Caracteristici cheie ale DeepSeek V4

Să analizăm câteva dintre elementele remarcabile ale ultimei versiuni:

Inovație structurală și eficiență pentru context de 1M

Caracteristica definitorie a DeepSeek V4 este gestionarea extrem de eficientă a contextului lung.

Conform notelor tehnice, seria V4 utilizează o arhitectură de atenție hibridă care combină Compressed Sparse Attention (CSA) și Heavily Compressed Attention (HCA).

Datorită acestor modificări structurale, un context de 1 milion de tokeni este acum standard pentru toate serviciile DeepSeek.

DeepSeek afirmă că, într-un scenariu cu context de 1M tokeni, DeepSeek-V4-Pro necesită doar 27% din FLOPs pentru inferența pe un singur token și doar 10% din cache-ul KV față de predecesorul său, DeepSeek-V3.2.

Trei moduri de efort pentru raționare

Pentru a le oferi utilizatorilor control granular asupra latenței și performanței, DeepSeek V4 include trei moduri de raționare:

- Non-think: Răspunsuri rapide, intuitive, pentru sarcini zilnice de rutină și decizii cu risc scăzut.

- Think High: Analiză logică deliberată, mai lentă, dar foarte precisă pentru rezolvarea problemelor complexe.

- Think Max: Împinge capacitățile de raționare la maximum pentru a explora limita capabilităților modelului.

Capabilități agentice îmbunătățite

DeepSeek V4 este, aparent, optimizat pentru programare agentică. Notițele de lansare afirmă că se integrează fără probleme cu agenți IA de top precum Claude Code, OpenClaw și OpenCode și că deja alimentează infrastructura internă de programare agentică a DeepSeek.

Optimizări avansate de antrenare

Sub capotă, DeepSeek a introdus Manifold-Constrained Hyper-Connections (mHC) pentru a întări conexiunile reziduale și a stabiliza propagarea semnalului. De asemenea, au trecut la optimizatorul Muon pentru convergență mai rapidă și stabilitate mai mare a antrenării, preantrenând modelele pe peste 32 de trilioane de tokeni diverși.

Benchmarkurile DeepSeek V4

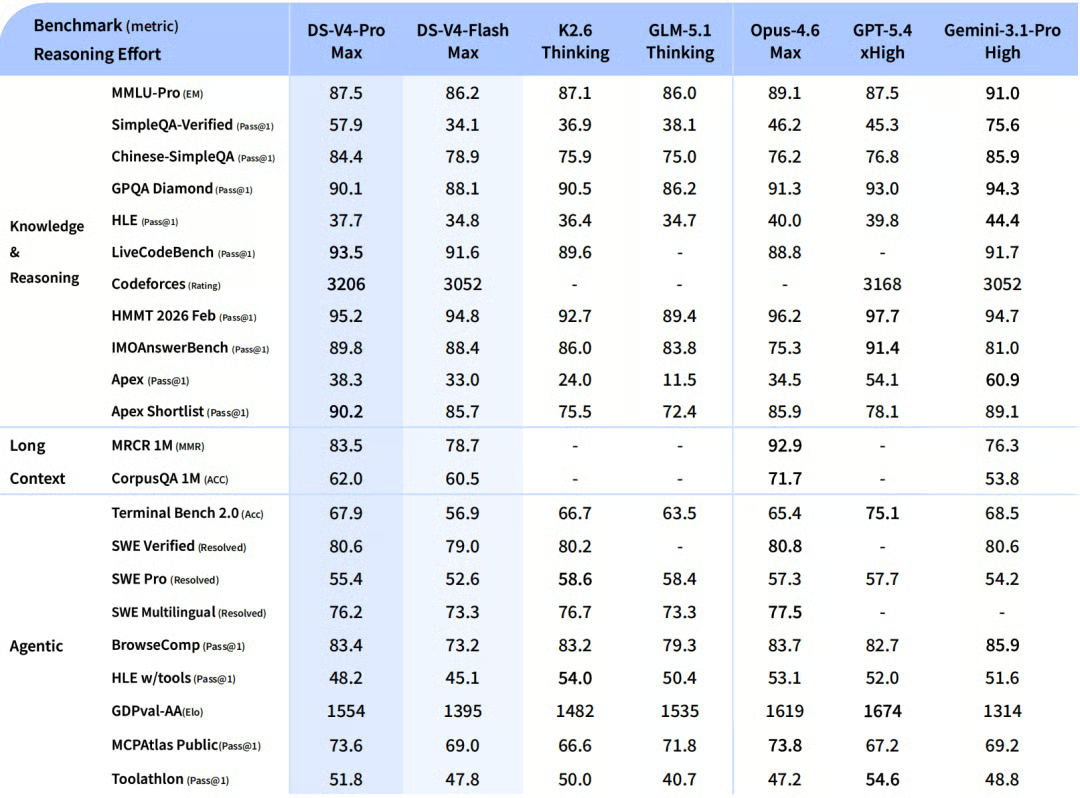

Potrivit rezultatelor interne ale DeepSeek, DeepSeek V4 demonstrează performanțe impresionante, în special când este împins la limitele sale maxime de raționare (DeepSeek-V4-Pro-Max).

Conform notelor oficiale de lansare, iată cum se poziționează modelul în raport cu restul industriei:

Cunoștințe și raționare

Pro-Max depășește cu ușurință alte modele open-source și bate modele de frontieră mai vechi precum GPT-5.2. Obține un 87,5% la MMLU-Pro și 90,1% la GPQA Diamond, alături de un impresionant 92,6% la GSM8K pentru matematică. Deși încă rămâne la câteva luni în urma vârfului absolut (GPT-5.4 și Gemini-3.1-Pro), a redus semnificativ decalajul de cunoștințe.

Sarcini agentice

Pro-Max este la nivel cu modelele deschise de top, atingând 67,9% la Terminal Bench 2.0 și 55,4% la SWE-Bench Pro. Deși este ușor sub cele mai noi modele închise pe leaderboarduri publice, testele interne arată că îl depășește pe Claude Sonnet 4.5 și se apropie de nivelurile Opus 4.5.

Context lung

Fereastra de 1 milion de tokeni nu este doar de formă. Pro-Max oferă rezultate extrem de solide aici, obținând 83,5% la testele MRCR 1M (MMR) de regăsire „acul în carul cu fân”. Acest scor depășește de fapt Gemini-3.1-Pro pe benchmarkurile academice de context lung.

DeepSeek V4 Pro vs Flash

Din cauza dimensiunii mai mici, Flash-Max obține, în mod natural, scoruri mai reduse la cunoaștere pură și are dificultăți cu cele mai complexe fluxuri de lucru agentice. Totuși, dacă îi alocați un „buget de gândire” mai mare, obține scoruri de raționare comparabile cu modelele de frontieră mai vechi, devenind o opțiune extrem de eficientă din punct de vedere al costurilor pentru sarcini voluminoase.

Cum pot accesa DeepSeek V4?

Există mai multe modalități de a accesa DeepSeek V4 chiar acum:

- Interfață web: Puteți testa ambele modele imediat pe chat.deepseek.com, prin modul Instant sau Expert.

- Acces API: API-ul este disponibil astăzi. Dezvoltatorii trebuie doar să actualizeze parametrul modelului la

deepseek-v4-prosaudeepseek-v4-flash. API-ul menține compatibilitatea atât cu formatele OpenAI ChatCompletions, cât și cu cele Anthropic. (Notă: modelele vechideepseek-chatșideepseek-reasonervor fi retrase pe 24 iulie 2026). - Greutăți deschise: Ambele modele sunt lansate sub licența MIT. Puteți descărca greutățile direct de pe Hugging Face sau ModelScope. Pro are un pachet de 865 GB, în timp ce Flash este mult mai gestionabil, de 160 GB.

DeepSeek V4 vs concurenți

În ultima săptămână, am văzut lansarea GPT-5.5 de la OpenAI și Claude Opus 4.7 de la Anthropic. Deși aceste modele oferă capabilități de top, în special în raționarea pe context lung și programarea agentică, DeepSeek V4 concurează puternic prin valoare și accesibilitate deschisă.

Iată cum se compară DeepSeek-V4-Pro cu noile modele fanion de la OpenAI și Anthropic:

|

Caracteristică/Benchmark |

DeepSeek V4 Pro |

GPT-5.5 |

Claude Opus 4.7 |

|

Preț API (Input / Output per 1M) |

1,74 $ / 3,48 $ |

5,00 $ / 30,00 $ |

5,00 $ / 25,00 $ |

|

Fereastră de context |

1M tokeni |

~1M tokeni |

~1M tokeni |

|

SWE-bench Pro (Programare) |

55,4% |

58,6% |

64,3% |

|

Terminal-Bench 2.0 (Agentic) |

67,9% |

82,7% |

69,4% |

|

Greutăți deschise |

Da (licență MIT) |

Nu (închis) |

Nu (închis) |

Notă: Pentru utilizatorii care prioritizează bugetul, DeepSeek V4 Flash costă doar 0,14 $ per 1M tokeni de input și 0,28 $ per 1M tokeni de output, sub nivelul chiar și al modelelor mici precum GPT-5.4 Nano.

Cât de bun este DeepSeek V4?

DeepSeek V4 este o lansare extrem de disruptivă. Potrivit benchmarkurilor auto-raportate de DeepSeek, modelul Pro este cu doar 3 până la 6 luni în urma modelelor de frontieră de ultimă generație (precum GPT-5.4 și Gemini-3.1-Pro) în traiectoria de dezvoltare.

Totuși, în contextul mai larg al industriei, performanța brută este doar jumătate din poveste. Titlul principal al DeepSeek V4 constă în eficiența extrem de ridicată pentru context și prețurile foarte scăzute.

Oferind capabilități aproape de frontieră, inclusiv o fereastră de context de 1M tokeni, la o fracțiune din costul GPT-5.5 sau Opus 4.7, DeepSeek V4 devine cea mai convingătoare opțiune pentru sarcini enterprise de volum mare, cercetători open-source și dezvoltatori atenți la buget.

Cazuri de utilizare DeepSeek V4

Ținând cont de aceste puncte forte, iată câteva zone în care văd că V4 excelează:

- Inginerie software automatizată: Benchmarkurile agentice solide și integrarea cu instrumente precum OpenClaw fac din V4-Pro un candidat robust pentru refactorizarea autonomă a bazelor de cod și depanare.

- Procesare de documente la volum mare: Costurile reduse pentru calculul în context de 1M tokeni înseamnă că analiștii financiari și echipele juridice pot procesa munți de PDF-uri, formulare 10-K și contracte cu costuri minime.

- Implementare locală și cercetare: Deoarece folosește o licență MIT, cercetătorii pot rula cuantizare (în special pe modelul Flash de 160 GB) pentru a experimenta local, pe hardware de consum de înaltă performanță, cu IA la nivel de frontieră.

Concluzii

DeepSeek V4 reprezintă un pas uriaș înainte pentru comunitatea IA open-source. Deși GPT-5.5 și Claude Opus 4.7 îl pot depăși la cele mai dificile benchmarkuri de programare și raționare, DeepSeek V4 democratizează accesul la ferestre de context de 1 milion de tokeni și la fluxuri de lucru agentice complexe.

Dacă doriți să fiți cu un pas înainte și să învățați cum să implementați aceste modele de ultimă generație în propriile fluxuri de lucru, vă recomandăm să consultați câteva dintre resursele noastre. În special, cursul Understanding Prompt Engineering pentru a vă rafina modul în care comunicați cu modele precum DeepSeek, sau traseul de competențe AI Agent Fundamentals, dacă doriți să începeți să construiți sisteme agentice scalabile.

Întrebări frecvente despre DeepSeek V4

DeepSeek V4 este open-source?

Da. Atât DeepSeek-V4-Pro, cât și DeepSeek-V4-Flash sunt modele cu greutăți deschise, lansate sub licența MIT, foarte permisivă. Acest lucru le permite dezvoltatorilor și cercetătorilor să utilizeze, să modifice și să implementeze comercial modelele.

Care este fereastra de context pentru DeepSeek V4?

Atât modelele Pro, cât și Flash au, în mod implicit, o fereastră de context de 1 milion de tokeni. Datorită noii sale arhitecturi de atenție hibride, DeepSeek V4 gestionează acest context uriaș cu o fracțiune din costurile de calcul și memorie ale modelelor mai vechi.

Cât costă API-ul DeepSeek V4?

Prețurile sunt extrem de competitive. DeepSeek-V4-Flash costă doar 0,14 $ per 1M tokeni de input și 0,28 $ per 1M tokeni de output. DeepSeek-V4-Pro costă 1,74 $ per 1M tokeni de input și 3,48 $ per 1M tokeni de output.

Cât de mari sunt modelele DeepSeek V4?

DeepSeek folosește o arhitectură Mixture of Experts (MoE). Modelul Pro conține 1,6 trilioane de parametri în total (49 de miliarde activi) și necesită un download de 865 GB. Modelul Flash conține 284 de miliarde de parametri (13 miliarde activi) și necesită un download de 160 GB.

Depășește DeepSeek V4 modelele GPT-5.5 și Claude Opus 4.7?

La nivel de capabilități pure, nu. Datele auto-raportate ale DeepSeek sugerează că modelul V4-Pro este cu aproximativ 3 până la 6 luni în urma modelelor închise de ultimă generație la cele mai dificile benchmarkuri de programare și raționare. Totuși, oferă performanță aproape de frontieră la circa o treime din costul API-ului, ceea ce îl face extrem de disruptiv.