tracks

수개월간의 소문과 새 GPT-5.5, Claude Opus 4.7 발표 직후, DeepSeek이 마침내 DeepSeek V4를 공개했습니다. 이번 출시에는 두 가지 프리뷰 모델인 V4-Pro와 V4-Flash가 포함되며, 공격적인 가격과 최전선에 가까운 성능으로 시장에 등장했습니다.

DeepSeek V4-Pro는 기본적으로 1600억억(1.6 trillion) 총 파라미터와 100만 토큰 컨텍스트 윈도우를 제공합니다. DeepSeek은 이 모델이 폐쇄형 최첨단 모델과의 격차가 3~6개월에 불과하면서 OpenAI나 Anthropic 같은 경쟁사 대비 비용은 극히 낮다고 주장합니다.

이 글에서는 DeepSeek V4 출시 내용을 정리하며 핵심 기능, 벤치마크 성능, 경쟁 제품과의 비교를 살펴봅니다. 또한 GPT-5.5와 Claude Opus 4.7 가이드도 참고하세요. 자세한 비교는 DeepSeek V4 vs GPT-5.5, Claude Opus 4.7 vs DeepSeek V4, DeepSeek V4 Flash vs GPT-5.4 mini and nano를 읽어보세요.

한눈에 보는 DeepSeek V4

- V4는 두 가지 버전으로 제공됩니다: Pro(1.6T 파라미터)와 Flash(284B 파라미터).

- 두 모델 모두 기본 100만 토큰 컨텍스트 윈도우를 제공합니다.

- Pro는 백만 토큰당 입력 $1.74 / 출력 $3.48로, GPT-5.5와 Opus 4.7 대비 압도적으로 저렴합니다.

- API, 웹 인터페이스, 오픈 웨이트(MIT 라이선스)로 이용 가능합니다.

DeepSeek V4란?

DeepSeek V4는 중국 AI 연구소 DeepSeek이 선보인 오픈 웨이트 대규모 언어 모델 시리즈의 신작입니다. 2026년 4월 24일 출시된 V4 시리즈는 DeepSeek-V4-Pro와 DeepSeek-V4-Flash 두 버전으로 제공됩니다. 두 모델 모두 a Mixture of Experts (MoE) a키텍처를 사용하며 기본적으로 100만 토큰의 거대한 컨텍스트 윈도우를 제공합니다.

DeepSeek V4가 업계에서 큰 의미를 갖는 이유는 최전선에 근접한 성능과 매우 경쟁력 있는 가격을 결합했기 때문입니다. V4-Pro 모델은 총 1.6조 파라미터(활성 490억)를 갖추고 있어 현재 이용 가능한 오픈 웨이트 모델 중 가장 큽니다.

이처럼 대형 모델임에도 불구하고, DeepSeek은 OpenAI나 Anthropic 같은 경쟁사 대비 비용은 극히 낮으면서 폐쇄형 최첨단 모델과의 격차가 3~6개월에 불과하다고 주장합니다.

DeepSeek V4의 핵심 기능

최신 릴리스의 두드러진 기능을 살펴보겠습니다.

구조적 혁신과 100만 토큰 컨텍스트 효율

DeepSeek V4의 가장 큰 특징은 긴 컨텍스트를 매우 효율적으로 처리한다는 점입니다.

기술 노트에 따르면, V4 시리즈는 Compressed Sparse Attention(CSA)과 Heavily Compressed Attention(HCA)을 결합한 하이브리드 어텐션 아키텍처를 사용합니다.

이러한 구조적 변화로 인해, DeepSeek의 모든 서비스에서 100만 토큰 컨텍스트가 표준이 되었습니다.

DeepSeek은 100만 토큰 컨텍스트 환경에서 DeepSeek-V4-Pro가 단일 토큰 추론 FLOPs의 27%와 KV 캐시의 10%만을 사용한다고, 전작인 DeepSeek-V3.2와 비교해 주장합니다.

세 가지 추론 노력 모드

지연 시간과 성능을 세밀하게 제어할 수 있도록, DeepSeek V4는 세 가지 추론 모드를 제공합니다:

- Non-think: 일상적인 작업과 저위험 의사결정을 위한 빠르고 직관적인 응답.

- Think High: 복잡한 문제 해결에 적합한 느리지만 매우 정확한 의식적 논리 분석.

- Think Max: 모델의 한계를 탐색하기 위해 추론 능력을 최대치로 끌어올립니다.

강화된 에이전트 기능

DeepSeek V4는 에이전트 기반 코딩에 최적화된 것으로 보입니다. 릴리스 노트에 따르면 Claude Code, OpenClaw, OpenCode 같은 대표적인 AI 에이전트와 무리 없이 통합되며, 이미 DeepSeek의 사내 에이전트 기반 코딩 인프라를 구동하고 있습니다.

고급 학습 최적화

내부적으로 DeepSeek은 잔차 연결을 강화하고 신호 전달을 안정화하기 위해 Manifold-Constrained Hyper-Connections(mHC)를 도입했습니다. 또한 더 빠른 수렴과 높은 학습 안정성을 위해 Muon Optimizer로 전환했으며, 32조 개가 넘는 다양한 토큰으로 사전 학습을 진행했습니다.

DeepSeek V4 벤치마크

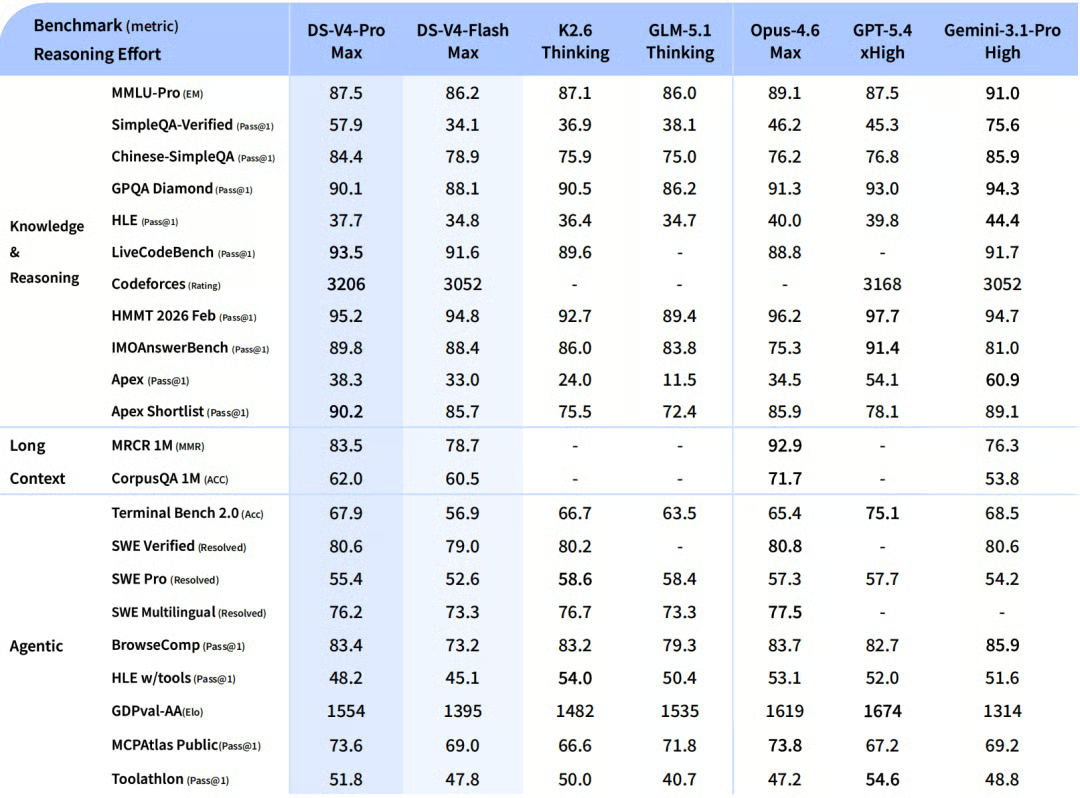

DeepSeek의 내부 결과에 따르면, DeepSeek V4는 특히 최대 추론 한계(DeepSeek-V4-Pro-Max)에서 강력한 성능을 보여줍니다.

공식 릴리스 노트에 따르면, 업계 전반과 비교한 성능은 다음과 같습니다:

지식과 추론

Pro-Max는 다른 오픈소스 모델을 쉽게 앞지르며 GPT-5.2 같은 이전 세대 최전선 모델도 능가합니다. MMLU-Pro에서 87.5%, GPQA Diamond에서 90.1%, 수학 분야에서는 GSM8K에서 92.6%라는 매우 경쟁력 있는 점수를 기록합니다. 최첨단(예: GPT-5.4, Gemini-3.1-Pro)과는 아직 몇 달의 차이가 있지만, 지식 격차를 크게 좁혔습니다.

에이전트 작업

Pro-Max는 선도적인 오픈 모델과 비슷한 수준으로, Terminal Bench 2.0에서 67.9%, SWE-Bench Pro에서 55.4%를 기록합니다. 공개 리더보드에서는 최신 폐쇄형 모델에 다소 못 미치지만, 내부 테스트에서는 Claude Sonnet 4.5를 능가하고 Opus 4.5 수준에 근접한다고 합니다.

긴 컨텍스트

100만 토큰 윈도우는 보여주기용이 아닙니다. Pro-Max는 이 영역에서 MRCR 1M(MMR) 건초 더미에서 바늘 찾기 검색 테스트에서 83.5%를 기록하는 등 매우 강력한 결과를 보여줍니다. 이는 학술적 장문 컨텍스트 벤치마크에서 Gemini-3.1-Pro를 실제로 상회합니다.

DeepSeek V4 Pro vs Flash

더 작은 규모 때문에 Flash-Max는 순수 지식 점수가 낮고 가장 복잡한 에이전트 워크플로에서는 어려움을 겪습니다. 그러나 더 큰 "사고 예산"을 부여하면 과거의 최전선 모델에 필적하는 추론 점수를 달성하여, 대규모 워크로드에 매우 비용 효율적인 선택지가 됩니다.

DeepSeek V4는 어떻게 사용하나요?

현재 DeepSeek V4에 접근하는 방법은 여러 가지입니다:

- 웹 인터페이스: chat.deepseek.com에서 즉시 두 모델을 체험할 수 있습니다. Instant Mode 또는 Expert Mode를 이용하세요.

- API 액세스: API는 오늘부터 사용할 수 있습니다. 개발자는 모델 파라미터를

deepseek-v4-pro또는deepseek-v4-flash로 업데이트하면 됩니다. API는 OpenAI ChatCompletions와 Anthropic API 포맷과의 호환성을 유지합니다. (참고: 기존deepseek-chat및deepseek-reasoner모델은 2026년 7월 24일에 지원 종료됩니다). - 오픈 웨이트: 두 모델 모두 MIT 라이선스로 공개됩니다. Hugging Face 또는 ModelScope에서 웨이트를 바로 다운로드할 수 있습니다. Pro는 865GB, Flash는 훨씬 관리하기 쉬운 160GB입니다.

DeepSeek V4와 경쟁사 비교

지난 한 주 동안 OpenAI의 GPT-5.5와 Anthropic의 Claude Opus 4.7이 출시되었습니다. 이들 모델은 특히 장문 컨텍스트 추론과 에이전트 기반 코딩에서 최고 수준의 역량을 자랑하지만, DeepSeek V4는 가치와 개방성 측면에서 강력히 경쟁합니다.

다음은 DeepSeek-V4-Pro를 OpenAI와 Anthropic의 최신 플래그십 모델과 비교한 내용입니다:

|

기능/벤치마크 |

DeepSeek V4 Pro |

GPT-5.5 |

Claude Opus 4.7 |

|

API 가격(백만 토큰당 입력 / 출력) |

$1.74 / $3.48 |

$5.00 / $30.00 |

$5.00 / $25.00 |

|

컨텍스트 윈도우 |

100만 토큰 |

~100만 토큰 |

~100만 토큰 |

|

SWE-bench Pro(코딩) |

55.4% |

58.6% |

64.3% |

|

Terminal-Bench 2.0(에이전트) |

67.9% |

82.7% |

69.4% |

|

오픈 웨이트 |

예(MIT 라이선스) |

아니요(비공개) |

아니요(비공개) |

참고: 예산을 최우선으로 하는 사용자라면, DeepSeek V4 Flash는 백만 입력 토큰당 $0.14, 백만 출력 토큰당 $0.28에 불과해 GPT-5.4 Nano 같은 소형 모델보다도 저렴합니다.

DeepSeek V4는 얼마나 좋은가요?

DeepSeek V4는 매우 파괴적인 출시작입니다. DeepSeek의 자체 보고 벤치마크에 따르면 Pro 모델은 개발 궤적상 최전선 모델(GPT-5.4, Gemini-3.1-Pro 등)에 비해 3~6개월 정도 뒤처질 뿐입니다.

다만 업계 전반을 보면, 순수 성능이 전부는 아닙니다. DeepSeek V4의 핵심 가치는 초고효율 컨텍스트 처리와 매우 낮은 가격에 있습니다.

GPT-5.5나 Opus 4.7 대비 극히 낮은 비용으로 100만 토큰 컨텍스트 윈도우를 포함한 최전선에 가까운 역량을 제공한다는 점에서, DeepSeek V4는 대규모 엔터프라이즈 작업, 오픈소스 연구자, 예산을 중시하는 개발자에게 가장 매력적인 선택지입니다.

DeepSeek V4 활용 사례

이러한 강점을 바탕으로, V4가 특히 뛰어날 것으로 보이는 영역은 다음과 같습니다:

- 자동화된 소프트웨어 엔지니어링: 강력한 에이전트 벤치마크와 OpenClaw 같은 도구와의 통합으로, V4-Pro는 자율 코드베이스 리팩터링과 디버깅에 유력한 후보입니다.

- 대량 문서 처리: 100만 토큰 컨텍스트 계산 비용 절감으로 금융 애널리스트와 법무 팀이 PDF, 10-K, 계약서를 매우 낮은 비용으로 대량 처리할 수 있습니다.

- 로컬 배포 및 연구: MIT 라이선스를 사용하므로, 연구자는(특히 160GB Flash 모델에서) 양자화를 통해 고급 소비자 하드웨어에서도 최전선 수준의 AI를 로컬로 실험할 수 있습니다.

마무리

DeepSeek V4는 오픈소스 AI 커뮤니티에 큰 도약을 가져옵니다. GPT-5.5와 Claude Opus 4.7이 가장 어려운 코딩 및 추론 벤치마크에서 근소하게 앞설 수 있지만, DeepSeek V4는 100만 토큰 컨텍스트 윈도우와 복잡한 에이전트 워크플로에 대한 접근을 민주화합니다.

최신 모델을 워크플로에 적용하며 한발 앞서고 싶다면, 우리의 리소스를 확인해 보세요. 특히 Understanding Prompt Engineering 과정을 통해 DeepSeek 같은 모델과의 소통 방식을 다듬거나, 확장 가능한 에이전트 시스템 구축을 시작하려면 AI Agent Fundamentals skill track을 추천합니다.

DeepSeek V4 자주 묻는 질문(FAQ)

DeepSeek V4는 오픈 소스인가요?

예. DeepSeek-V4-Pro와 DeepSeek-V4-Flash는 모두 매우 관대한 MIT 라이선스로 공개된 오픈 웨이트 모델입니다. 이를 통해 개발자와 연구자는 모델을 상업적으로 사용, 수정, 배포할 수 있습니다.

DeepSeek V4의 컨텍스트 윈도우는 어느 정도인가요?

Pro와 Flash 모델 모두 기본 100만 토큰 컨텍스트 윈도우를 제공합니다. 새로운 하이브리드 어텐션 아키텍처 덕분에 DeepSeek V4는 이전 모델 대비 훨씬 적은 연산 및 메모리 비용으로 이 방대한 컨텍스트를 처리합니다.

DeepSeek V4 API 가격은 얼마인가요?

가격은 매우 경쟁력 있습니다. DeepSeek-V4-Flash는 백만 입력 토큰당 $0.14, 백만 출력 토큰당 $0.28에 불과합니다. DeepSeek-V4-Pro는 백만 입력 토큰당 $1.74, 백만 출력 토큰당 $3.48입니다.

DeepSeek V4 모델의 크기는 어느 정도인가요?

DeepSeek은 Mixture of Experts(MoE) 아키텍처를 사용합니다. Pro 모델은 총 1.6조 파라미터(활성 490억)를 포함하며, 865GB를 다운로드해야 합니다. Flash 모델은 2840억 파라미터(활성 130억)를 포함하며, 160GB 다운로드가 필요합니다.

DeepSeek V4가 GPT-5.5와 Claude Opus 4.7을 능가하나요?

순수한 역량 측면에서는 아닙니다. DeepSeek의 자체 데이터에 따르면 V4-Pro 모델은 가장 어려운 코딩과 추론 벤치마크에서 최첨단 폐쇄형 모델에 약 3~6개월 뒤처집니다. 그러나 API 비용은 약 3분의 1 수준으로, 최전선에 가까운 성능을 제공해 매우 파괴적입니다.