track

Efter månader av rykten, och tätt inpå lanseringen av nya GPT-5.5 och Claude Opus 4.7, har DeepSeek äntligen släppt DeepSeek V4. Lanseringen kommer i form av två förhandsmodeller, V4-Pro och V4-Flash, som når marknaden med aggressiv prissättning och prestanda nära absoluta framkanten.

DeepSeek V4-Pro stoltserar med totalt 1,6 biljoner parametrar och ett kontextfönster på 1 miljon token som standard. DeepSeek hävdar att modellen ligger bara 3 till 6 månader efter de mest avancerade slutna modellerna, samtidigt som den kostar en bråkdel av konkurrenter som OpenAI och Anthropic.

I den här artikeln går jag igenom lanseringen av DeepSeek V4, med fokus på dess viktigaste funktioner, benchmarkprestanda och hur den står sig mot konkurrensen. Du kan också se våra guider till GPT-5.5 och Claude Opus 4.7. För en detaljerad jämförelse, läs våra artiklar om DeepSeek V4 vs GPT-5.5, Claude Opus 4.7 vs DeepSeek V4 och DeepSeek V4 Flash vs GPT-5.4 mini och nano.

DeepSeek V4 i korthet

- V4 finns i två varianter: Pro (1,6T parametrar) och Flash (284B parametrar).

- Båda modellerna har ett kontextfönster på 1 miljon token som standard.

- Pro kostar $1,74 indata / $3,48 utdata per miljon token och pressar priserna långt under GPT-5.5 och Opus 4.7.

- Tillgänglig via API, webbgränssnitt och öppna vikter (MIT-licens).

Vad är DeepSeek V4?

DeepSeek V4 är den efterlängtade nya serien av språkmodeller med öppna vikter från den kinesiska AI-labbet DeepSeek. Serien släpptes den 24 april 2026 och finns i två versioner: DeepSeek-V4-Pro och DeepSeek-V4-Flash. Båda modellerna använder en Mixture of Experts (MoE)-arkitektur och erbjuder ett massivt kontextfönster på 1 miljon token som standard.

Det som gör DeepSeek V4 till en stor händelse i branschen är kombinationen av prestanda nära framkanten och superkonkurrenskraftig prissättning. Modellen V4-Pro har totalt 1,6 biljoner parametrar (49 miljarder aktiva), vilket gör den till den största modellen med öppna vikter som finns tillgänglig just nu.

Trots sin storlek hävdar DeepSeek att den bara ligger 3 till 6 månader efter de mest avancerade slutna modellerna, samtidigt som den kostar en bråkdel av priset jämfört med konkurrenter som OpenAI och Anthropic.

Nyckelfunktioner i DeepSeek V4

Låt oss titta på några av höjdpunkterna i den senaste releasen:

Strukturell innovation och effektivitet i 1M-kontext

Den mest utmärkande egenskapen hos DeepSeek V4 är dess mycket effektiva hantering av långa kontexter.

Enligt de tekniska anteckningarna använder V4-serien en Hybrid Attention-arkitektur som kombinerar Compressed Sparse Attention (CSA) och Heavily Compressed Attention (HCA).

Tack vare dessa strukturella förändringar är ett kontextfönster på 1 miljon token nu standard i alla DeepSeek-tjänster.

DeepSeek hävdar att, i ett 1M-token-kontextscenario, kräver DeepSeek-V4-Pro endast 27% av FLOPs för inferens per enstaka token och bara 10% av KV-cachen jämfört med föregångaren DeepSeek-V3.2.

Tre lägen för resonemangsinsats

För att ge användarna finmaskig kontroll över latens och prestanda innehåller DeepSeek V4 tre resonemangslägen:

- Non-think: Snabba, intuitiva svar för rutinuppgifter och låg-riskbeslut.

- Think High: Medveten logisk analys som är långsammare men mycket exakt för komplex problemlösning.

- Think Max: Pressar resonemangsförmågan till sitt yttersta för att utforska modellens gränser.

Förbättrade agentiska förmågor

DeepSeek V4 är uppenbarligen optimerad för agentiskt kodande. Versionsnoterna hävdar att den integreras sömlöst med ledande AI-agenter som Claude Code, OpenClaw och OpenCode, och att den redan driver DeepSeeks egna agentiska kodinfrastruktur.

Avancerade träningsoptimeringar

Under huven har DeepSeek introducerat Manifold-Constrained Hyper-Connections (mHC) för att stärka residualkopplingar och stabilisera signalpropagering. De bytte också till Muon Optimizer för snabbare konvergens och högre träningsstabilitet, och förtränade modellerna på över 32 biljoner varierade token.

DeepSeek V4-benchmark

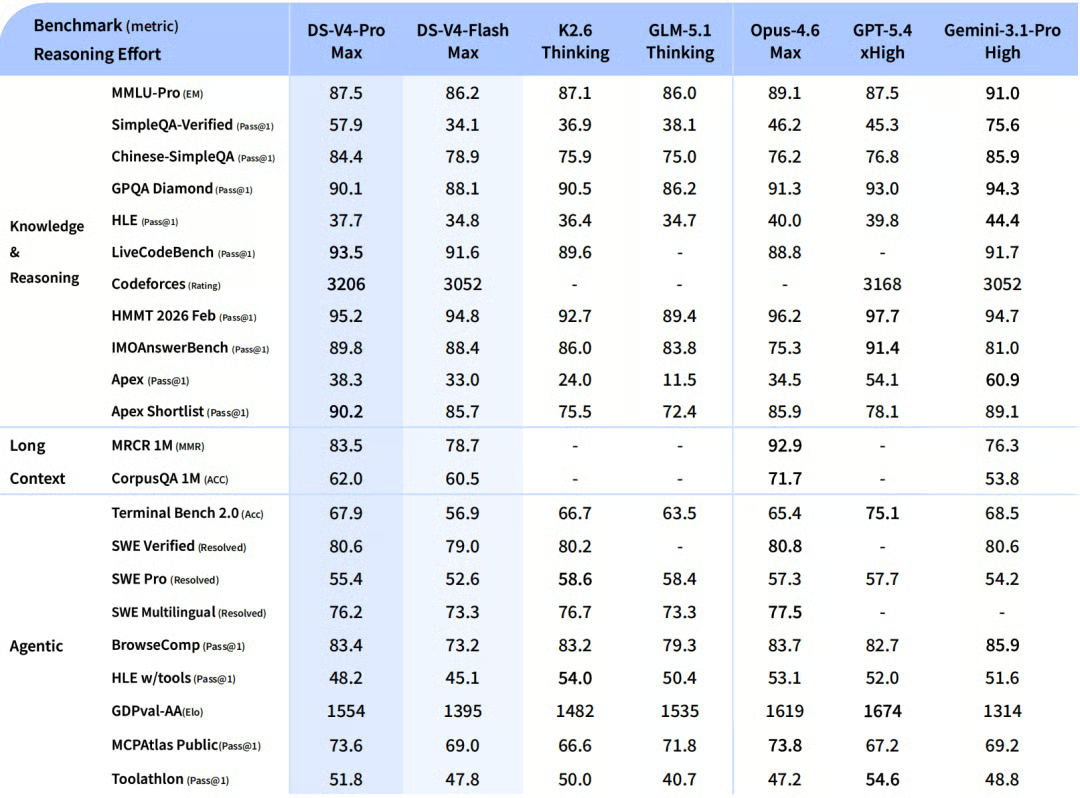

Enligt DeepSeeks interna resultat visar DeepSeek V4 imponerande prestanda, särskilt när den pressas till sina maximala resonemangsgränser (DeepSeek-V4-Pro-Max).

Enligt de officiella versionsnoterna står sig modellen så här mot resten av branschen:

Kunskap och resonemang

Pro-Max överträffar enkelt andra öppna modeller och slår äldre framkantmodeller som GPT-5.2. Den når mycket konkurrenskraftiga 87,5% på MMLU-Pro och 90,1% på GPQA Diamond, samt hela 92,6% på GSM8K för matematik. Även om den fortfarande ligger några månader efter den absoluta framkanten (GPT-5.4 och Gemini-3.1-Pro) har den markant minskat kunskapsgapet.

Agentiska uppgifter

Pro-Max är i nivå med ledande öppna modeller och når 67,9% på Terminal Bench 2.0 och 55,4% på SWE-Bench Pro. Även om den ligger något efter de senaste slutna modellerna på publika topplistor visar interna tester att den slår Claude Sonnet 4.5 och närmar sig Opus 4.5-nivåer.

Lång kontext

Fönstret på 1 miljon token är inte bara för syns skull. Pro-Max levererar mycket starka resultat här med 83,5% på MRCR 1M (MMR) "nålen i en höstack"-söktester. Detta överträffar faktiskt Gemini-3.1-Pro på akademiska långkontext-benchmark.

DeepSeek V4 Pro vs Flash

På grund av sin mindre storlek får Flash-Max naturligt lägre poäng på ren kunskap och har det tufft med de mest komplexa agentarbetsflödena. Men om du ger den en större "tänkarbudget" uppnår den resonemangspoäng jämförbara med äldre framkantmodeller, vilket gör den till ett otroligt kostnadseffektivt alternativ för tunga arbetslaster.

Hur får jag tillgång till DeepSeek V4?

Det finns flera sätt att få tillgång till DeepSeek V4 redan nu:

- Webbgränssnitt: Du kan testa båda modellerna direkt på chat.deepseek.com via Instant Mode eller Expert Mode.

- API-åtkomst: API:et är tillgängligt idag. Utvecklare behöver bara uppdatera sin model-parameter till

deepseek-v4-proellerdeepseek-v4-flash. API:et behåller kompatibilitet med både OpenAI ChatCompletions och Anthropic API-format. (Observera: äldre modellernadeepseek-chatochdeepseek-reasoneravvecklas den 24 juli 2026). - Öppna vikter: Båda modellerna släpps under MIT-licens. Du kan ladda ner vikterna direkt från Hugging Face eller ModelScope. Pro är en nedladdning på 865 GB, medan Flash är betydligt mer hanterliga 160 GB.

DeepSeek V4 jämfört med konkurrenter

Under den senaste veckan har vi sett lanseringen av OpenAI:s GPT-5.5 och Anthropics Claude Opus 4.7. Även om dessa modeller erbjuder topprestanda, särskilt i långkontextresonemang och agentiskt kodande, konkurrerar DeepSeek V4 hårt på värde och öppen tillgänglighet.

Så här står sig DeepSeek-V4-Pro mot de nya flaggskeppsmodellerna från OpenAI och Anthropic:

|

Funktion/Benchmark |

DeepSeek V4 Pro |

GPT-5.5 |

Claude Opus 4.7 |

|

API-prissättning (In/Ut per 1M) |

$1,74 / $3,48 |

$5,00 / $30,00 |

$5,00 / $25,00 |

|

Kontextfönster |

1M token |

~1M token |

~1M token |

|

SWE-bench Pro (Kodning) |

55,4% |

58,6% |

64,3% |

|

Terminal-Bench 2.0 (Agentiskt) |

67,9% |

82,7% |

69,4% |

|

Öppna vikter |

Ja (MIT-licens) |

Nej (Sluten) |

Nej (Sluten) |

Obs: För användare med fokus på budget kostar DeepSeek V4 Flash bara $0,14 per 1M indata-token och $0,28 per 1M utdata-token, billigare än till och med små modeller som GPT-5.4 Nano.

Hur bra är DeepSeek V4?

DeepSeek V4 är en oerhört omvälvande lansering. Enligt DeepSeeks egna benchmarkdata ligger Pro-modellen 3 till 6 månader efter de mest avancerade framkantmodellerna (som GPT-5.4 och Gemini-3.1-Pro) i utvecklingstakt.

Ser vi till branschen i stort är dock ren prestanda bara halva historien. Den stora nyheten med DeepSeek V4 är dess extremt höga kontexteffektivitet och mycket låga pris.

Att leverera kapabiliteter nära framkanten, inklusive ett kontextfönster på 1M token, till en bråkdel av kostnaden för GPT-5.5 eller Opus 4.7 gör DeepSeek V4 till det mest övertygande alternativet för högvolymsuppgifter i företag, open source-forskare och utvecklare med begränsad budget.

Användningsfall för DeepSeek V4

Med dessa styrkor i åtanke finns det några områden där jag ser att V4 verkligen glänser:

- Automatiserad mjukvaruutveckling: Starka agentiska benchmark och integration med verktyg som OpenClaw gör V4-Pro till en bra kandidat för autonom omstrukturering av kodbaser och felsökning.

- Dokumentbearbetning i stor skala: De lägre kostnaderna för beräkning i 1M-token-kontext innebär att finansanalytiker och juridiska team kan bearbeta berg av PDF:er, 10-K:er och avtal för småpengar.

- Lokal driftsättning och forskning: Eftersom den använder en MIT-licens kan forskare köra kvantisering (särskilt på 160GB-modellen Flash) för att experimentera med AI på framkantsnivå lokalt på kraftfull konsumenthårdvara.

Avslutande tankar

DeepSeek V4 är ett stort steg framåt för open source-AI-communityt. Även om GPT-5.5 och Claude Opus 4.7 kan gå segrande ur de absolut svåraste kodnings- och resonemangsbenchmarken, demokratiserar DeepSeek V4 tillgången till kontextfönster på 1 miljon token och komplexa agentiska arbetsflöden.

Om du vill ligga steget före och lära dig hur du implementerar dessa toppmoderna modeller i dina egna arbetsflöden rekommenderar jag att du kollar in några av våra resurser. Särskilt vår kurs Understanding Prompt Engineering för att finslipa hur du kommunicerar med modeller som DeepSeek, eller vårt AI Agent Fundamentals-kompetensspår om du vill börja bygga skalbara agentiska system.

DeepSeek V4 vanliga frågor

Är DeepSeek V4 open source?

Ja. Både DeepSeek-V4-Pro och DeepSeek-V4-Flash är modeller med öppna vikter som släppts under den mycket tillåtande MIT-licensen. Detta gör det möjligt för utvecklare och forskare att använda, modifiera och distribuera modellerna kommersiellt.

Vad är kontextfönstret för DeepSeek V4?

Både Pro- och Flash-modellerna har ett kontextfönster på 1 miljon token som standard. Tack vare sin nya Hybrid Attention-arkitektur hanterar DeepSeek V4 denna massiva kontext med en bråkdel av beräknings- och minneskostnaderna jämfört med äldre modeller.

Hur mycket kostar DeepSeek V4 API?

Prissättningen är mycket konkurrenskraftig. DeepSeek-V4-Flash kostar bara $0,14 per 1M indata-token och $0,28 per 1M utdata-token. DeepSeek-V4-Pro kostar $1,74 per 1M indata-token och $3,48 per 1M utdata-token.

Hur stora är DeepSeek V4-modellerna?

DeepSeek använder en Mixture of Experts (MoE)-arkitektur. Pro-modellen innehåller totalt 1,6 biljoner parametrar (49 miljarder aktiva) och kräver en nedladdning på 865 GB. Flash-modellen innehåller 284 miljarder parametrar (13 miljarder aktiva) och kräver en nedladdning på 160 GB.

Slår DeepSeek V4 GPT-5.5 och Claude Opus 4.7?

I ren kapacitet, nej. DeepSeeks egna data antyder att V4-Pro ligger cirka 3 till 6 månader efter de mest avancerade slutna modellerna på de svåraste kodnings- och resonemangsbenchmarket. Däremot levererar den prestanda nära framkanten till ungefär en tredjedel av API-kostnaden, vilket gör den mycket omvälvande.